Deepfake-baserte svindelaktiviteter i næringslivet har opplevd en enorm økning i løpet av de siste tolv månedene.

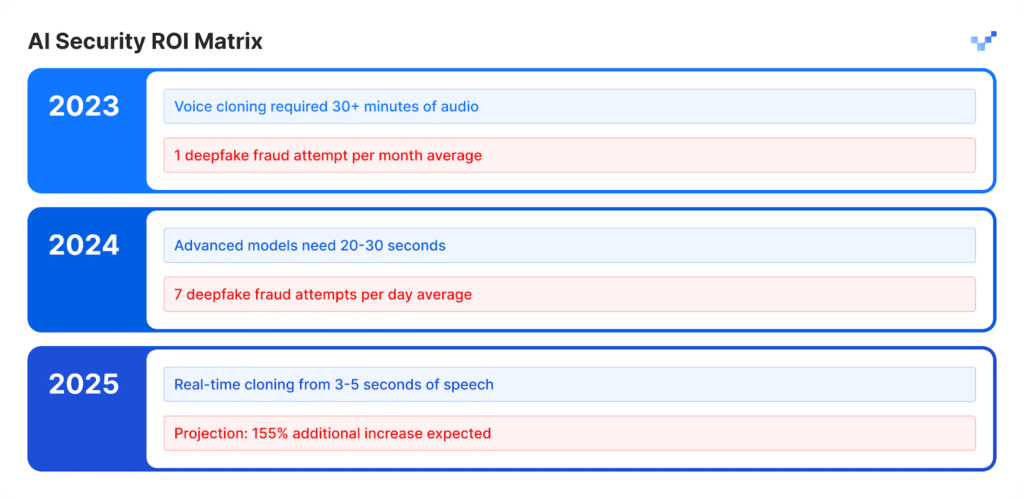

Den 2025 Voice Intelligence & Security-rapport fra Pindrop avslører at talebaserte angrep har økt til 1300% mer enn den tidligere månedlige forekomsten, fordi de nå forekommer syv ganger per dag.

Undersøkelsen av 1,2 milliarder kundesamtaler gjennom rapporten viser at denne utviklingen representerer mer enn vanlig vekst i nettkriminalitet, fordi den innebærer et fullstendig skifte i svindelmetoder.

Vekstmønsteret viser ingen tegn til å følge en gradvis utviklingsbane. Det raske tempoet i denne omveltningen har ført til en fullstendig omforming av tillitsbaserte økonomiske systemer.

Flere statistikker viser det fulle omfanget av denne krisen.

Identity Theft Resource Center registrerte en økning på 148% i antall svindelforsøk med etterligning i tidsrommet fra april 2024 til mars 2025.

Det totale svindeltapet i 2024 nådde $16,6 milliarder og viste en økning på 33% fra tallene for 2023.

Fremskritt innen AI-teknologi har gjort bedrag til en industriell virksomhet som driver sin virksomhet på et industrielt nivå.

Eksponering på ledernivå

Deepfake-angrep har vært rettet mot mer enn 25% av ledelsessystemer som håndterer både finans- og regnskapsoperasjoner.

Antallet ledere som spår at finansielle deepfake-angrep vil øke i løpet av det neste året, har nådd mer enn 50%.

Anatomien til et industrialisert angrep

Kloning av stemmer: Fra minutter til øyeblikk

AI-talemodeller har vist en eksepsjonell vekst i utviklingen i løpet av de siste årene.

Med grunnleggende gratisprogramvare kan brukerne lage syntetiske stemmer ved hjelp av korte stemmeopptak, noe som tidligere krevde omfattende lydmateriale og spesialiserte verktøy som det tok flere dager å fullføre.

Den kunstige taleproduksjonen tilsvarer den naturlige kvaliteten på menneskelig vokalisering.

Aldri bekymre deg for AI-svindel igjen. TruthScan Kan hjelpe deg:

- Oppdage AI generert bilder, tekst, tale og video.

- Unngå stor AI-drevet svindel.

- Beskytt dine mest følsom virksomhetens eiendeler.

Innvirkning etter bransje:

- I forsikringssektoren økte antallet syntetiske taleangrep med 475% i løpet av denne perioden.

- Banknæringen registrerte en økning på 149% i talebaserte svindelaktiviteter.

- Kontaktsentrene vil oppleve anslagsvis $44,5 milliarder i potensielle svindeltap i løpet av de neste fem årene.

- Sikkerhetshendelser koster virksomheter i gjennomsnitt $600 000 per hendelse.

Svindelens nye ansikt: Sofistikert og polert

Svindlere bruker nå avanserte deepfake-angrep som overgår vanlige svindel-e-poster fordi angrepene har feilfri grammatikk og dukker opp på passende tidspunkter, samtidig som de ser ekstremt autentiske ut.

Disse angrepene går ut på å omgå både programmerte sikkerhetssystemer og menneskelige vurderingsprosesser.

Casestudie: WPP var nær ved å gå glipp av noe

De kriminelle forsøkte å gjennomføre et forseggjort svindelopplegg ved å opprette en falsk WhatsApp-konto under WPP CEO ved å kombinere en stemmeklon som etterlignet Mark Reads stemme med YouTube-videoavspilling for falske ansiktsuttrykk i Mark Reads navn, samtidig som de brukte innspilte videoer fra offentlige domener.

Angriperne gjennomførte angrepet gjennom Microsoft Teams og sendte overbevisende falske meldinger ved hjelp av imitasjonsmetoder og sosial manipuleringstaktikk for å skape en falsk følelse av at det hastet.

Angriperne nådde et punkt der de nesten lyktes med å nå målet sitt.

Overgripernes bedrag lyktes ikke fordi de introduserte små uoverensstemmelser i fortellingen sin, noe som fikk offeret til å sette spørsmålstegn ved historien deres.

Hendelsen beviste at avanserte AI-bedragsteknikker kan lure selv erfarne fagfolk på grunn av deres realistiske og intrikate natur.

Asia og Stillehavsregionen: Den globale hotspot

Asia-Stillehavsområdet har blitt det globale knutepunktet for AI-baserte svindelaktiviteter. Antallet AI-relaterte angrep i 2024 økte med 194% sammenlignet med 2023.

Hvorfor akkurat her? Den raske innføringen av digitale betalingsløsninger kombinert med utilstrekkelige systemer for beskyttelse mot svindel i regionen har gjort det til et perfekt miljø for angripere å operere i.

Regionale nøkkeldata:

- Det gjennomsnittlige økonomiske tapet fra hver hendelse beløper seg til $600 000.

- Gjenvinningen av stjålne midler ligger under 5% i alle tilfeller.

- Deepfake-relaterte økonomiske tap på mer enn $1 millioner påvirket mer enn 10% finansinstitusjoner.

Regionen er et viktig mål for AI-basert svindel fordi de ansatte jobber eksternt og stemmesynteseverktøyene er lett tilgjengelige.

Mer enn bare stemme: Svindel i flere sektorer er her

En 704%-økning i antall ansiktsbytteangrep

Ifølge iProov økte antallet face swap-angrep med 704% i løpet av 2023, mens svindel med mobil nettinjeksjon økte med 255%.

Det totale antallet svindelforsøk inkluderer nå 42,5% AI-genererte forsøk, som lykkes i 30% av tilfellene.

De rapporterte sikkerhetshendelsene viser en kontinuerlig utvikling av trusler som påvirker ulike systemer.

Sårbarhetsmatrisen for bedrifter

- Detaljhandelen opplevde en økning på 107% i svindelaktiviteter i løpet av 2024, og eksperter spår at svindelsakene vil dobles i 2025.

- Angriperne bruker deepfakes for å omgå ID-verifiseringssystemer som beskytter mot KYC-prosesser.

- Systemer med kunstig intelligens produserer kunstige ansiktsprofiler som klarer å lure ansiktsgjenkjenningssystemer.

- Angriperne bruker syntetisk innhold til å generere falske juridiske dokumenter og legitimasjon ved hjelp av dokumentforfalskningsmetoder.

Brad Pitt-saken: AI-aktivert psykologisk svindel

En fransk interiørarkitekt ble offer for en sofistikert AI-svindel da han overførte nesten $1 million kroner til svindlere i løpet av flere måneder.

Angrepsstrategien:

- Bedrageren tok først kontakt med offeret mens han utga seg for å være Brad Pitts mor.

- Deepfake-lyd og AI-genererte bilder bidro til å opprettholde illusjonen over tid.

- Falske legejournaler og dokumenter som så lovlige ut, gjorde opplegget mer troverdig.

- Multimedieinnholdet holdt den falske identiteten troverdig i flere måneder.

En person som ikke var ukjent med teknologi, ble offer for en enkel svindel.

Offeret opererte som en bedriftseier som ikke var klar over at han samhandlet med kunstig intelligens.

Hendelsen demonstrerer det avanserte nivået av bedrag som moderne deepfake-teknologi kan oppnå.

Oppdagelsesgapet: Hvorfor de fleste bedrifter er uforberedt

En bevissthetskrise på toppen

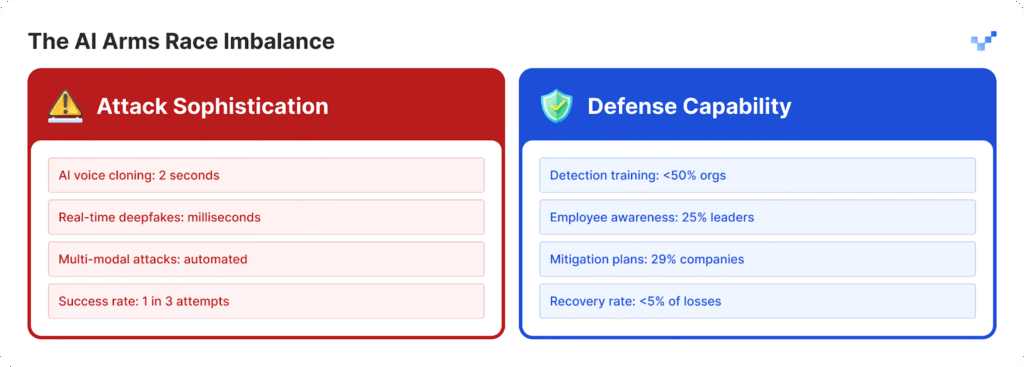

Organisasjoner sliter med å beskytte seg mot stadig flere angrep fordi de ikke har utviklet tilstrekkelige forsvarsstrategier.

- Ledere i 25% av organisasjonene viser begrenset forståelse for hvordan deepfake-teknologi fungerer.

- Organisasjoner sliter med å avgjøre om de er i stand til å oppdage deepfake-angrep, fordi 32% av dem fortsatt er usikre.

- Mer enn halvparten av organisasjonene gir ikke sine ansatte opplæring om AI-baserte trusler.

- De fleste organisasjoner har ikke etablerte planer eller spesifikke protokoller for å håndtere deepfake-trusler.

For organisasjoner som begynner å tette gapet i beredskapen, kan verktøy som TruthScan tilbyr et viktig første skritt.

TruthScan er utviklet for å oppdage AI-innhold i sanntid, og flagger mistenkelige bilder, tekst og medier på tvers av flere formater - og hjelper teamene med å oppdage syntetisk manipulasjon før den forårsaker skade.

Den menneskelige faktors sårbarhet

McAfee-undersøkelser viser at 70% av befolkningen klarer ikke å skille mellom autentiske stemmer og stemmekloner.

Problemet eskalerer fordi 40% av alle mennesker vil svare på en telefonsvarer når de tror den tilhører en de er glad i og som trenger hjelp.

Den farligste trusselen mot bedriftssikkerheten i dag kommer fra kombinasjonen av AI-generert realistisk innhold og psykologiske manipulasjonsteknikker.

Teknologigapet blir stadig større

Problemet med $40 milliarder kroner

Deloitte spår at AI-basert svindel vil nå $40 milliarder i USA innen 2027, mens det nåværende estimatet for 2023 ligger på $12,3 milliarder.

Den årlige vekstraten for denne perioden vil ifølge prognosene nå 32%.

De økonomiske konsekvensene inkluderer:

- Den umiddelbare økonomiske skaden oppstår gjennom syntetiske svindelaktiviteter.

- Tyveri av personlige identiteter og omfattende misbruk av personopplysninger forekommer.

- Virksomheten blir forstyrret på grunn av tiden som går med til kriminalteknisk etterforskning.

- Virksomheter må betale bøter fordi de ikke har iverksatt tilstrekkelige personverntiltak.

- Virksomheter får varig skade på omdømmet sitt etter at informasjonen blir offentlig tilgjengelig.

Kontaktsentre i faresonen

Innen 2025 vil én av 56 kundeservicesamtaler være svindel i detaljhandelen. Krisen i kontaktsentrene vil forverres fordi AI-drevne svindelaktiviteter vil øke i høyt volum.

Myndighetene begynner å reagere

I USA

- Federal Trade Commission har etablert nye regler som hindrer brukere i å bruke programvare for stemmeimitasjon.

- FBI advarer nå offentligheten om phishing-angrep som bruker kunstig intelligens-teknologi.

- Flere amerikanske delstater har vedtatt ny lovgivning som fokuserer på å regulere deepfake-teknologi.

Globalt

- EUs AI-lov krever at alt AI-generert innhold skal vise tydelige tegn på at det er produsert av kunstig intelligens.

- Flere nasjoner har utviklet internasjonale avtaler som gjør det mulig for dem å håndheve lovene sine i ulike land.

- AI-plattformer må vise at systemene deres har tiltak for å forhindre uautorisert bruk av teknologien.

Muligheten for etterlevelse

Organisasjoner som implementerer avanserte AI-systemer for å avdekke svindel i dag, vil etablere seg som markedsledere.

Organisasjonene vil oppfylle kommende reguleringer før andre fordi konkurrentene må bruke tid på å komme etter.

Et nytt sikkerhetsparadigme

1300% økningen i deepfake-angrep har gjort digitale tillitsoperasjoner til noe mer enn bare et spørsmål om cybersikkerhet.

Det strategiske skiftet:

- Moderne trusler har vokst seg større enn dagens perimeterforsvarssystemer, som ikke lenger gir tilstrekkelig beskyttelse.

- Sikkerhetseksperter som har brukt mange år på sitt felt, opplever nå deepfake-angrep som de ikke kan forsvare seg mot.

- Den nåværende "stol på, men verifiser"-tilnærmingen er ikke lenger effektiv, fordi verifisering må bli en permanent operasjonell prosedyre.

- Systemer for sanntidsoppdagelse må tas i bruk fordi manuelle oppdagelsesmetoder ikke kan oppdage trusler før de blir til trusler.

Fremtiden tilhører de forberedte

Organisasjoner må velge mellom å ta i bruk AI-deteksjonssystemer med en gang for å hindre at deepfake-svindel når den forventede veksten på 155% i 2025, eller å risikere at systemene deres blir offentlig kjent.

Organisasjoner som handler nå, vil forsvare sin økonomiske helse samtidig som de bygger tillitssystemer som vil sikre deres posisjon som ledere i det fremtidige AI-baserte markedet.

De selskapene som først oppdager AI-trusler og raskt tar i bruk løsninger, vil lykkes i kampen mellom AI og AI.

Referanser

- Pindrop (12. juni 2025): "Pindrops 2025 Voice Intelligence & Security Report" - 1,300% deepfake-svindelbølge, data fra samtaleanalyse

- Unite.AI (20 timer siden): "Deepfakes, Voice Clones Fuel 148% Surge in AI Impersonation Scams" - Identity Theft Resource Center statistikk

- Gruppe-IB (6. august 2025): "Anatomien til et Deepfake Voice Phishing-angrep" - Asia-Pacific 194%-økning, data om økonomiske konsekvenser

- J.P. Morgan (2025): "AI-svindel, dype forfalskninger, etterligninger" - $16,6 milliarder i svindeltap, 33% økning

- Incode (20. desember 2024): "Topp 5 tilfeller av AI Deepfake-svindel fra 2024" - Deloitte executive survey, WPP case details

- Eftsure USA (2025): "Deepfake-statistikk (2025): 25 nye fakta for finansdirektører" - Opplæringsgap, statistikk over ansattes tillit

- Security.org (26. august 2025): "2024 Deepfakes Guide and Statistics" - statistikk over ofre for stemmekloning og regelverk

- Den amerikanske advokatforeningen (2025): "Hva Deepfake-svindel lærer oss om AI og svindel" - Brad Pitt-casestudie, juridiske implikasjoner

- Axios (15. mars 2025): "Svindel med AI-stemme-kloning: En vedvarende trussel" - Consumer Reports-studie, FTC-imitasjonsdata