Deepfake-baserade bedrägliga aktiviteter i näringslivet upplevde en enorm ökning under de senaste tolv månaderna.

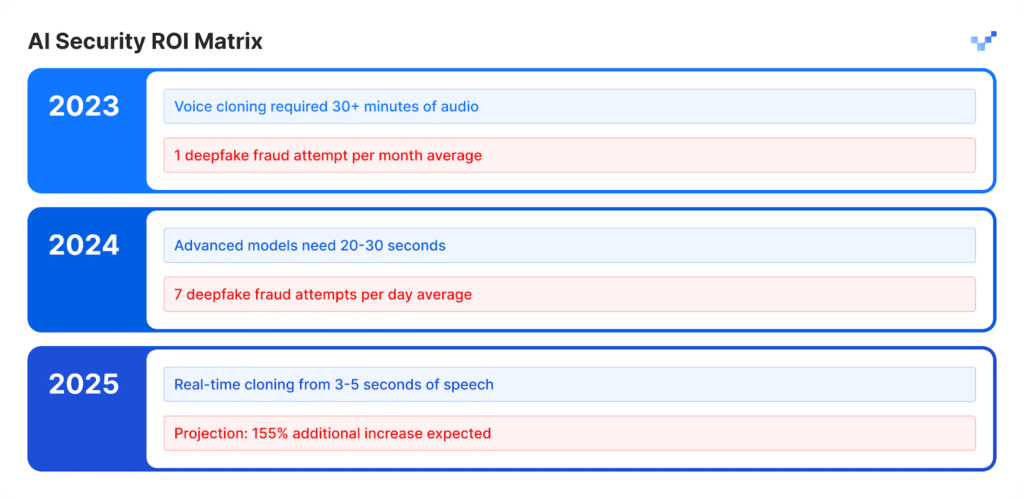

Den 2025 Voice Intelligence & Security-rapport från Pindrop visar att röstbaserade attacker har ökat till 1300% mer än deras tidigare månatliga förekomst eftersom de nu inträffar sju gånger per dag.

Undersökningen av 1,2 miljarder kundsamtal i rapporten visar att denna utveckling är mer än en vanlig ökning av cyberbrottslighet eftersom den innebär en fullständig förändring av bedrägeriernas operativa metoder.

Tillväxtmönstret visar inga tecken på att följa en gradvis utvecklingsväg. Den snabba takten i denna omvälvning har lett till en fullständig omvandling av förtroendebaserade ekonomiska system.

Flera statistiska uppgifter visar den fulla omfattningen av denna kris.

Identity Theft Resource Center registrerade en 148%-ökning av bedrägerier med efterliknande under tidsperioden från april 2024 till mars 2025.

Det totala beloppet för bedrägeriförluster under 2024 uppgick till $16,6 miljarder, vilket var en ökning med 33% jämfört med 2023.

AI-teknikens framsteg har gjort bedrägeri till en industriell verksamhet som bedriver sin verksamhet på en industriell nivå.

Exponering på ledningsnivå

Finansiella deepfake-attacker har riktats mot mer än 25% av verkställande system som hanterar både finans- och redovisningsverksamhet.

Antalet chefer som förutspår att finansiella deepfake-attacker kommer att öka under nästa år har nått mer än 50%.

Anatomi av en industrialiserad attack

Kloning av röster: Från minuter till ögonblick

Utvecklingen av AI-talmodeller har varit exceptionellt snabb under de senaste åren.

Med Basic Free Software kan användare skapa syntetiska röster genom korta röstinspelningar, något som tidigare krävde omfattande ljudmaterial och specialverktyg som tog flera dagar att genomföra.

Den artificiella talproduktionen matchar den naturliga kvaliteten hos mänskliga röster.

Oroa dig aldrig för AI-bedrägerier igen. TruthScan Kan hjälpa dig:

- Upptäcka AI-generering bilder, text, röst och video.

- Undvik stora AI-drivna bedrägerier.

- Skydda dina mest känslig Företagets tillgångar.

Påverkan per bransch:

- Inom försäkringssektorn ökade antalet syntetiska röstattacker med 475% under denna tidsperiod.

- Banksektorn noterade en ökning med 149% av röstbaserade bedrägerier.

- Kontaktcentren kommer att uppleva beräknade $44,5 miljarder i potentiella bedrägeriförluster under de kommande fem åren.

- Säkerhetsincidenter kostar företag i genomsnitt $600.000 per händelse.

Bedrägeriernas nya ansikte: Sofistikerat och polerat

Bedragare använder nu avancerade deepfake-attacker som överträffar vanliga bluffmejl eftersom deras attacker har felfri grammatik och dyker upp vid lämpliga tillfällen samtidigt som de ser extremt autentiska ut.

Dessa attacker försöker kringgå både programmerade säkerhetssystem och mänskliga bedömningsprocesser.

Fallstudie: WPP:s nära ögat-miss

Brottslingarna försökte genomföra ett avancerat bedrägeri genom att skapa ett falskt WhatsApp-konto under WPP:s VD genom att kombinera en röstklon som imiterade Mark Reads röst med YouTube-videouppspelning för falska ansiktsuttryck Mark Reads namn samtidigt som de använde inspelade videor från offentliga domäner.

Angriparna genomförde sin attack via Microsoft Teams och skickade övertygande falska meddelanden genom imitationsmetoder och social ingenjörskonst för att skapa en falsk känsla av brådska i verksamheten.

Angriparna nådde en punkt där de nästan lyckades med sitt mål.

Angriparnas bedrägeri lyckades inte eftersom de introducerade små inkonsekvenser i sin berättelse som fick offret att ifrågasätta deras berättelse.

Incidenten visade att avancerade AI-bedrägeritekniker kan lura även erfarna proffs på grund av deras realistiska och invecklade natur.

Asien och Stillahavsområdet: Den globala hotspoten

Asien och Stillahavsområdet har blivit det globala navet för AI-baserade bedrägerier. Antalet AI-relaterade attacker under 2024 ökade med 194% jämfört med 2023.

Varför just här? Det snabba införandet av digitala betalningar i kombination med otillräckliga system för skydd mot bedrägerier i regionen gjorde det till en perfekt miljö för angripare att verka i.

Regionala nyckeldata:

- Den genomsnittliga ekonomiska förlusten från varje incident uppgår till $600.000.

- Återvinningen av stulna medel ligger under 5% i samtliga fall.

- Deepfake-relaterade ekonomiska förluster på över $1 miljoner påverkade mer än 10% finansinstitut.

Regionen utgör ett viktigt mål för AI-baserade bedrägerier eftersom de anställda arbetar på distans och verktyg för röstsyntes är lättillgängliga.

Bortom rösten: Bedrägerier med flera vektorer är här

En 704%-ökning av angrepp med ansiktsbyte

Antalet face swap-attacker ökade med 704% under 2023 enligt iProov medan bedrägerier med mobila webbinjektioner ökade med 255%.

Det totala antalet bedrägeriförsök omfattar nu 42,5% AI-genererade försök som lyckas i 30% av fallen.

De rapporterade säkerhetsincidenterna visar på en pågående utveckling av hot som drabbar olika system.

Sårbarhetsmatris för företag

- Inom detaljhandeln ökade antalet bedrägerier med 107% under 2024 och experter förutspår att bedrägerierna kommer att fördubblas under 2025.

- Angripare använder deepfakes för att kringgå ID-verifieringssystem som skyddar mot KYC-processer.

- System för artificiell intelligens skapar artificiella ansiktsprofiler som lyckas lura system för ansiktsigenkänning.

- Angripare använder syntetiskt innehåll för att skapa vilseledande juridiska dokument och referenser genom dokumentförfalskningsmetoder.

Fallet Brad Pitt: Psykologiskt bedrägeri med hjälp av AI

En fransk inredningsarkitekt blev offer för ett sofistikerat AI-bedrägeri när han överförde nästan $1 miljon kronor till bedragare under flera månader.

Attackstrategin:

- Bedragaren kontaktade ursprungligen offret och utgav sig för att vara Brad Pitts mamma.

- Deepfake-ljud och AI-genererade bilder hjälpte till att upprätthålla illusionen över tid.

- Falska sjukjournaler och dokument som såg ut som lagliga handlingar gjorde upplägget mer trovärdigt.

- Multimediainnehållet gjorde den falska identiteten trovärdig under flera månader.

En person som inte var nybörjare på teknik blev offer för ett enkelt bedrägeri.

Offret arbetade som företagare och var inte medveten om att han interagerade med artificiell intelligens.

Händelsen visar på den avancerade nivå av bedrägeri som modern deepfake-teknik kan åstadkomma.

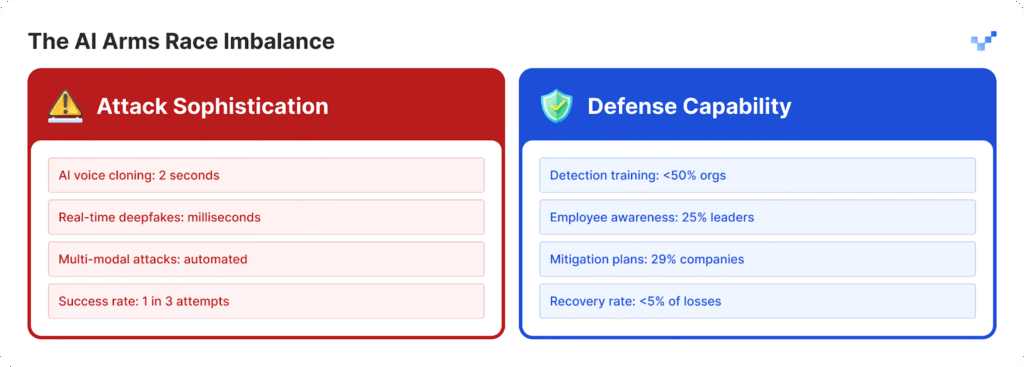

Detektionsgapet: Varför de flesta företag är oförberedda

En medvetenhetskris på högsta nivå

Organisationer har svårt att skydda sig mot allt fler attacker eftersom de inte har utvecklat tillräckliga försvarsstrategier.

- Ledare i 25% av organisationerna visar begränsad förståelse för verksamheten med deepfake-teknik.

- Organisationer har svårt att avgöra sin förmåga att upptäcka deepfake-attacker eftersom 32% av dem fortfarande är osäkra.

- Mer än hälften av organisationerna ger inte sina anställda utbildning om AI-baserade hot.

- De flesta organisationer har inga etablerade planer eller specifika protokoll för att hantera deepfake-hot.

För organisationer som börjar närma sig detta gap finns verktyg som TruthScan erbjuder ett viktigt första steg.

TruthScan är utformad för AI-innehållsdetektering i realtid och flaggar misstänkta bilder, text och media i flera format - vilket hjälper team att upptäcka syntetisk manipulation innan den orsakar skada.

Sårbarheten i den mänskliga faktorn

McAfees forskning visar att 70% av alla människor kan inte skilja mellan autentiska röster och röstkloner.

Problemet eskalerar eftersom 40% av alla människor skulle svara på ett röstmeddelande när de tror att det tillhör någon de älskar som behöver hjälp.

Det för närvarande farligaste hotet mot företagssäkerheten kommer från kombinationen av AI-genererat realistiskt innehåll och psykologiska manipulationstekniker.

Teknologiklyftan blir allt större

Problemet med $40 miljarder

Deloitte förutspår att AI-baserade bedrägerier kommer att uppgå till $40 miljarder i USA år 2027, medan den nuvarande uppskattningen för 2023 ligger på $12,3 miljarder.

Den årliga tillväxttakten för denna period kommer enligt prognoserna att uppgå till 32%.

Den ekonomiska effekten omfattar:

- Den omedelbara ekonomiska skadan uppstår genom syntetiska bedrägerier.

- Stöld av personliga identiteter tillsammans med omfattande missbruk av personlig information förekommer.

- Affärsverksamheten drabbas av störningar på grund av den tid som krävs för den kriminaltekniska undersökningen.

- Företag måste betala straffavgifter för att de inte genomför lämpliga åtgärder för dataskydd.

- Företag drabbas av permanent skada på sitt rykte när deras information blir tillgänglig för allmänheten.

Kontaktcenter i riskzonen

Antalet bedrägerier i detaljhandeln kommer att uppgå till ett av 56 kundtjänstsamtal år 2025. Krisen för kontaktcenter kommer att förvärras eftersom AI-drivna bedrägerier kommer att öka i stora volymer.

Regeringarna börjar reagera

I USA

- Federal Trade Commission har infört nya regler som hindrar användare från att använda programvara för röstimitation.

- FBI varnar nu allmänheten för nätfiskeattacker som använder sig av artificiell intelligens.

- Flera amerikanska delstater har antagit ny lagstiftning som fokuserar på att reglera deepfake-tekniken.

Globalt

- EU:s AI-lag kräver att allt AI-genererat innehåll ska visa tydliga tecken på att det har producerats av artificiell intelligens.

- Flera nationer har utvecklat internationella avtal som gör det möjligt för dem att genomdriva sina lagar i olika länder.

- AI-plattformar måste visa att deras system har åtgärder för att förhindra obehörig användning av deras teknik.

Möjligheten till efterlevnad

Organisationer som implementerar avancerade AI-system för att upptäcka bedrägerier redan idag kommer att etablera sig som marknadsledare.

Organisationerna kommer att uppfylla kommande regler före andra eftersom deras konkurrenter måste ägna tid åt att komma ikapp.

Ett nytt säkerhetsparadigm

Den 1300% stora ökningen av deepfake-attacker har förvandlat digitala förtroendeuppdrag till något mer än bara en cybersäkerhetsfråga.

Det strategiska skiftet:

- De moderna hoten har vuxit ifrån de nuvarande perimeterförsvarssystemen som inte längre ger tillräckligt skydd.

- Säkerhetsexperter som har tillbringat åratal inom sitt område upplever nu deepfake-attacker som de inte kan försvara sig mot.

- Den nuvarande strategin "lita på men verifiera" är inte längre effektiv, eftersom verifiering måste bli ett permanent operativt förfarande.

- System för realtidsdetektering måste användas eftersom manuella metoder inte kan upptäcka hot innan de blir hot.

Framtiden tillhör de förberedda

Organisationer måste välja mellan att använda AI-detekteringssystem direkt för att stoppa deepfake-bedrägerier från att nå den förutspådda 155%-tillväxten 2025 eller riskera att deras system offentliggörs.

Organisationer som agerar nu kommer att försvara sin finansiella hälsa samtidigt som de bygger upp förtroendesystem som kommer att säkra deras position som ledare på den framtida AI-baserade marknaden.

De företag som först upptäcker AI-hot och snabbt implementerar lösningar kommer att lyckas i kampen mellan AI och AI.

Referenser

- Pindrop (12 juni 2025): "Pindrop's 2025 Voice Intelligence & Security Report" - 1,300% deepfake-bedrägerier, data från samtalsanalys

- Unite.AI (20 timmar sedan): "Deepfakes, Voice Clones Fuel 148% Surge in AI Impersonation Scams" - Statistik för resurscenter för identitetsstöld

- Group-IB (6 augusti 2025): "The Anatomy of a Deepfake Voice Phishing Attack" - Asien och Stillahavsområdet 194%-ökning, uppgifter om finansiell påverkan

- J.P. Morgan (2025): "AI-bedrägerier, djupa förfalskningar, imitationer" - $16,6 miljarder bedrägeriförluster, 33% ökning

- Incode (20 december 2024): "Topp 5 fall av AI Deepfake-bedrägerier från 2024" - Deloittes undersökning, WPP:s ärendeinformation

- Eftsure USA (2025): "Deepfake-statistik (2025): 25 nya fakta för CFO:er" - Utbildningsluckor, statistik över medarbetarnas förtroende

- Security.org (26 augusti 2025): "2024 Deepfakes Guide and Statistics" - Statistik över offer för röstkloning, regelverk

- Amerikanska advokatsamfundet (2025): "Vad Deepfake-bedrägerier lär oss om AI och bedrägerier" - Brad Pitt-fallstudie, rättsliga konsekvenser

- Axios (15 mars 2025): "Bedrägerier med AI-röstkloning: Ett ihållande hot" - Consumer Reports-studie, FTC-imitationsdata