ビジネス界におけるディープフェイクを利用した詐欺行為は、過去1年を通じて非常に急増した。

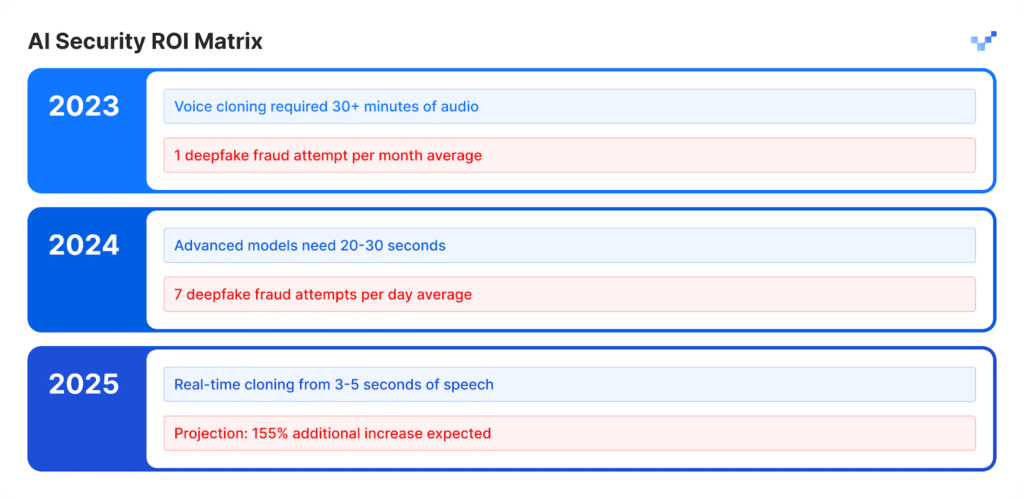

について 2025年 音声インテリジェンスとセキュリティに関するピンドロップ社のレポート によると、音声ベースの攻撃は1日7回発生するようになったため、以前の月間発生回数より1300%も急増している。

報告書を通じて12億件の顧客からの問い合わせを調査した結果、この進展は標準的なサイバー犯罪の増加以上のものであり、詐欺の運用方法の完全な転換を意味していることが証明された。

成長パターンを見ても、緩やかな発展経路をたどる気配はない。この崩壊の急速なペースは、信頼に基づく経済システムの完全な変革をもたらした。

複数の統計が、この危機的状況の全容を示している。

Identity Theft Resource Centerでは、2024年4月から2025年3月までの間に、なりすまし詐欺が148%増加したと記録している。

2024年の詐欺被害総額は、2023年の数字から33%増加し、$166億ドルに達した。

AI技術の進歩は、欺瞞を産業レベルで活動する産業オペレーションに変えた。

エグゼクティブ・レベルの露出

金融ディープフェイク攻撃は、財務と会計の両業務を管理する25%以上のエグゼクティブ・システムを標的にしている。

来年、金融機関のディープフェイク攻撃が増加すると予測する経営者の数は50%以上に達した。

工業化攻撃の解剖

声のクローニング分単位から瞬間単位へ

AI音声モデルはここ数年、その発展において例外的な成長を見せている。

基本的なフリーソフトを使えば、従来は膨大な音声素材と専用ツールが必要で、完成までに数日を要していた合成音声を、短い音声録音で作ることができる。

人工音声の出力は、人間の発声の自然な質と一致する。

もうAI詐欺を心配する必要はない。 TruthScan あなたを助けることができる:

- AIが生成したものを検出する 画像、テキスト、音声、ビデオ。

- 避ける AIによる大規模な詐欺

- 最も大切なものを守る 繊細 企業資産。

産業別インパクト:

- 保険部門では、この期間中、合成音声による攻撃が475%増加した。

- 銀行業界では、音声による詐欺行為が149%増加した。

- コンタクトセンターでは、今後5年間で、潜在的な不正行為による損失が$445億ドルに上ると予測されている。

- セキュリティ・インシデントが発生した場合、企業は1件当たり平均1TP760,000ドルの損害を被る。

詐欺の新しい顔:洗練され、磨き上げられた

詐欺師は現在、基本的な詐欺メールを凌駕する高度なディープフェイク攻撃を採用している。なぜなら、彼らの攻撃は文法が完璧で、極めて本物らしく見えながら、タイミングよく現れるからだ。

これらの攻撃は、プログラムされたセキュリティー・システムと人間の判断プロセスの両方を迂回するように働く。

ケーススタディWPPのニアミス

犯人は、マーク・リードの声を模倣したボイスクローンとYouTubeの動画再生を組み合わせ、WPP CEOの偽のWhatsAppアカウントを作成し、公開ドメインの録画動画を利用しながら、マーク・リードの名前の偽の表情のYouTube動画を再生することで、手の込んだ詐欺計画を実行しようとした。

攻撃者はMicrosoft Teamsを通じて攻撃を行い、なりすまし手法やソーシャル・エンジニアリングの手口を使って説得力のある偽メッセージを送り、偽のビジネス危機感を煽った。

攻撃隊は目的をほぼ達成するところまで到達した。

加害者たちの欺瞞が成功しなかったのは、被害者に彼らの話に疑問を抱かせるような小さな矛盾を話に持ち込んだからである。

この事件は、高度なAIの欺瞞技術が、その現実的で複雑な性質ゆえに、熟練したプロでさえも騙すことができることを証明した。

アジア太平洋世界のホットスポット

アジア太平洋地域は、AIを利用した詐欺行為の世界的な拠点となっている。2024年中のAI関連の攻撃件数は、2023年と比較して194%増加した。

なぜここなのか?同地域ではデジタル決済の導入が急速に進んでおり、不正防止システムも不十分であるため、攻撃者にとって絶好の活動環境となっている。

主要地域データ:

- 各事故による平均的な金銭的損失は$600,000にのぼる。

- 盗まれた資金の回収額はすべてのケースで5%を下回っている。

- ディープフェイクに関連した金融損失は$1百万ドルを超え、10%以上の金融機関に影響を与えた。

この地域は、従業員が遠隔地で働き、音声合成ツールに簡単にアクセスできるため、AIを使った詐欺の主要な標的となっている。

声を超える:マルチ・ベクトル詐欺の登場

704%によるフェイス・スワップ攻撃の急増

iProovによると、2023年中にフェイススワップ攻撃の数は704%増加し、モバイルウェブインジェクション詐欺は255%増加した。

現在、詐欺未遂件数の合計には、42.5%のAIが生成した未遂が含まれ、そのうち30%のケースで成功している。

報告されたセキュリティ・インシデントは、さまざまなシステムに影響を与える脅威の継続的な発展を示している。

企業の脆弱性マトリックス

- 小売業界では、2024年中に107%の詐欺行為が増加し、専門家は2025年には詐欺事件が倍増すると予測している。

- 攻撃者はディープフェイクを使って、KYCプロセスを保護するID検証システムを迂回する。

- 人工知能システムは、顔認識システムを欺くことができる人工的な顔のプロフィールを作り出す。

- 攻撃者は合成コンテンツを使い、文書偽造の手法で偽の法的文書や認証情報を生成する。

ブラッド・ピット事件AIによる心理的詐欺

フランスのインテリア・デザイナーが、数ヶ月間にわたって詐欺師たちに約$1万ドルを送金し、巧妙なAI詐欺の被害者となった。

攻撃戦略:

- 偽者は最初、ブラッド・ピットの母親のふりをして被害者に接触した。

- ディープフェイクの音声とAIが生成した画像は、時間が経っても錯覚を維持するのに役立った。

- 偽の医療記録と合法的に見える書類が、この計画に信憑性を与えた。

- マルチメディアのコンテンツは、数ヶ月間、偽の身元を信じさせ続けた。

技術に不慣れでない人が、わかりやすい詐欺の被害に遭ったのだ。

被害者は、人工知能とやりとりしていることに気づかないまま、企業経営者として活動していた。

この事件は、現代のディープフェイク技術が達成できる高度な欺瞞のレベルを示している。

検知のギャップ:ほとんどの企業が準備不足な理由

トップの意識危機

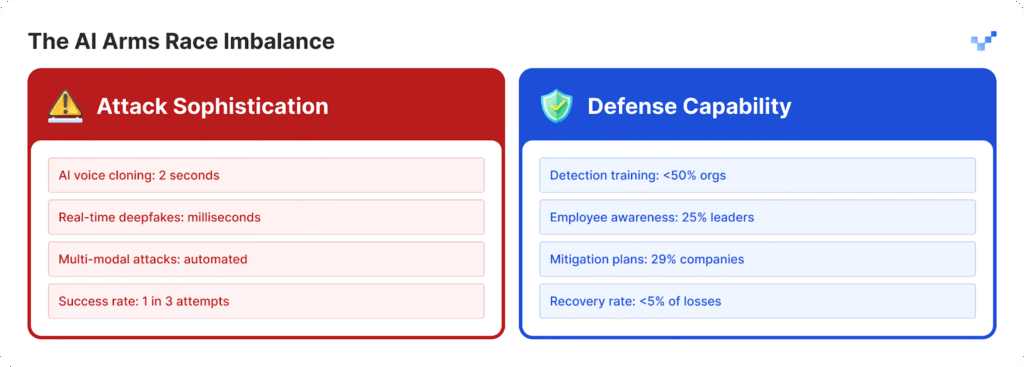

組織は十分な防御戦略を策定していないため、増加する攻撃から身を守るのに苦労している。

- 25%の組織のリーダーは、ディープフェイク・テクノロジーの運用について限られた理解しか示していない。

- 32%が不確かなままであるため、組織はディープフェイク攻撃を検出する能力を判断するのに苦労している。

- 半数以上の組織が、AIベースの脅威に関するトレーニングを従業員に提供していない。

- ほとんどの組織は、ディープフェイクの脅威に対処するための計画や具体的なプロトコルを確立していない。

このような準備のギャップを埋め始めている組織には、次のようなツールがある。 トゥルースキャン が重要な第一歩となる。

リアルタイムのAIコンテンツ検出用に設計されたTruthScanは、複数のフォーマットにまたがる疑わしいビジュアル、テキスト、メディアにフラグを立てます。

人的要因の脆弱性

マカフィーの調査によると 70%の人が本物の声と声マネを区別できない.

40%の人々が、助けを必要としている大切な人のボイスメールだと思うと、それに応答してしまうからだ。

現在、企業のセキュリティにとって最も危険な脅威は、AIが生成したリアルなコンテンツと心理操作のテクニックの組み合わせから生まれている。

広がる技術格差

$400億問題

デロイトは、AIを利用した不正行為が2027年までに米国で$400億ドルに達すると予測しているが、現在の2023年の予測は$123億ドルである。

予測によれば、この期間の年間成長率は32%に達する。

経済効果は以下の通り:

- 直接的な金銭的被害は、合成詐欺行為によって発生する。

- 個人情報の悪用が拡大し、個人情報の盗難が起こる。

- フォレンジック調査に時間がかかるため、業務に支障が生じる。

- 企業は適切なデータ保護対策を実施していないため、規制上の罰則を支払わなければならない。

- 企業は、情報が公開された後、その評判に永久的なダメージを受ける。

コンタクトセンターのリスク

2025年までに小売業の不正件数はカスタマーサービスコール56件に1件に達する。AIを活用した詐欺行為が大量に増加するため、コンタクトセンターの危機は悪化する。

各国政府は対応を始めている

アメリカでは

- 米連邦取引委員会は、音声なりすましソフトの使用を防止する新たな規則を制定した。

- FBIは現在、人工知能技術を使ったフィッシング攻撃について警告を発している。

- アメリカのいくつかの州は、ディープフェイク技術の規制に焦点を当てた新しい法律を制定した。

全世界

- EUのAI法は、AIが生成したすべてのコンテンツに、それが人工知能によって生成されたことを明らかに示すことを求めている。

- いくつかの国は国際協定を結んでおり、さまざまな国で自国の法律を施行できるようになっている。

- AIプラットフォームは、その技術が不正に使用されることを防止する措置をシステムが備えていることを証明しなければならない。

コンプライアンスの機会

今日、高度なAI不正検知システムを導入した企業は、市場リーダーとしての地位を確立するだろう。

競合他社はキャッチアップに時間を費やす必要があるため、組織は他社に先駆けて今後の規制に対応することになる。

新しいセキュリティ・パラダイム

1300%のディープフェイク攻撃の増加は、デジタルトラストオペレーションを単なるサイバーセキュリティの問題以上のものに変えた。

戦略転換:

- 現代の脅威は、もはや十分な防御を提供しない現在の境界防御システムを凌駕している。

- その分野で何年も費やしてきたセキュリティ専門家たちは、今や防御できないディープフェイク攻撃を経験している。

- 検証を恒久的な運用手順とする必要があるためだ。

- 手動の検知方法では脅威を事前に検知できないため、リアルタイムの検知システムを導入する必要がある。

未来は準備された者のもの

組織は、ディープフェイク詐欺が2025年に予測される155%の増加に達するのを阻止するために、AI検知システムをすぐに導入するか、システムを公開するリスクのどちらかを選択する必要がある。

今行動する組織は、財務の健全性を守ると同時に、信頼システムを構築し、将来のAIベースの市場におけるリーダーとしての地位を確保することができる。

AIの脅威をいち早く察知し、ソリューションを迅速に展開した企業が、AI対AIの戦いで成功を収めるだろう。

参考文献

- ピンドロップ(2025年6月12日):「Pindrop's 2025 Voice Intelligence & Security Report" - 1,300%ディープフェイク詐欺急増、通話分析データ

- Unite.AI(20時間前):「ディープフェイク、ボイスクローン、148%急増するAIなりすまし詐欺」 - Identity Stft Resource Center statistics.

- グループIB(2025年8月6日):「ディープフェイク音声フィッシング攻撃の解剖」-アジア太平洋194%急増、財務的影響データ

- JPモルガン(2025年):「AI詐欺、ディープフェイク、なりすまし」 - $166億の詐欺被害、33%増加

- インコード(2024年12月20日):「2024年からのAIディープフェイク詐欺事例トップ5」-デロイト幹部調査、WPP事例詳細

- エフツールUS(2025年):"ディープフェイク統計(2025年):CFOのための25の新事実」 - トレーニングギャップ、従業員の信頼度統計

- Security.org(2025年8月26日):「2024年ディープフェイクガイドと統計」-音声クローン被害者統計、規制状況

- 米国法曹協会(2025年):「ディープフェイク詐欺がAIと詐欺について教えてくれること」 - ブラッド・ピットのケーススタディ、法的意味合い

- アクシオス(2025年3月15日):「AIによる声マネ詐欺:根強い脅威」-コンシューマー・レポート調査、FTCなりすましデータ