Aktivitas penipuan berbasis deepfake di dunia bisnis mengalami lonjakan yang sangat besar selama dua belas bulan terakhir.

The Laporan Kecerdasan & Keamanan Suara 2025 dari Pindrop mengungkapkan bahwa serangan berbasis suara telah melonjak menjadi 1300% lebih banyak dari kejadian bulanan sebelumnya karena serangan ini sekarang terjadi tujuh kali per hari.

Penelitian terhadap 1,2 miliar panggilan pelanggan melalui laporan tersebut membuktikan bahwa perkembangan ini mewakili lebih dari sekadar pertumbuhan kejahatan siber karena menandakan pergeseran total dalam metode operasional penipuan.

Pola pertumbuhan tidak menunjukkan indikasi untuk mengikuti jalur perkembangan yang bertahap. Laju disrupsi yang cepat ini telah menyebabkan transformasi total sistem ekonomi berbasis kepercayaan.

Beberapa statistik menunjukkan tingkat penuh dari krisis yang berkembang ini.

Pusat Sumber Daya Pencurian Identitas mencatat kenaikan 148% dalam penipuan peniruan selama rentang waktu dari April 2024 hingga Maret 2025.

Jumlah total kerugian penipuan selama tahun 2024 mencapai $16,6 miliar sekaligus menunjukkan peningkatan 33% dari angka tahun 2023.

Kemajuan teknologi AI telah mengubah penipuan menjadi sebuah operasi industri yang melakukan aktivitasnya di tingkat industri.

Paparan Tingkat Eksekutif

Serangan financial deepfake telah menargetkan lebih dari 25% sistem eksekutif yang mengelola operasi keuangan dan akuntansi.

Jumlah eksekutif yang memprediksi serangan financial deepfake akan meningkat di tahun depan telah mencapai lebih dari 50%.

Anatomi Serangan Industri

Kloning Suara: Dari Menit ke Menit

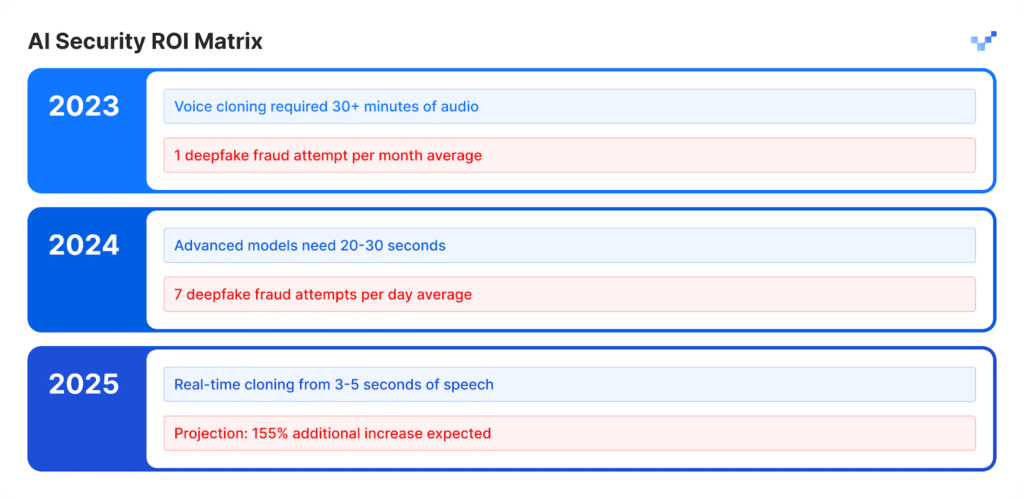

Model ucapan AI telah menunjukkan pertumbuhan yang luar biasa dalam perkembangannya selama beberapa tahun sebelumnya.

Perangkat lunak gratis dasar memungkinkan pengguna untuk membuat suara sintetis melalui rekaman suara pendek yang dulunya membutuhkan materi audio yang luas dan alat khusus yang membutuhkan waktu beberapa hari untuk menyelesaikannya.

Output ucapan buatan sesuai dengan kualitas alami vokalisasi manusia.

Jangan Pernah Khawatir Tentang Penipuan AI Lagi. TruthScan Dapat Membantu Anda:

- Mendeteksi AI yang dihasilkan gambar, teks, suara, dan video.

- Hindari penipuan besar yang digerakkan oleh AI.

- Lindungi sebagian besar sensitif aset perusahaan.

Dampak oleh Industri:

- Sektor asuransi mengalami peningkatan serangan suara sintetis sebesar 475% selama periode ini.

- Industri perbankan mencatat peningkatan 149% dalam aktivitas penipuan berbasis suara.

- Pusat kontak akan mengalami proyeksi kerugian potensial sebesar $44,5 miliar dalam potensi penipuan selama lima tahun ke depan.

- Insiden keamanan merugikan bisnis rata-rata $600.000 per kejadian.

Wajah Baru Penipuan: Canggih dan Dipoles

Para penipu sekarang menggunakan serangan deepfake canggih yang melampaui email penipuan biasa karena serangan mereka memiliki tata bahasa yang sempurna dan muncul di saat yang tepat dan terlihat sangat otentik.

Serangan ini bekerja untuk mem-bypass sistem keamanan terprogram dan proses penilaian manusia.

Studi Kasus: Nyaris Celaka di WPP

Para penjahat berusaha menjalankan skema penipuan yang rumit melalui pembuatan akun WhatsApp palsu di bawah nama CEO WPP dengan menggabungkan tiruan suara yang meniru suara Mark Read dengan pemutaran video YouTube untuk memalsukan ekspresi wajah Mark Read dengan menggunakan video rekaman dari domain publik.

Para penyerang melakukan serangan mereka melalui Microsoft Teams dan mengirimkan pesan palsu yang meyakinkan melalui metode peniruan dan taktik rekayasa sosial untuk menciptakan rasa urgensi bisnis yang palsu.

Para penyerang mencapai titik di mana mereka hampir berhasil mencapai tujuan mereka.

Penipuan para penyerang gagal karena mereka memperkenalkan ketidakkonsistenan kecil dalam narasi mereka yang membuat korban mempertanyakan cerita mereka.

Insiden ini membuktikan bahwa teknik penipuan AI yang canggih dapat mengelabui para profesional yang berpengalaman sekalipun karena sifatnya yang realistis dan rumit.

Asia-Pasifik: Hotspot Global

Kawasan Asia-Pasifik telah menjadi pusat aktivitas penipuan berbasis AI di seluruh dunia. Jumlah serangan terkait AI selama tahun 2024 meningkat sebesar 194% dibandingkan dengan tahun 2023.

Mengapa di sini? Adopsi pembayaran digital yang cepat dikombinasikan dengan sistem perlindungan penipuan yang tidak memadai di wilayah ini menjadikannya lingkungan yang sempurna bagi penyerang untuk beroperasi.

Data Regional Utama:

- Kerugian finansial rata-rata dari setiap insiden mencapai $600.000.

- Pemulihan dana yang dicuri tetap di bawah 5% dalam semua kasus.

- Kerugian finansial terkait Deepfake yang melebihi $1 juta mempengaruhi lebih dari 10% lembaga keuangan.

Wilayah ini menjadi target utama penipuan berbasis AI karena karyawan bekerja dari jarak jauh dan alat sintesis suara mudah diakses.

Melampaui Suara: Penipuan Multi-Vektor Ada di Sini

Lonjakan 704% dalam Serangan Penukaran Wajah

Jumlah serangan face swap meningkat sebesar 704% selama tahun 2023 menurut iProov, sementara penipuan injeksi web seluler meningkat sebesar 255%.

Jumlah total percobaan penipuan saat ini mencakup 42,5% percobaan yang dihasilkan oleh AI yang berhasil dalam 30% kasus.

Insiden keamanan yang dilaporkan menunjukkan perkembangan ancaman yang terus berlanjut yang berdampak pada sistem yang berbeda.

Matriks Kerentanan Perusahaan

- Sektor ritel mengalami peningkatan aktivitas penipuan sebesar 107% selama tahun 2024 dan para ahli memperkirakan bahwa kasus penipuan akan meningkat dua kali lipat pada tahun 2025.

- Penyerang menggunakan deepfakes untuk mem-bypass sistem verifikasi ID yang melindungi dari proses KYC.

- Sistem kecerdasan buatan menghasilkan profil wajah buatan yang dapat menipu sistem pengenalan wajah.

- Penyerang menggunakan konten sintetis untuk menghasilkan dokumen dan kredensial hukum yang menipu melalui metode pemalsuan dokumen.

Kasus Brad Pitt: Penipuan Psikologis yang Didukung AI

Seorang desainer interior Prancis menjadi korban penipuan AI yang canggih ketika ia mentransfer hampir $1 juta kepada para penipu selama beberapa bulan.

Strategi Serangan:

- Penipu tersebut awalnya menghubungi korban dengan berpura-pura menjadi ibu Brad Pitt.

- Audio deepfake dan gambar yang dihasilkan AI membantu mempertahankan ilusi dari waktu ke waktu.

- Rekam medis palsu dan dokumen yang terlihat legal menambahkan lapisan kredibilitas pada skema ini.

- Konten multimedia membuat identitas palsu tersebut dapat dipercaya selama beberapa bulan.

Seseorang yang tidak awam dengan teknologi menjadi korban penipuan langsung.

Korban beroperasi sebagai pemilik bisnis yang tidak menyadari bahwa ia berinteraksi dengan kecerdasan buatan.

Insiden ini menunjukkan tingkat penipuan tingkat lanjut yang dapat dicapai oleh teknologi deepfake modern.

Kesenjangan Deteksi: Mengapa Sebagian Besar Perusahaan Tidak Siap

Krisis Kesadaran di Tingkat Atas

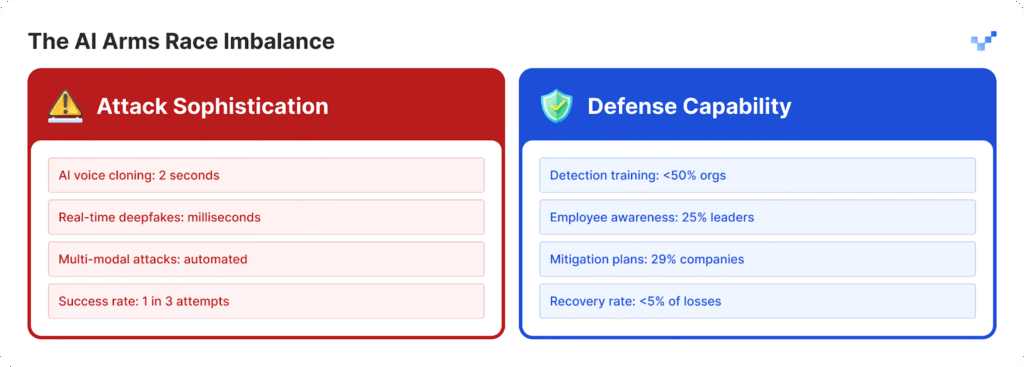

Organisasi berjuang untuk melindungi diri mereka sendiri dari serangan yang semakin meningkat karena mereka belum mengembangkan strategi pertahanan yang memadai.

- Para pemimpin di 25% organisasi menunjukkan pemahaman yang terbatas tentang operasi teknologi deepfake.

- Organisasi berjuang untuk menentukan kemampuan mereka dalam mendeteksi serangan deepfake karena 32% di antaranya masih belum pasti.

- Lebih dari separuh organisasi tidak memberikan pelatihan kepada anggota staf mereka tentang ancaman berbasis AI.

- Sebagian besar organisasi tidak memiliki rencana yang mapan atau protokol khusus untuk menangani ancaman deepfake.

Untuk organisasi yang mulai menutup kesenjangan kesiapan tersebut, alat bantu seperti TruthScan menawarkan langkah pertama yang penting.

Dirancang untuk mendeteksi konten AI secara real-time, TruthScan menandai visual, teks, dan media yang mencurigakan dalam berbagai format-membantu tim menemukan manipulasi sintetis sebelum menyebabkan kerusakan.

Kerentanan Faktor Manusia

Penelitian McAfee menunjukkan bahwa 70% orang gagal membedakan antara suara asli dan kloningan suara.

Masalahnya semakin meningkat karena 40% orang akan merespons pesan suara ketika mereka mengira pesan tersebut berasal dari seseorang yang mereka cintai yang membutuhkan bantuan.

Ancaman paling berbahaya saat ini terhadap keamanan perusahaan muncul dari kombinasi konten realistis yang dihasilkan AI dengan teknik manipulasi psikologis.

Kesenjangan Teknologi Semakin Melebar

Masalah $40 Miliar

Deloitte memprediksi bahwa penipuan berbasis AI akan mencapai $40 miliar di Amerika Serikat pada tahun 2027, sementara perkiraan tahun 2023 saat ini mencapai $12,3 miliar.

Tingkat pertumbuhan tahunan untuk periode ini akan mencapai 32% menurut proyeksi.

Dampak Ekonomi Meliputi:

- Kerusakan finansial langsung terjadi melalui aktivitas penipuan sintetis.

- Pencurian identitas pribadi serta penyalahgunaan informasi pribadi yang diperluas terjadi.

- Operasi bisnis mengalami gangguan karena waktu yang dibutuhkan untuk investigasi forensik.

- Bisnis harus membayar denda peraturan karena mereka tidak menerapkan langkah-langkah perlindungan data yang tepat.

- Bisnis mengalami kerusakan permanen pada reputasi mereka setelah informasi mereka tersedia untuk umum.

Pusat Kontak Berisiko

Jumlah kasus penipuan ritel akan mencapai satu dari setiap 56 panggilan layanan pelanggan pada tahun 2025. Krisis pusat kontak akan semakin parah karena aktivitas penipuan yang didukung oleh AI akan meningkat dalam volume yang tinggi.

Pemerintah Mulai Merespon

Di AS

- Komisi Perdagangan Federal menetapkan aturan baru yang mencegah pengguna menggunakan perangkat lunak peniruan suara.

- FBI sekarang memperingatkan publik tentang serangan phishing yang menggunakan teknologi kecerdasan buatan.

- Beberapa negara bagian di Amerika telah memberlakukan undang-undang baru yang berfokus pada pengaturan teknologi deepfake.

Secara global

- Undang-Undang AI Uni Eropa mewajibkan semua konten yang dihasilkan oleh AI untuk menunjukkan tanda-tanda yang jelas bahwa konten tersebut dihasilkan oleh kecerdasan buatan.

- Beberapa negara telah mengembangkan perjanjian internasional yang memungkinkan mereka untuk menegakkan hukum di berbagai negara.

- Platform AI harus menunjukkan bahwa sistem mereka memiliki langkah-langkah untuk mencegah penggunaan teknologi mereka yang tidak sah.

Peluang Kepatuhan

Organisasi yang menerapkan sistem pendeteksi kecurangan AI yang canggih saat ini akan menjadikan diri mereka sebagai pemimpin pasar.

Organisasi akan memenuhi peraturan yang akan datang sebelum yang lain karena pesaing mereka harus menghabiskan waktu untuk mengejar ketinggalan.

Paradigma Keamanan Baru

Peningkatan serangan deepfake sebesar 1300% telah mengubah operasi kepercayaan digital menjadi sesuatu yang lebih dari sekadar masalah keamanan siber.

Pergeseran Strategis:

- Ancaman modern telah melampaui sistem pertahanan perimeter saat ini yang tidak lagi memberikan perlindungan yang memadai.

- Pakar keamanan yang telah menghabiskan waktu bertahun-tahun di bidangnya kini mengalami serangan deepfake yang tidak dapat mereka tangkis.

- Pendekatan "percaya tapi verifikasi" yang ada saat ini tidak lagi efektif karena verifikasi harus menjadi prosedur operasional yang permanen.

- Sistem deteksi real-time perlu diterapkan karena metode penemuan manual tidak dapat mendeteksi ancaman sebelum menjadi ancaman.

Masa Depan Adalah Milik Mereka yang Bersiap

Organisasi harus memilih antara menerapkan sistem deteksi AI dengan segera untuk menghentikan penipuan deepfake agar tidak mencapai pertumbuhan 155% yang diprediksi pada tahun 2025 atau mengambil risiko pengungkapan sistem mereka kepada publik.

Organisasi yang bertindak sekarang akan mempertahankan kesehatan keuangan mereka sambil membangun sistem kepercayaan yang akan mengamankan posisi mereka sebagai pemimpin di pasar berbasis AI di masa depan.

Perusahaan yang mendeteksi ancaman AI lebih dulu dan menerapkan solusi dengan cepat akan berhasil dalam pertempuran AI versus AI.

Referensi

- Pindrop (12 Juni 2025): "Laporan Intelijen & Keamanan Suara Pindrop 2025" - Lonjakan penipuan deepfake 1.300%, data analisis panggilan

- Unite.AI (20 jam yang lalu): "Deepfakes, Klon Suara Memicu Lonjakan Penipuan Peniruan AI 148%" - Statistik Pusat Sumber Daya Pencurian Identitas

- Grup-IB (6 Agustus 2025): "Anatomi Serangan Phishing Suara Deepfake" - Lonjakan 194% di Asia Pasifik, data dampak finansial

- J.P. Morgan (2025): "Penipuan AI, Pemalsuan Mendalam, Peniruan" - Kerugian penipuan sebesar $16,6 miliar, peningkatan sebesar 33%

- Incode (20 Desember 2024): "5 Kasus Penipuan AI Deepfake Teratas Dari Tahun 2024" - Survei eksekutif Deloitte, rincian kasus WPP

- Eftsure AS (2025): "Statistik deepfake (2025): 25 fakta baru untuk CFO" - Kesenjangan pelatihan, statistik kepercayaan diri karyawan

- Security.org (26 Agustus 2025): "Panduan dan Statistik Deepfakes 2024" - Statistik korban kloning suara, lanskap peraturan

- American Bar Association (2025): "Apa yang Diajarkan Penipuan Deepfake Kepada Kita Tentang AI dan Penipuan" - Studi kasus Brad Pitt, implikasi hukum

- Axios (15 Maret 2025): "Penipuan dengan tiruan suara AI: Ancaman yang terus berlanjut" - Studi Consumer Reports, data peniruan FTC