V posledních dvanácti měsících došlo k obrovskému nárůstu podvodných aktivit v obchodním světě založených na Deepfake.

Na stránkách 2025 Voice Intelligence & Security Report od společnosti Pindrop ukazuje, že počet hlasových útoků se zvýšil na 1300%, což je více než jejich předchozí měsíční výskyt, protože se nyní vyskytují sedmkrát denně.

Výzkum 1,2 miliardy zákaznických hovorů prostřednictvím zprávy dokazuje, že tento vývoj představuje více než jen standardní nárůst kyberkriminality, protože znamená úplný posun v operačních metodách podvodů.

Struktura růstu nenaznačuje, že by se vyvíjela postupně. Rychlé tempo tohoto narušení vedlo k úplné transformaci ekonomických systémů založených na důvěře.

Rozsah této rozvíjející se krize dokládají četné statistiky.

V období od dubna 2024 do března 2025 zaznamenalo Identity Theft Resource Center 148% nárůst podvodů vydávajících se za identitu.

Celková výše ztrát z podvodů v roce 2024 dosáhla $16,6 miliardy a oproti roku 2023 se zvýšila o 33%.

Díky technologickému pokroku v oblasti umělé inteligence se z podvodu stala průmyslová operace, která provádí své činnosti na průmyslové úrovni.

Expozice na úrovni vedoucích pracovníků

Finanční deepfake útoky se zaměřily na více než 25% výkonných systémů, které řídí finanční i účetní operace.

Počet vedoucích pracovníků, kteří předpovídají, že počet finančních deepfake útoků v příštím roce vzroste, dosáhl více než 50%.

Anatomie průmyslového útoku

Klonování hlasu: Od minut k okamžikům

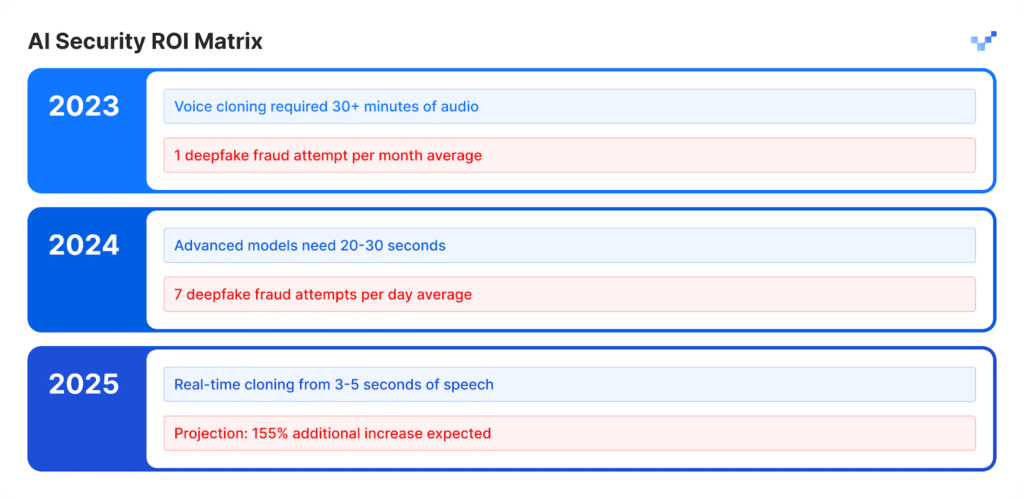

Modely řeči s umělou inteligencí zaznamenaly během několika předchozích let mimořádný rozvoj.

Základní bezplatný software umožňuje uživatelům vytvářet syntetické hlasy pomocí krátkých hlasových nahrávek, což dříve vyžadovalo rozsáhlý zvukový materiál a specializované nástroje, které k tomu potřebovaly několik dní.

Umělý řečový výstup odpovídá přirozené kvalitě lidských vokálů.

Už nikdy se nemusíte obávat podvodů s umělou inteligencí. TruthScan Může vám pomoci:

- Detekce generované umělou inteligencí obrázky, text, hlas a video.

- Vyhněte se velké podvody řízené umělou inteligencí.

- Chraňte své nejzajímavější citlivé majetek podniku.

Dopad podle odvětví:

- V odvětví pojišťovnictví došlo v tomto období k nárůstu syntetických hlasových útoků o 475%.

- Bankovní sektor zaznamenal 149% nárůst podvodných aktivit založených na hlasových službách.

- Kontaktní centra budou v příštích pěti letech zaznamenávat potenciální ztráty z podvodů v hodnotě $44,5 miliardy EUR.

- Bezpečnostní incidenty stojí podniky v průměru $600 000 za jeden případ.

Nová tvář podvodů: Sofistikované a vybroušené

Podvodníci nyní používají pokročilé deepfake útoky, které překonávají základní podvodné e-maily, protože jejich útoky mají bezchybnou gramatiku, objevují se ve vhodných okamžicích a vypadají velmi autenticky.

Tyto útoky se snaží obejít jak naprogramované bezpečnostní systémy, tak i procesy lidského úsudku.

Případová studie: Téměř nehoda WPP

Zločinci se pokusili provést propracované podvodné schéma vytvořením falešného účtu WhatsApp pod generálním ředitelem WPP kombinací hlasového klonu, který napodoboval hlas Marka Reada, s přehráváním videí YouTube pro falešné výrazy obličeje Jméno Marka Reada, přičemž využili nahraná videa z veřejných domén.

Útočníci vedli útok prostřednictvím služby Microsoft Teams a pomocí metod vydávání se za někoho jiného a taktik sociálního inženýrství rozesílali přesvědčivé falešné zprávy, aby vyvolali falešný pocit naléhavosti obchodní záležitosti.

Útočníci dosáhli bodu, kdy se jim téměř podařilo dosáhnout svého cíle.

Útočníkům se podvod nepodařil, protože do svého vyprávění vnesli drobné nesrovnalosti, které oběť přiměly k pochybnostem o jejich příběhu.

Incident ukázal, že pokročilé techniky podvodu s umělou inteligencí mohou díky své realistické a složité povaze oklamat i zkušené profesionály.

Asie a Tichomoří: Globální horký bod

Asijsko-pacifická oblast se stala celosvětovým centrem podvodných aktivit založených na umělé inteligenci. Počet útoků souvisejících s UI se v roce 2024 zvýšil o 194% ve srovnání s rokem 2023.

Proč právě tady? Rychlé zavádění digitálních plateb v kombinaci s nedostatečnými systémy ochrany proti podvodům v regionu vytvořilo pro útočníky ideální prostředí.

Klíčové regionální údaje:

- Průměrná finanční ztráta z každého incidentu činí $600 000.

- Výtěžnost odcizených finančních prostředků zůstává ve všech případech nižší než 5%.

- Finanční ztráty související s Deepfake přesahující $1 milionů postihly více než 10% finančních institucí.

Tento region je hlavním cílem podvodů založených na umělé inteligenci, protože zaměstnanci pracují na dálku a nástroje pro hlasovou syntézu jsou snadno dostupné.

Za hranice hlasu: Podvody ve více sektorech jsou tady

704% Nárůst útoků na výměnu tváří

Podle společnosti iProov vzrostl počet útoků na výměnu obličeje během roku 2023 o 704%, zatímco počet podvodů s mobilními webovými nástroji vzrostl o 255%.

Celkový počet pokusů o podvod nyní zahrnuje 42,5% pokusů generovaných umělou inteligencí, které jsou úspěšné v 30% případů.

Hlášené bezpečnostní incidenty ukazují na neustálý vývoj hrozeb, které mají dopad na různé systémy.

Matice zranitelnosti podniku

- V roce 2024 došlo v maloobchodním sektoru k nárůstu podvodných aktivit o 107% a odborníci předpovídají, že v roce 2025 se počet podvodů zdvojnásobí.

- Útočníci používají falešné doklady, aby obešli systémy ověřování totožnosti, které chrání procesy KYC.

- Systémy umělé inteligence vytvářejí umělé profily obličeje, které dokáží oklamat systémy rozpoznávání obličeje.

- Útočníci používají syntetický obsah k vytváření klamavých právních dokumentů a pověření pomocí metod padělání dokumentů.

Případ Brada Pitta: Psychologický podvod s pomocí umělé inteligence

Francouzský interiérový designér se stal obětí sofistikovaného podvodu s umělou inteligencí, když podvodníkům během několika měsíců převedl téměř $1 milion.

Útočná strategie:

- Podvodník oběť nejprve kontaktoval a vydával se za matku Brada Pitta.

- Iluzi pomohl udržet hluboký falešný zvuk a obrázky generované umělou inteligencí.

- Falešné lékařské záznamy a legálně vypadající dokumenty dodávaly tomuto systému na důvěryhodnosti.

- Multimediální obsah udržoval falešnou identitu věrohodnou po několik měsíců.

Osoba, která nebyla v oblasti technologií nováčkem, se stala obětí přímého podvodu.

Oběť fungovala jako majitel firmy, který si nebyl vědom, že komunikuje s umělou inteligencí.

Tento incident ukazuje, jak pokročilé úrovně podvodu je moderní technologie deepfake schopna dosáhnout.

Mezera v detekci: proč je většina firem nepřipravena

Krize informovanosti na vrcholu

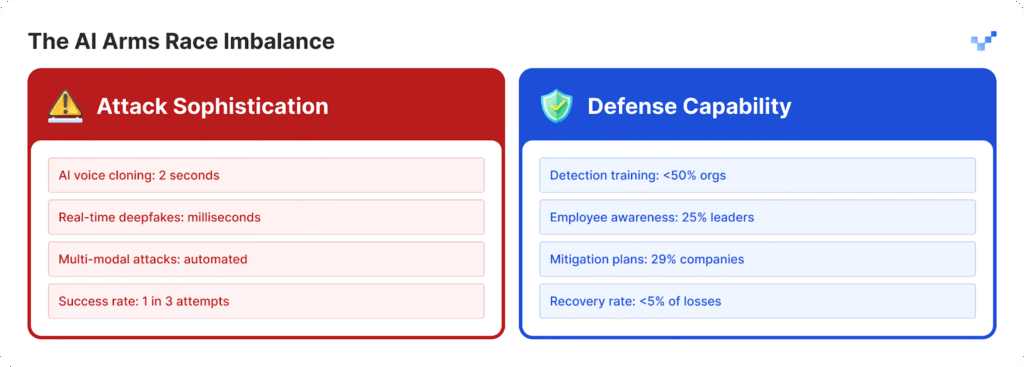

Organizace se snaží chránit před rostoucími útoky, protože nemají vyvinuté dostatečné obranné strategie.

- Vedoucí pracovníci v 25% organizacích vykazují omezené znalosti o provozu deepfake technologií.

- Organizace se snaží určit svou schopnost odhalit deepfake útoky, protože 32% z nich zůstává nejistý.

- Více než polovina organizací neposkytuje svým zaměstnancům školení o hrozbách založených na umělé inteligenci.

- Většina organizací nemá zavedené plány nebo konkrétní protokoly pro řešení hrozeb typu deepfake.

Pro organizace, které začínají tuto mezeru v připravenosti překonávat, jsou vhodné nástroje jako např. TruthScan nabízí první důležitý krok.

Funkce TruthScan, navržená pro detekci obsahu s umělou inteligencí v reálném čase, označuje podezřelé vizuály, texty a média v různých formátech a pomáhá týmům odhalit syntetickou manipulaci dříve, než způsobí škodu.

Zranitelnost lidského faktoru

Výzkum společnosti McAfee ukazuje, že 70% lidí nedokáže rozlišit mezi autentickými hlasy a hlasovými klony.

Problém se stupňuje, protože 40% lidí by reagovalo na hlasovou zprávu, pokud by si mysleli, že patří někomu, koho mají rádi a kdo potřebuje pomoc.

Současná nejnebezpečnější hrozba pro podnikovou bezpečnost vzniká kombinací realistického obsahu generovaného umělou inteligencí s technikami psychologické manipulace.

Technologická propast se zvětšuje

Problém $40 miliard

Společnost Deloitte předpovídá, že do roku 2027 dosáhnou podvody založené na umělé inteligenci ve Spojených státech $40 miliard, zatímco současný odhad pro rok 2023 činí $12,3 miliardy.

Roční tempo růstu v tomto období dosáhne podle prognóz 32%.

Ekonomický dopad zahrnuje:

- Bezprostřední finanční škody vznikají v důsledku syntetických podvodů.

- Dochází ke krádežím osobních identit a rozsáhlému zneužití osobních údajů.

- Kvůli času potřebnému na forenzní vyšetřování dochází k narušení provozu podniku.

- Podniky musí platit sankce podle právních předpisů, protože nezavedly řádná opatření na ochranu údajů.

- Podniky utrpí trvalou újmu na své pověsti poté, co se jejich informace dostanou na veřejnost.

Ohrožená kontaktní centra

Počet podvodů v maloobchodě dosáhne do roku 2025 jednoho z 56 hovorů se zákazníky. Krize kontaktních center se bude prohlubovat, protože podvodných aktivit na bázi umělé inteligence bude přibývat ve vysokých objemech.

Vlády začínají reagovat

V USA

- Federální obchodní komise zavedla nová pravidla, která uživatelům brání používat software pro vydávání se za hlas.

- FBI nyní upozorňuje veřejnost na phishingové útoky využívající technologii umělé inteligence.

- Několik amerických států přijalo nové právní předpisy, které se zaměřují na regulaci technologie deepfake.

Globálně

- Zákon EU o umělé inteligenci vyžaduje, aby veškerý obsah vytvořený umělou inteligencí vykazoval zjevné známky toho, že byl vytvořen umělou inteligencí.

- Několik států uzavřelo mezinárodní dohody, které jim umožňují prosazovat své zákony v různých zemích.

- Platformy umělé inteligence musí prokázat, že jejich systémy mají opatření, která zabraňují neoprávněnému použití jejich technologie.

Příležitost k dodržování předpisů

Organizace, které dnes zavedou pokročilé systémy pro odhalování podvodů s umělou inteligencí, se stanou lídry na trhu.

Organizace splní nadcházející předpisy dříve než ostatní, protože jejich konkurenti musí trávit čas doháněním.

Nové bezpečnostní paradigma

Nárůst počtu deepfake útoků 1300% proměnil digitální důvěryhodné operace v něco víc než jen v záležitost kybernetické bezpečnosti.

Strategický posun:

- Moderní hrozby přerostly současné systémy obrany perimetru, které již neposkytují dostatečnou ochranu.

- Bezpečnostní experti, kteří se léta věnují svému oboru, se nyní setkávají s deepfake útoky, proti kterým se nedokážou bránit.

- Současný přístup "důvěřuj, ale ověřuj" již není účinný, protože ověřování se musí stát trvalým operačním postupem.

- Je třeba nasadit systémy detekce v reálném čase, protože manuální metody odhalování nemohou odhalit hrozby dříve, než se stanou hrozbami.

Budoucnost patří připraveným

Organizace se musí rozhodnout, zda okamžitě nasadí systémy detekce umělé inteligence, aby zabránily podvodům typu "deepfake", které by měly v roce 2025 dosáhnout předpokládaného nárůstu 155%, nebo budou riskovat zveřejnění svých systémů.

Organizace, které jednají nyní, ochrání své finanční zdraví a zároveň si vybudují systémy důvěry, které jim zajistí vedoucí postavení na budoucím trhu založeném na umělé inteligenci.

V souboji AI versus AI uspějí ty společnosti, které jako první odhalí hrozby AI a rychle nasadí řešení.

Odkazy

- Pindrop (12. června 2025): "Pindrop's 2025 Voice Intelligence & Security Report" - 1,300% deepfake fraud surge, data z analýzy hovorů

- Unite.AI (před 20 hodinami): "Deepfakes, Voice Clones Fuel 148% Surge in AI Impersonation Scams" - statistika Identity Theft Resource Center

- Group-IB (6. srpna 2025): "Anatomie útoku Deepfake Voice Phishing" - asijsko-pacifický nárůst 194%, údaje o finančním dopadu

- J.P. Morgan (2025): "AI Scams, Deep Fakes, Impersonations" - $16,6 miliard ztrát z podvodů, nárůst o 33%

- Incode (20. prosince 2024): "Top 5 případů podvodů s umělou inteligencí od roku 2024" - průzkum společnosti Deloitte, podrobnosti o případu WPP

- Eftsure USA (2025): "Statistiky Deepfake (2025): 25 nových faktů pro finanční ředitele" - Mezery ve vzdělávání, statistiky důvěry zaměstnanců

- Security.org (26. srpna 2025): "2024 Deepfakes Guide and Statistics" - statistiky obětí klonování hlasu, regulační prostředí

- Americká advokátní komora (2025): "Co nás podvody Deepfake učí o umělé inteligenci a podvodech" - případová studie Brada Pitta, právní důsledky

- Axios (15. března 2025): "Podvody s klonováním hlasu umělou inteligencí: A persistent threat" - Consumer Reports study, FTC impersonation data