Чому останній прорив OpenAI став новим головним болем кожного керівника

Експеримент, який зламав інтернет

У квітні 2025 року простий експеримент у соціальних мережах сколихнув увесь світ кібербезпеки. Користувачі виявили, що GPT-4o від OpenAI може генерувати реалістичні підроблені картки Aadhaarнаціональна система ідентифікації особи в Індії, яка охоплює понад 1,3 мільярда людей.

Всього за кілька годин соціальні мережі заполонили згенеровані штучним інтелектом документи, що посвідчують особу, на яких зображені всі - від пересічних громадян до публічних осіб, таких як Сем Альтман та Ілон Маск.

Цифри були жахливими. З моменту випуску OpenAI GPT-4o вже створив понад 700 мільйонів зображень.

Більше ніколи не турбуйтеся про шахрайство зі штучним інтелектом. TruthScan Може допомогти тобі:

- Виявлення згенерованого ШІ зображення, текст, голос і відео.

- Уникайте велике шахрайство, кероване штучним інтелектом.

- Захистіть своє найдорожче чутливий активи підприємства.

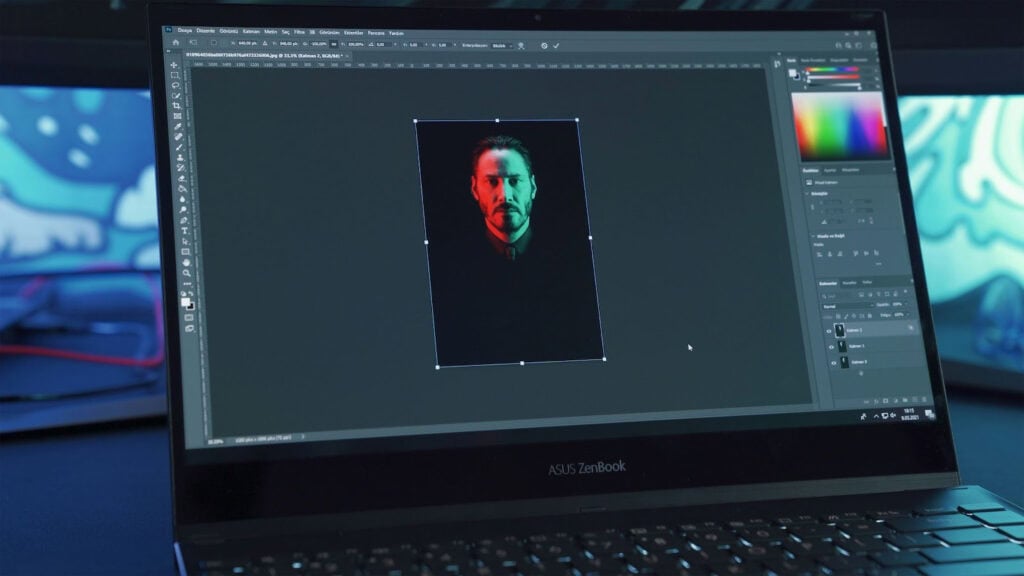

Те, що почалося як творчі експерименти з портретами у стилі Studio Ghibli, швидко переросло у щось більш загрозливе. Користувачі почали ділитися фотореалістичними макетами державних ідентифікаційних карток з QR-кодами, офіційним форматуванням і сфабрикованими особистими даними, які виглядали тривожно достовірними.

Технологія, що стоїть за загрозою: Чим відрізняється GPT-4o

Новий клас генерації зображень зі штучним інтелектом

На відміну від DALL-E, GPT-4o вбудований безпосередньо в ChatGPT. Ця зміна дає йому нові можливості, але також створює нові ризики.

Як визнає OpenAI в офіційній документації своєї системи: "Ці можливості, як окремо, так і в нових комбінаціях, мають потенціал для створення ризиків у низці сфер, причому таким чином, що попередні моделі не могли цього зробити".

Проблема доступності

Демократизація технологій генерації зображень створила те, що експерти називають "ідеальним штормом" для шахрайства з особистими даними.

По-перше, для цього не потрібні технічні навички. Будь-хто може створити фальшиві документи, просто набравши запит природною мовою. Результати є фотореалістичними, наближеними до офіційних макетів, шрифтів та дизайну.

Всього за кілька хвилин фальшиві посвідчення особи можна виготовити в масовому масштабі. А оскільки технологія працює в ідентифікаційних системах різних країн, загроза є глобальною.

Проблеми з навчальними даними

Найбільше занепокоєння викликає питання про джерела даних. Користувачі запитують, звідки GPT-4o отримав навчальні дані, щоб так точно відтворювати урядові документи. Користувачам цікаво, звідки модель отримала дані фотографій Aadhaar для навчання, і як вона змогла так точно вивчити формат.

Масштаби шахрайства з АІ-зображеннями: Зростаюча криза

Поточна статистика малює невтішну картину

Шахрайство, спричинене штучним інтелектом, є однією з найбільш швидкозростаючих загроз у сфері кібербезпеки:

- Глобальний рівень шахрайства збільшився з 1,10% у 2021 році до 2,50% у 2024 роцізбільшення на 127% всього за три роки

- На підроблені або змінені документи припадає 50% всіх спроб шахрайства у 2024 році, згідно зі звітом про шахрайство з особистими даними від Sumsub

- На цифрові підробки з використанням генеративного ШІ зараз припадає 57% всіх випадків шахрайства з документамищо на 244% більше, ніж у попередньому році

- Шахрайство з персональними даними, пов'язане з глибокими фейками, зросло в десять разів у 2023 році у порівнянні з попереднім роком

Фінансовий вплив у різних галузях

Економічні наслідки вже є серйозними і прискорюються:

- Шахрайство з використанням штучного інтелекту може коштувати $10,5 трильйонів у світі у 2025 роціза даними LexisNexis

- Шахрайство із синтетичними ідентифікаційними даними зросло на 31% оскільки шахраї все частіше використовують ШІ

- Половина опитаних компаній зіткнулася з шахрайством, пов'язаним із контентом, згенерованим штучним інтелектом у 2024 році

- Глобальні втрати від цифрового шахрайства сягнули понад 1 трлн 47,8 млрд доларів у 2024 році, що відображає збільшення на 15%

Сліпа пляма керівника: Чому лідери не готові до цього

Прогалина в обізнаності

Незважаючи на те, що загроза зросла, більшість керівників все ще ледве усвідомлюють її:

- 76% респондентів опитування побачили посилення регуляторних вимог заклик до посилення перевірки особистих даних

- На цифрові канали зараз припадає 51% випадків шахрайствавперше перевершивши фізичні канали

- Лише 43% фінансових організацій використовують передові методи верифікації коли з'являються червоні прапорці шахрайства

- Більшість організацій не мають комплексних стратегій виявлення шахрайства зі штучним інтелектом

Дефіцит підготовки кадрів

Розрив між новими загрозами і тим, наскільки готові до них організації, збільшується. Більшість тренінгів з безпеки все ще не охоплюють питання шахрайства зі штучним інтелектом, тому працівники не готові до нього. Досі немає широкого розповсюдження знань про глибокі підробки та зображення зі штучним інтелектом, а процедури верифікації не адаптовані до документації, створеної штучним інтелектом. Нарешті, можливості виявлення все ще недостатні порівняно з технологією генерації.

Вплив на промисловість: Сектори в облозі

Найбільш вразливі галузі

На основі статистики шахрайства за 2024 рік можна виокремити сектори, які стикаються з найбільшим ризиком:

- Платформи знайомств (рівень шахрайства 8,9%): Романтичні шахрайства з використанням фейкових профілів з документами, згенерованими штучним інтелектом

- Інтернет-ЗМІ (рівень шахрайства 4.27%): Обхід верифікації рахунку за допомогою синтетичних документів

- Банківська справа та страхування (рівень шахрайства 3,14%): Шахрайство при відкритті рахунків та кредитуванні

- Криптовалюта (88% випадків глибокого підроблення): Обхід KYC за допомогою згенерованих штучним інтелектом ідентифікаторів

Технологічна гонка озброєнь: виявлення проти покоління

Поточні можливості виявлення

Організації, які інвестували значні кошти в інструменти на основі штучного інтелекту для боротьби з шахрайством, що генерується штучним інтелектом, почали бачити результати: Системи виявлення шахрайства на основі АІ вже допомогли компаніям скоротити кількість випадків шахрайства приблизно на 30%.

Інші технології також досліджуються. Блокчейн може забезпечити сильніший захист даних, хоча для того, щоб бути ефективним, він все ще потребує ширшого впровадження.

Біометрична верифікація в поєднанні з аналізом документів створює більш надійну форму автентифікації.

Нарешті, виявлення в реальному часі стає потужним захистом. Вона підтверджує, що людина дійсно присутня, і не дає злочинцям використовувати підроблені статичні зображення під час верифікації.

Розрив у витонченості

Однак існує тривожна диспропорція між впевненістю у виявленні та фактичним запобіганням:

- Відсоток респондентів, які довіряють технологічним компаніям зберігати біометричні дані в безпеці, знизився з 29% у 2022 році до 5% у 2024 році

- Багато організацій переоцінюють свої можливості виявлення недооцінюючи при цьому витонченість загроз

- Традиційні заходи безпеки виявляються недостатніми проти документів, згенерованих штучним інтелектом

- Еволюція технологій виявлення відстає від розвитку поколінь

Регуляторне реагування: Правовий ландшафт

Чинна нормативно-правова база

Уряди в усьому світі намагаються боротися з шахрайством з документами, створеними за допомогою штучного інтелекту, але прогрес повільний:

- Регламент ЄС eIDAS набув чинності у травні 2024 року, вимагаючи посилення перевірки цифрової ідентичності

- Кілька країн мають укріплені захисні споруди навколо медичних даних та перевірки особистих даних

- Нові правила вимагають прозорості у процесах перевірки ідентичності на основі ШІ

- Кримінальні покарання існують для шахрайського використання документів, створених штучним інтелектом

Побудова захисту керівника: Комплексна стратегія захисту

1. Негайна оцінка ризиків

Аудит Поточні процеси верифікації: Проаналізуйте, як ваша організація перевіряє документи, що посвідчують особу, та визначте вразливості до шахрайства з використанням штучного інтелекту.

Визначте точки дотику з високим ризиком: Нанесіть на карту всі пункти, де приймають документи, що посвідчують особу, проводять адаптацію, відновлюють облікові записи, здійснюють транзакції на великі суми та перевіряють відповідність вимогам.

Оцініть можливості виявлення: Оцініть, чи можуть існуючі системи ідентифікувати документи, створені штучним інтелектом, і чи потрібно їх модернізувати.

2. Технологічні рішення

Розширений аналіз зображень: Розгортайте системи виявлення на основі ШІ, які можуть виявляти тонкі невідповідності в документах, створених штучним інтелектом:

- Аналіз текстури: Виявляйте неприродні шаблони у фонах документів та засобах захисту

- Перевірка узгодженості: Перевірка вирівнювання шрифтів, інтервалів та офіційного форматування

- Вивчення метаданих: Аналіз даних про створення зображень на наявність ознак генерації ШІ

- Перевірка в режимі реального часу: Впровадити системи, які можуть миттєво обробляти документи під час взаємодії з клієнтами

Багатофакторна перевірка: Поєднуйте аналіз документів з додатковими методами перевірки:

- Перевірка державних баз даних: Перехресні посилання на номери документів з офіційними базами даних

- Біометричне зіставлення: Використовуйте розпізнавання облич для зіставлення фотографій документів із живими людьми

- Поведінковий аналіз: Відстежуйте шаблони поведінки користувачів під час процесів верифікації

3. Навчання та підвищення обізнаності

Освіта для керівників: Команди керівників потребують спеціального навчання щодо ризиків шахрайства з використанням ШІ та наслідків для бізнесу від неналежної перевірки.

Програми навчання співробітників: Персонал, який працює на передовій, потребує навчання:

- Візуальні методи виявлення: Як виявити потенційні документи, створені штучним інтелектом

- Процедури верифікації: Коли і як ескалувати підозрілі документи

- Інтеграція технологій: Як ефективно використовувати інструменти виявлення

Постійні оновлення: Регулярне оновлення навчання в міру розвитку технологій генерації ШІ.

4. Редизайн процесу

Протоколи верифікації: Впровадити багатокрокову перевірку для сценаріїв з високим рівнем ризику:

- Аналіз первинних документів: Початкова оцінка з використанням технології виявлення

- Вторинна перевірка: Перехресне посилання на базу даних для перевірки автентичності документа

- Третинне підтвердження: Додаткова перевірка для високовартісних або підозрілих випадків

Обробка винятків: Чіткі процедури управління документами, які не пройшли перевірку або мають ознаки генерації ШІ.

Рішення: Розпізнавання зображень зі штучним інтелектом корпоративного рівня

Чому традиційні підходи не спрацьовують

Стандартна перевірка документів була розроблена для виявлення підробок старого зразка, а не документів, створених штучним інтелектом. Сучасна генерація АІ-зображень потребує не менш досконалих можливостей виявлення.

Поточні прогалини у верифікації включають

- Людська помилка: Рецензенти вручну не можуть надійно ідентифікувати складні документи, створені штучним інтелектом

- Обмежений технічний аналіз: Базова перевірка фокусується на очевидних змінах, пропускаючи тонкі індикатори ШІ

- Масштабні обмеження: Ручні процеси не можуть впоратися з обсягом спроб шахрайства, що генеруються штучним інтелектом

- Відставання еволюції: Статичні процедури верифікації не можуть адаптуватися до технологій ШІ, що швидко розвиваються

Потреба в спеціалізованому АІ-детекторі

Організаціям, які серйозно ставляться до захисту від шахрайства із зображеннями зі штучним інтелектом, потрібні спеціально розроблені системи виявлення, які можуть це зробити:

- Проаналізуйте маркери покоління ШІ: Виявляйте тонкі артефакти та патерни, унікальні для зображень, згенерованих штучним інтелектом

- Обробка в режимі реального часу: Забезпечити негайний аналіз під час подачі документів

- Безперервне навчання: Адаптуйтеся до нових технологій генерації ШІ, коли вони з'являються

- Можливості інтеграції: Безперешкодно працюйте з існуючими робочими процесами верифікації

Ефективні системи розпізнавання зображень зі штучним інтелектом використовують передові алгоритми для ідентифікації:

- Невідповідності на рівні пікселів: Тонкі закономірності, які вказують на створення ШІ

- Артефакти стиснення: Цифрові підписи процесів створення зображень зі штучним інтелектом

- Статистичні аномалії: Математичні патерни, які відрізняються від природних зображень

- Часові невідповідності: Ознаки маніпуляцій з зображенням або його створення

Підсумок: Шахрайство з зображеннями за допомогою штучного інтелекту вже тут і прискорюється

Статистика беззаперечна: Шахрайство з документами, згенерованими штучним інтелектом, перетворилося з теоретичної загрози на справжню реальність, що спричиняє мільярдні збитки.

Враховуючи, що лише GPT-4o вже згенерував понад 700 мільйонів зображень, а можливості штучного інтелекту швидко розвиваються, організації стикаються зі зростаючою загрозою, з якою не можуть впоратися традиційні заходи безпеки.

Вікно для проактивного захисту стрімко закривається.

Технологія створення переконливих фальшивих документів тепер доступна будь-кому, хто має доступ до інтернету. Тим часом, витонченість документів, створених штучним інтелектом, продовжує вдосконалюватися, що робить їх виявлення дедалі складнішим завданням для людей-рецензентів і базових систем верифікації.

Організації, які відмовляються адаптувати свої процеси верифікації до цієї нової реальності, стикаються з багатьма ризиками:

- Прямі фінансові втрати: Від шахрайства з використанням документів, згенерованих штучним інтелектом

- Регуляторні штрафи: За невідповідність посиленим вимогам верифікації

- Репутаційні збитки: Як уникнути зв'язку з інцидентами, пов'язаними з шахрайством з персональними даними

- Порушення операційної діяльності: З розслідувань та відновлювальних робіт

Питання не в тому, чи зіткнеться ваша організація з шахрайством з документами, створеними штучним інтелектом, а в тому, чи будете ви готові виявити і запобігти цьому.

Існує технологія, яка дозволяє боротися з шахрайством, створеним штучним інтелектом. Просунуті системи виявлення можуть ідентифікувати тонкі маркери, які відрізняють документи, створені штучним інтелектом, від справжніх. Але впровадження вимагає негайних дій, оскільки загроза еволюціонує щодня.

Зараз компаніям необхідно інвестувати в комплексні можливості розпізнавання зображень за допомогою штучного інтелекту, інакше вони ризикують стати черговою жертвою найбільш швидкозростаючої категорії шахрайства нашого часу.

Для керівників, готових захистити свої організації від шахрайства з використанням зображень зі штучним інтелектом, вже сьогодні доступна передова технологія виявлення. Дізнайтеся, як ШІ-розпізнавання зображень корпоративного рівня може захистити ваші процеси верифікації, на truthscan.com/ai-image-detector.

Посилання

- Outlook Money. "ChatGPT може генерувати фальшиві Aadhaar, PAN-карти: Ось що вам потрібно знати". Outlook Money5 квітня 2025 року. https://www.outlookmoney.com/news/chatgpt-can-generate-fake-aadhaar-pan-cards-heres-what-you-need-to-know

- Бізнес сьогодні. "Підроблений Aadhaar, PAN за допомогою ChatGPT: як розпізнати справжні державні документи, що посвідчують особу; кроки перевірки". Бізнес сьогодні5 квітня 2025 року. https://www.businesstoday.in/personal-finance/news/story/fake-aadhaar-pan-with-chatgpt-how-to-identify-real-government-id-proofs-check-steps-470849-2025-04-05

- Бізнес-стандарт. "ChatGPT може генерувати фальшиві Aadhaar, PAN-картки: Як їх перевірити". Бізнес-стандарт7 квітня 2025 року. https://www.business-standard.com/finance/personal-finance/chatgpt-can-generate-fake-aadhaar-pan-cards-how-to-verify-them-125040700728_1.html

- Новини OneIndia. "Чи може ChatGPT створювати картки Aadhaar та PAN-картки? Користувачі бомбардують соціальні мережі фальшивими посвідченнями особи". Новини OneIndia4 квітня 2025 року. https://www.oneindia.com/india/can-chatgpt-create-aadhaar-cards-pan-cards-netizens-bombard-social-media-with-fake-id-cards-4114335.html

- Технології для бізнесу сьогодні. "Підроблені картки Aadhaar викликають занепокоєння, оскільки інструмент зображень ChatGPT досягає 700 мільйонів створінь". Бізнес сьогодні4 квітня 2025 року. https://www.businesstoday.in/technology/news/story/fake-aadhaar-cards-spark-concern-as-chatgpts-image-tool-hits-700-million-creations-470750-2025-04-04

- MoneyLife. "Попередження про шахрайство: штучний інтелект створює "фальшиві" картки Aadhaar та PAN, що виглядають як справжні!" MoneyLife. https://www.moneylife.in/article/fraud-alert-ais-creating-genuinelooking-fake-aadhaar-pan-cards/76873.html

- Ринок аналітики даних. "ChatGPT викликає побоювання щодо шахрайства з ідентифікацією: Чи може він дійсно генерувати фальшиві Aadhaar та PAN-картки?" Ринок аналітики даних. https://www.datainsightsmarket.com/news/article/chatgpt-can-generate-fake-aadhaar-pan-cards-13557

- Ангел Один.. "ChatGPT може генерувати фальшиві Aadhaar та PAN-картки: Як їх перевірити". Ангел Один.8 квітня 2025 року. https://www.angelone.in/news/chatgpt-can-generate-fake-aadhaar-and-pan-cards-how-to-verify-them

- Оновлення біометричних даних. "Соціальний резонанс від паспортів та ідентифікаційних карток, створених за допомогою ChatGPT". Оновлення біометричних даних11 квітня 2025 року. https://www.biometricupdate.com/202504/social-buzzes-with-chatgpt-generated-passports-and-id-cards

- Munsif Daily. "Інструмент зображень ChatGPT, який використовується для створення Aadhaar і PAN-карт, викликає занепокоєння щодо конфіденційності та зловживань". Munsif Daily4 квітня 2025 року. https://munsifdaily.com/chatgpts-image-tool-used-to-generate-aadhaar-and-pan-cards/

- Snappt. "Тенденції верифікації ідентичності до 2025 року та перспективи на майбутнє". Snappt4 серпня 2025 року. https://snappt.com/blog/id-verification-trends/

- Snappt. "Статистика шахрайства з персональними даними на 2025 рік". Snappt20 листопада 2024 року. https://snappt.com/blog/identity-fraud-statistics/

- Sumsub. "Тенденції шахрайства до 2025 року: Від шахрайства, керованого штучним інтелектом, до крадіжки особистих даних та демократизації шахрайства". Sumsub. https://sumsub.com/blog/fraud-trends-sumsub-fraud-report/

- Sumsub. "Статистика крадіжок особистих даних та шахрайства у 2024 році". Sumsub. https://sumsub.com/fraud-report-2024/

- arXiv. "Виявлення шахрайства з використанням штучного інтелекту: Систематичний огляд". arXiv16 січня 2025 року. https://arxiv.org/html/2501.09239v1

- Довіряю. "Тенденції верифікації ідентичності у 2025 році і далі". Довіряю5 серпня 2025 року. https://www.entrust.com/blog/2025/02/identity-verification-trends-in-2025-and-beyond

- Кодуйте.. "Викрито топ-5 випадків шахрайства з використанням штучного інтелекту з 2024 року". Блог Incode20 грудня 2024 року. https://incode.com/blog/top-5-cases-of-ai-deepfake-fraud-from-2024-exposed/

- Mitek Systems. "Прогнози шахрайства до 2025 року: Розуміння нових загроз шахрайства". Mitek Systems12 грудня 2024 року. https://www.miteksystems.com/blog/2025-fraud-predictions-industry-innovators

- KYC Hub. "Топ-7 трендів у сфері верифікації особистих даних до 2025 року". KYC Hub30 грудня 2024 року. https://www.kychub.com/blog/identity-verification-trends/