Haziran 2025'te bir Google çalışanı, BT destek biriminden rutin bir arama gibi görünen bir telefon aldı.

Hattaki ses profesyonel, kendinden emin ve tamamen tanıdık geliyordu.

Teknisyen, çalışandan şirketin Salesforce sisteminde yeni bir uygulamayı onaylamasını istedi.

Saldırganlar birkaç dakika içinde Google'ın CRM'sine erişerek 2,55 milyon müşteri kaydını çaldı.

Bunu mümkün kılan şey, yapay zeka tarafından üretilen seslerin en güvenilir kimlik doğrulama yöntemlerinden biri olan iş arkadaşının sesini tanıma yöntemini yanıltacak kadar inandırıcı olduğu deepfake ses teknolojisinin kullanılmasıydı.

ShinyHunters grubuyla bağlantılı olan bu olay, saldırganların artık şirket sistemlerine girmek için yapay zekayı nasıl kullandıklarını gösteriyor.

Dünya çapında milyonlarca kuruluş için müşteri ilişkileri yönetiminin bel kemiği olan Salesforce, yeni nesil yapay zeka destekli sosyal mühendislik saldırılarının ana hedeflerinden biri haline geldi.

Salesforce Neden Deepfake Hedefi Oldu?

Salesforce'un büyümesi onu veri hırsızlığı için de büyük bir hedef haline getirdi.

Her şey merkezileştirildiğinden, tek bir ihlal birçok farklı şirketten milyonlarca müşteri kaydını açığa çıkarabilir.

WithSecure'un Tehdit İstihbaratı Başkanı Tim West'in belirttiği gibi:

Yapay Zeka Dolandırıcılığı Konusunda Bir Daha Asla Endişelenmeyin. TruthScan Sana yardım edebilirim:

- Üretilen yapay zekayı tespit edin görüntüler, metin, ses ve video.

- Kaçının Yapay zeka kaynaklı büyük dolandırıcılık.

- En değerli varlıklarınızı koruyun hassas kurumsal varlıklar.

"Scattered Spider gibi hack grupları SaaS ortamlarına erişim sağlamak için sosyal mühendislik kullanıyor. Saldırıları teknik olarak basit görünebilir, ancak bu onları daha az tehlikeli yapmaz."

Yeni WithSecure araştırmasına göre, Salesforce ortamlarındaki kötü niyetli faaliyetler 2025'in ilk çeyreğinde keskin bir artış gösterdi ve 2024'ün sonlarına kıyasla tespitlerde yirmi kat artış yaşandı.

Deepfakes Salesforce İhlalini Nasıl Besledi?

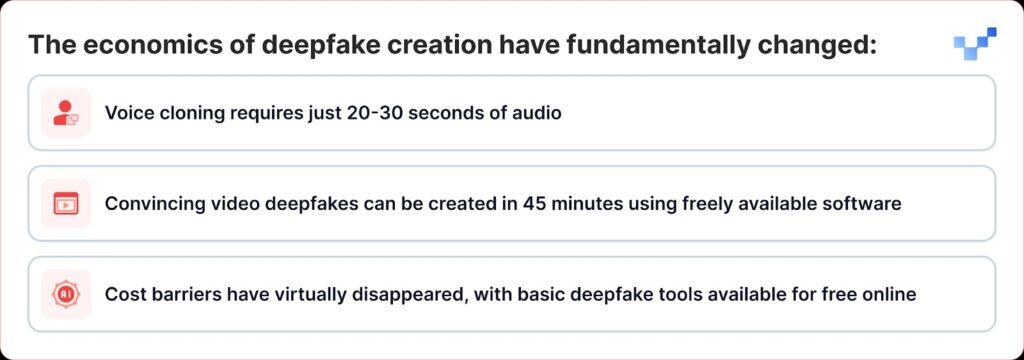

Son saldırıları özellikle tehlikeli kılan şey, deepfake teknolojisinin niş bir araçtan herkesin silah olarak kullanabileceği bir şeye dönüşmesidir.

Doğrudan veri tabanlarına giren geleneksel veri ihlallerinin aksine, siber suçlular artık ses tabanlı sosyal mühendislik veya "vishing" kullanıyor. Deepfake'lerin ve yapay zeka ses klonlamanın yükselişiyle birlikte bu saldırıları tespit etmek çok daha zor hale geliyor.

ShinyHunters'ın Salesforce müşterilerine karşı yürüttüğü kampanya, geleneksel sosyal mühendislik ile son teknoloji yapay zeka aldatmacasını birleştiren etkili bir oyun kitabını takip ediyor:

1. Aşama: Ses İstihbaratı Toplama

Saldırganlar, kamuya açık kaynaklardan, yönetici sunumlarından, konferans görüşmelerinden, şirket videolarından veya sosyal medya paylaşımlarından ses örnekleri toplayarak işe başlar.

20-30 saniye kadar net bir sesle, ikna edici ses klonları oluşturabilirler.

2. Aşama: Deepfake Vishing Çağrısı

Bir oltalama çağrısı sırasında saldırgan, kurbanı Salesforce'un bağlı uygulama kurulum sayfasına gitmeye ve Data Loader uygulamasının biraz değiştirilmiş markayla gizlenmiş sahte bir sürümünü onaylamaya ikna eder.

Böylece kurban farkında olmadan saldırganların Salesforce'tan hassas verileri çalmasına izin vermiş olur.

Gelişmişlik dikkat çekicidir. Bazı durumlarda saldırganlar, çalışanların kimliğine bürünmek ve yardım masası personelini hileli erişime izin vermeye ikna etmek için deepfake ses kullandılar.

Bu, saldırganların sadece otorite figürleri gibi davrandıkları geleneksel sesli kimlik avından, belirli kişiler gibi ses çıkarabildikleri yapay zeka ile geliştirilmiş taklitçiliğe doğru önemli bir evrimi temsil ediyor.

Aşama 3: OAuth İstismarı

Kötü amaçlı uygulama yetkilendirildiğinde, saldırganlar çok faktörlü kimlik doğrulamayı tamamen atlar.

Sahte uygulama onaylandıktan sonra saldırganlar, çok faktörlü kimlik doğrulamayı atlamalarına ve normal güvenlik uyarılarını tetiklemeden çalışabilmelerine olanak tanıyan uzun ömürlü OAuth belirteçleri elde ediyor.

Aşama 4: Sessiz Veri Çıkarma

Google'ın Tehdit İstihbarat Grubu, bir tehdit aktörünün hedeflenen her kuruluş için veri hırsızlığı sürecini otomatikleştirmek üzere bir Python aracı kullandığı ve araştırmacıların potansiyel olarak etkilenen 700'den fazla kuruluştan haberdar olduğu konusunda uyardı.

Yapay Zeka Seslerine Karşı Neden Savunmasızız?

Bu saldırıların başarısı temel bir insan özelliğinden faydalanmaktadır: duyduklarımıza güvenme eğilimimiz.

Yakın zamanda yapılan küresel bir araştırmaya göre, insanların yüzde 70'i gerçek bir ses ile klonlanmış bir sesi ayırt edebileceklerinden emin olmadıklarını söylüyor.

Yardım masası personelinin yardımsever ve uzlaşmacı olmak üzere eğitildiği ve uzaktan çalışmanın yalnızca sesli etkileşimleri normalleştirdiği kurumsal ortamlarda bu güvenlik açığı daha da artmaktadır.

CrowdStrike'ın 2025 Küresel Tehdit Raporu'na göre, 2024'ün ilk ve ikinci yarısı arasında sesli kimlik avı (vishing) saldırılarında, yapay zeka tarafından üretilen kimlik avı ve taklit taktiklerinin etkisiyle 442%'lik bir artış oldu.

$25 Milyon Uyandırma Çağrısı

Deepfake ile geliştirilmiş saldırıların etkileri Salesforce'un çok ötesine uzanıyor.

2024 yılının başlarında mühendislik firması Arup'ta gerçekleşen ve saldırganların bir video görüşmesinde birden fazla yöneticinin kimliğine bürünmek için yapay zeka kullandığı $25 milyonluk deepfake soygunu, hiçbir kuruluşun bu tehdide karşı bağışık olmadığını gösterdi.

Benzer saldırılar, Ferrari CEO'su Benedetto Vigna'nın güney İtalya aksanını taklit eden yapay zeka ile klonlanmış sesli aramalar kullanılarak taklit edilmesi girişimi de dahil olmak üzere farklı sektörlerdeki yöneticileri de hedef aldı.

Bu olaylar, güvenlik uzmanlarının "CEO dolandırıcılığı 2.0" olarak adlandırdıkları, deneyimli yöneticileri bile kandırabilecek çok duyulu aldatmacalar yaratmak için basit e-posta taklitlerinin ötesine geçen saldırıları temsil ediyor.

Platform Güvenliği ve İnsan Zafiyeti

Salesforce, bu ihlallerin kendi platformlarındaki güvenlik açıklarını temsil etmediğini vurgulamakta gecikmedi.

Salesforce, Mart 2025'te UNC6040'ın kampanyasını kabul ederek, saldırganların BT desteğini taklit ederek çalışanları kimlik bilgilerini vermeleri veya kötü niyetli bağlantılı uygulamaları onaylamaları için kandırdığı uyarısında bulundu.

Şirket, bu olayların platformundaki herhangi bir güvenlik açığını içermediğini veya bu açıklardan kaynaklanmadığını vurguladı.

Bu, tüm SaaS sağlayıcıları için büyük bir zorluk olduğunu gösteriyor: teknik kusurlar yerine insan güvenine oynayan saldırıları nasıl durduracaklarını bulmak.

Salesforce çeşitli savunma önlemlerini uygulamaya koymuştur:

- Bağlı uygulama sağlamlaştırma: Yeni kullanıcılar için yüklü olmayan bağlı uygulamaları otomatik olarak devre dışı bırakma

- OAuth akış kısıtlamaları: Belirli yetkilendirme süreçleri kullanılarak elde edilen bağlantıları devre dışı bırakma

- Gelişmiş izleme: Şüpheli uygulama yetkilendirme modellerinin gelişmiş tespiti

- Kullanıcı eğitimi: Sosyal mühendislik girişimlerini tanıma konusunda rehber yayınlama

Ağustos 2025'te Salesforce, ilgili saldırılarda OAuth belirteçlerinin çalındığını tespit ettikten sonra Drift uygulaması da dahil olmak üzere Salesloft teknolojileriyle tüm entegrasyonları kapattı.

Güvenlik uzmanları artık ekiplerin, bir sesin yapay zeka tarafından üretildiğini ortaya çıkarabilecek garip duraklamalar, arka plan gürültüsü veya ses hataları gibi ince ipuçlarını dinlemeleri gerektiği konusunda uyarıyor.

Kurumsal Yanıt: Teknoloji Çözümlerinin Ötesinde

Kuruluşlar, deepfake ile geliştirilmiş saldırılara karşı savunmanın teknolojik çözümlerden daha fazlasını gerektirdiğini anlamaya başlıyor; bu, güven ve doğrulama süreçlerinin temelden yeniden düşünülmesini gerektiriyor.

Sıfır Güven İletişimi

Beyond Identity tarafından sunulan RealityCheck, her katılımcıya kriptografik cihaz kimlik doğrulaması ve sürekli risk kontrolleri ile desteklenen, şu anda Zoom ve Microsoft Teams için mevcut olan görünür, doğrulanmış bir kimlik rozeti verir.

Bu tür çözümler, kurumsal iletişim için "asla güvenme, her zaman doğrula" modellerine doğru bir geçişi temsil etmektedir.

Geliştirilmiş Eğitim Programları

Resemble AI'ın deepfake simülasyon platformunu kullanan kuruluşlar, deepfake saldırılarının gerçek dünyada nasıl ortaya çıktığını göstermek için hiper-gerçekçi simülasyonlar kullanan platformu uyguladıktan sonra başarılı saldırılarda 90%'ye kadar azalma olduğunu bildiriyor.

Çok Kanallı Doğrulama

Önde gelen kuruluşlar, ilk iletişimin ne kadar gerçekçi göründüğüne bakılmaksızın, yüksek riskli talepler için birden fazla kanaldan doğrulama gerektiren protokoller uygulamaktadır.

Ses Artık Gerçek Olmadığında

Salesforce ve diğer kurumsal sistemlere yönelik deepfake tehdidi, siber güvenlik tarihinde bir dönüm noktasını temsil etmektedir.

Saldırganlar ilk kez sadece otorite figürlerini taklit etmekle kalmıyor; onlar gibi konuşabiliyor, onlar gibi görünebiliyor ve eğitimli güvenlik uzmanlarını bile kurumsal güvenliği tehlikeye atacak eylemlerde bulunmaya ikna edebiliyorlar.

Yapay zeka tarafından üretilen aldatma çağında güven, aşinalık yoluyla varsayılmamalı, doğrulama yoluyla kazanılmalıdır.

Bunu anlayan ve doğru araçlara, süreçlere ve kültüre yatırım yapan şirketler, giderek daha belirsiz hale gelen dijital dünyada hem güvenliği hem de güveni korumak için en iyi konumda olacaklardır.

Bu yeni gerçeklikte, hattın diğer ucundaki ses göründüğü gibi olmayabilir.

Derin sahtekarlıklar çağında, sürekli tetikte olmak güvenliğin bedelidir.