Giriş

Yapay zeka, finansal dolandırıcılık ortamını daha önce görülmemiş şekillerde dönüştürüyor. 2024'ün başlarında, dolandırıcılar yapay zeka tarafından üretilen derin taklitleri kullanarak bir video görüşmesinde yöneticilerin kimliğine büründü ve bir Hong Kong çalışanını $25 milyon dolandırıcılara[1][2]. Bu gibi olaylar, üretken yapay zekanın suçluları bankaları ve müşterilerini hedef alan son derece ikna edici dolandırıcılıklar yapma konusunda nasıl güçlendirdiğini gösteriyor. Düzenleyiciler alarm veriyor: ABD Hazinesi'nin FinCEN'i 2024'ün sonlarında, banka doğrulamalarını atlamak için sahte kimlik belgeleri de dahil olmak üzere yapay zeka tarafından oluşturulan "deepfake" medya kullanılarak artan dolandırıcılık konusunda bir uyarı yayınladı[3][4]. Bu teknik dokümanda en son gelişmeler incelenmektedir. Finansal hizmetlerde yapay zeka dolandırıcılığı trendleri ve kurumların savunmalarını nasıl güçlendirebileceklerini tartışıyor. Dolandırıcıların deepfake taklitlerden sentetik kimliklere kadar üretken yapay zekayı nasıl silah olarak kullandıklarını keşfediyor ve teknoloji ve stratejileri (aşağıdaki gibi gelişmiş tespit araçları dahil) özetliyoruz TruthScan) dolandırıcılık ekiplerinin ve yöneticilerinin bu gelişen tehdide karşı koyabilmek için kullanabilecekleri bir yöntemdir.

Finansal Hizmetlerde Temel Yapay Zeka Dolandırıcılık Trendleri

Yapay zeka ve makine öğrenimi, kötü aktörler tarafından daha büyük ölçekte ve karmaşıklıkta dolandırıcılık yapmak için kullanılıyor. Kayda değer Yapay zeka güdümlü dolandırıcılık taktikleri bankaları, fintech'leri ve sigortacıları etkilemektedir:

- Deepfake Taklit Dolandırıcılığı: Suçlular kullanır Yapay zeka tarafından oluşturulan video ve ses gerçek zamanlı olarak güvenilir kişileri (CEO'lar, müşteriler, vb.) taklit etmek. Örneğin, sahte banka havalelerini yetkilendirmek için vishing (sesli oltalama) saldırılarında gerçeğe yakın deepfake sesler kullanılmış ve yapay zeka tarafından hazırlanmış videolar, çalışanları sahte işlemleri onaylamaları için kandırmıştır[1][5]. Bu sentetik ortamlar, gerçekten düşündüğünüz kişiyle konuşup konuşmadığınızı bilmenizi zorlaştırarak yukarıdaki $25M deepfake vakası gibi yüksek değerli soygunlara olanak sağlıyor. Deepfake'ler giderek uygun fiyatlı ve üretimi kolayBir sesi klonlamak için 20-30 saniye kadar kısa bir süre veya görünüşte gerçek bir video oluşturmak için bir saatten az bir süre gerekir[6].

- Yapay Zeka ile Geliştirilmiş Kimlik Avı ve BEC: Üretken yapay zeka, kimlik avı e-postaları gibi sosyal mühendislik planlarını turbo şarj ediyor ve iş e-postalarının ele geçirilmesi (BEC). Yapay zeka sohbet robotları, mükemmel bir iş dilinde son derece kişiselleştirilmiş dolandırıcılık e-postaları hazırlayabilir, bir CEO'nun yazı stilini taklit edebilir veya büyük ölçekte ikna edici sahte satıcı faturaları oluşturabilir. Aslında, aşağıdaki gibi yeraltı araçları DolandırıcılıkGPT ve WormGPT (ChatGPT'nin filtrelenmemiş sürümleri) siber suçluların kimlik avı ve kötü amaçlı yazılım oluşturmayı otomatikleştirmelerine yardımcı olmak için ortaya çıkmıştır[7][8]. Bu, asgari becerilere sahip bir dolandırıcının kolaylıkla gösterişli kimlik avı kampanyaları veya kötü amaçlı kodlar oluşturabileceği anlamına geliyor. Yapay zeka sayesinde, tek bir suçlu binlerce özel dolandırıcılık e-postası veya kısa mesaj gönderebilir ve geleneksel dolandırıcılık girişimlerinin erişimini büyük ölçüde artırabilir. FBI'ın İnternet Suçları Merkezi şimdiden şunları gözlemledi $2,7 milyarın üzerinde 2022'de BEC dolandırıcılığına kurban gitti ve üretken yapay zeka önümüzdeki yıllarda bu kayıpları daha da artırma tehdidinde bulunuyor[9][10].

- Sentetik Kimlikler ve Belge Dolandırıcılığı: Üretken yapay zeka, sentetik kimlik dolandırıcılığında patlamayı körüklüyoren hızlı büyüyen mali suç türlerinden biridir[11][12]. Dolandırıcılar gerçek ve sahte kişisel verileri birleştirerek "Frankenstein" kimlikleri oluşturuyor, ardından yapay zekayı kullanarak gerçekçi destekleyici belgeler üretmek - sahte pasaportlardan banka hesap özetlerine ve maaş koçanlarına kadar[7]. AI görüntü oluşturucuları ve düzenleme araçları gerçek görünümlü kimlikler ve fotoğraflar sıradan incelemeyi geçen. Canlılık kontrolleri veya selfie doğrulamaları bile yapay zeka tarafından manipüle edilmiş görüntüler veya videolarla potansiyel olarak alt edilebilir. Suçlular, binlerce sahte kişiliğin (her biri yapay zeka tarafından oluşturulmuş profil resimleri, sosyal medya vb. ile) oluşturulmasını otomatikleştirerek, banka hesapları açabilir veya toplu olarak kredi başvurusunda bulunabilir ve para aklayabilir veya kredilerini ödeyemez hale gelebilirler. Sentetik kimlik dolandırıcılığından kaynaklanan kayıpların yaklaşık 2023 yılında $35 milyar[13]ve üretken yapay zeka, sahte kimlikleri daha ucuz ve tespit edilmesi daha zor hale getirerek bu eğilimi hızlandırıyor.

- Otomatik Dolandırıcılık ve Kaçakçılık: Yapay zeka sahte içerik oluşturmanın ötesinde dolandırıcılara da yardımcı oluyor planlarının başarısını en üst düzeye çıkarmak. Gelişmiş botlar, tespit tetikleyicilerinden kaçınmak için makine öğrenimini kullanarak çalınan kredi kartı bilgilerini e-ticaret sitelerinde hızlı bir şekilde test edebilir. Yapay zeka, suçluların bir kuruluşun güvenliğindeki en zayıf halkaları belirlemelerine ve hatta telefon tabanlı kimlik doğrulamasını yenmek için sesli yanıtları sentezlemelerine yardımcı olabilir. Dark web'deki bir sektör artık $20 kadar düşük bir fiyata "hizmet olarak dolandırıcılık" yapay zeka araçları satıyor[14]. Yapay zeka yeteneklerinin bu şekilde demokratikleşmesi, düşük seviyeli suçluların bile son derece sofistike dolandırıcılık saldırıları başlatabileceği anlamına geliyor. Silahlanma yarışı, tespitten kaçmaya kadar uzanıyor - dolandırıcılar, banka dolandırıcılıkla mücadele sistemlerini araştırmak ve filtrelerden geçecek bir yöntem bulana kadar yaklaşımlarını iyileştirmek için yapay zekayı kullanıyor[15]. Kısacası, yapay zeka dolandırıcılığın yapılmasına olanak sağlıyor daha önce görülmemiş bir ölçekte ve verimliliktegeleneksel savunmalara meydan okuyor.

Yapay zeka destekli bu taktikler halihazırda endişe verici bir hızla çoğalıyor. Çek sahteciliği veya kimlik avı gibi geleneksel dolandırıcılık planları yıllardır var, ancak yapay zeka bunların hacmini ve gerçekçiliğini artırıyor. Veriler net bir hikaye anlatıyor: Yapay zeka dolandırıcılığı dalgalanma.

Yapay Zeka Dolandırıcılığı Konusunda Bir Daha Asla Endişelenmeyin. TruthScan Sana yardım edebilirim:

- Üretilen yapay zekayı tespit edin görüntüler, metin, ses ve video.

- Kaçının Yapay zeka kaynaklı büyük dolandırıcılık.

- En değerli varlıklarınızı koruyun hassas kurumsal varlıklar.

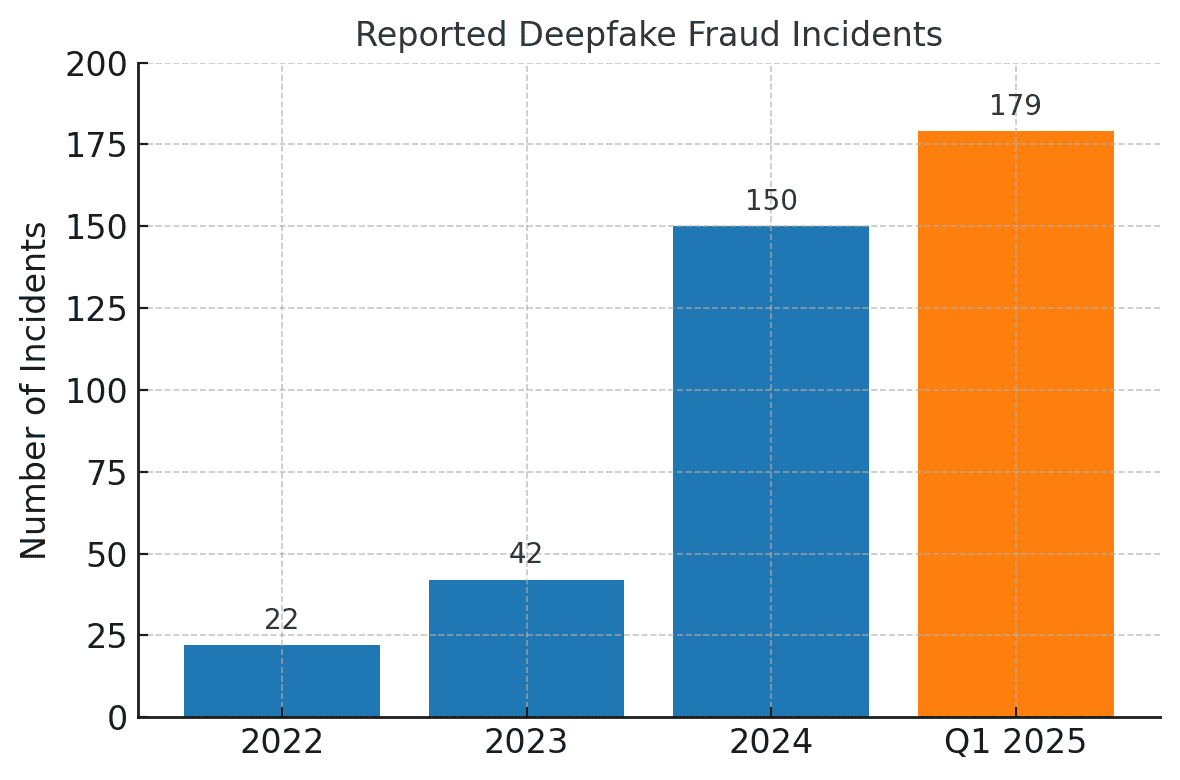

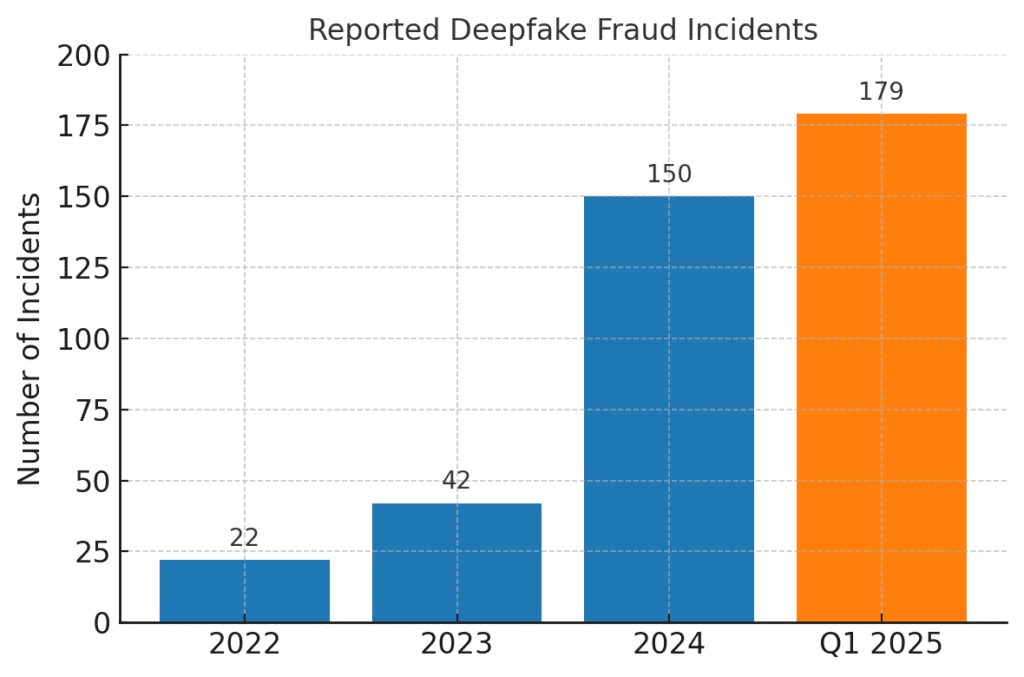

Deepfake ile ilgili dolandırıcılık olayları hızla arttı. 2022'de sadece 22 deepfake dolandırıcılık vakası kaydedilirken, 2023'te bu sayı 42'ye, 2024'te ise 150'ye çıkmıştır. 2025'in sadece ilk çeyreğinde, 179 deepfake dolandırıcılık olayı rapor edilmiştir - bu rakam 2024 yılının tamamındaki toplamı aşmaktadır[16][17].

Yakın zamanda yapılan sektör analizleri de bu eğilimleri yansıtmaktadır. Bir rapora göre 700% deepfake olaylarında artış 2023'te fintech firmalarını hedefliyor[18]. Daha da şaşırtıcı olanı, Kuzey Amerika'da 1,740% deepfake dolandırıcılık vakalarında artış 2022 ve 2023 yılları arasında[19]. Finansal suçlular bu araçları hızla benimsiyor çünkü işe yarıyorlar - birçok banka ve kurban henüz yapay zeka tarafından üretilen aldatmacayı tespit etmeye hazır değil.

Finansal Kurumlar için Etkiler ve Zorluklar

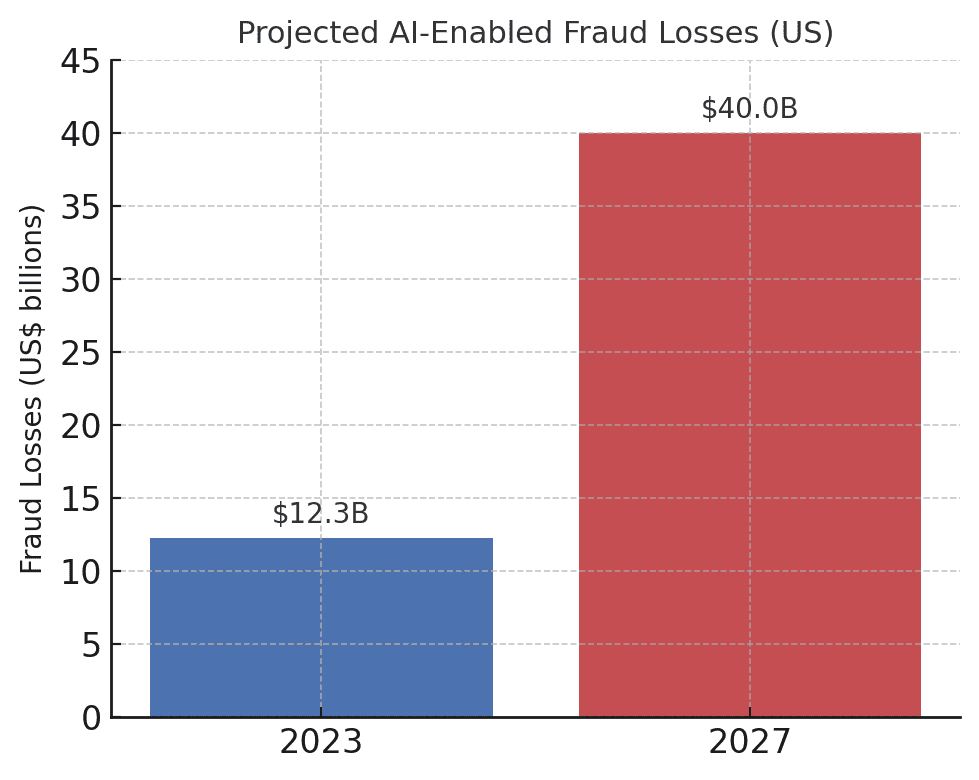

Yapay zeka odaklı dolandırıcılığın yükselişi önemli̇ etki̇ler finansal kuruluşlar, müşterileri ve daha geniş finansal sistem üzerinde. En yakın etki parasal kayıptır. Sektör tahminleri 2027 yılına kadar Üretken yapay zekanın sağladığı dolandırıcılık kayıpları ABD'de $40 milyara ulaşabilir2023'te $12,3 milyara yükseldi[20]. Bu üç kattan fazla artış (a 32% CAGR) dolandırıcılık riskinin dolar bazında ne kadar hızlı büyüdüğünü yansıtmaktadır.

Yapay zeka destekli dolandırıcılıktan kaynaklanan tahmini kayıplar dramatik bir şekilde artıyor. Deloitte, üretken yapay zeka ile bağlantılı ABD finansal dolandırıcılık kayıplarının 2023'te $12,3 milyardan 2027'de $40 milyara[20].

Ham kayıpların ötesinde, itibar ve güven maliyetleri. Tüketiciler bankalarının kendilerini korumasını bekliyor ancak yapay zeka kullanılarak yapılan dolandırıcılıklar dijital kanallara olan güveni sarsıyor. Örneğin, bir müşteri ikna edici bir deepfake dolandırıcılığının (sahte bir bankacı video araması gibi) kurbanı olursa, yetersiz güvenlik için bankayı suçlayabilir. Kamu güveni sesli doğrulama, e-postalar ve hatta video konferansta "gördükleriniz/duyduklarınız" artık gerçek kabul edilemezse aşınabilir[21]. Anketlere göre, ABD/İngiltere'deki finans profesyonellerinin 85%'si deepfake dolandırıcılığını kurumlarının güvenliğine yönelik "varoluşsal" bir tehdit olarak görmektedir[22]. Bu pazarlardaki şirketlerin yarısından fazlası deepfake destekli bir dolandırıcılık tarafından hedef alındığını bildiriyor ve endişe verici bir şekilde Hedef alınanların 43%'si saldırının başarılı olduğunu kabul etti onları kandırarak[23]. Her başarılı olay sadece maddi zarara yol açmakla kalmaz, aynı zamanda müşterilerin kuruma olan güvenini de sarsar.

Finans firmaları da şu sorunlarla boğuşuyor operasyonel ve uyum zorlukları yapay zeka dolandırıcılığından. Dolandırıcılıkla mücadele ekipleri, soruşturma kaynaklarını zorlayan uyarı ve olaylarda bir artışla karşı karşıyadır. Mevcut sahtekarlık tespit modelleri (birçoğu kurallara veya eski makine öğrenimi tekniklerine dayanan), meşru görünen yapay zeka tarafından sentezlenmiş içeriği tanımakta zorlanabilir. Aslında, laboratuvarlarda geliştirilen son teknoloji ürünü deepfake tespit sistemleri, aşağıdakilerle karşılaştıklarında doğruluklarının neredeyse 50% düştüğünü görüyor gerçek dünya deepfakes vahşi doğada[24]. İnsan personelin durumu da pek iyi değil - araştırmalar, insanların yalnızca yüksek kaliteli deepfake videoları tespit edebildiğini ortaya koyuyor Zamanın 55%-60%'siŞanstan biraz daha iyi[25]. Bu durum, yeni araçlar olmadan bankaların yapay zeka kaynaklı dolandırıcılık girişimlerinin büyük bir kısmını gözden kaçıracağını gösteriyor.

Ayrıca bir de düzenleyi̇ci̇ boyut. Düzenleyiciler ve kolluk kuvvetleri (FinCEN uyarısının da gösterdiği gibi) risklerin son derece farkında ve finans kuruluşlarının uyum sağlamasını bekliyorlar. Bankalar, yapay zeka çağında müşteri doğrulama ve dolandırıcılık raporlama konusunda daha sert kurallarla karşılaşabilir. Örneğin, bir banka çalışanının bir deepfake tarafından kandırılarak $10 milyonluk bir transferi onaylaması halinde, düzenleyiciler bankanın kontrollerini ve durum tespiti süreçlerini mercek altına alabilirler. Bu Banka Gizlilik Yasası artık şüpheli siber suçların ve deepfake ile ilgili faaliyetlerin raporlanmasını açıkça içeriyor[26][4]Bu da bankaların Şüpheli Faaliyet Raporlarında (SAR'lar) yapay zeka tarafından oluşturulan dolandırıcılık göstergelerini tanımaları ve raporlamaları için personelini eğitmesi gerektiği anlamına geliyor. Yapay zeka ile geliştirilmiş dolandırıcılık tekniklerine ayak uyduramamak, müşteriler veya karşı taraflar bankanın öngörülebilir yapay zeka destekli dolandırıcılıkları önlemek için yeterince çaba göstermediğini iddia ederse uyum ihlallerine veya yasal sorumluluğa yol açabilir.

Belki de en büyük zorluk bu yeni tehdidin asimetrik doğası. Üretken yapay zeka, saldırganlar için maliyet ve beceri engelini büyük ölçüde azaltırken, saldırıların hacmini ve gerçekçiliğini katlanarak artırır. Tek bir viral deepfake söylentisi veya ikna edici bir ses klonlama çağrısı, milyonlarca dolarlık kimlik doğrulama yatırımını alt edebilir. Bu arada savunucuların her işlem ve etkileşimin gerçekliğini doğrulaması gerekiyor ki bu çok daha zor bir görev. Bu gerçekten bir silahlanma yarışı: Yapay zeka, dolandırıcılara güvenliği atlatmak için kendi kendini güncelleyen bir araç seti sunuyor ve bankaların da savunmalarını sürekli güncellemelerini gerektiriyor[15][27]. Birçok finans kuruluşu yeterince hazırlıklı olmadıklarını kabul ediyor - Şirketlerin 80%'sinden fazlasının deepfake saldırılarına karşı resmi bir müdahale planı yokve yarısından fazlası deepfake riskleri konusunda çalışanlarına hiçbir eğitim vermemiştir[28][29]. Bu hazırlık açığı, kuruluşların şu anda savunmasız olduğu anlamına gelir, ancak aynı zamanda nerede harekete geçilmesi gerektiğini de vurgular.

Yakın tarihli bir sektör raporundan kayda değer ve ayıltıcı bir ölçüm geliyor: Finans sektöründeki dolandırıcılık girişimlerinin 42,5%'si artık bir tür yapay zeka içeriyor[30]. Başka bir deyişle, bankaların karşılaştığı dolandırıcılık saldırılarının neredeyse yarısı, ister yapay zeka tarafından oluşturulmuş bir belge, ister sentezlenmiş bir ses, ister makine tarafından oluşturulmuş bir kimlik avı mesajı olsun, bir yapay zeka bileşenine sahiptir. Bu istatistik, yapay zekanın gelecekteki varsayımsal bir tehdit olmadığının altını çiziyor; yapay zeka zaten burada ve finans kurumlarını uyum sağlamaya ya da artan kayıplarla yüzleşmeye zorluyor.

Yapay Zeka Destekli Dolandırıcılığa Karşı Savunma: Stratejiler ve Çözümler

Yapay zeka odaklı dolandırıcılıkla mücadele etmek, dolandırıcılık önleme stratejilerinde bir evrim gerektiriyor. Geleneksel yaklaşımlar (manuel doğrulama veya statik kural motorları gibi) şekil değiştiren yapay zeka dolandırıcılığı ile başa çıkamaz. Bunun yerine, bankalar şunları benimsemelidir teknoloji, eğitim ve ekip çalışması gelgiti tersine çevirmek için. Aşağıda, temel stratejileri ve ortaya çıkan çözümleri özetliyoruz:

- Yapay Zekayla Savaşmak için Yapay Zekadan Yararlanın (Gelişmiş Tespit Araçları): Finansal kurumlar giderek daha fazla Yapay zeka destekli algılama çözümleri Yapay zeka tarafından oluşturulan içeriği ve anormallikleri tanımlamak için. Özünde, ateşe ateşle karşılık vermeniz gerekir. Aşağıdakiler gibi yeni kurumsal araçlar TruthScan içeriğin gerçek zamanlı olarak doğrulanmasına yardımcı olmak için metin, görüntü, ses ve video genelinde çok modlu yapay zeka algılama sunar[31]. Örneğin bankalar, gelen iletişimleri (e-postalar, sohbet mesajları) kimlik avı e-postası veya sahte müşteri sorgusu anlamına gelebilecek yapay zeka tarafından oluşturulmuş dil işaretlerine karşı taramak için yapay zeka metin dedektörleri kullanabilir. TruthScan'in yapay zeka metin algılama sistemi, GPT-4 gibi modellerden yapay zeka ile yazılmış içeriği 99%+ doğrulukHatta hangi cümlelerin muhtemelen yapay zeka tarafından oluşturulduğunu bile tespit edebiliyor[32][33]. Benzer şekilde, yapay zeka görüntü adli tıp araçları belgeleri ve görüntüleri doğrulayabilir; bir AI Görüntü Dedektörü Gönderilen bir ehliyet veya faturanın dijital olarak oluşturulup oluşturulmadığını veya manipüle edilip edilmediğini, yapay zeka tarafından üretilen görüntülerin bilinen modelleriyle karşılaştırarak işaretleyebilir[34]. Sesli tehditler için bankalar şunları kullanmaya başlıyor voice deepfake dedektörleri - sentetik konuşmanın akustik parmak izleri için çağrı sesini analiz eden çözümler. Örneğin TruthScan'in Yapay Zeka Ses Dedektörü, ses klonlamasının belirgin işaretlerini dinler ve konuşmacının gerçekliğini doğrulayın Sahte aramaları önlemek için[35]. Finans kurumları, bu dedektörleri API aracılığıyla iş akışlarına entegre ederek, işlemlerin ve etkileşimlerin arka planında yapay zeka içeriğini otomatik olarak tarayabilir. Bu, makine hızında çalışan ve insan gözünün/kulağının kaçırabileceği şeyleri yakalayan ek bir savunma katmanı sağlar.

- Çok Faktörlü ve Bant Dışı Doğrulama Uygulayın: Yapay zeka seslere veya görüntülere güvenmeyi zorlaştırdıkça, bankalar yapay zekanın kolayca taklit edemeyeceği doğrulama yöntemlerine daha fazla güvenmelidir. Bu, güvenli kanallar kullanarak çok faktörlü kimlik doğrulamayı (MFA) içerir. Örneğin, bir havale talebi e-posta veya görüntülü arama yoluyla geliyorsa, talep sahibinin bilinen mobil cihazına gönderilen tek seferlik bir şifre veya dosyadaki güvenilir bir telefon numarasından geri arama gibi ikinci bir faktör isteyin. Bazı bankalar yüksek riskli işlemler için "canlılık" kontrolleri ekliyor - örneğin, bir müşteriden belirli bir jest veya kelimeyle canlı bir selfie çekmesini istemek, bu da bir deepfake videosunun kopyalanması için daha zordur. Biyometrik kimlik doğrulayıcılar sahteciliğe karşı önlemlerle geliştirilebilir (örneğin 3D yüz derinliği taraması veya deepfake'lerin genellikle taklit etmekte başarısız olduğu ince göz hareketlerinin izlenmesi)[27]). Önemli olan tek hata noktalarından kaçınmaktır. Bir yapay zeka deepfake'i bir kanalı kandırabilse bile (örneğin ses doğrulaması), koordineli bir bant dışı kontrol veya biyometrik test sahtekarlığı ortaya çıkarmak için gerekli zorluğu sağlayabilir. Sıfır güven ilkeleri uygulanmalıdır: istenmeyen veya beklenmeyen talimatları ("bilinen" bir yönetici veya müşteriden gelse bile) bağımsız bir kanaldan doğrulanana kadar şüpheli olarak değerlendirin.

- Çalışan Eğitimi ve Suistimal Farkındalığı: Teknoloji tek başına sihirli bir değnek değildir - özellikle de dolandırıcılar en zayıf halkayı hedef alacağından, ki bu genellikle insan güvenidir. Finans kurumları, dolandırıcılık önleme ekipleri ve ön saflardaki personel için yapay zeka tabanlı dolandırıcılıklar hakkında düzenli eğitimlere yatırım yapmalıdır. Çalışanlar deepfake ve sosyal mühendisliğin kırmızı bayraklarını tanımayı öğrenmelidir. Bu, ince anormallikler (örneğin bir video görüşmesinde dudak senkronizasyonu sorunları veya doğal olmayan tonlama veya çok az arka plan gürültüsü içeren ses - sentetik bir sesin potansiyel işaretleri) konusunda eğitimi içerebilir. Bir kültürü teşvik edin doğrulama: çalışanlar şüpheli bir işlemi veya talebi durdurma ve CEO'dan geliyor gibi görünse bile bağımsız olarak doğrulama yetkisine sahip olduklarını hissetmelidir. Dava konusu Ferrari CEO'sunun sesini taklit etme girişimi öğreticidir - bir yönetici, sahtekârın cevap veremediği kişisel bir soru sorarak hileyi ortaya çıkarmıştır[36]. Kimlik avı/sahte kimlik avı tatbikatlarının simülasyonu da faydalı olabilir. Şirketler personelini eğitmek için oltalama simülasyonları yaptıkları gibi, sahte bir sesli mesaj veya sahte bir görüntülü toplantı simülasyonu yapabilir ve çalışanların bunu tespit edip edemediğini görebilirler. Bu, gerçek saldırılara direnmek için kas hafızası oluşturur. Bu göz önüne alındığında şirketlerin 50%'sından fazlasının deepfake müdahale protokolü yok ve çok az eğitim var[29]Bu tür programların başlatılması, dayanıklılığın artırılması açısından önemli bir adımdır.

- Dolandırıcılık Analitiği ve Anomali Tespiti: Bankalar, dolandırıcılık analizlerini geliştirerek yapay zekayı savunma tarafında kullanmaya devam etmelidir. Modern dolandırıcılık tespit sistemleri, işlemleri gerçek zamanlı olarak analiz eden ve anormallikleri veya yüksek riskli modelleri işaretleyen makine öğrenimi modellerini kullanır. Bu modellerin, yapay zeka güdümlü dolandırıcılığın göstergesi olan sinyalleri içerecek şekilde güncellenmesi gerekir. Örneğin, bir makine öğrenimi modeli, bot güdümlü hesap ele geçirmelerle ilişkili meta verileri veya davranış kalıplarını (örneğin, inanılmaz derecede hızlı form doldurma süreleri veya otomatik bir komut dosyası olduğunu gösteren mükemmel tutarlı yazma kalıpları) tespit etmek için eğitilebilir. Dil modelleri, mesaj içeriğini analiz etmek ve bir tedarikçiden gelen bir e-postayı işaretlemek için kullanılabilir yapay zeka tarafından üretilen sesler veya aşırı kalıplaşmış (daha önce bahsedilen yapay zeka metin tespiti ile eşleştirilmiş). JPMorgan gibi bankalar, bir sosyal mühendislik girişimine işaret edebilecek ifadeleri veya bağlamları tespit etmek için iç iletişimlerinde büyük dil modelleri kullanmaya başladı[37]. Mastercard gibi ödeme ağları, geleneksel kuralların gözden kaçıracağı hileli işlemleri tespit etmek için yapay zeka ile geniş veri kümelerini (milyarlarca işlem) tarıyor[38]. Buradan çıkarılacak sonuç şudur savunmacı yapay zeka saldırgan YZ kadar yenilikçi olmalıdır. Firmalar özellikle deepfake içerikleri, sentetik kimlikleri ve jeneratif saldırı modellerini tespit etmek için YZ modelleri geliştirmeyi veya satın almayı düşünmelidir. En önemlisi, bu modeller en son YZ sahtekarlığı örnekleri (çevrimiçi öğrenme veya birleştirilmiş öğrenme adı verilen bir uygulama) üzerinde sürekli olarak yeniden eğitilmelidir, böylece suçluların hızla gelişen taktiklerine ayak uydurabilirler[39][40].

- İşbirliği ve Bilgi Paylaşımı: Yapay zeka destekli dolandırıcılıkla mücadele, hem kurumlar içinde hem de kurumlar arasında işbirliği gerektirecektir. Birbirinden kopuk çabalar, kurumsal sınırları aşan bir tehdide karşı daha az etkilidir. Dolandırıcılık önleme ekipleri, siber güvenlik ekipleri ve BT Örneğin, güvenlik ekipleri deepfake tespitini video konferans araçlarında kullanabilirken, dolandırıcılık ekipleri içerik taramalarını işlem izlemeye entegre edebilir. Daha geniş bir düzeyde, bankalar yeni yapay zeka dolandırıcılık planları hakkında istihbarat alışverişinde bulunmak için Finansal Hizmetler Bilgi Paylaşımı ve Analiz Merkezi (FS-ISAC) gibi sektör gruplarına katılmalıdır[41]. Bir banka yeni bir deepfake saldırı vektörü keşfederse, bu bilginin paylaşılması diğerlerinin saldırıya uğramadan önce açığı kapatmasına yardımcı olabilir. Sektör konsorsiyumları aracılığıyla veya düzenleyici desteği ile YZ içeren senaryolarla (örneğin, deepfake yönetici dolandırıcılığı veya YZ tarafından oluşturulan kimlik doğrulama baypası) ortak tatbikatlar veya "kırmızı ekip" simülasyonları gerçekleştirilebilir. Düzenleyicilerin kendileri de YZ risklerine odaklanmaktadır, bu nedenle onlarla proaktif olarak etkileşim kurmak akıllıca olacaktır. Bankalar, yapay zeka kullanımına yönelik standartlara ve kılavuzlara katkıda bulunarak daha güvenli bir ekosistemin şekillenmesine yardımcı olabilir. Nihayetinde, çünkü bir banka için tehdit, herkes için tehdittir bu alanda[42]kolektif bir savunma yaklaşımı, herkesin yapay zeka destekli dolandırıcılığı tespit etme ve caydırma kabiliyetini güçlendirecektir.

- Müşteri Eğitimi ve Güven Önlemleri: Son olarak, finans kurumları müşteri farkındalığının rolünü göz ardı etmemelidir. Genel halkı hedef alan deepfake ve yapay zeka dolandırıcılıkları (örneğin, büyükanne-büyükbaba dolandırıcılıklarındaki sahte sesler veya yapay zeka tarafından oluşturulan sahte "teknik destek" sohbetleri) ile bankalar, müşterilerin bu tehlikeler hakkında eğitilmesine yardımcı olabilir. Birçok banka halihazırda kimlik avı hakkında uyarılar göndermektedir; bunları yapay zeka ses klonlama ve deepfake videolardan bahsedecek şekilde genişletebilir ve taleplerin nasıl doğrulanacağına dair ipuçları sağlayabilirler. Bazı ilerici kuruluşlar anlık bildirimler veya bilinen bir dolandırıcılığın dolaşımda olması durumunda uygulamalarında uyarılar (örneğin, "Dikkat: dolandırıcılar para isteyen aile üyelerinin ses klonlarını kullanabilir")[43]. Eğitim, saldırıları doğrudan engellemese de başarı oranını azaltabilir ve bankanın güvenlik konusunda bir ortak olduğunu pekiştirebilir. Dahası, dolandırıcılığı önleme konusunda en son teknolojiye yatırım yapan bankalar, bunu müşterilerine bir avantaj olarak vurgulamalıdır. farklılaştırıcı - Örneğin, müşterilere tüm görüntülü aramaların veya gönderilen belgelerin yapay zeka tarafından doğruluk açısından tarandığını (hassas yöntemleri ifşa etmeden) bildirmek, bankanın onları korumak için mevcut her aracı kullandığı konusunda müşterilere güven verebilir. Dijital güveni korumak, bankaların yapay zekanın hizmetlerdeki faydalarından tam olarak yararlanabilmesi için kritik öneme sahip olacaktır, bu nedenle şeffaflık ve müşteri odaklı önlemler bütünsel bir savunmanın parçasıdır.

Yapay Zeka İçerik Tespit Hizmetlerinin Rolü

Yapay zeka çağında dolandırıcılıkla mücadele araç setinin temel taşlarından biri Yapay zeka içerik algılama hizmetleri. Bu hizmetler, yapay zeka tarafından üretilen içeriğin insan gözden geçiricilerin gözünden kaçabilecek "parmak izlerini" tespit etme konusunda uzmanlaşmıştır. TruthScan, kurumsal düzeyde bir yapay zeka Yapay Zeka Algılama Paketi birden fazla içerik türünü kapsar. Finans kurumları, sahtecilik ve dolandırıcılık göstergelerini otomatik olarak taramak için bu araçları entegre edebilir:

- Belge ve Görüntü Doğrulama: TruthScan'in platformu bankaların şunları yapmasını sağlar Finansal belgeleri gerçek zamanlı olarak yapay zeka tarafından oluşturulan sahtekarlığa karşı test edin[44]. Bu, yeni bir hesap açıldığında veya bir kredi başvurusu fotoğraflı bir kimlik ve maaş koçanı ile geldiğinde, sistemin bu görüntüleri sentetik üretim veya tahrifat belirtilerine karşı anında analiz edebileceği anlamına gelir. 99%'nin üzerinde hedef doğruluğu ile[45]Yapay Zeka Görüntü Dedektörü, bir insanın görünüşte onaylayabileceği sahte kimlik görüntülerini veya üzerinde oynanmış PDF'leri yakalayabilir. Bu tür bir belge gerçekli̇ği̇ doğrulama hesaplar daha açılmadan önce sentetik kimlik dolandırıcılığını durdurmak için çok önemlidir.

- Gerçek Zamanlı İşlem İzleme: TruthScan, API entegrasyonlarını kullanarak bankaların işlem süreçlerine bağlanabilir ve anormallikleri gerçek zaman. E-posta yoluyla şüpheli görünen bir talimat gelirse, E-posta Dolandırıcılık Dedektörü mesaj içeriğini analiz edebilir ve muhtemelen bir satıcıyı veya yöneticiyi taklit etmeye çalışan bir yapay zeka modeli tarafından yazılıp yazılmadığını tespit edebilir[46]. Benzer şekilde Gerçek Zamanlı Yapay Zeka Dedektörü canlı iletişimleri (sohbetler veya işbirliği platformları gibi) izleyebilir ve örneğin yüksek riskli bir toplantı sırasında sahtekar bir deepfake video akışı tespit edilirse anında uyarılar sağlayabilir[47][48]. Anlık uyarılar ve otomatik yanıtlarla sürekli izleme, dolandırıcılığın tespit edilmeden gerçekleşebileceği pencereyi daraltmaya yardımcı olur.

- Ses ve Video Deepfake Savunması: Çağrı merkezleri ve ilişki yöneticileri için TruthScan'in Yapay Zeka Ses Dedektörü ekstra bir güvenlik katmanı ekler. Bir dolandırıcı, bir ses klonunu kullanarak bir müşteriyi taklit etmek için ararsa, sistem arama sesini analiz edebilir ve yapay zeka tarafından sentezlenmiş unsurlar içerip içermediğini işaretleyebilir (eksik doğal mikro duraklamalar veya ses dalgalarındaki artefaktlar gibi)[35]. Video cephesinde ise Deepfake Dedektörü doğal olmayan yüz hareketleri, garip ışıklandırma veya uyumsuz dudak senkronizasyonu gibi tutarsızlıkları yakalamak için video karelerine bilgisayarla görme algoritmaları uygular[49][50]. Bankalar, kilit etkileşimlerde seslerin ve yüzlerin doğruluğunu teyit ederek çalışanlarını kandırmaya çalışan sahtekarları engelleyebilirler. Bu araçlar, arka planda görünmez bir şekilde çalışan, dijital içerik için yüksek teknolojili bir yalan dedektörü gibi hareket eder.

Bu tür bir tespit teknolojisini kullanmanın her derde deva bir tak-çalıştır yöntemi olmadığını belirtmek gerekir; bu teknoloji kalibre edilmeli ve kurumun iş akışlarına göre ayarlanmalıdır. Yanlış pozitifler yönetilmelidir (örneğin, bir yapay zeka metin dedektörü, farkı öğrenene kadar şablon tabanlı meşru iletişimleri şüpheli olarak işaretleyebilir). Bununla birlikte, uygun şekilde entegre edildiğinde, bu araçlar bir kuruluşun aşağıdakileri yapma becerisini önemli ölçüde geliştirir Hileli içeriği zarar vermeden önce tespit edin. Ayrıca, uyumluluk ve dolandırıcılık modellerinin sürekli olarak iyileştirilmesi için yararlı olan denetim izleri ve analitik raporlar oluştururlar.

Yapay zeka tespit araçlarının etkinliği önemli ölçüde şunlara bağlıdır sürekli güncellemeler. Antivirüs yazılımlarının yeni virüsler için yeni imzalara ihtiyaç duyması gibi, yapay zeka dedektörlerinin de en yeni deepfake teknikleri ve yapay zeka modelleri konusunda yeniden eğitilmesi gerekir. TruthScan gibi satıcılar algoritmalarını yeni jeneratif modeller ve kaçınma taktikleriyle başa çıkacak şekilde güncelleyerek YZ gelişirken bile yüksek doğruluğu koruyor[51]. Bu, kurum içi ekiplerin yükünü hafifletir ve suçlular yeni yapay zeka numaralarına geçerken bankaların dünün savaşıyla mücadele etmemesini sağlar.

Sonuç

Finansal hizmetler sektörü dolandırıcılıkla mücadelede bir yol ayrımında duruyor. Bir tarafta suçlular, her zamankinden daha ikna edici ve yaygın dolandırıcılıklar başlatmak için üretken yapay zekayı hızla benimsiyor. Öte yandan, bankalar ve dolandırıcılıkla mücadele edenlerin ellerinde yapay zekâya dayalı savunmalardan oluşan genişleyen bir cephanelik var. Başarılı olacak kurumlar şunlardır yeni tehdit ortamının farkına varmak ve aynı ustalıkla karşılık vermek. Bu, gelişmiş tespit yeteneklerine yatırım yapmak, çok katmanlı doğrulama süreçlerini entegre etmek, hem personeli hem de müşterileri eğitmek ve bir teyakkuz ve uyum kültürünü teşvik etmek anlamına gelir.

Yapay zeka destekli dolandırıcılık hızlı hareket eden bir hedeftir - bugün bir şirketi kandıran deepfake dolandırıcılığına yarın yeni tespit teknikleriyle karşı konulabilir, ancak dolandırıcılar gelecek hafta yöntemlerini değiştirebilir. Bu nedenle, 2025 yılında "endüstri standardı" bir suistimal önleme stratejisi, çevikliği ve sürekli iyileştirmeyi vurgulayan bir stratejidir. Finansal kuruluşlar dolandırıcılık savunma sistemlerini yaşayan, öğrenen varlıklar Suç taktiklerine paralel olarak gelişen. Teknoloji sağlayıcılarıyla ortaklıklardan yararlanmak, bu yetenekleri geliştirmek için akıllıca bir kestirme yoldur. Örneğin, TruthScan (bankacılık ve finans için özel çözümler sunan) gibi uzmanlaşmış firmalarla işbirliği yapmak, bir kurumun aşağıdakileri yapabilmesini hızlandırabilir mevzuata uygunluğu ve müşteri güvenini korurken yapay zeka destekli dolandırıcılığı önleyin[52].

Nihayetinde, yapay zeka kaynaklı dolandırıcılığa karşı korunmak sadece teknolojiyle ilgili değildir - temel değerleri korumakla ilgilidir güven finansın temelini oluşturur. Müşteriler, bankalarının gerçek bir işlemi sahtesinden, gerçek bir müşteriyi bir YZ sahtekarından ayırt edebileceğine güven duymalıdır. Finansal hizmet firmaları, son teknoloji yapay zeka tespit araçları kullanarak, doğrulama protokollerini güçlendirerek ve ortaya çıkan tehditlerin önüne geçerek bu güveni koruyabilir. Önümüzdeki yol hiç şüphesiz düşmanlar tarafından daha fazla dolandırıcılık inovasyonu girişimini içerecektir, ancak hazırlıklılık ve doğru yatırımlarla bankalar şunları sağlayabilir Yapay zeka bir tehditten çok bir varlık haline geliyor dolandırıcılığı önleme alanında. Bu ulaşılabilir bir hedeftir: finansal sistemimizin bütünlüğünü korumak için yıkım tehdidinde bulunan aynı yapay zeka teknolojilerinden faydalanılabilir. Şimdi dolandırıcılık önleme ekiplerinin ve C düzeyindeki yöneticilerin kararlı bir şekilde hareket etme zamanıdır, dolandırıcıları alt etmek için gelişmiş çözümleri ve stratejileri benimsemek ve dijital finansın geleceğini güvence altına alın.

Kaynaklar: Yakın tarihli sektör raporları, düzenleyici uyarılar ve teknoloji teknik incelemelerine referans verilmiştir (Deloitte[20][18], Dünya Ekonomik Forumu[19][24], ABD Hazinesi FinCEN[3][4], Federal Rezerv[13], Keepnet Labs[16][30]diğerlerinin yanı sıra) veri ve örnekler sağlamak için. Okuyucuların daha fazla araştırma yapabilmeleri için tüm veri ve örneklere satır içi atıfta bulunulmuştur.

[1] [9] [10] [14] [15] [18] [20] [37] [38] [42] [43] Deepfake bankacılık ve yapay zeka dolandırıcılık riski | Deloitte Insights

[2] [5] [6] [19] [21] [24] [25] [27] [36] [39] [40] [41] Deepfake çağında tehlikeli yapay zekayı tespit etmek şart | Dünya Ekonomik Forumu

[3] [4] [26] FinCEN, Finansal Kurumları Hedef Alan Deepfake Medya İçeren Dolandırıcılık Planları Hakkında Uyarı Yayınladı | FinCEN.gov

[7] [8] FraudGPT ve GenAI: Dolandırıcılar bundan sonra yapay zekayı nasıl kullanacak? | Alaşım

[11] Sentetik kimlik dolandırıcılığı: Yapay zeka oyunu nasıl değiştiriyor - Federal Reserve Bank of Boston

[12] [13] Üretken Yapay Zeka Sentetik Kimlik Dolandırıcılığı Tehditlerini Artırıyor

[16] [17] [22] [23] [28] [29] [30] Deepfake İstatistikleri ve Trendleri 2025 | Temel Veriler ve İçgörüler - Keepnet

[31] [34] [35] [46] [47] [48] TruthScan - Kurumsal Yapay Zeka Tespiti ve İçerik Güvenliği

[32] [33] [51] Yapay Zeka Dedektörü: Kurumsal Sınıf Yapay Zeka Metin Algılama - TruthScan

[44] [45] [52] Bankacılık Yapay Zeka Dolandırıcılık Tespiti | CRO Çözümleri | TruthScan

[49] [50] Deepfake Dedektörü - Sahte ve Yapay Zeka Videolarını Tanımlayın - TruthScan