В июне 2025 года сотрудник Google получил, казалось бы, обычный звонок из службы ИТ-поддержки.

Голос на линии звучал профессионально, уверенно и совершенно знакомо.

Техник попросил сотрудника одобрить новое приложение в системе Salesforce компании.

В течение нескольких минут злоумышленники получили доступ и похитили 2,55 миллиона записей о клиентах из CRM Google.

Это стало возможным благодаря использованию технологии deepfake audio: голоса, сгенерированные искусственным интеллектом, были настолько убедительны, что обманули одну из самых надежных форм аутентификации - распознавание голоса коллеги.

Этот инцидент, связанный с группой ShinyHunters, показывает, как злоумышленники используют искусственный интеллект для взлома систем компаний.

Являясь основой управления взаимоотношениями с клиентами для миллионов организаций по всему миру, Salesforce стала одной из главных мишеней для нового поколения социально-инженерных атак с использованием искусственного интеллекта.

Почему Salesforce стала мишенью для подделок

Рост компании Salesforce также превратил ее в большую мишень для кражи данных.

Поскольку все централизовано, в результате одной утечки могут быть раскрыты миллионы записей о клиентах из разных компаний.

Как отмечает руководитель отдела аналитики угроз компании WithSecure Тим Уэст:

Никогда больше не беспокойтесь о мошенничестве с помощью искусственного интеллекта. TruthScan Мы можем помочь вам:

- Обнаружение сгенерированного искусственного интеллекта изображения, текст, голос и видео.

- Избегайте Крупнейшее мошенничество, управляемое искусственным интеллектом.

- Защитите свои самые чувствительный активы предприятия.

"Хакерские группы вроде Scattered Spider используют социальную инженерию для получения доступа к SaaS-средам. Их атаки могут выглядеть технически простыми, но это не делает их менее опасными".

Согласно новому исследованию WithSecure, вредоносная активность в средах Salesforce резко возросла в первом квартале 2025 года, причем количество обнаружений увеличилось в двадцать раз по сравнению с концом 2024 года.

Как фальшивки привели к взлому Salesforce

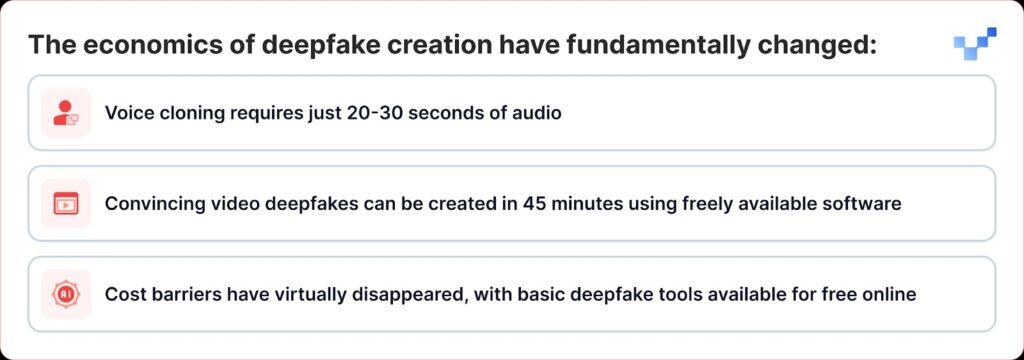

Особую опасность последним атакам придает то, что технология deepfake превратилась из нишевого инструмента в то, что каждый может использовать в качестве оружия.

В отличие от традиционной утечки данных, при которой взламываются непосредственно базы данных, теперь киберпреступники используют голосовую социальную инженерию, или "вишинг". С появлением глубоких подделок и клонирования голоса с помощью искусственного интеллекта такие атаки становится все сложнее обнаружить.

Кампания ShinyHunters, направленная против клиентов Salesforce, следует эффективной схеме, сочетающей традиционную социальную инженерию и передовой искусственный интеллект для обмана:

Этап 1: Сбор голосовой информации

Злоумышленники начинают с того, что собирают аудиозаписи из открытых источников, презентаций руководителей, конференц-звонков, видеоматериалов компании или постов в социальных сетях.

Всего за 20-30 секунд чистого звука они могут создать убедительные голосовые клоны.

Этап 2: Вишинг-вызов Deepfake

Во время вишингового звонка злоумышленник убеждает жертву перейти на страницу настройки подключенных приложений Salesforce и одобрить поддельную версию приложения Data Loader, замаскированную слегка измененным брендом.

Таким образом, жертва неосознанно позволяет злоумышленникам украсть конфиденциальные данные из Salesforce.

Изощренность поражает воображение. В некоторых случаях злоумышленники использовали поддельные аудиозаписи, чтобы выдать себя за сотрудников и убедить сотрудников службы поддержки разрешить несанкционированный доступ.

Это значительная эволюция от традиционного голосового фишинга, когда злоумышленники просто выдавали себя за авторитетных людей, к имперсонации с помощью искусственного интеллекта, когда они действительно могут выдавать себя за конкретных людей.

Этап 3: Эксплуатация OAuth

После авторизации вредоносного приложения злоумышленники полностью обходят многофакторную аутентификацию.

После одобрения поддельного приложения злоумышленники получают долгоживущие токены OAuth, которые позволяют им обходить многофакторную аутентификацию и работать, не вызывая обычных предупреждений системы безопасности.

Этап 4: Бесшумное извлечение данных

Группа разведки угроз Google предупредила, что угрожающий субъект использовал инструмент Python для автоматизации процесса кражи данных для каждой организации, на которую была направлена атака. Исследователям известно о более чем 700 потенциально пострадавших организациях.

Почему мы уязвимы перед голосами искусственного интеллекта

Успех этих атак основан на фундаментальной человеческой черте: нашей склонности доверять тому, что мы слышим.

Согласно одному из последних глобальных исследований, 70 % людей говорят, что не уверены в том, что смогут отличить настоящий голос от клонированного.

Эта уязвимость усугубляется в корпоративной среде, где сотрудники службы поддержки обучены быть услужливыми и сговорчивыми, а удаленная работа привела к нормализации взаимодействия только по аудиосвязи.

Согласно отчету CrowdStrike о глобальных угрозах за 2025 год, в первой и второй половине 2024 года число голосовых фишинговых атак (вишинг) увеличилось на 442%, что обусловлено тактиками фишинга и самозванства, создаваемыми искусственным интеллектом.

Пробуждение $25 миллионов

Последствия атак с использованием deepfake выходят далеко за пределы Salesforce.

Афера с глубокой подделкой на сумму $25 миллионов в инженерной компании Arup в начале 2024 года, где злоумышленники использовали искусственный интеллект, чтобы выдать себя за нескольких руководителей во время видеозвонка, показала, что ни одна организация не застрахована от этой угрозы.

Подобные атаки также были направлены на руководителей различных отраслей, включая попытку выдать себя за генерального директора Ferrari Бенедетто Винья с помощью клонированных искусственным интеллектом голосовых вызовов, имитирующих его южный итальянский акцент.

Эти инциденты представляют собой то, что эксперты по безопасности называют "мошенничеством для руководителей 2.0" - атаки, которые выходят за рамки простого пародирования электронной почты и создают мультисенсорные обманы, способные одурачить даже опытных руководителей.

Безопасность платформы против уязвимости человека

Компания Salesforce поспешила подчеркнуть, что эти взломы не являются уязвимостью самой платформы.

Компания Salesforce признала факт кампании UNC6040 в марте 2025 года, предупредив, что злоумышленники выдают себя за сотрудников службы ИТ-поддержки, чтобы обманом заставить их передать учетные данные или одобрить вредоносные подключенные приложения.

Компания подчеркнула, что эти инциденты не связаны с какими-либо уязвимостями в ее платформе и не являются их следствием.

Это говорит о том, что перед всеми поставщиками SaaS стоит серьезная задача: понять, как остановить атаки, которые играют на доверии людей, а не на технических недостатках.

Salesforce предприняла ряд защитных мер:

- Усиление защиты подключенных приложений: Автоматическое отключение неустановленных подключенных приложений для новых пользователей

- Ограничения потока OAuth: Запрет соединений, полученных с помощью определенных процессов авторизации

- Усовершенствованный мониторинг: Улучшенное обнаружение подозрительных шаблонов авторизации приложений

- Обучение пользователей: Публикация руководства по распознаванию попыток социальной инженерии

В августе 2025 года компания Salesforce закрыла все интеграции с технологиями Salesloft, включая приложение Drift, после того как обнаружила, что токены OAuth были украдены в ходе соответствующих атак.

Эксперты по безопасности теперь предупреждают, что команды должны прислушиваться к едва уловимым признакам, таким как странные паузы, фоновый шум или звуковые сбои, которые могут показать, что голос был сгенерирован искусственным интеллектом.

Ответ предприятия: За пределами технологических решений

Организации начинают понимать, что защита от атак с использованием deepfake требует не только технологических решений, но и фундаментального переосмысления процессов доверия и проверки.

Общение с нулевым доверием

RealityCheck от Beyond Identity дает каждому участнику видимый, проверенный бейдж, который поддерживается криптографической аутентификацией устройств и постоянной проверкой рисков. В настоящее время эта технология доступна для Zoom и Microsoft Teams.

Такие решения представляют собой переход к модели "никогда не доверяй, всегда проверяй" для корпоративных коммуникаций.

Расширенные программы обучения

Организации, использующие платформу моделирования глубоких подделок Resemble AI, сообщают о сокращении числа успешных атак на 90% после внедрения платформы, которая использует гиперреалистичное моделирование для иллюстрации того, как глубокие поддельные атаки разворачиваются в реальном мире.

Многоканальная верификация

Ведущие организации внедряют протоколы, требующие проверки по нескольким каналам для любых запросов с высоким риском, независимо от того, насколько подлинным кажется первоначальное сообщение.

Когда голос перестает быть правдой

Угроза deepfake для Salesforce и других корпоративных систем представляет собой переломный момент в истории кибербезопасности.

Впервые злоумышленники могут не просто выдавать себя за авторитетных людей - они могут говорить как они, выглядеть как они и убеждать даже подготовленных специалистов по безопасности совершать действия, которые ставят под угрозу безопасность организации.

В эпоху обмана, генерируемого искусственным интеллектом, доверие нужно заслужить путем проверки, а не предполагать его на основе знакомства.

Компании, которые понимают это и инвестируют в правильные инструменты, процессы и культуру, окажутся в наилучшем положении для защиты безопасности и доверия в условиях все более неопределенного цифрового мира.

В этой новой реальности голос на другом конце линии может оказаться не тем, кем кажется.

В эпоху фальшивок постоянная бдительность - это цена безопасности.