În iunie 2025, un angajat Google a primit ceea ce părea a fi un apel de rutină de la asistența IT.

Vocea de pe linie părea profesionistă, încrezătoare și complet familiară.

Tehnicianul i-a cerut angajatului să aprobe o nouă aplicație în sistemul Salesforce al companiei.

În câteva minute, atacatorii au avut acces și au furat 2,55 milioane de înregistrări ale clienților din CRM-ul Google.

Acest lucru a fost posibil datorită utilizării tehnologiei audio deepfake, cu voci generate de AI atât de convingătoare încât au păcălit una dintre cele mai de încredere forme de autentificare, recunoașterea vocii unui coleg.

Acest incident, legat de grupul ShinyHunters, arată cum atacatorii folosesc acum inteligența artificială pentru a pătrunde în sistemele companiilor.

Fiind coloana vertebrală a gestionării relațiilor cu clienții pentru milioane de organizații din întreaga lume, Salesforce a devenit una dintre principalele ținte pentru o nouă generație de atacuri de inginerie socială bazate pe inteligență artificială.

De ce Salesforce a devenit o țintă Deepfake

Creșterea Salesforce a transformat-o, de asemenea, într-o țintă importantă pentru furtul de date.

Deoarece totul este centralizat, o singură breșă poate expune milioane de înregistrări ale clienților din mai multe companii diferite.

După cum remarcă Tim West, șeful departamentului de informații privind amenințările din cadrul WithSecure:

Nu vă mai îngrijorați niciodată de frauda AI. TruthScan Vă poate ajuta:

- Detectarea AI generate imagini, text, voce și video.

- Evitați fraudă majoră generată de IA.

- Protejați-vă cele mai sensibile activele întreprinderii.

"Grupuri de hackeri precum Scattered Spider utilizează ingineria socială pentru a obține acces la mediile SaaS. Atacurile lor pot părea simple din punct de vedere tehnic, dar asta nu le face mai puțin periculoase."

Conform noii cercetări WithSecure, activitatea malițioasă din mediile Salesforce a crescut brusc în primul trimestru al anului 2025, cu o creștere de douăzeci de ori a detecțiilor comparativ cu sfârșitul anului 2024.

Cum au alimentat Deepfakes o breșă Salesforce

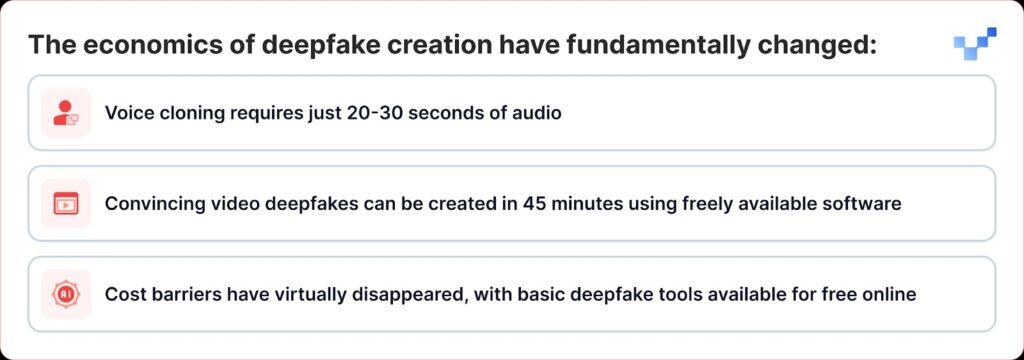

Ceea ce face atacurile recente deosebit de periculoase este modul în care tehnologia deepfake s-a transformat dintr-un instrument de nișă într-un instrument pe care oricine îl poate folosi ca armă.

Spre deosebire de breșele de date tradiționale care pătrund direct în bazele de date, infractorii cibernetici folosesc acum ingineria socială bazată pe voce, sau "vishing". Odată cu apariția deepfakes și a clonării vocii AI, aceste atacuri devin mult mai greu de depistat.

Campania ShinyHunters împotriva clienților Salesforce urmează un plan de acțiune eficient care combină ingineria socială tradițională cu înșelăciunea AI de ultimă oră:

Faza 1: Culegerea de informații vocale

Atacatorii încep prin recoltarea de mostre audio din surse publice, prezentări executive, conferințe telefonice, videoclipuri ale companiei sau postări pe rețelele sociale.

Cu doar 20-30 de secunde de sunet clar, ei pot crea clone vocale convingătoare.

Faza 2: Apelul Deepfake Vishing

În timpul unui apel de tip vishing, atacatorul convinge victima să acceseze pagina de configurare a aplicației conectate Salesforce și să aprobe o versiune falsă a aplicației Data Loader, deghizată cu un brand ușor modificat.

Astfel, victima lasă atacatorii să fure, fără să știe, date sensibile din Salesforce.

Nivelul de sofisticare este remarcabil. În unele cazuri, atacatorii au folosit un sistem audio de tip deepfake pentru a se da drept angajați și a convinge personalul biroului de asistență să autorizeze accesul necinstit.

Aceasta reprezintă o evoluție semnificativă de la phishing-ul vocal tradițional, în care atacatorii pur și simplu pretindeau că sunt figuri autoritare, la impersonarea îmbunătățită de inteligență artificială, în care pot suna ca anumite persoane.

Faza 3: Exploatarea OAuth

Odată ce aplicația malițioasă este autorizată, atacatorii ocolesc complet autentificarea multifactorială.

După ce aplicația falsă este aprobată, atacatorii obțin jetoane OAuth de lungă durată, care le permit să ocolească autentificarea multifactorială și să opereze fără a declanșa alertele de securitate normale.

Faza 4: Extragerea datelor silențioase

Grupul de informații privind amenințările de la Google a avertizat că un agent de amenințare a utilizat un instrument Python pentru a automatiza procesul de furt de date pentru fiecare organizație vizată, cercetătorii având cunoștință de peste 700 de organizații potențial afectate.

De ce suntem vulnerabili la vocile AI

Succesul acestor atacuri exploatează o trăsătură umană fundamentală: tendința noastră de a avea încredere în ceea ce auzim.

Conform unui studiu global recent, 70% dintre oameni spun că nu sunt siguri că pot identifica o voce reală față de una clonată.

Această vulnerabilitate este agravată în mediile corporative în care personalul biroului de asistență este instruit să fie serviabil și conciliant, iar munca la distanță a normalizat interacțiunile doar audio.

Conform raportului CrowdStrike 2025 Global Threat Report, s-a înregistrat o creștere de 442% a atacurilor de phishing vocal (vishing) între prima și a doua jumătate a anului 2024, determinată de tacticile de phishing și substituire generate de AI.

$25 Million Wake-Up Call

Implicațiile atacurilor îmbunătățite de deepfake se extind mult dincolo de Salesforce.

Furtul deepfake de $25 milioane de la firma de inginerie Arup la începutul anului 2024, în care atacatorii au folosit inteligența artificială pentru a se da drept mai mulți directori în cadrul unui apel video, a demonstrat că nicio organizație nu este imună la această amenințare.

Atacuri similare au vizat, de asemenea, directori executivi din diferite industrii, inclusiv o încercare de a se da drept directorul general al Ferrari, Benedetto Vigna, folosind apeluri vocale clonate de AI care imitau accentul său din sudul Italiei.

Aceste incidente reprezintă ceea ce experții în securitate numesc "frauda CEO 2.0", atacuri care depășesc simpla impostură prin e-mail pentru a crea înșelătorii multisenzoriale care pot păcăli chiar și directori cu experiență.

Securitatea platformei vs. Vulnerabilitatea umană

Salesforce s-a grăbit să sublinieze că aceste breșe nu reprezintă vulnerabilități ale platformei sale în sine.

Salesforce a recunoscut campania UNC6040 în martie 2025, avertizând că atacatorii se dădeau drept suport IT pentru a păcăli angajații să ofere acreditări sau să aprobe aplicații conectate rău intenționate.

Compania a subliniat că aceste incidente nu au implicat sau nu au provenit din vulnerabilități ale platformei sale.

Acest lucru arată o provocare majoră pentru toți furnizorii SaaS: găsirea unui mod de a opri atacurile care se bazează pe încrederea umană în locul defectelor tehnice.

Salesforce a implementat mai multe măsuri defensive:

- Întărirea aplicațiilor conectate: Dezactivarea automată a aplicațiilor conectate neinstalate pentru utilizatorii noi

- Restricții de flux OAuth: Dezactivarea conexiunilor obținute utilizând anumite procese de autorizare

- Monitorizare îmbunătățită: Detectarea îmbunătățită a tiparelor suspecte de autorizare a aplicațiilor

- Educația utilizatorilor: Publicarea de orientări privind recunoașterea tentativelor de inginerie socială

În august 2025, Salesforce a oprit toate integrările cu tehnologiile Salesloft, inclusiv aplicația Drift, după ce a constatat că token-urile OAuth fuseseră furate în atacuri conexe.

Experții în securitate avertizează acum că echipele trebuie să asculte indiciile subtile, cum ar fi pauzele ciudate, zgomotul de fond sau defecțiunile audio, care pot dezvălui când o voce a fost generată de AI.

Răspunsul întreprinderii: Dincolo de soluțiile tehnologice

Organizațiile încep să recunoască faptul că apărarea împotriva atacurilor îmbunătățite de deepfake necesită mai mult decât soluții tehnologice; aceasta necesită o regândire fundamentală a proceselor de încredere și verificare.

Comunicarea fără încredere

RealityCheck de la Beyond Identity oferă fiecărui participant o insignă de identitate vizibilă și verificată, susținută de autentificarea dispozitivelor criptografice și de verificări continue ale riscurilor, disponibilă în prezent pentru Zoom și Microsoft Teams.

Astfel de soluții reprezintă o schimbare către modelele "niciodată de încredere, întotdeauna de verificare" pentru comunicarea în întreprinderi.

Programe de formare îmbunătățite

Organizațiile care utilizează platforma de simulare deepfake a Resemble AI raportează o reducere de până la 90% a atacurilor reușite după implementarea platformei, care utilizează simulări hiperrealiste pentru a ilustra modul în care atacurile deepfake se desfășoară în lumea reală.

Verificare multicanal

Organizațiile de vârf implementează protocoale care impun verificarea prin mai multe canale pentru orice cerere cu risc ridicat, indiferent de cât de autentică pare comunicarea inițială.

Când vocea nu mai este adevăr

Amenințarea deepfake la adresa Salesforce și a altor sisteme de întreprindere reprezintă un punct de inflexiune în istoria securității cibernetice.

Pentru prima dată, atacatorii nu pot doar să se dea drept figuri de autoritate, ci pot chiar să vorbească ca ei, să arate ca ei și să convingă chiar și profesioniști calificați în domeniul securității să ia măsuri care compromit securitatea organizației.

Într-o eră a înșelăciunii generate de inteligența artificială, încrederea trebuie câștigată prin verificare, nu asumată prin familiaritate.

Companiile care înțeleg acest lucru și investesc în instrumentele, procesele și cultura potrivite vor fi în cea mai bună poziție pentru a proteja atât securitatea, cât și încrederea într-o lume digitală tot mai nesigură.

În această nouă realitate, vocea de la celălalt capăt al firului poate să nu fie cine pare.

În era deepfakes, vigilența constantă este prețul securității.