Bevezetés

A mesterséges intelligencia soha nem látott módon alakítja át a pénzügyi csalás területét. 2024 elején a csalók mesterséges intelligencia által generált mély hamisítványokat használtak arra, hogy egy videóhívás során vezetőknek adják ki magukat, és egy hongkongi alkalmazottat arra csaltak, hogy átutaljon $25 millió a csalóknak[1][2]. Az ehhez hasonló esetek azt mutatják, hogy a generatív mesterséges intelligencia hogyan teszi lehetővé a bűnözők számára, hogy rendkívül meggyőző csalásokat készítsenek a bankok és ügyfeleik ellen. A szabályozó hatóságok riadót fújnak: az amerikai pénzügyminisztérium FinCEN 2024 végén riasztást adott ki, amelyben a mesterséges intelligencia által generált "deepfake" médiát használó csalásokra figyelmeztet, beleértve a banki ellenőrzések megkerülésére szolgáló hamis személyazonossági dokumentumokat.[3][4]. Ez a fehér könyv a legújabb AI csalási trendek a pénzügyi szolgáltatásokban és megvitatja, hogy az intézmények hogyan erősíthetik meg a védelmüket. Feltárjuk, hogy a csalók hogyan használják fel a generatív mesterséges intelligenciát - a mélyreható hamis személyazonosságtól a szintetikus személyazonosságig -, és felvázoljuk a technológiákat és stratégiákat (beleértve az olyan fejlett felderítő eszközöket, mint a TruthScan), amelyeket a csalással foglalkozó csapatok és a vezetők bevethetnek e fejlődő fenyegetés elhárítására.

A legfontosabb AI csalási trendek a pénzügyi szolgáltatásokban

Az AI-t és a gépi tanulást a rossz szereplők egyre nagyobb mértékű és kifinomultabb csalások elkövetésére használják fel. Figyelemre méltó AI-vezérelt csalási taktikák a bankokat, a fintecheket és a biztosítókat érintő:

- Deepfake imitációs csalások: A bűnözők a Mesterséges intelligencia által generált videó és hang megbízható személyek (vezérigazgatók, ügyfelek stb.) valós idejű megszemélyesítésére. Például élethű, hamisított hangokat használtak a vishing (voice phishing) támadásokban csalárd átutalások engedélyezésére, és mesterséges intelligenciával létrehozott videókkal vették rá az alkalmazottakat, hogy hamis tranzakciókat hagyjanak jóvá.[1][5]. Ezek a szintetikus médiumok megnehezítik annak megállapítását, hogy valóban azzal a személlyel beszélsz-e, akinek gondolod magad, és lehetővé teszik az olyan nagy értékű rablásokat, mint a fenti $25M deepfake eset. A mélyhamisítások egyre megfizethető és könnyen előállítható, mindössze 20-30 másodpercnyi hangot igényel egy hang klónozásához, vagy kevesebb mint egy órát egy látszólag hiteles videó létrehozásához.[6].

- AI-fejlesztett adathalászat és BEC: A generatív mesterséges intelligencia felturbózza a social engineering módszereket, például az adathalász e-maileket és a üzleti e-mail kompromittálás (BEC). A mesterséges intelligencia chatrobotok képesek tökéletes üzleti nyelven, személyre szabottan, tökéletes üzleti nyelven átverő e-maileket írni, a vezérigazgató írásmódját utánozva, vagy meggyőző hamis szállítói számlákat létrehozni. Valójában az olyan földalatti eszközök, mint a FraudGPT és WormGPT (a ChatGPT szűretlen változatai) jelentek meg, hogy segítsék a kiberbűnözőket az adathalászat és a rosszindulatú programok létrehozásának automatizálásában.[7][8]. Ez azt jelenti, hogy egy minimális ismeretekkel rendelkező leendő csaló könnyedén létrehozhat csiszolt adathalász kampányokat vagy rosszindulatú kódot. A mesterséges intelligencia segítségével egyetlen bűnöző több ezer személyre szabott csaló e-mailt vagy szöveges üzenetet küldhet ki, ami jelentősen megnöveli a hagyományos csalási kísérletek hatókörét. Az FBI Internetes Bűnözési Központja már megfigyelte, hogy több mint $2,7 milliárd a BEC-csalások miatt 2022-ben, és a generatív mesterséges intelligencia azzal fenyeget, hogy a következő években még nagyobb veszteségeket okozhat.[9][10].

- Szintetikus személyazonosságok és okmánycsalás: A generatív mesterséges intelligencia a szintetikus személyazonossággal kapcsolatos csalások fellendülését segíti előa pénzügyi bűncselekmények egyik leggyorsabban növekvő fajtája.[11][12]. A csalók valódi és hamis személyes adatokat kombinálnak, hogy "Frankenstein" személyazonosságokat hozzanak létre, majd a mesterséges intelligenciát arra használják, hogy reális alátámasztó dokumentumokat készítsen - a hamis útlevelektől és bankszámlakivonatoktól kezdve a fizetési csekkekig...[7]. AI képgenerátorok és képszerkesztő eszközök hamisíthatnak hitelesnek tűnő igazolványok és fényképek amelyek átmennek az alkalmi ellenőrzésen. Még az életjel-ellenőrzés vagy a szelfi ellenőrzése is potenciálisan legyőzhető az AI által manipulált képekkel vagy videókkal. Több ezer hamis személyiség (mindegyik mesterséges intelligencia által generált profilképpel, közösségi médiával stb.) automatizált létrehozásával a bűnözők tömegesen nyithatnak bankszámlát vagy igényelhetnek hitelt, és moshatnak pénzt vagy nem fizethetnek hitelt. A szintetikus személyazonossággal kapcsolatos csalásokból származó veszteségeket a becslések szerint mintegy $35 milliárd 2023-ban[13], és a generatív mesterséges intelligencia csak felgyorsítja ezt a tendenciát azáltal, hogy a hamis személyazonosságokat olcsóbbá és nehezebben felderíthetővé teszi.

- Automatizált csalás és adóelkerülés: A hamis tartalmak létrehozásán túl a mesterséges intelligencia a csalóknak is segít maximalizálják a programjaik sikerét. A fejlett botok gyorsan tesztelhetik a lopott hitelkártyaadatokat az e-kereskedelmi oldalakon, az ML segítségével elkerülve a felderítéseket. A mesterséges intelligencia segíthet a bűnözőknek azonosítani a leggyengébb láncszemeket egy szervezet biztonságában, vagy akár hangválaszokat is szintetizálhatnak, hogy legyőzzék a telefonos személyazonosság-ellenőrzést. A dark web egy iparága már "csalás mint szolgáltatás" AI-eszközöket árul mindössze $20-ért.[14]. A mesterséges intelligencia képességeinek demokratizálódása azt jelenti, hogy még az alacsony szintű bűnözők is képesek rendkívül kifinomult csalási támadásokat indítani. A fegyverkezési verseny kiterjed a felderítés megkerülésére is - a csalók a mesterséges intelligenciát a banki csalás elleni rendszerek szondázására használják, és addig finomítják megközelítésüket, amíg nem találnak olyan módszert, amely átcsúszik a szűrőkön.[15]. Röviden, a mesterséges intelligencia lehetővé teszi a csalások lebonyolítását. eddig nem látott mértékben és hatékonysággal, kihívást jelentve a hagyományos védekezésnek.

Ezek a mesterséges intelligenciával támogatott taktikák már riasztó ütemben szaporodnak. Az olyan hagyományos csalási módszerek, mint a csekkhamisítás vagy az adathalászat már évek óta léteznek, de a mesterséges intelligencia felgyorsítja ezek mennyiségét és realitását. Az adatok egyértelmű történetet mesélnek: A mesterséges intelligencia csalás hullámzó.

Soha többé ne aggódjon az AI-csalások miatt. TruthScan Segíthet:

- AI generált érzékelése képek, szöveg, hang és videó.

- Kerülje a jelentős mesterséges intelligencia által vezérelt csalás.

- Védje a leg érzékeny vállalati eszközök.

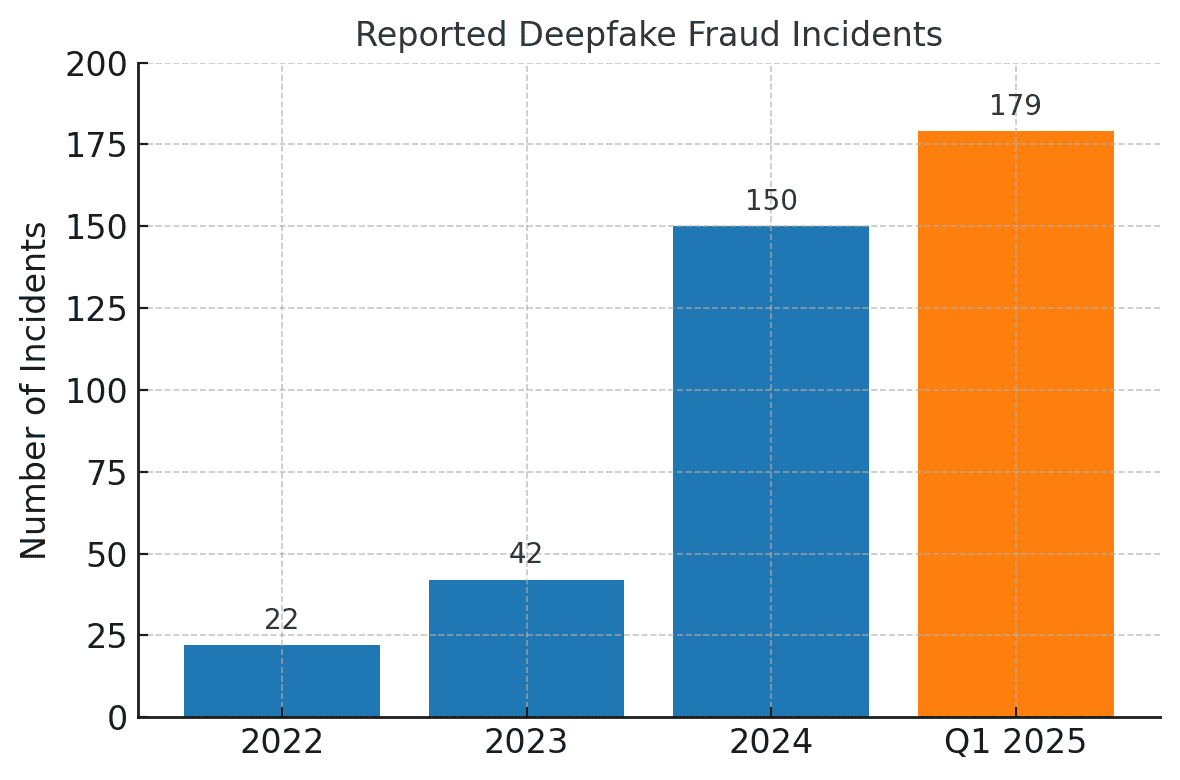

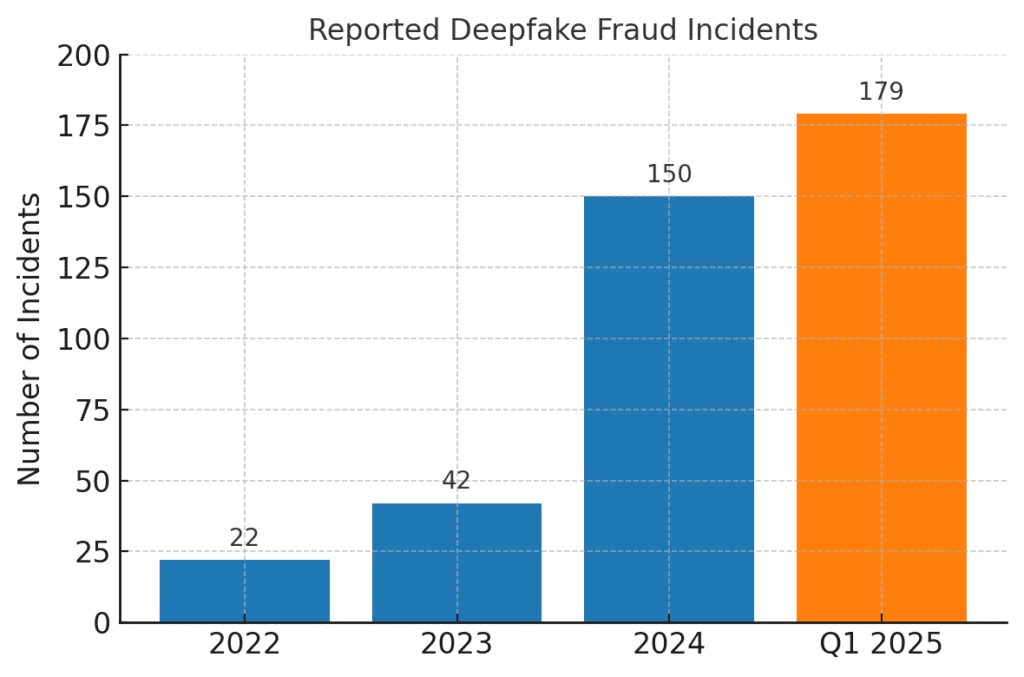

A Deepfake-hez kapcsolódó csalások száma az egekbe szökött. 2022-ben még csak 22 deepfake csalási esetet jegyeztek fel, 2023-ban azonban már 42-t, 2024-re pedig 150-re robbantak az incidensek. Csak 2025 első negyedévében, 179 deepfake csalási incidens jelentettek - ami meghaladja az egész 2024-es év összesített adatát.[16][17].

A legújabb iparági elemzések is ezeket a tendenciákat tükrözik. Az egyik jelentés szerint 700% a deepfake incidensek számának növekedése a fintech cégek megcélzása 2023-ban[18]. Még megdöbbentőbb, hogy Észak-Amerikában egy 1,740% a deepfake csalási ügyek megugrása 2022 és 2023 között[19]. A pénzügyi bűnözők gyorsan átveszik ezeket az eszközöket, mert működnek - sok bank és áldozat még nincs felkészülve a mesterséges intelligencia által generált megtévesztés felismerésére.

Hatások és kihívások a pénzügyi intézmények számára

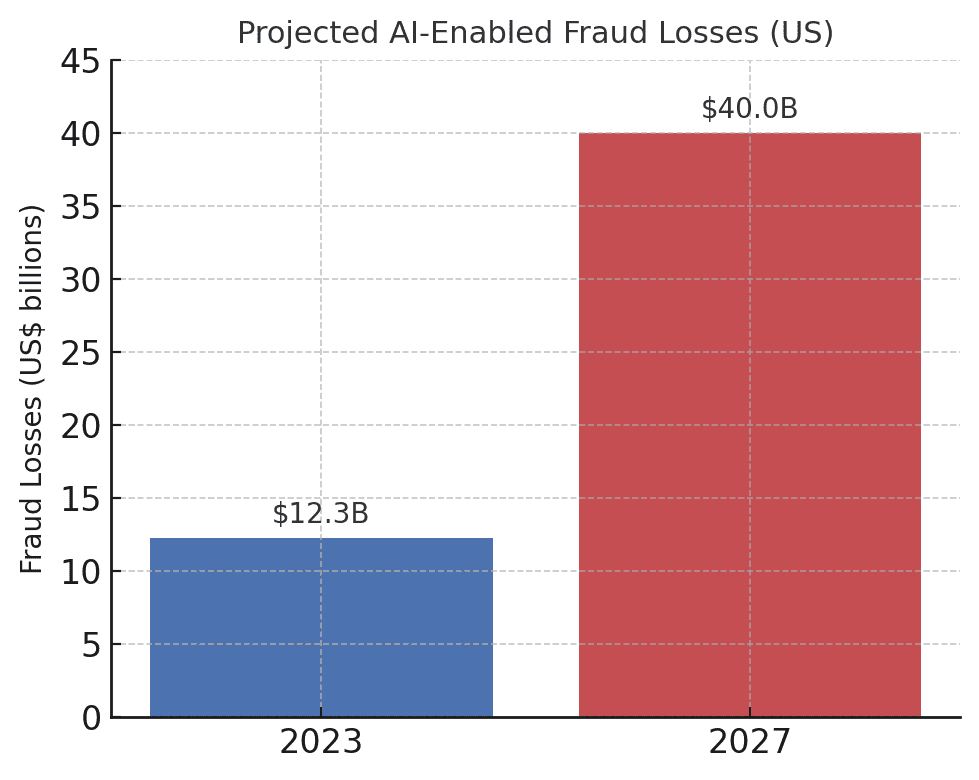

A mesterséges intelligencia által vezérelt csalások terjedése jelentős hatások a pénzügyi intézményekre, ügyfeleikre és a szélesebb pénzügyi rendszerre. A legközvetlenebb hatás a pénzbeli veszteség. Az iparági előrejelzések szerint 2027-re, a generatív mesterséges intelligencia által lehetővé tett csalási veszteségek elérhetik az $40 milliárdot az USA-ban, a 2023-as $12,3 milliárdról $12,3 milliárdra[20]. Ez a több mint háromszoros növekedés (a 32% CAGR) azt tükrözi, hogy a csalási kockázat dollárban kifejezve milyen gyorsan növekszik.

Az AI-alapú csalásokból eredő várható veszteségek drámaian emelkednek. A Deloitte becslései szerint a generatív mesterséges intelligenciával összefüggő amerikai pénzügyi csalások veszteségei a következő évtizedekre $12,3 milliárd 2023-ban $40 milliárd 2027-ig[20].

A nyers veszteségeken túlmenően a hírnév és a hírnévvesztés is bizalmi költségek. A fogyasztók elvárják, hogy bankjaik megvédjék őket - de a mesterséges intelligenciát használó csalások aláássák a digitális csatornákba vetett bizalmat. Ha például egy ügyfél egy meggyőző deepfake átverés áldozatává válik (például egy hamis banki videohívás), a bankot hibáztathatja a nem megfelelő biztonság miatt. Közbizalom a hangellenőrzés, az e-mailek, sőt a videokonferencia is erodálódhat, ha "amit látunk/hallunk" már nem tekinthető valósnak.[21]. Felmérések szerint az Egyesült Államokban és az Egyesült Királyságban a pénzügyi szakemberek 85%-je úgy véli, hogy a deepfake csalások "egzisztenciális" fenyegetést jelentenek a szervezetük biztonságára nézve.[22]. Az említett piacokon működő vállalatok több mint fele számolt be arról, hogy deepfake-alapú átverés célpontjává vált, és riasztó módon A célpontok közül 43% elismerte, hogy a támadás sikeres volt. a becsapásukban[23]. Minden sikeres incidens nemcsak pénzügyi kárt okoz, hanem az ügyfelek intézménybe vetett bizalmát is megingatja.

A pénzügyi cégek is küzdenek a működési és megfelelési kihívások az AI csalástól. A csalás elleni csapatoknak a riasztások és incidensek sokaságával kell szembenézniük, ami megterheli a vizsgálati erőforrásokat. A meglévő csalásfelismerő modellek (amelyek közül sokan szabályokra vagy régebbi gépi tanulási technikákra támaszkodnak) nehezen ismerik fel a mesterséges intelligenciával szintetizált, legitimnek tűnő tartalmakat. Valójában a laboratóriumokban kifejlesztett legkorszerűbb mélyreható hamisítvány-felismerő rendszerek pontossága csaknem 50%-tal csökken, amikor szembesülnek a következő elemekkel valós világ deepfakes a természetben[24]. Az emberi személyzet sem jár sokkal jobban - a tanulmányok szerint az emberek csak a jó minőségű deepfake videókat képesek kiszúrni. 55%-60% az időből, alig jobb, mint a véletlen[25]. Ez azt jelzi, hogy új eszközök nélkül a bankok a mesterséges intelligencia által vezérelt csalási kísérletek nagy részét elszalasztják.

Van még egy szabályozási dimenzió. A szabályozó hatóságok és a bűnüldöző szervek nagyon is tisztában vannak a kockázatokkal (amint azt a FinCEN riasztása is bizonyítja), és elvárják, hogy a pénzügyi intézmények alkalmazkodjanak. A bankok a mesterséges intelligencia korszakában szigorúbb irányelvekkel szembesülhetnek az ügyfelek ellenőrzésére és a csalások bejelentésére vonatkozóan. Ha például egy bank alkalmazottját egy deepfake rászedi egy $10 milliós átutalás jóváhagyására, a szabályozók alaposan megvizsgálhatják a bank ellenőrzéseit és átvilágítási folyamatait. A Banki titoktartási törvény most már kifejezetten magában foglalja a kiberbűnözés és a deepfake-hez kapcsolódó gyanús tevékenységek bejelentését is.[26][4], ami azt jelenti, hogy a bankoknak ki kell képezniük a személyzetet, hogy felismerjék és jelentsék az AI által generált csalásjelzőket a gyanús tevékenységi jelentésekben (SAR). Ha nem tartanak lépést az AI-alapú csalási technikákkal, az megfelelés megsértéséhez vagy jogi felelősségre vonáshoz vezethet, ha az ügyfelek vagy a partnerek azt állítják, hogy a bank nem tett eleget az előre látható AI-alapú csalások megelőzése érdekében.

Talán a legnagyobb kihívást a az új fenyegetés aszimmetrikus jellege. A generatív mesterséges intelligencia jelentősen csökkenti a támadók költségeit és képzettségi korlátját, miközben exponenciálisan növeli a támadások mennyiségét és realizmusát. Egyetlen vírusos deepfake pletyka vagy egy meggyőző hangklónhívás több millió dolláros hitelesítési beruházást is legyőzhet. Eközben a védőknek minden egyes tranzakció és interakció hitelességét ellenőrizniük kell, ami sokkal nehezebb feladat. Ez valóban fegyverkezési verseny: A mesterséges intelligencia a csalóknak önfrissítő eszköztárat ad a biztonság megkerülésére, ami megköveteli a bankoktól, hogy a védelmüket is folyamatosan frissítsék.[15][27]. Sok pénzintézet elismeri, hogy nincs megfelelően felkészülve - a vállalatok több mint 80%-ének nincs hivatalos válaszadási terve a deepfake támadásokra, és több mint a fele nem biztosított képzést az alkalmazottaknak a deepfake kockázatokról.[28][29]. Ez a felkészültségi hiányosság azt jelenti, hogy a szervezetek jelenleg sebezhetőek, de rávilágít arra is, hogy hol van szükség cselekvésre.

Egy figyelemre méltó és kijózanító mérőszám egy nemrégiben készült iparági jelentésből származik: A pénzügyi szektorban elkövetett csalási kísérletek 42,5%-je ma már valamilyen formában mesterséges intelligenciával történik.[30]. Más szóval, a bankok által tapasztalt csalási támadások közel felének van mesterséges intelligencia komponense - legyen szó mesterséges intelligenciával generált dokumentumról, szintetizált hangról vagy gép által generált adathalász üzenetről. Ez a statisztika hangsúlyozza, hogy a mesterséges intelligencia nem egy hipotetikus jövőbeli fenyegetés; már itt van, és arra kényszeríti a pénzintézeteket, hogy alkalmazkodjanak, különben egyre nagyobb veszteségekkel kell szembenézniük.

Védekezés az AI-alapú csalás ellen: Stratégiák és megoldások

A mesterséges intelligencia által vezérelt csalás elleni küzdelem a csalásmegelőzési stratégiák fejlődését igényli. A hagyományos megközelítések (mint például a kézi ellenőrzés vagy a statikus szabályrendszerek) nem képesek felvenni a versenyt az alakváltó mesterséges intelligencia csalásaival. Ehelyett a bankoknak a következőket kell elfogadniuk technológia (például, hogy biztosítsák, hogy van egy Biztonságos SSL tanúsítvány), képzés és csapatmunka hogy megfordítsuk a helyzetet. Az alábbiakban felvázoljuk a legfontosabb stratégiákat és a kialakulóban lévő megoldásokat:

- A mesterséges intelligencia kihasználása a mesterséges intelligencia elleni küzdelemben (fejlett észlelési eszközök): A pénzintézetek egyre inkább a AI-alapú észlelési megoldások a mesterséges intelligencia által generált tartalmak és anomáliák azonosítása. Lényegében tűzzel kell harcolni a tűz ellen. Az olyan új vállalati eszközök, mint a TruthScan szöveg, kép, hang és videó multimodális mesterséges intelligencia-felismerést kínál a tartalom valós idejű hitelesítéséhez.[31]. A bankok például mesterséges intelligencia szövegdetektorokat alkalmazhatnak a bejövő kommunikáció (e-mailek, chat-üzenetek) átvizsgálására az AI által generált nyelvi jelek után, amelyek adathalász e-mailt vagy hamis ügyfélkérdést jelezhetnek. A TruthScan AI szövegfelismerő rendszere képes azonosítani a mesterséges intelligenciával írt tartalmakat az olyan modellekből, mint a GPT-4, a következőkkel. 99%+ pontosság, még azt is megállapítva, hogy mely mondatok valószínűleg mesterséges intelligencia által generáltak.[32][33]. Hasonlóképpen, a mesterséges intelligencia képi törvényszéki eszközök is ellenőrizhetik a dokumentumokat és a képeket; a AI képérzékelő képes jelezni, ha egy benyújtott jogosítványt vagy közüzemi számlát digitálisan készítettek vagy manipuláltak, összehasonlítva azt a mesterséges intelligencia által generált képek ismert mintáival.[34]. A bankok az audiofenyegetésekhez kezdik használni voice deepfake detektorok - olyan megoldások, amelyek a hívás hangját elemzik a szintetikus beszéd akusztikai ujjlenyomatai szempontjából. A TruthScan AI Voice Detector például figyeli a hangklónozás árulkodó jeleit, és képes ellenőrizze az előadó hitelességét a csaló hívások megelőzése érdekében[35]. Azáltal, hogy ezeket az érzékelőket API-n keresztül integrálják munkafolyamataikba, a pénzintézetek automatikusan szűrhetik a tranzakciók és interakciók hátterében lévő mesterséges intelligencia tartalmakat. Ez egy további védelmi réteget jelent, amely gépi sebességgel működik, és észreveszi azt, amit az emberi szemek/fülek esetleg nem vesznek észre.

- Többfaktoros és sávon kívüli ellenőrzés végrehajtása: Mivel a mesterséges intelligencia megnehezíti a hangok vagy képek megbízhatóságát, a bankoknak jobban kellene támaszkodniuk az olyan ellenőrzési módszerekre, amelyeket a mesterséges intelligencia nem tud könnyen meghamisítani. Ez magában foglalja a többfaktoros hitelesítést (MFA) biztonságos csatornákon. Például, ha az átutalási kérelem e-mailben vagy videohíváson keresztül érkezik, kérjen második tényezőt, például a kérelmező ismert mobileszközére küldött egyszeri jelkódot, vagy a fájlban lévő, megbízható telefonszámon történő visszahívást. Egyes bankok a nagy kockázatú tranzakciók esetében "életszerűségi" ellenőrzéseket is bevezetnek - például arra kérik az ügyfelet, hogy készítsen egy élő szelfit egy bizonyos gesztussal vagy szóval, amelyet nehezebben tud lemásolni egy hamisított videó. A biometrikus hitelesítők hamisítás elleni intézkedésekkel is kiegészíthetők (pl. 3D-s arcmélység szkennelés vagy a finom szemmozgások figyelése, amelyeket a mélyhamisítványok gyakran nem tudnak utánozni).[27]). A kulcs az egyetlen hibapontok elkerülése. Még ha egy AI deepfake képes is becsapni egy csatornát (mondjuk a hangellenőrzést), egy összehangolt sávon kívüli ellenőrzés vagy biometrikus teszt biztosíthatja a csalás leleplezéséhez szükséges kihívást. Zéró bizalmi elvek kell alkalmazni: minden kéretlen vagy váratlan utasítást (még egy "ismert" vezető vagy ügyfél részéről is) gyanúsnak kell tekinteni, amíg azt független csatornán keresztül nem ellenőrzik.

- Munkavállalói képzés és csalás-tudatosság: A technológia önmagában nem jelent megoldást - különösen azért, mert a csalók a leggyengébb láncszemet veszik célba, ami gyakran az emberi bizalom. A pénzintézeteknek be kell fektetniük a csalásmegelőző csoportok és a frontvonalban dolgozó munkatársak rendszeres képzésébe a mesterséges intelligencia alapú csalásokról. Az alkalmazottaknak meg kell tanulniuk felismerni a mély hamisítványok és a social engineering piros zászlós jeleit. Ez magában foglalhatja a finom anomáliákról szóló képzést is (pl. ajakszinkronizációs problémák egy videóhívásban, vagy olyan hang, amely természetellenes intonációt vagy túl kevés háttérzajt tartalmaz - ezek a szintetikus hang lehetséges jelei). A következő kultúra ösztönzése ellenőrzés: az alkalmazottaknak felhatalmazást kell érezniük arra, hogy egy gyanús tranzakciót vagy kérést szüneteltessenek és függetlenül ellenőrizzék, még akkor is, ha az látszólag a vezérigazgatótól származik. Az eset a A Ferrari vezérigazgatójának hangja hamisítási kísérlet tanulságos - egy végrehajtó csak úgy leplezte le a csalást, hogy feltett egy személyes kérdést, amelyre az imposztor nem tudott válaszolni.[36]. A szimulált adathalászat/mélyreható csalás gyakorlatok szintén hasznosak lehetnek. Ahogyan a vállalatok adathalász szimulációkat futtatnak a személyzet kiképzésére, úgy szimulálhatnak egy mélyen hamis hangüzenetet vagy egy hamis videós megbeszélést, és megnézhetik, hogy az alkalmazottak észlelik-e azt. Ez az izommemóriát fejleszti a valós támadásoknak való ellenálláshoz. Tekintettel arra, hogy a vállalatok több mint 50%-je nem rendelkezik mélyreható hamisításokra adott válaszprotokollal és kevés képzéssel[29], az ilyen programok bevezetése alacsonyan függő gyümölcs az ellenálló képesség javítása érdekében.

- Csaláselemzés és anomália-felismerés: A bankoknak a csaláselemzés fejlesztésével továbbra is használniuk kell a mesterséges intelligenciát a védekező oldalon. Modern csalásfelderítő rendszerek olyan gépi tanulási modelleket alkalmaznak, amelyek valós időben elemzik a tranzakciókat, és jelzik az anomáliákat vagy a magas kockázatú mintákat. Ezeket a modelleket frissíteni kell, hogy tartalmazzák a mesterséges intelligencia által vezérelt csalásra utaló jeleket. Például egy ML-modell betanítható a botvezérelt fiókátvételekhez kapcsolódó metaadatok vagy viselkedési minták észlelésére (pl. lehetetlenül gyors űrlapkitöltési idők vagy tökéletesen következetes gépelési minták, amelyek automatikus szkriptre utalnak). A nyelvi modellek felhasználhatók az üzenetek tartalmának elemzésére, és jelezhetik, ha egy szállítótól érkező e-mail mesterséges intelligencia által generált hangok vagy túlságosan sablonos (a korábban említett mesterséges intelligencia szövegfelismeréssel párosítva). Az olyan bankok, mint a JPMorgan, nagy nyelvi modelleket használnak belső kommunikációjukban, hogy kiszúrják azokat a mondatokat vagy szövegkörnyezeteket, amelyek egy social engineering kísérletre utalhatnak.[37]. Az olyan fizetési hálózatok, mint a Mastercard, hatalmas adathalmazokat (tranzakciók milliárdjait) vizsgálnak át mesterséges intelligenciával, hogy azonosítsák a csalárd tranzakciókat, amelyeket a hagyományos szabályok nem vennének észre.[38]. A tanulság az, hogy defenzív AI ugyanolyan innovatívnak kell lennie, mint a támadó mesterséges intelligenciának. A cégeknek fontolóra kell venniük, hogy kifejezetten a hamisított tartalmak, a szintetikus identitások és a generatív támadási minták felismerésére szolgáló mesterséges intelligencia-modelleket fejlesszenek ki vagy vásároljanak. Fontos, hogy ezeket a modelleket folyamatosan újra kell képezni az AI csalások legújabb példáin (ez az úgynevezett online tanulás vagy szövetségi tanulás), hogy lépést tartsanak a bűnözők gyorsan fejlődő taktikáival.[39][40].

- Együttműködés és információmegosztás: Az AI-alapú csalás elleni küzdelemhez intézményen belüli és intézményközi együttműködésre lesz szükség. A szervezeti határokat átlépő fenyegetésekkel szemben az elszigetelt erőfeszítések kevésbé hatékonyak. Csalásmegelőzési csapatok, kiberbiztonsági csapatok és informatikai csoportok kéz a kézben kell dolgozniuk - például a biztonsági csapatok a videokonferencia-eszközökbe beépíthetik a deepfake-érzékelést, míg a csalással foglalkozó csapatok a tranzakciófigyelésbe integrálhatják a tartalomellenőrzést. Szélesebb szinten a bankoknak részt kell venniük az olyan iparági csoportokban, mint a Pénzügyi Szolgáltatások Információmegosztó és Elemző Központja (FS-ISAC), hogy kicseréljék az új mesterséges intelligencia alapú csalási módszerekkel kapcsolatos információkat.[41]. Ha egy bank felfedez egy újszerű deepfake támadási vektort, akkor ennek megosztása segíthet a többieknek, hogy még azelőtt behozzák a lemaradást, mielőtt őket is elérné a támadás. Az iparági konzorciumokon keresztül vagy szabályozási támogatással közös gyakorlatokat vagy "vörös csapat" szimulációkat lehet végezni mesterséges intelligenciát tartalmazó forgatókönyvekkel (pl. deepfake ügyvezetői csalás vagy mesterséges intelligencia által generált személyazonosság-ellenőrzés megkerülése). A szabályozó hatóságok maguk is az AI kockázatokra összpontosítanak, ezért bölcs dolog proaktívan együttműködni velük. A bankok a mesterséges intelligencia használatára vonatkozó szabványokhoz és iránymutatásokhoz való hozzájárulással segíthetnek egy biztonságosabb ökoszisztéma kialakításában. Végső soron, mivel az egyik bankot fenyegető veszély az összes bankot fenyegeti. ezen a téren[42], a kollektív védelmi megközelítés megerősíti mindenki képességét a mesterséges intelligenciával támogatott csalások felderítésére és megakadályozására.

- Ügyféloktatás és bizalmi intézkedések: Végezetül a pénzügyi intézményeknek nem szabad figyelmen kívül hagyniuk az ügyféltudatosság szerepét. Mivel a deepfakes és az AI csalások a nagyközönséget célozzák (például a nagyszülői csalásokban használt hamis hangok vagy az AI által generált hamis "tech support" csevegések), a bankok segíthetnek az ügyfelek felvilágosításában ezekről a veszélyekről. Sok bank már most is küld figyelmeztető üzeneteket az adathalászatról; ezeket kiterjeszthetik az AI hangklónozásra és a mélyhamisított videókra is, és tippeket adhatnak a kérések ellenőrzésére. Egyes progresszív szervezetek küldenek push értesítések vagy figyelmeztetések az alkalmazásukban, ha egy ismert csalás van forgalomban (pl. "Vigyázat: csalók a családtagok hangklónjait használhatják, hogy pénzt kérjenek").[43]. Bár közvetlenül nem lehet megelőzni a támadásokat, az oktatás csökkentheti a sikerességi arányt, és megerősítheti, hogy a bank partner a biztonságban. Ezen túlmenően a legmodernebb csalásmegelőzésbe beruházó bankoknak ezt az ügyfeleknek is ki kell emelniük, mint egyfajta differenciáló - Ha például az ügyfelek tudomásul veszik, hogy minden videóhívást vagy benyújtott dokumentumot mesterséges intelligencia vizsgál be a hitelesség érdekében (anélkül, hogy felfedné az érzékeny módszereket), az megnyugtathatja az ügyfeleket, hogy a bank minden rendelkezésre álló eszközt felhasznál a védelmük érdekében. A digitális bizalom megőrzése kulcsfontosságú lesz ahhoz, hogy a bankok teljes mértékben kiaknázhassák a mesterséges intelligencia előnyeit a szolgáltatásokban, ezért az átláthatóság és az ügyfélközpontú biztosítékok a holisztikus védelem részét képezik.

Az AI tartalomérzékelési szolgáltatások szerepe

A mesterséges intelligencia korszakában a csalás elleni eszköztár egyik sarokköve a következő eszközök használata AI tartalomérzékelési szolgáltatások. Ezek a szolgáltatások arra specializálódtak, hogy kiszúrják a mesterséges intelligencia által generált tartalmak "ujjlenyomatait", amelyek elkerülhetik az emberi ellenőröket. A TruthScan az egyik ilyen szolgáltató, amely vállalati szintű AI Detection Suite több tartalomtípuson átívelő. A pénzintézetek integrálhatják ezeket az eszközöket a hamisítás és csalásjelzők automatikus szűrésére:

- Dokumentum- és képellenőrzés: A TruthScan platformja lehetővé teszi a bankok számára, hogy valós időben tesztelheti a pénzügyi dokumentumokat mesterséges intelligencia által generált csalás szempontjából.[44]. Ez azt jelenti, hogy amikor egy új számlát nyitnak, vagy egy hitelkérelem érkezik fényképes személyi igazolvánnyal és fizetési csekkekkel, a rendszer azonnal elemezni tudja ezeket a képeket a szintetikus generáció vagy hamisítás jelei után. Több mint 99% célpontossággal[45]a mesterséges intelligencia képdetektor képes elkapni a hamis személyazonosító képeket vagy a manipulált PDF-eket, amelyeket az ember esetleg névértéken elfogadna. Ez a fajta dokumentum hitelességének ellenőrzése kulcsfontosságú a szintetikus személyazonossággal kapcsolatos csalások megállításában, még a számlanyitás előtt.

- Valós idejű tranzakció-felügyelet: API integrációk telepítésével a TruthScan be tud kapcsolódni a bankok tranzakciófeldolgozásába, és jelezni tudja az anomáliákat a következőkben valós időben. Ha egy gyanúsnak tűnő utasítás érkezik e-mailben, az Email Scam Detector képes elemezni az üzenet tartalmát, és felismeri, hogy azt valószínűleg egy AI modell írta-e, amely megpróbál hamisítani egy szállítót vagy ügyvezetőt.[46]. Hasonlóképpen, a Valós idejű AI detektor képes figyelni az élő kommunikációt (például a csevegéseket vagy az együttműködési platformokat), hogy azonnali riasztást adjon, ha például egy nagy téttel bíró megbeszélés során egy hamisított deepfake videótovábbítást észlelnek.[47][48]. Az azonnali figyelmeztetésekkel és automatizált válaszokkal ellátott folyamatos felügyelet segít csökkenteni azt az ablakot, amelyben a csalás észrevétlenül történhet.

- Hang és videó Deepfake védelem: A call centerek és a kapcsolattartók számára a TruthScan AI hangdetektor egy extra biztonsági réteget ad hozzá. Ha egy csaló egy ügyfélnek adva ki magát egy hangklónt használva telefonál, a rendszer elemezni tudja a hívás hangját, és jelzi, ha az mesterséges intelligenciával szintetizált elemeket tartalmaz (például hiányzó természetes mikroszüneteket vagy a hanghullámokban lévő műalkotásokat).[35]. A videófronton a Deepfake detektor a számítógépes látás algoritmusait alkalmazza a videóképekre, hogy észrevegye a következetlenségeket - például a természetellenes arcmozgásokat, a furcsa megvilágítást vagy a nem megfelelő ajakszinkronizációt -, amelyek egy hamisítványról árulkodnak.[49][50]. Azáltal, hogy a bankok a legfontosabb interakciók során ellenőrzik a hangok és az arcok integritását, meghiúsíthatják az alkalmazottak megtévesztésére irányuló csalók próbálkozásait. Ezek az eszközök úgy működnek, mint a digitális tartalom high-tech hazugságvizsgálója, láthatatlanul, a háttérben.

Érdemes megjegyezni, hogy az ilyen észlelési technológia telepítése nem egy plug-and-play gyógymód; azt az intézmény munkafolyamataihoz kell kalibrálni és hangolni. A téves pozitív eredményeket kezelni kell (például egy mesterséges intelligencia alapú szövegérzékelő gyanúsnak minősítheti a sablonalapú, legitim kommunikációt, amíg meg nem tanulja a különbséget). Megfelelő integrálás esetén azonban ezek az eszközök jelentősen javítják a szervezet képességét a következőkre a csalárd tartalmak kiszűrése, mielőtt kárt okoznának. Emellett ellenőrzési nyomvonalakat és elemző jelentéseket is generálnak, amelyek hasznosak a megfelelés és a csalási modellek folyamatos javítása szempontjából.

A mesterséges intelligencia felderítő eszközök hatékonysága elsősorban a következőktől függ folyamatos frissítések. Ahogyan a vírusirtó szoftvereknek is új aláírásokra van szükségük az új vírusokhoz, úgy a mesterséges intelligencia detektoroknak is át kell képezniük magukat a legújabb deepfake technikákra és mesterséges intelligencia modellekre. Az olyan gyártók, mint a TruthScan, frissítik algoritmusaikat, hogy kezelni tudják az új generatív modelleket és a kijátszási taktikákat, így a magas pontosságot a mesterséges intelligencia fejlődésével párhuzamosan is fenntartják.[51]. Ez tehermentesíti a házon belüli csapatokat, és biztosítja, hogy a bankok ne a tegnapi háborút vívják, miközben a bűnözők új mesterséges intelligencia trükkökre lépnek át.

Következtetés

A pénzügyi szolgáltatási ágazat válaszúthoz érkezett a csalás elleni küzdelemben. Az egyik oldalon a bűnözők gyorsan alkalmazzák a generatív mesterséges intelligenciát, hogy minden eddiginél meggyőzőbb és szélesebb körben elterjedt csalásokat hajtsanak végre. A másik oldalon a bankok és a csalás elleni harcosok egyre szélesedő arzenállal rendelkeznek a mesterséges intelligencia által vezérelt védekezés terén. Azok az intézmények fognak gyarapodni, amelyek fel kell ismerni az új fenyegetettségi helyzetet, és ugyanilyen leleményesen kell reagálni rá.. Ez a fejlett észlelési képességekbe való befektetést, többszintű ellenőrzési folyamatok integrálását, a személyzet és az ügyfelek oktatását, valamint az éberség és az alkalmazkodás kultúrájának előmozdítását jelenti.

A mesterséges intelligenciával támogatott csalás gyorsan mozgó célpont - a ma egy vállalatot átverő deepfake csalás ellen holnap új felderítési technikák léphetnek fel, és a csalók a jövő héten már változtatnak a módszereiken. Ezért a 2025-ös "iparági szabványnak" megfelelő csalásmegelőzési stratégia olyan stratégia, amely az agilitásra és a folyamatos fejlesztésre helyezi a hangsúlyt. A pénzügyi szervezeteknek úgy kell kezelniük csalásvédelmi rendszereiket, mint élő, tanuló entitások amelyek a bűnözői taktikákkal párhuzamosan fejlődnek. A technológiai szolgáltatókkal való partnerségek kihasználása okos rövidítés e képességek kiépítéséhez. Például az olyan speciális cégekkel való együttműködés, mint a TruthScan (amely a banki és pénzügyi szektorra szabott megoldásokat kínál), felgyorsíthatja az intézmény képességét arra, hogy a mesterséges intelligenciával támogatott csalások megelőzése a jogszabályi megfelelés és az ügyfelek bizalmának fenntartása mellett[52].

Végső soron a mesterséges intelligencia által vezérelt csalás elleni védelem nem csak a technológiáról szól - az alapvető bizalom amely a pénzügyek alapját képezi. Az ügyfeleknek meg kell bízniuk abban, hogy bankjuk meg tudja különböztetni a valódi tranzakciót a hamisítványtól, a valódi ügyfelet a mesterséges intelligencia csalójától. A pénzügyi szolgáltató cégek a legmodernebb mesterséges intelligencia-felismerő eszközök alkalmazásával, az ellenőrzési protokollok megerősítésével és a felmerülő fenyegetések megelőzésével fenntarthatják ezt a bizalmat. Az előttünk álló út kétségtelenül több csalási kísérletet fog tartalmazni az ellenfelek részéről, de felkészültséggel és a megfelelő befektetésekkel a bankok biztosíthatják, hogy A mesterséges intelligencia inkább előny, mint fenyegetés lesz a csalásmegelőzés területén. Ez egy elérhető cél: ugyanazokat a mesterséges intelligencia technológiákat, amelyek zavarokkal fenyegetnek, fel lehet használni pénzügyi rendszerünk integritásának védelmére. Itt az ideje, hogy a csalásmegelőzési csoportok és a C-szintű vezetők határozottan cselekedjenek, fejlett megoldások és stratégiák alkalmazása a csalók kijátszása érdekében és biztosítsa a digitális pénzügyek jövőjét.

Források: A közelmúltban készült iparági jelentésekre, szabályozási figyelmeztetésekre és technológiai fehér könyvekre hivatkozunk (Deloitte[20][18], Világgazdasági Fórum[19][24], U.S. Treasury FinCEN[3][4], Federal Reserve[13], Keepnet Labs[16][30], többek között), hogy adatokat és példákat szolgáltassanak. Minden adatot és példát soron belül idézünk, hogy az olvasók tovább kutathassanak.

[1] [9] [10] [14] [15] [18] [20] [37] [38] [42] [43] Deepfake banking és az AI csalási kockázat | Deloitte Insights

[2] [5] [6] [19] [21] [24] [25] [27] [36] [39] [40] [41] A veszélyes mesterséges intelligencia felismerése elengedhetetlen a deepfake korszakban | Világgazdasági Fórum

[3] [4] [26] A FinCEN riasztást ad ki a pénzügyi intézményeket célzó Deepfake Media csalási rendszerekről | FinCEN.gov

[7] [8] FraudGPT és GenAI: Hogyan fogják a csalók legközelebb használni az AI-t? | Alloy

[11] Szintetikus személyazonossággal kapcsolatos csalás: Federal Reserve Bank of Boston: Hogyan változtatja meg a játékot a mesterséges intelligencia - Federal Reserve Bank of Boston

[12] [13] A generatív mesterséges intelligencia növeli a szintetikus személyazonossággal kapcsolatos csalási fenyegetéseket

[16] [17] [22] [23] [28] [29] [30] Deepfake statisztikák és trendek 2025 | Key Data & Insights - Keepnet

[31] [34] [35] [46] [47] [48] TruthScan - Vállalati AI felderítés és tartalombiztonság

[32] [33] [51] AI Detector: Vállalati szintű AI szövegfelismerés - TruthScan

[44] [45] [52] Banki AI csalásfelismerés | CRO megoldások | TruthScan

[49] [50] Deepfake Detector - Hamis és AI videók azonosítása - TruthScan