Miksi OpenAIn uusimmasta läpimurrosta on tullut jokaisen johtajan uusin päänsärky.

Kokeilu, joka rikkoi internetin

Huhtikuussa 2025 yksinkertainen sosiaalisen median kokeilu järkytti koko kyberturvallisuusmaailmaa. Käyttäjät saivat selville, että OpenAI:n GPT-4o voi luoda realistiset väärennetyt Aadhaar-kortit, Intian kansallinen henkilöllisyystodistusjärjestelmä, joka kattaa yli 1,3 miljardia ihmistä.

Vain muutamassa tunnissa sosiaalisen median alustat tulvivat tekoälyn luomat henkilöllisyystodistukset, joissa esiintyivät kaikki tavallisista kansalaisista Sam Altmanin ja Elon Muskin kaltaisiin julkisuuden henkilöihin.

Luvut olivat järkyttäviä. Julkaisunsa jälkeen OpenAI:n GPT-4o on tehnyt jo yli 700 miljoonaa kuvaa.

Älä enää koskaan ole huolissasi tekoälypetoksista. TruthScan Voi auttaa sinua:

- Tunnista AI luotu kuvat, teksti, ääni ja video.

- Vältä merkittävä tekoälyyn perustuva petos.

- Suojaa kaikkein herkkä yrityksen omaisuuserät.

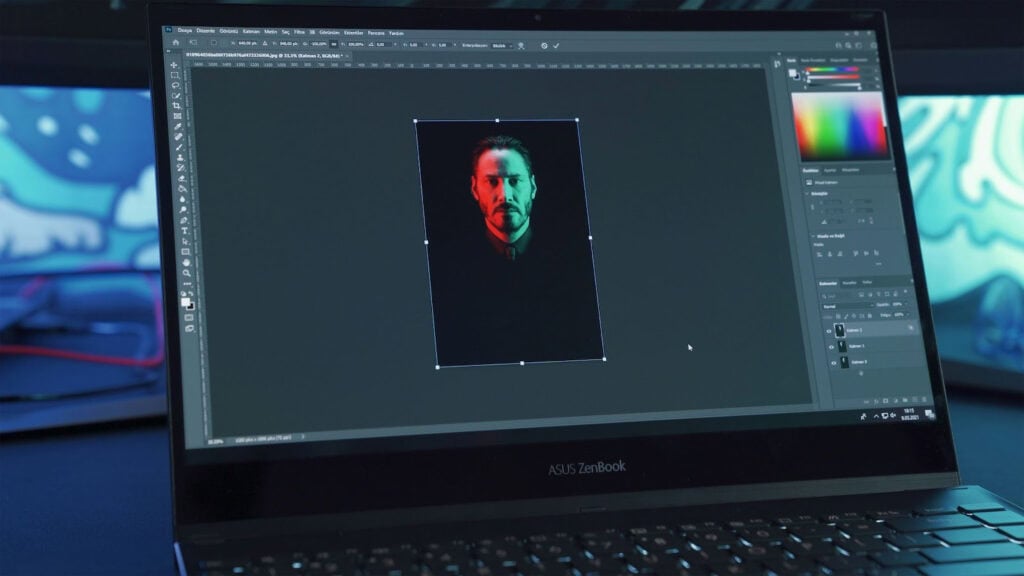

Studio Ghibli -tyylisten muotokuvien luova kokeilu kehittyi nopeasti joksikin huolestuttavammaksi. Käyttäjät alkoivat jakaa valokuvamaisia mock-upeja valtion henkilökorteista, joissa oli QR-koodeja, virallista muotoilua ja väärennettyjä henkilötietoja, jotka näyttivät häiritsevän aidoilta.

Teknologia uhan takana: GPT-4o on erilainen

Uuden luokan tekoälykuvantuotanto

Toisin kuin DALL-E, GPT-4o on integroitu suoraan ChatGPT:hen. Tämä muutos antaa sille uusia kykyjä, mutta luo myös uusia riskejä.

Kuten OpenAI myönsi virallisessa järjestelmäasiakirjassaan: "Nämä valmiudet yksinään ja uusina yhdistelminä voivat aiheuttaa riskejä useilla aloilla tavalla, johon aiemmat mallit eivät pystyneet."

Saavutettavuusongelma

Kuvantuotantoteknologian demokratisoituminen on luonut asiantuntijoiden mukaan täydellisen myrskyn identiteettipetoksille.

Ensinnäkään teknisiä taitoja ei tarvita. Kuka tahansa voi luoda väärennettyjä asiakirjoja kirjoittamalla pyynnön luonnollisella kielellä. Tulokset ovat fotorealistisia ja vastaavat tarkasti virallisia ulkoasuja, fontteja ja malleja.

Väärennettyjä henkilöllisyystodistuksia voidaan valmistaa laajamittaisesti muutamassa minuutissa. Ja koska teknologia toimii eri maiden tunnistusjärjestelmissä, uhka on maailmanlaajuinen.

Koulutustietoihin liittyvät ongelmat

Kaikkein huolestuttavinta on kysymys tietolähteistä. Käyttäjät ovat kyselleet, mistä GPT-4o on saanut harjoitusaineiston, jolla se pystyy jäljittelemään hallituksen asiakirjoja niin tarkasti. Käyttäjät ovat ihmetelleet, mistä malli on saanut Aadhaar-kuvatiedot koulutusta varten ja miten se on oppinut muodon niin tarkasti.

Tekoälyn kuvapetosten laajuus: Kasvava kriisi

Nykyiset tilastot antavat synkän kuvan

Tekoälyn tuottamat petokset ovat yksi nopeimmin kasvavista uhkista kyberturvallisuudessa:

- Maailmanlaajuinen petosten määrä kasvoi 1,10%:stä vuonna 2021 2,50%:iin vuonna 2024., 127% lisäys vain kolmessa vuodessa.

- 50% kaikista petosyrityksistä kohdistuu väärennettyihin tai muutettuihin asiakirjoihin. vuonna 2024 Sumsubin identiteettipetosraportin mukaan.

- Geneeristä tekoälyä hyödyntävien digitaalisten väärennösten osuus kaikista asiakirjapetoksista on nyt 57%., mikä on 244% enemmän kuin edellisenä vuonna.

- Deepfakeen liittyvät identiteettipetokset kymmenkertaistuivat vuonna 2023 edelliseen vuoteen verrattuna

Taloudelliset vaikutukset eri toimialoilla

Taloudelliset seuraukset ovat jo nyt vakavia ja kiihtyvät:

- Tekoälyyn perustuvat petokset voivat maksaa $10,5 biljoonaa euroa maailmanlaajuisesti vuonna 2025.LexisNexisin mukaan

- Synteettiset identiteettipetokset lisääntyivät 31%:llä. kun huijarit hyödyntävät yhä enemmän tekoälyä

- Puolet kaikista tutkituista yrityksistä on kokenut tekoälyn tuottamaan sisältöön liittyviä petoksia. vuonna 2024

- Digitaalisten petosten aiheuttamat maailmanlaajuiset tappiot olivat yli $47,8 miljardia euroa. vuonna 2024, mikä vastaa 15%:n lisäystä.

Johtajan sokea piste: Miksi johto on valmistautumaton

Tietoisuuskuilu

Vaikka uhka on kasvanut, useimmat johtajat eivät ole siitä vielä juurikaan tietoisia:

- 76% kyselyyn vastanneista näki sääntelyvaatimusten lisääntyvän. vaativat vahvempaa henkilöllisyyden todentamista

- Digitaalisten kanavien osuus petoksista on nyt 51%., ohittaen fyysiset kanavat ensimmäistä kertaa.

- Vain 43% rahoitusalan organisaatioista käyttää kehittyneitä todentamismenetelmiä. kun petoksen punaiset liput näkyvät

- Useimmilla organisaatioilla ei ole kattavia tekoälypetosten havaitsemisstrategioita

Koulutusvaje

Kuilu uusien uhkien ja organisaatioiden valmiuden välillä on kasvanut. Useimmat turvallisuuskoulutukset eivät vieläkään kata tekoälyn aiheuttamia huijauksia, joten työntekijät eivät ole valmistautuneet. Syväväärennöksiä ja tekoälykuvia koskevaa tietämystä ei vieläkään ole laajalti, eivätkä todentamismenettelyt ole mukautuneet tekoälyn tuottamiin asiakirjoihin. Lisäksi havaitsemisvalmiudet ovat edelleen puutteelliset verrattuna sukupolviteknologiaan.

Vaikutus teollisuuteen: Sektorit piiritettynä

Haavoittuvimmat toimialat

Vuoden 2024 petostilastojen perusteella suurimmat riskit kohdistuvat seuraaviin aloihin:

- Dating alustat (8,9% petosprosentti): Romantiikkahuijaukset, joissa käytetään tekoälyn luomia asiakirjoja sisältäviä väärennettyjä profiileja.

- Verkkomedia (4,27% petosprosentti): Tilin todentaminen synteettisten asiakirjojen avulla

- Pankkitoiminta ja vakuutukset (3,14% petosprosentti): Tilien avaamiseen ja lainoihin liittyvät petokset

- Kryptovaluutta (88% of deepfake cases): KYC:n ohittaminen tekoälyn luomilla henkilöllisyyksillä

Teknologian asevarustelukilpailu: havaitseminen vs. sukupolvi

Nykyiset havaintokyvyt

Organisaatiot, jotka ovat investoineet paljon tekoälyyn perustuviin työkaluihin tekoälyn aiheuttamien petosten torjumiseksi, ovat alkaneet nähdä tuloksia: Tekoälypohjaiset petosten havaitsemisjärjestelmät ovat jo auttaneet yrityksiä vähentämään petostapauksia noin 30%.

Myös muita tekniikoita tutkitaan. Lohkoketju voi parantaa tietoturvaa, mutta se tarvitsee vielä laajempaa hyväksyntää ollakseen tehokas.

Kun biometrinen todentaminen yhdistetään asiakirjojen analysointiin, saadaan aikaan luotettavampi todentamismuoto.

Reaaliaikaisesta havaitsemisesta on tulossa tehokas suojauskeino. Se vahvistaa, että henkilö on todella paikalla, ja estää rikollisia käyttämästä väärennettyjä staattisia kuvia todentamisen aikana.

Hienostuneisuuskuilu

Havaitsemisvarmuuden ja todellisen ennaltaehkäisyn välillä on kuitenkin huolestuttava epäsuhta:

- Niiden vastaajien osuus, jotka luottavat siihen, että teknologiayritykset pitävät biometriset tiedot turvassa, laski 29%:stä vuonna 2022 5%:hen vuonna 2024.

- Monet organisaatiot yliarvioivat havaitsemisvalmiutensa aliarvioimalla samalla uhkien kehittyneisyyttä

- Perinteiset turvatoimet osoittautuvat riittämättömiksi tekoälyn luomia asiakirjoja vastaan

- Ilmaisinteknologian kehitys on jäljessä sukupolvien kehityksestä.

Sääntelyn vastaus: Oikeudellinen ympäristö

Nykyinen oikeudellinen kehys

Maailmanlaajuisesti hallitukset pyrkivät puuttumaan tekoälyn tuottamiin asiakirjapetoksiin, mutta edistyminen on ollut hidasta:

- EU:n eIDAS-asetus tuli voimaan toukokuussa 2024, ja siinä edellytetään vahvempaa digitaalisen henkilöllisyyden todentamista.

- Useat maat ovat vahvistaneet suojaa terveydenhuollon tietojen ja henkilöllisyyden todentaminen

- Uudet säännökset edellyttävät avoimuutta tekoälypohjaisissa identiteetin todentamisprosesseissa

- Rikosoikeudelliset seuraamukset tekoälyn avulla luotujen asiakirjojen käyttäminen vilpilliseen tarkoitukseen on mahdollista.

Johtajan puolustuksen rakentaminen: Kokonaisvaltainen suojelustrategia

1. Välitön riskinarviointi

Nykyisten tarkastusprosessien tarkastaminen: Tarkastele, miten organisaatiosi validoi henkilöllisyysasiakirjat tällä hetkellä, ja tunnista tekoälypetosten haavoittuvuudet.

Tunnista korkean riskin kosketuspisteet: Kartoita kaikki kohdat, joissa henkilöllisyystodistuksia hyväksytään, sisäänotto, tilien palautus, arvokkaat maksutapahtumat ja vaatimustenmukaisuuden todentaminen.

Havaintokyvyn arviointi: Arvioidaan, pystyvätkö nykyiset järjestelmät tunnistamaan tekoälyn tuottamat asiakirjat vai tarvitaanko päivityksiä.

2. Teknologiaratkaisut

Kehittynyt kuva-analyysi: Ota käyttöön tekoälypohjaisia havaitsemisjärjestelmiä, jotka voivat tunnistaa hienovaraisia epäjohdonmukaisuuksia tekoälyn tuottamissa asiakirjoissa:

- Tekstuurianalyysi: Havaitse luonnottomat kuviot asiakirjojen taustoista ja turvallisuusominaisuuksista.

- Johdonmukaisuuden tarkistus: Tarkista fonttien, välilyöntien ja virallisen muotoilun kohdistaminen.

- Metatietojen tarkastelu: Analysoi kuvanluontitietoja tekoälyn luomisen merkkien löytämiseksi.

- Reaaliaikainen todentaminen: Ota käyttöön järjestelmiä, jotka voivat käsitellä asiakirjoja välittömästi asiakaskohtaamisten aikana.

Monitekijävarmennus: Yhdistä asiakirjojen analyysi ja muut todentamismenetelmät:

- Hallituksen tietokannan todentaminen: Ristiinviittaus asiakirjanumeroihin virallisten tietokantojen kanssa.

- Biometrinen täsmäytys: Käytä kasvojentunnistusta asiakirjakuvien ja elävien kohteiden yhdistämiseen.

- Käyttäytymisanalyysi: Seuraa käyttäjien käyttäytymismalleja todentamisprosessien aikana

3. Koulutus ja tietoisuus

Johtajakoulutus: Johtoryhmät tarvitsevat erityiskoulutusta tekoälyn kuvapetosriskeistä ja riittämättömän todentamisen vaikutuksista liiketoimintaan.

Työntekijöiden koulutusohjelmat: Etulinjan henkilöstö tarvitsee koulutusta seuraavista aiheista:

- Visuaaliset havaitsemistekniikat: Miten tunnistaa mahdolliset tekoälyn luomat asiakirjat

- Tarkastusmenettelyt: Milloin ja miten epäilyttäviä asiakirjoja on käsiteltävä?

- Teknologian integrointi: Miten havaintovälineitä käytetään tehokkaasti

Jatkuvat päivitykset: Säännölliset koulutuspäivitykset tekoälyn luomismenetelmien kehittyessä.

4. Prosessin uudelleensuunnittelu

Tarkastusprotokollat: Toteuttaa monivaiheinen todentaminen korkean riskin skenaarioita varten:

- Ensisijainen asiakirjojen tarkastelu: Alustava arviointi havaitsemistekniikan avulla

- Toissijainen todentaminen: Tietokannan ristiviittaus asiakirjojen aitoutta varten

- Kolmannen asteen vahvistus: Lisätarkastus arvokkaissa tai epäilyttävissä tapauksissa

Poikkeusten käsittely: Selkeät menettelyt sellaisten asiakirjojen hallinnoimiseksi, joiden todentaminen ei onnistu tai joissa on merkkejä tekoälyn tuottamisesta.

Ratkaisu: Yritysluokan tekoälyn kuvantunnistus

Miksi perinteiset lähestymistavat epäonnistuvat

Asiakirjojen vakiotarkistukset on suunniteltu vanhanlaisten väärennösten, ei tekoälyn tekemien asiakirjojen, jäljittämistä varten. Nykyaikainen tekoälykuvantuotanto tarvitsee yhtä kehittyneitä havaitsemisominaisuuksia.

Nykyisiin todentamispuutteisiin kuuluvat:

- Inhimillinen virhe: Manuaaliset tarkastajat eivät pysty luotettavasti tunnistamaan tekoälyn tuottamia hienostuneita asiakirjoja.

- Rajoitettu tekninen analyysi: Perusvarmennus keskittyy ilmeisiin muutoksiin, jolloin hienovaraiset tekoälyindikaattorit puuttuvat.

- Mittakaavan rajoitukset: Manuaaliset prosessit eivät pysty käsittelemään tekoälyn luomia petosyrityksiä.

- Evoluution viive: Staattiset verifiointimenettelyt eivät pysty mukautumaan nopeasti kehittyviin tekoälytekniikoihin.

Erikoistuneen tekoälyn havaitsemisen tarve

Organisaatiot, jotka haluavat tosissaan suojautua tekoälyn kuvapetoksilta, tarvitsevat tarkoitusta varten kehitettyjä tunnistusjärjestelmiä, jotka pystyvät:

- Analysoi AI-sukupolven markkereita: Havaita tekoälyn luomissa kuvissa esiintyvät hienovaraiset artefaktit ja kuviot.

- Reaaliaikainen käsittely: Välitön analyysi asiakirjojen toimittamisen aikana

- Jatkuva oppiminen: Sopeutuminen uusiin tekoälytekniikoihin sitä mukaa kuin niitä syntyy.

- Integrointikyvyt: Toimii saumattomasti nykyisten todentamistyönkulkujen kanssa.

Tehokkaat tekoälyn kuvantunnistusjärjestelmät käyttävät kehittyneitä algoritmeja tunnistamiseen:

- Pikselitason epäjohdonmukaisuudet: Hienovaraisia kuvioita, jotka viittaavat tekoälyn sukupolveen

- Pakkausartefaktat: Tekoälyn kuvien luomisprosessien digitaaliset allekirjoitukset

- Tilastolliset poikkeamat: Matemaattiset kuviot, jotka eroavat luonnollisista kuvista

- Ajalliset epäjohdonmukaisuudet: Merkkejä kuvankäsittelystä tai kuvien luomisesta

Lopputulos: AI Image Fraud on täällä ja kiihtyy.

Tilastot ovat kiistattomia: Tekoälyn luomat asiakirjapetokset ovat kehittyneet teoreettisesta uhasta todellisuudeksi, joka on aiheuttanut miljardeja tappioita.

Pelkästään GPT-4o on jo tuottanut yli 700 miljoonaa kuvaa, ja tekoälyominaisuudet kehittyvät nopeasti, joten organisaatiot kohtaavat kasvavan uhan, johon perinteiset turvatoimet eivät pysty vastaamaan.

Ennakoivan puolustuksen ikkuna sulkeutuu nopeasti.

Vakuuttavien väärennettyjen asiakirjojen luomiseen tarvittava tekniikka on nyt kaikkien saatavilla, joilla on internet-yhteys. Samaan aikaan tekoälyn tuottamien asiakirjojen kehittyneisyys paranee jatkuvasti, mikä tekee niiden havaitsemisesta yhä haastavampaa inhimillisille tarkastajille ja perustarkastusjärjestelmille.

Organisaatiot, jotka kieltäytyvät mukauttamasta todentamisprosessejaan tähän uuteen todellisuuteen, kohtaavat monia riskejä:

- Suorat taloudelliset tappiot: Petoksista tekoälyn avulla luotujen asiakirjojen avulla

- Sääntelyyn liittyvät seuraamukset: Tehostettujen tarkastusvaatimusten noudattamatta jättäminen

- Mainevahingot: Siitä, että heidät yhdistetään identiteettipetoksiin

- Toiminnan häiriöt: Tutkinta- ja korjaustoimista

Kysymys ei ole siitä, tuleeko organisaatiosi kohtaamaan tekoälyn luomia asiakirjapetoksia, vaan siitä, oletko valmis havaitsemaan ja estämään ne.

Teknologia on olemassa tekoälyn tuottamien petosten torjumiseksi. Kehittyneet havaitsemisjärjestelmät voivat tunnistaa hienovaraiset merkit, jotka erottavat tekoälyn luomat asiakirjat aidoista asiakirjoista. Käyttöönotto edellyttää kuitenkin välittömiä toimia, sillä uhka kehittyy päivittäin.

Yritysten on nyt investoitava kattaviin tekoälyn kuvantunnistusominaisuuksiin tai vaarana on, että niistä tulee jälleen yksi uhri aikamme nopeimmin kasvavassa petosluokassa.

Johtajat, jotka ovat valmiita suojaamaan organisaationsa tekoälyn kuvapetoksilta, voivat hyödyntää nykyisin kehittynyttä tunnistustekniikkaa. Lue, miten yritystason tekoälyn kuvantunnistus voi suojata todentamisprosesseja osoitteessa osoitteessa truthscan.com/ai-image-detector.

Viitteet

- Outlook Money. "ChatGPT voi luoda väärennettyjä Aadhaar- ja PAN-kortteja. Here's What You Need to Know." Outlook Money, 5. huhtikuuta 2025. https://www.outlookmoney.com/news/chatgpt-can-generate-fake-aadhaar-pan-cards-heres-what-you-need-to-know

- Business Today. "Väärennetty Aadhaar, PAN ChatGPT: Miten tunnistaa todelliset hallituksen henkilötodistukset; tarkista vaiheet." Business Today, 5. huhtikuuta 2025. https://www.businesstoday.in/personal-finance/news/story/fake-aadhaar-pan-with-chatgpt-how-to-identify-real-government-id-proofs-check-steps-470849-2025-04-05

- Business Standard. "ChatGPT voi luoda väärennettyjä Aadhaar- ja PAN-kortteja: " Business Standard, 7. huhtikuuta 2025. https://www.business-standard.com/finance/personal-finance/chatgpt-can-generate-fake-aadhaar-pan-cards-how-to-verify-them-125040700728_1.html

- OneIndia Uutiset. "Voiko ChatGPT luoda Aadhaar-kortteja ja PAN-kortteja? Netizens Bombard Social Media With Fake ID Cards." OneIndia Uutiset, 4. huhtikuuta 2025. https://www.oneindia.com/india/can-chatgpt-create-aadhaar-cards-pan-cards-netizens-bombard-social-media-with-fake-id-cards-4114335.html

- Business Today Teknologia. "Väärennetyt Aadhaar-kortit herättävät huolta, kun ChatGPT:n imagotyökalu saavuttaa 700 miljoonaa luomusta." Business Today, 4. huhtikuuta 2025. https://www.businesstoday.in/technology/news/story/fake-aadhaar-cards-spark-concern-as-chatgpts-image-tool-hits-700-million-creations-470750-2025-04-04

- MoneyLife. "Petosvaroitus: Tekoälyt luovat aidon näköisiä 'väärennettyjä' Aadhaar- ja PAN-kortteja!" MoneyLife. https://www.moneylife.in/article/fraud-alert-ais-creating-genuinelooking-fake-aadhaar-pan-cards/76873.html

- Data Insights -markkinat. "ChatGPT herättää henkilöllisyyspetosten pelkoja: " Data Insights -markkinat. https://www.datainsightsmarket.com/news/article/chatgpt-can-generate-fake-aadhaar-pan-cards-13557

- Angel One. "ChatGPT voi luoda väärennettyjä Aadhaar- ja PAN-kortteja. " Angel One, 8. huhtikuuta 2025. https://www.angelone.in/news/chatgpt-can-generate-fake-aadhaar-and-pan-cards-how-to-verify-them

- Biometrinen päivitys. "Yhteiskunta kuhisee ChatGPT:n tuottamia passeja ja henkilökortteja." Biometrinen päivitys, 11. huhtikuuta 2025. https://www.biometricupdate.com/202504/social-buzzes-with-chatgpt-generated-passports-and-id-cards

- Munsif Daily. "ChatGPT:n kuvatyökalua käytetään Aadhaar- ja PAN-korttien luomiseen, yksityisyyden suojaa ja väärinkäyttöä koskevat huolenaiheet lisääntyvät." Munsif Daily, 4. huhtikuuta 2025. https://munsifdaily.com/chatgpts-image-tool-used-to-generate-aadhaar-and-pan-cards/

- Snappt. "Henkilöllisyyden todentamisen trendit vuodelle 2025 ja tulevaisuuden näkymät." Snappt, 4. elokuuta 2025. https://snappt.com/blog/id-verification-trends/

- Snappt. "Identiteettipetostilastot vuodelle 2025." Snappt, 20. marraskuuta 2024. https://snappt.com/blog/identity-fraud-statistics/

- Sumsub. "Petostrendit vuonna 2025: .". Sumsub. https://sumsub.com/blog/fraud-trends-sumsub-fraud-report/

- Sumsub. "2024 Identiteettivarkauksia ja petoksia koskevat tilastot." Sumsub. https://sumsub.com/fraud-report-2024/

- arXiv. "Tekoälypohjainen identiteettipetosten havaitseminen: A Systematic Review." arXiv, 16. tammikuuta 2025. https://arxiv.org/html/2501.09239v1

- Entrust. "Identiteetin todentamisen suuntaukset vuonna 2025 ja sen jälkeen". Entrust, 5. elokuuta 2025. https://www.entrust.com/blog/2025/02/identity-verification-trends-in-2025-and-beyond

- Incode. "Top 5 tapausta tekoälyn Deepfake-huijauksista vuodelta 2024 paljastui." Incode blogi, 20. joulukuuta 2024. https://incode.com/blog/top-5-cases-of-ai-deepfake-fraud-from-2024-exposed/

- Mitek Systems. "Vuoden 2025 petosennusteet: .". Mitek Systems, 12. joulukuuta 2024. https://www.miteksystems.com/blog/2025-fraud-predictions-industry-innovators

- KYC Hub. "Top 7 Identiteetin todentamisen trendejä vuodelle 2025." KYC Hub, 30. joulukuuta 2024. https://www.kychub.com/blog/identity-verification-trends/