Por qué el último avance de OpenAI se ha convertido en el nuevo quebradero de cabeza de todos los ejecutivos

El experimento que rompió Internet

En abril de 2025, un simple experimento en las redes sociales sacudió todo el mundo de la ciberseguridad. Los usuarios descubrieron que el GPT-4o de OpenAI podía generar tarjetas Aadhaar falsas y realistas, el sistema nacional de identificación de la India, que cubre a más de 1.300 millones de personas.

En pocas horas, las plataformas de las redes sociales se inundaron de documentos de identidad generados por IA en los que aparecían desde ciudadanos de a pie hasta personajes públicos como Sam Altman y Elon Musk.

Las cifras eran escalofriantes. Desde su lanzamiento, el GPT-4o de OpenAI ya ha realizado más de 700 millones de imágenes.

No vuelva a preocuparse por el fraude de IA. TruthScan puede ayudarle:

- Detectar IA generada imágenes, texto, voz y vídeo.

- Evite grandes fraudes impulsados por la IA.

- Proteja sus sensible activos de la empresa.

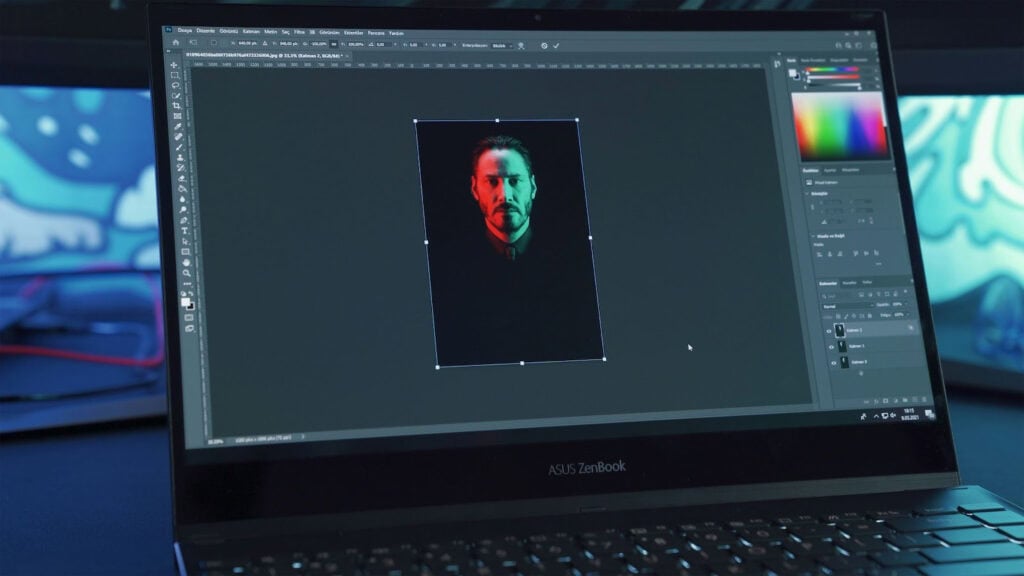

Lo que empezó como una experimentación creativa con retratos al estilo de Studio Ghibli pronto se convirtió en algo más preocupante. Los usuarios empezaron a compartir maquetas fotorrealistas de tarjetas de identificación del gobierno, con códigos QR, formato oficial y datos personales inventados que parecían inquietantemente auténticos.

La tecnología detrás de la amenaza: Por qué GPT-4o es diferente

Una nueva clase de generación de imágenes por IA

A diferencia de DALL-E, GPT-4o está integrado en ChatGPT. Este cambio le confiere nuevas capacidades, pero también crea nuevos riesgos.

Como reconoce OpenAI en su documentación oficial del sistema: "Estas capacidades, por sí solas y en nuevas combinaciones, tienen el potencial de crear riesgos en una serie de áreas, en formas que los modelos anteriores no podían".

El problema de la accesibilidad

La democratización de la tecnología de generación de imágenes ha creado lo que los expertos denominan la "tormenta perfecta" para el fraude de identidad.

En primer lugar, no se necesitan conocimientos técnicos. Cualquiera puede crear documentos falsos simplemente escribiendo una solicitud en lenguaje natural. Los resultados son fotorrealistas y se asemejan mucho a los diseños, fuentes y maquetaciones oficiales.

En sólo unos minutos se pueden fabricar documentos de identidad falsos a gran escala. Y como la tecnología funciona en los sistemas de identificación de distintos países, la amenaza es mundial.

Datos de formación

Lo más preocupante es la cuestión de las fuentes de datos. Los usuarios se preguntan de dónde ha sacado GPT-4o los datos de entrenamiento para reproducir documentos gubernamentales con tanta precisión. Los usuarios se preguntan de dónde sacó el modelo los datos de las fotos de Aadhaar para entrenarse y cómo pudo aprender el formato con tanta precisión.

La magnitud del fraude de imágenes con IA: Una crisis creciente

Las estadísticas actuales dibujan un panorama desolador

El fraude generado por la IA representa una de las amenazas de más rápido crecimiento en ciberseguridad:

- La tasa mundial de fraude pasó de 1,10% en 2021 a 2,50% en 2024un aumento de 127% en sólo tres años

- Los documentos falsificados o alterados representan el 50% de todos los intentos de fraude en 2024, según el Informe sobre fraude de identidad de Sumsub.

- Las falsificaciones digitales mediante IA generativa representan ya el 57% de todo el fraude documental244% más que el año anterior

- El fraude de identidad relacionado con el deepfake se multiplicó por diez en 2023 en comparación con el año anterior

Impacto financiero en todos los sectores

Las consecuencias económicas ya son graves y se están acelerando:

- El fraude posibilitado por la IA podría costar $10,5 billones en todo el mundo en 2025según LexisNexis

- El fraude de identidad sintética aumentó un 31% los defraudadores explotan cada vez más la IA

- La mitad de las empresas encuestadas han sufrido fraudes relacionados con contenidos generados por inteligencia artificial. en 2024

- Las pérdidas mundiales por fraude digital superaron los $47.800 millones en 2024, lo que supone un aumento de 15%

El punto ciego de los directivos: Por qué el liderazgo no está preparado

El déficit de sensibilización

Aunque se ha producido un crecimiento de la amenaza, la mayoría de los ejecutivos apenas son conscientes de ello:

- 76% de los encuestados ven un aumento de los requisitos normativos pedir una mayor verificación de la identidad

- Los canales digitales representan ya el 51% del fraudesuperando por primera vez a los canales físicos

- Sólo 43% de las organizaciones financieras utilizan métodos avanzados de verificación cuando aparecen las banderas rojas del fraude

- La mayoría de las organizaciones carecen de estrategias integrales de detección del fraude mediante IA

El déficit de formación

La brecha entre las nuevas amenazas y el grado de preparación de las organizaciones ha ido en aumento. La mayor parte de la formación en seguridad sigue sin cubrir las estafas generadas por IA, por lo que los empleados no están preparados. Todavía no hay un conocimiento generalizado sobre las deepfakes y las imágenes de IA, y los procedimientos de verificación no se han adaptado a la documentación generada por IA. Por último, las capacidades de detección siguen siendo insuficientes en comparación con la tecnología de generación.

Impacto en la industria: Sectores asediados

Industrias más vulnerables

Según las estadísticas de fraude de 2024, los sectores con mayor riesgo son:

- Plataformas de citas (tasa de fraude del 8,9%): Estafas románticas que utilizan perfiles falsos con documentos generados por IA

- Medios de comunicación en línea (tasa de fraude de 4,27%): Evasión de la verificación de cuentas mediante documentos sintéticos

- Banca y seguros (tasa de fraude de 3,14%): Fraude en la apertura de cuentas y préstamos

- Criptomoneda (88% de casos de deepfake): Elusión del sistema KYC mediante identidades generadas por IA

La carrera de armamentos tecnológica: detección frente a generación

Capacidades de detección actuales

Las organizaciones que han realizado grandes inversiones en herramientas basadas en IA para luchar contra el fraude generado por esta tecnología han empezado a ver resultados: Los sistemas de detección de fraude basados en IA ya han ayudado a las empresas a reducir los casos de fraude en aproximadamente 30%.

También se están explorando otras tecnologías. Blockchain puede proporcionar una mayor seguridad de los datos, aunque todavía necesita una adopción más amplia para ser eficaz.

La verificación biométrica, combinada con el análisis de documentos, crea una forma de autenticación más fiable.

Por último, la detección en tiempo real se está convirtiendo en una poderosa salvaguardia. Confirma que una persona está realmente presente y evita que los delincuentes utilicen imágenes estáticas falsas durante la verificación.

La brecha de la sofisticación

Sin embargo, existe una disparidad preocupante entre la confianza en la detección y la prevención real:

- El porcentaje de encuestados que confían en que las empresas tecnológicas mantengan seguros los datos biométricos se redujo de 29% en 2022 a 5% en 2024

- Muchas organizaciones sobrestiman su capacidad de detección subestimando la sofisticación de las amenazas

- Las medidas de seguridad tradicionales resultan insuficientes contra documentos generados por IA

- La evolución de la tecnología de detección va a la zaga de los avances generacionales

Respuesta normativa: El panorama jurídico

Marco jurídico actual

Los gobiernos de todo el mundo se esfuerzan por hacer frente al fraude documental generado por IA, con lentas mejoras:

- Reglamento eIDAS de la UE entró en vigor en mayo de 2024, exigiendo una verificación más estricta de la identidad digital

- Varios países han reforzado las protecciones en torno a los datos sanitarios y la verificación de identidad

- La nueva normativa obliga a la transparencia en procesos de verificación de identidad basados en IA

- Sanciones penales por el uso fraudulento de documentos generados por IA

Construir la defensa ejecutiva: Una estrategia de protección integral

1. Evaluación inmediata del riesgo

Auditoría de los actuales procesos de verificación: Revise cómo valida actualmente su organización los documentos de identidad e identifique los puntos vulnerables al fraude de IA.

Identificar los puntos de contacto de alto riesgo: Mapee todos los puntos en los que se aceptan documentos de identidad, incorporación, recuperación de cuentas, transacciones de alto valor y verificación del cumplimiento.

Evaluar la capacidad de detección: Evaluar si los sistemas actuales pueden identificar los documentos generados por IA o si es necesario actualizarlos.

2. Soluciones tecnológicas

Análisis avanzado de imágenes: Despliegue sistemas de detección basados en IA que puedan identificar incoherencias sutiles en documentos generados por IA:

- Análisis de texturas: Detección de patrones no naturales en fondos de documentos y elementos de seguridad

- Comprobación de la coherencia: Verifique la alineación entre fuentes, el espaciado y el formato oficial.

- Examen de metadatos: Analizar los datos de creación de imágenes en busca de indicios de generación de IA

- Verificación en tiempo real: Implantar sistemas que puedan procesar documentos instantáneamente durante las interacciones con los clientes.

Verificación multifactor: Combinar el análisis de documentos con otros métodos de verificación:

- Verificación de bases de datos gubernamentales: Números de documentos de referencia cruzada con bases de datos oficiales

- Correspondencia biométrica: Utiliza el reconocimiento facial para emparejar fotos de documentos con sujetos vivos

- Análisis del comportamiento: Seguimiento de los patrones de comportamiento de los usuarios durante los procesos de verificación

3. Formación y sensibilización

Educación ejecutiva: Los equipos directivos necesitan formación específica sobre los riesgos de fraude de imagen de IA y las implicaciones empresariales de una verificación inadecuada.

Programas de formación para empleados: El personal de primera línea necesita formación sobre:

- Técnicas de detección visual: Cómo detectar posibles documentos generados por IA

- Procedimientos de verificación: Cuándo y cómo escalar documentos sospechosos

- Integración de la tecnología: Cómo utilizar eficazmente las herramientas de detección

Actualizaciones en curso: Actualizaciones periódicas de la formación a medida que evolucionan las técnicas de generación de IA.

4. Rediseño de procesos

Protocolos de verificación: Implantar la verificación multipaso para escenarios de alto riesgo:

- Revisión de documentos primarios: Evaluación inicial mediante tecnología de detección

- Verificación secundaria: Base de datos de referencias cruzadas para la autenticidad de los documentos

- Confirmación terciaria: Verificación adicional para casos de alto valor o sospechosos

Gestión de excepciones: Procedimientos claros para gestionar los documentos que no se verifiquen o que muestren signos de generación de IA.

La solución: Detección de imágenes con IA de nivel empresarial

Por qué fracasan los enfoques tradicionales

Los controles de documentos estándar se crearon para detectar falsificaciones a la antigua usanza, no documentos creados con IA. La generación moderna de imágenes de IA necesita capacidades de detección igualmente sofisticadas.

Las lagunas de verificación actuales incluyen:

- Error humano: Los revisores manuales no pueden identificar con fiabilidad los documentos sofisticados generados por IA.

- Análisis técnico limitado: La verificación básica se centra en las alteraciones evidentes y pasa por alto los indicadores sutiles de IA

- Limitaciones de la escala: Los procesos manuales no pueden hacer frente al volumen de intentos de fraude generados por la IA.

- Evolución Lag: Los procedimientos de verificación estática no pueden adaptarse a la rápida evolución de las técnicas de IA

La necesidad de una detección especializada de la IA

Las organizaciones que se tomen en serio la protección contra el fraude de imágenes de IA necesitan sistemas de detección especialmente diseñados para ello:

- Analizar los marcadores de generación de IA: Detecte artefactos sutiles y patrones exclusivos de las imágenes generadas por IA.

- Procesamiento en tiempo real: Proporcionar análisis inmediatos durante la presentación de documentos

- Aprendizaje continuo: Adaptarse a las nuevas técnicas de generación de IA a medida que surgen.

- Capacidades de integración: Funciona a la perfección con los flujos de trabajo de verificación existentes

Los sistemas eficaces de detección de imágenes por IA utilizan algoritmos avanzados para identificar:

- Inconsistencias a nivel de píxel: Patrones sutiles que indican la generación de IA

- Artefactos de compresión: Firmas digitales de los procesos de creación de imágenes AI

- Anomalías estadísticas: Patrones matemáticos que difieren de las imágenes naturales

- Incoherencias temporales: Indicios de manipulación o generación de imágenes

Lo esencial: El fraude de imágenes con IA está aquí y se acelera

Las estadísticas son innegables: El fraude documental generado por IA ha pasado de ser una amenaza teórica a una realidad presente, causando miles de millones en pérdidas.

Con más de 700 millones de imágenes ya generadas sólo por GPT-4o, y las capacidades de IA avanzando rápidamente, las organizaciones se enfrentan a una amenaza creciente que las medidas de seguridad tradicionales no pueden abordar.

La ventana para una defensa proactiva se está cerrando rápidamente.

La tecnología para generar documentos falsos convincentes está ahora al alcance de cualquiera con acceso a Internet. Mientras tanto, la sofisticación de los documentos generados por IA sigue mejorando, lo que hace que su detección sea cada vez más difícil para los revisores humanos y los sistemas de verificación básicos.

Las organizaciones que se niegan a adaptar sus procesos de verificación a esta nueva realidad se enfrentan a muchos riesgos:

- Pérdidas financieras directas: Del fraude mediante documentos generados por IA

- Sanciones reglamentarias: Por no cumplir los requisitos de verificación reforzada

- Daños a la reputación: De ser asociado con incidentes de fraude de identidad

- Perturbaciones operativas: De los esfuerzos de investigación y reparación

La cuestión no es si su empresa se enfrentará al fraude documental generado por IA, sino si estará preparada para detectarlo y evitarlo.

Existe tecnología para luchar contra el fraude generado por IA. Los sistemas de detección avanzados pueden identificar los sutiles marcadores que distinguen los documentos generados por IA de los auténticos. Pero su aplicación requiere una actuación inmediata, ya que la amenaza evoluciona a diario.

Las empresas tienen que invertir ahora en capacidades completas de detección de imágenes mediante IA, o arriesgarse a convertirse en otra víctima de la categoría de fraude de más rápido crecimiento de nuestro tiempo.

Para los ejecutivos dispuestos a proteger sus organizaciones contra el fraude de imágenes de IA, la tecnología de detección avanzada está disponible hoy. Descubra cómo la detección de imágenes de IA de nivel empresarial puede proteger sus procesos de verificación en truthscan.com/ai-detector-de-imagen.

Referencias

- Outlook Dinero. "ChatGPT puede generar tarjetas Aadhaar y PAN falsas: Esto es lo que debes saber". Outlook Dinero, 5 de abril de 2025. https://www.outlookmoney.com/news/chatgpt-can-generate-fake-aadhaar-pan-cards-heres-what-you-need-to-know

- La actualidad empresarial. "Aadhaar falso, PAN con ChatGPT: Cómo identificar las pruebas de identificación del gobierno real; comprobar los pasos". La actualidad empresarial, 5 de abril de 2025. https://www.businesstoday.in/personal-finance/news/story/fake-aadhaar-pan-with-chatgpt-how-to-identify-real-government-id-proofs-check-steps-470849-2025-04-05

- Estándar empresarial. "ChatGPT puede generar falsas tarjetas Aadhaar, PAN: Cómo verificarlas". Estándar empresarial, 7 de abril de 2025. https://www.business-standard.com/finance/personal-finance/chatgpt-can-generate-fake-aadhaar-pan-cards-how-to-verify-them-125040700728_1.html

- Noticias OneIndia. "¿Puede ChatGPT crear tarjetas Aadhaar y PAN? Los internautas bombardean las redes sociales con DNI falsos". Noticias OneIndia4 de abril de 2025. https://www.oneindia.com/india/can-chatgpt-create-aadhaar-cards-pan-cards-netizens-bombard-social-media-with-fake-id-cards-4114335.html

- Negocios Hoy Tecnología. "Las tarjetas Aadhaar falsas desatan la preocupación: la herramienta de imagen de ChatGPT alcanza los 700 millones de creaciones". La actualidad empresarial4 de abril de 2025. https://www.businesstoday.in/technology/news/story/fake-aadhaar-cards-spark-concern-as-chatgpts-image-tool-hits-700-million-creations-470750-2025-04-04

- MoneyLife. "Alerta de fraude: ¡Inteligencias Artificiales crean tarjetas Aadhaar y PAN "falsas" que parecen auténticas!". MoneyLife. https://www.moneylife.in/article/fraud-alert-ais-creating-genuinelooking-fake-aadhaar-pan-cards/76873.html

- Mercado de la información. "ChatGPT desata temores de fraude de identidad: ¿Puede realmente generar tarjetas Aadhaar y PAN falsas?". Mercado de la información. https://www.datainsightsmarket.com/news/article/chatgpt-can-generate-fake-aadhaar-pan-cards-13557

- Ángel Uno. "ChatGPT puede generar tarjetas Aadhaar y PAN falsas: Cómo verificarlas". Ángel Uno, 8 de abril de 2025. https://www.angelone.in/news/chatgpt-can-generate-fake-aadhaar-and-pan-cards-how-to-verify-them

- Actualización biométrica. "La sociedad bulle con pasaportes y carnés de identidad generados por ChatGPT". Actualización biométrica, 11 de abril de 2025. https://www.biometricupdate.com/202504/social-buzzes-with-chatgpt-generated-passports-and-id-cards

- Diario Munsif. "ChatGPT's Image Tool Used to Generate Aadhaar and PAN Cards, Privacy and Misuse Concerns Mount". Diario Munsif4 de abril de 2025. https://munsifdaily.com/chatgpts-image-tool-used-to-generate-aadhaar-and-pan-cards/

- Snappt. "Tendencias en verificación de identidad para 2025 y perspectivas de futuro". Snappt4 de agosto de 2025. https://snappt.com/blog/id-verification-trends/

- Snappt. "Estadísticas de fraude de identidad para 2025". Snappt20 de noviembre de 2024. https://snappt.com/blog/identity-fraud-statistics/

- Sumsub. "Tendencias del fraude para 2025: De las estafas impulsadas por IA al robo de identidad y la democratización del fraude". Sumsub. https://sumsub.com/blog/fraud-trends-sumsub-fraud-report/

- Sumsub. "Estadísticas de robo de identidad y fraude en 2024". Sumsub. https://sumsub.com/fraud-report-2024/

- arXiv. "Detección del fraude de identidad basado en IA: Una revisión sistemática". arXiv, 16 de enero de 2025. https://arxiv.org/html/2501.09239v1

- Confíe en. "Tendencias en la verificación de identidad en 2025 y más allá". Confíe en5 de agosto de 2025. https://www.entrust.com/blog/2025/02/identity-verification-trends-in-2025-and-beyond

- Incode. "Expuestos los 5 principales casos de fraude de IA Deepfake de 2024". Blog de Incode20 de diciembre de 2024. https://incode.com/blog/top-5-cases-of-ai-deepfake-fraud-from-2024-exposed/

- Sistemas Mitek. "Predicciones sobre el fraude en 2025: Perspectivas sobre las nuevas amenazas de fraude". Sistemas Mitek12 de diciembre de 2024. https://www.miteksystems.com/blog/2025-fraud-predictions-industry-innovators

- Centro KYC. "Las 7 principales tendencias en verificación de identidad para 2025". Centro KYC30 de diciembre de 2024. https://www.kychub.com/blog/identity-verification-trends/