Warum der jüngste Durchbruch von OpenAI das neueste Kopfzerbrechen eines jeden Managers geworden ist

Das Experiment, das das Internet sprengte

Im April 2025 erschütterte ein einfaches Experiment in den sozialen Medien die gesamte Welt der Cybersicherheit. Die Nutzer fanden heraus, dass OpenAIs GPT-4o eine realistische gefälschte Aadhaar-KartenIndiens nationales ID-System, das über 1,3 Milliarden Menschen erfasst.

Innerhalb weniger Stunden wurden die sozialen Medien mit KI-generierten Identitätsdokumenten überschwemmt, auf denen jeder zu sehen ist, vom einfachen Bürger bis zu Persönlichkeiten des öffentlichen Lebens wie Sam Altman und Elon Musk.

Die Zahlen waren erschreckend. Seit seiner Veröffentlichung hat der GPT-4o von OpenAI bereits mehr als 700 Millionen Bilder erstellt.

Machen Sie sich nie wieder Sorgen über KI-Betrug. TruthScan Kann Ihnen helfen:

- Erkennen Sie AI-generierte Bilder, Text, Sprache und Video.

- Vermeiden Sie KI-gesteuerter Betrug in großem Umfang.

- Schützen Sie Ihre wichtigsten empfindlich Unternehmensvermögen.

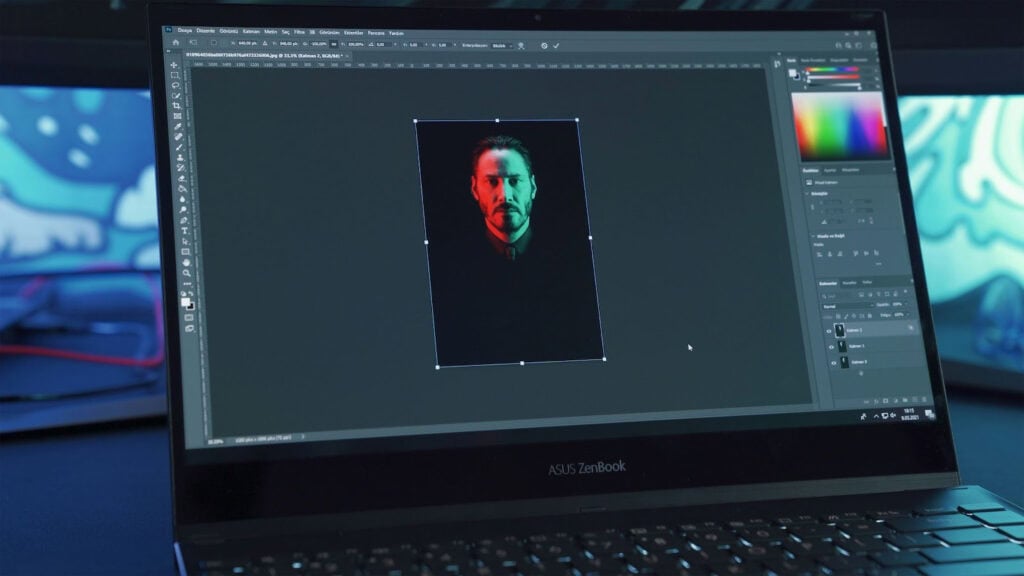

Was als kreatives Experiment mit Porträts im Stil von Studio Ghibli begann, entwickelte sich schnell zu etwas Bedenklichem. Nutzer begannen, fotorealistische Attrappen von staatlichen Ausweisen zu teilen, komplett mit QR-Codes, offizieller Formatierung und gefälschten persönlichen Daten, die beunruhigend echt aussahen.

Die Technologie hinter der Bedrohung: Warum GPT-4o anders ist

Eine neue Klasse der KI-Bilderzeugung

Anders als DALL-E ist GPT-4o direkt in ChatGPT integriert. Diese Verschiebung verleiht ihm neue Fähigkeiten, schafft aber auch neue Risiken.

Wie OpenAI in seiner offiziellen Systemdokumentation einräumt: "Diese Fähigkeiten, einzeln und in neuen Kombinationen, haben das Potenzial, in einer Reihe von Bereichen Risiken zu schaffen, und zwar auf eine Art und Weise, wie es frühere Modelle nicht konnten.

Das Problem der Zugänglichkeit

Die Demokratisierung der Bilderzeugungstechnologie hat das geschaffen, was Experten den "perfekten Sturm" für Identitätsbetrug nennen.

Erstens sind keine technischen Kenntnisse erforderlich. Jeder kann gefälschte Dokumente erstellen, indem er einfach eine Anfrage in natürlicher Sprache eintippt. Die Ergebnisse sind fotorealistisch und entsprechen genau den offiziellen Layouts, Schriftarten und Designs.

In nur wenigen Minuten können gefälschte Ausweise im großen Stil hergestellt werden. Und da die Technologie über die Identifikationssysteme verschiedener Länder hinweg funktioniert, ist die Bedrohung global.

Bedenken bezüglich der Trainingsdaten

Am beunruhigendsten ist die Frage der Datenquellen. Die Nutzer haben sich gefragt, woher GPT-4o die Trainingsdaten hat, um Regierungsdokumente so genau zu replizieren. Die Nutzer fragen sich, woher das Modell die Aadhaar-Fotodaten für das Training hat und wie es das Format so genau lernen konnte.

Das Ausmaß des KI-Bilderbetrugs: Eine wachsende Krise

Aktuelle Statistiken zeichnen ein düsteres Bild

Der durch KI generierte Betrug stellt eine der am schnellsten wachsenden Bedrohungen im Bereich der Cybersicherheit dar:

- Die weltweite Betrugsrate stieg von 1,10% im Jahr 2021 auf 2,50% im Jahr 2024ein Anstieg um 127% in nur drei Jahren

- 50% aller Betrugsversuche entfallen auf gefälschte oder geänderte Dokumente im Jahr 2024, laut dem Identitätsbetrugsbericht von Sumsub

- Digitale Fälschungen mit generativer KI machen inzwischen 57% des gesamten Dokumentenbetrugs ausein Anstieg von 244% gegenüber dem Vorjahr

- Deepfake-bedingter Identitätsbetrug verzehnfacht sich bis 2023 im Vergleich zum Vorjahr

Finanzielle Auswirkungen über alle Branchen hinweg

Die wirtschaftlichen Folgen sind bereits schwerwiegend und werden immer gravierender:

- KI-gestützter Betrug könnte im Jahr 2025 weltweit $10,5 Billionen kostenlaut LexisNexis

- Synthetischer Identitätsbetrug um 31% angestiegen da Betrüger zunehmend KI ausnutzen

- Die Hälfte aller befragten Unternehmen hat Betrug mit KI-generierten Inhalten erlebt im Jahr 2024

- Weltweite Verluste durch digitalen Betrug erreichen über $47,8 Milliarden im Jahr 2024, was einem Anstieg von 15% entspricht

Der blinde Fleck der Führungskräfte: Warum Führungskräfte unvorbereitet sind

Die Bewusstseinslücke

Auch wenn die Bedrohung zugenommen hat, sind sich die meisten Führungskräfte dessen noch kaum bewusst:

- 76% der Umfrageteilnehmer sahen eine Zunahme der regulatorischen Anforderungen Forderung nach stärkerer ID-Überprüfung

- 51% der Betrugsfälle entfallen inzwischen auf digitale Kanäleund übertrifft damit zum ersten Mal die physischen Kanäle

- Nur 43% der Finanzunternehmen verwenden fortschrittliche Überprüfungsmethoden wenn Betrugsmerkmale auftauchen

- Den meisten Unternehmen fehlen umfassende Strategien zur Erkennung von KI-Betrug

Das Ausbildungsdefizit

Die Kluft zwischen den neuen Bedrohungen und der Bereitschaft der Unternehmen hat sich vergrößert. Die meisten Sicherheitsschulungen decken immer noch nicht die durch KI erzeugten Betrügereien ab, so dass die Mitarbeiter nicht vorbereitet sind. Das Wissen über Deepfakes und KI-Bilder ist noch immer nicht weit verbreitet, und die Überprüfungsverfahren wurden noch nicht an die KI-generierte Dokumentation angepasst. Und schließlich sind die Erkennungsmöglichkeiten im Vergleich zur Generationstechnologie noch unzureichend.

Auswirkungen auf die Industrie: Sektoren unter Beschuss

Anfälligste Industrien

Auf der Grundlage der Betrugsstatistiken für das Jahr 2024 sind folgende Sektoren am stärksten gefährdet:

- Dating-Plattformen (8,9% Betrugsrate): Romantik-Betrug mit gefälschten Profilen und KI-generierten Dokumenten

- Online-Medien (4,27% Betrugsrate): Umgehung der Kontoüberprüfung mit synthetischen Dokumenten

- Banken und Versicherungen (3,14% Betrugsrate): Kontoeröffnung und Kreditbetrug

- Kryptowährung (88% der Deepfake-Fälle): Umgehung der KYC durch KI-generierte Identitäten

Das technologische Wettrüsten: Erkennung vs. Erzeugung

Aktuelle Erkennungsfähigkeiten

Unternehmen, die stark in KI-gestützte Tools zur Bekämpfung von KI-gestütztem Betrug investiert haben, können erste Erfolge verzeichnen: KI-gesteuerte Betrugserkennungssysteme haben Unternehmen bereits geholfen, Betrugsfälle um etwa 30% zu reduzieren.

Auch andere Technologien werden derzeit erforscht. Blockchain kann für mehr Datensicherheit sorgen, muss sich aber noch weiter verbreiten, um effektiv zu sein.

Die biometrische Überprüfung in Verbindung mit der Dokumentenanalyse schafft eine zuverlässigere Form der Authentifizierung.

Schließlich entwickelt sich die Echtzeit-Erkennung zu einem wirksamen Schutz. Sie bestätigt, dass eine Person wirklich anwesend ist, und hindert Kriminelle daran, bei der Überprüfung gefälschte statische Bilder zu verwenden.

Die Kluft zwischen den Ansprüchen

Es besteht jedoch eine besorgniserregende Diskrepanz zwischen der Entdeckungssicherheit und der tatsächlichen Prävention:

- Der Prozentsatz der Befragten, die darauf vertrauen, dass Technologieunternehmen biometrische Daten sicher aufbewahren, sank von 29% im Jahr 2022 auf 5% im Jahr 2024

- Viele Unternehmen überschätzen ihre Aufdeckungsmöglichkeiten und dabei die Komplexität der Bedrohung unterschätzt

- Herkömmliche Sicherheitsmaßnahmen erweisen sich als unzureichend gegen KI-generierte Dokumente

- Die Entwicklung der Detektionstechnologie hinkt den Fortschritten der Generation hinterher

Regulatorische Antwort: Die rechtliche Landschaft

Derzeitiger Rechtsrahmen

Regierungen auf der ganzen Welt bemühen sich, den durch KI generierten Dokumentenbetrug zu bekämpfen, was nur langsam gelingt:

- Die eIDAS-Verordnung der EU tritt im Mai 2024 in Kraft und erfordert eine stärkere Überprüfung der digitalen Identität

- Mehrere Länder haben ihre Schutzmaßnahmen verstärkt rund um Gesundheitsdaten und Identitätsüberprüfung

- Neue Vorschriften schreiben Transparenz vor in KI-gesteuerten Identitätsprüfungsverfahren

- Strafrechtliche Sanktionen für die betrügerische Verwendung von KI-generierten Dokumenten existieren

Aufbau der Verteidigung der Exekutive: Eine umfassende Schutzstrategie

1. Unmittelbare Risikobewertung

Audit der aktuellen Verifizierungsprozesse: Überprüfen Sie, wie Ihr Unternehmen derzeit Identitätsdokumente validiert, und ermitteln Sie Schwachstellen bei AI-Betrug.

Identifizieren Sie risikoreiche Touchpoints: Abbildung aller Punkte, an denen Identitätsdokumente akzeptiert werden, Onboarding, Kontenwiederherstellung, Transaktionen mit hohem Wert und Überprüfung der Einhaltung von Vorschriften.

Bewertung der Aufdeckungsfähigkeiten: Bewertung, ob die derzeitigen Systeme KI-generierte Dokumente erkennen können oder ob Upgrades erforderlich sind.

2. Technologie-Lösungen

Erweiterte Bildanalyse: Einsatz von KI-gestützten Erkennungssystemen, die subtile Unstimmigkeiten in KI-generierten Dokumenten identifizieren können:

- Textur-Analyse: Unnatürliche Muster in Dokumentenhintergründen und Sicherheitsmerkmalen erkennen

- Überprüfung der Konsistenz: Überprüfung der Ausrichtung von Schriftarten, Abständen und der offiziellen Formatierung

- Prüfung der Metadaten: Analysieren Sie die Daten zur Bilderstellung auf Anzeichen von KI

- Verifizierung in Echtzeit: Implementierung von Systemen, die Dokumente während des Kundenkontakts sofort verarbeiten können

Multi-Faktor-Verifizierung: Kombinieren Sie die Dokumentenanalyse mit zusätzlichen Prüfmethoden:

- Überprüfung von Regierungsdatenbanken: Abgleich der Dokumentennummern mit offiziellen Datenbanken

- Biometrischer Abgleich: Verwenden Sie die Gesichtserkennung, um Dokumentenfotos mit lebenden Personen abzugleichen

- Verhaltensanalyse: Überwachen Sie das Benutzerverhalten während der Verifizierungsprozesse

3. Schulung und Sensibilisierung

Ausbildung von Führungskräften: Die Führungsteams benötigen spezielle Schulungen zu den Risiken von KI-Bilderbetrug und den geschäftlichen Auswirkungen einer unzureichenden Überprüfung.

Schulungsprogramme für Mitarbeiter: Das Personal an der Front muss in folgenden Bereichen geschult werden:

- Visuelle Erkennungstechniken: Wie man potenzielle KI-generierte Dokumente erkennt

- Überprüfungsverfahren: Wann und wie verdächtige Dokumente eskaliert werden sollten

- Technologie-Integration: Wie man Detektionswerkzeuge effektiv einsetzt

Laufende Aktualisierungen: Regelmäßige Trainings-Updates im Zuge der Weiterentwicklung der KI-Generierungstechniken.

4. Prozess-Neugestaltung

Überprüfungsprotokolle: Implementierung einer mehrstufigen Überprüfung für Hochrisikoszenarien:

- Überprüfung von Primärdokumenten: Erste Bewertung mittels Detektionstechnologie

- Sekundäre Verifizierung: Datenbank-Querverweis für die Authentizität von Dokumenten

- Tertiär-Bestätigung: Zusätzliche Überprüfung bei besonders wertvollen oder verdächtigen Fällen

Behandlung von Ausnahmen: Klare Verfahren für den Umgang mit Dokumenten, die nicht überprüft werden können oder Anzeichen von künstlicher Intelligenz aufweisen.

Die Lösung: KI-Bilderkennung in Unternehmensqualität

Warum traditionelle Ansätze scheitern

Standard-Dokumentenprüfungen wurden entwickelt, um Fälschungen alten Stils zu erkennen, nicht aber KI-generierte Dokumente. Die moderne KI-Bilderzeugung benötigt ebenso anspruchsvolle Erkennungsfunktionen.

Zu den derzeitigen Überprüfungslücken gehören:

- Menschliches Versagen: Manuelle Prüfer können anspruchsvolle KI-generierte Dokumente nicht zuverlässig erkennen

- Begrenzte technische Analyse: Die Basisüberprüfung konzentriert sich auf offensichtliche Veränderungen und übersieht subtile AI-Indikatoren

- Einschränkungen der Skala: Manuelle Prozesse können das Volumen der KI-generierten Betrugsversuche nicht bewältigen

- Entwicklungsverzögerung: Statische Prüfverfahren können sich nicht an die sich schnell entwickelnden KI-Techniken anpassen

Der Bedarf an spezialisierter KI-Detektion

Unternehmen, die sich ernsthaft gegen KI-Image-Betrug schützen wollen, brauchen speziell entwickelte Erkennungssysteme, die das können:

- Analysieren Sie AI-Generationenmarker: Erkennen von subtilen Artefakten und Mustern, die nur in KI-generierten Bildern vorkommen

- Verarbeitung in Echtzeit: Sofortige Analyse bei der Einreichung von Dokumenten

- Kontinuierliches Lernen: Anpassung an neue Techniken der KI-Generierung, sobald diese auftauchen

- Fähigkeiten zur Integration: Nahtlose Integration in bestehende Prüfabläufe

Wirksame KI-Bilderkennungssysteme verwenden fortschrittliche Algorithmen zur Identifizierung:

- Unstimmigkeiten auf Pixel-Ebene: Subtile Muster, die auf eine AI-Generation hinweisen

- Artefakte der Kompression: Digitale Signaturen von AI-Bilderstellungsprozessen

- Statistische Anomalien: Mathematische Muster, die sich von natürlichen Bildern unterscheiden

- Zeitliche Ungereimtheiten: Anzeichen für eine Bildmanipulation oder -erzeugung

Die Quintessenz: KI-Bildbetrug ist da und beschleunigt sich

Die Statistiken sind unbestreitbar: KI-generierter Dokumentenbetrug hat sich von einer theoretischen Bedrohung zu einer aktuellen Realität entwickelt, die Verluste in Milliardenhöhe verursacht.

Mit mehr als 700 Millionen Bildern, die allein von GPT-4o generiert wurden, und den schnell fortschreitenden KI-Fähigkeiten sehen sich Unternehmen einer wachsenden Bedrohung gegenüber, der herkömmliche Sicherheitsmaßnahmen nicht gewachsen sind.

Das Zeitfenster für eine proaktive Verteidigung schließt sich rasch.

Die Technologie zur Erstellung überzeugender gefälschter Dokumente ist heute für jeden mit Internetzugang zugänglich. Gleichzeitig werden die von der KI generierten Dokumente immer ausgefeilter, so dass die Erkennung für menschliche Prüfer und einfache Überprüfungssysteme immer schwieriger wird.

Unternehmen, die sich weigern, ihre Überprüfungsprozesse an diese neue Realität anzupassen, sind vielen Risiken ausgesetzt:

- Direkte finanzielle Verluste: Vor Betrug mit KI-generierten Dokumenten

- Ordnungsrechtliche Sanktionen: Wegen Nichterfüllung der erweiterten Überprüfungsanforderungen

- Reputationsschaden: Von der Verbindung mit Vorfällen von Identitätsbetrug

- Betriebliche Unterbrechung: Von Untersuchungen und Sanierungsmaßnahmen

Die Frage ist nicht, ob Ihr Unternehmen mit KI-generiertem Dokumentenbetrug konfrontiert wird, sondern ob Sie darauf vorbereitet sind, ihn zu erkennen und zu verhindern.

Die Technologie ist vorhanden, um sich gegen KI-generierten Betrug zu wehren. Fortschrittliche Erkennungssysteme können die subtilen Merkmale identifizieren, die KI-generierte Dokumente von echten unterscheiden. Die Umsetzung erfordert jedoch sofortiges Handeln, da sich die Bedrohung täglich weiterentwickelt.

Unternehmen müssen jetzt in umfassende KI-Bilderkennungsfunktionen investieren oder riskieren, ein weiteres Opfer in der am schnellsten wachsenden Betrugskategorie unserer Zeit zu werden.

Für Führungskräfte, die ihr Unternehmen vor KI-Bilderbetrug schützen möchten, steht heute eine fortschrittliche Erkennungstechnologie zur Verfügung. Erfahren Sie, wie KI-Bilderkennung auf Unternehmensebene Ihre Verifizierungsprozesse schützen kann unter truthscan.com/ai-bild-detektor.

Referenzen

- Ausblick Geld. "ChatGPT kann gefälschte Aadhaar- und PAN-Karten erzeugen: Here's What You Need to Know." Ausblick Geld5. April 2025. https://www.outlookmoney.com/news/chatgpt-can-generate-fake-aadhaar-pan-cards-heres-what-you-need-to-know

- Business Today. "Gefälschter Aadhaar, PAN mit ChatGPT: Wie man echte staatliche Ausweise erkennt; Schritte prüfen". Business Today5. April 2025. https://www.businesstoday.in/personal-finance/news/story/fake-aadhaar-pan-with-chatgpt-how-to-identify-real-government-id-proofs-check-steps-470849-2025-04-05

- Business Standard. "ChatGPT kann gefälschte Aadhaar- und PAN-Karten erstellen: Wie man sie verifiziert". Business Standard7. April 2025. https://www.business-standard.com/finance/personal-finance/chatgpt-can-generate-fake-aadhaar-pan-cards-how-to-verify-them-125040700728_1.html

- OneIndia Nachrichten. "Kann ChatGPT Aadhaar-Karten und PAN-Karten erstellen? Netizens bombardieren soziale Medien mit gefälschten ID-Karten". OneIndia Nachrichten4. April 2025. https://www.oneindia.com/india/can-chatgpt-create-aadhaar-cards-pan-cards-netizens-bombard-social-media-with-fake-id-cards-4114335.html

- Business Today Technologie. "Gefälschte Aadhaar-Karten lösen Besorgnis aus, da ChatGPTs Image-Tool 700 Millionen Kreationen erreicht". Business Today4. April 2025. https://www.businesstoday.in/technology/news/story/fake-aadhaar-cards-spark-concern-as-chatgpts-image-tool-hits-700-million-creations-470750-2025-04-04

- MoneyLife. "Betrugswarnung: KI erstellt echt aussehende 'gefälschte' Aadhaar- und PAN-Karten!" MoneyLife. https://www.moneylife.in/article/fraud-alert-ais-creating-genuinelooking-fake-aadhaar-pan-cards/76873.html

- Markt für Dateneinblicke. "ChatGPT weckt Befürchtungen über ID-Betrug: Can It Really Generate Fake Aadhaar & PAN Cards?" Markt für Dateneinblicke. https://www.datainsightsmarket.com/news/article/chatgpt-can-generate-fake-aadhaar-pan-cards-13557

- Engel Eins. "ChatGPT kann gefälschte Aadhaar- und PAN-Karten generieren: How to Verify Them." Engel Eins8. April 2025. https://www.angelone.in/news/chatgpt-can-generate-fake-aadhaar-and-pan-cards-how-to-verify-them

- Biometrisches Update. "Die Gesellschaft brummt mit ChatGPT-generierten Pässen und ID-Karten". Biometrisches Update11. April 2025. https://www.biometricupdate.com/202504/social-buzzes-with-chatgpt-generated-passports-and-id-cards

- Munsif Daily. "ChatGPT's Image Tool Used to Generate Aadhaar and PAN Cards, Privacy and Misuse Concerns Mount". Munsif Daily4. April 2025. https://munsifdaily.com/chatgpts-image-tool-used-to-generate-aadhaar-and-pan-cards/

- Schnappt. "ID Verification Trends for 2025 & The Future Outlook". Schnappt4. August 2025. https://snappt.com/blog/id-verification-trends/

- Schnappt. "Identitätsbetrugsstatistik für 2025". Schnappt20. November 2024. https://snappt.com/blog/identity-fraud-statistics/

- Sumsub. "Betrugstrends für 2025: From AI-Driven Scams to Identity Theft and Fraud Democratization". Sumsub. https://sumsub.com/blog/fraud-trends-sumsub-fraud-report/

- Sumsub. "2024 Statistik über Identitätsdiebstahl und Betrug". Sumsub. https://sumsub.com/fraud-report-2024/

- arXiv. "AI-based Identity Fraud Detection: A Systematic Review". arXiv16. Januar 2025. https://arxiv.org/html/2501.09239v1

- Anvertrauen. "Trends bei der Identitätsüberprüfung im Jahr 2025 und darüber hinaus". Anvertrauen5. August 2025. https://www.entrust.com/blog/2025/02/identity-verification-trends-in-2025-and-beyond

- Incode. "Top 5 Cases of AI Deepfake Fraud From 2024 Exposed". Incode Blog20. Dezember 2024. https://incode.com/blog/top-5-cases-of-ai-deepfake-fraud-from-2024-exposed/

- Mitek-Systeme. "Betrugsprognosen 2025: Einblicke in aufkommende Betrugsbedrohungen". Mitek-Systeme12. Dezember 2024. https://www.miteksystems.com/blog/2025-fraud-predictions-industry-innovators

- KYC-Drehscheibe. "Die 7 wichtigsten Trends zur Identitätsüberprüfung für 2025". KYC-Drehscheibe30. Dezember 2024. https://www.kychub.com/blog/identity-verification-trends/