Вступ

Генеративний ШІ революціонізує охорону здоров'я - і не завжди на краще. У 2025 році схеми шахрайства у сфері охорони здоров'я зросли більш цифровим і складним, що підживлюється витоками даних, автоматизацією та генеративним ШІ[1]. Злочинці використовують інструменти штучного інтелекту для створення фальшиві особистості пацієнтів, синтетичні страхові вимоги, медичні документи, створені штучним інтелектом, підроблені рецепти і навіть глибоко фальсифіковані взаємодії між лікарем і пацієнтом. Ці високотехнологічні обмани виводять шахрайство на нові висоти, загрожуючи фінансам страховиків і безпеці пацієнтів у всьому світі. Виклик величезний: шахрайство в сфері охорони здоров'я вже коштує десятки мільярдів доларів щорічно, а розвиток штучного інтелекту посилення як масштабу, так і складності шахрайства[2][3]. У цьому документі детально розглядаються останні тенденції шахрайства з використанням штучного інтелекту у сфері охорони здоров'я, реальні кейси з 2025 року, а також стратегії - від детекторів контенту до перевірки особи - для боротьби з цією загрозою, що еволюціонує.

Зростання кількості шахрайських схем з використанням штучного інтелекту в охороні здоров'я

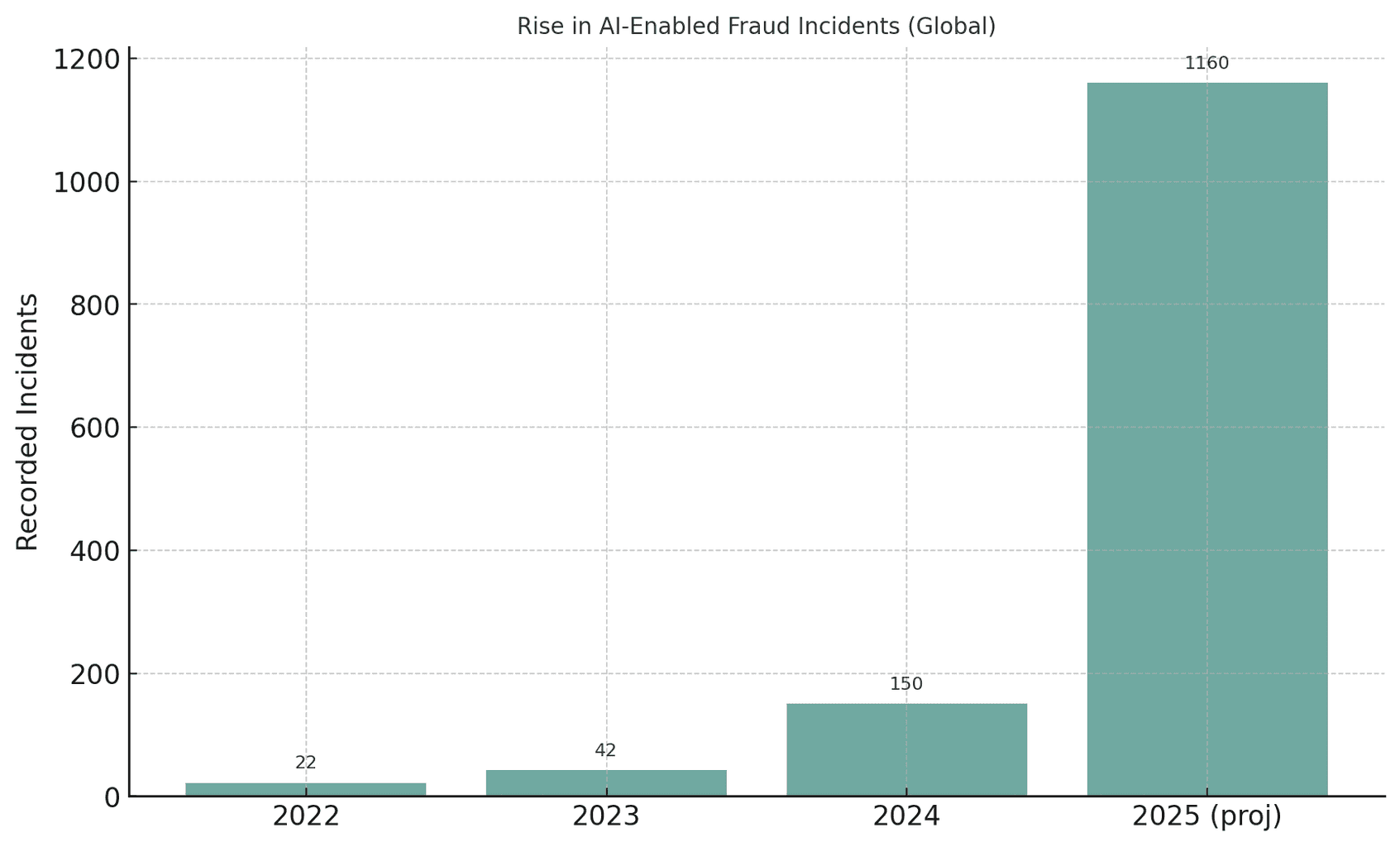

Світовий сектор охорони здоров'я переживає безпрецедентний сплеск спроб шахрайства з використанням штучного інтелекту. Коли генеративний ШІ стає доступним, шахраї можуть автоматизувати те, що раніше відбувалося вручну, створюючи переконливі фальшиві ідентичності, документи і навіть голоси або відео у великих масштабах. Наприклад, органи влади відзначають, що спроб шахрайства з використанням глибоко фейкових медіа зросла на 3,000% у 2023 році наодинці.[4][5]. Кількість інцидентів, пов'язаних із глибокими фейками, майже подвоїлася з 22 у 2022 році до 42 у 2023 році, а потім зросла до 150 інцидентів у 2024 році; вражає те, що в першому кварталі 2025 року було зафіксовано 179 випадків шахрайства з глибокими фейками, що вже перевищило загальну кількість випадків за 2024 рік.[6][7]. Ця тенденція свідчить про те, що стрімке зростання шахрайства, керованого штучним інтелектомАналітики прогнозують, що генеративний ШІ може зменшити втрати від шахрайства від $12,3 млрд у 2023 році до $40 млрд до 2027 року (32% CAGR)[8].

Малюнок: Вибухове зростання кількості випадків шахрайства з використанням ШІ за останні роки. Виявлені випадки глибокого шахрайства або шахрайства за допомогою штучного інтелекту різко зросли з 2022 по 2025 рік, що ілюструє, як інструменти штучного інтелекту прискорюють спроби шахрайства.[4][7].

Більше ніколи не турбуйтеся про шахрайство зі штучним інтелектом. TruthScan Може допомогти тобі:

- Виявлення згенерованого ШІ зображення, текст, голос і відео.

- Уникайте велике шахрайство, кероване штучним інтелектом.

- Захистіть своє найдорожче чутливий активи підприємства.

Охорона здоров'я особливо вразлива до цієї хвилі злочинів, що підживлюється штучним інтелектом. Величезна, фрагментована екосистема сектору, що охоплює лікарні, клініки, страхові компанії, аптеки та платформи телемедицини, пропонує тисячі точок для атак.[9][10]. Традиційні шахрайства (наприклад, підроблені страхові картки або викрадені ідентифікаційні дані пацієнтів) мають переросла в системну експлуатацію за допомогою штучного інтелекту[10][11]. У 2025 році Міністерство юстиції США висунуло звинувачення 324 обвинуваченим у схемах на загальну суму $14.6 млрд у фальшивих заявах - найбільший випадок шахрайства у сфері охорони здоров'я за всю історію[12][13]. Багато шахрайств були пов'язані з телемедичними консультаціями та шахрайством з генетичним тестуванням, а нове міністерство юстиції Центр злиття даних про шахрайство у сфері охорони здоров'я використовували AI-аналітику для проактивного виявлення закономірностей[14][15]. Очевидно, що ШІ - це палиця з двома кінцями: він допомагає слідчим ловити шахраїв, але також надання злочинцям можливості здійснювати шахрайство в безпрецедентних масштабах і з безпрецедентною витонченістю[11][2].

Поширені методи шахрайства на основі ШІ в охороні здоров'я (2025)

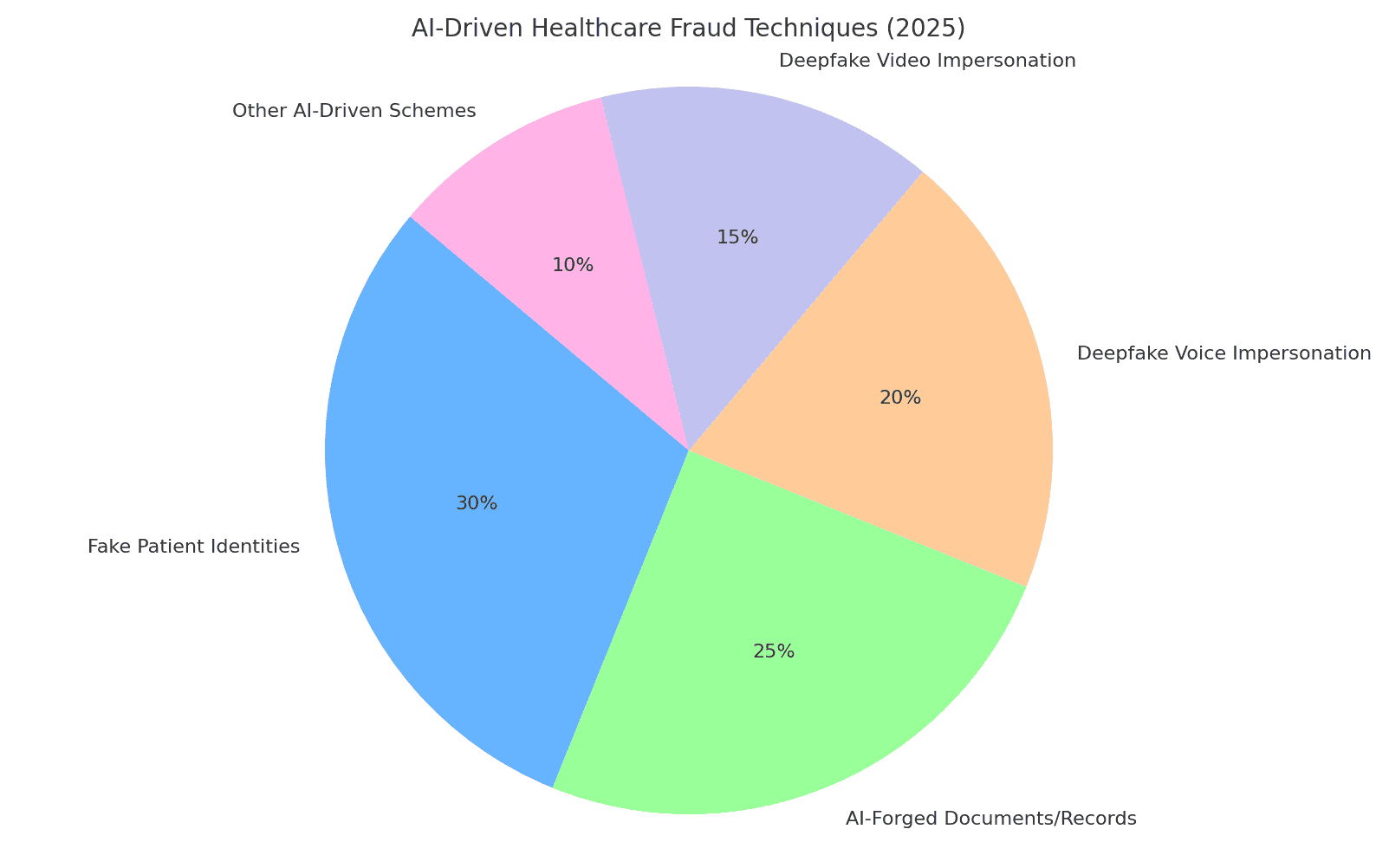

У 2025 році шахраї матимуть у своєму арсеналі цілу низку тактик з використанням штучного інтелекту для обману систем охорони здоров'я та страховиків. Основні схеми включають підробку особистих даних і документів, створення фальшивих медичних даних і видавання себе за довірених осіб за допомогою глибоких підробок. Нижче ми розглянемо найпоширеніші методи шахрайства з використанням АІ та способи їх застосування проти медичних організацій:

Малюнок: Розподіл основних методів шахрайства у сфері охорони здоров'я на основі штучного інтелекту у 2025 році. Фальшиві ідентифікаційні дані пацієнтів і Підроблені штучним інтелектом документи (наприклад, медичні записи, претензії) складають значну частку схем, тоді як глибоко підроблені голос і відеопародії є швидкозростаючою загрозою. "Інші схеми, керовані ШІ", включають створені ШІ фішингові електронні листи, боти, що атакують портали пацієнтів, і подібні експлойти (оціночні відсотки на основі галузевих звітів).[8][16]).

Синтетичні ідентичності пацієнтів

Фальшиві ідентифікаційні дані пацієнтів - часто створені за допомогою штучного інтелекту - це основна тактика шахрайства. Замість того, щоб красти особистість однієї людини, злочинці об'єднують реальні дані кількох людей зі сфабрикованими деталями, щоб створити синтетичні ідентичності які видають себе за нових пацієнтів.[17][18]. Генеративний ШІ прискорює цей процес, створюючи реалістичні особисті записи. Наприклад, ШІ може генерувати правдоподібні Посвідчення особи, профілі, навіть сімейні історії ("синтетичні батьки") для фальшивого пацієнта[19][20]. Ці фантомні пацієнти потім використовуються для відкривати рахунки, отримувати страхові поліси або виставляти рахунки за послуги які ніколи не відбувалися. Під час пандемії COVID-19 шахраї використовували синтетичні посвідчення особи для отримання екстреної медичної допомоги; зараз вони використовують їх для подавати фальшиві страхові заяви або отримувати рецептизнаючи, що добре продумана особистість може уникнути виявлення[21][22]. За даними Федеральної резервної системи США, збитки від шахрайства з синтетичними ідентифікаційними даними перевищили $35 мільярдів у 2023 році і продовжують зростати[23]. Вплив на охорону здоров'я є серйозним: шахраї можуть використовувати викрадений номер соціального страхування дитини, щоб створити фальшивого пацієнта з ідеальною кредитною історією, або змішати викрадені дані пацієнта, щоб обійти перевірку страховика.[17][24]. Кожен синтетичний пацієнт, введений в систему підриває цілісність даних і може призвести до неправомірних виплат або навіть клінічні помилки, якщо фейкова особистість переплітається зі справжніми медичними записами.

Медичні документи та страхові відшкодування, створені за допомогою штучного інтелекту

Генеративний ШІ зараз використовується для підробки медичні документи, записи та цілі страхові випадки. Мовні моделі можуть створювати автентичні на вигляд лікарські довідки, виписки, результати лабораторних аналізів або рахунки, наповнені медичним жаргоном, - все це для того, щоб підтримати шахрайську заяву. Насправді, галузеві оглядачі повідомляють, що 89% Зростання кількості медичних документів, згенерованих ШІ що подаються, порівняно з попередніми роками[25][26]. Шахраї використовують ці фальшиві записи, щоб виправдати дорогі процедури або ліки, які ніколи не надавалися, або завищити коди відшкодування. Наприклад, штучний інтелект може згенерувати фальшивий звіт про діагностичну візуалізацію або результат лабораторних досліджень для обґрунтування високовартісних претензій на ліки від онкології. Страховики та системи охорони здоров'я стикаються з потоком таких синтетичні документищо ускладнює розрізнення законних претензій від фейків. У Великій Британії страховики відзначають стрімке зростання використання глибоких підробок та підроблених документів у шахрайстві з виплатами страхових відшкодуваньчасто у, здавалося б, рутинних позовах з низькою вартістю, щоб уникнути ретельної перевірки[27]. Навіть клінічні зображення не захищені - існують докази того, що шахраї використовують генеративний ШІ для імітації медичних зображень як рентгенівські промені або сканування[3]. Наслідки виходять за рамки фінансових втрат: якщо фальсифіковані медичні документи потрапляють в історії хвороби, вони можуть призвести до помилкових діагнозів або неправильного лікування. Таким чином, Медичні документи, написані штучним інтелектом, становлять серйозний ризик для цілісності та безпеки.

Підроблені рецепти та шахрайство в аптеках

Шахрайство з рецептами увійшло в цифрову епоху завдяки штучному інтелекту. Підроблені рецепти - Традиційно це робилося за допомогою вкрадених бланків рецептів або елементарного редагування - тепер можна автоматично генерувати з реалістичними деталями та підписами лікарів. Генератори зображень або шаблони зі штучним інтелектом спрощують створення автентичні роздруківки електронних рецептів або аптечні бланки замовлень. Більш підступно злочинці використовують клонування голосу видавати себе за лікарів у розмовах з фармацевтами. В одному з випадків шахраї зламували медичні записи, щоб викрасти реєстраційні номери лікарів у DEA, а потім використовували ці дані для надсилання електронних рецептів на контрольовані речовини.[28]. Були випадки, коли Підробки голосу ШІ використовуються для авторизації поповнення рахунку - фармацевт отримує дзвінок, який звучить точно так само, як голос відомого лікаря, що підтверджує рецепт, але насправді це голос, згенерований штучним інтелектом. Як наслідок, підконтрольні препарати (наприклад, опіоїди або стимулятори) можуть бути отримані незаконним шляхом і потрапити в нелегальний обіг. Шахрайство з підробленими рецептами не лише завдає фінансових збитків страховикам та аптекам, але й ставить під загрозу пацієнтів, які можуть отримати неправильні ліки, записані в їхніх картках. Наприклад, якщо шахрай видає себе за пацієнта, щоб отримати опіоїдні рецепти, то в медичну карту реального пацієнта можуть бути внесені препарати, які він ніколи не приймав, що може призвести до небезпечних взаємодій або позначити його як такого, що шукає наркотики[29]. Таке поєднання кіберзлочинності та експлуатації ШІ викликало застереження з боку регуляторів. Тепер медичні організації повинні перевіряти, що кожен рецепт - особливо на ліки з високим ризиком - є законним і дійсно від авторизованого постачальникаа не глибокий фейк чи витік даних.

Фальшиві імітації лікарів та пацієнтів

Мабуть, найбільш помітною розробкою, що привертає увагу, є використання глибокі фейки, що видають себе за медичний персонал або пацієнтів. У сфері телемедицини та обслуговування клієнтів шахраї використовують відео- та аудіоматеріали, створені штучним інтелектом, щоб обдурити людей на іншому кінці дроту. Наприклад, злочинці створили глибоко підроблені відео пацієнтів для телемедичних консультацій, обманом змушуючи лікарів надавати "лікування" або направлення, які потім виставляються до страхової компанії[30][31]. І навпаки, шахрай може глибоко підробити подобу лікаря - використовуючи обличчя та голос авторитетного лікаря - у відеодзвінку до переконують пацієнта заплатити за шахрайську послугу або розголосити особисту інформацію. ІТ-експерти в галузі охорони здоров'я попереджають, що телемедицина стала зрілою мішеннюможна записатися на віртуальний прийом, використовуючи фальшиву ідентифікацію пацієнта, а потім попросити аватар ШІ записатися на відео, щоб отримати рецепти або медичну консультацію під фальшивим приводом[31][32]. Окрім телемедицини, глибокі фейки насичують соціальні мережі у вигляді "лікарські" відео, що рекламують чудодійні ліки. У 2024 році експерти помітили, що глибоко підроблені відео відомих лікарів "справді злетіла.націлені на старшу аудиторію з фальшивими порадами щодо здоров'я та шахрайськими продуктами[33][34]. Довірені телевізійні лікарі у Великій Британії та Франції клонували свою подобу, щоб схвалити фальшиві ліки від діабету та препарати для зниження артеріального тиску.[35][36]. До половини глядачів не змогли відрізнити ці глибоко фальшиві медичні відео від справжніх[37]. Ця ерозія правди має відчутні наслідки: пацієнти можуть слідувати шкідливим порадам з фальшивого відео з лікарем, або шахраї можуть виставляти страховикам рахунки за консультації, яких ніколи не було, окрім як на підробленому записі. Загалом, Штучний інтелект підриває фундаментальну довіру до взаємодії у сфері охорони здоров'я - Якщо ви не можете довіряти тому, що людина на екрані або в телефоні є тією, за кого себе видає, вся система під загрозою.

Вплив і масштаби: шахрайство у 2025 році в цифрах

Шахрайство, кероване штучним інтелектом, більше не є маргінальною проблемою - тепер це серйозний фінансовий відтік і загроза безпеці глобальних систем охорони здоров'я. Розглянемо наступні нещодавні статистичні дані та кейси, що ілюструють масштаб проблеми:

- Щорічні втрати: Шахрайство у сфері охорони здоров'я коштує США приблизно $68 мільярдів або більше щороку[25]приблизно 3-10% всіх витрат на охорону здоров'я[38]. У глобальному масштабі шахрайство може поглинути близько 6% витрат на охорону здоров'я[39] - приголомшлива цифра, враховуючи, що світові витрати на охорону здоров'я сягають трильйонів доларів. Ці втрати в кінцевому підсумку призводять до підвищення страхових внесків, збільшення витрат на лікарні та скорочення ресурсів на лікування пацієнтів.

- Сплеск шахрайства у 2023-2025 роках: Поява генеративного ШІ призвела до вибуху спроб шахрайства. Почастішали випадки шахрайства, пов'язані з глибокими підробками вдесятеро з 2022 по 2023 рік[4]. У 2024 році кількість повідомлень про глибокі фейкові інциденти підскочила до 150 (зростання на 257%)[40]а 2025 рік може значно перевершити цей показник (580 інцидентів лише за першу половину 2025 року, що майже в 4 рази більше, ніж за весь 2024 рік).[7]. Експерти з питань шахрайства зазначають, що 46% зіткнулися з підробкою синтетичних ідентифікаторів, 37% - з голосовими підробками, а 29% - з підробками відео у своїх розслідуваннях[8] - підкреслюючи, наскільки поширеними стали ці методи ШІ.

- Рекордні вилучення: Правоохоронні органи реагують на це посиленням репресій. У червні 2025 року Міністерство юстиції США оголосило найбільше в історії викриття шахрайства у сфері охорони здоров'явисунувши звинувачення 324 особам та викривши $14.6 млрд у шахрайських заявах[1][13]. Схеми включали шахрайство з телемедичними консультаціями, шахрайство з генетичними тестами та шахрайство з медичним обладнанням тривалого користування в масовому масштабі[13]. В рамках цих зусиль Medicare призупинив виплату $4 мільярдів на очікувані виплати вважаються підозрілими[41]запобігаючи цим втратам. Одна з наріжних справ ("Операція "Золота лихоманка") викрила міжнародне угруповання, яке використовувало викрадені особисті дані для подачі $10,6 мільярдів неправдивих заяв на медичні товари[42] - свідчення того, як далеко можуть зайти злочинці, озброєні зламаними даними та автоматизацією.

- Вплив страховика: Страховики в усьому світі спостерігають сплеск шахрайства, пов'язаного зі штучним інтелектом. У Великій Британії страховики повідомляють про дедалі частіше використання глибоких підробок у заявках на виплату страхових відшкодувань (часто це "легкі" заявки, щоб уникнути виявлення).[27]. Провідна перестрахувальна компанія попереджає, що фальсифіковані медичні записи та глибоко підроблені захворювання підривають андеррайтинг і можуть призвести до збільшення збитків у страхуванні життя та здоров'я[43]. Аналіз компанії Deloitte, проведений у 2024 році, прогнозує, що до 2027 року це станеться, генеративне шахрайство з використанням штучного інтелекту може становити 1 трлн 7 трлн 40 млрд доларів щорічних збитків у США. (порівняно з $12,3 млрд у 2023 році)[8]. Ця траєкторія означає значний удар по прибутку страховиків, якщо не буде вжито ефективних контрзаходів.

- Терплячі жертви: Пацієнти та громадськість також втрачають гроші через ці шахрайства. Люди похилого віку, зокрема, стали мішенню для голосових шахрайств зі штучним інтелектом (телефонні дзвінки "онук у біді") та фальшивих медичних послуг. У 2023 році американські пенсіонери повідомили $3.4 млрд збитків від шахрайства, що на 111ТП6Т більше, ніж у попередньому році[44][45] - частково завдяки схемам зі штучним інтелектом. І крім грошових витрат, є ще людські жертвишахрайські медичні поради та фальшиві методи лікування, що рекламуються за допомогою ШІ, можуть призвести до фізичної шкоди або втрати довіри до законних медичних рекомендацій.

Загалом, 2025 рік чітко показав, що ШІ прискорює традиційне шахрайство у сфері охорони здоров'я. Те, що раніше було невеликими опортуністичними схемами, перетворилося на індустріально розвинені операції, що охоплюють континенти. Поєднання великих обсягів даних (часто отриманих в результаті зломів) і створення штучного інтелекту означає, що шахрайство може бути реалізоване з жахливою швидкістю і правдоподібністю. Глобальні втрати обчислюються десятками мільярдів і продовжують зростатиі кожна зацікавлена сторона - від лікарень і страховиків до пацієнтів - перебуває під загрозою. У наступному розділі обговорюється, як галузь може дати відсіч, використовуючи не менш передові технології та стратегії.

Захист від шахрайства, керованого штучним інтелектом: Стратегії та рішення

Протистояння шахрайству в сфері охорони здоров'я з використанням штучного інтелекту вимагає арсеналу однаково досконалих засобів захисту. Керівники закладів охорони здоров'я, команди кібербезпеки, фахівці з комплаєнсу та страховики повинні координувати свої дії, щоб впроваджуйте заходи протидії шахрайству в кожній вразливій точці - від реєстрації пацієнтів до виплат страхових відшкодувань. Нижче наведено ключові стратегії та технічні рішення для протидії шахрайству, керованому штучним інтелектом:

- Інструменти для виявлення вмісту зі штучним інтелектом: Так само, як злочинці використовують ШІ для фабрикації контенту, організації можуть використовувати ШІ для його виявлення. Розширений Детектори контенту зі штучним інтелектом (наприклад, пакет TruthScan) аналізують текст, зображення, аудіо та відео, щоб виявити ознаки генерації штучного інтелекту. Наприклад, платформа TruthScan застосовує машинне навчання для виявлення статистичних закономірностей і лінгвістичних особливостей, які вказують на те, що текст згенерований штучним інтелектом з більш ніж 99% точність[46][47]. Ці інструменти можуть бути інтегровані в системи управління претензіями або електронні медичні картки, щоб автоматично позначати підозрілі документи - наприклад, медичний звіт, який, ймовірно, був написаний ChatGPT - для ручної перевірки. Аналогічно, АІ-криміналістика зображень може виявити маніпуляції з медичними сканами або фальшиві посвідчення особи, а алгоритми глибокого виявлення фейків можуть аналізувати відео на наявність ознак синтезу (артефакти в пікселях, дивний хронометраж рухів обличчя і т.д.).[48][49]. Розгортаючи мультимодальні датчики ШІ, медичні організації можуть відсіювати велику частину підробленого ШІ контенту в режимі реального часу до того, як вона завдасть шкоди.

- Перевірка медичної картки та документів: Постачальники медичних послуг звертаються до спеціалізованих рішень, щоб перевіряти достовірність записів і заявлених документів. Це включає хешування та цифровий підпис легітимних записів, а також використання баз даних шаблонів відомих документів для порівняння з поданими заявками. Служби верифікації на основі штучного інтелекту (наприклад, TruthScan's Автентифікація медичних документів рішення) може миттєво проаналізувати вміст і метадані документа, щоб визначити, чи був він створений машиною або змінений[50][51]. Вони шукають невідповідності, які людина може не помітити - наприклад, ледь помітні аномалії форматування або метадані, що вказують на те, що зображення було створено штучним інтелектом. Моніторинг історій хвороби та страхових випадків у режимі реального часу для аномалій також є важливим[52]. Безперервно скануючи нові записи (результати лабораторних досліджень, записи лікарів, додатки до заяв), ці системи можуть виявляти фальшиві записи до того, як вони призводять до шахрайських виплат або клінічних помилок. Деякі страховики запровадили правила, згідно з якими будь-яка документація, ідентифікована як згенерована штучним інтелектом, автоматично витягується для розслідування шахрайства. Мета полягає в тому, щоб гарантувати, що кожна медична картка або заява, яка потрапляє в робочий процес, є достовірною та незмінною.

- Підтвердження особи та валідація: Посилення верифікації особи є критично важливим в епоху синтетичних ідентифікаторів. Заклади охорони здоров'я повинні забезпечити сувора перевірка особистих даних нових пацієнтів, постачальників послуг та продавців. Це може включати багатофакторну автентифікацію, біометричні перевірки (наприклад, розпізнавання обличчя або відбитків пальців при реєстрації), а також використання сервісів перевірки особи, які використовують ШІ для виявлення підроблені посвідчення особи або невідповідність персональних даних. Наприклад, розпізнавання обличчя можна поєднати з тестами на реальність, щоб запобігти видаванню згенерованого ШІ обличчя за справжнього пацієнта за допомогою фотографії. На зворотному боці алгоритми можуть здійснювати перехресну перевірку даних пацієнта (адреса, телефон, електронна пошта, присутність у соціальних мережах), щоб виявити "тонкі" ідентичності, які не мають нормальної історії - відома ознака синтетичних ідентифікаційних даних.[53]. Фінансові установи з великим успіхом використовують такі фонові перевірки узгодженості на основі штучного інтелекту[54]і охорона здоров'я може робити те ж саме: наприклад, позначати нового заявника на Medicare, якщо у нього не було цифрового сліду до цього року. Перевірка ідентифікаційних даних постачальника Не менш важливо переконатися, що лікар на відео в системі телемедицини має ліцензію і дійсно є тим, за кого себе видає, можливо, шляхом видачі цифрових сертифікатів або відеопотоків з водяними знаками, які важко підробити. В аптеках персонал повинен перевіряти незвичайні запити на рецепти, безпосередньо передзвонюючи постачальникам і використовуючи кодові фрази або перевірочні запитання, щоб протистояти потенційним голосовим самозванцям зі штучним інтелектом.

- Інтегроване виявлення шахрайства в робочих процесах: Щоб по-справжньому захистити систему, виявлення шахрайства не може бути окремим кроком - воно повинно бути вплетений у кожен робочий процес в організації охорони здоров'я.

На практиці це означає, що лікарні та страхові компанії розгортають API-інтеграції для виклику служб виявлення шахрайства в критичні моменти. Наприклад, коли постачальник послуг подає заяву з доданими документами, служба штучного інтелекту може автоматично оцінити ці додатки на автентичність за лічені секунди. Якщо ініціюється телемедичний прийом, платформа може запустити пасивний аналіз голосу у фоновому режимі, щоб переконатися, що абонент не використовує синтезований голос. Постійний моніторинг також є ключовим: сучасні платформи для боротьби з шахрайством пропонують інформаційні панелі, які відстежують сигнали про шахрайство в організації (невдалі перевірки, часте позначення заяв певної клініки тощо), щоб виявити закономірності, наприклад, організоване шахрайське угруповання, яке працює з кількома заявами на виплату страхових відшкодувань. Ставлячись до шахрайства у сфері охорони здоров'я більше як до кіберзагроз - з 24/7 моніторинг, виявлення аномалій та швидке реагування на інциденти - організації можуть виявити проблеми до того, як вони розкрутяться[55].

- ШІ для аналізу шахрайства та розпізнавання шаблонів: Обсяг даних у сфері охорони здоров'я настільки великий, що штучний інтелект незамінний у пошуку шахрайських схем, які люди не помічають. Моделі машинного навчання можна навчати на історичних випадках шахрайства, щоб виявляти нові (наприклад, групувати заяви, які мають схожі незвичайні коди МКХ, або визначати, коли рахунки одного лікаря значно відрізняються від рахунків інших лікарів). Страховики вже використовують предиктивну аналітику для оцінювати претензії за ризиком шахрайства в режимі реального часу. Нові технології, такі як графові нейронні мережі, можуть відображати взаємозв'язки між пацієнтами, постачальниками, діагнозами та заявами, щоб виявити неймовірні зв'язки (наприклад, один і той самий серійний номер пристрою, використаний у заявах з різних штатів). Наприклад, пакет TruthScan для виявлення страхового шахрайства включає в себе розпізнавання шаблонів претензій та прогностичне моделювання, щоб виявити організовані шахрайські групи та нетипові схеми до того, як збитки накопичаться[56][57]. Центр злиття Мін'юсту 2025 року став прикладом такого підходу - об'єднання даних Medicare та приватних страховиків для проактивного пошуку кластерів підозрілої активності.[58]. Організації охорони здоров'я також повинні обмінюватися даними та моделями штучного інтелекту у консорціумах, щоб розширити спектр сигналів про шахрайство, які кожен з них може виявити. Що більше даних (у межах конфіденційності) надходить до цих моделей, то краще вони розрізняють нормальну та шахрайську поведінку.

- Навчання персоналу та контроль процесів: Технології мають вирішальне значення, але обізнаність людей залишається потужним захистом. Медичний персонал і адміністратори повинні бути навчені тактиці шахрайства з використанням штучного інтелекту - наприклад, знати, що ідеально написаний лист від генерального директора може бути фішингом, створеним штучним інтелектомабо що вони повинні перевіряти особи учасників відеодзвінків якщо щось здається "не так" (дивні рухи очей або затримка звуку можуть натякати на глибоку підробку). Регулярні тренінги та поради (на кшталт тренінгів з протидії фішингу) можуть бути впроваджені для боротьби з новими загрозами, такими як телефонні шахрайства з використанням підроблених телефонів. Прості засоби контролю процесів додають рівні безпеки: вимога зворотного дзвінка або вторинної перевірки для великих або незвичайних платіжних запитів, використання відомих безпечних каналів зв'язку для передачі конфіденційної інформації, а також наявність плану реагування на інциденти, спеціально розробленого на випадок підозри в шахрайстві, опосередкованому ШІ. Важливо, щоб організації розвивали культуру, в якій працівники відчувають себе уповноваженими ставити під сумнів аномаліїнавіть якщо це "лікар" на відео, який звертається з дивним проханням. Багато шахрайств з глибокими підробками досягають успіху, експлуатуючи довіру та авторитет; пильні працівники, які знають про ці трюки, можуть зупинити інциденти на ранній стадії. Як зазначив один з експертів, боротьба з deepfakes може стати такою ж рутиною, як виявлення фішингових електронних листів - стандартна частина гігієни кібербезпеки[32][59].

- Використання спеціалізованих послуг: Враховуючи швидку еволюцію загроз, пов'язаних зі штучним інтелектом, багато медичних організацій співпрацюють зі спеціалізованими провайдерами послуг із запобігання шахрайству. Такі сервіси, як TruthScan для охорони здоров'я пропонуємо комплексні рішення, адаптовані до медичних потреб, зокрема: моніторинг цілісності електронних медичних карток (ЕМК) в режимі реального часу, перевірка документів пацієнта проти маніпуляцій зі штучним інтелектом, глибокого виявлення підробок для телемедицини та звітності про дотримання вимог (наприклад, аудиторські сліди, які підтверджують належну ретельність у виявленні шахрайства для регуляторів).[60][51]. Такі платформи часто надають Інтеграція з API для безперешкодної інтеграції в існуючі системи та створені відповідно до вимог законодавства у сфері охорони здоров'я (HIPAA, GDPR)[61][62]. Використовуючи інструменти корпоративного рівня, навіть невеликі клініки або регіональні страхові компанії можуть отримати доступ до передових можливостей виявлення ШІ без необхідності розробляти їх власними силами. Крім того, страховики і постачальники послуг повинні стежити за оновленнями в нормативних актах і галузевих стандартах - наприклад, новими законами проти шахрайства з використанням глибоких підробок (деякі юрисдикції тепер прямо забороняють підробку медичних документів, а США розширюють законодавство про крадіжку особистих даних, щоб охопити видавання себе за ШІ), щоб запобігти шахрайству з використанням ШІ.[63]). Дотримання таких стандартів та впровадження найсучасніших інструментів не лише зменшить втрати від шахрайства, але й продемонструє партнерам, аудиторам та пацієнтам сильну позицію безпеки.

Висновки та перспективи

2025 рік продемонстрував, що в майбутньому джина випустили з пляшки - Генеративний ШІ та автоматизація тепер переплітаються з шахрайством у сфері охорони здоров'я. У майбутньому шахраї, ймовірно, продовжать впроваджувати інновації: ми можемо побачити моделі штучного інтелекту, які навчаться імітувати стиль письма конкретних лікарів, або глибокі фейки, які реагуватимуть у реальному часі на складні запитання. Битва буде постійною гонкою озброєнь. Однак галузь охорони здоров'я реагує з такою ж енергією, інвестуючи в засоби захисту на основі штучного інтелекту та посилюючи робочі процеси безпеки. Поєднуючи передові технології виявлення, суворі процеси перевірки, міжгалузевий обмін даними та пильність співробітниківВ результаті дослідження, організації охорони здоров'я можуть суттєво зменшити загрозу шахрайства за допомогою штучного інтелекту.

Важливо, що це не просто питання ІТ - це питання управління та довіри. Ради директорів і керівники в галузі охорони здоров'я повинні визнати, що шахрайство з використанням штучного інтелекту є стратегічним ризиком для фінансів і довіри пацієнтів, що вимагає регулярної уваги і ресурсів. Відділи комплаєнсу повинні оновити оцінку ризиків шахрайства, включивши в неї аспекти ШІ, а страховики можуть переглянути припущення андеррайтингу, знаючи, що певний відсоток претензій може бути шахрайством за допомогою ШІ. З іншого боку, етичне використання ШІ в охороні здоров'я (для підтримки прийняття клінічних рішень, ефективності виставлення рахунків тощо) продовжуватиме приносити величезну користь - доти, доки існуватимуть надійні запобіжники для запобігання зловживанням.

Підводячи підсумок, Генеративний ШІ змінив правила гри в шахрайстві у сфері охорони здоров'я, але завдяки обізнаності та вдосконаленим контрзаходам вони не повинні перевантажувати систему. Успіху досягнуть ті організації, які залишатимуться в курсі нових загроз, швидко адаптуватимуться до них за допомогою засобів захисту, керованих штучним інтелектом, і розвиватимуть культуру "перевіряй і довіряй", а не "довіряй за замовчуванням". Таким чином, охорона здоров'я може безпечно використовувати позитивні сторони ШІ, одночасно нейтралізуючи його зловживання, захищаючи як прибуток, так і благополуччя пацієнтів у цифрову епоху.

Джерела: Нещодавні галузеві звіти та кейси, згадані вище, включаючи Pymnts (липень 2025 року)[2][3]Інститут Swiss Re (червень 2025)[27]Федеральний резервний банк Бостона (квітень 2025)[19]BMJ (2024)[37]та аналітичні записки TruthScan (2025)[51][64]серед інших. Усі дані та цитати відображають найсвіжіші дані, доступні у 2024-2025 роках, що ілюструють поточний стан шахрайства, керованого ШІ, у сфері охорони здоров'я та заходи боротьби з ним.

[1] [2] [3] [9] [10] [11] [12] [13] [14] [15] [41] [42] [55] [58] Міністерство юстиції США відзначило роль інструментів штучного інтелекту в боротьбі з шахрайством у сфері охорони здоров'я

[4] [5] [6] [7] [16] [40] [44] [45] Фейкова статистика та тенденції 2025 року | Ключові дані та ідеї - Keepnet

https://keepnetlabs.com/blog/deepfake-statistics-and-trends

[8] Deepfakes і криза знань | ЮНЕСКО

https://www.unesco.org/en/articles/deepfakes-and-crisis-knowing

[17] [18] [19] [20] [21] [22] [23] [24] [53] [54] Gen AI посилює загрозу шахрайства з синтетичними ідентифікаційними даними - Федеральний резервний банк Бостона

[25] [26] [56] [57] [62] [64] Страхування життя та здоров'я. Виявлення шахрайства за допомогою штучного інтелекту | TruthScan

https://truthscan.com/solutions/health-life-commercial-insurance-fraud-detection-solution

[27] [43] Як deepfakes, дезінформація та штучний інтелект посилюють страхове шахрайство | Swiss Re

[28] DEA попереджає про шахрайство з електронними рецептами - новини фармацевтичної практики

[29] [39] Кібербезпека та шахрайство в охороні здоров'я: Глибоке занурення в найбільші ризики та засоби захисту сьогодні | CrossClassify

https://www.crossclassify.com/resources/articles/healthcare-cybersecurity-and-fraud/

[30] [31] [32] [59] Еволюція загрози шахрайства в сфері телемедицини, Майк Руджіо

https://insights.taylorduma.com/post/102jkzn/the-evolving-threat-of-deepfake-telemedicine-scams

[33] [34] Експерти попереджають про шахраїв, які використовують "діпфейки" відомих лікарів у соціальних мережах

[35] [36] [37] Телевізійні лікарі, яким довіряють, "фальсифікували" рекламу медичних шахрайств у соціальних мережах - BMJ Group

https://bmjgroup.com/trusted-tv-doctors-deepfaked-to-promote-health-scams-on-social-media/

[38] [PDF] поточний стан досліджень Аджит Аппарі та М. Ерік Джонсон

http://mba.tuck.dartmouth.edu/digital/Research/ResearchProjects/AJIJIEM.pdf

[46] [47] [48] [49] TruthScan - виявлення та захист контенту за допомогою штучного інтелекту на підприємстві

[50] [51] [52] [60] [61] Виявлення шахрайства в медичній документації з використанням штучного інтелекту | Рішення для CRO в охороні здоров'я | TruthScan

https://truthscan.com/solutions/healthcare-cro-fraud-detection

[63] Наскільки небезпечні діпфейки та інші види шахрайства зі штучним інтелектом?