У 90-х це була ДНК.

У 2000-х роках це були пінги стільникових веж.

Але в 2026 році новим золотим стандартом доказів стане цифровий відбиток пальця.

Подумайте про це так...

Кожен відеофайл має унікальний підпис.

Якщо ШІ змінить хоча б один піксель, відбиток миттєво зміниться.

Якщо ваші докази зі штучного інтелекту не мають перевіреної часової позначки в блокчейні, щоб зафіксувати цей відбиток на місці, це все одно, що карикатура в очах сучасного судді.

Це означає, що епоха “побачити - значить повірити” закінчилася.

Ми вступили в еру відео-верифікації зі штучним інтелектом, де доказом є не те, що ви бачите, а цифровий код, прихований під поверхнею.

У цьому блозі ми розглянемо, чому традиційні докази не спрацьовують проти відеошахрайства, як розпізнати підроблені кліпи, чому верифікація є критично важливою для допустимості доказів і чому відеодетектор зі штучним інтелектом, такий як TruthScan, зараз є необхідним для юридичних команд.

Давайте зануримося.

Основні висновки

- У 2026 році всі відеодокази повинні пройти перевірку ШІ, щоб вважатися достовірними.

- Шахрайство з відео включає в себе невеликі зміни, такі як маніпуляції з мітками часу, а не лише повну заміну облич.

- Професійний детектор глибоких підробок - це єдиний спосіб виявити артефакти GAN, які людина не помічає.

- Нові правила, такі як Федеральне правило 707, стандартизують, як докази зі штучного інтелекту приймаються в суді.

- Автоматизований аналіз доказів дозволяє фірмам швидко і точно обробляти величезні пакети доказів.

- TruthScan запобігає шахрайству під час слухань у прямому ефірі, виявляючи синтетичні маски в режимі реального часу.

Що таке відеодокази в судових спорах?

Відеодокази - це, по суті, будь-який відеозапис, що використовується в суді для доведення того, що сталося. Від кримінальних справ до страхових врегулювань - скрізь.

Однак у 2026 році зростання відеошахрайства зробило припущення “бачив - значить, вірю” небезпечним. Тепер юристам потрібна надійна відео-верифікація зі штучним інтелектом, щоб забезпечити цілісність системи правосуддя.

Типи відеодоказів, які суди використовують щодня

Більше ніколи не турбуйтеся про шахрайство зі штучним інтелектом. TruthScan Може допомогти тобі:

- Виявлення згенерованого ШІ зображення, текст, голос і відео.

- Уникайте велике шахрайство, кероване штучним інтелектом.

- Захистіть своє найдорожче чутливий активи підприємства.

- Відеоспостереження (CCTV): Камери з магазинів чи світлофорів. Це найпоширеніший доказ у кримінальних справах.

- Камери на тілі: Відеозаписи з поліцейськими, які використовуються переважно у справах про громадянські права або перевищення повноважень.

- Відеореєстратори: Основний доказ в автомобільних аваріях і страхових спорах.

- Записані свідчення: Відеосвідчення або віддалені свідчення свідків, які стали нормою з часів пандемії. Зараз це стандарт, але з ним пов'язані юридичні проблеми з виявленням шахрайства.

- Смартфон і соціальні мережі: Відео від очевидців або пости, які підтверджують чиюсь поведінку або місцезнаходження.

- Служба безпеки компанії: Відеоматеріали, що використовуються корпораціями для шахрайства або “неправомірних звільнень”.

Генеративний ШІ та технологія глибокого підроблення додали новий рівень ризику. У 2025 році

- Кожна 20-та перевірка особи була обдурена глибокими фейками зі штучним інтелектом

- Опитування Medius показало, що 43% професіоналів стали жертвами спроби глибокого шахрайства

Реальні випадки шахрайства з відеодоказами

- Маніпуляції з відеозаписами судових засідань

Маніпуляції з відеозаписами судових засідань - це будь-які відео- або аудіодокази, подані в судовій справі, які були змінені, відредаговані або повністю сфабриковані за допомогою технологій.

Приклади:

- Справа про глибоку фальсифікацію в окрузі Аламеда (2025): Цивільна справа в Каліфорнії була закрита після того, як суд виявив, що відеозапис свідка, поданий як доказ, був повністю створений за допомогою ШІ.

- Захист від глибокого фейку у справі Sz Huang проти Tesla (2023): У позові про протиправне заподіяння смерті адвокати Tesla стверджували, що ключові відеозаписи аварії можуть бути підробкою.

Змінені відеозаписи з камер спостереження

Відео з камер спостереження - один із найпоширеніших видів доказів, які використовують у суді. Однак багато хто помилково вважає, що маніпуляції - це лише повні фейки.

Насправді ж відеошахрайство часто відбувається меншими, менш очевидними способами, які можуть скомпрометувати справу.

До поширених типів маніпуляцій належать

- Зміни мітки часу

- Видалення рами

- Зміни метаданих або GPS

- Заміна обличчя

- Видалення або вставлення об'єкта

- Зациклення відеозаписів

- Погіршення якості

Відео з камер спостереження часто надходить з різних місць: приватних магазинів, дверних дзвінків, автостоянок та міських камер. На відміну від поліцейських нагрудних камер, ці системи зазвичай не дотримуються суворих правил передачі даних.

Це означає:

- Може бути відсутній чіткий запис про те, хто працював з файлом.

- Відзнятий матеріал можна копіювати, передавати або конвертувати кілька разів.

- Процедури автентифікації можуть бути слабкими або непослідовними.

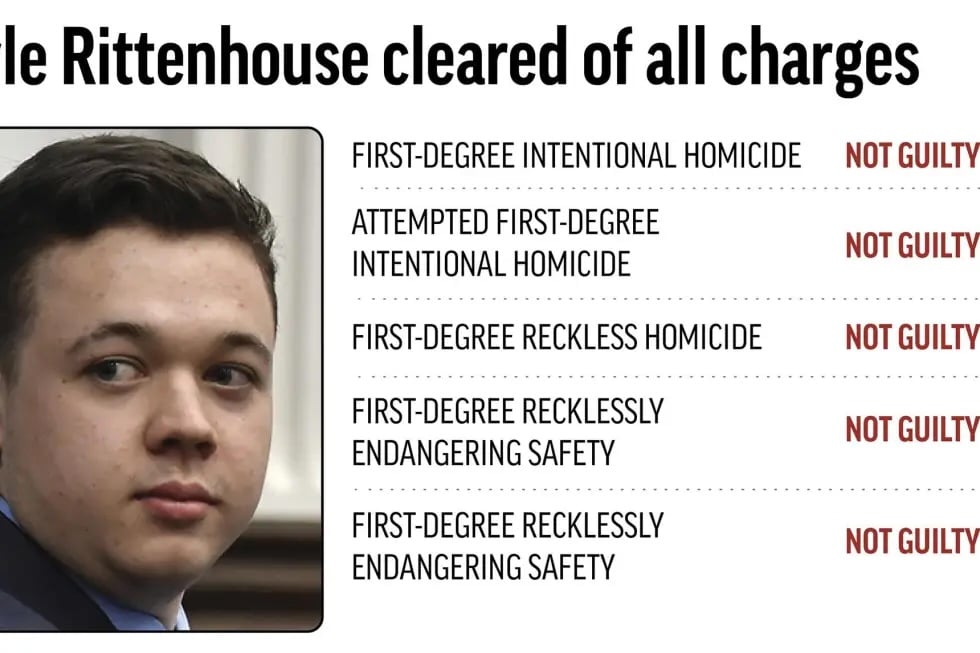

Приклад: Справа "Вісконсин проти Ріттенгауза" про вдосконалення штучного інтелекту

Відомий приклад з судового процесу Вісконсін проти Ріттенгауза. Обвинувачення намагалося використати функцію збільшення зображення на iPad, щоб показати деталі на відео, знятому дроном.

Захист стверджував, що зум Apple використовує ШІ-інтерполяцію, щоб здогадатися, що там має бути. Суддя постановив, що без професійного відеодетектора зі штучним інтелектом покращені кадри не можуть бути допущені до розгляду.

Оспорювані відеосвідчення

Спірне відеосвідчення, як правило, потребує юридичної експертизи, щоб визначити, чи є запис шахрайським:

- Повністю сфабриковані свідчення або заява

- Справжнє свідчення, оскаржене як фальшиве

- Маніпуляції з реальним записом

Кожен сценарій створює серйозний тягар автентифікації для суду.

Приклад: Справа про опіку над дитиною у Великій Британії

У сімейному судовому спорі у Великій Британії, на який посилається видання University of Baltimore Law Review, мати подала сильно змінений запис, щоб зобразити батька жорстоким під час боротьби за право опіки над дитиною.

Метою було обмежити його доступ до дітей.

Зростання ролі відео, згенерованого штучним інтелектом, у юридичних справах

Шлях до нинішньої ери детекторів глибоких підробок проходив кілька етапів:

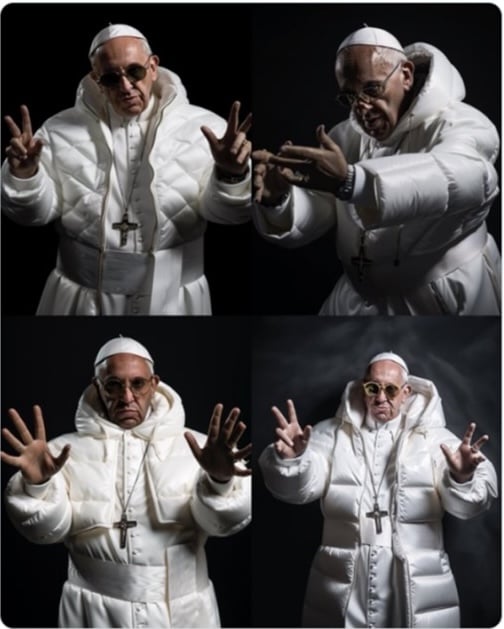

- Роки раннього попередження (2017-2021)

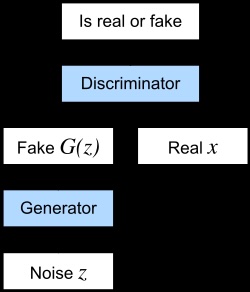

Технологія глибокого підроблення (на основі генеративних ворожих мереж (GAN)) з'явилася в полі зору громадськості приблизно в 2017 році.

Перші глибокі підробки часто були неякісними: обличчя з дивними викривленнями, зайвими пальцями, невідповідним освітленням і розмитими рисами, що робило їх легко помітними.

- Етап ескалації (2022-2023)

До 2022 року технологія вдосконалювалася. Багато з них були безкоштовними і їх можна було використовувати на смартфоні.

У 2023 році ми стали свідками перших серйозних викликів, пов'язаних із глибоким фейком, у судових справах, зокрема Sz Huang проти Tesla, Сполучені Штати проти Реффітта та Сполучені Штати проти Дуліна, де адвокати піднімали питання про те, чи можуть відеодокази бути згенеровані штучним інтелектом.

Приблизно в той самий час Консультативний комітет Американської асоціації адвокатів з правил доказування офіційно розпочав вивчення цього питання.

- Критичний поріг (2024-2025)

Контент, створений штучним інтелектом, недовго залишався академічним. У 2024 році інцидент з інжиніринговою компанією Arup, пов'язаний зі згенерованим штучним інтелектом фальшивим відеодзвінком, який дозволив шахрайські дії. банківських переказів на загальну суму $25 мільйонів.

Правова система почала реагувати.

У 2025 році, Луїзіана прийняла HB 178, створивши першу на державному рівні систему перевірки доказів щодо ШІ.

На федеральному рівні Консультативний комітет США з правил доказування запропонував Правило 707, присвячене машинним доказам.

Що буде у 2026 році

Станом на початок 2026 року регулювання глибоких фейків та ШІ-відео прискорилося по всій країні:

- 46 штатів прийняли певну форму глибоко фальшивого законодавства.

- З 2022 року, 169 законів було прийнято, а 146 законопроектів було внесено лише у 2025 році.

- Федеральне правило 707 відкрите для публічних коментарів до 16 лютого 2026 року.

Покращення верифікації відео за допомогою штучного інтелекту

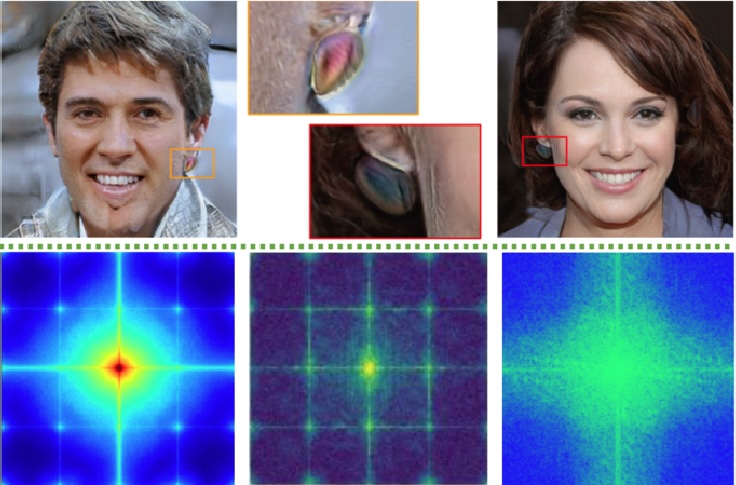

Найефективніший спосіб виявити відео, створене штучним інтелектом, - використовувати сам штучний інтелект.

Це пов'язано з тим, що глибокі підробки створюються системами машинного навчання, які залишають за собою ледь помітні цифрові шаблони.

Ці патерни занадто малі або складні, щоб людське око могло їх помітити. Але вони можуть бути виявлені іншими алгоритмами.

Надійна система верифікації відео зі штучним інтелектом може аналізувати одразу кілька шарів відео, в тому числі:

- Аналіз на рівні фреймів перевіряє кожен кадр на наявність візуальних помилок, таких як дивні текстури, невідповідність освітлення або проблеми з накладанням навколо облич.

- Аналіз часової когерентності дивиться на рух між кадрами, щоб знайти неприродні стрибки або непослідовні рухи.

- Відстеження орієнтирів на обличчі відстежує рух очей, моргання та форму обличчя, щоб виявити неприродні зміни.

- Тестування аудіовізуальної синхронізації перевіряє, чи точно рухи губ відповідають вимовленим словам.

- Аудіо-криміналістика аналізує голос на наявність ознак клонування, таких як незвичні звукові патерни або роботизовані інтонації.

- Метадані та аналіз стиснення перевіряє приховані дані файлів, що є життєво важливим для юридичного виявлення шахрайства, щоб перевірити, чи збігаються вони з оригінальними даними запису.

Навчання юридичних команд щодо відеошахрайства

Оскільки штучний інтелект може імітувати людську поведінку з жахливою точністю, юридичні фірми використовують автоматизований аналіз доказів і поєднання традиційних тактик, щоб залишатися на крок попереду.

| Категорія | Метод | Опис |

| Офіційні способи | Кредити CLE (безперервна юридична освіта) | Обов'язкові або факультативні курси, які навчають юристів, як автентифікувати цифрові докази, розпізнавати глибокі фейки та дотримуватися стандартів доказової бази. |

| Призначені судом експерти зі штучного інтелекту | Створення сертифікованих судових експертів зі штучного інтелекту, подібних до ДНК-експертів, для оцінки спірних відеодоказів у суді. | |

| Неофіційні способи | Внутрішній Red-Teaming | Найняти фахівців з кібербезпеки, щоб перевірити, чи можуть фальшиві або підроблені докази просочитися крізь системи прийому доказів фірми. |

| “Протокол ”Vibe Check" | Навчіть персонал виявляти поширені ознаки глибокої підробки, такі як неприродне моргання, спотворені риси обличчя або проблеми з синхронізацією губ, перш ніж передавати справу на експертизу. |

Інструменти та технології для перевірки доказів

У 2026 році ми перейшли від простого візуального огляду.

Оскільки штучний інтелект здатен обдурити навіть найдосвідченіших слідчих, юридичні команди використовують спеціальний набір інструментів, щоб переконатися, що те, що вони бачать, є абсолютною правдою.

Технологія, що стоїть за перевіркою доказів

- Детектори підробок: Це спеціалізовані програми, які сканують артефакти ГАН. Це мікроскопічні, математичні візерунки або шуми, залишені моделями штучного інтелекту, які генерують синтетичні обличчя. У той час як людина бачить обличчя, детектор бачить цифровий підпис, який їй не належить.

- TruthScan це детектор глибоких підробок, який сканує відео кадр за кадром на наявність ознак ШІ, таких як незвичне моргання, дивні форми обличчя або піксельні помилки, коли додається фальшиве обличчя.

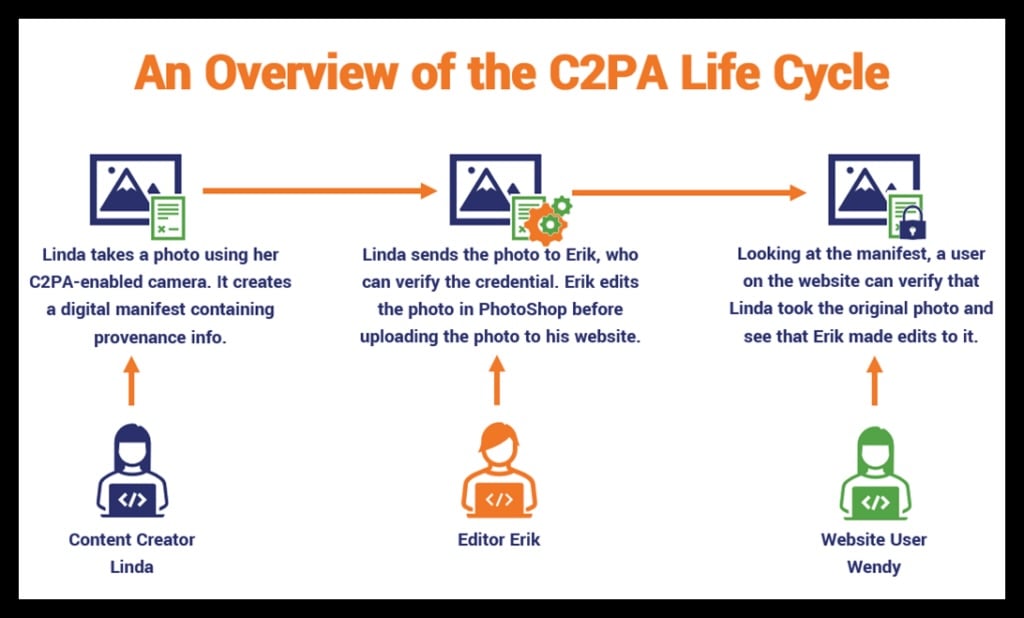

- Блокчейн-мітки часу: Щоб довести, що відео не було змінено з моменту його запису, багато агентств використовують стандарт C2PA. Коли відео записується на відповідний пристрій, створюється унікальний цифровий відбиток (хеш), який зберігається в блокчейні.

- TruthScan може перевірити, чи збігається цей відбиток з відео, показуючи, чи був файл відредагований або порушений ланцюжок зберігання.

- Інструменти для аналізу метаданих: Кожен цифровий файл має свідоцтво про народження, відоме як Exif-дані. Ці інструменти перевіряють, чи не було файл повторно збережено в програмному забезпеченні для редагування зі штучним інтелектом і чи не підроблено дані про місцезнаходження (GPS). Якщо відео стверджує, що воно зняте камерою в магазині, але метадані показують, що його було експортовано з відеоредактора, у вас є проблема.

- Amped Software і TruthScan досліджують приховані дані файлу (Exif, заголовки), щоб дізнатися, чи було відео відредаговано або оброблено штучним інтелектом.

Тенденції у сфері відеодоказів зі штучним інтелектом

Ось три тренди 2026 року.

- Генеративна судова експертиза: ШІ проти ШІ

Найпрогресивніший спосіб зловити глибокий фейк у 2026 році - використовувати ту саму технологію, яка його створила. Це називається генеративною змагальною криміналістикою.

- Один ШІ (генератор) намагається створити фейк, тоді як інший ШІ (дискримінатор) намагається його зловити. У залі суду такі інструменти, як TruthScan, можуть стати остаточним дискримінатором.

- Приклад: Позивач подає відеозапис, на якому керівник компанії укладає усний договір. TruthScan сканує відео, використовуючи власні змагальні моделі для виявлення артефактів GAN. Якщо програма позначає синтетичну ймовірність 98%, це означає, що докази, швидше за все, підроблені, щоб обдурити людське око.

- Аналіз синхронізації аудіо-відео (правило 0,01 мс)

Люди зазвичай можуть помітити затримку, якщо звук на відео вимкнений приблизно на 40-80 мілісекунд. Однак глибокі підробки 2026 року часто майже ідеальні.

- Сучасні криміналістичні інструменти зі штучним інтелектом тепер шукають затримку в 0,01 мілісекунди між фонетичним звучанням слова і механічним рухом губ.

- Приклад: У справі про домагання 2026 року відповідач стверджував, що відео було підроблене. Судово-медичний автоматизований аналіз доказів показав, що форми губ “М” і “Б” були на 0,02 мс не синхронізовані з аудіозаписом. Ця мікроскопічна помилка доводить, що голос був клонований і накладений на інше відео, що призвело до закриття справи.

- Дешеві фейки проти глибоких фейків

У той час як глибокі підробки використовують висококласний штучний інтелект, дешеві підробки є найпоширенішою формою відеошахрайства.

- Глибокий фейк створює реальність, якої ніколи не було (наприклад, підміна облич). Дешевий фейк бере реальні кадри і змінює контекст або намір за допомогою простих інструментів.

- Приклад (Уповільнення): Відео, на якому політик виглядає п'яним або нетверезим, можна створити, просто сповільнивши відзнятий матеріал на 20% і відрегулювавши висоту звуку.

- Приклад (Повторний контекст): Кадри з протесту 2022 року в іншій країні публікують у 2026 році як живий доказ місцевих заворушень. Тепер юридичні команди використовують аналіз метаданих TruthScan, щоб довести реальну дату народження відео.

Як TruthScan захищає юридичні відеодокази

TruthScan гарантує, що кожен кадр, який ви надасте в суді, є автентичним, перевіреним та юридично обґрунтованим.

Платформа спрощує ШІ-верифікацію відео завдяки наступним перевагам:

Автоматизовані журнали аудиту та документація ланцюга поставок

- Надійність, готова до суду: Створює звіти у форматі PDF та JSON, які документують кожен крок перевірки з точними оцінками достовірності та часовими мітками.

- Відповідність найвищому рівню: Будьте спокійні, знаючи, що ваші дані захищені та відповідають суворим світовим стандартам, таким як SOC 2, ISO 27001 та GDPR.

- Гнучкий контроль даних: Зберігайте конфіденційні докази в межах необхідної юрисдикції за допомогою варіантів розгортання локальних або віртуальних центрів обробки даних, розроблених для галузей із суворим регулюванням.

Пакетна обробка та інтеграція API для юридичних процесів

- Величезна економія часу: Обробляйте тисячі файлів з пакетів виявлення або наборів спостереження одночасно, використовуючи масовий імпорт зі сховища (S3/GCS).

- Безшовне електронне відкриття: Оптимізуйте свої операції, інтегрувавши верифікацію безпосередньо в існуюче програмне забезпечення за допомогою веб-хуків та API.

- Усунення помилок вручну: Автоматизуйте перший етап перевірки доказів, щоб ваша команда могла зосередитися на стратегії, а не на нудній перевірці кожного файлу.

Верифікація в режимі реального часу для свідчень та дистанційних слухань

- Припини вдавати з себе імітатора: Використовуйте кінцеві точки прямої трансляції, щоб виявити, чи використовує свідок фільтри глибокої підробки або голосові клони під час віддаленого слухання.

- Підтримувати цілісність суду: Позначайте візуальні або звукові аномалії в режимі реального часу, запобігаючи потраплянню до запису неправдивих свідчень.

- Душевний спокій: Надайте своїм клієнтам і суду додатковий рівень безпеки, який гарантує, що людина на екрані є саме тією, за кого себе видає.

Дізнайтеся більше про захист відеодоказів зі штучним інтелектом

Захистіть свою компанію від ризиків маніпуляцій у ЗМІ. Детектор глибоких підробок TruthScan та технологія відеодетектора зі штучним інтелектом забезпечують найкраще рішення для електронного виявлення та юридичної перевірки.

Готові побачити TruthScan в дії?

- Відвідати truthscan.com щоб отримати безкоштовні 20 000 кредитів.

- Для корпоративних запитів, інтеграції з API або індивідуальних варіантів розгортання зверніться до їхньої команди за адресою Truthscan.com/contact.