Лише кілька років тому, щоб імітувати чийсь голос, потрібна була професійна студія та багато технічних навичок.

Тепер кожен, хто має доступ до інтернету і трохи вільного часу, може створити цифровий клон чийогось голосу менш ніж за хвилину.

Інструменти для таких атак стають дешевшими і доступнішими з кожним днем. А оскільки так багато людей діляться своїм життям у соціальних мережах, шахраям дуже легко знайти потрібний їм аудіозапис.

У цій статті ми розповімо вам про деякі з найвідоміших реальних прикладів аудіошахрайства. Ми також познайомимо вас із рішенням, яке допоможе вчасно покласти край цим загрозам.

Основні висновки

- За останні роки кількість спроб шахрайства з голосовими підробками зросла більш ніж на 2137%, чому сприяв той факт, що сучасний ШІ може згенерувати точний голосовий клон 85%, використовуючи лише три секунди вихідного аудіо.

- Серед відомих реальних атак - пограбування інжинірингової компанії Arup у 2024 році, коли шахраї використовували підроблені відео та аудіозаписи фінансового директора, щоб обдурити співробітника і змусити його переказати $25,6 млн. доларів США.

- Окрім корпоративних крадіжок, голосові підробки створюють серйозні емоційні ризики для сімей через шахрайство з викраденням і можуть обходити традиційні біометричні системи безпеки, що використовуються банками та іншими додатками з високим рівнем захисту.

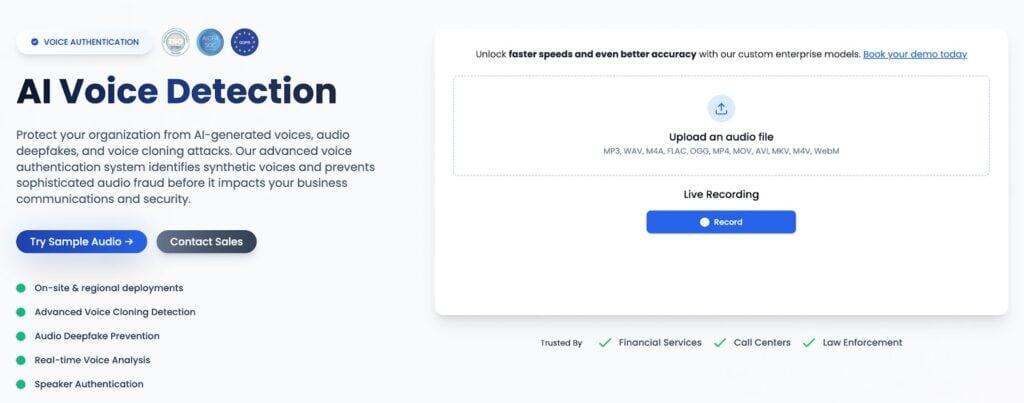

- Організації змушені відмовитися від верифікації лише людиною, впроваджуючи протоколи схвалення великих переказів кількома особами та розгортаючи детектори голосу зі штучним інтелектом, такі як TruthScan, для аналізу акустичних відбитків пальців у реальному часі.

- TruthScan захищає корпоративну взаємодію, ідентифікуючи артефакти синтетичного мовлення з таких платформ, як ElevenLabs і Murf, з точністю понад 99% у всіх основних аудіо- та відеоформатах.

Що таке голосова фальшива атака?

Підробка голосу - це цифрова підробка чийогось голосу. Зловмисник використовує програмне забезпечення, яке може проаналізувати кожну дрібну деталь про те, як хтось говорить із запису свого голосу.

Щоб клонувати голос, програма намагається помітити в ньому певні закономірності. В основному, програма враховує такі речі, як висота голосу, тон, те, як людина дихає між реченнями тощо.

Вивчивши ці шаблони, зловмисник може змусити його говорити цим голосом все, що завгодно.

Більше ніколи не турбуйтеся про шахрайство зі штучним інтелектом. TruthScan Може допомогти тобі:

- Виявлення згенерованого ШІ зображення, текст, голос і відео.

- Уникайте велике шахрайство, кероване штучним інтелектом.

- Захистіть своє найдорожче чутливий активи підприємства.

Небезпека полягає в тому, що інструменти для створення голосових підробок легко доступні. І більшість з них не потребують встановлення. Вони доступні в Інтернеті у вигляді веб-сайтів.

Вам потрібно лише вкинути в них кілька доларів і почати клонувати голоси. Якщо копнути глибше, можна навіть знайти інструменти, які дозволяють клонувати голоси безкоштовно.

Ця нова і легкодоступна технологія призвела до різкого зростання кількості аудіошахрайства.

Шахраям потрібен лише крихітний шматочок аудіозапису, який вони можуть отримати з соціальних мереж або інших публічних каналів, щоб клонувати його.

Потім вони можуть використовувати клонований голос, щоб видавати себе за людину в таких ситуаціях, як телефонні дзвінки в прямому ефірі, відеозустрічі, голосові нотатки, оголошення тощо.

Це не просто гіпотетичні випадки використання голосових фейкових атак. Такі речі вже траплялися. Пізніше ми розглянемо деякі з найвідоміших голосових фейкових атак.

Потенційні ризики голосових фальшивих атак

Почувши про глибоку фальсифікацію голосу, ви, можливо, уявили собі кумедне відео зі знаменитостями, які говорять те, чого вони ніколи не говорили.

Але таке, на перший погляд, невинне використання клонованого голосу може завдати серйозної шкоди залученим сторонам. Поговоримо про ризики.

Фінансове спустошення для бізнесу

Підробка голосу може назавжди зіпсувати репутацію компанії. Він також здатен за лічені хвилини позбавити її великих сум грошей.

Як так, запитаєте ви? Шахраї можуть клонувати голос керівника компанії і використовувати його для дзвінків співробітникам, щоб змусити їх робити те, чого вони не повинні робити, наприклад, переказувати гроші на рахунок.

Це лише один приклад. Можливості безмежні.

Обхід систем безпеки

Ваш голос - це біометрія, яку не повинен мати ніхто інший. Це тому, що ви використовуєте його як пароль для входу до багатьох своїх додатків, особливо банківських.

Хоча ці програми можуть мати вбудовану автоматизовану систему перевірки голосу для запобігання несанкціонованому доступу, хороший голосовий клон все одно має шанс їх обдурити.

Емоційні втрати для сімей

Мабуть, найлегшою мішенню для аудіо-шахраїв є літні люди в родині. Наприклад, батьки, бабусі та дідусі.

Шахраї можуть зателефонувати, скажімо, матері і ввімкнути звук її дочки, яка благає про допомогу, кажучи, що її викрали.

Підрив довіри на робочому місці

Голосові фейкові атаки також підривають довіру до здорового робочого місця.

Співробітникам доведеться перевіряти телефонні дзвінки від свого керівника, щоб переконатися, що це не шахрай, який клонованим голосом наказує їм робити ризиковані речі.

Які ж тоді є варіанти, якщо не перевіряти все вручну? Всі ризики, які ми щойно обговорили, вказують на необхідність автоматизованого запобігання deepfake-атакам.

На щастя, зараз у нас є інструменти для виявлення підроблених голосів зі штучним інтелектом, і TruthScan - один з них.

Запобігайте шахрайству та видаванню себе за іншу особу за допомогою TruthScan ШІ-детектор голосу.

Реальні приклади голосових фейкових атак

Завдяки штучному інтелекту ми дійшли до того, що не можемо з легкістю довіряти тому, що бачать наші очі або чують наші вуха. ШІ тепер здатен створювати реалістичні зображення та відео. Те ж саме стосується і звуку.

Можливо, ви вже чули історії про те, як люди потрапляли на фальшиві аудіо-шахрайства. Час від часу вони з'являються в новинах та соціальних мережах. Деякі з них важко усвідомити.

Ми розповімо вам про деякі з найвідоміших голосових фейкових атак, щоб ви могли отримати уявлення про те, наскільки майстерно вони виконуються.

Віртуальна зустріч на мільйон $25, якої насправді не було

Про цю фейкову атаку, ймовірно, найбільше повідомлень.

У "The жертвою стала британська інжинірингова компанія Arup, але шахрайство виникло в її гонконгському офісі.

Це був початок 2024 року, коли працівник фінансового відділу компанії отримав електронного листа від фінансового директора компанії у Великобританії. В електронному листі фінансовий директор просив працівника здійснити таємні грошові перекази на деякі банківські рахунки.

Спочатку співробітник був досить підозрілим, оскільки запит здавався трохи дивним, і він подумав, що це може бути фішингове шахрайство.

Але потім працівника запросили на відеоконференцію. Коли працівник приєднався до дзвінка, він побачив, що його співрозмовник був дуже схожий на фінансового директора та кількох інших старших колег.

Всі виглядали і звучали саме так, як і мали б виглядати. Вони також розмовляли один з одним, щоб все здавалося більш реальним.

Це повністю розвіяло всі сумніви працівника фінансового відділу, який 15 транзакціями переказав $25.6 мільйонів (~HK$200 мільйонів) на кілька різних рахунків у гонконгських банках.

Пізніше з'ясувалося, що все це було фейком. Жодна людина у дзвінку не була тією, за кого себе видавала, окрім співробітника Arup. Шахраї чудово скоординували атаку, використовуючи високоякісні аудіо- та відео-клони фінансового директора та старших співробітників компанії.

Італійський міністр та ікони моди

Цей також відбувся у 2024 році. A фейковий міністр оборони Італії Гвідо Кросетто зателефонувала кільком італійським елітам і попросила їх негайно надати фінансову допомогу для порятунку викрадених журналістів.

У дзвінку фальшивий Гвідо Кросетто стверджував, що це надсекретна урядова операція. Додзвонювачу навіть вдалося додзвонитися до легендарних діячів моди, таких як Джорджіо Армані.

На жаль, одна людина зрештою переказала близько мільйона доларів. Ймовірно, у них почуття патріотичного обов'язку допомогти було сильнішим, ніж у інших, і шахраям вдалося цим скористатися.

Енергетична крадіжка $243,000 у Великій Британії

Це сталося у 2019 році і, ймовірно, це був перший в історії глибокий фейк такого масштабу, про який повідомлялося в ЗМІ.

Генеральний директор британської енергетичної компанії думав, що розмовляє по телефону зі своїм босом з материнської компанії в Німеччині.

Генеральному директору було наказано переказати близько 220 000 євро ($243 000) постачальнику в Угорщині. Йому сказали, що це важлива угода, яка потребує негайного переказу. Генеральний директор повівся на аферу і переказав гроші.

Жахливий дзвінок для матері в Арізоні

Пам'ятаєте, ми говорили про те, що аудіопідробки становлять загрозу для сімей? Приклад шахрайства, який ми навели, насправді стався.

Шахраї клонували голос 15-річної дівчинки з її відео в соціальних мережах. Потім вони зателефонували її матері і голосом доньки заявили, що її викрали, і викрадачі вимагають негайно заплатити викуп.

На щастя, батько зміг додзвонитися до своєї справжньої доньки, яка була в безпеці на гірськолижному тренуванні під час усього цього випробування. Вони уникнули шахрайства.

Як підробка голосу впливає на підприємства

Основна мета голосової фальшивої атаки - викрасти гроші.

Але коли мішенню стають підприємства, шкода є багатовимірною.

Наприклад, глибокі фейки можуть отруїти атмосферу між працівниками компанії. Це може створити культуру, в якій працівники завжди бояться припуститися помилки.

Візьмемо приклад кол-центрів. Ми бачимо повідомлення про те, що кіберзлочинці телефонують до них і видають себе за конкретних клієнтів.

Їхній трюк полягає в тому, щоб змусити агентів кол-центру змінити дані рахунків цих клієнтів (наприклад, домашні адреси, номери телефонів) і заволодіти їхніми рахунками.

Дистанційний найм і віртуальні співбесіди - ще одна сфера, де кандидати можуть використовувати фальшиві голоси, щоб отримати роботу, для якої вони не мають достатньої кваліфікації.

Захист бізнесу від голосових фальшивих атак

Традиційні правила безпеки на підприємствах були написані ще до епохи штучного інтелекту.

Настав час для бізнесу переглянути їх. Для початку їм варто почати з ознайомлення з багатьма новими кіберзагрозами, які виникли внаслідок зловживання штучним інтелектом.

Наприклад, вони можуть організувати тренінги для всієї своєї команди і показати їм реальні приклади аудіошахрайства. Ви можете почати з прикладів, які ми щойно обговорили вище. На цих тренінгах вони також повинні отримати поради щодо запобігання фейковим атакам для різних сценаріїв.

Після цього ви можете перейти до оновлення внутрішньої бізнес-політики. Однією з важливих змін може стати припинення надання одній особі права одноосібно санкціонувати масові банківські перекази.

Великі платежі повинні вимагати схвалення всієї комісії, щоб хоча б один з них міг вчасно помітити, що щось не так.

Вам також варто подумати про інтеграцію автоматизованого ШІ-детектор голосу працювати у фоновому режимі під час дзвінків.

Саме для цього були створені інструменти штучного інтелекту TruthScan. Ви можете виявляти, перевіряти та запобігати голосовим фейковим атакам за допомогою наших АІ-інструментів. Ми розповімо вам, як це зробити.

Як TruthScan захищає голосову взаємодію

Ми розуміємо, що працівники не можуть самостійно відрізнити фальшивий голос від справжнього під час стресового дзвінка. Їм потрібен спеціальний асистент, який міг би впоратися з цією роботою під час дзвінка, в той час як ваша команда може зосередитися на тому, для чого їх найняли.

Наш ШІ-детектор голосу це спеціалізоване рішення.

Ось як він працює і на що здатен:

- Аналізує мільйони різних точок даних під час телефонних дзвінків і відеозустрічей у реальному часі та забезпечує точність 99%

- Видає попередження миттєво після виявлення фальшивого голосу

- Вловлює спектральні патерни та акустичні відбитки в голосі, які залишають лише синтетичні моделі

- Інтеграція з вашим існуючим кол-центром або службою підтримки за допомогою простого REST API

- Може сканувати всі основні аудіо- та відеоформати

Поговоріть з TruthScan про запобігання голосовим фальшивим атакам

Ви можете зупинити шахрайство з клонуванням голосу в режимі реального часу за допомогою TruthScan, але питання в тому, коли ви почнете? Рано чи пізно ваші співробітники можуть припуститися помилки і ошукати вас. Не чекайте цього нещасного моменту.

Наш детектор голосу зі штучним інтелектом може виявляти голосові підробки за допомогою таких платформ, як ElevenLabs і Murf.

Він працює у фоновому режимі під час телефонних дзвінків і відеозустрічей, тому вашим операторам не доведеться виконувати кілька завдань одночасно.

Все, що потрібно - це швидка інтеграція через наш REST API.

Почніть з TruthScan зараз і захистіть свій бізнес від шахрайства.