Вступ

Штучний інтелект безпрецедентно змінює ландшафт фінансового шахрайства. На початку 2024 року шахраї використовували згенеровані ШІ глибокі підробки, щоб видавати себе за керівників під час відеодзвінків, обманом змусивши співробітника з Гонконгу перевести $25 мільйонів шахраям[1][2]. Подібні інциденти демонструють, як генеративний ШІ дає злочинцям можливість створювати дуже переконливі шахрайські схеми, націлені на банки та їхніх клієнтів. Регулятори б'ють на сполох: наприкінці 2024 року FinCEN Міністерства фінансів США випустив попередження про зростання шахрайства з використанням "глибоко підроблених" носіїв, створених ШІ, включаючи підроблені документи, що посвідчують особу, для обходу банківських перевірок.[3][4]. У цьому документі розглядаються останні Тенденції шахрайства зі штучним інтелектом у фінансових послугах і обговорює, як установи можуть посилити свій захист. Ми досліджуємо, як шахраї використовують генеративний ШІ на озброєнні - від глибоко підроблених імітацій до синтетичних ідентичностей - і описуємо технології та стратегії (включно з передовими інструментами виявлення, такими як TruthScan), які можуть застосувати групи по боротьбі з шахрайством та керівники для протидії цій еволюціонуючій загрозі.

Основні тенденції шахрайства зі штучним інтелектом у фінансових послугах

ШІ та машинне навчання використовуються зловмисниками для більш масштабного та витонченого шахрайства. Серед найбільш помітних Тактика шахрайства з використанням ШІ Серед них - банки, фінтехи та страховики:

- Шахрайство з підробленими особами: Злочинці використовують Відео та аудіо зі штучним інтелектом видавати себе за довірених осіб (керівників, клієнтів тощо) у режимі реального часу. Наприклад, реалістичні фальшиві голоси використовувалися в атаках вішингу (голосового фішингу) для авторизації шахрайських банківських переказів, а створені штучним інтелектом відеоролики обманом змушували співробітників схвалювати фальшиві транзакції.[1][5]. Ці синтетичні носії ускладнюють визначення того, чи дійсно ви говорите з тією людиною, за яку себе видаєте, що уможливлює крадіжки на великі суми, як у випадку з підробкою $25M, наведеному вище. Глибокі підробки стають доступні та прості у виробництвідля клонування голосу потрібно лише 20-30 секунд аудіо, а для створення на перший погляд автентичного відео - менше години.[6].

- Фішинг та BEC з використанням штучного інтелекту: Генеративний ШІ турбулізує схеми соціальної інженерії, такі як фішингові електронні листи та компрометація ділової електронної пошти (BEC). Чат-боти зі штучним інтелектом можуть створювати високо персоналізовані шахрайські електронні листи ідеальною діловою мовою, імітуючи стиль письма генерального директора або створюючи переконливі фальшиві рахунки-фактури від постачальників у великих масштабах. Насправді, підпільні інструменти, такі як ШахрайствоGPT і WormGPT (нефільтровані версії ChatGPT) з'явилися, щоб допомогти кіберзлочинцям автоматизувати фішинг і створення шкідливого програмного забезпечення[7][8]. Це означає, що потенційний шахрай з мінімальними навичками може з легкістю створювати відшліфовані фішингові кампанії або шкідливий код. Завдяки штучному інтелекту один злочинець може розіслати тисячі спеціально розроблених шахрайських електронних листів або текстових повідомлень, що значно збільшує охоплення традиційних спроб шахрайства. Центр боротьби з інтернет-злочинністю ФБР вже помітив понад 1 трлн 7 трлн 2,7 млрд втратили від BEC-шахрайства у 2022 році, а генеративний ШІ загрожує ще більше збільшити ці втрати в найближчі роки.[9][10].

- Синтетичні особистості та шахрайство з документами: Генеративний ШІ стимулює бум шахрайства з синтетичними ідентифікаційними данимиодин з найбільш швидкозростаючих видів фінансових злочинів[11][12]. Шахраї комбінують реальні та фейкові персональні дані для створення "франкенштейнівських" особистостей, а потім використовують штучний інтелект, щоб створювати реалістичні підтверджуючі документи - від підроблених паспортів і банківських виписок до платіжних квитанцій[7]. Генератори зображень ШІ та інструменти редагування можуть підробляти автентичні посвідчення особи та фотографії які проходять випадкову перевірку. Навіть перевірка наявності або селфі-верифікація може бути потенційно обіграна за допомогою зображень або відео, якими маніпулює ШІ. Автоматизувавши створення тисяч фальшивих особистостей (кожна з яких має згенероване ШІ зображення профілю, соціальні мережі тощо), злочинці можуть масово відкривати банківські рахунки або подавати заявки на кредити, а також відмивати гроші або не повертати кредити. Збитки від шахрайства з використанням синтетичних ідентифікаційних даних оцінюються приблизно в $35 мільярдів у 2023 році[13]а генеративний ШІ лише прискорює цю тенденцію, роблячи фальшиві ідентичності дешевшими і складнішими для виявлення.

- Автоматизоване шахрайство та ухилення: Окрім створення фейкового контенту, ШІ також допомагає шахраям максимізувати успіх своїх схем. Просунуті боти можуть швидко перевіряти дані викрадених кредитних карток на сайтах електронної комерції, використовуючи ML, щоб уникнути тригерів виявлення. ШІ може допомогти злочинцям виявити найслабші ланки в системі безпеки організації або навіть синтезувати голосові відповіді, щоб обійти телефонну верифікацію особи. Кустарна індустрія в темному інтернеті зараз продає інструменти ШІ "шахрайство як послуга" всього за $20[14]. Така демократизація можливостей штучного інтелекту означає, що навіть злочинці низького рівня можуть здійснювати високотехнологічні шахрайські атаки. Гонка озброєнь поширюється і на ухилення від виявлення - шахраї використовують ШІ, щоб досліджувати банківські системи протидії шахрайству і вдосконалювати свій підхід, поки не знайдуть метод, який прослизає крізь фільтри.[15]. Коротше кажучи, ШІ дозволяє здійснювати шахрайство з небаченими раніше масштабами та ефективністюкидаючи виклик традиційним засобам захисту.

Ці тактики з використанням штучного інтелекту вже поширюється з тривожною швидкістю. Традиційні схеми шахрайства, такі як підробка чеків або фішинг, існують роками, але ШІ збільшує їхній обсяг і реалістичність. Дані розповідають чітку історію: Шахрайство зі штучним інтелектом - це зростаючий.

Більше ніколи не турбуйтеся про шахрайство зі штучним інтелектом. TruthScan Може допомогти тобі:

- Виявлення згенерованого ШІ зображення, текст, голос і відео.

- Уникайте велике шахрайство, кероване штучним інтелектом.

- Захистіть своє найдорожче чутливий активи підприємства.

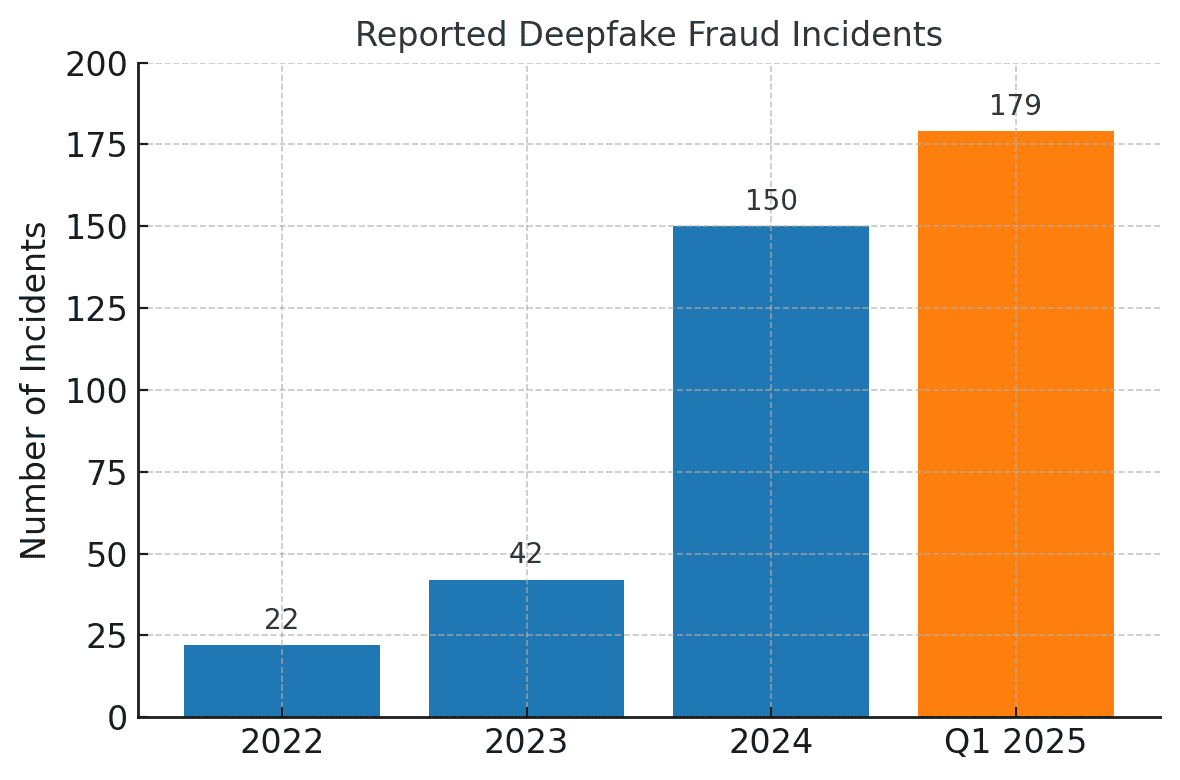

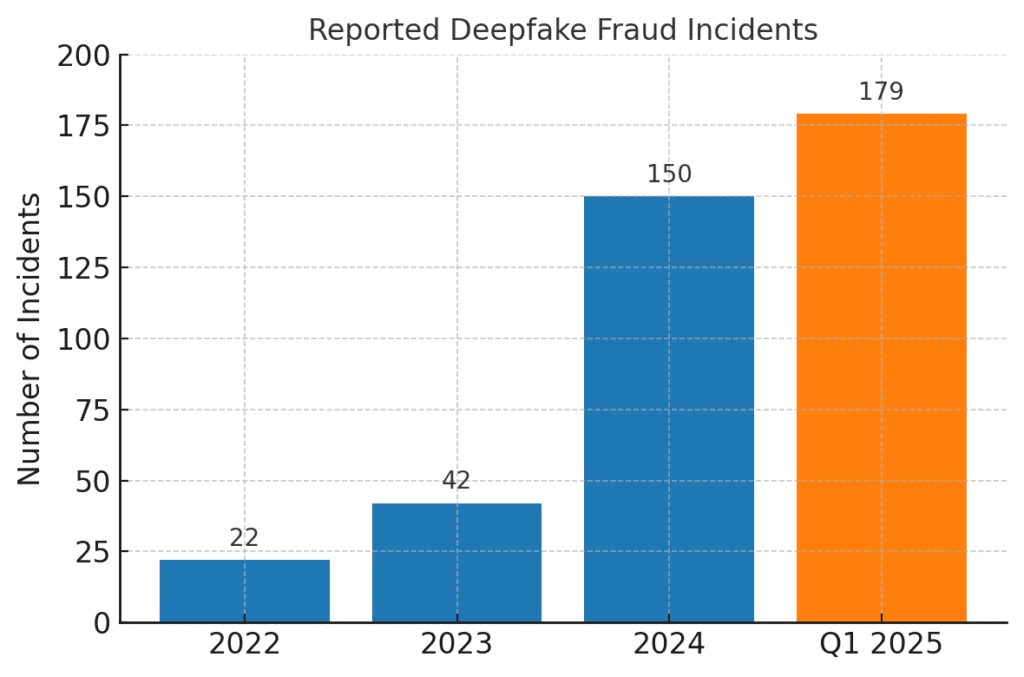

Кількість випадків шахрайства, пов'язаного з глибокими підробками, стрімко зросла. У 2022 році було зафіксовано лише 22 випадки шахрайства з використанням глибоких фейків, у 2023 році - 42, а до 2024 року кількість інцидентів зросла до 150. І це лише за перший квартал 2025 року, 179 випадків глибокого шахрайства було зареєстровано - що перевищує загальну кількість за весь 2024 рік[16][17].

Нещодавні галузеві аналізи підтверджують ці тенденції. В одному зі звітів зазначається, що 700% Збільшення кількості інцидентів з глибокими фейками для фінтех-компаній у 2023 році[18]. Ще більш вражаючим є те, що в Північній Америці спостерігається 1,740% Сплеск випадків шахрайства з використанням підроблених документів між 2022 та 2023 роками[19]. Фінансові злочинці швидко впроваджують ці інструменти, тому що вони працюють - багато банків і жертв ще не готові до виявлення обману, створеного штучним інтелектом.

Вплив та виклики для фінансових установ

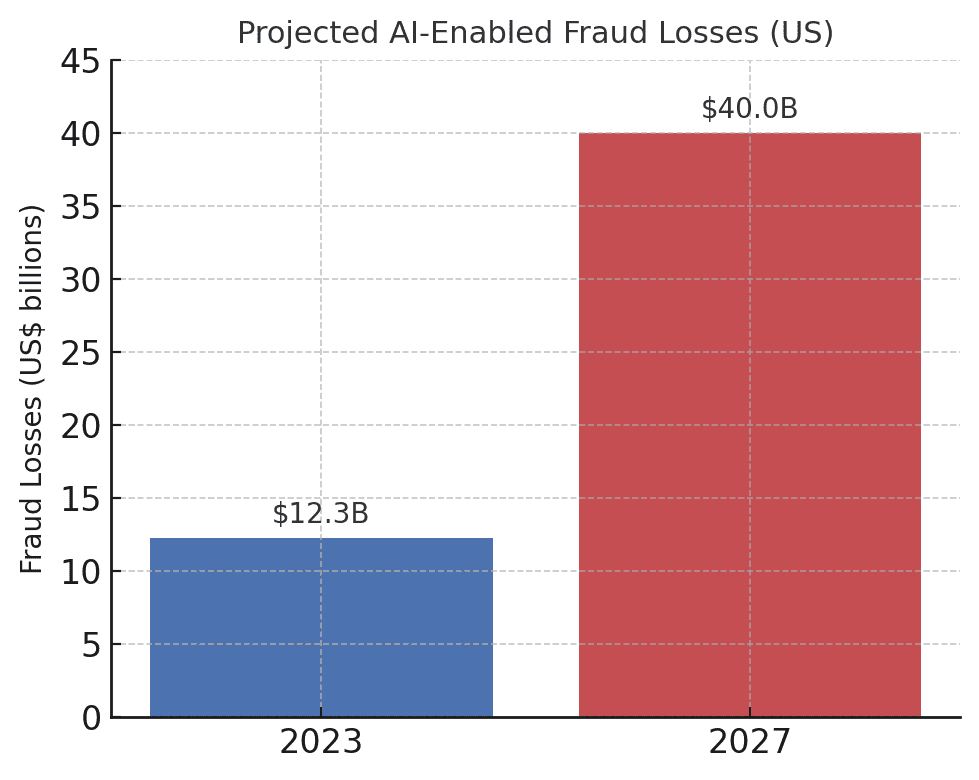

Зростання шахрайства, керованого штучним інтелектом, загрожує значний вплив на фінансові установи, їхніх клієнтів та фінансову систему в цілому. Найбезпосередніший вплив - це грошові втрати. Галузеві прогнози передбачають, що до 2027 року, збитки від шахрайства, спричинені генеративним ШІ, можуть сягнути 1 трлн 7 трлн 40 млрд доларів у СШАпорівняно з $12,3 млрд у 2023 році[20]. Це більш ніж триразове збільшення (a 32% CAGR) відображає, наскільки швидко зростає ризик шахрайства в доларовому еквіваленті.

Прогнозовані збитки від шахрайства з використанням штучного інтелекту стрімко зростають. За оцінками Deloitte, збитки від фінансового шахрайства в США, пов'язаного з генеративним ШІ, зростуть з $12,3 млрд у 2023 році до $40 млрд до 2027 року[20].

Окрім сировинних втрат, існують репутаційні та витрати на довіру. Споживачі очікують, що їхні банки захистять їх, але шахрайство з використанням штучного інтелекту підриває довіру до цифрових каналів. Наприклад, якщо клієнт стає жертвою переконливої фальшивої афери (наприклад, фальшивого відеодзвінка від банкіра), він може звинуватити банк у недостатній безпеці. Довіра громадськості у верифікації голосу, електронних листах і навіть відеоконференціях може розмитися, якщо "те, що ви бачите/чуєте" більше не можна вважати реальним[21]. Згідно з опитуваннями, 85% фінансових фахівців у США/Великобританії вважають шахрайство з глибокими підробками "екзистенційною" загрозою для безпеки їхніх організацій.[22]. Більше половини компаній на цих ринках повідомляють, що стали мішенню для шахрайства з використанням глибоко законспірованих фейків, і це викликає тривогу 43% з тих, кого атакували, визнали, що атака була успішною в тому, щоб обдурити їх.[23]. Кожен успішний інцидент не лише завдає фінансових збитків, але й підриває довіру клієнтів до установи.

Фінансові фірми також борються з операційні та комплаєнс-виклики від шахрайства з використанням штучного інтелекту. Команди по боротьбі з шахрайством стикаються з різким збільшенням кількості сповіщень та інцидентів, що призводить до перенапруження ресурсів для проведення розслідувань. Існуючі моделі виявлення шахрайства (багато з яких покладаються на правила або застарілі методи машинного навчання) можуть не розпізнавати синтезований штучним інтелектом контент, який виглядає легітимним. Насправді, найсучасніші системи виявлення глибоких підробок, розроблені в лабораторіях, знижують свою точність майже на 50%, коли стикаються з такими факторами реальні фейки в реальному світі в дикій природі[24]. Людський персонал не набагато краще - дослідження показують, що люди можуть помітити лише високоякісні глибоко підроблені відео навколо 55%-60% того часунавряд чи краще, ніж випадковість[25]. Це свідчить про те, що без нових інструментів банки пропускатимуть значну частину спроб шахрайства за допомогою ШІ.

Існує також регуляторний вимір. Регулятори та правоохоронні органи добре усвідомлюють ризики (про що свідчить попередження FinCEN) і очікують, що фінансові установи будуть адаптуватися. В епоху ШІ банки можуть зіткнутися з більш жорсткими вимогами щодо верифікації клієнтів та повідомлень про шахрайство. Наприклад, якщо співробітника банку обманом змусять схвалити переказ на суму $10 мільйонів, регулятори можуть ретельно вивчити систему контролю та процеси належної перевірки банку. У цьому випадку регуляторні органи можуть ретельніше перевіряти контроль і процеси належної перевірки банку. Закон про банківську таємницю тепер чітко включає повідомлення про підозри у кіберзлочинах та діяльність, пов'язану з глибокими фейками[26][4]Це означає, що банки повинні навчити персонал розпізнавати ознаки шахрайства, згенеровані штучним інтелектом, і повідомляти про них у звітах про підозрілу активність (SAR). Відставання від методів шахрайства з використанням штучного інтелекту може призвести до порушення нормативних вимог або юридичної відповідальності, якщо клієнти або контрагенти стверджуватимуть, що банк не зробив достатньо для запобігання передбачуваним шахрайствам із застосуванням штучного інтелекту.

Мабуть, найбільшим викликом є асиметричний характер цієї нової загрози. Генеративний ШІ значно знижує вартість і бар'єр навичок для зловмисників, водночас експоненціально збільшуючи обсяг і реалістичність атак. Один вірусний фейковий слух або переконливий дзвінок клону голосу може звести нанівець мільйони доларів інвестицій в аутентифікацію. Тим часом захисники повинні перевіряти автентичність кожної транзакції та взаємодії, що є набагато складнішим завданням. Це справжня гонка озброєнь: ШІ дає шахраям самооновлюваний інструментарій для обходу системи безпеки, що вимагає від банків також постійно оновлювати свій захист[15][27]. Багато фінансових установ визнають, що вони недостатньо підготовлені понад 80% компаній не мають офіційного плану реагування на глибокі фейкові атакиі більше половини не проводили жодних тренінгів для працівників щодо ризиків глибокого фейку[28][29]. Цей пробіл у готовності означає, що організації наразі є вразливими, але він також вказує на те, де необхідно діяти.

Вартий уваги і протверезливий показник походить з нещодавнього галузевого звіту: 42.51TP6Т спроб шахрайства у фінансовому секторі зараз включають ту чи іншу форму ШІ[30]. Іншими словами, майже половина шахрайських атак, з якими стикаються банки, мають АІ-компонент - чи то згенерований АІ документ, синтезований голос або машинне фішингове повідомлення. Ця статистика підкреслює, що штучний інтелект - це не гіпотетична загроза майбутнього, він вже тут, змушуючи фінансові установи адаптуватися або зазнавати все більших збитків.

Захист від шахрайства з використанням штучного інтелекту: Стратегії та рішення

Протидія шахрайству, керованому штучним інтелектом, вимагає еволюції стратегій запобігання шахрайству. Традиційні підходи (наприклад, ручна перевірка або статичні правила) не підходять для боротьби з шахрайством, що змінює форму за допомогою ШІ. Замість цього банки повинні використовувати технології, навчання та командна робота щоб переломити ситуацію. Нижче ми окреслюємо ключові стратегії та нові рішення:

- Використовуйте ШІ для боротьби зі штучним інтелектом (розширені інструменти виявлення): Фінансові установи все частіше звертаються до Рішення для виявлення на основі штучного інтелекту для виявлення контенту, згенерованого штучним інтелектом, і аномалій. По суті, потрібно боротися з вогнем вогнем. Нові корпоративні інструменти, такі як TruthScan пропонують мультимодальне виявлення ШІ в тексті, зображеннях, голосі та відео, щоб допомогти автентифікувати контент у режимі реального часу.[31]. Наприклад, банки можуть використовувати детектори тексту зі штучним інтелектом для сканування вхідних повідомлень (електронних листів, повідомлень у чаті) на наявність ознак мови, згенерованої штучним інтелектом, що може свідчити про фішинговий лист або фальшивий запит клієнта. Система виявлення тексту зі штучним інтелектом TruthScan може ідентифікувати вміст, написаний штучним інтелектом, у таких моделях, як GPT-4, за допомогою 99%+ точністьі навіть визначити, які речення, ймовірно, згенеровані штучним інтелектом[32][33]. Аналогічно, інструменти ШІ-криміналістики зображень можуть перевіряти документи та зображення; а ШІ-детектор зображень може виявити, що подане водійське посвідчення або рахунок за комунальні послуги було створено цифровим способом або підроблено, порівнюючи його з відомими шаблонами зображень, згенерованих штучним інтелектом[34]. Для аудіозагроз банки починають використовувати детектори голосової фальсифікації - рішення, які аналізують аудіо дзвінків на наявність акустичних відбитків синтетичного мовлення. Наприклад, детектор голосу зі штучним інтелектом TruthScan слухає ознаки клонування голосу і може перевірити автентичність спікера щоб запобігти дзвінкам від самозванців[35]. Інтегруючи ці детектори через API у свої робочі процеси, фінансові установи можуть автоматично перевіряти вміст штучного інтелекту на тлі транзакцій і взаємодій. Це забезпечує додатковий рівень захисту, який працює зі швидкістю машини, вловлюючи те, що можуть пропустити людські очі/вуха.

- Впровадити багатофакторну та позасмугову перевірку: Оскільки ШІ ускладнює довіру до голосу чи зображення, банкам слід більше покладатися на методи перевірки, які ШІ не може легко підробити. Це включає в себе багатофакторну автентифікацію (MFA) з використанням захищених каналів. Наприклад, якщо запит на банківський переказ надходить через електронну пошту або відеодзвінок, потрібен другий фактор, такий як одноразовий пароль, надісланий на відомий мобільний пристрій заявника, або зворотний дзвінок на перевірений номер телефону, що є в базі даних. Деякі банки додають перевірку "живості" для транзакцій з високим ризиком - наприклад, просять клієнта зробити селфі в реальному часі з певним жестом або словом, яке складніше відтворити за допомогою підробленого відео. Біометричні автентифікатори можна вдосконалити заходами проти підробок (наприклад, скануванням глибини 3D-обличчя або моніторингом тонких рухів очей, які часто не вдається імітувати підробленим відео).[27]). Ключовим моментом є уникнення окремих точок відмови. Навіть якщо штучний інтелект може обдурити один канал (скажімо, голосову верифікацію), скоординована позасмугова перевірка або біометричний тест може забезпечити необхідний виклик, щоб виявити шахрайство. Принципи нульової довіри слід застосовувати: розглядати будь-які непрохані або несподівані вказівки (навіть від "відомого" керівника або клієнта) як підозрілі, доки вони не будуть підтверджені через незалежний канал.

- Навчання співробітників та обізнаність про шахрайство: Технології самі по собі не є панацеєю від усіх бід, особливо якщо врахувати, що шахраї обирають найслабшу ланку, якою часто є людська довіра. Фінансові установи повинні інвестувати в регулярні тренінги для команд із запобігання шахрайству та персоналу, який працює з клієнтами, щодо шахрайства з використанням штучного інтелекту. Співробітники повинні навчитися розпізнавати червоні прапорці глибоких підробок і соціальної інженерії. Це може включати в себе навчання щодо тонких аномалій (наприклад, проблеми з синхронізацією голосу під час відеодзвінка або аудіо, яке містить неприродні інтонації або занадто низький рівень фонового шуму - потенційні ознаки синтетичного голосу). Заохочуйте культуру перевіркаСпівробітники повинні мати право призупинити підозрілу транзакцію або запит і перевірити їх самостійно, навіть якщо здається, що вони йдуть від генерального директора. Прикладом може слугувати справа Спроба підробки голосу генерального директора Ferrari є повчальним - керівник розкрив обман, лише поставивши особисте запитання, на яке самозванець не зміг відповісти[36]. Корисними також можуть бути симуляції фішингу/підробки. Подібно до того, як компанії проводять симуляції фішингу для навчання персоналу, вони можуть імітувати фальшиву голосову пошту або фальшиву відеозустріч і перевірити, чи виявляють це співробітники. Це формує м'язову пам'ять для протистояння реальним атакам. Враховуючи, що понад 50% компаній не мають протоколів реагування на глибокі фейки та не мають достатнього рівня підготовки[29]На думку експертів, запровадження таких програм є легким шляхом до підвищення стійкості.

- Аналітика шахрайства та виявлення аномалій: Банки повинні продовжувати використовувати штучний інтелект для захисту від шахрайства, вдосконалюючи свою аналітику шахрайства. Сучасні системи виявлення шахрайства використовують моделі машинного навчання, які аналізують транзакції в режимі реального часу і виявляють аномалії або шаблони з високим рівнем ризику. Ці моделі потрібно оновлювати, щоб вони включали сигнали, які вказують на шахрайство, кероване ШІ. Наприклад, модель ML можна навчити виявляти метадані або поведінкові шаблони, пов'язані з захопленням акаунтів ботами (наприклад, неймовірно швидке заповнення форм або абсолютно однаковий набір тексту, що свідчить про використання автоматизованого сценарію). Мовні моделі можна використовувати для аналізу вмісту повідомлень і позначки, якщо електронний лист від постачальника звуки, згенеровані штучним інтелектом або надто шаблонними (у поєднанні зі згаданим вище розпізнаванням текстів за допомогою ШІ). Такі банки, як JPMorgan, почали використовувати великі мовні моделі у своїх внутрішніх комунікаціях, щоб виявляти фрази або контексти, які можуть свідчити про спробу соціальної інженерії[37]. Платіжні мережі, такі як Mastercard, сканують величезні масиви даних (мільярди транзакцій) за допомогою ШІ, щоб виявити шахрайські транзакції, які традиційні правила пропустили б[38]. Висновок полягає в тому, що оборонний ШІ має бути настільки ж інноваційним, як і наступальний ШІ. Фірмам слід розглянути можливість розробки або придбання моделей ШІ спеціально для виявлення глибоко підробленого контенту, синтетичних ідентифікаторів і генеративних шаблонів атак. Важливо, щоб ці моделі постійно проходили перепідготовку на останніх прикладах шахрайства зі застосуванням ШІ (така практика називається онлайн-навчанням або федеративним навчанням), щоб вони не відставали від тактики злочинців, яка швидко розвивається.[39][40].

- Співпраця та обмін інформацією: Боротьба з шахрайством за допомогою штучного інтелекту вимагатиме співпраці як всередині установ, так і між ними. Розрізнені зусилля менш ефективні проти загрози, яка виходить за межі організації. Команди із запобігання шахрайству, кібербезпеки та ІТ потрібно працювати пліч-о-пліч - наприклад, команди безпеки можуть впровадити глибоке виявлення підробок в інструментах відеоконференцій, в той час як команди по боротьбі з шахрайством інтегрують сканування контенту в моніторинг транзакцій. На більш широкому рівні банки повинні брати участь у галузевих групах, таких як Центр обміну та аналізу інформації про фінансові послуги (FS-ISAC), щоб обмінюватися розвідданими про нові схеми шахрайства зі штучним інтелектом.[41]. Якщо один банк виявляє новий вектор фальшивих атак, обмін цією інформацією може допомогти іншим закрити прогалину до того, як вони будуть вражені. Спільні навчання або симуляції "червоної команди" зі сценаріями, що включають ШІ (наприклад, фальшиве шахрайство з керівником або обхід перевірки ідентифікації за допомогою ШІ), можуть проводитися через галузеві консорціуми або за підтримки регуляторів. Регулятори самі зосереджують увагу на ризиках, пов'язаних зі штучним інтелектом, тому проактивна співпраця з ними є розумним кроком. Беручи участь у розробці стандартів і рекомендацій щодо використання ШІ, банки можуть допомогти сформувати безпечнішу екосистему. Зрештою, оскільки загроза одному банку - загроза для всіх у цьому просторі[42]підхід до колективного захисту посилить здатність кожного виявляти та стримувати шахрайство з використанням штучного інтелекту.

- Просвітницька робота з клієнтами та заходи довіри: Нарешті, фінансові установи не повинні забувати про роль обізнаності клієнтів. Зважаючи на підробки та шахрайство з використанням штучного інтелекту, спрямоване на широкі верстви населення (наприклад, фальшиві голоси в шахрайських схемах з бабусями і дідусями або фальшиві чати "технічної підтримки", згенеровані штучним інтелектом), банки можуть допомогти проінформувати клієнтів про ці небезпеки. Багато банків вже надсилають сповіщення про фішинг; вони можуть розширити їх, включивши в них згадки про клонування голосу за допомогою ШІ та підроблені відео, а також поради, як перевірити запити. Деякі прогресивні організації надсилають push-повідомлення або попередження у своїх додатках, якщо поширюється відоме шахрайство (наприклад, "Обережно: шахраї можуть використовувати голосові клони членів сім'ї, які вимагають гроші")[43]. Не запобігаючи безпосередньо атакам, освіта може знизити відсоток успішних атак і зміцнити репутацію банку як партнера у сфері безпеки. Більше того, банки, які інвестують у найсучасніші засоби запобігання шахрайству, повинні наголошувати на цьому клієнтам як на диференціатор - Наприклад, інформування клієнтів про те, що всі відеодзвінки або подані документи скануються штучним інтелектом для перевірки автентичності (без розкриття секретних методів), може запевнити клієнтів у тому, що банк використовує всі доступні інструменти для їхнього захисту. Збереження цифрової довіри матиме вирішальне значення для повного використання банками переваг штучного інтелекту в послугах, тому прозорість і клієнтоорієнтовані заходи безпеки є частиною комплексного захисту.

Роль служб виявлення контенту зі штучним інтелектом

Наріжним каменем інструментарію боротьби з шахрайством в епоху ШІ є використання Сервіси для виявлення контенту зі штучним інтелектом. Ці сервіси спеціалізуються на виявленні "відбитків пальців" контенту, створеного штучним інтелектом, який може прослизнути повз людей-рецензентів. TruthScan - один із таких провайдерів, що пропонує рішення корпоративного рівня AI Detection Suite що охоплюють різні типи контенту. Фінансові установи можуть інтегрувати ці інструменти для автоматичної перевірки на наявність ознак підробки та шахрайства:

- Перевірка документів і зображень: Платформа TruthScan дозволяє банкам тестувати фінансові документи на наявність шахрайства, спричиненого ШІ, в режимі реального часу[44]. Це означає, що коли відкривається новий рахунок або надходить заявка на кредит з фотографією посвідчення особи та квитанцією про оплату, система може миттєво проаналізувати ці зображення на наявність ознак синтетичного створення або фальсифікації. З точністю понад 99%[45]ШІ-детектор зображень може виявляти фальшиві зображення посвідчень особи або підроблені PDF-файли, які людина може сприйняти за чисту монету. Цей тип перевірка автентичності документів має вирішальне значення для припинення шахрайства із синтетичними ідентифікаційними даними ще до відкриття рахунків.

- Моніторинг транзакцій в режимі реального часу: Розгортаючи API-інтеграції, TruthScan може підключатися до банківської обробки транзакцій і позначати аномалії в в реальному часі. Якщо інструкція надходить електронною поштою, яка здається підозрілою, детектор шахрайства може проаналізувати вміст повідомлення і виявити, чи не була вона написана моделлю штучного інтелекту, яка намагається видати себе за продавця або керівника.[46]. Так само, як і в Детектор штучного інтелекту в реальному часі можуть відстежувати живі комунікації (наприклад, чати або платформи для спільної роботи), щоб миттєво сповіщати, якщо, скажімо, під час важливої зустрічі виявлено фальшиве відео з боку самозванця[47][48]. Постійний моніторинг з миттєвими сповіщеннями та автоматизованим реагуванням допомагає зменшити вікно, в якому шахрайство може відбутися непоміченим.

- Захист від підробок голосу та відео: Для колл-центрів і менеджерів по роботі з клієнтами, які використовують TruthScan ШІ-детектор голосу додає додатковий рівень безпеки. Якщо шахрай дзвонить від імені клієнта, використовуючи голосовий клон, система може проаналізувати аудіозапис дзвінка і відмітити, чи містить він елементи, синтезовані штучним інтелектом (наприклад, відсутні природні мікропаузи або артефакти в звукових хвилях).[35]. Що стосується відео, то Детектор підробок застосовує алгоритми комп'ютерного зору до відеокадрів, щоб виявити невідповідності - неприродні рухи обличчя, дивне освітлення або невідповідну синхронізацію губ, - які викривають фейк.[49][50]. Перевіряючи справжність голосів та облич під час ключових взаємодій, банки можуть запобігти спробам самозванців обдурити своїх співробітників. Ці інструменти діють як високотехнологічний детектор брехні для цифрового контенту, працюючи непомітно у фоновому режимі.

Варто зазначити, що розгортання такої технології виявлення не є панацеєю від усіх бід; її слід відкалібрувати і налаштувати відповідно до робочих процесів установи. Необхідно контролювати хибні спрацьовування (наприклад, детектор тексту зі штучним інтелектом може позначати легітимні повідомлення на основі шаблонів як підозрілі, доки не навчиться розрізняти їх). Однак при правильній інтеграції ці інструменти значно покращують здатність організації виявляти шахрайський контент до того, як він завдасть шкоди. Вони також створюють аудиторські сліди та аналітичні звіти, корисні для дотримання нормативних вимог і постійного вдосконалення моделей протидії шахрайству.

Ефективність інструментів виявлення ШІ залежить від постійні оновлення. Так само, як антивірусне програмне забезпечення потребує нових сигнатур для нових вірусів, детектори ШІ потребують перенавчання новітнім методам глибокої підробки та моделям ШІ. Такі постачальники, як TruthScan, оновлюють свої алгоритми для роботи з новими генеративними моделями і тактиками ухилення, зберігаючи високу точність навіть у міру розвитку ШІ.[51]. Це знімає навантаження з власних команд і гарантує, що банки не ведуть вчорашню війну, в той час як злочинці переходять до нових трюків зі штучним інтелектом.

Висновок

Індустрія фінансових послуг стоїть на роздоріжжі в боротьбі з шахрайством. З одного боку, злочинці швидко освоюють генеративний ШІ, щоб запускати шахрайські схеми, які є більш переконливими і широкомасштабними, ніж будь-коли. З іншого боку, банки та борці з шахрайством мають у своєму розпорядженні все більший арсенал засобів захисту на основі штучного інтелекту. Процвітатимуть ті установи, які розпізнавати новий ландшафт загроз і реагувати на них з однаковою винахідливістю. Це означає інвестиції в передові засоби виявлення, інтеграцію багаторівневих процесів перевірки, навчання як персоналу, так і клієнтів, а також виховання культури пильності та адаптації.

Шахрайство з використанням штучного інтелекту є мішенню, що швидко змінюється: шахрайство, яке сьогодні обдурило компанію, завтра може протистояти новим методам виявлення, але вже наступного тижня шахраї змінять свої методи. Таким чином, "галузевий стандарт" стратегії запобігання шахрайству у 2025 році - це стратегія, яка наголошує на гнучкості та постійному вдосконаленні. Фінансові організації повинні розглядати свої системи захисту від шахрайства як живі істоти, що навчаються які розвиваються в тандемі зі злочинною тактикою. Налагодження партнерських відносин з постачальниками технологій - це розумний шлях до розбудови цих можливостей. Наприклад, співпраця зі спеціалізованими фірмами, такими як TruthScan (яка пропонує рішення для банківської та фінансової сфери), може прискорити здатність установи запобігати шахрайству з використанням штучного інтелекту, зберігаючи при цьому відповідність нормативним вимогам і довіру клієнтів[52].

Зрештою, захист від шахрайства, керованого штучним інтелектом, - це не просто технологія, це збереження фундаментальних довіра що лежить в основі фінансів. Клієнтам потрібна впевненість у тому, що їхній банк може відрізнити справжню транзакцію від підробленої, а справжнього клієнта від самозванця зі штучним інтелектом. Розгортаючи найсучасніші інструменти виявлення ШІ, посилюючи протоколи верифікації та випереджаючи нові загрози, фінансові компанії можуть підтримувати цю довіру. Попереду, безсумнівно, буде ще більше спроб шахрайських інновацій з боку зловмисників, але завдяки готовності та правильним інвестиціям банки можуть гарантувати, що ШІ стає більше перевагою, ніж загрозою у сфері запобігання шахрайству. Це цілком досяжна мета: ті самі технології штучного інтелекту, які загрожують підривом, можуть бути використані для захисту цілісності нашої фінансової системи. Настав час для команд із запобігання шахрайству та керівників вищої ланки діяти рішуче, використання передових рішень і стратегій, щоб перехитрити шахраїв та забезпечити майбутнє цифрових фінансів.

Джерела: Всюди наводяться посилання на останні галузеві звіти, регуляторні попередження та технічні документи (Deloitte[20][18], Всесвітній економічний форум[19][24]FinCEN Казначейства США[3][4]Федеральна резервна система[13], Keepnet Labs[16][30]та ін.), щоб надати дані та приклади. Усі дані та приклади наводяться у тексті, щоб читачі могли дослідити їх далі.

[1] [9] [10] [14] [15] [18] [20] [37] [38] [42] [43] Ризик шахрайства з використанням штучного інтелекту та фальшивих банківських послуг | Deloitte Insights

[2] [5] [6] [19] [21] [24] [25] [27] [36] [39] [40] [41] Виявлення небезпечного ШІ має важливе значення в епоху глибоких фейків | Всесвітній економічний форум

[3] [4] [26] FinCEN оприлюднив попередження про шахрайські схеми, пов'язані з використанням фальшивих ЗМІ, націлених на фінансові установи | FinCEN.gov

[7] [8] FraudGPT і GenAI: як шахраї використовуватимуть АІ далі? | Сплав

[11] Шахрайство з синтетичними ідентичностями: Як штучний інтелект змінює правила гри - Федеральний резервний банк Бостона

[12] [13] Генеративний штучний інтелект збільшує загрози шахрайства із синтетичними ідентифікаційними даними

[16] [17] [22] [23] [28] [29] [30] Фейкова статистика та тенденції 2025 року | Ключові дані та ідеї - Keepnet

[31] [34] [35] [46] [47] [48] TruthScan - виявлення та захист контенту за допомогою штучного інтелекту на підприємстві

[32] [33] [51] Детектор штучного інтелекту: Розпізнавання АІ тексту корпоративного рівня - TruthScan

[44] [45] [52] Виявлення шахрайства з використанням банківського AI | CRO-рішення | TruthScan

[49] [50] Deepfake Detector - виявлення фейкових відео та відео зі штучним інтелектом - TruthScan