Sadece birkaç yıl önce, birinin sesini taklit etmek için profesyonel bir stüdyoya ve çok fazla teknik beceriye ihtiyacınız vardı.

Artık internet bağlantısı ve biraz boş zamanı olan herkes, bir dakikadan kısa bir sürede herhangi birinin sesinin dijital bir klonunu oluşturabilir.

Bu saldırılar için gerekli araçlar her geçen gün daha ucuz ve herkes için daha erişilebilir hale geliyor. Ve pek çok insan hayatını sosyal medyada paylaştığı için, bir dolandırıcının ihtiyaç duyduğu sesi bulması çok kolay.

Bu makalede, ses dolandırıcılığının gerçek dünyadaki kötü şöhretli örneklerinden bazılarını ele alacağız. Ayrıca size bu tehditlere zamanında son verecek bir çözümü de tanıtacağız.

Önemli Çıkarımlar

- Modern yapay zekanın üç saniye gibi kısa bir kaynak ses kullanarak 85% doğru ses klonu üretebilmesiyle, sesli deepfake dolandırıcılık girişimleri son yıllarda 2,137%'nin üzerinde artış gösterdi.

- Gerçek dünyadaki kötü şöhretli saldırılar arasında, dolandırıcıların bir çalışanı kandırarak $25,6 milyon transfer etmesini sağlamak için bir CFO'nun deepfake video ve sesini kullandığı 2024 Arup mühendislik firması soygunu yer alıyor.

- Kurumsal hırsızlığın ötesinde, ses taklitleri adam kaçırma dolandırıcılığı yoluyla aileler için ciddi duygusal riskler oluşturmakta ve bankalar ve diğer yüksek güvenlikli uygulamalar tarafından kullanılan geleneksel biyometrik güvenlik sistemlerini atlatabilmektedir.

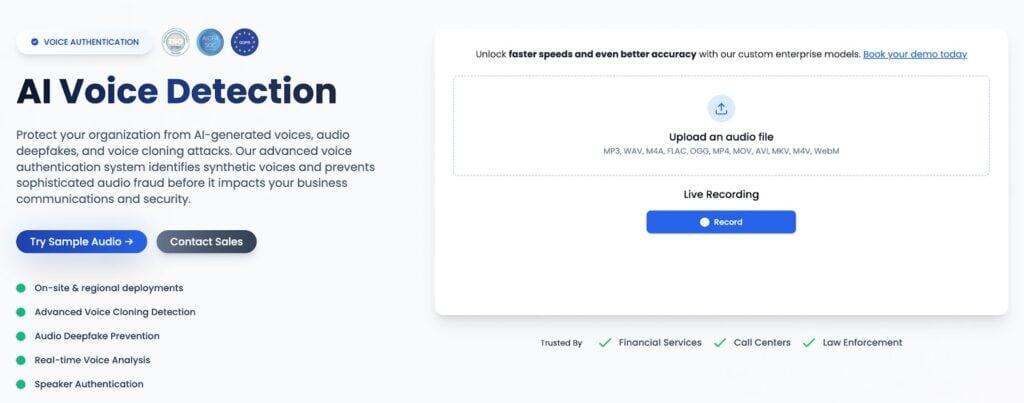

- Kuruluşlar, büyük transferler için çok kişili onay protokolleri uygulayarak ve akustik parmak izlerini gerçek zamanlı olarak analiz etmek için TruthScan gibi yapay zeka ses algılayıcıları kullanarak tek başına insan doğrulamasının ötesine geçmek zorunda kalıyor.

- TruthScan, ElevenLabs ve Murf gibi platformlardan gelen sentetik konuşma yapaylıklarını tüm ana ses ve video formatlarında 99%'den fazla doğrulukla tanımlayarak kurumsal etkileşimleri güvence altına alır.

Sesli Deepfake Saldırıları Nedir?

Deepfake ses, bir kişinin sesinin dijital olarak taklit edilmesidir. Saldırgan, bir kişinin ses kaydından nasıl konuştuğuna dair her küçük ayrıntıyı analiz edebilen bir yazılım kullanır.

Sesi klonlamak için yazılım sesteki kalıpları fark etmeye çalışır. Temel olarak, perde, ton, birinin cümleler arasında nefes alma şekli vb. gibi şeyler yazılım tarafından dikkate alınır.

Bu kalıpları öğrendikten sonra, saldırgan o sesle her şeyi söyletebilir.

Yapay Zeka Dolandırıcılığı Konusunda Bir Daha Asla Endişelenmeyin. TruthScan Sana yardım edebilirim:

- Üretilen yapay zekayı tespit edin görüntüler, metin, ses ve video.

- Kaçının Yapay zeka kaynaklı büyük dolandırıcılık.

- En değerli varlıklarınızı koruyun hassas kurumsal varlıklar.

Tehlikeli olan şey, sesli deepfake oluşturma araçlarının kolayca erişilebilir olmasıdır. Ve çoğu herhangi bir kurulum gerektirmez. Web siteleri şeklinde çevrimiçi olarak mevcutturlar.

Tek yapmanız gereken onlara birkaç dolar vermek ve sesleri klonlamaya başlamak. Biraz daha araştırırsanız, sesleri ücretsiz olarak klonlamanıza izin veren araçlar bile bulabilirsiniz.

Bu yeni ve kolay erişilebilir teknoloji, ses dolandırıcılığında ciddi bir artışa yol açtı.

Dolandırıcılar, bir kişiyi klonlamak için yalnızca sosyal medyadan veya başka bir kamusal kanaldan elde edebilecekleri küçük bir ses parçasına ihtiyaç duyarlar.

Daha sonra klonlanmış sesi canlı telefon görüşmeleri, görüntülü toplantılar, sesli notlar, duyurular vb. durumlarda bir kişiyi taklit etmek için kullanabilirler.

Bunlar sadece ses taklidi saldırılarının varsayımsal kullanım durumları değildir. Bunlar zaten yaşandı. Kötü şöhretli ses taklidi saldırılarından bazılarını daha sonra ele alacağız.

Sesli Deepfake Saldırılarının Potansiyel Riskleri

Deepfake sesini duyduğunuzda, bir ünlünün hiç söylemediği şeyleri söylediği komik bir video aklınıza gelmiş olabilir.

Ancak klonlanmış sesin görünüşte zararsız olan bu kullanımı, ilgili taraflara ciddi zararlar verebilir. Riskler hakkında konuşalım.

İşletmeler için Mali Yıkım

Bir ses deepfake'i bir şirketin itibarını sonsuza kadar mahvedebilir. Ayrıca dakikalar içinde büyük miktarlarda para çalma gücüne de sahiptir.

Nasıl olur diye sorabilirsiniz? Dolandırıcılar, bir şirketin patronunun sesini klonlayabilir ve bunu çalışanları aramak ve bir hesaba para aktarmak gibi yapılmaması gereken şeyleri yapmalarını sağlamak için kullanabilir.

Bu sadece bir örnek. Olasılıklar sonsuzdur.

Güvenlik Sistemlerini Atlatmak

Sesiniz, başka hiç kimsenin sahip olmaması gereken bir biyometriktir. Bunun nedeni, özellikle bankacılık uygulamaları olmak üzere birçok uygulamanıza giriş yapmak için şifre olarak kullanmanızdır.

Bu uygulamalar yetkisiz erişimi önlemek için yerleşik bir otomatik ses doğrulama sistemine sahip olsa da, iyi bir ses klonunun hala onları kandırma şansı vardır.

Aileler Üzerindeki Duygusal Etkiler

Ses dolandırıcıları için belki de en kolay hedefler ailedeki yaşlı kişilerdir. Örneğin ebeveynler ve büyükanne ve büyükbabalar.

Dolandırıcılar, diyelim ki bir anneyi arayabilir ve kaçırıldığını söyleyerek yardım için ağlayan kızının sesini dinletebilirler.

İşyerinde Güvenin Aşınması

Sesli deepfake saldırıları sağlıklı bir işyerine olan güveni de zedeler.

Çalışanlar, klonlanmış bir sesle riskli şeyler yapmalarını emreden bir dolandırıcı olmadığından emin olmak için yöneticilerinden gelen telefonları iki kez kontrol etmek zorunda kalacaklar.

O halde manuel olarak iki kez kontrol etmeyecekseniz seçenekleriniz nelerdir? Az önce bahsettiğimiz tüm riskler, otomatik bir deepfake saldırısı önleme ihtiyacına işaret ediyor.

Neyse ki artık TruthScan'in de aralarında bulunduğu deepfake yapay zeka ses tespit araçlarımız var.

TruthScan ile sahtekarlığı ve taklitçiliği önleyin Yapay Zeka Ses Dedektörü.

Sesli Deepfake Saldırılarına Gerçek Dünyadan Örnekler

Yapay zeka sayesinde artık gözlerimizin gördüğüne ya da kulaklarımızın duyduğuna güvenemeyeceğimiz bir noktaya ulaştık. Yapay zeka artık gerçekçi resimler ve videolar yaratabiliyor. Aynı şey ses için de geçerli.

Deepfake ses dolandırıcılığına düşen insanların hikayelerini zaten duymuş olabilirsiniz. Zaman zaman haberlerde ve sosyal medyada da ortaya çıkmaya devam ediyor. Bunlardan bazılarına akıl sır erdirmek zor.

Size en kötü şöhretli ses sahteciliği saldırılarından bazılarını anlatalım, böylece bunların ne kadar akıllıca uygulandığına dair iyi bir fikir edinebilirsiniz.

Aslında Hiç Gerçekleşmeyen $25 Milyon Sanal Toplantı

Bu deepfake saldırısı muhtemelen en çok rapor edilen saldırıdır.

Bu Kurban, Arup adlı bir İngiliz mühendislik firmasıydı, Ancak dolandırıcılık Hong Kong ofisinden kaynaklanmıştır.

Şirketin finans departmanında çalışan bir işçi, şirketin İngiltere'deki CFO'sundan bir e-posta aldığında 2024 yılının başlarıydı. E-postada işçi, CFO tarafından bazı banka hesaplarına gizli para transferleri yapması için yönlendiriliyordu.

İlk başta, çalışan aslında oldukça şüpheliydi çünkü talep biraz garip geldi ve bunun bir kimlik avı dolandırıcılığı olabileceğini düşündü.

Ancak daha sonra çalışan bir video konferans görüşmesine davet edildi. Çalışan görüşmeye katıldığında, tam olarak CFO'ya ve diğer birkaç üst düzey meslektaşına benzeyen bir şey gördü.

Herkes tam olması gerektiği gibi görünüyor ve ses çıkarıyordu. Ayrıca daha gerçekçi görünmesi için birbirleriyle konuşuyorlardı.

Bu, finans departmanı çalışanının tüm şüphelerini tamamen ortadan kaldırdı ve daha sonra 15 işlemle birkaç farklı Hong Kong banka hesabına $25.6 milyondan (~HK$200 milyon) fazla para gönderdi.

Daha sonra tüm bu kurgunun derin bir sahtekarlık olduğu anlaşıldı. Arup çalışanı dışında görüşmedeki hiç kimse göründüğü gibi değildi. Dolandırıcılar, şirketin CFO'su ve üst düzey çalışanlarının yüksek kaliteli ses ve görüntü klonlarını kullanarak saldırıyı mükemmel bir şekilde koordine etmişlerdi.

İtalyan Bakan ve Moda İkonları

Bu da 2024 yılında gerçekleşti. A Sahte İtalyan Savunma Bakanı Guido Crosetto bazı İtalyan elitlerini arayarak kaçırılan gazetecilerin kurtarılması için acil mali yardım talep etti.

Aramada sahte Guido Crosetto bunun çok gizli bir hükümet operasyonu olduğunu iddia etti. Arayan kişi Giorgio Armani gibi efsanevi moda figürleriyle bile telefonda görüşmeyi başarmıştır.

Ne yazık ki, bir kişi yaklaşık bir milyon dolar transfer etti. Muhtemelen yardım etmek için diğerlerinden daha güçlü bir vatanseverlik görevi duygusuna sahiplerdi ve dolandırıcılar bunu istismar etmeyi başardılar.

$243,000 Birleşik Krallık Enerji Soygunu

Bu 2019'da gerçekleşti ve muhtemelen bu ölçekte rapor edilen ilk deepfake idi.

Birleşik Krallık'taki bir enerji firmasının CEO'su, Almanya'daki ana şirketten patronuyla telefonda konuştuğunu sanıyordu.

CEO'ya Macaristan'daki bir tedarikçiye yaklaşık 220,000 € ($243,000) havale etmesi emredildi. Kendisine bunun acil transfer gerektiren kritik bir anlaşma olduğu söylenmiştir. CEO dolandırıcılığa kanmış ve parayı transfer etmiştir.

Arizona'da Bir Anne İçin Dehşet Verici Bir Çağrı

Ses sahteciliğinin aileler için bir tehdit olduğundan bahsetmiştik, hatırlıyor musunuz? Verdiğimiz dolandırıcılık örneği gerçekten yaşandı.

Dolandırıcılar 15 yaşındaki bir kızın sesini sosyal medyadaki bir videosundan klonlamışlardı. Daha sonra annesini arayarak kızın sesiyle kaçırıldığını ve kaçıranların derhal fidye talep ettiklerini iddia ettiler.

Neyse ki baba, tüm bu olaylar sırasında kayak antrenmanında güvende olan gerçek kızını arayabilmiş. Dolandırıcılıktan kurtuldular.

Ses Sahtekarlıkları Şirketleri Nasıl Etkiliyor?

Bir ses deepfake saldırısının ana amacı çoğunlukla para çalmaktır.

Ancak hedef işletmeler olduğunda, hasar çok boyutludur.

Örneğin, deepfakes bir şirketin çalışanları arasındaki atmosferi zehirleyebilir. Çalışanların her zaman bir hata yapmaktan korktuğu bir kültür yaratma potansiyeline sahiptir.

Çağrı merkezleri örneğini ele alalım. Siber suçluların onları arayıp belirli müşteriler gibi davrandıklarına dair raporlar görüyoruz.

Yaptıkları numara, çağrı merkezi temsilcilerinin bu müşterilerin hesap bilgilerini (örneğin ev adresleri, telefon numaraları) değiştirmesini sağlamak ve hesaplarını ele geçirmektir.

Uzaktan işe alım ve sanal mülakatlar, adayların kalifiye olmadıkları işlere girmek için sahte sesleri kullanabilecekleri bir başka alandır.

İşletmeleri Sesli Deepfake Saldırılarından Koruma

İşletmelerdeki geleneksel güvenlik kuralları yapay zeka öncesi dönemde yazılmıştır.

İşletmelerin bunları yeniden gözden geçirmesinin tam zamanı. Öncelikle yapay zekanın kötüye kullanılmasından kaynaklanan birçok yeni siber tehdit hakkında kendilerini eğitmekle işe başlamalılar.

Örneğin, tüm ekipleri için eğitim oturumları düzenleyebilir ve onlara gerçek ses sahtekarlığı örnekleri gösterebilirler. Yukarıda bahsettiğimiz örneklerle başlayabilirsiniz. Bu eğitimlerde ayrıca farklı senaryolar için deepfake saldırılarını önleme ipuçları da verilmelidir.

O zaman devam edebilir ve dahili iş politikalarını güncelleyebilirsiniz. Önemli bir değişiklik, tek bir kişinin tek başına büyük banka havalelerini yetkilendirmesine izin vermemek olabilir.

Büyük ödemeler tüm panelin onayını gerektirmelidir, böylece en azından bir tanesi bir şeylerin yanlış gittiğini zamanında fark edebilir.

Ayrıca otomatikleştirilmiş bir Yapay Zeka Ses Dedektörü aramalar sırasında arka planda çalışmak için.

TruthScan AI araçları bunun için üretildi. Yapay zeka araçlarımızı kullanarak sesli deepfake saldırılarını tespit edebilir, doğrulayabilir ve önleyebilirsiniz. Size nasıl olduğunu anlatalım.

TruthScan Sesli Etkileşimleri Nasıl Güvence Altına Alıyor?

Çalışanların stresli bir görüşmenin ortasında derinden gelen sahte bir sesle gerçek bir sesi tek başlarına ayırt edemeyeceklerini biliyoruz. Ekibiniz işe alınma amaçlarına odaklanabilirken, çağrı sırasında bu işle ilgilenebilecek özel bir asistana ihtiyaçları var.

Bizim Yapay Zeka Ses Dedektörü özel bir çözümdür.

İşte nasıl çalıştığı ve neler yapabildiği:

- Canlı telefon görüşmelerinde ve görüntülü toplantılarda milyonlarca farklı veri noktasını analiz eder ve 99% doğruluk sağlar

- Sahte bir ses algıladıktan sonra anında uyarı verir

- Seste sadece sentetik modellerin geride bıraktığı spektral desenleri ve akustik parmak izlerini yakalar

- Basit bir REST API aracılığıyla mevcut çağrı merkeziniz veya yardım masanızla entegre olur

- Tüm önemli ses ve video formatlarını tarayabilir

Sesli Deepfake Saldırılarını Önleme Hakkında TruthScan ile Konuşun

TruthScan ile ses klonlama dolandırıcılığını gerçek zamanlı olarak durdurabilirsiniz, ancak soru şu ki, ne zaman başlayacaksınız? Çalışanlarınız er ya da geç bir hata yapabilir ve sizi dolandırabilir. O talihsiz anı beklemeyin.

Yapay zeka ses dedektörümüz ElevenLabs ve Murf gibi platformları kullanarak ses sahtekarlıklarını işaretleyebilir.

Canlı telefon görüşmeleri ve görüntülü toplantılar sırasında arka planda çalışır, böylece çağrı temsilcilerinizin birden fazla görev yapması gerekmez.

Bunun için gereken tek şey REST API'miz aracılığıyla hızlı bir entegrasyon.

İle başlayın TruthScan şimdi ve işinizi deepfake dolandırıcılığından koruyun.