İşletmelerde yapay zeka ses dolandırıcılığını anlama, tespit etme ve önlemeye yönelik kapsamlı bir kılavuz

Hiç Gerçekleşmeyen $25 Milyon Sesli Arama

Şubat 2024'te, Hong Kong'daki çok uluslu bir şirkette çalışan bir finans çalışanı, CFO'sundan bir video araması aldı.

Diğer uçtaki ses hatasızdı; her tonlama, her duraklama ve hatta hafif aksan bile anında tanınıyordu.

Gizli bir satın alma işlemini tamamlamak için acilen toplam $25 milyon tutarındaki 15 banka havalesini işleme koymasını istedi.

Yapay Zeka Dolandırıcılığı Konusunda Bir Daha Asla Endişelenmeyin. TruthScan Sana yardım edebilirim:

- Üretilen yapay zekayı tespit edin görüntüler, metin, ses ve video.

- Kaçının Yapay zeka kaynaklı büyük dolandırıcılık.

- En değerli varlıklarınızı koruyun hassas kurumsal varlıklar.

CFO bu çağrıyı hiç yapmadı. Tamamen yapay zeka tarafından oluşturuldu.

Bu münferit bir vaka değildi. Finans kurumları deepfake dolandırıcılığında büyük bir artış görüyor.

Son üç yılda, vakalar 2,137% arttı ve yapay zeka şu anda sektördeki tüm dolandırıcılık girişimlerinin 42.5%'sini yönlendiriyor.

Yapay zeka ses dolandırıcılığındaki artışa rağmen, iş liderlerinin yarısından fazlası çalışanlarının deepfake saldırılarını tespit etmek veya bunlara yanıt vermek için eğitilmediğini kabul ediyor; şirketlerin yaklaşık 80%'sinin bu olayları ele almak için resmi protokolleri yok.

Yapay Zeka Ses Klonlama Nasıl Çalışır ve Neden Bir Tehdittir?

Modern yapay zeka ses sentezi şaşırtıcı derecede az veriye ihtiyaç duyar. Sadece birkaç saniyelik ses, 85%'ye kadar doğrulukla bir sesi klonlayabilir.

Süreç üç ana adımdan oluşmaktadır:

- Veri Toplama: Dolandırıcılar ses örneklerini konferans görüşmeleri, podcast röportajları, sosyal medya klipleri ve hatta LinkedIn video gönderileri gibi halka açık kaynaklardan toplar.

- Model Eğitimi: Yapay zeka, ses perdesi, ton, aksan, hız ve nefes alma şekilleri gibi ses özelliklerini analiz eder.

- Nesil: Sistem, yakın iş arkadaşlarını bile kandırabilecek kadar ikna edici sentetik konuşma yaratıyor.

Erişilebilirlik Sorunu

Bu tehdidi daha da tehlikeli kılan şey ise demokratikleşmesi. Dolandırıcıların artık Hollywood düzeyinde kaynaklara ihtiyacı yok.

Tek gereken, kısa bir sosyal medya klibinden ses klonlamak için erişilebilir bir yazılımdır; açık kaynaklı araçlar ve bulut tabanlı yapay zeka hizmetleri, ses klonlamayı temel teknik becerilere sahip herkes için kullanılabilir hale getirmiştir.

Yöneticiler Neden Dolandırıcılık İçin En Önemli Hedefler

Yöneticiler risk faktörlerinin tehlikeli bir karışımıyla karşı karşıyadır.

Sosyal medya aracılığıyla kamuya açık olmaları, ses örneklerinin bulunmasını kolaylaştırır ve yetkileri genellikle çalışanları acil talepler konusunda hızlı hareket etmeye yönlendirir.

Ortalama olarak, her dört yöneticiden biri deepfake teknolojisi hakkında sınırlı bir anlayışa sahiptir.

Güncel İstatistikler Endişe Verici Bir Tablo Çiziyor

Bir 2024 Deloitte araştırmasıYöneticilerin 25.9%'si, kuruluşlarının geçtiğimiz yıl finans veya muhasebe verilerini hedef alan en az bir deepfake olayıyla karşılaştığını ve tüm katılımcıların yarısının bu tür saldırıların önümüzdeki 12 ay içinde artacağına inandığını söyledi.

En endişe verici olanı: kurumların yalnızca 52%'si CEO'larının deepfake'ini tespit edebileceklerinden emin.

Yapay Zeka Ses Dolandırıcılığı Nasıl Tespit Edilir?

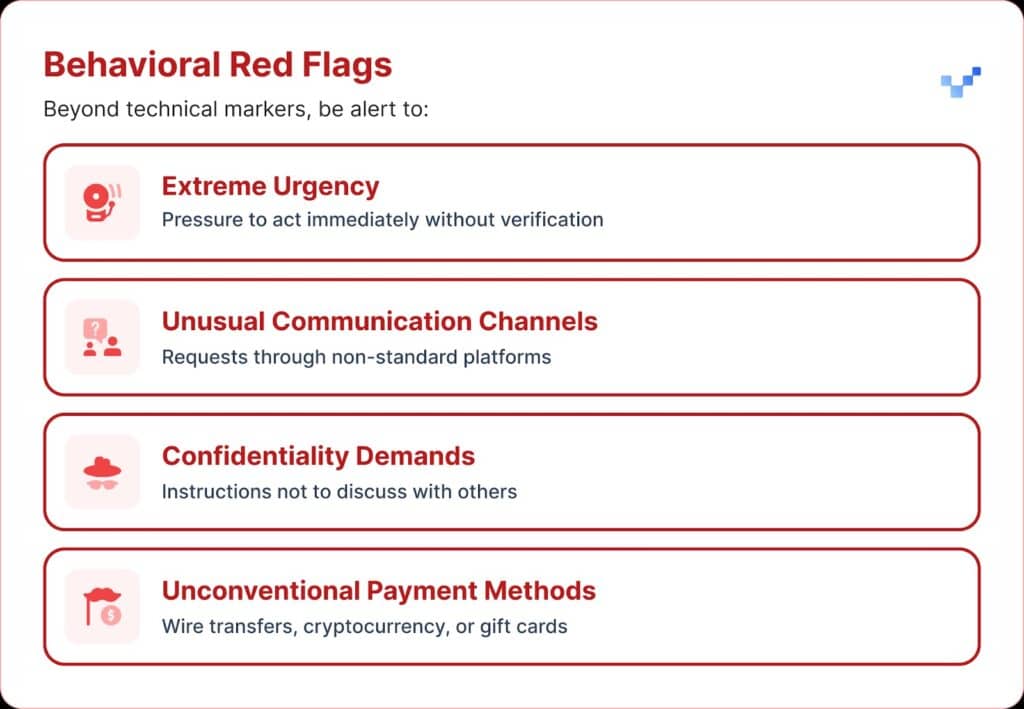

Şüpheli bir sesli iletişim aldığınızda, dikkat etmeniz gereken birkaç uyarı işareti vardır.

Yapay zeka ses dolandırıcılığı genellikle monoton veya düz ses çıkarır. Ayrıca garip duraklamalar veya doğal olmayan bir ritim ile olağandışı bir hız fark edebilirsiniz.

Ses, özellikle uzun aramalar sırasında hafif elektronik uğultu veya yankı da taşıyabilir.

Ve çoğu durumda ses, senaryo veya prova gibi görünen sınırlı cümleleri tekrarlıyor.

Mali Etkisi ve Gerçek Maliyeti

Çoğu kuruluş ortalama $450.000 civarında kayıp yaşarken, finansal hizmetler sektöründe kayıplar $603.000'in üzerine çıktı.

En ağır vakalarda ise her 10 kuruluştan 1'i $1 milyondan fazla kayıp bildirmiştir.

Bu eğilim hızla büyümüştür. 2022'de yapılan daha önceki bir araştırma, kimlik dolandırıcılığının ortalama mali yükünün $230,000 civarında, yani mevcut rakamın neredeyse yarısı kadar olduğunu gösteriyordu.

Gelecekte Öngörülen Kayıplar

Deloitte'un Finansal Hizmetler Merkezi'ne göre, ABD'de yapay zeka dolandırıcılığı nedeniyle kaybedilen para 2023'te $12,3 milyardan 2027'ye kadar $40 milyara yükselebilir. Bu da her yıl yaklaşık 32% büyüme anlamına geliyor.

Bölgesel Kırılganlık

Kuzey Amerika'da deepfake dolandırıcılığında 1740%'lik bir artış yaşanmıştır.

Bu önemli bölgesel artış, muhtemelen büyük dijital ekonomisi ve çevrimiçi hizmetlerin yaygın kullanımı nedeniyle Kuzey Amerika'nın deepfake dolandırıcıları için birincil hedef olabileceğini düşündürmektedir.

Yönetici Korumaya Stratejik Yaklaşımlar

1. Doğrulama Protokollerinin Uygulanması

Savunmayı güçlendirmenin bir yolu, kilit personel ile paylaşılan önceden kararlaştırılmış kimlik doğrulama ifadeleri olan bir "güvenli kelime" sistemi kullanmaktır.

Yapay zeka ses klonlama kullanan bir dolandırıcı, kişisel doğrulama sorularının doğru yanıtlarını bilemeyecektir.

Bir diğer önlem de çok kanallı doğrulamadır.

Olağandışı mali talepler ayrı bir iletişim kanalı aracılığıyla teyit edilmeli, asla yalnızca orijinal iletişim yöntemine güvenilmemelidir.

Şirketler ayrıca, kimin talep ettiğine bakılmaksızın, büyük finansal işlemler için bekleme süreleri ve onay adımları ile birlikte eskalasyon için net kurallar belirlemelidir.

2. Dijital Maruziyet Konusunda Dikkatli Olun

Bir başka koruma katmanı da çevrimiçi ortamda ne kadar yönetici ses ve görüntüsünün bulunabileceğinin sınırlandırılmasıdır. Dolandırıcılar ne kadar çok örnek toplayabilirse, klonları da o kadar inandırıcı olur.

Ayrıca, özellikle temiz ses içeren videoların yayınlanması konusunda yöneticiler için net sosyal medya yönergeleri belirlemek de yardımcı olur.

Konferanslar söz konusu olduğunda, kuruluşlar uzun ses örnekleri veren kayıtlı konuşmalara veya röportajlara dikkat etmelidir.

3. Teknik Çözümleri Dağıtın

İşte bu noktada gelişmiş yapay zeka algılama teknolojisi kritik hale geliyor.

Kuruluşlar kurumsal düzeyde ses kimlik doğrulamasına ve deepfake tespi̇ti̇ sağlayan yetenekler:

- Gerçek Zamanlı Analiz: Canlı iletişim sırasında sentetik sesleri algılama

- Tarihsel Doğrulama: Kaydedilen çağrı ve mesajların gerçekliğini analiz edin

- Entegrasyon Yetenekleri: Mevcut iletişim platformlarıyla sorunsuz çalışın

- Yüksek Doğruluk Oranları: Sofistike sahtekarlıkları yakalarken yanlış pozitifleri en aza indirin

4. Kapsamlı Eğitim Programları

Liderlik ekiplerinin yapay zeka ses tehditleri ve doğrulama prosedürleri konusunda hedefli eğitime ihtiyacı vardır.

En az bunun kadar önemli olan bir diğer husus da çalışanların farkındalığının artırılmasıdır.

Hangi görevde olursa olsun herkes potansiyel sahtekarlıkları tespit edebilecek ve siber tehditlerin kuruma girmesini önleyebilecek donanıma sahip olmalıdır.

Düzenli simülasyon tatbikatları, müdahale prosedürlerini test etmek ve iyileştirmek için sahte ses dolandırıcılığı girişimlerini kullanarak bu hazırlığı güçlendirebilir.

Gelişmiş Yapay Zeka Ses Algılama Çözümleri

Geleneksel savunmalar ağ tabanlı tehditler için geliştirilmiştir, yapay zeka destekli insan taklidi için değil.

Standart siber güvenlik araçlarının ses tabanlı sosyal mühendisliği ele alamamasının ana nedenleri:

- Kötü Amaçlı Yazılım İmzası Yok: Sesli aramalar geleneksel güvenlik sistemlerini tetiklemez

- İnsan Güven Faktörü: İnsanlar doğal olarak duyduklarına, özellikle de tanıdık seslere güvenirler

- Algılama Teknolojisi Boşlukları: Deepfake'ler de dahil olmak üzere yapay zeka odaklı dolandırıcılık girişimlerindeki artışa rağmen, finans kurumlarının yalnızca 22%'si yapay zeka tabanlı dolandırıcılık önleme araçlarını uygulamaya koymuştur

Özel Ses Algılama İhtiyacı

Modern ses dolandırıcılığı, modern tespit yetenekleri gerektirir.

Kurumsal sınıf Yapay zeka ses algılama sistemleri Yapabilirsin:

- Vokal Biyobelirteçleri Analiz Edin: Sentetik konuşmadaki ince tutarsızlıkları tespit edin

- Gerçek Zamanlı İşleme: Şüpheli çağrılar sırasında anında uyarılar sağlayın

- Sürekli Öğrenme: Yeni ses sentezleme tekniklerine uyum sağlama

- Entegrasyona Hazır: Mevcut iletişim altyapısı ile çalışın

Ses dolandırıcılığına karşı korunma konusunda ciddi olan kuruluşların, karşılaştıkları tehditlerin karmaşıklığıyla eşleşebilecek amaca yönelik yapay zeka algılama teknolojisine yatırım yapmaları gerekiyor.

Ses Dolandırıcılığı Artık Burada ve Giderek Artıyor

2025'in ilk çeyreğinde, deepfake dolandırıcılığı ve kimlik hırsızlığı $200 milyondan fazla zarara neden oldu.

Yapay zeka klonlarıyla sesli kimlik avı 442%'ye sıçradı ve günde 400'den fazla işletme deepfake CEO veya CFO dolandırıcılığıyla vuruluyor.

İşletmelerin 56%'si derin sahtekarlıkları tespit etme konusunda kendilerine çok güvendiklerini söylerken, yalnızca 6%'si bu sahtekarlıklardan kaynaklanan mali kayıplardan kaçınabilmiştir.

Önemli olan kuruluşunuzun hedef alınıp alınmayacağı değil, buna hazır olup olmadığınızdır.

Ses dolandırıcılığı siber güvenliğin çehresini değiştiriyor. Geleneksel savunmalar yapay zeka destekli taklitçiliğe ayak uyduramıyor.

Korunmak için kuruluşların daha iyi tespit araçlarına, güçlü eğitim programlarına ve net doğrulama prosedürlerine ihtiyacı vardır.

Karşı koyacak teknoloji zaten burada. Asıl soru, bunu ilk sesli dolandırıcılık olayınızdan önce mi yoksa sonra mı kullanacağınızdır.