För bara några år sedan behövde man en professionell studio och en hel del teknisk skicklighet för att härma någons röst.

Nu kan vem som helst med en internetuppkoppling och lite tid över skapa en digital klon av vem som helsts röst på mindre än en minut.

Verktygen för dessa attacker blir billigare och mer lättillgängliga för var och en varje dag. Och eftersom så många människor delar med sig av sina liv på sociala medier är det mycket lätt för en bedragare att hitta det ljud de behöver.

I den här artikeln går vi igenom några av de mest ökända exemplen på ljudbedrägerier i den verkliga världen. Vi kommer också att presentera en lösning för att få ett snabbt slut på dessa hot.

Viktiga slutsatser

- Försök till röstbedrägerier med deepfake har ökat med över 2 137% de senaste åren, drivet av det faktum att modern AI kan generera en 85% korrekt röstklon med så lite som tre sekunders källjud.

- Berömda attacker i verkligheten inkluderar stölden av ingenjörsbyrån Arup 2024 där bedragare använde deepfake video och ljud av en finansdirektör för att lura en anställd att överföra $25,6 miljoner.

- Utöver företagsstölder utgör röstförfalskningar allvarliga känslomässiga risker för familjer genom kidnappningsbedrägerier och kan kringgå traditionella biometriska säkerhetssystem som används av banker och andra högsäkerhetsappar.

- Organisationer tvingas gå längre än enbart mänsklig verifiering genom att implementera godkännandeprotokoll med flera personer för stora överföringar och använda AI-röstdetektorer som TruthScan för att analysera akustiska fingeravtryck i realtid.

- TruthScan säkrar företagsinteraktioner genom att identifiera syntetiska talartefakter från plattformar som ElevenLabs och Murf med över 99% noggrannhet i alla större ljud- och videoformat.

Vad är Voice Deepfake-attacker?

En voice deepfake är en digital förfalskning av någons röst. Angriparen använder programvara som kan analysera varje liten detalj om hur någon talar från en inspelning av deras röst.

För att klona rösten försöker programvaran lägga märke till mönster i rösten. Programvaran tar främst hänsyn till saker som tonhöjd, ton, hur någon andas mellan meningarna etc.

När den väl har lärt sig dessa mönster kan angriparen få den att säga vad som helst med den rösten.

Oroa dig aldrig för AI-bedrägerier igen. TruthScan Kan hjälpa dig:

- Upptäcka AI-generering bilder, text, röst och video.

- Undvik stora AI-drivna bedrägerier.

- Skydda dina mest känslig Företagets tillgångar.

Det som är farligt är att verktyg för att skapa röst deepfake är lättillgängliga. Och de flesta av dem behöver inte någon installation. De finns tillgängliga online i form av webbplatser.

Du behöver bara kasta några dollar på dem och börja klona röster. Om du gräver lite mer kan du till och med hitta verktyg som låter dig klona röster gratis.

Denna nya och lättillgängliga teknik har lett till en kraftig ökning av ljudbedrägerier.

Bedragare behöver bara en liten bit ljud av någon, som de kan hämta från sociala medier eller någon annan offentlig kanal, för att klona den.

Sedan kan de använda den klonade rösten för att utge sig för att vara en person i situationer som direktsända telefonsamtal, videomöten, röstanteckningar, meddelanden etc.

Det här är inte bara hypotetiska användningsfall av röst deepfake-attacker. Dessa saker har redan hänt. Vi kommer att täcka några av de ökända röst deepfake-attackerna senare.

Potentiella risker med Deepfake-attacker mot röster

När du hörde talas om voice deepfake kanske du har framkallat bilder av en rolig video av en kändis som säger saker som de aldrig har sagt.

Men den till synes oskyldiga användningen av en klonad röst kan orsaka allvarliga skador för de inblandade parterna. Låt oss prata om riskerna.

Ekonomisk förödelse för företag

En röst deepfake kan förstöra ett företags rykte för alltid. Det kan också stjäla stora summor pengar på bara några minuter.

Hur kommer det sig, kanske du undrar? Bedragare kan klona rösten från ett företags chef och använda den för att ringa upp anställda och få dem att göra saker som inte ska göras, som att flytta pengar till ett konto.

Detta är bara ett exempel. Möjligheterna är oändliga.

Kringgå säkerhetssystem

Din röst är ett biometriskt kännetecken som ingen annan borde ha. Det beror på att du använder den som ett lösenord för att logga in på många av dina appar, särskilt bankapparna.

Även om dessa appar kan ha ett inbyggt automatiserat röstverifieringssystem för att förhindra obehörig åtkomst, har en bra röstklon fortfarande en chans att lura dem.

Den känslomässiga påfrestningen på familjer

De kanske enklaste måltavlorna för ljudbedragare är äldre personer i familjen. Föräldrar och mor- och farföräldrar, till exempel.

Bedragare kan ringa, låt oss säga, en mamma och spela upp ljudet av hennes dotter som ropar på hjälp och säger att hon har kidnappats.

Förtroendet på arbetsplatsen urholkas

Voice deepfake-attacker skadar också förtroendet för en hälsosam arbetsplats.

Anställda måste dubbelkolla telefonsamtal från sin chef för att se till att det inte är en bedragare som beordrar dem att göra riskabla saker med en klonad röst.

Så vad är då dina alternativ om inte dubbelkolla manuellt? Alla risker som vi just diskuterat pekar på behovet av ett automatiserat förebyggande av deepfake-attacker.

Lyckligtvis har vi nu verktyg för deepfake AI-röstdetektor, TruthScan är ett av dem.

Förhindra bedrägerier och förfalskningar med TruthScans AI-röstdetektor.

Verkliga exempel på Deepfake-attacker mot röster

Tack vare AI har vi nu nått en punkt där vi inte längre kan lita på vad våra ögon ser eller öron hör. AI kan nu skapa realistiska bilder och videor. Samma sak gäller för ljud.

Du kanske redan har hört historier om människor som faller för deepfake ljudbedrägeri. Det dyker upp på nyheterna och sociala medier då och då också. Några av dessa är svåra att linda huvudet runt.

Låt oss berätta om några av de mest ökända röst deepfake-attackerna så att du kan få en god uppfattning om hur smart dessa utförs.

Det virtuella mötet för $25 miljoner som aldrig ägde rum

Den här deepfake-attacken är förmodligen den mest rapporterade.

Den offret var en brittisk ingenjörsfirma vid namn Arup, men bedrägeriet härrörde från dess kontor i Hongkong.

Det var i början av 2024 när en anställd på företagets ekonomiavdelning fick ett mejl från företagets finansdirektör i Storbritannien. I mejlet uppmanades medarbetaren av finanschefen att göra hemliga överföringar av pengar till vissa bankkonton.

Till en början var medarbetaren faktiskt ganska misstänksam eftersom förfrågan kändes lite konstig, och de trodde att det kunde vara ett phishingbedrägeri.

Men så blev medarbetaren inbjuden till ett videokonferenssamtal. När medarbetaren anslöt till samtalet såg hen vad som såg ut att vara precis som finanschefen och flera andra seniora kollegor.

Alla såg ut och lät precis som de skulle. De pratade också med varandra för att få det att verka mer verkligt.

Detta undanröjde helt alla tvivel hos den anställde på finansavdelningen, som sedan skickade över $25,6 miljoner (~HK$200 miljoner) till flera olika bankkonton i Hongkong via 15 transaktioner.

Det visade sig senare att hela upplägget var en deepfake. Ingen person i samtalet var den de såg ut att vara, förutom den Arup-anställde. Bedragarna hade perfekt samordnat attacken med hjälp av högkvalitativa ljud- och videokloner av företagets finansdirektör och högre anställda.

Den italienska ministern och modeikonerna

Även denna utspelade sig år 2024. A falska italienska försvarsministern Guido Crosetto ringde flera italienska elitpersoner och bad dem om omedelbar ekonomisk hjälp för att rädda kidnappade journalister.

I samtalet hävdade den falske Guido Crosetto att detta var en topphemlig regeringsoperation. Den som ringde lyckades till och med få tag på legendariska modeprofiler som Giorgio Armani.

Tyvärr slutade det med att en person överförde cirka en miljon dollar. De hade förmodligen en starkare känsla av patriotisk plikt att hjälpa till än andra, vilket bedragarna lyckades utnyttja.

Den brittiska energikuppen på $243,000

Detta hände under 2019 och var förmodligen den första rapporterade deepfake i den här omfattningen.

En VD för ett brittiskt energiföretag trodde att han talade i telefon med sin chef på moderbolaget i Tyskland.

VD:n beordrades att föra över cirka 220.000 euro ($243.000) till en leverantör i Ungern. Han fick veta att det var en kritisk affär som behövde överföras omedelbart. VD:n gick på bluffen och överförde pengarna.

Ett skrämmande samtal till en mamma i Arizona

Kommer du ihåg att vi pratade om att audio deepfakes var ett hot för familjer? Det exempel på bedrägeri som vi gav hände faktiskt.

Bedragare hade klonat en 15-årig flickas röst från en video av henne på sociala medier. De ringde sedan hennes mamma och påstod med dotterns röst att hon hade blivit kidnappad och att kidnapparna krävde en omedelbar lösensumma.

Lyckligtvis kunde pappan ringa sin riktiga dotter, som var i säkerhet på en skidträning under hela händelsen. De klarade sig undan bedrägeriet.

Hur röstförfalskningar påverkar företag

En röst deepfake-attacks huvudsyfte är oftast att stjäla pengar.

Men när målet är företag är skadan flerdimensionell.

Till exempel kan deepfakes förgifta stämningen mellan de anställda på ett företag. Det kan skapa en kultur där medarbetarna alltid är livrädda för att göra ett misstag.

Ta callcenter som exempel. Vi ser rapporter om cyberbrottslingar som ringer dem och utger sig för att vara specifika kunder.

Deras trick är att få callcenteragenterna att ändra kontouppgifter för dessa kunder (t.ex. hemadresser, telefonnummer) och ta över deras konton.

Distansrekrytering och virtuella intervjuer är ett annat område där falska röster kan användas av kandidater för att få jobb som de inte är kvalificerade för.

Skyddar företag från Deepfake-attacker mot röst

De traditionella säkerhetsreglerna på företag skrevs i tiden före AI.

Det är hög tid att företagen omprövar sina beslut. De bör först börja med att utbilda sig själva om de många nya cyberhot som har uppstått genom missbruk av AI.

De kan till exempel organisera utbildningstillfällen för hela sitt team och visa dem verkliga exempel på ljudbedrägerier. Du kan börja med de exempel som vi just diskuterade ovan. Dessa utbildningssessioner bör också ge dem tips om förebyggande av deepfake-attacker för olika scenarier.

Sedan kan du gå vidare och uppdatera interna affärspolicyer. En viktig förändring kan vara att inte längre tillåta att en enda person godkänner stora banköverföringar på egen hand.

Stora betalningar bör kräva godkännande av en hel panel så att åtminstone en av dem i tid kan märka att något är fel.

Du bör också fundera på att integrera en automatiserad AI-röstdetektor att köras i bakgrunden under samtal.

Det är vad TruthScan AI-verktyg är gjorda för. Du kan upptäcka, verifiera och förhindra deepfake-attacker med röst med hjälp av våra AI-verktyg. Låt oss berätta hur.

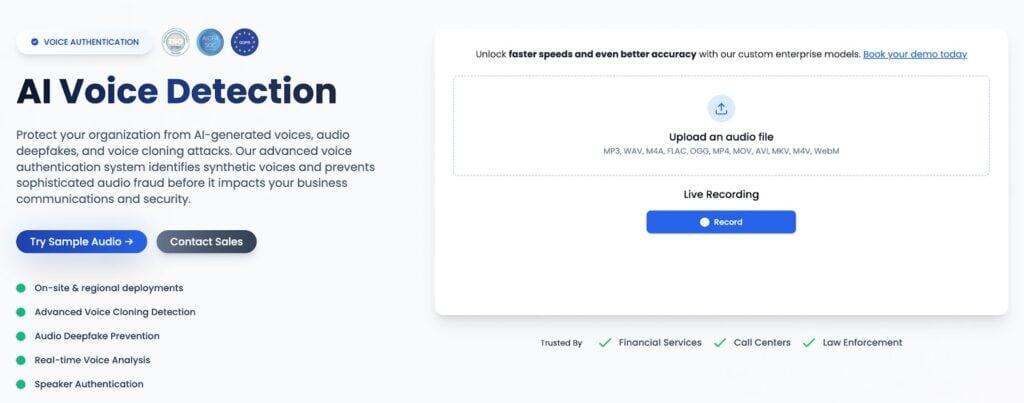

Hur TruthScan säkrar röstinteraktioner

Vi förstår att anställda inte på egen hand kan skilja en falsk röst från en riktig röst mitt i ett stressigt samtal. De behöver en dedikerad assistent som kan ta hand om det jobbet under ett samtal, medan ditt team kan fokusera på att göra det de anställdes för.

Vår AI-röstdetektor är en dedikerad lösning.

Så här fungerar den och vad den kan göra:

- Analyserar miljontals olika datapunkter i direktsända telefonsamtal och videomöten och levererar 99% noggrannhet

- Utfärdar en varning direkt efter att ha upptäckt en falsk röst

- Fångar upp spektrala mönster och akustiska fingeravtryck i rösten som bara syntetiska modeller kan lämna efter sig

- Integreras med ditt befintliga callcenter eller din helpdesk via ett enkelt REST API

- Kan skanna alla större ljud- och videoformat

Prata med TruthScan om att förhindra Voice Deepfake-attacker

Du kan stoppa bedrägerier med röstkloning i realtid med TruthScan, men frågan är när du ska börja? Dina anställda kan förr eller senare göra en blunder och få dig lurad. Vänta inte på det olyckliga ögonblicket.

Vår AI-röstdetektor kan flagga för röstförfalskningar med hjälp av plattformar som ElevenLabs och Murf.

Det fungerar i bakgrunden under direktsända telefonsamtal och videomöten, så att dina telefonister inte behöver göra flera saker samtidigt.

Allt som behövs är en snabb integration via vårt REST API.

Kom igång med TruthScan nu och skydda ditt företag från deepfake-bedrägerier.