Hur deepfake-teknik blöder miljarder från globala företag - och varför varje chef nu är en måltavla

Siffrorna ljuger inte

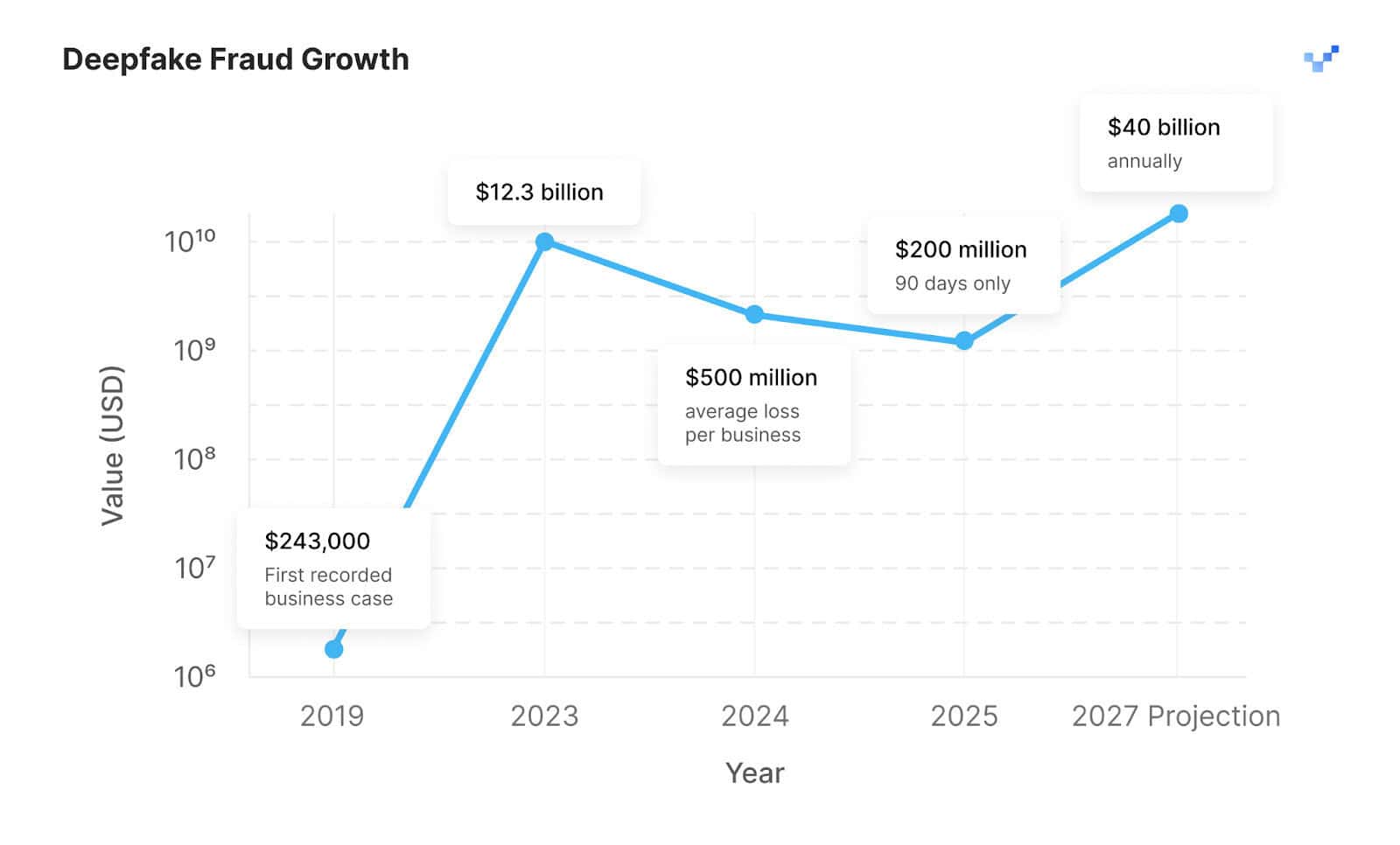

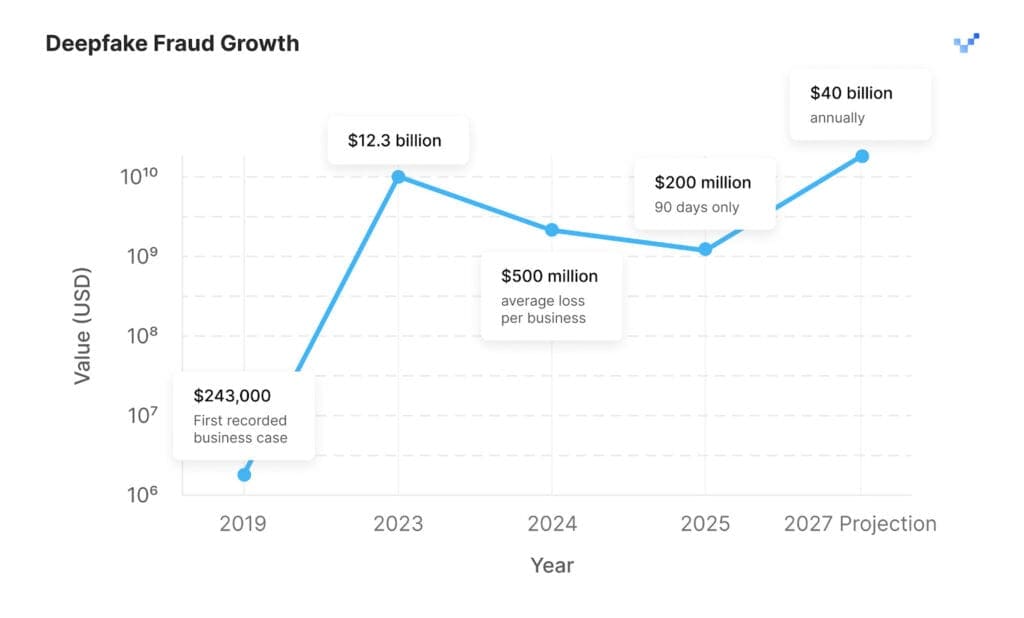

Deepfake-aktiverade bedrägerier orsakade över $200 miljoner i förluster bara under det första kvartalet 2025enligt Resemble AI:s senaste incidentrapport. Men det är toppen av ett isberg; säkerhetsexperter varnar för att det kan nå $40 miljarder i årliga förluster i hela USA fram till 2027.

Matematiken bakom digitala bedrägerier är nedslående:

Detta motsvarar en sammansatt årlig tillväxttakt för 32%-snabbare än de flesta teknikutvecklingskurvor, och definitivt snabbare än vår förmåga att försvara oss mot den.

Oroa dig aldrig för AI-bedrägerier igen. TruthScan Kan hjälpa dig:

- Upptäcka AI-generering bilder, text, röst och video.

- Undvik stora AI-drivna bedrägerier.

- Skydda dina mest känslig Företagets tillgångar.

Skalan för sårbarhet

Ny forskning från Deloitte visar att 25,9% av cheferna har redan upplevt deepfake-incidenter riktade mot deras finansiella data under de senaste 12 månaderna. Ännu mer alarmerande: 50% förväntar sig att attackerna kommer att öka under nästa år.

Den regionala påverkan ger en tydlig bild:

- Nordamerika: 1,740% ökning av bedrägerifall med deepfake under 2023

- Genomsnittlig affärsförlust: $500.000 per händelse

- Påverkan på stora företag: Upp till $680.000 per attack

Varför explosionen nu?

Deepfake-skapande brukade isoleras till avlägsna hörn av den djupa webben, där skumma cyberbrottslingar bytte ut kryptovalutor mot lösenord.

Nu är AI-verktyg allmänt tillgängliga för vem som helst att använda, och chattbotar för allmänna ändamål kan användas för att tillfälligt lura befintliga system.

Deras förmågor överträffar vida allmänhetens förmåga att känna igen dem. Som cybersäkerhetsexperten David Fairman från Netskope förklarar: "Den allmänna tillgängligheten till dessa tjänster har sänkt inträdesbarriären för cyberbrottslingar - de behöver inte längre ha någon särskild teknisk kompetens."

Den kriminella ekonomin:

- Kostnad för skapande: Så lågt som $20 för grundläggande deepfake-programvara

- Framgångsgrad: Behöver bara fungera en gång för massiv ROI

- Detekteringshastighet: 68% av människor kan inte skilja verklig från falsk video

- Kloning av röst: Kräver bara 3-5 sekunders ljudprov för 85%-noggrannhet

Senaste Deepfake-attackerna

UK Bilförsäkring Deepfake Ökning (2024) Brittiska försäkringsbolag som Allianz och Zurich rapporterade en 300% ökning av bedrägliga anspråk som involverade AI-manipulerade foton och videor från 2021 till 2023, med en accelererande trend under 2024. Ett specifikt fall involverade bedragare som manipulerade CCTV-bevis för att ändra datum, tid och fordonsregistreringsnummer till stöd för ett påstått olycksfallskrav Kennedys Law LLPÄlska pengar. Enligt Association of British Insurers var det genomsnittliga bedrägliga anspråket värt 15 000 pund 2023, och dessa brott ökar den genomsnittliga försäkringstagarens bil- och hemförsäkringspremier med cirka 50 pund per år

Försök att efterlikna Ferraris VD (2024) I juli 2024 utsattes det italienska bilföretaget Ferrari för en attack där bedragare försökte lura finanschefer med hjälp av en digital imitation av VD Benedetto Vigna. Bedragarna kontaktade först ledande befattningshavare på WhatsApp och frågade om "det stora förvärvet vi planerar", och eskalerade sedan till djupa falska röstsamtal som replikerade Vignas distinkta syditalienska accent (artikel här).

Bedrägeri inom federal förvaltning (2024) Forskning från GB Group uppskattar att cirka 8,6 miljoner människor i Storbritannien har använt falska eller bedrägliga identiteter för att få tillgång till myndighetstjänster. AI-aktiverade deepfake-ID:n används allt oftare för olika bedrägerier, bland annat för att få tillgång till myndighetstjänster med hjälp av falska identitetsuppgifter.ID.me rapporterade en kraftig ökning av attackvektorer från 2023 till 2024, med face swap deepfake-attacker som ökade med 300%, bild- och videoinjektionsattacker som ökade 783% och virtuella kameraattacker som sköt i höjden 2,665%

Förvaltningsskatten

Utöver direkta ekonomiska förluster innebär deepfakes vad ekonomer skulle kunna kalla en "trustskatt" på den globala handeln. När 32% av företagsledarna har inget förtroende för att deras anställda kan känna igen försök till deepfake-bedrägerierkostnaden sträcker sig långt bortom enskilda incidenter.

Organisationer tvingas nu att investera i:

- Förbättrade verifieringsprotokoll

- Utbildningsprogram för anställda

- Avancerad detektionsteknik

- Förmåga till krishantering

- Efterlevnad av lagar och regler

Men trots detta växande hot, endast 29% av företagen har vidtagit åtgärder för att skydda sig, med 46% saknar helt och hållet en plan för att minska riskerna.

Den kommande accelerationen

FinCEN (Financial Crimes Enforcement Network) har observerat "en ökning av misstänkt aktivitetsrapportering från finansinstitut som beskriver den misstänkta användningen av deepfake media i bedrägerier" med början 2023 och fortsätter in i 2024.

Detta problem på $25 miljarder handlar inte bara om pengar - det handlar om den grundläggande urholkningen av förtroendet för digital kommunikation som driver moderna företag. Varje videosamtal, varje ljudmeddelande, varje digital interaktion väcker nu frågan: "Hur vet jag att det här är på riktigt?"

De chefer som först löser denna förtroendekris kommer att ha en avgörande fördel. De som inte gör det kan komma att spela huvudrollen i sin egen fallstudie om deepfake-bedrägerier.

Referenser:

Resemble AI Q1 2025 Deepfake-incidentrapport - $200 miljoner i förluster under Q1 2025

Deloitte Center för finansiella tjänster (maj 2024) - $40 miljarder i prognos till 2027, 25,9% av cheferna upplevde incidenter, 50% förväntar sig ökningar

Variety (18 april 2025) - "Deepfake-aktiverat bedrägeri har redan orsakat $200 miljoner i ekonomiska förluster 2025"

Eftsure USA (2025) - "Deepfake-statistik (2025): 25 nya fakta för CFO:er" - $500.000 genomsnittliga förluster för företag, $680.000 förluster för stora företag

CNBC (28 maj 2024) - David Fairman citat från Netskope

Entrust 2025 Rapport om identitetsbedrägerier - 3,000% ökning av deepfakes från 2022-2023

FinCEN-varning FIN-2024-Alert004 - Ökning av antalet rapporter om misstänkta aktiviteter

Olika studier som citeras i Eftsure - 32% av ledarna har inget förtroende för medarbetarigenkänning, 68% kan inte skilja äkta från falsk video, 3-5 sekunder behövs för röstkloning