Агенты службы поддержки обучены быть самыми полезными людьми в вашей компании.

Они стоят на переднем крае репутации вашего бренда и делают все возможное, чтобы каждое взаимодействие заканчивалось улыбкой.

Но знаете ли вы самую опасную иронию 2026 года?

Именно эта услужливость делает их самой большой помехой вашей безопасности.

Ваши агенты нацелены на удовлетворение потребностей клиентов.

Они не всегда замечают легкую роботизированную интонацию в голосе собеседника или крошечное размытие вокруг челюсти клиента во время видеозвонка.

Это дает мошенникам идеальное окно для нанесения удара.

Если ваша служба поддержки не имеет автоматизированной системы обнаружения мошенничества, возможно, вы уже подвержены риску.

В этом блоге мы расскажем о том, что такое deepfake impersonation, какие методы используют злоумышленники, чтобы обойти вашу защиту, какие ранние индикаторы могут предупредить вашу команду и как использовать детектор ИИ в реальном времени для защиты вашего бизнеса.

Давайте погрузимся.

Основные выводы

- Агенты службы поддержки обучены быть полезными, поэтому они являются основными объектами для обхода системы обнаружения самозванства ИИ.

- Современные мошенники используют детектор ИИ в реальном времени для выявления голосовых клонов, которые синхронизируются менее чем за 50 миллисекунд.

- Автоматическое обнаружение мошенничества теперь должно охватывать записи с экрана, поддельные квитанции и идентификаторы, сгенерированные искусственным интеллектом.

- Эффективное предотвращение deepfake требует одновременного сканирования аудио, видео и изображений.

- Интеграция детектора deepfake в рабочие процессы электронного обнаружения и поддержки сокращает финансовые потери от BEC (Business Email Compromise) до 80%.

Что такое пародия на Deepfake?

Слово “deepfake” происходит от глубокое обучение (один из видов искусственного интеллекта) и подделка.

Самозванство означает выдачу себя за другого человека, обычно для того, чтобы войти в доверие, украсть деньги или получить доступ к частной информации.

Глубокие подделки происходят, когда ИИ копирует лицо, голос или поведение реального человека, чтобы создать поддельный контент, предназначенный для обмана других людей.

Никогда больше не беспокойтесь о мошенничестве с помощью искусственного интеллекта. TruthScan Мы можем помочь вам:

- Обнаружение сгенерированного искусственного интеллекта изображения, текст, голос и видео.

- Избегайте Крупнейшее мошенничество, управляемое искусственным интеллектом.

- Защитите свои самые чувствительный активы предприятия.

Глубокие подделки больше не ограничиваются простой подменой лиц. В 2026 году мы увидим поведенческие глубокие подделки, способные копировать:

- Речевые шаблоны

- Тон и паузы

- Микровыражения лица

- Даже нюансы личности

Это значительно затрудняет обнаружение манипуляций невооруженным глазом.

Пример из реального мира: Пародия на генерального директора WPP (май 2024)

Киберпреступники использовали общедоступную фотографию генерального директора WPP Марка Рида для создания поддельной учетной записи WhatsApp.

Они заманили руководителя на совещание в Microsoft Teams, где с помощью голосового клона с детектором ИИ в режиме реального времени дали разрешение на мошеннический перевод денег.

К счастью, бдительный сотрудник заметил подозрения и сообщил о случившемся, предотвратив финансовые потери.

Почему служба поддержки клиентов уязвима

Риск мошенничества со стороны клиентов начал расти в 2023-24 годах, когда инструменты генеративного ИИ стали широко доступны.

Но к 2025-26 годам угроза достигла промышленных масштабов.

То, что раньше требовало технических навыков, теперь можно сделать с помощью простых инструментов и нескольких минут работы со звуком.

Команды поддержки клиентов не стали вдруг беспечными. Они стали уязвимыми.

Агенты службы поддержки обучены помогать людям, а не задавать им вопросы, Именно поэтому предотвращение глубоких подделок так сложно осуществлять вручную. Злоумышленники полагаются на инстинкт доверия и быстрое перемещение агента.

Большинство контакт-центров по-прежнему проверяют личность с помощью простых вопросов: номера счетов, даты рождения, последние четыре цифры идентификатора. Проблема в том, что эта информация больше не является частной.

Утечки данных и социальные сети позволяют легко обойти традиционные проверки, что делает обнаружение искусственного интеллекта в качестве обязательного уровня защиты.

Кроме того, на вас давит объем. Многие агенты обрабатывают от 80 до 120 звонков в день. Когда звонки идут один за другим, нет времени анализировать тонкие изменения голоса.

Именно здесь автоматизированное обнаружение мошенничества становится спасительным средством. Без ИИ-детектора, работающего в режиме реального времени, агенты вынуждены реагировать на срочность и эмоции.

Техники, используемые пародистами Deepfake

- Клонирование голоса при звонках

К 2026 году такие инструменты, как ElevenLabs, Speechify и Murf, смогут создавать убедительные клоны из аудиозаписей длительностью менее 10 секунд.

Что еще более важно, преобразование голоса в реальном времени может превратить голос звонящего в чужой менее чем за 50 миллисекунд.

Для жертвы это звучит живо, естественно и знакомо.

Роботы уже редко дают очевидные подсказки. Без программного обеспечения для защиты от мошенничества агенты не смогут уловить такие тонкие артефакты, как металлические полутона или неестественное дыхание, которые указывают на обман клиентов.

Пример:

- Виз (конец 2024 года): Злоумышленники клонировали голос генерального директора Ассафа Раппапорта, чтобы получить полномочия. Хотя эта попытка провалилась из-за несоответствия тембров, она подчеркнула острую необходимость обнаружения искусственного интеллекта в корпоративных коммуникациях.

- LastPass (начало 2024 года): Один из сотрудников стал жертвой поддельного голоса генерального директора, обученного по видеороликам на YouTube. Этот инцидент показал, что высокопоставленные лица постоянно подвергаются риску, поэтому для защиты внутренних каналов поддержки требуется автоматическое обнаружение мошенничества.

- Видеоролики агентов с заменой лиц

Глубокие подделки с заменой лица используют продвинутые модели искусственного интеллекта для замены лица одного человека на другое в живом видео.

К 2026 году такие инструменты, как DeepFaceLive и Deep-Live-Cam, смогут работать в режиме реального времени с задержкой менее 50 миллисекунд.

Мошенники могут транслировать это измененное видео через такие платформы, как Zoom, Microsoft Teams или Google Meet, используя инструменты виртуальной камеры, такие как OBS Studio. Для собеседника все выглядит нормально.

Пример:

Дело о подставном сотруднике KnowBe4 (июль 2024 года): Северокорейский государственный деятель использовал технологию подмены лиц с помощью искусственного интеллекта, чтобы проходить видеоинтервью в прямом эфире с украденной американской личностью. Его поймали только после того, как внутренняя служба безопасности отметила необычную активность устройства.

- Манипулирование записями с экрана

Злоумышленники все чаще используют искусственный интеллект для создания или изменения записей с экрана, создавая видимость того, что возврат средств, транзакция или обращение в службу поддержки имели место.

Эти фальшивые записи могут манипулировать агентами службы поддержки, отменять споры или эскалировать возврат платежей.

Теперь искусственный интеллект может настолько убедительно подправить временные метки, остатки на счетах и динамические элементы пользовательского интерфейса, что случайный осмотр не заметит этого.

Мошенники могут даже внедрять заранее записанные или подделанные видео в живые звонки в службу поддержки с помощью плагинов для виртуальных камер.

Ранние индикаторы угроз Deepfake

Современные глубокие подделки убедительны. Эффективное предотвращение глубоких подделок заключается в поиске этих “подсказок”:

Аудиоуровень рассказов:

- Клонированные голоса звучат плоско и лишены естественных изменений высоты тона.

- В речи ИИ часто отсутствуют нормальное дыхание и наполняющие звуки.

- Голос может не совпадать с фоновым шумом.

- Преобразование голоса в реальном времени может вызвать небольшие задержки (200-400 мс) при внезапных вопросах.

- Голоса из записей публичных выступлений могут звучать слишком официально для непринужденной беседы.

Рассказы на видеоуровне:

- Волосы, уши и края челюсти могут выглядеть слегка размытыми.

- Мигание происходит через очень регулярные промежутки времени.

- Взгляд не может следовать за камерой естественным образом.

- Освещение на лице может не совпадать с освещением в помещении.

- Микровыражения отсутствуют или очень сглажены.

- Плохое соединение может скрывать артефакты видео, вызванные сжатием.

Поведенческие / интерактивные подсказки:

- Операторы Deepfake избегают неожиданных запросов на проверку.

- Они могут сначала связаться с вами через неофициальные приложения, прежде чем использовать официальные каналы.

- Срочность и скрытность вместе - тревожный знак.

- Они противостоят внеполосным проверкам, например, звонку на известный номер.

Использование средств обнаружения ИИ

TruthScan - это мощная платформа для автоматического обнаружения мошенничества, которой доверяют более 250 миллионов пользователей.

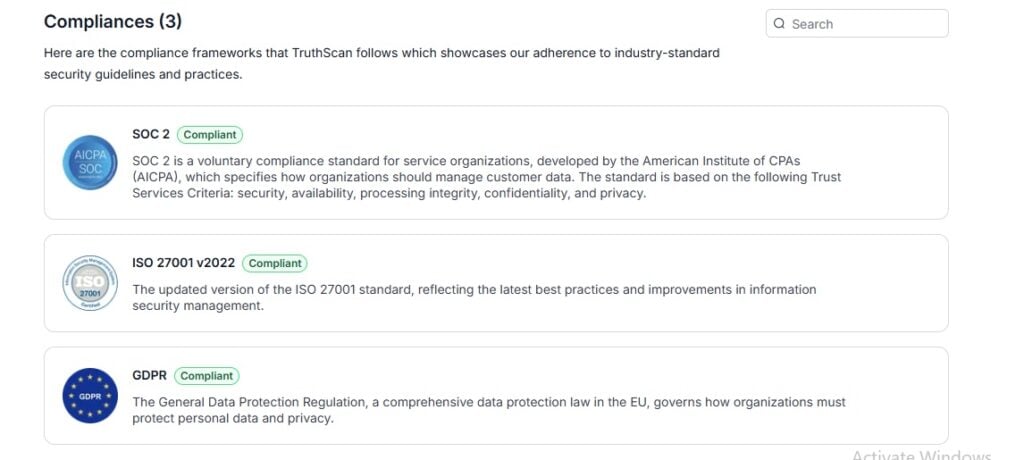

Он полностью сертифицирован по стандартам ISO 27001, SOC 2 и соответствует требованиям GDPR, а также легко работает с такими инструментами, как Salesforce, Microsoft 365, Google Workspace, SAP и Zoom.

- Детектор подделок

Этот детектор глубоких подделок выявляет сгенерированные искусственным интеллектом видео, подмену лиц и манипуляции с медиа во всех основных форматах (MP4, AVI, MOV, MKV, WebM) вплоть до 4K.

Вот как это работает:

- Отслеживает движения лица, моргания и микровыражения.

- Выявляет несоответствия на уровне пикселей, несоответствия освещения и артефакты между кадрами.

- Обнаруживает модели генерации на основе GAN, такие как AnimateDiff, D-ID, HeyGen, Runway Gen-4, Stable Video Diffusion и другие.

Загрузите известное настоящее видео и глубокую подделку (HeyGen/D-ID) на сайт TruthScan Детектор подделок.

- Детектор изображений AI

Детектор изображений TruthScan AI флаги Сгенерированные искусственным интеллектом или обработанные им изображения с таких платформ, как Midjourney, DALL-E, Stable Diffusion, Canva AI, Grok Imagine, StyleGAN и ThisPersonDoesNotExist.

Вот как это работает:

- Замена фона, удаление объектов и редактирование освещения.

- Генерирует баллы доверия и информацию на уровне пикселей без хранения файлов.

Загружайте реальные изображения в сравнении с изображениями, сгенерированными искусственным интеллектом, на сайте TruthScan Детектор изображений AI для сравнения доверительных оценок.

Эффективная защита каналов поддержки

В 2026 году службам поддержки клиентов будет постоянно угрожать мошенничество, управляемое искусственным интеллектом.

Злоумышленники могут подделывать голоса, менять лица на видео в реальном времени или предоставлять файлы с манипуляциями, что делает практически невозможным для агентов определить, что реально, а что нет.

Вот почему так важно обеспечить каналы поддержки.

- Детектор искусственного интеллекта в реальном времени

Детектор ИИ в реальном времени предназначен для обнаружения контента, созданного ИИ, до того, как он попадет к вашим агентам или клиентам.

В отличие от инструментов на основе файлов, которые анализируют загруженные файлы, эта платформа отслеживает живое взаимодействие по электронной почте, чату, телефону и видеоканалу.

Как это поможет вашей команде:

- Обнаружение попыток обнаружения искусственного интеллекта в режиме реального времени.

- Отмечайте сообщения и звонки, сгенерированные искусственным интеллектом, которые пытаются обманом заставить агентов предоставить доступ или обработать запрос.

- Работает с Salesforce, Teams, Gmail, Zoom и другими приложениями, обеспечивая автоматическое обнаружение мошенничества без замедления работы.

- Обработка миллионов взаимодействий по всем каналам без замедления работы.

- Сертификаты SOC 2, ISO 27001 и GDPR означают, что каждое действие проверяется и готово к суду.

Политика и обучение для команд

- Стандартные операционные процедуры

| Название политики | Политика |

| Многофакторная верификация | Требуйте MFA для сброса учетной записи, важных транзакций и изменений в системе безопасности. |

| Проверка каналов | Перенаправляйте все запросы из неофициальных каналов (WhatsApp, Telegram, личная почта) в официальные системы поддержки. |

| Регистрация контактов | Агенты должны регистрировать необычные контакты с указанием канала, времени и характера запроса. |

| Система безопасных слов | Используйте заранее зарегистрированные проверочные фразы для особо ценных аккаунтов. |

| Внеполосная верификация | Любая внутренняя эскалация или запрос руководителя должны быть подтверждены с помощью обратного звонка на официальные номера справочника. |

| Нет одобрения соло | Никогда не разрешайте транзакции или изменения в системе безопасности только на основании видеозвонков или электронных писем. |

| Голосовое подтверждение | Требуйте голосового подтверждения для всех переводов средств, превышающих установленный порог. |

| Проверка СМИ | Сканируйте все фотографии, видео и записи с экрана с помощью детекторов TruthScan перед просмотром человеком. |

| Проверки метаданных | Используйте детектор изображений AI, чтобы отметить несоответствующие EXIF или временные метки. |

| Вторичный обзор | Заявления, представляющие большую ценность, должны пройти вторичную проверку перед обработкой. |

- Обучение персонала по вопросам мошенничества

Сотрудникам необходимо испытать реалистичные глубокие подделки. Исследования показывают, что уровень обнаружения подделок возрастает с 34% до 74% после десятка живых симуляций с участием видеодетектора с искусственным интеллектом.

Красные флажки, за которыми нужно следить:

- Срочность в сочетании с секретностью

- Просьбы, не относящиеся к обычным каналам

- Сопротивление обратному вызову или вторичной проверке

- Обход стандартных процессов

- Эмоциональное давление (страх, чувство вины, авторитет)

- Регулярные проверки безопасности

В 2026 году даже самые лучшие SOP требуют регулярного аудита с помощью автоматизированных протоколов обнаружения мошенничества:

| Название политики | Политика |

| Ежеквартальная оценка угроз | Проверьте новые инструменты для глубокой подделки, проверьте пороги обнаружения и проанализируйте инциденты, которые не были успешными. |

| Аудит безопасности канала | Проверьте каждый канал поддержки на наличие слабых мест; злоумышленники выбирают путь наименьшего сопротивления. |

| Проверка средств обнаружения | Периодически прогоняйте известные подделки через TruthScan, чтобы убедиться, что точность обнаружения не отстает от развивающихся методов искусственного интеллекта. |

| Учения по реагированию на инциденты | Проведите планшетные учения, имитирующие подставных лиц, для проверки уведомлений, блокировки и скорости реагирования. |

| Проверки поставщиков и третьих лиц | Убедитесь, что внешние сообщения от партнеров или клиентов соответствуют тем же стандартам строгой аутентификации, что и внутренние каналы. |

Как TruthScan укрепляет безопасность службы поддержки клиентов

TruthScan создан для предотвращения мошенничества с помощью ИИ на всех уровнях поддержки клиентов. Он объясняет, почему что-то вызывает подозрения, чтобы команды могли действовать уверенно.

| Инструмент | Цель и польза |

| Детектор голоса ИИ | Выявляет клонированные голоса в звонках и записях, защищая живые разговоры от подражания. |

| Детектор подделок | Анализирует видео и изображения, чтобы обнаружить подмену лиц, синтетические личности и манипуляции со СМИ. |

| Детектор изображений AI | Отмечает сгенерированные искусственным интеллектом фотографии профиля, фальшивые идентификаторы и подделанные скриншоты еще до принятия решения. |

| Детектор искусственного интеллекта в реальном времени | Постоянный мониторинг чата, электронной почты и видео с посекундным автоматическим оповещением о мошенничестве. |

| Детектор фальшивых квитанций | Обнаружение сгенерированных искусственным интеллектом квитанций или доказательных документов, используемых в мошеннических заявлениях. |

| Детектор мошенничества по электронной почте | Отлавливает сгенерированные искусственным интеллектом попытки фишинга и атаки BEC до того, как они попадут в почтовый ящик. |

Как он вписывается в стек безопасности службы поддержки клиентов:

- Входящие медиа (фотографии, видео, записи) → Детектор подделок + ИИ-детектор изображений перед человеческим просмотром

- Звонки в службу поддержки в режиме реального времени → Детектор голоса ИИ, анализирующий записи звонков или прямые трансляции

- Сеансы видеоподдержки → Детектор Deepfake в режиме реального времени или после вызова

- Каналы электронной почты и чата → Детектор искусственного интеллекта в реальном времени для непрерывного мониторинга

- Предоставление документов (удостоверения личности, квитанции, скриншоты) → Детектор поддельных квитанций + детектор изображений AI

Поговорите с TruthScan о защите от подделок в службе поддержки

Не ждите, пока станет слишком поздно. TruthScan поможет вашей команде обнаружить контент ИИ до того, как он попадет к вашим агентам.

Выберите, как начать:

- Проверьте сами: Попробуйте все инструменты обнаружения TruthScan, получив 20 000 бесплатных кредитов. Оплата не требуется. → Начните бесплатную пробную версию на сайте TruthScan.

- Демоверсия предприятия: Наша команда продемонстрирует вам индивидуальное развертывание для Salesforce, Microsoft 365, Zoom и Google Workspace. → Закажите демонстрацию по адресу TruthScan.

Защитите свои каналы поддержки уже сегодня, потому что видеть - не значит верить, а проверять - значит проверять.