Как технология deepfake уносит миллиарды из глобального бизнеса - и почему каждый руководитель теперь является мишенью

Цифры не лгут

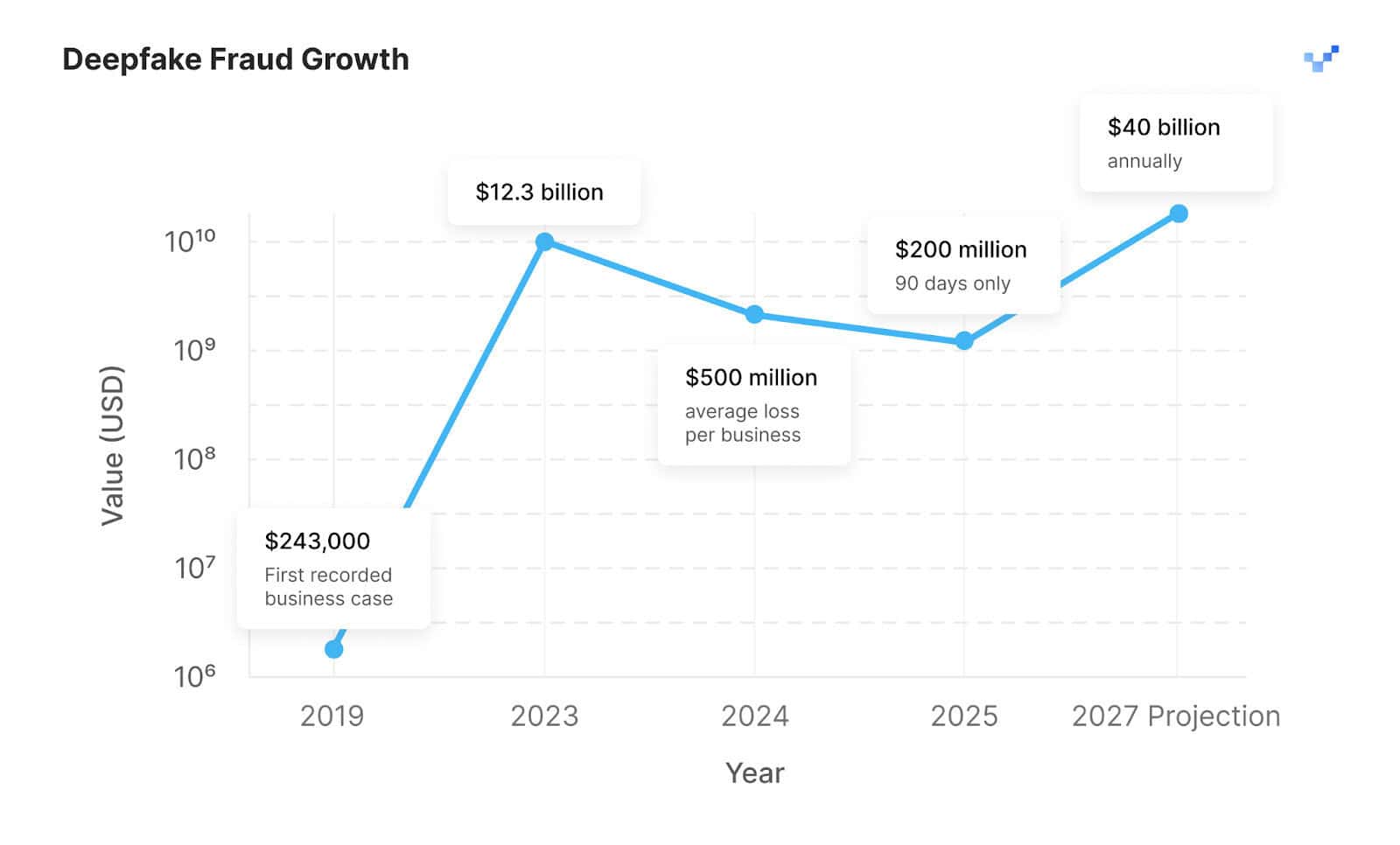

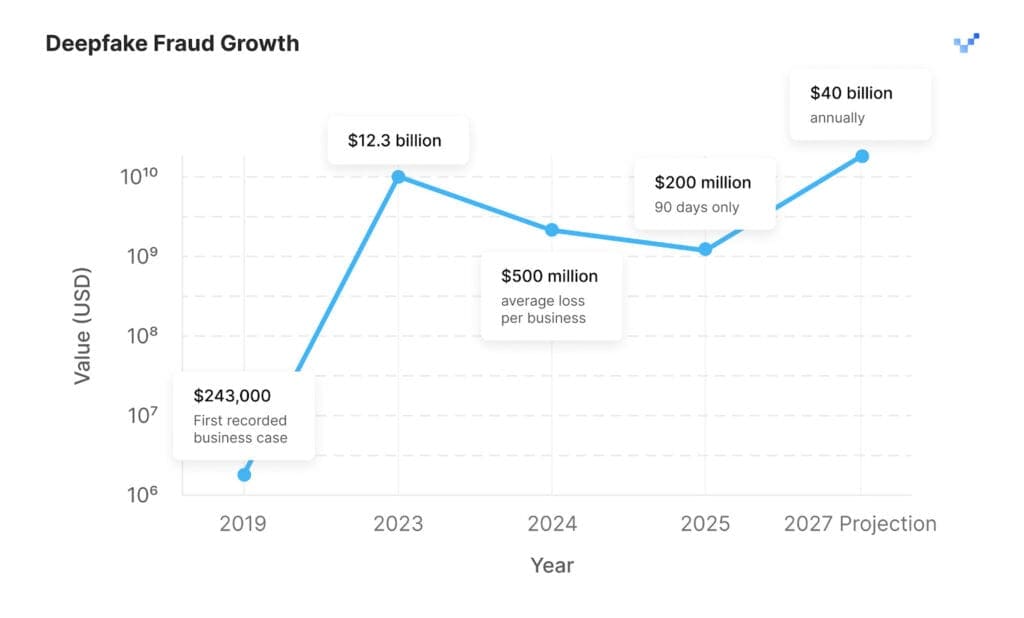

Только за первый квартал 2025 года мошенничество с использованием Deepfake принесло более $200 миллионов убытков.Согласно последнему отчету об инцидентах, подготовленному компанией Resemble AI. Но это лишь верхушка айсберга; эксперты по безопасности предупреждают, что он может достигнуть $40 миллиардов ежегодных убытков по всем Соединенным Штатам к 2027 году.

Математика цифрового обмана отрезвляет:

Это представляет собой среднегодовой темп роста 32%-быстрее, чем большинство кривых внедрения технологий, и уж точно быстрее, чем наша способность защищаться от них.

Никогда больше не беспокойтесь о мошенничестве с помощью искусственного интеллекта. TruthScan Мы можем помочь вам:

- Обнаружение сгенерированного искусственного интеллекта изображения, текст, голос и видео.

- Избегайте Крупнейшее мошенничество, управляемое искусственным интеллектом.

- Защитите свои самые чувствительный активы предприятия.

Масштаб уязвимости

Недавнее исследование компании Deloitte показало, что 25,9% руководителей компаний уже сталкивались с инцидентами deepfake, направленными на их финансовые данные. за последние 12 месяцев. Еще более тревожно: 50% ожидают увеличения числа атак в течение следующего года.

Влияние региона на ситуацию говорит о многом:

- Северная Америка: 1,740% рост числа случаев мошенничества deepfake в 2023 году

- Средние потери бизнеса: $500 000 за инцидент

- Влияние на крупные предприятия: До $680 000 за атаку

Почему взрыв произошел именно сейчас?

Раньше создание подделок было уединенным занятием в дальних уголках глубокой паутины, где коварные киберпреступники обменивали криптовалюту на пароли.

Теперь инструменты искусственного интеллекта доступны всем желающим, а чат-боты общего назначения могут использоваться для случайного обмана существующих систем.

Их возможности намного опережают способность широкой общественности распознать их. Как объясняет эксперт по кибербезопасности Дэвид Фэйрман из компании Netskope: "Общедоступность этих сервисов снизила барьер входа для киберпреступников - им больше не нужно обладать специальными технологическими навыками".

Криминальная экономика:

- Стоимость создания: По цене $20 за базовое программное обеспечение для глубокой подделки

- Уровень успеха: Достаточно один раз поработать, чтобы получить огромный возврат инвестиций

- Скорость обнаружения: 68% людей не могут отличить настоящее видео от подделки

- Клонирование голоса: Требуется всего 3-5 секунд аудио образца для точности 85%

Недавние атаки Deepfake

Глубокий всплеск фальсификаций в автостраховании Великобритании (2024) Британские страховщики, в том числе Allianz и Zurich, сообщили о росте числа мошеннических претензий с использованием фотографий и видео, обработанных искусственным интеллектом, на 300% в период с 2021 по 2023 год, причем в 2024 году эта тенденция усилится. В одном из конкретных случаев мошенники манипулировали данными камер видеонаблюдения, чтобы изменить дату, время и регистрационный номер автомобиля в обоснование предполагаемого заявления о ДТП. Kennedys Law LLPЛюбовь к деньгам. По данным Ассоциации британских страховщиков, в 2023 году средняя сумма мошеннических претензий составляла 15 000 фунтов стерлингов, и эти преступления добавляли примерно 50 фунтов стерлингов в год к страховым взносам среднего страхователя на страхование автомобиля и дома.

Попытка пародирования генерального директора Ferrari (2024) В июле 2024 года итальянская автомобильная компания Ferrari подверглась атаке, в ходе которой мошенники пытались обмануть финансовых руководителей, используя цифровую пародию на генерального директора Бенедетто Винья. Сначала мошенники связывались с руководителями по WhatsApp, спрашивая о "крупном приобретении, которое мы планируем", а затем переходили к поддельным голосовым звонкам, воспроизводящим характерный южноитальянский акцент Виньи (статья здесь).

Мошенничество в федеральных государственных службах (2024) По данным исследования GB Group, около 8,6 миллиона человек в Великобритании использовали фальшивые или поддельные удостоверения личности для доступа к государственным услугам. Глубокие поддельные идентификаторы с поддержкой искусственного интеллекта все чаще используются для различных афер, в том числе для получения доступа к государственным услугам по поддельным учетным данным .ID.me В период с 2023 по 2024 год было отмечено резкое увеличение числа векторов атак: число атак на подмену лиц выросло на 300%, число атак на внедрение изображений и видео увеличилось на 783%, а число атак на виртуальные камеры выросло на 2665%.

Налог на доверие

Помимо прямых финансовых потерь, глубокие подделки накладывают на мировую торговлю то, что экономисты называют "налогом на доверие". Когда 32% руководителей компаний не уверены в том, что их сотрудники могут распознать попытки мошенничества deepfake.Но расходы выходят далеко за рамки отдельных инцидентов.

Теперь организации вынуждены инвестировать в:

- Усовершенствованные протоколы проверки

- Программы обучения сотрудников

- Передовые технологии обнаружения

- Возможности антикризисного управления

- Соблюдение правовых и нормативных требований

И все же, несмотря на эту растущую угрозу, только 29% фирм предприняли шаги для защиты себя, с 46% без какого-либо плана по смягчению последствий.

Ускорение впереди

FinCEN (Сеть по борьбе с финансовыми преступлениями) отмечает "увеличение количества сообщений о подозрительной деятельности со стороны финансовых учреждений, в которых говорится о предполагаемом использовании deepfake media в мошеннических схемах", начиная с 2023 года и до 2024 года.

Проблема в $25 миллиардов - это не просто деньги, это фундаментальная эрозия доверия к цифровым коммуникациям, которые обеспечивают современный бизнес. Каждый видеозвонок, каждое аудиосообщение, каждое цифровое взаимодействие теперь сопряжено с вопросом: "Откуда я знаю, что это правда?".

Руководители, которые первыми преодолеют этот кризис доверия, получат решающее преимущество. Те, кто этого не сделает, могут оказаться в главной роли в собственном примере мошенничества с глубокой подделкой.

Ссылки:

Resemble AI Q1 2025 Deepfake Incident Report - $200 миллионов в первом квартале 2025 года

Центр финансовых услуг Deloitte (май 2024 года) - Прогноз $40 млрд к 2027 году, 25,9% руководителей столкнулись с инцидентами, 50% ожидают увеличения

Variety (18 апреля 2025) - "Мошенничество с помощью Deepfake уже привело к финансовым потерям в размере $200 миллионов в 2025 году".

Eftsure US (2025) - "Статистика Deepfake (2025): 25 новых фактов для финансовых директоров" - $500 000 убытков среднего бизнеса, $680 000 убытков крупных предприятий

CNBC (28 мая 2024 года) - Дэвид Фэйрман цитата из книги Netskope

Отчет о мошенничестве с использованием личных данных Entrust 2025 - 3,000% увеличение количества глубоких подделок с 2022-2023 гг.

Оповещение FinCEN FIN-2024-Alert004 - Увеличение числа сообщений о подозрительной деятельности

Различные исследования, цитируемые в Eftsure - 32% руководителей не доверяют распознаванию сотрудников, 68% не могут отличить настоящее видео от подделки, для клонирования голоса требуется 3-5 секунд