В 90-е годы это была ДНК.

В 2000-х годах это были пинги с сотовых вышек.

Но в 2026 году новым золотым стандартом доказательств станут цифровые отпечатки пальцев.

Подумайте об этом так...

Каждый видеофайл имеет уникальную подпись.

Если хотя бы один пиксель будет изменен искусственным интеллектом, отпечаток пальца мгновенно изменится.

Если у вашего ИИ-доказательства нет проверенной временной метки на блокчейне, чтобы зафиксировать этот отпечаток пальца, то в глазах современного судьи оно может оказаться карикатурой.

Это означает, что эпоха “видеть - значит верить” закончилась.

Мы вступили в эру видеоверификации с искусственным интеллектом, когда доказательством служит не то, что вы видите, а цифровой код, скрытый под поверхностью.

В этом блоге мы расскажем о том, почему традиционные доказательства оказываются несостоятельными в борьбе с видеомошенничеством, как выявить манипуляции с видеороликами, почему проверка имеет решающее значение для допустимости, и почему видеодетектор с искусственным интеллектом, такой как TruthScan, стал незаменим для юридических команд.

Давайте погрузимся.

Основные выводы

- В 2026 году все видеодоказательства должны проходить видеоверификацию ИИ, чтобы считаться достоверными.

- Мошенничество с видео включает в себя небольшие правки, такие как манипуляции с временными метками, а не только полную замену лица.

- Профессиональный детектор глубоких подделок - единственный способ поймать артефакты GAN, которые человек не замечает.

- Новые правила, такие как Федеральное правило 707, стандартизируют порядок принятия доказательств ИИ в суде.

- Автоматизированный анализ доказательств позволяет фирмам быстро и точно обрабатывать огромные пакеты документов.

- TruthScan предотвращает мошенничество во время прямых слушаний, обнаруживая синтетические маски в режиме реального времени.

Что такое видеодоказательства в судебных спорах?

Видеодоказательства - это, по сути, любой записанный ролик, используемый в суде для доказательства произошедшего. Они используются повсеместно - от уголовных дел до страховых выплат.

Однако в 2026 году рост видеомошенничества сделал “видеть - значит верить” опасным предположением. Юристы теперь нуждаются в надежной видеопроверке с помощью искусственного интеллекта, чтобы гарантировать честность системы правосудия.

Виды видеодоказательств, которые суды используют каждый день

Никогда больше не беспокойтесь о мошенничестве с помощью искусственного интеллекта. TruthScan Мы можем помочь вам:

- Обнаружение сгенерированного искусственного интеллекта изображения, текст, голос и видео.

- Избегайте Крупнейшее мошенничество, управляемое искусственным интеллектом.

- Защитите свои самые чувствительный активы предприятия.

- Видеонаблюдение (CCTV): Камеры в магазинах или на светофорах. Это самое распространенное доказательство в уголовных делах.

- Телесные камеры: Видеозаписи с полицейскими, используемые в основном в делах о гражданских правах или чрезмерном применении силы.

- Видеокамеры: Убедительные доказательства при автомобильных авариях и страховых спорах.

- Записанные свидетельства: Видеодекларации или удаленные показания свидетелей, ставшие нормой после пандемии. Теперь это стандарт, но чревато проблемами с обнаружением мошенничества.

- Смартфон и социальные сети: Видеозаписи от очевидцев или сообщения, подтверждающие чье-то поведение или местоположение.

- Безопасность компании: Материалы, используемые корпорациями в делах о мошенничестве или “незаконном увольнении”.

Генеративный ИИ и технология глубокой подделки добавили новый уровень риска. В 2025 г:

- 1 из 20 проверок личности был обманут глубокими подделками ИИ

- По данным исследования, проведенного компанией Medius, 43% профессионалов стали жертвами попытки мошенничества с помощью deepfake

Реальные случаи мошенничества с видеодоказательствами

- Манипулированные ролики из зала суда

Манипулированные ролики в зале суда - это любые видео- или аудиодоказательства, представленные в судебном деле, которые были изменены, отредактированы или полностью сфабрикованы с помощью технологий.

Примеры:

- Случай глубокой подделки округа Аламеда (2025 год): Гражданское дело в Калифорнии было прекращено после того, как суд обнаружил, что видеозапись со свидетелями, представленная в качестве доказательства, была полностью создана с помощью искусственного интеллекта.

- Защита от глубоких подделок "Sz Huang против Tesla" (2023): В иске о причинении смерти по неосторожности адвокаты Tesla утверждали, что ключевые кадры аварии могут быть глубокой подделкой.

Измененные видеозаписи с камер наблюдения

Видео с камер наблюдения - один из самых распространенных видов доказательств ИИ, используемых в суде. Однако многие ошибочно считают, что манипуляции - это только полные глубокие подделки.

В действительности видеомошенничество часто происходит более мелкими, менее очевидными способами, которые могут скомпрометировать дело.

К распространенным видам манипуляций относятся:

- Изменения временной метки

- Снятие рамы

- Изменения метаданных или GPS

- Замена лица

- Извлечение или введение предметов

- Зацикленные кадры

- Снижение качества

Видео с камер наблюдения часто поступает из самых разных мест: частных магазинов, домофонов, парковок и городских камер. В отличие от записей, сделанных полицейскими камерами, эти системы обычно не следуют строгим правилам цепочки хранения.

Это значит:

- Может не быть четких сведений о том, кто занимался этим делом.

- Отснятый материал можно многократно копировать, передавать или конвертировать.

- Процедуры аутентификации могут быть слабыми или непоследовательными.

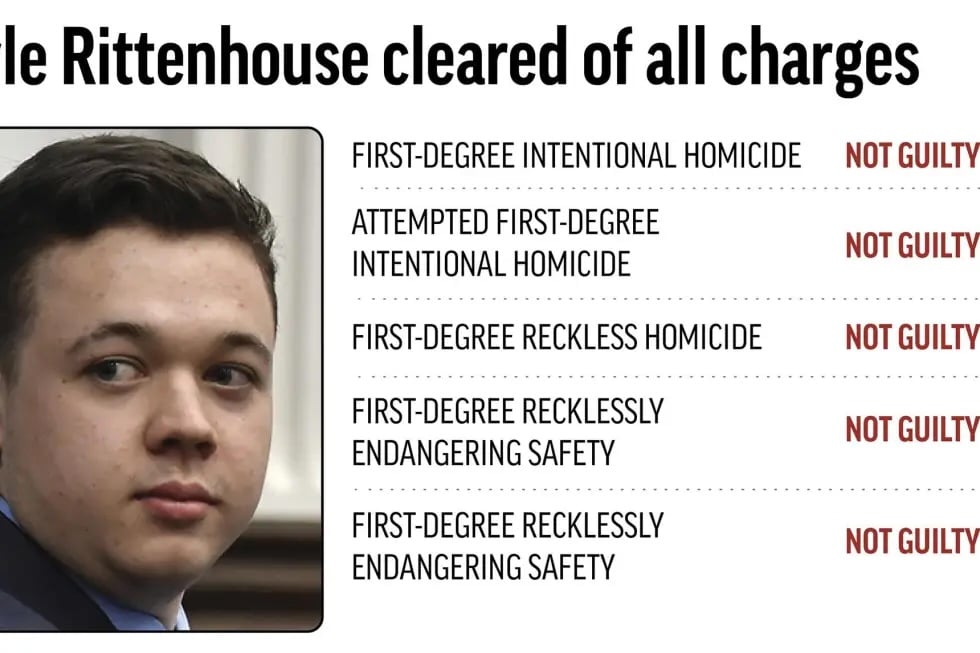

Пример: Проблема усиления искусственного интеллекта в деле Висконсин против Риттенхауса

Известный пример произошел в суде по делу Висконсин против Риттенхауса. Обвинение пыталось использовать функцию масштабирования на iPad, чтобы показать детали на видео с беспилотника.

Защита утверждала, что зум Apple использует интерполяцию искусственного интеллекта, чтобы угадать, что там должно быть. Судья постановил, что без профессионального видеодетектора с искусственным интеллектом увеличенные кадры не могут быть приняты к рассмотрению.

Спорные видеосвидетельства

Спорные видеосвидетельства, как правило, требуют юридической экспертизы на предмет мошенничества, чтобы определить, является ли запись таковой:

- Полностью сфабрикованные показания или заявления

- Настоящее свидетельство, которое оспаривается как подделка

- Манипулированная реальная запись

Каждый из сценариев создает для суда серьезное бремя проверки подлинности.

Пример: Дело об опеке над ребенком в Великобритании

В одном из семейных судебных споров Великобритании, о котором говорится в юридическом обзоре Балтиморского университета, мать представила сильно измененную запись, чтобы представить отца жестоким во время борьбы за опекунство.

Цель заключалась в том, чтобы ограничить его доступ к детям.

Рост использования видео, созданных искусственным интеллектом, в юридических вопросах

Путь к нынешней эре детекторов deepfake проходил в несколько этапов:

- Годы раннего предупреждения (2017-2021)

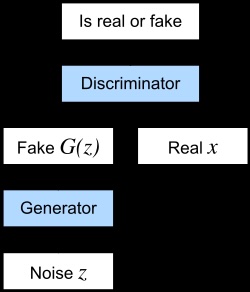

Технология Deepfake (основанная на генеративных состязательных сетях (GAN)) стала достоянием общественности примерно в 2017 году.

Первые глубокие подделки часто были низкого качества: лица со странными искажениями, лишние пальцы, несоответствующее освещение и размытые черты, что облегчало их обнаружение.

- Фаза эскалации (2022-2023)

К 2022 году технологии усовершенствовались. Многие из них были бесплатными и могли использоваться на смартфоне.

В 2023 году мы начали наблюдать первые серьезные судебные разбирательства, связанные с deepfake, включая дела Sz Huang против Tesla, United States против Reffitt и United States против Doolin, в которых адвокаты поднимали вопросы о том, могут ли видеодоказательства быть сгенерированы искусственным интеллектом.

Примерно в то же время Консультативный комитет Американской ассоциации юристов по правилам доказывания официально начал изучать этот вопрос.

- Критический порог (2024-2025)

Контент, созданный искусственным интеллектом, недолго оставался академическим. В 2024 году в инженерной компании Arup произошел инцидент, связанный с поддельным видеозвонком, сгенерированным ИИ, который разрешил мошенничество. электронные переводы на общую сумму $25 млн..

Юридическая система начала реагировать.

В 2025 году, В Луизиане принят закон HB 178, Создана первая система проверки доказательств ИИ на уровне штата.

На федеральном уровне Консультативный комитет по правилам доказывания США предложил Правило 707, посвященное доказательствам, сгенерированным машиной.

Что будет в 2026 году

К началу 2026 года регулирование deepfake и AI-видео ускорится по всей стране:

- 46 штатов в той или иной форме приняли закон о глубоких подделках.

- С 2022 года, Принято 169 законов и внесено 146 законопроектов только в 2025 году.

- Федеральное правило 707 открыто для публичных комментариев до 16 февраля 2026 года.

Улучшение проверки видео с помощью искусственного интеллекта

Самый эффективный способ обнаружить видео, созданное ИИ, - использовать сам ИИ.

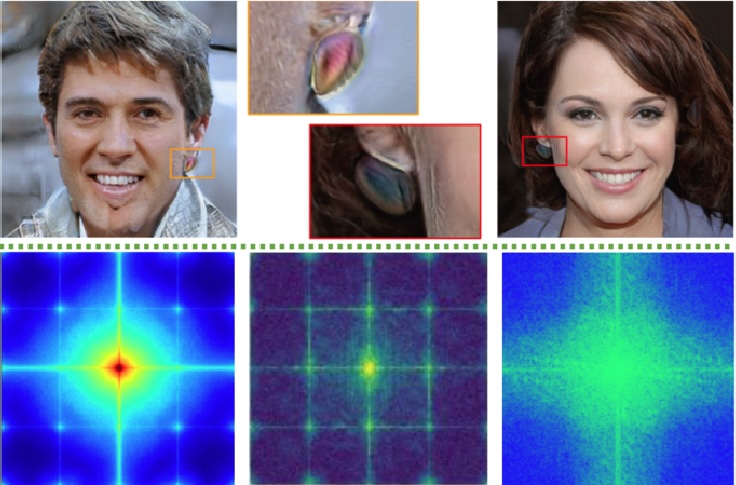

Это связано с тем, что глубокие подделки создаются системами машинного обучения, которые оставляют за собой едва уловимые цифровые узоры.

Эти узоры слишком малы или сложны, чтобы человеческий глаз мог их заметить. Но они могут быть обнаружены другими алгоритмами.

Надежная система видеопроверки с искусственным интеллектом может анализировать сразу несколько слоев видео, включая:

- Анализ на уровне фреймов Проверяет каждый кадр на наличие визуальных ошибок, таких как странные текстуры, несоответствие освещения или проблемы со смешиванием вокруг лиц.

- Анализ временной когерентности просматривает движение по кадрам, чтобы найти неестественные прыжки или непоследовательные движения.

- Отслеживание ориентиров на лице Следит за движением глаз, морганием и формой лица, чтобы обнаружить неестественные изменения.

- Тестирование аудиовизуальной синхронизации Проверяет, точно ли движения губ соответствуют произносимым словам.

- Аудиокриминалистика анализирует голос на предмет признаков клонирования, например, необычных звуковых паттернов или роботизированных тонов.

- Анализ метаданных и сжатия Изучение данных скрытых файлов необходимо для выявления юридического мошенничества, чтобы проверить, совпадают ли они с оригинальными данными записи.

Обучение юридических специалистов по вопросам видеомошенничества

Поскольку искусственный интеллект теперь может имитировать поведение человека с ужасающей точностью, юридические фирмы используют автоматизированный анализ доказательств и сочетание традиционных тактик, чтобы быть впереди.

| Категория | Метод | Описание |

| Официальные способы | Кредиты CLE (непрерывное юридическое образование) | Обязательные или факультативные курсы, обучающие юристов проверять подлинность цифровых доказательств, разбираться в подделках и соблюдать стандарты доказательной базы. |

| Эксперты по искусственному интеллекту, назначенные судом | Учреждение сертифицированных специалистов по судебной экспертизе ИИ, аналогичных экспертам по ДНК, для оценки спорных видеодоказательств в суде. | |

| Неофициальные способы | Внутренняя красная команда | Нанимайте специалистов по кибербезопасности для проверки того, могут ли поддельные или подтасованные доказательства проскользнуть через системы приема документов фирмы. |

| “Протокол ”Проверка вибраций" | Обучение персонала выявлению распространенных признаков deepfake, таких как неестественное моргание, искаженные черты лица или проблемы с синхронизацией губ, прежде чем передавать дело на экспертизу. |

Инструменты и технологии для проверки доказательств

В 2026 году мы перешли от простого осмотра глазами.

Поскольку искусственный интеллект способен обмануть даже самых опытных следователей, юридические команды используют специальный набор инструментов для проверки того, что увиденное ими - чистая правда.

Технология, лежащая в основе проверки доказательств

- Детекторы фальшивок: Это специализированные программы, которые сканируют на наличие артефактов GAN. Это микроскопические математические узоры или шум, оставленные моделями искусственного интеллекта, которые генерируют синтетические лица. В то время как человек видит лицо, детектор видит не принадлежащую ему цифровую подпись.

- TruthScan Это глубокий детектор подделок, который покадрово сканирует видео на наличие признаков искусственного интеллекта, таких как необычное моргание, странные формы лица или ошибки в пикселях, где добавлено поддельное лицо.

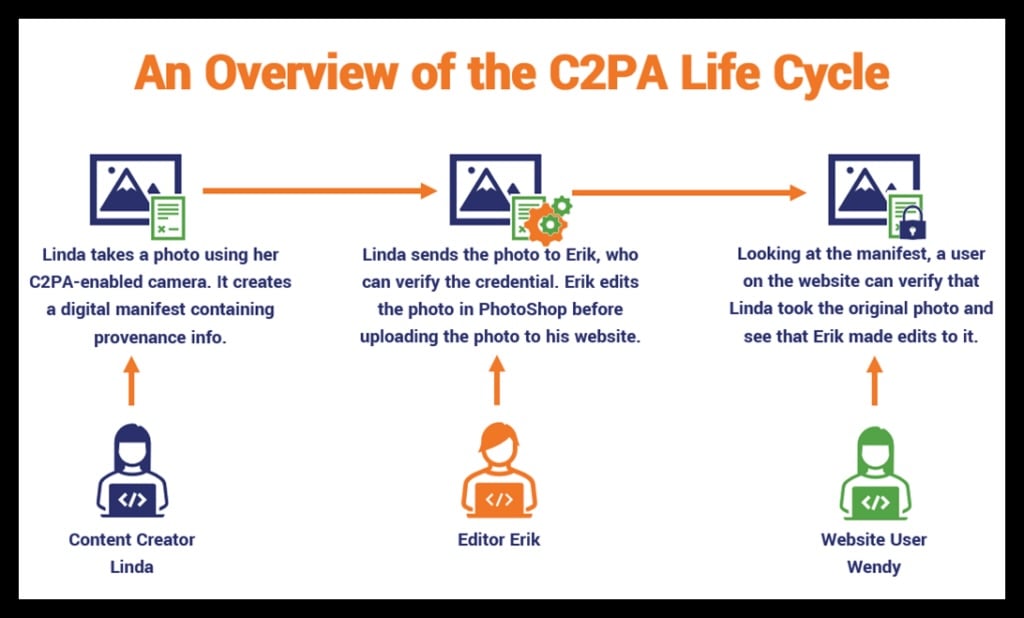

- Временные метки блокчейна: Чтобы доказать, что видео не трогали с момента его записи, многие агентства используют стандарт C2PA. Когда видео записывается на совместимое устройство, создается уникальный цифровой отпечаток (хэш), который хранится в блокчейне.

- TruthScan может проверить, совпадает ли этот отпечаток с видео, и показать, не был ли файл отредактирован или не была ли нарушена цепочка хранения.

- Инструменты для судебной экспертизы метаданных: У каждого цифрового файла есть свидетельство о рождении, известное как данные Exif. Эти инструменты проверяют, не был ли файл пересохранен в программе редактирования AI или не были ли подделаны данные о местоположении (GPS). Если видео утверждает, что оно снято магазинной камерой, но метаданные показывают, что оно было экспортировано из видеоредактора, у вас проблемы.

- Amped Software и TruthScan исследуют скрытые данные файлов (Exif, заголовки), чтобы определить, было ли видео отредактировано или обработано искусственным интеллектом.

Тенденции в области искусственного интеллекта для видеодоказательств

Вот три тренда 2026 года.

- Генеративная адверсарная криминалистика: ИИ против ИИ

Самый продвинутый способ поймать deepfake в 2026 году - использовать ту же технологию, которая его создала. Этот способ известен как генеративная адверсарная криминалистика.

- Один ИИ (генератор) пытается создать фальшивку, а другой ИИ (дискриминатор) пытается ее поймать. В зале суда такие инструменты, как TruthScan, могут стать главным дискриминатором.

- Пример: Истец присылает видеозапись, на которой генеральный директор заключает устный договор. TruthScan сканирует видео, используя собственные состязательные модели для обнаружения артефактов GAN. Если программа отмечает синтетическую вероятность 98%, доказательство, скорее всего, является подделкой, чтобы обмануть человеческие глаза.

- Анализ синхронизации аудио- и видеосигнала (правило 0,01 мс)

Человек обычно может заметить задержку, если звук в видео отклоняется примерно на 40-80 миллисекунд. Однако глубокие подделки 2026 года часто почти идеальны.

- Современные криминалистические инструменты ИИ теперь ищут 0,01-миллисекундную задержку между фонетическим звучанием слова и механическим движением губ.

- Пример: В деле о домогательствах 2026 года ответчик заявил, что видеозапись была подделана. Криминалистический автоматизированный анализ доказательств показал, что формы губ “М” и “Б” были рассинхронизированы со звуком на 0,02 мс. Эта микроскопическая ошибка доказывает, что голос был клонирован и наложен на другое видео, что привело к прекращению дела.

- Дешевые подделки против глубоких подделок

В то время как в глубоких подделках используется высокотехнологичный искусственный интеллект, дешевые подделки являются наиболее распространенной формой видеомошенничества.

- Глубокий фейк создает реальность, которой никогда не было (например, подмена лица). Дешевая подделка берет реальные кадры и изменяет контекст или замысел с помощью простых инструментов.

- Пример (Замедление): Видео, на котором политик выглядит пьяным или не в себе, можно создать, просто замедлив кадры на 20% и изменив шаг звука.

- Пример (повторный контекст): Видеозапись с акции протеста 2022 года в другой стране размещена в 2026 году как живое свидетельство местных беспорядков. Теперь юристы используют анализ метаданных TruthScan, чтобы доказать реальную дату рождения видео.

Как TruthScan защищает юридические видеодоказательства

TruthScan гарантирует, что каждый кадр, который вы представите в суде, будет подлинным, проверенным и юридически обоснованным.

Платформа упрощает проверку видео с помощью искусственного интеллекта благодаря следующим преимуществам:

Автоматизированные журналы аудита и документация по цепочке поставок

- Надежность, готовая к суду: Генерирует отчеты в форматах PDF и JSON, документирующие каждый шаг проверки с точными показателями достоверности и временными метками.

- Соответствие требованиям высшего уровня: Будьте спокойны, зная, что ваши данные остаются в безопасности и соответствуют строгим мировым стандартам, таким как SOC 2, ISO 27001 и GDPR.

- Гибкий контроль данных: Сохраняйте конфиденциальные данные в пределах требуемой юрисдикции с помощью вариантов развертывания в локальной сети или в виртуальной среде, разработанных для отраслей с жестким регулированием.

Пакетная обработка и интеграция API для юридических рабочих процессов

- Значительная экономия времени: Одновременная обработка тысяч файлов из пакетов обнаружения или наборов наблюдений с помощью массового импорта из хранилища (S3/GCS).

- Бесшовное электронное обнаружение: Оптимизируйте свои операции, интегрируя проверку непосредственно в существующее программное обеспечение с помощью веб-крючков и API.

- Устраните ошибки, допущенные вручную: Автоматизируйте первый этап проверки доказательств, чтобы ваша команда могла сосредоточиться на стратегии, а не на утомительной проверке каждого файла.

Верификация в режиме реального времени для дачи показаний и удаленных слушаний

- Остановить самозванство: Используйте конечные точки прямой трансляции, чтобы обнаружить, использует ли обвиняемый фильтры deepfake или голосовые клоны во время удаленного слушания.

- Поддерживайте целостность суда: Отмечайте визуальные или звуковые аномалии в режиме реального времени, предотвращая попадание в протокол мошеннических показаний.

- Спокойствие: Обеспечьте своим клиентам и суду дополнительный уровень безопасности, гарантирующий, что человек на экране - именно тот, за кого он себя выдает.

Узнайте больше о защите видеодоказательств искусственного интеллекта

Защитите свою компанию от рисков, связанных с манипуляциями в СМИ. Технология TruthScan по глубокому обнаружению фальшивок и видеодетектор с искусственным интеллектом представляют собой оптимальное решение для электронного обнаружения и юридической проверки.

Готовы увидеть TruthScan в действии?

- Посетите сайт truthscan.com чтобы получить бесплатно 20 000 кредитов.

- Для получения информации о предприятиях, интеграции API или индивидуальных вариантах развертывания обращайтесь к их команде по адресу Truthscan.com/contact.