Всего несколько лет назад, чтобы имитировать чей-то голос, требовалась профессиональная студия и немалые технические навыки.

Теперь любой человек, имеющий подключение к Интернету и немного свободного времени, может создать цифровой клон любого голоса менее чем за минуту.

Инструменты для таких атак с каждым днем становятся все дешевле и доступнее для всех. А поскольку многие люди делятся своей жизнью в социальных сетях, мошенникам очень легко найти нужные им аудиозаписи.

В этой статье мы расскажем вам о некоторых печально известных примерах мошенничества в сфере аудио. Мы также познакомим вас с решением, позволяющим своевременно покончить с этими угрозами.

Основные выводы

- За последние годы число попыток подделки голоса выросло более чем на 2137%, чему способствует тот факт, что современный искусственный интеллект может создать 85% точный клон голоса, используя всего три секунды исходного аудио.

- Среди известных реальных атак - ограбление инженерной компании Arup в 2024 году, когда мошенники использовали поддельное видео и аудио финансового директора, чтобы обманом заставить сотрудника перевести $25,6 миллиона.

- Помимо корпоративного воровства, подделки голоса представляют серьезную эмоциональную опасность для семей в результате мошенничества с похищением людей и могут обойти традиционные биометрические системы безопасности, используемые банками и другими высокозащищенными приложениями.

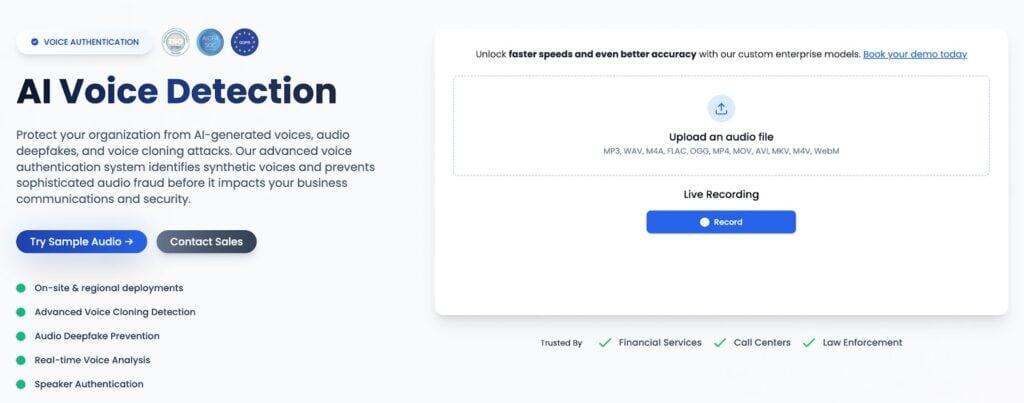

- Организациям приходится выходить за рамки человеческой верификации, внедряя протоколы утверждения крупных переводов несколькими лицами и применяя детекторы голоса с искусственным интеллектом, такие как TruthScan, для анализа акустических отпечатков пальцев в режиме реального времени.

- TruthScan обеспечивает безопасность корпоративного взаимодействия, выявляя синтетические речевые артефакты с таких платформ, как ElevenLabs и Murf, с точностью более 99% во всех основных аудио- и видеоформатах.

Что такое голосовые атаки Deepfake?

Голосовой фейк - это цифровая подделка чьего-либо голоса. Злоумышленник использует программное обеспечение, способное анализировать каждую мелочь в речи человека на основе записи его голоса.

Чтобы клонировать голос, программа пытается заметить в нем закономерности. В основном программа учитывает такие вещи, как высота тона, тембр, дыхание между предложениями и т. д.

Узнав эти шаблоны, злоумышленник может заставить его говорить что угодно этим голосом.

Никогда больше не беспокойтесь о мошенничестве с помощью искусственного интеллекта. TruthScan Мы можем помочь вам:

- Обнаружение сгенерированного искусственного интеллекта изображения, текст, голос и видео.

- Избегайте Крупнейшее мошенничество, управляемое искусственным интеллектом.

- Защитите свои самые чувствительный активы предприятия.

Опасно то, что инструменты для создания голосовых deepfake легко доступны. И большинство из них не требуют установки. Они доступны в Интернете в виде веб-сайтов.

Вам просто нужно выложить несколько долларов и начать клонировать голоса. Если немного покопаться, можно даже найти инструменты, позволяющие клонировать голоса бесплатно.

Эта новая и легкодоступная технология привела к резкому росту мошенничества с аудиосистемами.

Мошенникам нужен лишь крошечный кусочек аудиозаписи человека, которую они могут получить из социальных сетей или другого публичного канала, чтобы клонировать его.

Затем они могут использовать клонированный голос, чтобы выдать себя за человека в таких ситуациях, как телефонные звонки, видеовстречи, голосовые заметки, объявления и т. д.

Это не просто гипотетические случаи использования голосовых атак deepfake. Такие случаи уже происходили. Мы рассмотрим некоторые из известных атак с подделкой голоса позже.

Потенциальные риски атак на голосовые подделки

Услышав о voice deepfake, вы, возможно, представили себе забавное видео, в котором знаменитость говорит то, чего она никогда не говорила.

Но такое, казалось бы, безобидное использование клонированного голоса может нанести серьезный ущерб собеседникам. Давайте поговорим о рисках.

Финансовое опустошение для бизнеса

Подделка голоса может навсегда испортить репутацию компании. Она также способна лишить ее крупных сумм денег за считанные минуты.

Как же так, спросите вы? Мошенники могут клонировать голос начальника компании и с его помощью звонить сотрудникам, заставляя их делать то, что не положено, например переводить деньги на счет.

Это лишь один из примеров. Возможности безграничны.

Обход систем безопасности

Ваш голос - это биометрическая характеристика, которой никто не должен обладать. Это потому, что вы используете его как пароль для входа во многие приложения, особенно банковские.

Хотя эти приложения могут иметь встроенную систему автоматической проверки голоса для предотвращения несанкционированного доступа, у хорошего голосового клона все равно есть шанс обмануть их.

Эмоциональный удар по семьям

Пожалуй, самыми легкими мишенями для аудиомошенников являются пожилые члены семьи. Например, родители, бабушки и дедушки.

Мошенники могут позвонить, например, матери и воспроизвести звук крика ее дочери о помощи, сказав, что ее похитили.

Уменьшение доверия на рабочем месте

Голосовые атаки deepfake также подрывают доверие к здоровому рабочему месту.

Сотрудникам придется перепроверять телефонные звонки от своего руководителя, чтобы убедиться, что это не мошенник, который клонированным голосом приказывает им совершить рискованные действия.

Что же тогда делать, если не перепроверять вручную? Все риски, о которых мы только что говорили, указывают на необходимость автоматического предотвращения атак deepfake.

К счастью, теперь у нас есть инструменты для обнаружения глубоко поддельных голосов ИИ, и TruthScan - один из них.

Предотвращайте мошенничество и выдачу себя за другого с помощью TruthScan Детектор голоса ИИ.

Реальные примеры атак на подделку голоса

Благодаря искусственному интеллекту мы достигли того момента, когда уже не можем доверять тому, что видят наши глаза или слышат уши. ИИ теперь способен создавать реалистичные изображения и видео. То же самое касается и аудио.

Возможно, вы уже слышали истории о том, как люди попадались на мошенничество с аудиозаписями deepfake. Они постоянно всплывают в новостях и социальных сетях. Некоторые из них трудно понять.

Давайте расскажем вам о некоторых наиболее известных атаках с подделкой голоса, чтобы вы могли получить представление о том, как ловко они осуществляются.

Виртуальная встреча на $25 миллионов, которая так и не состоялась

Эта атака deepfake, вероятно, является самой известной.

Сайт жертвой стала британская инженерная фирма Arup, Но мошенничество было совершено в офисе компании в Гонконге.

В начале 2024 года сотрудник финансового отдела компании получил электронное письмо от финансового директора компании, находящегося в Великобритании. В письме финансовый директор поручал сотруднику сделать секретные денежные переводы на некоторые банковские счета.

Сначала сотрудник был очень подозрителен, потому что запрос показался ему немного странным, и он подумал, что это может быть фишинговое мошенничество.

Но затем сотрудника пригласили на видеоконференцию. Когда сотрудник присоединился к разговору, он увидел человека, похожего на финансового директора и еще нескольких старших коллег.

Все выглядели и звучали именно так, как должны были. Они также разговаривали друг с другом, чтобы все казалось более реальным.

Это полностью развеяло все сомнения сотрудника финансового отдела, который затем отправил более $25,6 млн (~HK$200 млн) на несколько различных счетов в гонконгских банках посредством 15 транзакций.

Позже выяснилось, что вся эта подстава была глубокой подделкой. Ни один человек в звонке не был тем, за кого себя выдавал, за исключением сотрудника Arup. Мошенники идеально скоординировали атаку, используя высококачественные аудио- и видеоклоны финансового директора и старших сотрудников компании.

Итальянский министр и иконы моды

Действие этой истории также происходит в 2024 году. A Поддельный министр обороны Италии Гвидо Крозетто позвонил нескольким представителям итальянской элиты и попросил их оказать немедленную финансовую помощь в спасении похищенных журналистов.

В звонке фальшивый Гвидо Кросетто утверждал, что это сверхсекретная правительственная операция. Ему даже удалось дозвониться до таких легендарных деятелей моды, как Джорджио Армани.

К сожалению, один человек в итоге перевел около миллиона долларов. Вероятно, у него было более сильное чувство патриотического долга помочь, чем у других, чем и воспользовались мошенники.

Ограбление $243 000 британских энергетиков

Это произошло в 2019 году и, вероятно, это была первая в истории глубокая подделка такого масштаба.

Генеральный директор британской энергетической компании думал, что разговаривает по телефону со своим начальником из материнской компании в Германии.

Генеральному директору было приказано перевести около 220 000 евро ($243 000) поставщику в Венгрии. Ему сказали, что речь идет о критически важной сделке, требующей немедленного перевода. Генеральный директор поддался на уловку и перевел деньги.

Ужасающий звонок для матери из Аризоны

Помните, мы говорили о том, что аудиоподделки представляют угрозу для семей? Пример мошенничества, который мы привели, действительно имел место.

Мошенники клонировали голос 15-летней девочки из ее видеоролика в социальных сетях. Затем они позвонили ее матери и голосом дочери заявили, что ее похитили и похитители требуют немедленного выкупа.

К счастью, отец смог позвонить своей настоящей дочери, которая во время всего этого была в безопасности на лыжной тренировке. Им удалось избежать мошенничества.

Как голосовые подделки влияют на предприятия

Основная цель атаки "глубокого подлога" - кража денег.

Но когда целью становятся предприятия, ущерб оказывается многомерным.

Например, глубокие подделки могут отравить атмосферу между сотрудниками компании. Это может создать культуру, в которой сотрудники всегда боятся совершить ошибку.

Возьмем, к примеру, колл-центры. Мы видим сообщения о том, что киберпреступники звонят в них и выдают себя за конкретных клиентов.

Их уловка заключается в том, чтобы заставить агентов колл-центра изменить данные учетной записи этих клиентов (например, домашние адреса, номера телефонов) и завладеть их счетами.

Удаленный прием на работу и виртуальные собеседования - еще одна область, где поддельные голоса могут использоваться кандидатами для получения работы, на которую они не претендуют.

Защита бизнеса от атак с использованием голосовых фейков

Традиционные правила безопасности на предприятиях были написаны в эпоху, предшествующую появлению искусственного интеллекта.

Предприятиям давно пора пересмотреть свои взгляды. Прежде всего, им следует начать с ознакомления с многочисленными новыми киберугрозами, возникшими в результате злоупотребления искусственным интеллектом.

Например, они могут организовать тренинги для всей своей команды и показать им реальные примеры аудиомошенничества. Начать можно с примеров, о которых мы говорили выше. На этих занятиях также следует дать им советы по предотвращению атак deepfake в различных сценариях.

Затем вы можете приступить к обновлению внутренних бизнес-политик. Одним из важных изменений может стать отказ от разрешения одному человеку в одиночку санкционировать массовые электронные переводы.

Крупные платежи должны требовать одобрения всей комиссии, чтобы хотя бы один из них мог вовремя заметить, что что-то не так.

Вам также следует подумать об интеграции автоматизированной Детектор голоса ИИ чтобы работать в фоновом режиме во время звонков.

Именно для этого были созданы инструменты TruthScan AI. С помощью наших инструментов искусственного интеллекта вы можете обнаруживать, проверять и предотвращать атаки с глубокой подделкой голоса. Давайте расскажем вам, как это сделать.

Как TruthScan защищает голосовое взаимодействие

Мы понимаем, что сотрудники не могут в одиночку отличить фальшивый голос от настоящего в разгар напряженного разговора. Им нужен специальный помощник, который мог бы заниматься этой работой во время звонка, а ваши сотрудники могли бы сосредоточиться на том, для чего их наняли.

Наш сайт Детектор голоса ИИ это специализированное решение.

Вот как он работает и на что способен:

- Анализирует миллионы различных точек данных во время телефонных разговоров и видеовстреч в реальном времени и обеспечивает точность 99%

- Мгновенно выдает предупреждение после обнаружения фальшивого голоса

- Улавливает спектральные паттерны и акустические отпечатки в голосе, которые оставляют только синтетические модели

- Интеграция с существующим центром обработки вызовов или справочной службой через простой REST API

- Сканирует все основные аудио- и видеоформаты

Поговорите с TruthScan о предотвращении атак на голосовые фальшивки

С помощью TruthScan вы можете остановить мошенничество с клонированием голоса в режиме реального времени, но вопрос в том, когда вы собираетесь начать? Рано или поздно ваши сотрудники могут допустить ошибку и стать причиной мошенничества. Не ждите этого неприятного момента.

Наш детектор голоса с искусственным интеллектом может выявлять подделки голоса с помощью таких платформ, как ElevenLabs и Murf.

Он работает в фоновом режиме во время телефонных звонков и видеовстреч, так что вашим агентам не придется работать в режиме многозадачности.

Все, что для этого нужно, - быстрая интеграция через наш REST API.

Начните с TruthScan сейчас и защитите свой бизнес от мошенничества deepfake.