Cu doar câțiva ani în urmă, aveai nevoie de un studio profesional și de multe abilități tehnice pentru a imita vocea cuiva.

Acum, oricine are o conexiune la internet și ceva timp liber poate crea o clonă digitală a vocii oricărei persoane în mai puțin de un minut.

Instrumentele pentru aceste atacuri devin mai ieftine și mai accesibile în fiecare zi pentru toată lumea. Și pentru că atât de mulți oameni își împărtășesc viața pe social media, este foarte ușor pentru un escroc să găsească informațiile audio de care are nevoie.

În acest articol, vă vom prezenta câteva dintre cele mai cunoscute exemple reale de fraudă audio. De asemenea, vă vom prezenta o soluție pentru a pune capăt la timp acestor amenințări.

Principalele concluzii

- În ultimii ani, tentativele de fraudă prin falsificare profundă a vocii au crescut cu peste 2,137%, alimentate de faptul că inteligența artificială modernă poate genera o clonă vocală exactă de 85% folosind doar trei secunde de sursă audio.

- Printre atacurile reale de notorietate se numără jaful din 2024 de la firma de inginerie Arup, în care escrocii au folosit imagini video și audio deepfake ale unui director financiar pentru a păcăli un angajat să transfere $25,6 milioane.

- Dincolo de furtul corporativ, falsurile de voce prezintă riscuri emoționale grave pentru familii prin escrocherii de răpire și pot ocoli sistemele tradiționale de securitate biometrică utilizate de bănci și alte aplicații de înaltă securitate.

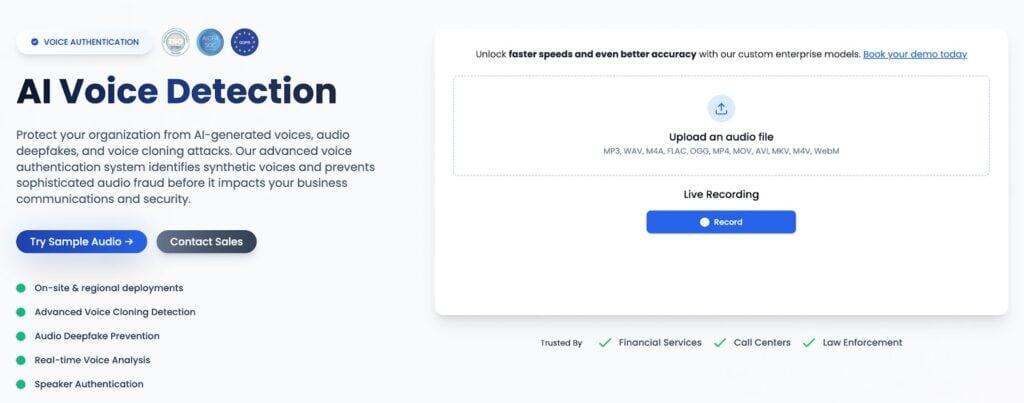

- Organizațiile sunt forțate să treacă dincolo de verificarea umană prin punerea în aplicare a protocoalelor de aprobare de către mai multe persoane pentru transferurile mari și prin implementarea detectoarelor de voce AI, precum TruthScan, pentru a analiza amprentele acustice în timp real.

- TruthScan securizează interacțiunile întreprinderilor prin identificarea artefactelor de vorbire sintetică de la platforme precum ElevenLabs și Murf cu o precizie de peste 99% în toate formatele audio și video majore.

Ce sunt atacurile Voice Deepfake?

Un deepfake vocal este o falsificare digitală a vocii cuiva. Atacatorul utilizează un software care poate analiza fiecare detaliu despre modul în care cineva vorbește, pornind de la o înregistrare a vocii sale.

Pentru a clona vocea, software-ul încearcă să observe tipare în voce. În principal, software-ul ia în considerare lucruri precum înălțimea, tonul, modul în care cineva respiră între propoziții etc.

Odată ce a învățat aceste tipare, atacatorul îl poate face să spună orice cu acea voce.

Nu vă mai îngrijorați niciodată de frauda AI. TruthScan Vă poate ajuta:

- Detectarea AI generate imagini, text, voce și video.

- Evitați fraudă majoră generată de IA.

- Protejați-vă cele mai sensibile activele întreprinderii.

Ceea ce este periculos este că instrumentele de creare a deepfake-urilor vocale sunt ușor accesibile. Iar majoritatea acestora nu necesită instalare. Acestea sunt disponibile online sub formă de site-uri web.

Trebuie doar să le dați câțiva dolari și să începeți să clonați voci. Dacă cercetați puțin mai mult, s-ar putea să găsiți chiar și instrumente care vă permit să clonați voci gratuit.

Această tehnologie nouă și ușor disponibilă a dus la o creștere abruptă a fraudei audio.

Escrocii au nevoie doar de o mică bucățică de înregistrare audio a unei persoane, pe care o pot obține din social media sau de pe un alt canal public, pentru a o clona.

Apoi pot folosi vocea clonată pentru a se da drept o persoană în situații precum apeluri telefonice live, întâlniri video, note vocale, anunțuri etc.

Acestea nu sunt doar cazuri ipotetice de utilizare a atacurilor Deepfake vocale. Aceste lucruri s-au întâmplat deja. Ne vom referi mai târziu la unele dintre cele mai cunoscute atacuri de falsificare profundă a vocii.

Riscurile potențiale ale atacurilor Deepfake vocale

Auzind despre voice deepfake, este posibil să vă fi imaginat un videoclip amuzant cu o celebritate care spune lucruri pe care nu le-a spus niciodată.

Dar această utilizare aparent inofensivă a vocii clonate poate cauza daune grave părților implicate. Să vorbim despre riscuri.

Devastație financiară pentru întreprinderi

Un deepfake de voce poate ruina reputația unei companii pentru totdeauna. De asemenea, are puterea de a-i fura sume mari de bani în câteva minute.

Cum se poate, vă veți întreba? Escrocii pot să cloneze vocea șefului unei companii și să o folosească pentru a suna angajații și a-i determina să facă lucruri care nu ar trebui să fie făcute, cum ar fi să mute bani într-un cont.

Acesta este doar un exemplu. Posibilitățile sunt nelimitate.

Ocolirea sistemelor de securitate

Vocea ta este o biometrie pe care nimeni altcineva nu ar trebui să o aibă. Asta pentru că o folosiți ca parolă pentru a vă conecta la multe dintre aplicațiile dvs., în special la cele bancare.

Deși aceste aplicații pot avea încorporat un sistem automat de verificare a vocii pentru a preveni accesul neautorizat, o clonă vocală bună are încă o șansă de a le păcăli.

Impactul emoțional asupra familiilor

Poate că cele mai ușoare ținte pentru escrocii audio sunt persoanele în vârstă din familie. Părinții și bunicii, de exemplu.

Escrocii ar putea suna, să zicem, o mamă și să difuzeze sunetul fiicei sale strigând după ajutor, spunând că a fost răpită.

Erodarea încrederii la locul de muncă

Atacurile deepfake vocale afectează, de asemenea, încrederea într-un loc de muncă sănătos.

Angajații vor trebui să verifice de două ori apelurile telefonice de la managerul lor pentru a se asigura că nu este un escroc care le ordonă să facă lucruri riscante cu o voce clonată.

Deci, care sunt opțiunile dumneavoastră dacă nu faceți o dublă verificare manuală? Toate riscurile pe care tocmai le-am discutat indică necesitatea prevenirii automate a atacurilor deepfake.

Din fericire, avem acum instrumente de detectare a vocii AI deepfake, TruthScan fiind unul dintre ele.

Preveniți frauda și uzurparea identității cu sistemul TruthScan Detector de voce AI.

Exemple din lumea reală de atacuri Deepfake vocale

Datorită inteligenței artificiale, am ajuns într-un punct în care nu mai putem avea încredere în ceea ce văd ochii sau aud urechile noastre. IA este acum capabilă să creeze imagini și videoclipuri realiste. Același lucru este valabil și pentru audio.

S-ar putea să fi auzit deja povești despre oameni care au căzut pradă fraudei audio deepfake. De asemenea, aceasta apare din când în când la știri și pe rețelele sociale. Unele dintre acestea sunt greu de înțeles.

Să vă povestim despre unele dintre cele mai cunoscute atacuri deepfake de voce, astfel încât să vă puteți face o idee despre cât de inteligent sunt executate acestea.

Întâlnirea virtuală de $25 milioane care nu a avut loc niciodată

Acest atac deepfake este probabil cel mai raportat.

The victima a fost o firmă britanică de inginerie numită Arup, dar escrocheria a pornit de la biroul său din Hong Kong.

Era începutul anului 2024 când un lucrător din departamentul financiar al companiei a primit un e-mail de la directorul financiar al companiei din Regatul Unit. În e-mail, lucrătorul era îndrumat de directorul financiar să facă transferuri secrete de bani către anumite conturi bancare.

La început, angajatul a fost destul de suspicios, deoarece solicitarea părea puțin ciudată și a crezut că ar putea fi o înșelătorie de phishing.

Dar apoi angajatul a fost invitat la o videoconferință. Când angajatul s-a alăturat apelului, a văzut ceea ce părea a fi exact directorul financiar și alți câțiva colegi seniori.

Toți arătau și sunau exact așa cum ar fi trebuit. De asemenea, vorbeau între ei pentru a face totul să pară mai real.

Acest lucru a înlăturat complet toate îndoielile lucrătorului din departamentul financiar, care a trimis apoi peste $25,6 milioane (~HK$200 milioane) în mai multe conturi bancare diferite din Hong Kong prin intermediul a 15 tranzacții.

Ulterior, s-a descoperit că toată această înscenare a fost un deepfake. Nicio persoană din apel nu era cine părea, cu excepția angajatului Arup. Escrocii au coordonat perfect atacul folosind clone audio și video de înaltă calitate ale directorului financiar și ale angajaților de rang înalt ai companiei.

Ministrul italian și icoanele modei

Și acesta a avut loc în 2024. A falsul ministru italian al apărării Guido Crosetto a sunat mai multe elite italiene și le-a cerut ajutor financiar imediat pentru salvarea jurnaliștilor răpiți.

În apel, falsul Guido Crosetto a susținut că este vorba despre o operațiune guvernamentală strict secretă. Apelantul a reușit chiar să vorbească la telefon cu figuri legendare ale modei, precum Giorgio Armani.

Din păcate, o persoană a ajuns să transfere aproximativ un milion de dolari. Probabil că această persoană a avut un sentiment mai puternic decât alții al datoriei patriotice de a ajuta, lucru pe care escrocii au reușit să îl exploateze.

Jaful energetic de $243 000 din Regatul Unit

Acest s-a întâmplat în 2019 și a fost, probabil, primul deepfake de amploarea sa raportat vreodată.

Directorul general al unei companii energetice din Regatul Unit a crezut că vorbea la telefon cu șeful său de la compania mamă din Germania.

Directorului general i s-a ordonat să transfere aproximativ 220 000 EUR ($243 000) către un furnizor din Ungaria. I s-a spus că era vorba de o afacere critică care necesita un transfer imediat. Directorul general a căzut în plasa escrocheriei și a transferat banii.

Un apel terifiant pentru o mamă din Arizona

Vă amintiți, am vorbit despre deepfakes audio fiind o amenințare pentru familii? Exemplul de escrocherie pe care l-am dat chiar s-a întâmplat.

Escrocii au clonat vocea unei fete în vârstă de 15 ani dintr-un videoclip al acesteia de pe rețelele sociale. Apoi au sunat-o pe mama acesteia și au afirmat, cu vocea fiicei, că a fost răpită și că răpitorii ei cer imediat bani pentru răscumpărare.

Din fericire, tatăl a reușit să își sune fiica, care se afla în siguranță la un antrenament de schi în timpul întregii aventuri. Ei au scăpat de escrocherie.

Cum afectează întreprinderile falsurile vocale profunde

Scopul principal al unui atac deepfake vocal este, în principal, furtul de bani.

Dar atunci când ținta sunt întreprinderile, daunele sunt multidimensionale.

De exemplu, deepfakes pot otrăvi atmosfera dintre angajații unei companii. Acesta are potențialul de a crea o cultură în care angajații sunt întotdeauna îngroziți de posibilitatea de a face o gafă.

Să luăm exemplul centrelor de apel. Vedem rapoarte despre infractori cibernetici care le apelează și pretind a fi anumiți clienți.

Trucul lor constă în a-i face pe agenții centrului de apeluri să schimbe detaliile contului acestor clienți (de exemplu, adresele de domiciliu, numerele de telefon) și să preia conturile acestora.

Angajarea la distanță și interviurile virtuale sunt un alt domeniu în care vocile false pot fi folosite de candidați pentru a obține locuri de muncă pentru care nu sunt calificați.

Protejarea întreprinderilor împotriva atacurilor Voice Deepfake

Regulile tradiționale de securitate din cadrul întreprinderilor au fost scrise în era pre-AI.

Este timpul ca întreprinderile să le reconsidere. Acestea ar trebui să înceapă prin a se educa cu privire la numeroasele amenințări cibernetice noi care au apărut ca urmare a abuzului de inteligență artificială.

De exemplu, pot organiza sesiuni de formare pentru întreaga echipă și le pot arăta exemple reale de fraudă audio. Puteți începe cu exemplele pe care tocmai le-am discutat mai sus. Aceste sesiuni de formare ar trebui, de asemenea, să le ofere sfaturi de prevenire a atacurilor deepfake pentru diferite scenarii.

Apoi, puteți continua și să actualizați politicile interne de afaceri. O schimbare importantă poate fi aceea de a nu mai permite unei singure persoane să autorizeze singură transferuri bancare masive.

Plățile mari ar trebui să necesite aprobarea unui întreg grup, astfel încât cel puțin unul dintre aceștia să poată observa la timp că ceva nu este în regulă.

De asemenea, ar trebui să vă gândiți la integrarea unui Detector de voce AI pentru a rula în fundal în timpul apelurilor.

Pentru asta au fost create instrumentele AI TruthScan. Puteți detecta, verifica și preveni atacurile deepfake vocale cu ajutorul instrumentelor noastre AI. Să vă spunem cum.

Cum securizează TruthScan interacțiunile vocale

Înțelegem că angajații nu pot distinge singuri o voce falsă de o voce reală în mijlocul unui apel stresant. Ei au nevoie de un asistent dedicat care să se ocupe de această sarcină în timpul unui apel, în timp ce echipa dvs. se poate concentra asupra activității pentru care a fost angajată.

noastre Detector de voce AI este o soluție dedicată.

Iată cum funcționează și de ce este capabil:

- Analizează milioane de puncte de date diferite în apeluri telefonice și întâlniri video în direct și oferă o precizie de 99%

- Emite instantaneu un avertisment după detectarea unei voci false

- Captează modelele spectrale și amprentele acustice ale vocii care sunt lăsate în urmă doar de modelele sintetice

- Se integrează cu call center-ul sau biroul de asistență existente prin intermediul unui API REST simplu

- Poate scana toate formatele audio și video majore

Discutați cu TruthScan despre prevenirea atacurilor Voice Deepfake

Puteți opri frauda prin clonarea vocii în timp real cu TruthScan, dar întrebarea este, când veți începe? Angajații dvs. ar putea, mai devreme sau mai târziu, să facă o gafă și să vă păcălească. Nu așteptați acel moment nefericit.

Detectorul nostru de voce AI poate semnala falsurile vocale folosind platforme precum ElevenLabs și Murf.

Funcționează în fundal în timpul apelurilor telefonice în direct și al întâlnirilor video, astfel încât agenții dvs. de apeluri să nu fie nevoiți să facă mai multe lucruri în același timp.

Tot ceea ce este necesar este o integrare rapidă prin API-ul nostru REST.

Începeți cu TruthScan acum și protejați-vă afacerea de înșelăciunile deepfake.