În anii '90, era vorba de ADN.

În anii 2000, a fost vorba de semnalul antenelor de telefonie mobilă.

Dar în 2026, noul standard de aur al probelor este amprenta digitală.

Gândiți-vă în felul următor...

Fiecare fișier video are o semnătură unică.

Dacă un singur pixel este modificat de inteligența artificială, amprenta se schimbă instantaneu.

În cazul în care dovezile AI nu au un marcaj temporal blockchain verificat pentru a bloca amprenta digitală în loc, acestea ar putea fi la fel de bine ca un desen animat în ochii unui judecător modern.

Prin urmare, acest lucru înseamnă că era “a vedea înseamnă a crede” s-a încheiat.

Am intrat în era verificării video AI, în care dovada nu se găsește în ceea ce vezi, ci în codul digital ascuns sub suprafață.

În acest blog, vom analiza de ce probele tradiționale nu reușesc să contracareze frauda video, cum să identificăm clipurile manipulate, de ce verificarea este esențială pentru admisibilitate și de ce un detector video AI precum TruthScan este acum esențial pentru echipele juridice.

Să începem.

Principalele concluzii

- În 2026, pentru a fi considerate fiabile, toate probele video trebuie să fie supuse unei verificări video AI.

- Frauda video include editări mici, cum ar fi manipularea marcajului de timp, nu doar schimbarea completă a feței.

- Un detector deepfake profesionist este singura modalitate de a detecta artefactele GAN pe care oamenii le ratează.

- Noile norme, precum Federal Rule 707, standardizează modul în care probele AI sunt admise în instanță.

- Analiza automatizată a probelor permite firmelor să proceseze rapid și precis pachete masive de descoperiri.

- TruthScan previne frauda în timpul audierilor live prin detectarea măștilor sintetice în timp real.

Ce sunt probele video în litigiile juridice?

Probele video reprezintă în principiu orice clip înregistrat utilizat în instanță pentru a dovedi ce s-a întâmplat. De la cazuri penale la despăgubiri de asigurare, acestea sunt prezente peste tot.

Cu toate acestea, în 2026, creșterea fraudei video a făcut din “a vedea înseamnă a crede” o presupunere periculoasă. Profesioniștii din domeniul juridic au acum nevoie de o verificare video AI robustă pentru a asigura integritatea sistemului de justiție.

Tipuri de probe video utilizate zilnic de instanțe

Nu vă mai îngrijorați niciodată de frauda AI. TruthScan Vă poate ajuta:

- Detectarea AI generate imagini, text, voce și video.

- Evitați fraudă majoră generată de IA.

- Protejați-vă cele mai sensibile activele întreprinderii.

- Supraveghere (CCTV): Camere video de la magazine sau semafoare. Aceasta este cea mai frecventă probă în cazurile penale.

- Body Cams: Imagini filmate de ofițeri de poliție, utilizate mai ales în cazuri de drepturi civile sau forță excesivă.

- Camere de bord: Dovada de referință pentru accidentele auto și luptele legate de asigurări.

- Mărturii înregistrate: Depozițiile video sau declarațiile martorilor de la distanță care au devenit normale de la pandemie. Devenite un standard, dar predispuse la provocări legate de detectarea fraudelor juridice.

- Smartphone și social media: Videoclipuri de la martori sau postări care dovedesc comportamentul sau locația cuiva.

- Securitatea companiei: Imagini folosite de corporații în cazuri de fraudă sau “concediere abuzivă”.

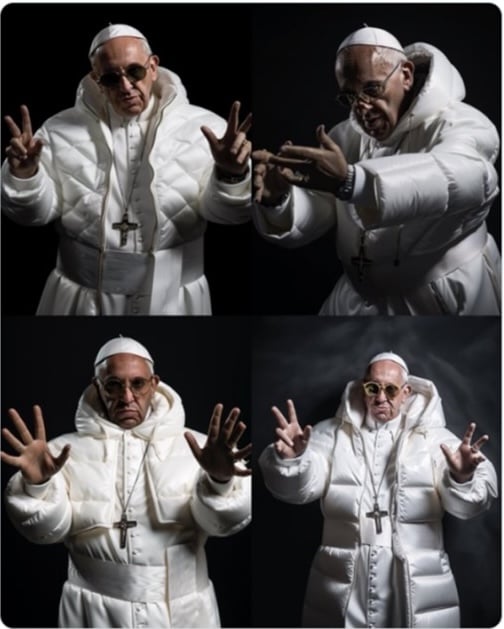

Inteligența artificială generativă și tehnologia deepfake au adăugat un nou nivel de risc. În 2025:

- 1 din 20 de verificări ale identității au fost înșelate de AI deepfakes

- Un sondaj Medius a raportat că 43% dintre profesioniști au căzut victime unei tentative de fraudă deepfake

Cazuri reale de fraudare a probelor video

- Clipuri manipulate din sala de judecată

Clipurile manipulate din sala de judecată se referă la orice probă video sau audio prezentată într-un caz juridic care a fost modificată, editată sau fabricată complet cu ajutorul tehnologiei.

Exemple:

- Cazul Alameda County deepfake (2025): Un caz civil din California a fost respins după ce instanța a descoperit că înregistrarea video a unui martor prezentată ca probă fusese complet creată cu ajutorul inteligenței artificiale.

- Sz Huang v. Tesla deepfake apărare (2023): În cadrul unui proces pentru ucidere din culpă, avocații Tesla au susținut că imaginile cheie ale accidentului ar putea fi un deepfake.

Videoclipuri de supraveghere modificate

Înregistrarea video de supraveghere este unul dintre cele mai frecvente tipuri de probe AI utilizate în instanță. Cu toate acestea, mulți oameni se gândesc în mod eronat la manipulare doar ca la deepfakes complete.

În realitate, frauda video se întâmplă adesea în moduri mai mici, mai puțin evidente, care pot compromite un caz.

Tipurile comune de manipulare includ:

- Modificări ale marcajului temporal

- Îndepărtarea cadrului

- Modificări ale metadatelor sau GPS

- Înlocuirea feței

- Îndepărtarea sau introducerea unui obiect

- Filmare în buclă

- Degradarea calității

Imaginile video de supraveghere provin adesea din mai multe locuri diferite, cum ar fi magazinele private, soneriile casnice, parcările și camerele din oraș. Spre deosebire de imaginile surprinse de camerele de corp ale poliției, aceste sisteme nu respectă de obicei reguli stricte privind lanțul de custodie.

Asta înseamnă:

- Este posibil să nu existe o înregistrare clară a persoanei care a gestionat dosarul.

- Imaginile pot fi copiate, transferate sau convertite de mai multe ori.

- Procedurile de autentificare pot fi slabe sau inconsecvente.

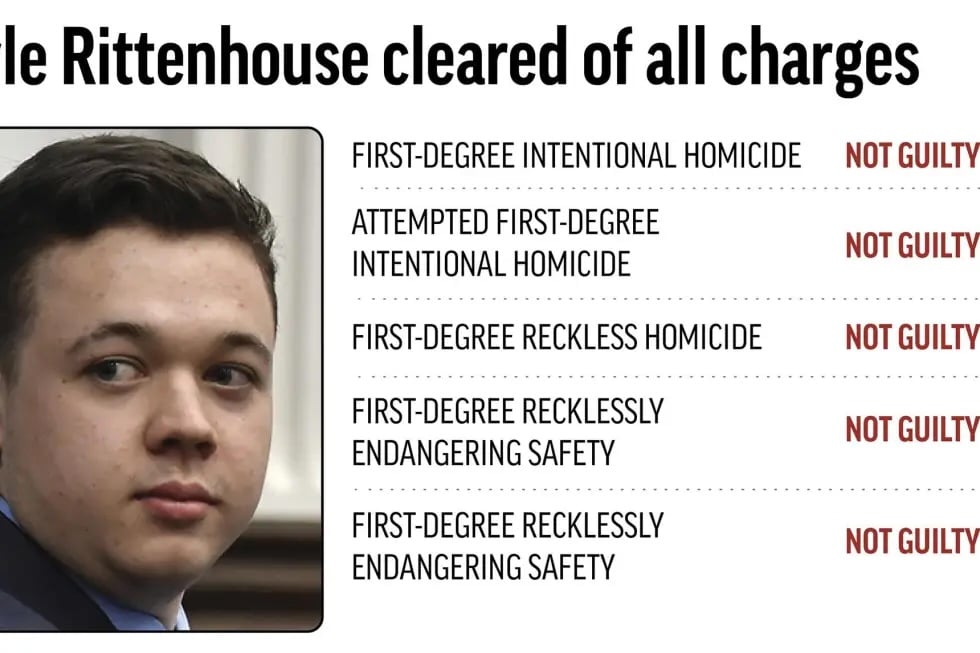

Exemplu: Problema îmbunătățirii AI în cazul Wisconsin v. Rittenhouse

Un exemplu celebru provine din procesul Wisconsin v. Rittenhouse. Acuzarea a încercat să folosească funcția "pinch-to-zoom" a unui iPad pentru a arăta detaliile unui videoclip realizat de o dronă.

Apărarea a susținut că zoom-ul Apple utilizează interpolarea AI pentru a ghici ce ar trebui să fie acolo. Judecătorul a decis că, în lipsa unui detector video AI profesional, imaginile îmbunătățite nu pot fi admise.

Mărturii video contestate

O mărturie video contestată necesită, de obicei, detectarea fraudei juridice pentru a determina dacă o înregistrare este:

- O depoziție sau o declarație complet inventată

- O mărturie reală contestată ca falsă

- O înregistrare reală manipulată

Fiecare scenariu creează o sarcină serioasă de autentificare pentru instanță.

Exemplu: Cazul custodiei copilului în Regatul Unit

Într-un litigiu din Marea Britanie, citat de University of Baltimore Law Review, o mamă a prezentat o înregistrare puternic modificată pentru a-l prezenta pe tată ca fiind violent în timpul unei lupte pentru custodie.

Scopul a fost acela de a-i restricționa accesul la copiii săi.

Creșterea înregistrărilor video generate de inteligența artificială în materie juridică

Călătoria către era actuală a detectorului deepfake s-a desfășurat în etape distincte:

- Anii de avertizare timpurie (2017-2021)

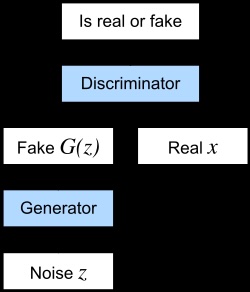

Tehnologia Deepfake (alimentată de rețele generative adversariale (GAN)) a intrat în atenția publicului în jurul anului 2017.

Primele falsuri erau adesea de calitate scăzută: fețe cu distorsiuni ciudate, degete în plus, iluminare nepotrivită și trăsături neclare care le făceau ușor de observat.

- Faza de escaladare (2022-2023)

Până în 2022, tehnologia s-a îmbunătățit. Multe erau gratuite și utilizabile pe un smartphone.

În 2023, am început să vedem unele dintre primele provocări semnificative legate de deepfake în cazuri judiciare, inclusiv Sz Huang v. Tesla, Statele Unite v. Reffitt și Statele Unite v. Doolin, unde avocatul a ridicat întrebări cu privire la posibilitatea ca dovezile video să fie generate de AI.

Aproximativ în aceeași perioadă, Comitetul consultativ al Asociației Avocaților Americani privind regulile în materie de probe a început să studieze oficial această problemă.

- Pragul critic (2024-2025)

Conținutul generat de inteligența artificială nu a rămas pentru mult timp la nivel academic. În 2024, un incident al firmei de inginerie Arup, în care a fost implicat un apel video fals generat de inteligența artificială care autoriza transferuri electronice în valoare totală de $25 milioane.

Sistemul juridic a început să reacționeze.

În 2025, Louisiana a adoptat HB 178, creând primul cadru de verificare a dovezilor IA la nivel de stat.

La nivel federal, Comitetul consultativ al Statelor Unite privind normele în materie de probe a propus Norma 707, axată pe probele generate automat.

Situația în 2026

De la începutul anului 2026, reglementarea deepfake și AI-video s-a accelerat la nivel național:

- 46 de state au adoptat o formă de legislație deepfake.

- Din 2022, 169 de legi au fost adoptate, iar 146 de proiecte de lege au fost introduse numai în 2025.

- Regula federală 707 este deschisă pentru comentarii publice până la 16 februarie 2026.

Îmbunătățirea verificării video cu ajutorul inteligenței artificiale

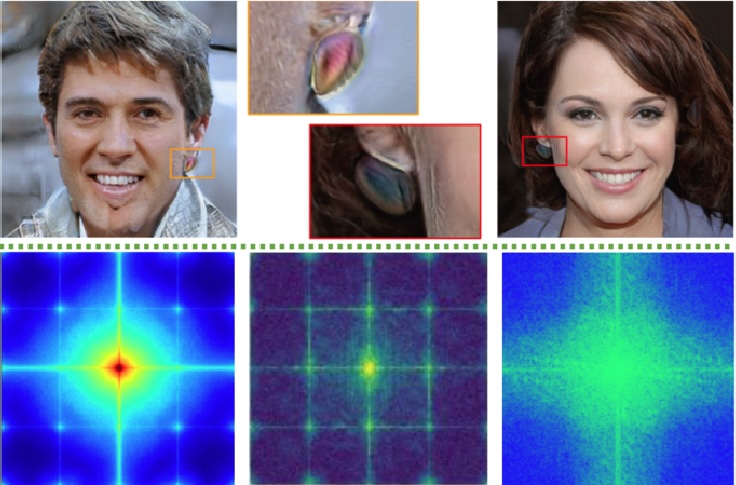

Cea mai eficientă modalitate de a detecta înregistrările video generate de inteligența artificială este utilizarea inteligenței artificiale în sine.

Acest lucru se datorează faptului că deepfakes sunt create de sisteme de învățare automată care lasă în urmă modele digitale subtile.

Aceste modele sunt prea mici sau complexe pentru a fi observate de ochiul uman. Dar ele pot fi detectate de alți algoritmi.

Un sistem fiabil de verificare video cu inteligență artificială poate analiza simultan mai multe straturi ale unei înregistrări video, inclusiv:

- Analiza la nivel de cadru verifică fiecare cadru pentru erori vizuale, cum ar fi texturi ciudate, nepotriviri de iluminare sau probleme de blending în jurul fețelor.

- Analiza coerenței temporale analizează mișcarea pe cadre pentru a găsi salturi nefirești sau mișcări inconsecvente.

- Urmărirea reperelor faciale monitorizează mișcarea ochilor, clipitul și forma feței pentru a detecta schimbările nefirești.

- Testarea sincronizării audiovizuale verifică dacă mișcările buzelor corespund exact cuvintelor rostite.

- Criminalistică audio analizează vocea pentru a detecta semne de clonare, cum ar fi modele de sunet neobișnuite sau tonuri robotice.

- Analiza metadatelor și a compresiei examinarea datelor din fișierele ascunse este vitală pentru detectarea fraudei legale, pentru a vedea dacă acestea corespund detaliilor înregistrării originale.

Educarea echipelor juridice cu privire la frauda video

Întrucât inteligența artificială poate imita acum comportamentul uman cu o acuratețe terifiantă, firmele de avocatură folosesc analiza automată a probelor și un mix de tactici tradiționale pentru a rămâne în frunte.

| Categorie | Metoda | Descriere |

| Modalități oficiale | Credite CLE (Educație juridică continuă) | Cursuri obligatorii sau facultative care să îi învețe pe avocați cum să autentifice probele digitale, să înțeleagă "deepfakes" și să respecte standardele în materie de probe. |

| Experți AI numiți de instanță | Stabilirea de specialiști criminaliști certificați în IA, asemănători experților ADN, pentru a evalua în instanță probele video contestate. | |

| Modalități neoficiale | Echipa roșie internă | Angajarea de profesioniști în domeniul securității cibernetice pentru a verifica dacă probele false sau manipulate se pot strecura prin sistemele de preluare ale firmei. |

| “Protocolul ”Vibe Check" | Instruirea personalului pentru a depista semnele de avertizare comune ale deepfake-ului, cum ar fi clipitul nefiresc, trăsăturile distorsionate sau problemele de sincronizare a buzelor, înainte de a le trimite spre o analiză criminalistică. |

Instrumente și tehnologii pentru validarea probelor

În 2026, am depășit simpla inspecție vizuală.

Deoarece inteligența artificială este acum capabilă să păcălească chiar și cei mai experimentați investigatori, echipele juridice folosesc un set specific de instrumente pentru a verifica dacă ceea ce văd este adevărul absolut.

Tehnologia din spatele validării probelor

- Detectoare Deepfake: Acestea sunt programe software specializate care caută artefacte GAN. Acestea sunt modele matematice microscopice sau zgomote lăsate în urmă de modelele AI care generează fețe sintetice. În timp ce un om vede o față, detectorul vede o semnătură digitală care nu aparține.

- TruthScan este un detector deepfake care scanează clipurile video cadru cu cadru în căutarea semnelor AI, cum ar fi clipitul neobișnuit, formele faciale ciudate sau erorile de pixeli în care este adăugată o față falsă.

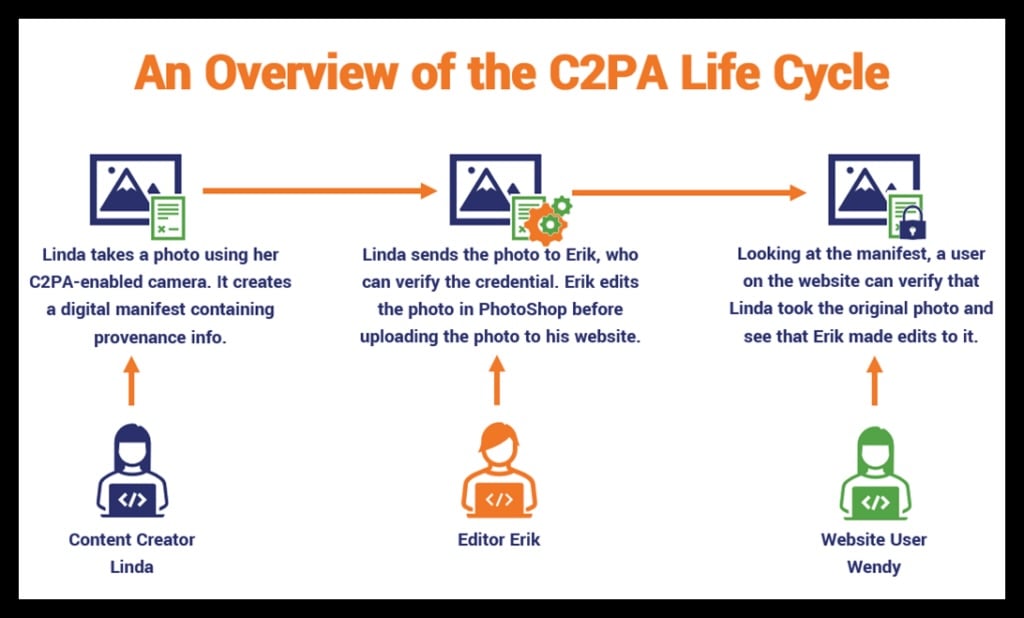

- Blockchain Timestamps: Pentru a dovedi că o înregistrare video nu a fost atinsă din momentul în care a fost înregistrată, multe agenții utilizează acum standardul C2PA. Atunci când un material video este înregistrat pe un dispozitiv conform, se creează o amprentă digitală unică (hash), care este stocată pe un blockchain.

- TruthScan poate verifica dacă această amprentă se potrivește cu înregistrarea video, arătând dacă fișierul a fost editat sau dacă lanțul de custodie a fost încălcat.

- Instrumente criminalistice pentru metadate: Fiecare fișier digital are un certificat de naștere cunoscut sub numele de date Exif. Aceste instrumente verifică dacă un fișier a fost salvat din nou în software-ul de editare AI sau dacă datele de localizare (GPS) au fost falsificate. Dacă un videoclip pretinde că provine de la o cameră de magazin, dar metadatele arată că a fost exportat de la un editor video, aveți o problemă.

- Amped Software și TruthScan examinează datele ascunse ale fișierelor (Exif, anteturi) pentru a vedea dacă videoclipul a fost editat sau procesat de AI.

Tendințe în domeniul dovezilor video AI

Iată cele trei tendințe ale anului 2026.

- Criminalistică generativă adversarială: AI vs. AI

Cea mai avansată modalitate de a prinde un deepfake în 2026 este de a utiliza aceeași tehnologie care l-a creat. Aceasta este cunoscută sub numele de Generative Adversarial Forensics.

- O AI (generatorul) încearcă să creeze un fals, în timp ce o altă AI (discriminatorul) încearcă să îl prindă. În sala de judecată, instrumente precum TruthScan pot fi discriminatorul suprem.

- Exemplu: Un reclamant prezintă o înregistrare video cu un CEO care încheie un contract verbal. TruthScan scanează înregistrarea video utilizând propriile modele adversariale pentru a detecta artefactele GAN. Dacă software-ul semnalează o probabilitate sintetică 98%, dovada este probabil un fals pentru a păcăli ochii umani.

- Analiza sincronizării audio-video (Regula 0,01ms)

De obicei, oamenii pot identifica o întârziere dacă sunetul unui videoclip este diferit cu aproximativ 40-80 de milisecunde. Cu toate acestea, deepfakes 2026 sunt adesea aproape perfecte.

- Instrumentele criminalistice moderne de IA caută acum o întârziere de 0,01 milisecunde între sunetul fonetic al unui cuvânt și mișcarea mecanică a buzelor.

- Exemplu: Într-un caz de hărțuire din 2026, un pârât a susținut că o înregistrare video a fost falsificată. Analiza criminalistică automată a probelor a arătat că formele buzelor “M” și “B” nu erau sincronizate cu sunetul cu 0,02 ms. Această eroare microscopică dovedește că vocea a fost clonată și suprapusă peste o înregistrare video diferită, ceea ce a condus la o respingere.

- Cheapfakes vs. Deepfakes

În timp ce deepfakes utilizează AI de înaltă calitate, cheapfakes sunt cea mai comună formă de fraudă video.

- Un Deepfake creează o realitate care nu s-a întâmplat niciodată (cum ar fi un schimb de fețe). Un Cheapfake ia imagini reale și schimbă contextul sau intenția cu ajutorul unor instrumente simple.

- Exemplu (Încetinirea): Un videoclip cu un politician care pare beat sau cu probleme poate fi creat pur și simplu încetinind filmarea cu 20% și ajustând tonul audio.

- Exemplu (Re-Contextul): O înregistrare de la un protest din 2022 din altă țară este postată în 2026 ca dovadă live a unei revolte locale. Echipele juridice folosesc acum analiza metadatelor TruthScan pentru a dovedi data de naștere reală a înregistrării video.

Cum protejează TruthScan dovezile video legale

TruthScan se asigură că fiecare cadru pe care îl prezentați în instanță este autentic, verificat și poate fi apărat din punct de vedere legal.

Platforma eficientizează verificarea video AI prin următoarele beneficii:

Jurnale de audit automatizate și documentație privind lanțul de custodie

- Fiabilitatea în fața instanței: Generează rapoarte PDF și JSON care documentează fiecare etapă de verificare cu scoruri de încredere precise și marcaje temporale.

- Conformitate de nivel superior: Fiți liniștit, știind că datele dvs. rămân în siguranță și respectă standarde globale stricte precum SOC 2, ISO 27001 și GDPR.

- Control flexibil al datelor: Păstrați dovezile sensibile în jurisdicția dorită cu opțiuni de implementare on-premise sau VPC concepute pentru industriile foarte reglementate.

Procesarea loturilor și integrarea API pentru fluxurile de lucru juridice

- Economii masive de timp: Procesați simultan mii de fișiere din pachete de descoperire sau seturi de supraveghere utilizând importuri de stocare în masă (S3/GCS).

- E-Discovery fără întreruperi: Simplificați-vă operațiunile prin integrarea verificării direct în software-ul dvs. existent prin webhooks și API-uri.

- Eliminați erorile manuale: Automatizați prima trecere a verificării dovezilor, astfel încât echipa dvs. să se poată concentra pe strategie în loc să verifice plictisitor fișier cu fișier.

Verificarea în timp real pentru depoziții și audieri la distanță

- Opriți impersonarea: Utilizați puncte finale de streaming live pentru a detecta dacă un deponent utilizează filtre deepfake sau clone vocale în timpul unei audieri la distanță.

- Menținerea integrității instanței: Identificați anomaliile vizuale sau audio în timp real, împiedicând înregistrarea mărturiilor frauduloase.

- Pacea minții: Oferiți clienților dvs. și instanței un nivel suplimentar de securitate care garantează că persoana de pe ecran este exact cine pretinde a fi.

Aflați mai multe despre securizarea probelor video AI

Protejați-vă firma de riscurile media manipulate. Detectorul de falsuri profunde și tehnologia de detectare video cu inteligență artificială de la TruthScan oferă cea mai bună soluție pentru e-discovery și verificarea juridică.

Sunteți gata să vedeți TruthScan în acțiune?

- Vizită truthscan.com pentru a primi gratuit 20.000 de credite.

- Pentru întrebări despre întreprinderi, integrare API sau opțiuni de implementare personalizate, contactați echipa lor la Truthscan.com/contact.