Un ghid cuprinzător pentru înțelegerea, detectarea și prevenirea fraudei cu voce AI în întreprinderi

Apelul vocal de $25 milioane care nu a avut loc niciodată

În februarie 2024, un lucrător financiar de la o companie multinațională din Hong Kong a primit un apel video de la directorul său financiar.

Vocea de la celălalt capăt al firului era inconfundabilă; fiecare inflexiune, fiecare pauză și chiar și ușorul accent erau recunoscute instantaneu.

El i-a cerut urgent să proceseze 15 transferuri bancare, în valoare totală de $25 milioane, pentru a finaliza o achiziție confidențială.

Nu vă mai îngrijorați niciodată de frauda AI. TruthScan Vă poate ajuta:

- Detectarea AI generate imagini, text, voce și video.

- Evitați fraudă majoră generată de IA.

- Protejați-vă cele mai sensibile activele întreprinderii.

Directorul financiar nu a făcut niciodată acel apel. A fost complet generat de AI.

Acesta nu a fost un caz izolat. Instituțiile financiare înregistrează o creștere abruptă a fraudelor de tip deepfake.

În ultimii trei ani, numărul cazurilor a crescut cu 2,137%, iar inteligența artificială generează în prezent 42,5% din toate tentativele de fraudă din sector.

Chiar și în condițiile creșterii fraudei vocale cu inteligență artificială, mai mult de jumătate dintre liderii de afaceri recunosc că angajații lor nu au fost instruiți să identifice sau să răspundă la atacurile deepfake; aproape 80% dintre companii nu au protocoale formale pentru a gestiona aceste incidente.

Cum funcționează clonarea vocii AI și de ce este o amenințare

Sinteza modernă a vocii AI necesită surprinzător de puține date. Doar câteva secunde de sunet pot clona o voce cu o precizie de până la 85%.

Procesul se reduce la trei etape principale:

- Colectarea datelor: Escrocii colectează mostre de voce din surse publice, cum ar fi conferințe telefonice, interviuri podcast, clipuri din social media sau chiar postări video pe LinkedIn.

- Model de formare: Inteligența artificială analizează trăsături vocale precum înălțimea, tonul, accentul, ritmul și tiparele de respirație.

- Generație: Sistemul creează un discurs sintetic suficient de convingător pentru a păcăli chiar și colegii apropiați.

Problema accesibilității

Ceea ce face această amenințare și mai periculoasă este democratizarea sa. Escrocii nu mai au nevoie de resurse la nivel de Hollywood.

Tot ceea ce este necesar este un software accesibil pentru a clona o voce dintr-un scurt clip social media. Multe instrumente disponibile publicului, inclusiv instrumente AI text to speech pot fi utilizate abuziv pentru a genera sunet sintetic convingător.

De ce executivii sunt principalele ținte ale fraudelor

Executivii se confruntă cu o combinație periculoasă de factori de risc.

Expunerea lor publică prin intermediul social media face ca mostrele vocale să fie ușor de găsit, iar autoritatea lor îi determină adesea pe angajați să acționeze rapid în cazul unor solicitări urgente.

În medie, unul din patru directori are o înțelegere limitată a tehnologiei deepfake.

Statisticile actuale prezintă o imagine îngrijorătoare

Într-un 2024 Studiu Deloitte, 25,9% dintre directori au declarat că organizațiile lor s-au confruntat cu cel puțin un incident deepfake care a vizat date financiare sau contabile în ultimul an, iar jumătate dintre toți respondenții cred că astfel de atacuri vor crește în următoarele 12 luni.

Cel mai îngrijorător: doar 52% dintre organizații se simt încrezătoare că ar putea detecta un deepfake al CEO-ului lor.

Cum să depistați escrocheriile cu inteligență artificială vocală

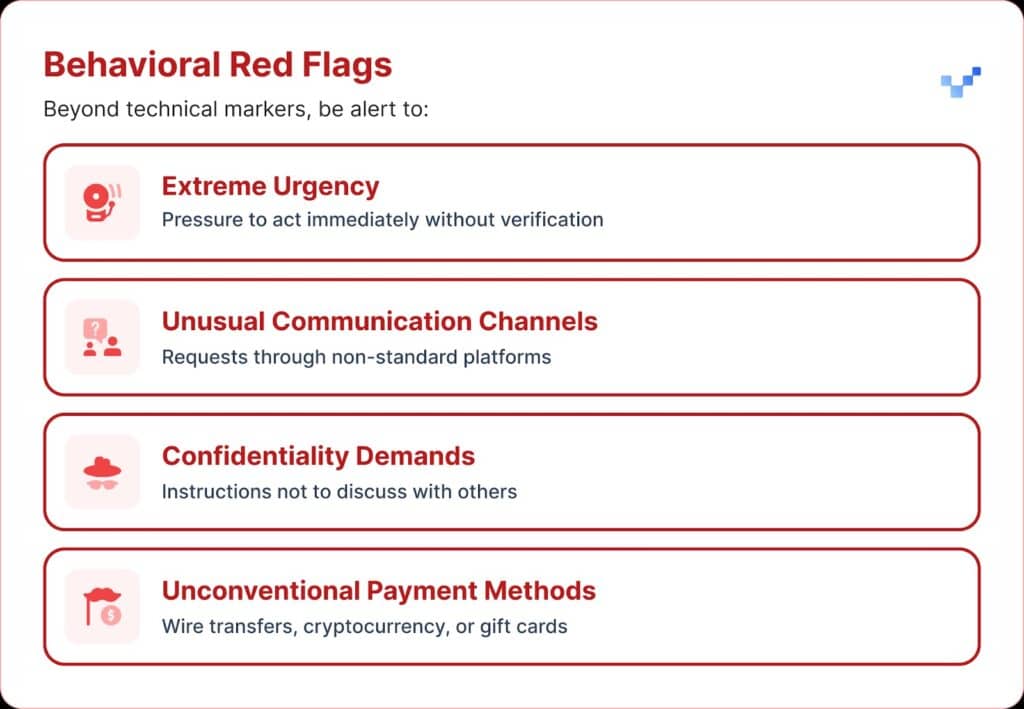

Atunci când primiți o comunicare vocală suspectă, există câteva semne de avertizare la care trebuie să fiți atenți.

Escrocheriile cu voce AI au adesea un sunet monoton sau plat. De asemenea, puteți observa un ritm neobișnuit, cu pauze ciudate sau un ritm nefiresc.

De asemenea, sunetul poate conține bâzâituri sau ecouri electronice slabe, în special în timpul apelurilor mai lungi.

Și în multe cazuri, vocea repetă fraze limitate care par a fi scrise sau repetate.

Impactul financiar și costurile reale

Majoritatea organizațiilor au pierdut în medie aproximativ $450,000, dar în sectorul serviciilor financiare pierderile au depășit $603,000.

Iar în cele mai grave cazuri, 1 din 10 organizații a raportat pierderi de peste $1 milioane.

Această tendință a crescut rapid. O cercetare anterioară din 2022 a indicat că povara financiară medie a fraudei de identitate era de aproximativ $230 000, aproape jumătate din cifra actuală.

Pierderi viitoare preconizate

Potrivit Centrului pentru servicii financiare al Deloitte, banii pierduți din cauza fraudei AI în SUA ar putea crește de la $12,3 miliarde în 2023 la $40 miliarde până în 2027. Aceasta înseamnă o creștere de aproximativ 32% în fiecare an.

Vulnerabilitatea regională

America de Nord a înregistrat o creștere de 1740% a fraudelor deepfake.

Această creștere regională semnificativă sugerează că America de Nord ar putea fi o țintă principală pentru escrocii deepfake, probabil din cauza economiei sale digitale mari și a utilizării pe scară largă a serviciilor online.

Abordări strategice ale protecției cadrelor

1. Implementarea protocoalelor de verificare

O modalitate de a consolida apărarea este utilizarea unui sistem de "cuvinte de siguranță", fraze de autentificare convenite în prealabil și împărtășite cu personalul cheie.

Un escroc care folosește clonarea inteligenței artificiale a vocii nu va cunoaște răspunsurile corecte la întrebările de verificare personală.

O altă măsură de protecție este verificarea pe mai multe canale.

Orice solicitare financiară neobișnuită trebuie confirmată prin intermediul unui canal de comunicare separat, fără a vă baza doar pe metoda de contact inițială.

De asemenea, companiile ar trebui să stabilească reguli clare pentru escaladare, cu perioade de așteptare și etape de aprobare pentru tranzacțiile financiare mari, indiferent cine le solicită.

2. Fiți atenți la expunerea digitală

Un alt nivel de protecție constă în limitarea cantității de materiale audio și video executive disponibile online. Cu cât mai multe mostre pot colecta escrocii, cu atât mai convingătoare devin clonele lor.

De asemenea, este util să se stabilească orientări clare privind rețelele de socializare pentru executivi, în special în ceea ce privește postarea de videoclipuri cu sunet curat.

Iar când vine vorba de conferințe, organizațiile ar trebui să fie atente la discuțiile sau interviurile înregistrate care oferă lungi perioade de mostre de voce.

3. Implementarea soluțiilor tehnice

Acesta este momentul în care tehnologia avansată de detectare a IA devine esențială.

Organizațiile au nevoie de autentificare vocală de nivel enterprise și detectarea deepfake capabilitățile pe care le oferă:

- Analiză în timp real: Detectarea vocilor sintetice în timpul comunicațiilor în direct

- Verificare istorică: Analizați apelurile și mesajele înregistrate pentru autenticitate

- Capacități de integrare: Funcționează perfect cu platformele de comunicare existente

- Ratele de precizie ridicate: Minimizați falsurile pozitive, prinzând în același timp falsurile sofisticate

4. Programe cuprinzătoare de formare

Echipele de conducere au nevoie de instruire specifică cu privire la amenințările legate de vocea AI și la procedurile de verificare.

La fel de importantă este și sensibilizarea angajaților.

Toată lumea, indiferent de rol, ar trebui să fie pregătită să identifice potențialele deepfakes și să prevină intrarea amenințărilor cibernetice în organizație.

Exercițiile regulate de simulare pot consolida această pregătire prin utilizarea unor încercări simulate de fraudă vocală pentru a testa și perfecționa procedurile de răspuns.

Soluții avansate de detectare a vocii AI

Sistemele tradiționale de apărare au fost concepute pentru amenințările bazate pe rețea, nu pentru substituirea identității umane prin inteligență artificială.

Principalele motive pentru care instrumentele standard de securitate cibernetică nu pot aborda ingineria socială bazată pe voce:

- Nu există semnătură Malware: Apelurile vocale nu declanșează sistemele de securitate tradiționale

- Factorul de încredere umană: Oamenii au încredere în mod natural în ceea ce aud, în special în vocile familiare

- Lacune în tehnologia de detectare: În ciuda creșterii numărului de tentative de fraudă bazate pe inteligența artificială, inclusiv deepfakes, doar 22% din instituțiile financiare au implementat instrumente de prevenire a fraudei bazate pe inteligența artificială

Nevoia de detectare specializată a vocii

Frauda vocală modernă necesită capacități moderne de detectare.

Grad de întreprindere Sisteme AI de detectare a vocii poate:

- Analizați biomarkerii vocali: Detectarea inconsecvențelor subtile în vorbirea sintetică

- Procesare în timp real: Furnizarea de alerte imediate în timpul apelurilor suspecte

- Învățarea continuă: Adaptarea la noile tehnici de sinteză vocală

- Gata de integrare: Lucrul cu infrastructura de comunicații existentă

Organizațiile care doresc cu adevărat să se protejeze împotriva fraudei vocale trebuie să investească în tehnologii de detectare a inteligenței artificiale special concepute, care să se ridice la nivelul de sofisticare al amenințărilor cu care se confruntă.

Frauda vocală este prezentă acum și se intensifică

În primul trimestru al anului 2025, frauda deepfake și furtul de identitate au cauzat pierderi de peste $200 milioane.

Phishing-ul vocal cu clone AI a sărit de 442%, iar peste 400 de întreprinderi sunt afectate zilnic de înșelătorii cu CEO sau CFO de tip deepfake.

În timp ce 56% dintre întreprinderi afirmă că sunt foarte încrezătoare în ceea ce privește depistarea falsurilor profunde, doar 6% au evitat efectiv să sufere pierderi financiare din cauza acestora.

Ceea ce contează nu este dacă organizația dvs. va fi vizată, ci dacă sunteți pregătiți pentru aceasta.

Frauda vocală schimbă fața securității cibernetice. Sistemele tradiționale de apărare nu pot ține pasul cu imitațiile bazate pe inteligența artificială.

Pentru a rămâne protejate, organizațiile au nevoie de instrumente de detectare mai bune, programe de instruire solide și proceduri clare de verificare.

Tehnologia de ripostă este deja aici. Adevărata întrebare este dacă o veți folosi înainte de primul incident de fraudă vocală sau după.