Introducere

Inteligența artificială generativă revoluționează asistența medicală - și nu întotdeauna în bine. În 2025, schemele de fraudă în domeniul asistenței medicale au crescut mai digitale și mai sofisticate, alimentate de încălcarea securității datelor, automatizare și inteligență artificială generativă[1]. Infractorii exploatează instrumentele AI pentru a crea identități false ale pacienților, cereri de asigurare sintetice, documente medicale generate de AI, rețete falsificate și chiar interacțiuni medic-pacient falsificate. Aceste înșelătorii de înaltă tehnologie ridică frauda la noi cote, amenințând finanțele asigurătorilor și siguranța pacienților din întreaga lume. Provocarea este enormă: frauda în domeniul sănătății costă deja zeci de miliarde de euro anual, iar creșterea inteligenței artificiale este intensificarea atât a dimensiunii, cât și a complexității de escrocherii[2][3]. Acest whitepaper oferă o privire detaliată asupra celor mai recente tendințe de fraudă bazate pe inteligența artificială în domeniul asistenței medicale, cazuri reale din 2025 și strategii - de la detectoare de conținut AI la verificarea identității - pentru a combate această amenințare în continuă evoluție.

Apariția schemelor de fraudă bazate pe inteligența artificială în domeniul sănătății

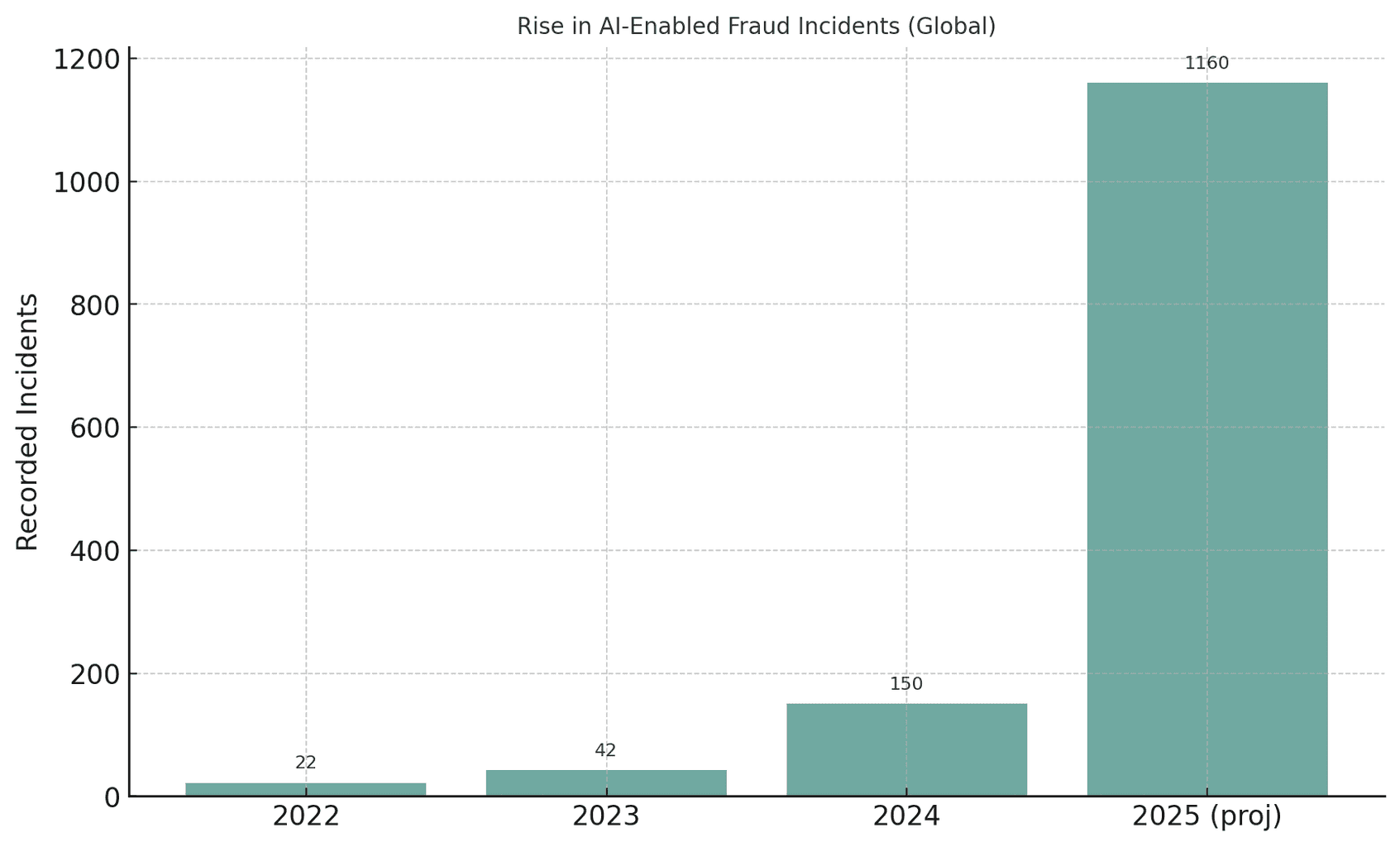

Sectorul mondial al asistenței medicale se confruntă cu o creștere fără precedent a tentativelor de fraudă bazate pe IA. Pe măsură ce inteligența artificială generativă devine accesibilă, escrocii pot automatiza ceea ce înainte erau escrocherii manuale, producând la scară largă identități false convingătoare, documente și chiar voci sau videoclipuri. De exemplu, autoritățile au observat că tentativele de fraudă care implică deepfake media au crescut cu 3,000% în 2023 singur[4][5]. Incidentele legate de Deepfake aproape s-au dublat de la 22 în 2022 la 42 în 2023, apoi au explodat la 150 de incidente în 2024; uimitor, în primul trimestru al anului 2025 s-au înregistrat 179 de cazuri de fraudă Deepfake - depășind deja totalul pentru 2024[6][7]. Această tendință sugerează o creșterea vertiginoasă a fraudei bazate pe inteligența artificială, analiștii preconizând că inteligența artificială generativă ar putea duce la pierderi de fraudă de $12,3 miliarde în 2023 la $40 miliarde până în 2027 (32% CAGR)[8].

Figura: Creșterea explozivă a incidentelor de fraudă bazate pe IA în ultimii ani. Cazurile detectate de fraudă deepfake sau asistată de IA au crescut dramatic între 2022 și 2025, ilustrând modul în care instrumentele generative de IA au supraîncărcat tentativele de fraudă[4][7].

Nu vă mai îngrijorați niciodată de frauda AI. TruthScan Vă poate ajuta:

- Detectarea AI generate imagini, text, voce și video.

- Evitați fraudă majoră generată de IA.

- Protejați-vă cele mai sensibile activele întreprinderii.

Sistemul de sănătate este deosebit de vulnerabil la acest val de infracțiuni alimentat de IA. Ecosistemul vast și fragmentat al sectorului - care cuprinde spitale, clinici, asigurători, farmacii și platforme de telesănătate - oferă mii de puncte de atac[9][10]. Escrocheriile tradiționale (de exemplu, carduri de asigurare false sau acte de identitate furate ale pacienților) au a evoluat în exploatare sistemică utilizarea AI[10][11]. În 2025, Departamentul de Justiție al SUA a acuzat 324 de inculpați în cadrul unor scheme în valoare totală de $14,6 miliarde în reclamații false - cel mai mare caz de fraudă în domeniul sănătății înregistrat vreodată[12][13]. Multe escrocherii au implicat consultații de telemedicină și fraude legate de testele genetice, iar un nou raport al DOJ Centrul de fuziune a datelor privind frauda în domeniul sănătății a utilizat analizele AI pentru a detecta în mod proactiv modele[14][15]. În mod clar, inteligența artificială este o sabie cu două tăișuri: ajută investigatorii să prindă frauda, dar și permițând infractorilor să comită fraude la o scară și o sofisticare fără precedent[11][2].

Tehnici comune de fraudă bazate pe IA în domeniul sănătății (2025)

În 2025, escrocii dispun de un set de tactici bazate pe inteligența artificială pentru a frauda sistemele de sănătate și asigurătorii. Principalele scheme includ falsificarea identităților și a documentelor, generarea de date medicale false și impersonarea personalului de încredere prin intermediul deepfakes. Mai jos vom analiza cele mai răspândite tehnici de fraudă bazate pe IA și modul în care acestea sunt utilizate împotriva organizațiilor din domeniul sănătății:

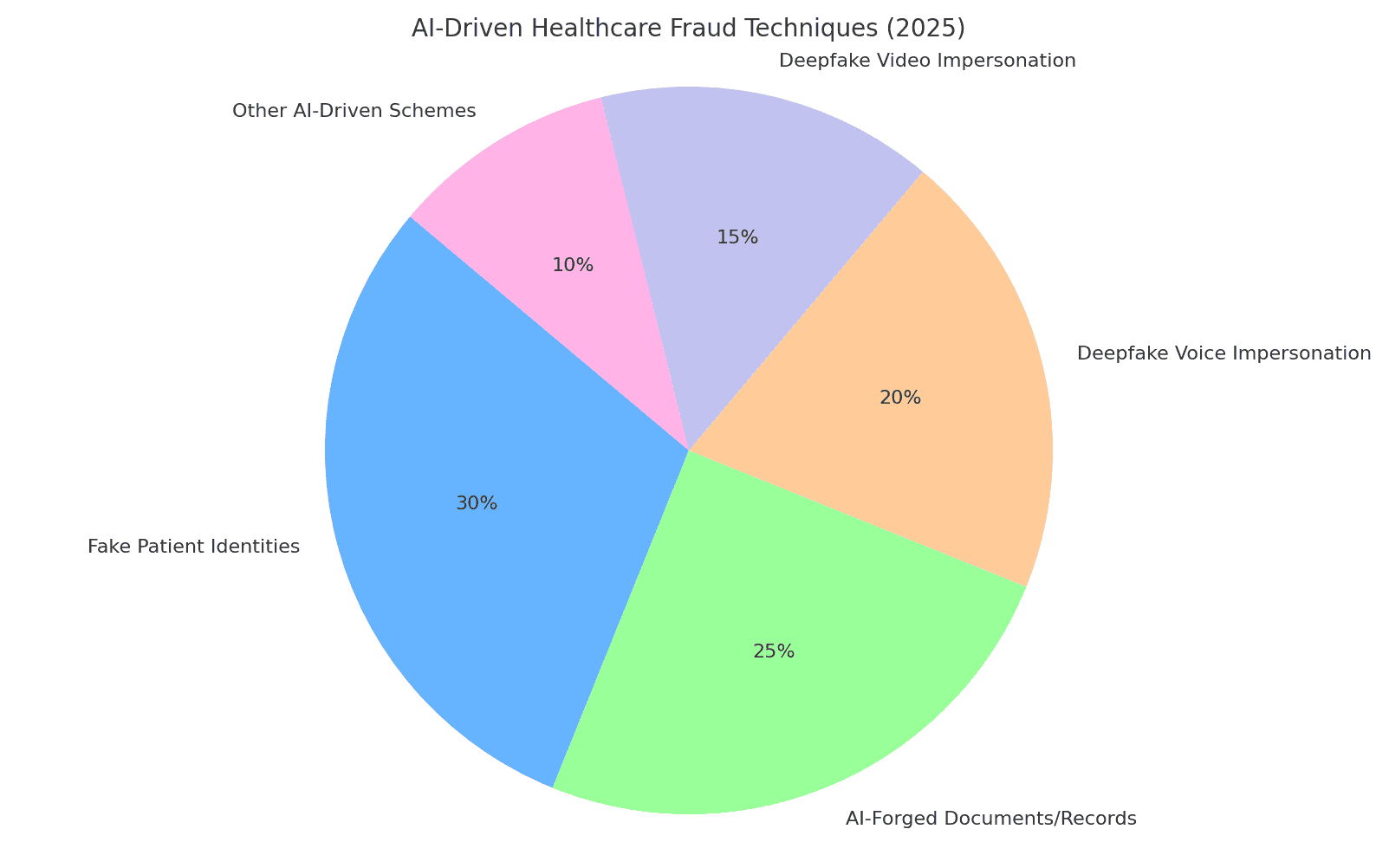

Figura: Defalcarea principalelor tehnici de fraudare a asistenței medicale bazate pe IA în 2025. Identități false ale pacienților și Documente falsificate de AI (de exemplu, fișe medicale, reclamații) reprezintă o mare parte a schemelor, în timp ce deepfake voce și imitații video sunt o amenințare în creștere rapidă. "Alte scheme bazate pe inteligența artificială" includ e-mailuri de phishing create de inteligența artificială, roboți care atacă portalurile pacienților și exploatări similare (procente estimate pe baza rapoartelor din industrie[8][16]).

Identități sintetice ale pacienților

Identități false ale pacienților - adesea create cu ajutorul inteligenței artificiale - reprezintă o tactică fundamentală de fraudă. În loc să fure identitatea unei persoane, infractorii combină date reale de la mai multe persoane cu detalii inventate pentru a crea identități sintetice care trec drept pacienți noi[17][18]. Inteligența artificială generativă accelerează acest proces prin producerea de înregistrări personale realiste. De exemplu, AI poate genera date plauzibile ID-uri, profiluri, chiar istoricul familiei ("părinți sintetici") pentru un pacient fals[19][20]. Acești pacienți-fantomă sunt apoi utilizați pentru să deschidă conturi, să obțină polițe de asigurare sau să factureze pentru servicii care nu a avut loc niciodată. În timpul pandemiei COVID-19, escrocii au folosit identități sintetice pentru a beneficia de ajutoare medicale de urgență; acum le folosesc pentru să depună cereri false de asigurare sau să obțină rețete, știind că o identitate bine creată poate eluda detectarea[21][22]. Potrivit U.S. Federal Reserve, pierderile cauzate de frauda de identitate sintetică au depășit $35 miliarde în 2023 și continuă să crească[23]. Impactul asupra asistenței medicale este grav: escrocii ar putea utiliza numărul de securitate socială furat al unui copil pentru a crea un pacient fals cu un credit perfect sau ar putea amesteca datele furate ale unui pacient pentru a ocoli verificarea asiguratorului[17][24]. Fiecare pacient sintetic introdus în sistem subminează integritatea datelor și poate duce la plăți eronate sau chiar erori clinice în cazul în care identitatea falsă se împletește cu dosarele medicale reale.

Documente medicale și cereri de despăgubire generate de AI

Inteligența artificială generativă este utilizată în prezent pentru a forja documente medicale, dosare și cereri de despăgubire complete. Modelele lingvistice pot produce note medicale autentice, rezumate de externare, rezultate de laborator sau declarații de facturare pline de jargon medical - toate adaptate pentru a susține o cerere frauduloasă. De fapt, observatorii din industrie raportează o 89% creșterea numărului de documente medicale generate de AI prezentate, în comparație cu anii anteriori[25][26]. Escrocii folosesc aceste înregistrări false pentru a justifica proceduri sau medicamente costisitoare care nu au fost furnizate niciodată sau pentru a umfla codurile de rambursare. De exemplu, o inteligență artificială ar putea genera un raport de diagnostic imagistic sau rezultat de laborator pentru a justifica o cerere de rambursare de costuri ridicate pentru medicamente oncologice. Asigurătorii și sistemele de sănătate se confruntă cu un val de astfel de hârtii sintetice, ceea ce face mai dificilă diferențierea cererilor de despăgubire legitime de cele false. În Regatul Unit, asigurătorii constată o creșterea rapidă a utilizării deepfakes și a documentelor falsificate în fraudarea cererilor de despăgubire, adesea în cereri aparent de rutină cu valoare redusă, pentru a evita controlul[27]. Nici imagistica clinică nu este imună - există dovezi că fraudatorii folosesc inteligența artificială generativă pentru a imita imagini medicale cum ar fi razele X sau scanările[3]. Consecințele merg dincolo de pierderile financiare: în cazul în care fișele medicale falsificate intră în dosarele pacienților, acestea pot duce la diagnostice greșite sau la tratamente necorespunzătoare. Astfel, Documentele de sănătate redactate de AI prezintă un risc grav pentru integritate și siguranță.

Prescripții falsificate și fraudă în farmacie

Frauda cu prescripție medicală a intrat în era digitală cu ajutorul IA. Prescripții falsificate - realizate în mod tradițional cu carnete de rețete furate sau editare rudimentară - pot fi acum generate automat cu detalii realiste și semnături ale medicilor. Generatoarele de imagini AI sau șabloanele fac trivială crearea tipărituri de prescripții electronice cu aspect autentic sau formulare de comandă pentru farmacii. Mai insidios, infractorii folosesc clonarea vocii pentru a se da drept medici în apelurile cu farmaciștii. Într-o tendință raportată, escrocii au pătruns în dosarele medicale pentru a fura numerele de înregistrare DEA ale medicilor și apoi au folosit aceste acreditări pentru a trimite rețete electronice pentru substanțe controlate[28]. Au existat cazuri de Falsuri vocale AI utilizate pentru a autoriza reîncărcări - un farmacist primește un apel care sună exact ca un medic cunoscut care confirmă o rețetă, dar este de fapt o voce generată de inteligența artificială. Ca urmare, medicamentele controlate (cum ar fi opioidele sau stimulentele) pot fi obținute ilegal și deturnate. Frauda cu rețete falsificate nu cauzează doar pierderi financiare pentru asigurători și farmacii, ci pune în pericol pacienții, care pot primi medicamente incorecte în dosarele lor. De exemplu, dacă un escroc se dă drept un pacient pentru a obține rețete de opioide, acesta dosarul medical al unui pacient real poate fi actualizat cu medicamente pe care acesta nu le-a luat niciodată, ceea ce duce la interacțiuni periculoase sau îl semnalează ca fiind în căutare de medicamente[29]. Această combinație de criminalitate cibernetică și exploatare a IA a determinat avertizări din partea autorităților de reglementare. Organizațiile medicale trebuie acum să verifice dacă fiecare rețetă - în special medicamentele cu risc ridicat - este legitimă și provenind cu adevărat de la furnizorul autorizat, nu un deepfake sau o încălcare a securității datelor.

Imitații Deepfake Doctor-Pacient

Poate cea mai importantă evoluție este utilizarea deepfakes pentru a se da drept personal medical sau pacienți. În cadrul telemedicinei și al serviciilor pentru clienți, escrocii folosesc înregistrări video și audio generate de AI pentru a păcăli persoanele de la celălalt capăt al firului. De exemplu, infractorii au creat videoclipuri deepfake ale pacienților pentru consultații telehealth, păcălind medicii să ofere "tratament" sau trimiteri care sunt apoi facturate la asigurări[30][31]. În schimb, un escroc ar putea falsifica imaginea unui medic - folosind chipul și vocea unui medic cu reputație - într-un apel video pentru a să convingă un pacient să plătească pentru un serviciu fraudulos sau să divulge informații personale. Experții IT din domeniul sănătății avertizează că telemedicina a devenit o țintă perfectă: se poate programa o întâlnire virtuală folosind o identitate falsă de pacient, apoi un avatar AI poate interveni pe video pentru a obține rețete sau sfaturi medicale sub pretexte false[31][32]. Dincolo de telemedicină, deepfakes sunt saturate de social media sub formă de videoclipuri cu "doctori" care promovează tratamente miraculoase. În 2024, experții au observat că videoclipurile deepfaked ale unor medici celebri "a decolat cu adevărat," care vizează publicul în vârstă cu sfaturi de sănătate false și produse înșelătoare[33][34]. Medicii de încredere de la televiziunile din Marea Britanie și Franța și-au clonat înfățișarea pentru a susține tratamente false pentru diabet și suplimente pentru tensiunea arterială[35][36]. Până la jumătate dintre spectatori nu și-au putut da seama că aceste videoclipuri medicale deepfake sunt false[37]. Această erodare a adevărului are costuri tangibile: pacienții pot urma sfaturi dăunătoare dintr-un videoclip fals al unui medic sau escrocii pot factura asigurătorilor pentru consultații care nu au avut loc niciodată, cu excepția unei înregistrări deepfake. În total, Imitațiile bazate pe inteligența artificială subminează încrederea fundamentală în interacțiunile medicale - dacă nu puteți avea încredere că persoana de pe ecran sau de pe telefon este cine pretinde că este, întregul sistem este în pericol.

Impact și amploare: 2025 Frauda în cifre

Frauda generată de inteligența artificială nu mai este o problemă marginală - ea reprezintă în prezent o pierdere financiară majoră și o amenințare la adresa securității în cadrul sistemelor de sănătate globale. Luați în considerare următoarele statistici și cazuri recente care ilustrează amploarea problemei:

- Pierderi anuale: Frauda în domeniul asistenței medicale costă în SUA aproximativ $68 miliarde sau mai mult în fiecare an[25], aproximativ 3-10% din toate cheltuielile de sănătate[38]. La nivel mondial, frauda poate consuma aproximativ 6% din cheltuielile de sănătate[39] - o cifră uluitoare, având în vedere că cheltuielile mondiale cu sănătatea se ridică la trilioane de dolari. Aceste pierderi se traduc în cele din urmă prin prime mai mari, costuri spitalicești mai mari și resurse reduse pentru îngrijirea pacienților.

- Intensificarea fraudelor în 2023-2025: Apariția inteligenței artificiale generative a dus la o explozie a tentativelor de fraudă. Incidentele de fraudă legate de Deepfake au crescut de zece ori din 2022 până în 2023[4]. În 2024, incidentele deepfake raportate au crescut la 150 (o creștere de 257%)[40], iar anul 2025 este pe cale să depășească cu mult această cifră (580 de incidente doar în prima jumătate a anului 2025, aproape 4× totalul pentru 2024)[7]. Experții în fraudă observă că 46% s-au confruntat cu fraude de identificare sintetică, 37% cu falsuri vocale și 29% cu falsuri video în investigațiile lor[8] - subliniind cât de comune au devenit aceste tehnici de inteligență artificială.

- Recorduri de Takedowns: Agențiile de aplicare a legii răspund cu măsuri mai drastice. În iunie 2025, Departamentul de Justiție al SUA a anunțat cea mai mare fraudă în domeniul sănătății din istorie, inculparea a 324 de persoane și descoperirea $14,6 miliarde în cereri frauduloase[1][13]. Schemele au inclus escrocherii de consultanță telehealth, fraude de testare genetică și escrocherii cu echipamente medicale durabile la scară largă[13]. Ca parte a acestui efort, Medicare a suspendat $4 miliarde în plăți în așteptare considerate suspecte[41], prevenind aceste pierderi. Un caz fundamental ("Operațiunea Gold Rush") a dezvăluit o rețea internațională care folosea identități furate pentru a depune $10,6 miliarde de dolari în cereri false de plată pentru materiale medicale[42] - o dovadă a cât de departe vor merge infractorii atunci când sunt înarmați cu date violate și automatizare.

- Impactul asupra asigurătorilor: Asigurătorii din întreaga lume observă o creșterea fraudelor legate de inteligența artificială. În Regatul Unit, asigurătorii raportează utilizarea tot mai frecventă a falsurilor profunde în cadrul cererilor de despăgubire (adesea cereri de despăgubire "de mică importanță" pentru a evita detectarea)[27]. O firmă de reasigurare de top avertizează că dosarele medicale falsificate și condițiile de sănătate false subminează subscrierea și ar putea duce la creșterea pierderilor din asigurările de viață și sănătate[43]. O analiză Deloitte din 2024 a estimat că până în 2027, frauda generată de inteligența artificială generativă ar putea reprezenta pierderi anuale de $40 miliarde în SUA. (în creștere de la $12,3 miliarde în 2023)[8]. Această traiectorie implică o lovitură semnificativă pentru rezultatele financiare ale asigurătorilor dacă nu sunt adoptate contramăsuri solide.

- Victimele pacienților: Pacienții și publicul pierd, de asemenea, bani din cauza acestor escrocherii. Adulții în vârstă, în special, au fost vizați de escrocherii cu voce AI (apeluri telefonice de tip "nepot în primejdie") și escrocherii de tip "deepfake health". În 2023, persoanele în vârstă din SUA au raportat $3.4 miliarde în pierderi cauzate de fraudă, o creștere de 11% față de anul precedent[44][45] - unele dintre acestea fiind determinate de scheme îmbunătățite de inteligența artificială. Și dincolo de costul monetar, există un costul uman: sfaturile medicale frauduloase și tratamentele false promovate prin intermediul inteligenței artificiale pot duce la vătămări fizice sau la pierderea încrederii în îndrumările medicale legitime.

În general, 2025 a arătat clar că Inteligența artificială stimulează frauda tradițională în domeniul sănătății. Ceea ce înainte erau scheme mici și oportuniste s-au transformat în operațiuni industrializate care se întind pe continente. Combinația dintre datele de mari dimensiuni (adesea provenite din breșe) și generarea inteligenței artificiale înseamnă că escrocheriile pot fi desfășurate cu o viteză și o plauzibilitate înspăimântătoare. Pierderile globale sunt de ordinul zecilor de miliarde și sunt în creștere, iar fiecare parte interesată - de la spitale și asigurători la pacienți - este în pericol. Următoarea secțiune analizează modul în care industria poate riposta folosind tehnologii și strategii la fel de avansate.

Apărarea împotriva fraudelor generate de inteligența artificială: Strategii și soluții

Înfruntarea fraudei în domeniul sănătății bazate pe inteligența artificială necesită un arsenal de mijloace de apărare la fel de avansate. Directorii din domeniul sănătății, echipele de securitate cibernetică, ofițerii de conformitate și asigurătorii trebuie să se coordoneze pentru să integreze măsuri antifraudă în fiecare punct vulnerabil - de la înscrierea pacienților până la plata despăgubirilor. Mai jos sunt prezentate strategiile-cheie și soluțiile tehnice pentru combaterea fraudei bazate pe inteligența artificială:

- Instrumente de detectare a conținutului AI: La fel cum infractorii folosesc inteligența artificială pentru a fabrica conținut, organizațiile pot folosi inteligența artificială pentru a-l detecta. Tehnologie avansată Detectoare de conținut scris cu inteligență artificială (cum ar fi suita TruthScan) analizează texte, imagini, materiale audio și video pentru a identifica semnele revelatoare ale generării AI. De exemplu, platforma TruthScan aplică învățarea automată pentru a identifica modelele statistice și ciudățeniile lingvistice care indică un text generat de AI cu peste 99% precizie[46][47]. Aceste instrumente pot fi integrate în sistemele de gestionare a cererilor de despăgubire sau în fișele medicale electronice pentru a semnala automat documente suspecte - de exemplu, un raport medical care a fost probabil scris de ChatGPT - pentru revizuire manuală. De asemenea, AI image forensics poate detecta scanările medicale manipulate sau cărțile de identitate false, iar algoritmii de detectare a falsurilor profunde pot analiza videoclipurile pentru a găsi semne de sinteză (artefacte în pixeli, sincronizare ciudată a mișcărilor faciale etc.)[48][49]. Prin implementarea detectoarelor AI multimodale, organizațiile de sănătate pot eliminarea în timp real a unei mari părți din conținutul falsificat de AI înainte de a provoca daune.

- Verificarea dosarelor medicale și a documentelor: Furnizorii de servicii medicale apelează la soluții specializate pentru verifică autenticitatea înregistrărilor și a documentelor privind cererile de despăgubire. Aceasta include hashing-ul și semnarea digitală a înregistrărilor legitime, precum și utilizarea bazelor de date cu modele de documente bune cunoscute pentru a le compara cu documentele depuse. Serviciile de verificare bazate pe inteligența artificială (de exemplu, TruthScan's Autentificarea documentelor medicale ) poate analiza instantaneu conținutul și metadatele unui document pentru a determina dacă acesta a fost generat sau modificat automat[50][51]. Aceștia se uită la neconcordanțele pe care un om le-ar putea omite - cum ar fi anomaliile subtile de formatare sau metadatele care indică faptul că o imagine a fost produsă de AI. Monitorizarea în timp real a dosarelor pacienților și a cererilor de despăgubire pentru anomalii este, de asemenea, esențială[52]. Prin scanarea continuă a noilor intrări (rezultate de laborator, note medicale, anexe la cereri de rambursare), aceste sisteme pot detecta înregistrările false înainte de acestea conduc la plăți frauduloase sau la erori clinice. Unii asigurători au pus în aplicare norme prin care orice documentație de cerere de rambursare identificată ca fiind generată de inteligența artificială este retrasă automat pentru investigarea fraudelor. Scopul este de a se asigura că fiecare înregistrare medicală sau cerere care intră în fluxul de lucru este demnă de încredere și nealterată.

- Dovada și validarea identității: Consolidarea verificării identității este esențială în era ID-urilor sintetice. Entitățile din domeniul sănătății ar trebui să impună dovedirea riguroasă a identității pentru noii pacienți, furnizori și vânzători. Aceasta poate implica autentificarea cu mai mulți factori, verificări biometrice (cum ar fi recunoașterea facială sau amprentele digitale la înregistrare) și utilizarea serviciilor de verificare a identității care utilizează inteligența artificială pentru a detecta acte de identitate false sau date personale necorespunzătoare. De exemplu, recunoașterea facială poate fi combinată cu teste de vivacitate pentru a împiedica o față generată de AI să treacă drept un pacient real prin intermediul unei fotografii. La final, algoritmii pot verifica încrucișat detaliile unui pacient (adresă, telefon, e-mail, prezență pe rețelele sociale) pentru a detecta identitățile "subțiri" care nu au un istoric normal - un indiciu cunoscut al identificărilor sintetice[53]. Instituțiile financiare au utilizat cu mare succes astfel de verificări ale consistenței antecedentelor bazate pe inteligența artificială[54]și asistența medicală pot face același lucru: de exemplu, să semnaleze un nou solicitant Medicare dacă nu are nicio amprentă digitală anterioară acestui an. Validarea identităților furnizorilor este la fel de importantă - asigurarea faptului că medicul de pe un videoclip de telemedicină este licențiat și este într-adevăr cine pretinde că este, poate prin emiterea de certificate digitale sau de fluxuri video cu filigran care sunt greu de imitat de către deepfakes. În farmacii, personalul ar trebui să verifice de două ori solicitările neobișnuite de rețete prin apeluri directe către furnizori și să utilizeze fraze de cod sau întrebări de verificare pentru a învinge eventualii impostori de voce AI.

- Detectarea integrată a fraudelor în fluxurile de lucru: Pentru a proteja cu adevărat sistemul, detectarea fraudei nu poate fi o etapă de sine stătătoare - trebuie să fie integrat în fiecare flux de lucru într-o organizație de sănătate.

În practică, aceasta înseamnă că spitalele și asigurătorii implementează integrări API pentru a apela servicii de detectare a fraudelor în momente critice. De exemplu, atunci când un furnizor depune o cerere de rambursare cu documente atașate, un serviciu AI ar putea evalua automat autenticitatea acestor atașamente în câteva secunde. În cazul în care este inițiată o programare telehealth, platforma ar putea rula analiza vocii pasive în fundal pentru a se asigura că apelantul nu utilizează o voce sintetizată. Monitorizare continuă este, de asemenea, esențială: platformele moderne de fraudă oferă tablouri de bord care urmăresc semnalele de fraudă în întreaga organizație (validări nereușite, semnalizarea frecventă a cererilor de rambursare ale unei anumite clinici etc.) pentru a identifica modele, cum ar fi o rețea organizată de fraudă care operează pe mai multe cereri de rambursare. Prin tratarea fraudei în domeniul asistenței medicale mai mult ca amenințările cibernetice - cu Monitorizare 24/7, detectarea anomaliilor și răspuns rapid la incidente - organizațiile pot surprinde problemele înainte ca acestea să se agraveze[55].

- IA pentru analiza fraudelor și recunoașterea modelelor: Volumul de date din domeniul asistenței medicale este atât de mare, încât inteligența artificială este indispensabilă pentru a găsi modele de fraudă pe care oamenii nu le observă. Modelele de învățare automată pot fi antrenate pe cazuri istorice de fraudă pentru a detecta cazuri noi (de exemplu, gruparea cererilor de rambursare care au coduri ICD neobișnuite similare sau identificarea cazurilor în care facturarea unui medic se abate foarte mult de la cea a colegilor). Asigurătorii utilizează deja analiza predictivă pentru clasificarea cererilor de despăgubire în funcție de riscul de fraudă în timp real. Tehnicile emergente, cum ar fi rețelele neuronale grafice, pot cartografia relațiile dintre pacienți, furnizori, diagnostice și reclamații pentru a identifica conexiunile improbabile (cum ar fi același număr de serie al dispozitivului utilizat în reclamații din state diferite). De exemplu, suita TruthScan pentru fraude în domeniul asigurărilor include recunoașterea modelului cererilor și modelarea predictivă pentru a prinde rețelele organizate de fraudă și modelele atipice înainte de acumularea pierderilor[56][57]. Centrul de fuziune al DOJ din 2025 a exemplificat această abordare - agregarea datelor din cadrul Medicare și al asigurătorilor privați pentru a găsi în mod proactiv grupuri de activități suspecte[58]. Organizațiile medicale ar trebui, de asemenea partajarea datelor și a modelelor AI în consorții pentru a lărgi aria semnalelor de fraudă pe care fiecare le poate detecta. Cu cât aceste modele sunt alimentate cu mai multe date (în limitele confidențialității), cu atât ele devin mai bune în a discerne comportamentul normal de cel fraudulos.

- Formarea personalului și controlul proceselor: Tehnologia este esențială, dar conștientizarea umană rămâne o apărare puternică. Personalul medical și administratorii ar trebui să fie instruiți cu privire la tacticile de fraudă bazate pe inteligența artificială - de exemplu, să știe că un un e-mail perfect scris de un CEO ar putea fi un phishing creat de AI, sau că ar trebui verificați identitatea apelanților video dacă ceva pare "ciudat" (mișcările ciudate ale ochilor sau decalajul audio pot indica o înșelătorie profundă). Se pot pune în aplicare exerciții și sfaturi periodice (asemănătoare cursurilor de sensibilizare cu privire la phishing) pentru noile amenințări, cum ar fi înșelăciunile telefonice de tip deepfake. Controalele simple ale proceselor adaugă straturi de securitate: solicitarea unor apeluri de răspuns sau a unei verificări secundare pentru cererile de plată mari sau neobișnuite, utilizarea unor canale de comunicare sigure și cunoscute pentru informațiile sensibile și menținerea unui plan de răspuns la incidente special pentru suspiciunile de fraudă mediate de inteligența artificială. În mod important, organizațiile ar trebui să cultive o cultură în care angajații se simt împuterniciți să pună în discuție anomaliile, chiar dacă este vorba despre un "medic" filmat care solicită o cerere ciudată. Multe înșelătorii de tip deepfake reușesc prin exploatarea încrederii și a autorității; o forță de muncă vigilentă care cunoaște aceste trucuri poate opri incidentele la timp. După cum a remarcat un expert, confruntarea cu deepfakes poate deveni la fel de rutinieră ca depistarea e-mailurilor de phishing - o parte standard a igienei de securitate cibernetică[32][59].

- Valorificarea serviciilor specializate: Având în vedere evoluția rapidă a amenințărilor IA, multe organizații din domeniul sănătății colaborează cu furnizori specializați în prevenirea fraudelor. Servicii precum TruthScan pentru asistență medicală oferă soluții end-to-end adaptate cazurilor de utilizare medicală, inclusiv: monitorizarea în timp real a integrității înregistrărilor medicale electronice (EMR), verificarea documentelor pacientului împotriva manipulării AI, detectarea deepfake pentru telemedicină și raportarea conformității (de exemplu, piste de audit care dovedesc diligența necesară în detectarea fraudei pentru autoritățile de reglementare)[60][51]. Astfel de platforme oferă adesea Integrare API pentru integrarea perfectă în sistemele existente și sunt construite pentru a respecta reglementările din domeniul sănătății (HIPAA, GDPR)[61][62]. Prin utilizarea instrumentelor de nivel enterprise, chiar și clinicile mai mici sau asigurătorii regionali pot avea acces la capacități avansate de detectare a IA fără a le dezvolta intern. În plus, asigurătorii și furnizorii ar trebui să fie atenți la actualizările reglementărilor și standardelor din industrie - de exemplu, noile legi împotriva fraudelor de tip deepfake (unele jurisdicții interzic acum în mod explicit fraudele de tip deepfake în domeniul medical, iar Statele Unite extind legislația privind furtul de identitate pentru a acoperi substituirea AI[63]). Alinierea la astfel de standarde și implementarea instrumentelor de ultimă generație nu numai că vor reduce pierderile cauzate de fraude, dar vor demonstra, de asemenea, partenerilor, auditorilor și pacienților o poziție solidă în materie de securitate.

Concluzii și perspective

Anul 2025 a demonstrat că geniul a ieșit din sticlă - IA generativă și automatizarea sunt acum interconectate cu frauda în domeniul asistenței medicale. În viitor, escrocii vor continua probabil să inoveze: am putea vedea modele AI care învață să imite anumite stiluri de scriere ale medicilor sau deepfakes care reacționează în timp real la întrebările provocatoare. Lupta va fi o cursă continuă a înarmărilor. Cu toate acestea, industria medicală răspunde cu aceeași vigoare, investind în sisteme de apărare bazate pe IA și în fluxuri de securitate mai stricte. Prin combinarea tehnologie de detecție de ultimă generație, procese de verificare riguroase, schimbul de date între industrii și vigilența angajaților, organizațiile din domeniul sănătății pot reduce în mod substanțial amenințarea fraudelor facilitate de IA.

În mod esențial, aceasta nu este doar o problemă IT - este o problemă de guvernanță și încredere. Consiliile de administrație și directorii executivi din domeniul sănătății trebuie să recunoască frauda AI ca fiind un risc strategic pentru finanțe și încrederea pacienților, care necesită atenție și resurse regulate. Echipele de conformitate ar trebui să actualizeze evaluările riscurilor de fraudă pentru a include aspectele legate de inteligența artificială, iar asigurătorii ar putea regândi ipotezele de subscriere, știind că un anumit procent din cereri ar putea fi fraudă asistată de inteligența artificială. Pe de altă parte, utilizarea AI în mod etic în domeniul asistenței medicale (pentru sprijinirea deciziilor clinice, eficientizarea facturării etc.) va continua să aducă mari beneficii - atât timp cât sunt instituite garanții puternice pentru a preveni abuzurile.

În rezumat, inteligența artificială generativă a schimbat jocul fraudei în domeniul asistenței medicale, dar prin conștientizare și contramăsuri avansate, acestea nu trebuie să copleșească sistemul. Organizațiile care vor reuși vor fi cele care vor rămâne informate cu privire la amenințările emergente, se vor adapta rapid cu mijloace de apărare bazate pe IA și vor promova o cultură a "verificării și încrederii" mai degrabă decât a "încrederii implicite". Procedând astfel, sistemul de sănătate poate valorifica în siguranță aspectele pozitive ale IA, neutralizând în același timp utilizarea abuzivă a acesteia, protejând atât rezultatele financiare, cât și bunăstarea pacienților în era digitală.

Surse: Rapoarte și cazuri recente din industrie, citate mai sus, inclusiv Pymnts (iulie 2025)[2][3], Institutul Swiss Re (iunie 2025)[27], Federal Reserve Bank of Boston (aprilie 2025)[19], BMJ (2024)[37], și rezumatele soluțiilor TruthScan (2025)[51][64], printre altele. Toate datele și citatele reflectă cele mai recente date disponibile în 2024-2025, ilustrând starea actuală a fraudei bazate pe IA în domeniul asistenței medicale și răspunsurile pentru combaterea acesteia.

[1] [2] [3] [9] [10] [11] [12] [13] [14] [15] [41] [42] [55] [58] DOJ atribuie instrumentele AI în cadrul represiunii istorice împotriva fraudei în domeniul sănătății

[4] [5] [6] [7] [16] [40] [44] [45] Statistici și tendințe Deepfake 2025 | Date și informații cheie - Keepnet

https://keepnetlabs.com/blog/deepfake-statistics-and-trends

[8] Deepfakes și criza cunoașterii | UNESCO

https://www.unesco.org/en/articles/deepfakes-and-crisis-knowing

[17] [18] [19] [20] [21] [22] [23] [24] [53] [54] Generația AI sporește amenințarea fraudei de identitate sintetică - Federal Reserve Bank of Boston

[25] [26] [56] [57] [62] [64] Detectarea fraudelor prin inteligență artificială în asigurări de sănătate și de viață | TruthScan

https://truthscan.com/solutions/health-life-commercial-insurance-fraud-detection-solution

[27] [43] Modul în care deepfakes, dezinformarea și AI amplifică frauda în asigurări | Swiss Re

[28] DEA avertizează asupra fraudei cu rețete electronice - Pharmacy Practice News

[29] [39] Securitatea cibernetică și frauda în domeniul sănătății: O scufundare profundă în cele mai mari riscuri și apărări de astăzi | CrossClassify

https://www.crossclassify.com/resources/articles/healthcare-cybersecurity-and-fraud/

[30] [31] [32] [59] Amenințarea în evoluție a înșelătoriilor de telemedicină Deepfake, Mike Ruggio

https://insights.taylorduma.com/post/102jkzn/the-evolving-threat-of-deepfake-telemedicine-scams

[33] [34] Experții avertizează că escrocii folosesc "Deepfakes" ale unor medici celebri pe rețelele sociale

[35] [36] [37] Medici de încredere de la televizor "deepfaked" pentru a promova escrocherii de sănătate pe rețelele sociale - BMJ Group

https://bmjgroup.com/trusted-tv-doctors-deepfaked-to-promote-health-scams-on-social-media/

[38] [PDF] stadiul actual al cercetării Ajit Appari și M. Eric Johnson

http://mba.tuck.dartmouth.edu/digital/Research/ResearchProjects/AJIJIEM.pdf

[46] [47] [48] [49] TruthScan - Detectarea IA la nivel de întreprindere și securitatea conținutului

[50] [51] [52] [60] [61] Detectarea fraudelor în fișele medicale cu IA | Soluții CRO pentru sănătate | TruthScan

https://truthscan.com/solutions/healthcare-cro-fraud-detection

[63] Cât de periculoase sunt Deepfakes și alte fraude bazate pe inteligența artificială?