Há apenas alguns anos, era necessário um estúdio profissional e muita perícia técnica para imitar a voz de alguém.

Agora, qualquer pessoa com uma ligação à Internet e algum tempo livre pode criar um clone digital da voz de qualquer pessoa em menos de um minuto.

As ferramentas para estes ataques estão a tornar-se mais baratas e mais acessíveis a cada dia que passa para todos. E como muitas pessoas partilham as suas vidas nas redes sociais, é muito fácil para um burlão encontrar o áudio de que precisa.

Neste artigo, apresentamos-lhe alguns dos exemplos reais mais notórios de fraude de áudio. Também lhe apresentaremos uma solução para pôr um fim atempado a estas ameaças.

Principais conclusões

- As tentativas de fraude de deepfake de voz aumentaram mais de 2,137% nos últimos anos, impulsionadas pelo facto de a IA moderna poder gerar um clone de voz preciso 85% utilizando apenas três segundos de áudio de origem.

- Entre os ataques reais mais conhecidos contam-se o assalto à empresa de engenharia Arup, em 2024, em que os burlões utilizaram um vídeo e áudio deepfake de um diretor financeiro para enganar um empregado e levá-lo a transferir $25,6 milhões.

- Para além do roubo empresarial, os deepfakes de voz representam graves riscos emocionais para as famílias através de esquemas de rapto e podem contornar os sistemas tradicionais de segurança biométrica utilizados pelos bancos e outras aplicações de alta segurança.

- As organizações são forçadas a ultrapassar a verificação humana por si só, implementando protocolos de aprovação de várias pessoas para grandes transferências e implementando detectores de voz com IA, como o TruthScan, para analisar impressões digitais acústicas em tempo real.

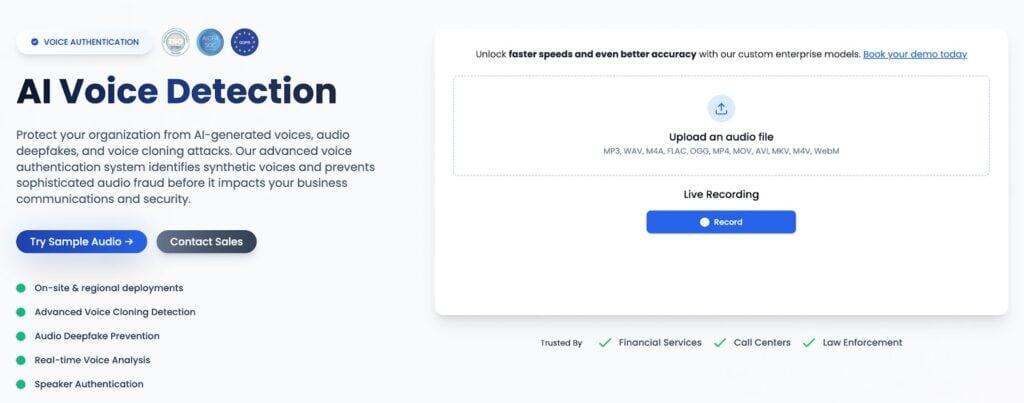

- O TruthScan protege as interações empresariais identificando artefactos de fala sintética de plataformas como ElevenLabs e Murf com uma precisão superior a 99% em todos os principais formatos de áudio e vídeo.

O que são ataques de voz Deepfake?

Um deepfake de voz é uma falsificação digital da voz de alguém. O atacante utiliza software que pode analisar todos os pormenores da forma como alguém fala a partir de uma gravação da sua voz.

Para clonar a voz, o software tenta detetar padrões na voz. O software tem em conta, principalmente, aspectos como o tom, o timbre, a forma como a pessoa respira entre frases, etc.

Depois de aprender estes padrões, o atacante pode fazê-lo dizer qualquer coisa com essa voz.

Nunca mais se preocupe com fraudes de IA. TruthScan Pode ajudar-vos:

- Detetar a IA gerada imagens, texto, voz e vídeo.

- Evitar grandes fraudes impulsionadas pela IA.

- Proteja os seus mais sensível activos da empresa.

O que é perigoso é que as ferramentas de criação de voice deepfake são facilmente acessíveis. E a maior parte delas não precisa de ser instalada. Estão disponíveis online sob a forma de sítios Web.

Só precisa de gastar alguns dólares e começar a clonar vozes. Se procurar um pouco mais, pode até encontrar ferramentas que lhe permitem clonar vozes gratuitamente.

Esta tecnologia nova e facilmente disponível conduziu a um aumento acentuado da fraude no sector do áudio.

Os burlões só precisam de uma pequena parte do áudio de alguém, que podem obter nas redes sociais ou noutro canal público, para o clonar.

Depois, podem utilizar a voz clonada para se fazerem passar por uma pessoa em situações como chamadas telefónicas em direto, reuniões em vídeo, notas de voz, anúncios, etc.

Estes não são apenas casos hipotéticos de utilização de ataques de deepfake de voz. Estas coisas já aconteceram. Iremos abordar alguns dos notórios ataques de deepfake de voz mais à frente.

Riscos potenciais dos ataques de voz Deepfake

Ao ouvir falar de voice deepfake, pode ter imaginado um vídeo engraçado de uma celebridade a dizer coisas que nunca disse.

Mas esse uso aparentemente inócuo da voz clonada pode causar sérios danos às partes envolvidas. Vamos falar sobre os riscos.

Devastação financeira para as empresas

Um deepfake de voz pode arruinar a reputação de uma empresa para sempre. Tem também o poder de lhe roubar grandes somas de dinheiro em minutos.

Como é que isso acontece, pode perguntar-se? Os burlões podem clonar a voz do chefe de uma empresa e usá-la para telefonar aos empregados e obrigá-los a fazer coisas que não é suposto serem feitas, como transferir dinheiro para uma conta.

Este é apenas um exemplo. As possibilidades são infinitas.

Contornar sistemas de segurança

A sua voz é uma biometria que mais ninguém deveria ter. Isto porque a utiliza como palavra-passe para iniciar sessão em muitas das suas aplicações, especialmente as bancárias.

Embora estas aplicações possam ter um sistema de verificação de voz automatizado incorporado para impedir o acesso não autorizado, um bom clone de voz ainda tem uma hipótese de os enganar.

O impacto emocional nas famílias

Os alvos mais fáceis para os burlões do áudio são talvez as pessoas idosas da família. Os pais e os avós, por exemplo.

Os burlões podem telefonar, por exemplo, a uma mãe e reproduzir o som da sua filha a pedir ajuda, dizendo que foi raptada.

A erosão da confiança no local de trabalho

Os ataques de voz deepfake também prejudicam a confiança num local de trabalho saudável.

Os empregados terão de verificar novamente as chamadas telefónicas do seu gestor para se certificarem de que não se trata de um burlão a ordenar-lhes que façam coisas arriscadas com uma voz clonada.

Então, quais são as suas opções, se não a dupla verificação manual? Todos os riscos que acabámos de discutir apontam para a necessidade de uma prevenção automatizada de ataques deepfake.

Felizmente, dispomos agora de ferramentas de deteção de vozes com IA deepfake, sendo o TruthScan uma delas.

Evite fraudes e falsificações de identidade com o TruthScan Detetor de voz AI.

Exemplos reais de ataques Deepfake de voz

Graças à IA, chegámos a um ponto em que não podemos confiar facilmente no que os nossos olhos vêem ou os nossos ouvidos ouvem. A IA é agora capaz de criar imagens e vídeos realistas. O mesmo se aplica ao áudio.

Você já deve ter ouvido histórias de pessoas que caíram na fraude de áudio deepfake. De vez em quando, também aparece nas notícias e nas redes sociais. Algumas delas são difíceis de entender.

Vamos falar-lhe de alguns dos mais notórios ataques de deepfake de voz para que possa ter uma boa ideia da forma inteligente como são executados.

A reunião virtual de $25 milhões que nunca aconteceu

Este ataque de deepfake é provavelmente o mais relatado.

O A vítima foi uma empresa de engenharia britânica chamada Arup, mas a fraude teve origem no seu escritório de Hong Kong.

Estávamos no início de 2024 quando um trabalhador do departamento financeiro de uma empresa recebeu um e-mail do diretor financeiro da empresa no Reino Unido. No e-mail, o trabalhador recebia instruções do diretor financeiro para fazer transferências secretas de dinheiro para algumas contas bancárias.

No início, o funcionário ficou bastante desconfiado porque o pedido parecia um pouco estranho e pensou que poderia ser um esquema de phishing.

Mas depois o empregado foi convidado para uma videoconferência. Quando o empregado entrou na chamada, viu o que parecia ser exatamente o diretor financeiro e vários outros colegas seniores.

Todos pareciam e soavam exatamente como deviam. Estavam também a falar uns com os outros para que tudo parecesse mais real.

Isto dissipou completamente todas as dúvidas do funcionário do departamento financeiro, que enviou então mais de $25,6 milhões (~HK$200 milhões) para várias contas bancárias diferentes de Hong Kong através de 15 transacções.

Descobriu-se mais tarde que todo este esquema era uma farsa. Nenhuma pessoa na chamada era quem parecia ser, exceto o funcionário da Arup. Os burlões tinham coordenado na perfeição o ataque, utilizando clones de áudio e vídeo de alta qualidade do diretor financeiro da empresa e de funcionários superiores.

O ministro italiano e os ícones da moda

Este também teve lugar em 2024. A falso ministro da defesa italiano Guido Crosetto telefonou a várias elites italianas e pediu-lhes ajuda financeira imediata para resgatar os jornalistas raptados.

Na chamada, o falso Guido Crosetto afirmava que se tratava de uma operação governamental ultra-secreta. O autor da chamada até conseguiu falar ao telefone com figuras lendárias da moda, como Giorgio Armani.

Infelizmente, uma pessoa acabou por transferir cerca de um milhão de dólares. Provavelmente, a pessoa tinha um sentido mais forte de dever patriótico para ajudar do que outras, o que os burlões conseguiram explorar.

O roubo de energia de $243,000 no Reino Unido

Isto aconteceu em 2019 e foi provavelmente o primeiro deepfake desta dimensão alguma vez registado.

Um diretor executivo de uma empresa de energia do Reino Unido pensou que estava ao telefone com o seu chefe da empresa-mãe na Alemanha.

O diretor executivo recebeu ordens para transferir cerca de 220 000 euros ($243 000) para um fornecedor na Hungria. Disseram-lhe que se tratava de um negócio importante que necessitava de transferência imediata. O diretor-geral caiu no esquema e transferiu o dinheiro.

Uma chamada aterradora para uma mãe no Arizona

Lembram-se de termos falado que os deepfakes de áudio eram uma ameaça para as famílias? O exemplo da fraude que demos aconteceu de facto.

Os burlões tinham clonado a voz de uma rapariga de 15 anos a partir de um vídeo seu nas redes sociais. Depois ligaram à mãe e afirmaram, na voz da filha, que esta tinha sido raptada e que os raptores exigiam um resgate imediato.

Felizmente, o pai conseguiu telefonar à filha verdadeira, que estava a salvo num treino de esqui durante toda a situação. Evitaram a burla.

Como as falsificações profundas de voz afectam as empresas

O principal objetivo de um ataque de deepfake de voz é sobretudo roubar dinheiro.

Mas quando o alvo são as empresas, os danos são multidimensionais.

Por exemplo, os deepfakes podem envenenar a atmosfera entre os empregados de uma empresa. Tem o potencial de criar uma cultura em que os empregados estão sempre com medo de cometer um erro.

Tomemos o exemplo dos centros de atendimento telefónico. Há relatos de cibercriminosos que lhes telefonam e fingem ser clientes específicos.

O seu truque consiste em fazer com que os agentes do centro de atendimento alterem os dados da conta desses clientes (por exemplo, endereços residenciais, números de telefone) e assumam o controlo das suas contas.

A contratação à distância e as entrevistas virtuais são outra área em que as vozes falsas podem ser utilizadas pelos candidatos para conseguirem empregos para os quais não estão qualificados.

Proteger as empresas contra ataques de voz Deepfake

As regras de segurança tradicionais das empresas foram redigidas na era anterior à IA.

É mais do que tempo de as empresas as reconsiderarem. Em primeiro lugar, devem começar por se informarem sobre as muitas novas ameaças cibernéticas que resultam do abuso da IA.

Por exemplo, podem organizar sessões de formação para toda a sua equipa e mostrar-lhes exemplos reais de fraude áudio. Pode começar com os exemplos que acabámos de discutir acima. Essas sessões de formação devem também dar-lhes dicas de prevenção de ataques de deepfake para diferentes cenários.

Depois, pode avançar e atualizar as políticas internas da empresa. Uma alteração importante pode ser deixar de permitir que uma única pessoa autorize sozinha transferências electrónicas maciças.

Os grandes pagamentos deveriam exigir a aprovação de todo um painel, para que pelo menos um deles possa aperceber-se a tempo de que algo está errado.

Também deve pensar em integrar um sistema automatizado de Detetor de voz AI para ser executado em segundo plano durante as chamadas.

É para isso que as ferramentas de IA do TruthScan foram criadas. É possível detetar, verificar e impedir ataques de deepfake de voz usando nossas ferramentas de IA. Vamos dizer como.

Como o TruthScan protege as interações de voz

Compreendemos que os funcionários não conseguem, sozinhos, distinguir uma voz falsa de uma voz real no meio de uma chamada stressante. Precisam de um assistente dedicado que possa tratar dessa tarefa durante uma chamada, enquanto a sua equipa pode concentrar-se naquilo para que foi contratada.

O nosso Detetor de voz AI é uma solução específica.

Eis como funciona e do que é capaz:

- Analisa milhões de pontos de dados diferentes em chamadas telefónicas e videoconferências em direto e oferece uma precisão de 99%

- Emite um aviso instantâneo após detetar uma voz falsa

- Capta padrões espectrais e impressões digitais acústicas na voz que só são deixados para trás por modelos sintéticos

- Integra-se com o seu call center ou help desk existente através de uma simples API REST

- Pode digitalizar todos os principais formatos de áudio e vídeo

Fale com o TruthScan sobre a prevenção de ataques de Deepfake de voz

Pode impedir a fraude de clonagem de voz em tempo real com o TruthScan, mas a questão é: quando é que vai começar? Os seus funcionários podem, mais cedo ou mais tarde, cometer um erro e fazer com que você seja enganado. Não espere por esse momento infeliz.

O nosso detetor de voz com IA pode detetar deepfakes de voz utilizando plataformas como ElevenLabs e Murf.

Funciona em segundo plano durante as chamadas telefónicas em direto e as videoconferências, para que os seus agentes de chamadas não tenham de realizar várias tarefas.

Tudo o que precisa é de uma rápida integração através da nossa API REST.

Comece a utilizar TruthScan agora e proteja a sua empresa das fraudes deepfake.