Uma chamada normal do seu diretor financeiro pode ser o momento em que a confiança se volta contra si. Imagine que a violação começa com;

“Pode enviar-me a palavra-passe de administrador antes do almoço?’

Obedece como se fosse a única forma de sobreviver ao almoço. Parece razoável, pois é apenas um momento perfeitamente normal de um dia de trabalho.

Mas este momento de rotina no trabalho vai ser a cena inicial de um incidente de segurança. O risco chega agora disfarçado de rotina.

No início de 2024, este tipo de engano chegou com uma voz familiar e uma cara amiga, quando um trabalhador financeiro de Hong Kong levantou dinheiro $25 milhões a alguém que se parece exatamente com o seu verdadeiro diretor financeiro.

A sua empresa já não se pode dar ao luxo de assumir boas intenções. É como se estivéssemos na intersecção entre a confiança e a responsabilidade legal.

Por isso, é uma chamada de atenção para alinhar os seus protocolos de TI com a mais recente legislação de IA deepfake. Porque os hackers falam agora com vozes que estamos habituados a ouvir todos os dias.

Continue a ler e entre na nova era jurídica da IA para ver como as imagens e sons falsos podem criar uma exposição jurídica real.

Principais conclusões

- A confiança já não é segura. A fraude do CFO de Hong Kong, no valor de $25 milhões, provou que a familiaridade pode ser falsificada de forma convincente.

- A lei está a avançar mais rapidamente. No momento em que a IA é implementada, a responsabilidade legal segue a empresa. Por isso, não importa quem carregou em “implementar”, a lei aponta para si.

- Os meios sintéticos estão tão avançados que confiar apenas nos instintos humanos é agora um risco. As empresas precisam de sistemas de deteção de IA em tempo real para analisar todos os e-mails, todas as chamadas de vídeo/voz e ficheiros partilhados em busca de sinais de manipulação.

O que é a legislação Deepfake?

A legislação Deepfake já não é abstrata, ou o que dizemos “só existe em teoria”. Trata-se de uma necessidade legal inegociável que mesmo as empresas bem estabelecidas são pressionadas a adotar.

Mas o que é exatamente este conjunto de regras que obriga a escolhas difíceis? Nada de confuso, apenas um mapa de que precisa para se manter na vanguarda nesta era da IA.

Como cada pixel contém uma verdade oculta (ou um mentira), os governos mundiais estão a correr para impedir que a manipulação da IA afunde as empresas. Por exemplo, o Lei da IA da UE obriga agora as empresas a rotularem os conteúdos de IA ou arriscam-se a pagar milhões em multas.

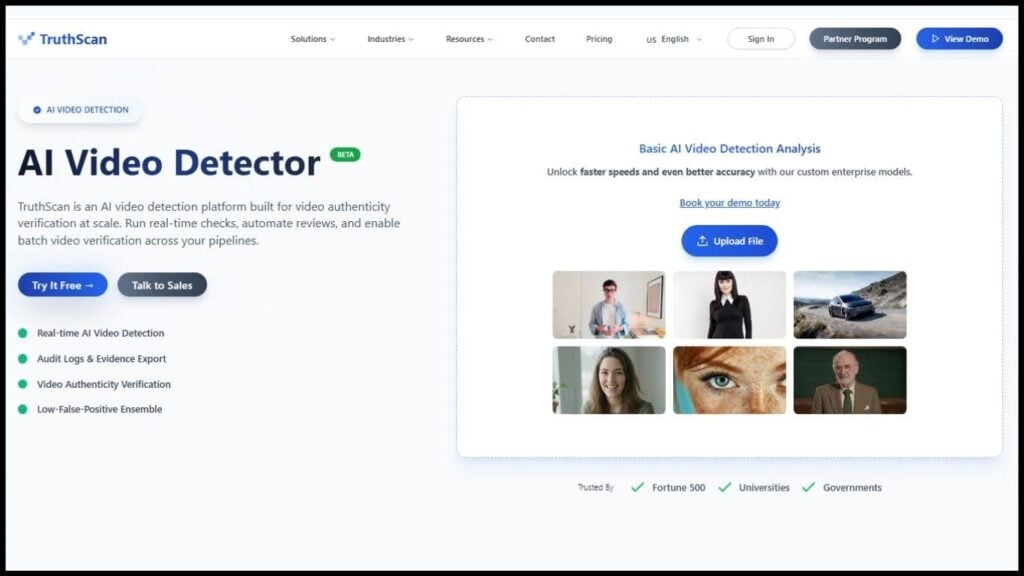

Nunca mais se preocupe com fraudes de IA. TruthScan Pode ajudar-vos:

- Detetar a IA gerada imagens, texto, voz e vídeo.

- Evitar grandes fraudes impulsionadas pela IA.

- Proteja os seus mais sensível activos da empresa.

Porque os humanos precisam de saber quando é uma IA que está a falar e não uma pessoa real.

Como é que o Deepfake afecta as empresas

E-mails de phishing e violações de rede? Notícia velha!

A ameaça agora soa e parece-se com o seu CEO (e com a legislação de deepfake de IA, as empresas não se podem dar ao luxo de a ignorar). Um simples “sim” pode custar milhões. Isso prova que a confiança é o investimento mais selvagem - pode ser tanto tesouro e armadilha.

Mas, e se as mentiras mostrarem as mãos primeiro? Sim, as mentiras do deepfake encontraram o seu adversário: A deteção por IA.

As organizações estão agora a implementar Detectores de IA através dos canais de comunicação interna porque temem o “CEO” que nunca telefonou.

E, honestamente, esperar por uma violação não passa de uma aposta de vários milhões de dólares.

É mais uma vulnerabilidade, porque os vídeos deepfake hoje em dia ultrapassaram a nossa capacidade natural de detetar uma falsificação.

A triste realidade é que já não há diferença entre um BOSS e um pixel ghost, a não ser que se utilize um detetor de vídeo com IA credível que se recusa a deixar um fantoche gerir a sua folha de pagamentos.

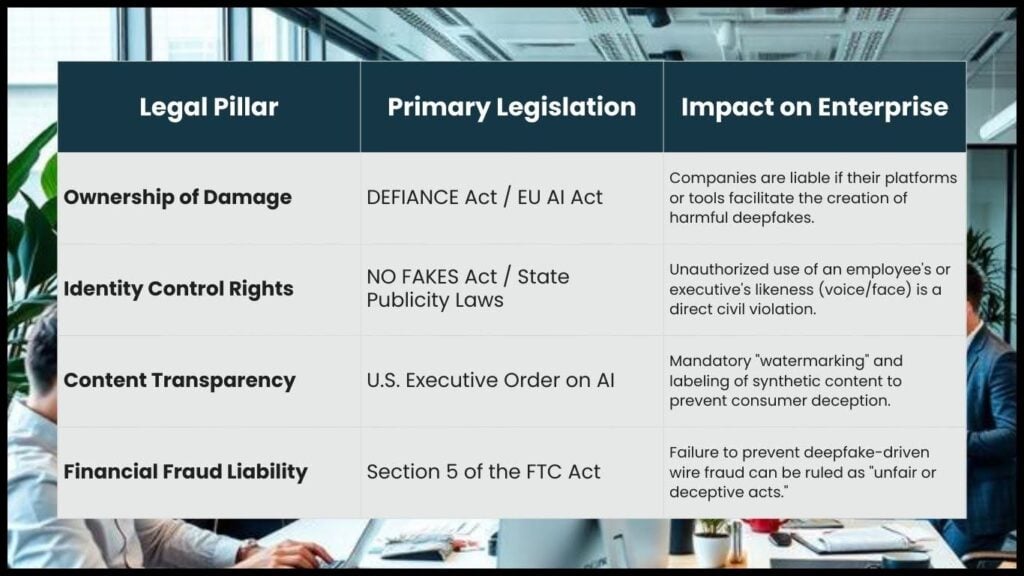

Riscos jurídicos para as empresas

“Eu não sabia” não é uma defesa legal válida em 2026 (graças ao novo legislação "deepfake).

Se a sua empresa tratar as leis da IA como “sugestões”, uma ação judicial é apenas uma questão de tempo (um facto divertido: é apenas uma forma de tornar os seus advogados muito, muito ricos).

Agora, para proteger o seu C-suite de um erro de $25 milhões e para não entrar na sala de audiências, É essencial fazer de “Verificar” a nova palavra favorita da sua empresa.

Porque, na realidade, “Verificar” é o único controlo interno que protege uma marca.

Garante que os seus activos não se tornam o ROI de outra pessoa, quebrando o ciclo de engano.

‘Verificar’ não é uma frase de efeito, é uma ordem!

Já lá vai o tempo em que as promessas vagas e os pedidos de informação educados eram eficazes. Atualmente, tudo se resume a recibos legais claros e a uma política de tolerância zero para erros.

O Ordem Executiva dos EUA sobre IA, A legislação sobre o deepfake da IA não exige apenas boa vontade; exige também um rasto frio e duro de documentos - e a legislação sobre o deepfake da IA está apenas a reforçar essa responsabilidade.

Assim, quando se contrata a IA e se faz dela a pedra angular da sua estratégia, o objetivo deve ser garantir que seja uma estratégia ética.

Porque quando o seu agente autónomo de IA infringe a lei, os tribunais não vão culpar o bug, vão culpar quem o implementou - o que significa que a sua empresa será legalmente responsabilizada. E isso nunca acaba bem.

Nova era - a legislação reatribui responsabilidades

“O erro humano pode acontecer e a vítima de um deepfake não deve ser processada”.”

Estas são as palavras da nova lei, tal como salientado nas recentes notícias sobre a legislação "deepfake", que está agora a colocar a tónica no engano e não nos enganados.

Parece que é a infraestrutura que está a sofrer as consequências.

Por isso, se a sua empresa ainda está indefesa, é altura de tomar as medidas de precaução corretas, porque confrontar um juiz que não acredita em “oops” vai ser definitivamente duro.

Três áreas críticas de exposição legal:

As empresas estão agora expostas a três linhas de defesa jurídica fundamentais.

1- Propriedade do dano

O Ato de rebeldia e a legislação emergente sobre deepfake responsabiliza claramente as empresas pelo impacto a jusante da sua tecnologia. Se, por exemplo, a sua plataforma permitir a criação de um deepfake prejudicial, a responsabilidade recairá sobre si.

2- Direitos de controlo da identidade

Muitos Estados dos EUA estão a redefinir a quem pertence a imagem de uma pessoa. A identidade é, sem dúvida, um ativo legalmente protegido, mas nesta era da IA e dos meios sintéticos, a utilização indevida já não é uma área cinzenta, é uma violação legal direta.

Assim, se uma empresa não respeitar os direitos de identidade, a responsabilidade recairá sobre ela com toda a força.

3-Proteção jurídica de palavras e obras

Se alguém violar os direitos de marca registada e utilizar material protegido por direitos de autor sem direitos de licenciamento, considere a possibilidade de aplicar sanções civis onde mais lhe dói - os seus lucros.

Desafios e requisitos de conformidade

Há uma linha ténue entre o que é real e o que apenas parece real.

A conformidade existe para evitar que essa linha desapareça - especialmente com as notícias sobre legislação "deepfake", que realçam a rapidez com que a IA pode contornar as regras.

Mas, quando essa linha se esbate, a fraude tem um rosto amigável. Para se manter na vanguarda, proteger os activos e apanhar mentiras subtis, a vigilância deve ser o seu padrão.

Mas, em primeiro lugar, porque é que a conformidade nos vê cair? Porque a IA consegue fazer com que as mentiras sejam tão suaves que parecem mais reais do que a própria verdade.

Desafio 1: Falso “Olá”.”

Não somos enganados apenas por sistemas avançados de IA e código; somos enganados por maneiras.

É bastante claro que as mentiras da IA vêm vestidas com o sorriso que se reconhece, por isso os empregados normalmente deixam o reconhecimento sobrepor-se à razão.

Desde uma saudação amigável num e-mail até um memorando que parece uma nota normal de um dia de trabalho, ninguém pode culpar os funcionários por baixarem a guarda.

Porque a IA tem a capacidade de transformar um “Olá” amigável num assalto de alta tecnologia sem nunca levantar suspeitas.

Desafio 2: Atraso regulamentar (velhas leis, nova guerra)

A IA evolui mais rapidamente do que as regras destinadas a controlá-lo.

As leis existentes verificam certamente as identificações e os logins de forma eficiente, mas padrões persuasivos? Falta de intuição digital e de tração.

As estruturas de conformidade e até mesmo a legislação de deepfake não conseguem acompanhar a velocidade do engano, o que representa um enorme risco para as organizações em todo o mundo.

Uma vez que as empresas são responsabilizadas pelos riscos, o direito fica aquém da evolução da IA.

Desafio 3: Julgamento humano sobrecarregado

Por muito treinadas que sejam, as pessoas não conseguem manter a perfeição 24 horas por dia, 7 dias por semana, num cérebro das 9 às 5.

É certo que os funcionários examinam os e-mails, mas se o volume aumenta, o esgotamento deixa crescer os pequenos erros.

Assim, se as empresas continuarem a confiar na vigilância humana, até mesmo uma mensagem de correio eletrónico negligenciada tornar-se-á uma porta de entrada para algo mortal, como por exemplo:

- Ruína da reputação

- Dor de cabeça jurídica

- Responsabilidade civil enorme

Requisito 1: Protocolo de segurança em camadas

A validação humana e automatizada deve passar por todo o espetro de salvaguardas.

A validação normal inclui normalmente verificações simples de formulários e referências cruzadas básicas, razão pela qual subsistem lacunas que podem comprometer a segurança.

Por outro lado, a segurança avançada em camadas exige inspecções em várias etapas para cada ação.

Por exemplo, quando é efectuada uma transferência bancária importante, cada passo desencadeia uma verificação biométrica, automatizada e humana antes de ser concluído.

Desta forma, nada passa despercebido.

Requisito 2: Vigilância cognitiva

Quem disse que só os olhos humanos apanham sinais falsos? A melhor forma de detetar rostos sintéticos é deixar que uma IA mais apurada analise cada sinal.

É aqui que o TruthScan's Detetor de IA em tempo real é o derradeiro guardião da conformidade contra todas as fraudes da IA.

Como a verdadeira conformidade não é episódica, o detetor de IA em tempo real do TruthScan funciona 24 horas por dia, 7 dias por semana, garantindo que a fraude nunca se instale.

Analisa e-mails, documentos e plataformas de conversação para expor truques sintéticos e desmascarar identidades falsas instantaneamente.

Requisito 3: Observador comportamental

O questionamento deve ser a norma.

Quando a dúvida se torna um hábito protetor, as empresas ficam dois passos à frente do engano.

Por exemplo, sempre que um executivo de alto nível envia um pedido de transferência de fundos urgente e fora do normal, um momento de dúvida pode poupar milhões.

Melhores práticas para a preparação das empresas

A preparação é tudo - especialmente com a legislação "deepfake" a tornar a responsabilização inevitável.

A melhor defesa é uma equipa preparada para estar sempre alerta. Numa era de rápida transformação digital e constantes ameaças cibernéticas, só os vigilantes protegem os activos e neutralizam as ameaças.

A defesa deve ser inultrapassável. Em 2024, o custo da complacência atingiu níveis recorde. O $4.88 Milhões A perda mostra o custo real da negligência digital.

Por isso, estar “preparado” deve significar não ter nenhum elo fraco à vista, todas as pessoas treinadas e todos os sistemas testados para evitar falhas.

1- Auditorias regulares e avaliações de risco

Se é inexplorado, é desprotegido.

As empresas precisam de identificar os riscos e colmatar todas as lacunas antes que se tornem notícia. Os sectores de alto risco, como o financeiro e o da saúde, exigem auditorias pelo menos trimestrais, porque o risco não pára.

Depois, essas auditorias ajudarão a identificar todas as vulnerabilidades ocultas.

Sempre que as suas defesas forem insuficientes, quantifique a sua distância em relação às normas ISO e NIST.

Não se limite à auditoria, concentre-se no padrão e estude as tendências que mostram exatamente onde o seu sistema é mais frágil.

Executar “Exercícios de mesa”, onde a liderança simula multas regulamentares e o escrutínio público.

2- Desenvolver um plano de resposta a crises

Um plano que não é posto em prática é apenas papel.

Um verdadeiro Plano de Resposta a Crises (PRC) é um roteiro que transforma a incerteza em acções coordenadas. É como uma defesa passo-a-passo contra as perturbações.

É necessário definir quem faz o quê e quando surge o primeiro sinal de problema.

Definir claramente a estrutura da Equipa de Gestão de Crises (EGC).

Crie modelos prontos a utilizar para cada cenário de comunicação. Por exemplo, A resposta da Airbnb durante a crise de viagens provocada pela COVID-19 transformou um impasse global num avanço estratégico.

Utilizando ‘Newsrooms’ pré-estabelecidas e centros de recursos, asseguraram que cada mensagem fosse oportuna e autêntica. Isto manteve as partes interessadas calmas, mesmo quando o mundo mudou.

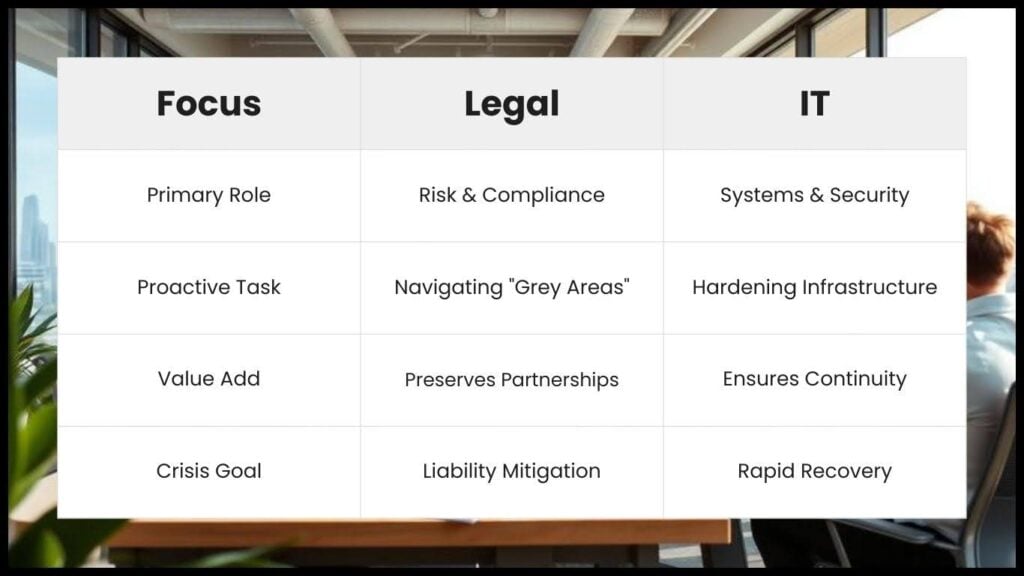

3- Colaborar proactivamente com as equipas jurídicas e informáticas

O isolamento dos serviços só prejudica a sua empresa.

Os departamentos jurídico e de TI são inseparáveis. Numa crise, estes dois departamentos devem agir como um só, totalmente alinhados para fazer face aos riscos assinalados pela legislação "deepfake".

O jurídico como cérebro da empresa

As equipas jurídicas devem ser integradas em todas as decisões, para que a sua empresa nunca aprenda da forma mais difícil.

Os especialistas em direito mostram à sua liderança onde cada área jurídica cinzenta pode custar as relações com clientes e parceiros.

TI como espinha dorsal

As TI são mais do que apenas “apoio técnico”, são os guardiões da continuidade operacional. Quanto mais digitalizarem, menos a fraude consegue entrar.

A colaboração proactiva faz da conformidade e da eficiência parceiros, o que significa que nenhum ataque digital perturba as operações.

É melhor prevenir do que....Curar

O tempo confirma o ditado.

O custo da prevenção de uma crise é uma fração do que é necessário para limpar o seu rescaldo. O preço da recuperação é sempre muito mais elevado e superior ao que qualquer orçamento pode suportar.

1- Defesa ativa

As vulnerabilidades precisam de ser resolvidas antes que os danos aumentem. Quer se trate da cadeia de abastecimento, da cibersegurança ou da integridade dos dados, a estratégia mais inteligente é corrigir antes de falhar.

2- Financiamento e afetação de forças

As organizações com visão de futuro dão prioridade à proteção em vez de pagarem mais para resolver crises que a preparação poderia impedir.

Por exemplo, a Maersk, o gigante mundial do sector dos transportes marítimos, sofreu um $Perda de 300 milhões em 2017 devido a uma única violação do sistema.

Mais tarde, a empresa gastou milhões para reinstalar milhares de máquinas, incluindo 4.000 servidores e 45.000 PCs, em apenas dez dias, para evitar que a sua cadeia de fornecimento se afundasse no caos.

Considerações finais

A preparação das empresas é a única forma de se manterem dois passos à frente do próximo logro alimentado por IA.

À medida que a tecnologia deepfake esbate o que é real e o que é falso, só os preparados sobrevivem. Aderir à legislação sobre deepfake, como o AI Act da UE ou a Ordem Executiva dos EUA sobre IA, não é apenas uma formalidade, é a sua defesa contra a manipulação.

A integração de ferramentas de deteção de IA em tempo real, detectores de vídeo, e a formação contínua dos empregados, transforma a prudência no seu derradeiro escudo contra o engano.