Nos anos 90, era o ADN.

Na década de 2000, eram os pings das torres de telemóveis.

Mas em 2026, o novo padrão de ouro das provas é a impressão digital.

Pense nisso desta forma...

Cada ficheiro de vídeo tem uma assinatura única.

Se um único pixel for alterado pela IA, a impressão digital muda instantaneamente.

Se a sua prova de IA não tiver um registo de data e hora verificado na cadeia de blocos para fixar essa impressão digital, mais vale ser uma banda desenhada aos olhos de um juiz moderno.

Isto significa que a era do “ver para crer” acabou.

Entrámos na era da verificação por vídeo com IA, em que a prova não se encontra no que se vê, mas no código digital escondido sob a superfície.

Neste blogue, vamos explorar porque é que as provas tradicionais estão a falhar contra a fraude de vídeo, como detetar clips manipulados, porque é que a verificação é fundamental para a admissibilidade e porque é que um detetor de vídeo com IA como o TruthScan é agora essencial para as equipas jurídicas.

Vamos mergulhar no assunto.

Principais conclusões

- Em 2026, todas as provas de vídeo devem ser submetidas a verificação de vídeo por IA para serem consideradas fiáveis.

- A fraude em vídeo inclui pequenas edições, como a manipulação do carimbo de data/hora, e não apenas a troca total de rostos.

- Um detetor profissional de deepfake é a única forma de detetar artefactos GAN que os humanos não detectam.

- Novas regras, como a Regra Federal 707, estão a normalizar a forma como as provas de IA são admitidas em tribunal.

- A análise automatizada de provas permite que as empresas processem pacotes de descoberta maciços com rapidez e precisão.

- O TruthScan evita fraudes durante audiências ao vivo, detectando máscaras sintéticas em tempo real.

O que é a prova de vídeo em litígios jurídicos?

As provas de vídeo são basicamente qualquer clip gravado utilizado em tribunal para provar o que aconteceu. Desde casos criminais a acordos de seguros, está em todo o lado.

No entanto, em 2026, o aumento da fraude de vídeo tornou o “ver para crer” uma suposição perigosa. Os profissionais do sector jurídico necessitam agora de uma verificação de vídeo com IA robusta para garantir a integridade do sistema judicial.

Tipos de provas de vídeo que os tribunais utilizam todos os dias

Nunca mais se preocupe com fraudes de IA. TruthScan Pode ajudar-vos:

- Detetar a IA gerada imagens, texto, voz e vídeo.

- Evitar grandes fraudes impulsionadas pela IA.

- Proteja os seus mais sensível activos da empresa.

- Vigilância (CCTV): Câmaras de lojas ou semáforos. Esta é a prova mais comum nos processos penais.

- Câmaras de vigilância: Filmagens de agentes da polícia, utilizadas sobretudo em casos de direitos civis ou de uso excessivo da força.

- Dashcams: A prova de referência para acidentes de viação e lutas de seguros.

- Testemunhos gravados: Depoimentos em vídeo ou depoimentos de testemunhas à distância que se tornaram normais desde a pandemia. São agora uma norma, mas estão sujeitos a desafios de deteção de fraudes jurídicas.

- Smartphone e redes sociais: Vídeos de transeuntes ou mensagens que comprovem o comportamento ou a localização de alguém.

- Segurança da empresa: Filmagens utilizadas por empresas em casos de fraude ou de “despedimento ilícito”.

A IA generativa e a tecnologia deepfake acrescentaram uma nova camada de risco. Em 2025:

- 1 em cada 20 verificações de identidade foram enganadas por deepfakes de IA

- Um inquérito da Medius indicou que 43% de profissionais foram vítimas de uma tentativa de fraude deepfake

Casos reais de fraude com provas de vídeo

- Clips de tribunal manipulados

Os clipes manipulados em tribunal referem-se a qualquer prova de vídeo ou áudio apresentada num processo judicial que tenha sido alterada, editada ou completamente fabricada com recurso à tecnologia.

Exemplos:

- Caso deepfake do condado de Alameda (2025): Um processo civil na Califórnia foi arquivado depois de o tribunal ter descoberto que um vídeo de uma testemunha apresentado como prova tinha sido totalmente criado com recurso à IA.

- A defesa do deepfake Sz Huang contra Tesla (2023): Numa ação judicial por homicídio culposo, os advogados da Tesla alegaram que as principais imagens do acidente poderiam ser uma falsificação profunda.

Vídeos de vigilância alterados

O vídeo de vigilância é um dos tipos mais comuns de provas de IA utilizadas em tribunal. No entanto, muitas pessoas pensam erradamente que a manipulação se limita a deepfakes completos.

Na realidade, a fraude de vídeo ocorre frequentemente de formas mais pequenas e menos óbvias que podem comprometer um caso.

Os tipos comuns de manipulação incluem:

- Alterações de carimbo de data/hora

- Remoção do quadro

- Alterações de metadados ou GPS

- Substituição do rosto

- Remoção ou inserção de objectos

- Filmagem em loop

- Degradação da qualidade

Os vídeos de vigilância provêm frequentemente de muitos locais diferentes, como lojas privadas, campainhas de casa, parques de estacionamento e câmaras municipais. Ao contrário das filmagens das câmaras da polícia, estes sistemas normalmente não seguem regras rigorosas de cadeia de custódia.

Isso significa que:

- Pode não haver um registo claro de quem tratou o processo.

- As filmagens podem ser copiadas, transferidas ou convertidas várias vezes.

- Os procedimentos de autenticação podem ser fracos ou incoerentes.

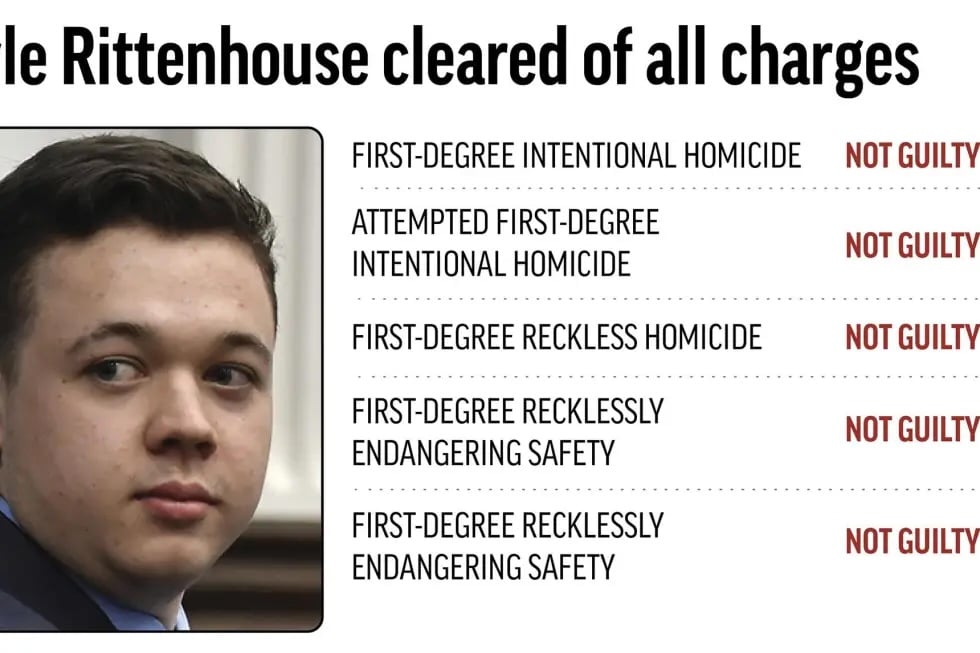

Exemplo: A questão do reforço do IA no caso Wisconsin v. Rittenhouse

Um exemplo famoso foi o do julgamento Wisconsin v. Rittenhouse. A acusação tentou utilizar a funcionalidade "pinch-to-zoom" de um iPad para mostrar pormenores num vídeo de um drone.

A defesa argumentou que o zoom da Apple utiliza interpolação de IA para adivinhar o que deveria estar lá. O juiz decidiu que, sem um detetor de vídeo com IA profissional, as imagens melhoradas não podiam ser admitidas.

Testemunhos vídeo contestados

Um testemunho de vídeo contestado requer normalmente a deteção de fraude legal para determinar se uma gravação é verdadeira:

- Um depoimento ou declaração totalmente forjado

- Um testemunho real contestado como falso

- Uma gravação real manipulada

Cada cenário cria um sério ónus de autenticação para o tribunal.

Exemplo: O processo de custódia de crianças no Reino Unido

Num litígio no tribunal de família do Reino Unido, citado pela University of Baltimore Law Review, uma mãe apresentou uma gravação fortemente alterada para retratar o pai como violento durante uma batalha pela custódia.

O objetivo era restringir o seu acesso aos filhos.

Aumento do vídeo gerado por IA em questões jurídicas

O caminho para a atual era do detetor de deepfake surgiu em fases distintas:

- Os primeiros anos de alerta (2017-2021)

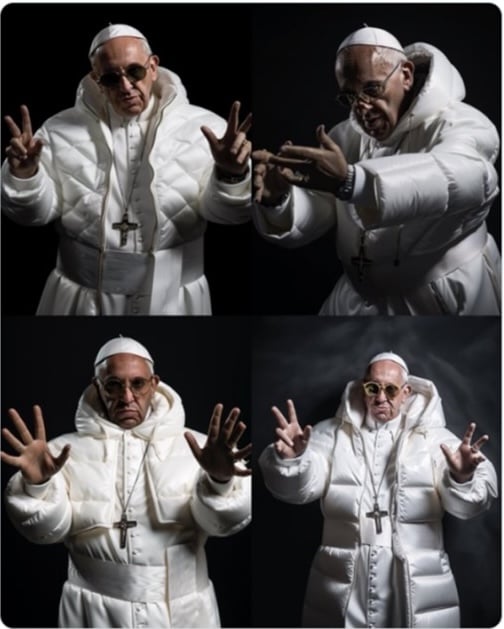

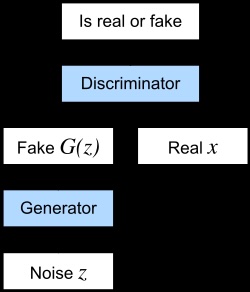

A tecnologia Deepfake (alimentada por redes adversárias generativas (GAN)) entrou na mira do público por volta de 2017.

Os primeiros deepfakes eram frequentemente de baixa qualidade: rostos com distorções estranhas, dedos extra, iluminação inadequada e caraterísticas desfocadas que os tornavam fáceis de detetar.

- A fase de escalada (2022-2023)

Em 2022, a tecnologia melhorou. Muitos eram gratuitos e utilizáveis num smartphone.

Em 2023, começámos a ver alguns dos primeiros desafios significativos relacionados com o deepfake em processos judiciais, incluindo Sz Huang v. Tesla, Estados Unidos v. Reffitt e Estados Unidos v. Doolin, onde o advogado levantou questões sobre se as provas de vídeo poderiam ser geradas por IA.

Na mesma altura, o Advisory Committee on Evidence Rules da American Bar Association começou formalmente a estudar a questão.

- O limiar crítico (2024-2025)

Os conteúdos gerados por IA não permaneceram académicos durante muito tempo. Em 2024, um incidente na empresa de engenharia Arup, envolvendo uma videochamada falsa gerada por IA que autorizava chamadas de vídeo fraudulentas transferências electrónicas num total de $25 milhões.

O sistema jurídico começou a reagir.

Em 2025, Louisiana aprovou a HB 178, criando o primeiro quadro de verificação de provas de IA a nível estatal.

A nível federal, o Comité Consultivo dos EUA sobre as Regras de Prova propôs Regra 707, centrada nas provas geradas por máquinas.

A situação em 2026

A partir do início de 2026, a regulamentação do deepfake e do vídeo com IA acelerou a nível nacional:

- 46 estados aprovaram alguma forma de legislação sobre deepfake.

- Desde 2022, Só em 2025 foram promulgadas 169 leis e apresentados 146 projectos de lei.

- A Regra Federal 707 está aberta a comentários do público até 16 de fevereiro de 2026.

Melhorar a verificação de vídeo com IA

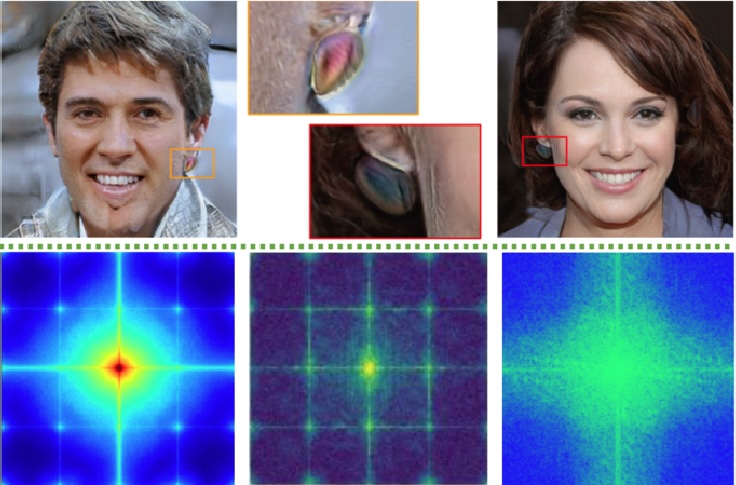

A forma mais eficaz de detetar vídeos gerados por IA é utilizar a própria IA.

Isto deve-se ao facto de as deepfakes serem criadas por sistemas de aprendizagem automática que deixam para trás padrões digitais subtis.

Esses padrões são demasiado pequenos ou complexos para serem detectados pelo olho humano. Mas podem ser detectados por outros algoritmos.

Um sistema fiável de verificação de vídeo com IA pode analisar várias camadas de um vídeo ao mesmo tempo, incluindo:

- Análise a nível do quadro verifica em cada fotograma a existência de erros visuais, como texturas estranhas, incompatibilidades de iluminação ou problemas de mistura em torno de rostos.

- Análise da coerência temporal analisa o movimento entre fotogramas para encontrar saltos não naturais ou movimentos inconsistentes.

- Seguimento de marcos faciais monitoriza o movimento dos olhos, o pestanejar e a forma facial para detetar alterações não naturais.

- Teste de sincronização audiovisual verifica se os movimentos dos lábios correspondem exatamente às palavras faladas.

- Análise forense de áudio analisa a voz para detetar sinais de clonagem, tais como padrões de som invulgares ou tons robóticos.

- Análise de metadados e compressão Examinar os dados do ficheiro oculto é vital para a deteção de fraudes legais, para verificar se correspondem aos detalhes do registo original.

Educar as equipas jurídicas sobre a fraude de vídeo

Uma vez que a IA pode agora imitar o comportamento humano com uma precisão assustadora, os escritórios de advogados estão a utilizar a análise automatizada de provas e uma mistura de tácticas tradicionais para se manterem à frente.

| Categoria | Método | Descrição |

| Formas oficiais | Créditos CLE (Formação Jurídica Contínua) | Cursos obrigatórios ou electivos que ensinem os advogados a autenticar provas digitais, a compreender os deepfakes e a cumprir as normas probatórias. |

| Peritos em IA nomeados pelo tribunal | Estabelecer especialistas forenses certificados em IA, semelhantes aos peritos em ADN, para avaliar em tribunal as provas de vídeo contestadas. | |

| Formas não oficiais | Equipa vermelha interna | Contratação de profissionais de cibersegurança para testar se provas falsas ou manipuladas podem passar pelos sistemas de admissão da empresa. |

| “Protocolo ”Vibe Check | Treinar o pessoal para detetar sinais de aviso comuns de deepfake, como pestanejar não natural, caraterísticas distorcidas ou problemas de sincronização labial, antes de os encaminhar para análise forense. |

Ferramentas e tecnologias para a validação de provas

Em 2026, ultrapassámos a simples inspeção visual.

Como a IA é agora capaz de enganar até os investigadores mais experientes, as equipas jurídicas utilizam um conjunto específico de ferramentas para verificar se o que estão a ver é a verdade absoluta.

A tecnologia por detrás da validação de provas

- Detectores de Deepfake: Estes são programas de software especializados que procuram artefactos GAN. Estes são padrões matemáticos microscópicos ou ruídos deixados pelos modelos de IA que geram rostos sintéticos. Enquanto um humano vê um rosto, o detetor vê uma assinatura digital que não pertence.

- TruthScan é um detetor de deepfake que analisa os vídeos fotograma a fotograma em busca de sinais de IA, como pestanejar invulgar, formas faciais estranhas ou erros de píxeis onde é adicionado um rosto falso.

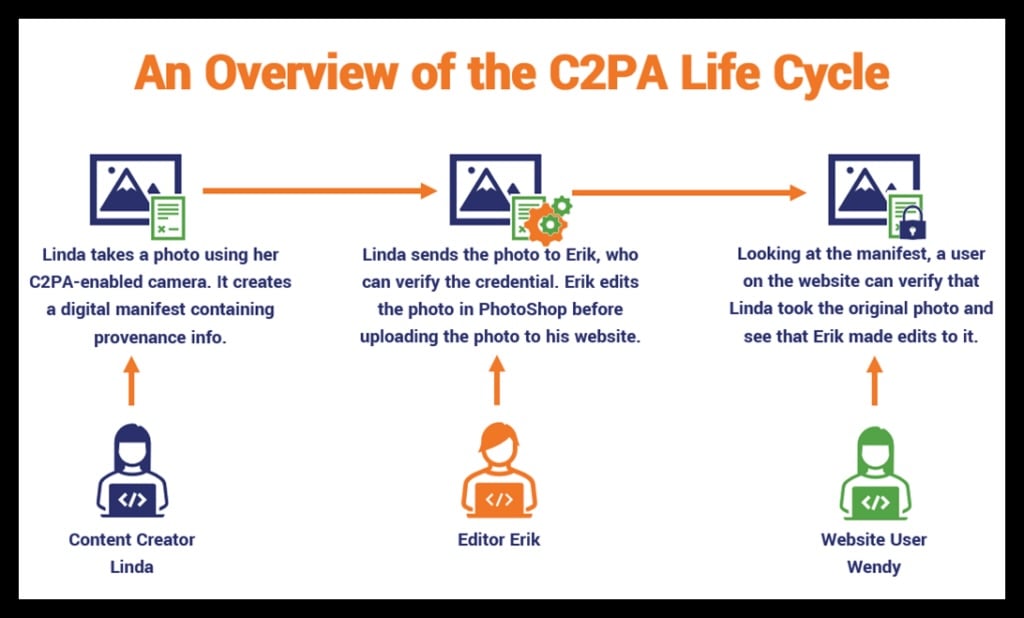

- Carimbos temporais da cadeia de blocos: Para provar que um vídeo não foi tocado desde o momento em que foi gravado, muitas agências utilizam atualmente a norma C2PA. Quando um vídeo é gravado num dispositivo compatível, é criada uma impressão digital única (hash) que é armazenada numa cadeia de blocos.

- O TruthScan pode verificar se esta impressão digital corresponde ao vídeo, mostrando se o ficheiro foi editado ou se a cadeia de custódia foi quebrada.

- Ferramentas forenses de metadados: Todos os ficheiros digitais têm uma certidão de nascimento conhecida como dados Exif. Estas ferramentas verificam se um ficheiro foi guardado novamente num software de edição de IA ou se os dados de localização (GPS) foram falsificados. Se um vídeo afirma ser de uma câmara de loja, mas os metadados mostram que foi exportado de um editor de vídeo, temos um problema.

- O Amped Software e o TruthScan examinam dados de ficheiros ocultos (Exif, cabeçalhos) para ver se o vídeo foi editado ou processado por IA.

Tendências em provas de vídeo com IA

Eis as três tendências de 2026.

- Análise forense adversarial generativa: IA vs. IA

A forma mais avançada de apanhar um deepfake em 2026 é utilizar a mesma tecnologia que o criou. Isto é conhecido como Generative Adversarial Forensics.

- Uma IA (o gerador) tenta criar uma falsificação, enquanto outra IA (o discriminador) tenta apanhá-la. Na sala de audiências, ferramentas como o TruthScan podem ser o melhor discriminador.

- Exemplo: Um queixoso apresenta um vídeo de um diretor executivo a fazer um contrato verbal. O TruthScan analisa o vídeo utilizando os seus próprios modelos contraditórios para detetar artefactos GAN. Se o software assinalar uma probabilidade sintética 98%, a prova é provavelmente uma falsificação para enganar os olhos humanos.

- Análise de sincronização de áudio e vídeo (a regra dos 0,01 ms)

Os humanos conseguem normalmente detetar um atraso se o áudio de um vídeo estiver desfasado em cerca de 40-80 milissegundos. No entanto, os deepfakes de 2026 são muitas vezes quase perfeitos.

- As modernas ferramentas forenses de IA procuram agora um atraso de 0,01 milissegundos entre o som fonético de uma palavra e o movimento mecânico dos lábios.

- Exemplo: Num processo de assédio de 2026, um arguido alegou que um vídeo tinha sido forjado. A análise forense automatizada das provas mostrou que as formas dos lábios “M” e “B” estavam 0,02 ms dessincronizadas com o áudio. Este erro microscópico prova que a voz foi clonada e colocada sobre um vídeo diferente, o que levou a um arquivamento.

- Cheapfakes vs. Deepfakes

Enquanto as falsificações profundas utilizam IA de ponta, as falsificações baratas são a forma mais comum de fraude em vídeo.

- Um Deepfake cria uma realidade que nunca aconteceu (como uma troca de rosto). Um Cheapfake pega em imagens reais e altera o contexto ou a intenção utilizando ferramentas simples.

- Exemplo (O abrandamento): É possível criar um vídeo de um político que pareça estar embriagado ou deficiente simplesmente abrandando a filmagem em 20% e ajustando o tom do áudio.

- Exemplo (O Re-Contexto): As imagens de um protesto de 2022 noutro país são publicadas em 2026 como prova viva de um motim local. As equipas jurídicas utilizam agora a análise de metadados do TruthScan para provar a data de nascimento real do vídeo.

Como o TruthScan protege as provas de vídeo legais

O TruthScan garante que todos os fotogramas que apresenta em tribunal são autênticos, verificados e legalmente defensáveis.

A plataforma simplifica a verificação de vídeo com IA através das seguintes vantagens:

Registos de auditoria automatizados e documentação da cadeia de custódia

- Fiabilidade para o tribunal: Gera relatórios em PDF e JSON que documentam cada etapa de verificação com pontuações de confiança e carimbos de data e hora precisos.

- Conformidade de alto nível: Fique tranquilo sabendo que os seus dados permanecem seguros e cumprem normas globais rigorosas como SOC 2, ISO 27001 e GDPR.

- Controlo de dados flexível: Mantenha as evidências confidenciais dentro da jurisdição exigida com opções de implantação no local ou VPC projetadas para setores altamente regulamentados.

Processamento de lotes e integração de API para fluxos de trabalho jurídicos

- Grande poupança de tempo: Processe milhares de ficheiros de pacotes de descoberta ou conjuntos de vigilância simultaneamente utilizando importações de armazenamento em massa (S3/GCS).

- E-Discovery sem descontinuidades: Simplifique as suas operações integrando a verificação diretamente no seu software existente através de webhooks e APIs.

- Eliminar os erros manuais: Automatize a primeira passagem do rastreio de provas para que a sua equipa se possa concentrar na estratégia em vez da entediante verificação ficheiro a ficheiro.

Verificação em tempo real para depoimentos e audiências remotas

- Parar a imitação: Utilizar pontos finais de transmissão em direto para detetar se um depoente está a utilizar filtros deepfake ou clones de voz durante uma audição remota.

- Manter a integridade do tribunal: Assinalar anomalias visuais ou sonoras em tempo real, impedindo que testemunhos fraudulentos entrem no registo.

- Paz de espírito: Proporcione aos seus clientes e ao tribunal uma camada extra de segurança que garante que a pessoa no ecrã é exatamente quem diz ser.

Saiba mais sobre a proteção de provas de vídeo com IA

Proteja sua empresa contra os riscos da mídia manipulada. O detetor de deepfake do TruthScan e a tecnologia de detetor de vídeo com IA fornecem a solução definitiva para descoberta eletrônica e verificação legal.

Pronto para ver o TruthScan em ação?

- Visitar truthscan.com para obter 20.000 créditos gratuitos.

- Para questões empresariais, integração de API ou opções de implementação personalizadas, contacte a sua equipa em Truthscan.com/contacto.