Os seus agentes de apoio são formados para serem as pessoas mais prestáveis da sua empresa.

Eles são a linha da frente da reputação da sua marca, trabalhando arduamente para garantir que cada interação termina com um sorriso.

Mas sabe qual é a ironia mais perigosa de 2026?

Esta utilidade faz deles o seu maior risco de segurança.

Os seus agentes estão concentrados na satisfação do cliente.

Nem sempre se apercebem de um ligeiro tom robótico na voz de um interlocutor ou de uma pequena mancha na linha do maxilar de um cliente durante uma videochamada.

Isto dá à fraude contra o cliente a oportunidade perfeita para atacar.

Se o seu balcão de apoio não for apoiado por uma deteção automática de fraudes, pode já estar exposto.

Neste blogue, vamos abordar o que é a personificação de deepfake, as técnicas utilizadas pelos atacantes para contornar as suas defesas, os primeiros indicadores que podem alertar a sua equipa e como utilizar um detetor de IA em tempo real para proteger a sua empresa.

Vamos mergulhar.

Principais conclusões

- Os agentes de apoio são treinados para serem prestáveis, o que os torna os principais alvos de desvios à deteção de imitação de IA.

- Os autores de fraudes modernas utilizam um detetor de IA em tempo real para identificar clones de voz que sincronizam em menos de 50 milissegundos.

- A deteção automatizada de fraudes deve agora abranger gravações de ecrã manipuladas, recibos falsos e identificações geradas por IA.

- A prevenção eficaz de deepfake requer a análise simultânea de áudio, vídeo e imagens.

- A integração de um detetor de deepfake nos fluxos de trabalho de e-discovery e de suporte reduz as perdas financeiras resultantes do BEC (Business Email Compromise) até 80%.

O que são imitações de Deepfake?

A palavra “deepfake” vem de aprendizagem profunda (um tipo de IA) e falso.

Falsificação de identidade significa fingir ser outra pessoa, normalmente para ganhar confiança, roubar dinheiro ou aceder a informações privadas.

As imitações de deepfake acontecem quando a IA copia o rosto, a voz ou o comportamento de uma pessoa real para criar conteúdos falsos destinados a enganar os outros.

Nunca mais se preocupe com fraudes de IA. TruthScan Pode ajudar-vos:

- Detetar a IA gerada imagens, texto, voz e vídeo.

- Evitar grandes fraudes impulsionadas pela IA.

- Proteja os seus mais sensível activos da empresa.

Os deepfakes já não se limitam a simples trocas de rostos. Em 2026, estamos a ver deepfakes comportamentais que podem copiar:

- Padrões de discurso

- Tom e pausas

- Microexpressões faciais

- Até as nuances de personalidade

Isto faz com que seja muito mais difícil detetar a manipulação a olho nu.

Exemplo do mundo real: Personificação do Diretor-Geral da WPP (maio de 2024)

Os cibercriminosos utilizaram uma fotografia publicamente disponível do CEO da WPP, Mark Read, para criar uma conta falsa no WhatsApp.

Atraíram um executivo para uma reunião do Microsoft Teams, utilizando um detetor de IA em tempo real que desafiava o clone de voz para autorizar uma transferência bancária fraudulenta.

Felizmente, um funcionário atento suspeitou e comunicou o incidente, evitando perdas financeiras.

Porque é que o apoio ao cliente é vulnerável

O risco de fraude dos clientes começou a aumentar em 2023-24, quando as ferramentas de IA generativa se tornaram amplamente disponíveis.

Mas em 2025-26, a ameaça atingiu a escala industrial.

O que antes exigia conhecimentos técnicos pode agora ser feito com ferramentas simples e alguns minutos de áudio.

As equipas de apoio ao cliente não se tornaram descuidadas de repente. Ficaram expostas.

Os agentes de apoio são formados para ajudar as pessoas, não para as questionar, e é por isso que a prevenção de deepfake é tão difícil de gerir manualmente. Os atacantes confiam no instinto de confiança do agente e agem rapidamente.

A maioria dos centros de contacto ainda verifica a identidade através de perguntas simplesnúmeros de conta, datas de nascimento, últimos quatro dígitos de um BI. O problema é que essas informações já não são privadas.

As violações de dados e as redes sociais tornam fácil contornar as verificações tradicionais, tornando a deteção de falsificação de identidade por IA uma camada obrigatória de defesa.

Há também a pressão do volume. Muitos agentes lidam com 80 a 120 interações por dia. Quando as chamadas são sucessivas, não há tempo para analisar alterações subtis na voz.

É aqui que a deteção automática de fraudes se torna um salva-vidas. Sem um detetor de IA em tempo real a funcionar em segundo plano, os agentes são forçados a responder à urgência e à emoção.

Técnicas utilizadas pelos imitadores de Deepfake

- Clonagem de voz em chamadas

Em 2026, ferramentas como ElevenLabs, Speechify e Murf podem criar clones convincentes a partir de menos de 10 segundos de áudio.

Mais preocupante ainda, a conversão de voz em tempo real pode transformar a voz de um interlocutor na voz de outra pessoa em menos de 50 milissegundos.

Para a vítima, soa a vivo, natural e familiar.

Já raramente há uma pista robótica óbvia. Sem um software de proteção contra fraudes de apoio, os agentes não conseguem detetar os artefactos subtis, como tons metálicos ou padrões de respiração não naturais, que indicam fraude por parte do cliente.

Exemplo:

- Wiz (Final de 2024): Os atacantes clonaram a voz do diretor executivo Assaf Rappaport para solicitar credenciais. Embora esta tentativa tenha falhado devido a uma incompatibilidade de tom, salientou a necessidade urgente de deteção de imitação de IA nas comunicações empresariais.

- LastPass (Início de 2024): Um funcionário foi alvo de um deepfake de voz de CEO treinado em vídeos do YouTube. Este incidente provou que as pessoas de alto perfil estão em risco constante, exigindo uma deteção automática de fraudes para salvaguardar os canais de apoio internos.

- Vídeos de agentes com rosto trocado

Os deepfakes de troca de rosto utilizam modelos avançados de IA para substituir o rosto de uma pessoa por outro num vídeo em direto.

Em 2026, ferramentas como o DeepFaceLive e o Deep-Live-Cam poderão funcionar em tempo real com menos de 50 milissegundos de atraso.

Os autores das fraudes podem transmitir este vídeo alterado através de plataformas como o Zoom, o Microsoft Teams ou o Google Meet, utilizando ferramentas de câmara virtual como o OBS Studio. Para a pessoa que está a fazer a chamada, tudo parece normal.

Exemplo:

Caso do falso empregado KnowBe4 (julho de 2024): Um ator estatal norte-coreano utilizou a tecnologia de troca de rostos da IA para passar entrevistas em vídeo em direto com uma identidade americana roubada. Só foi apanhado depois de a segurança interna ter detectado uma atividade invulgar do dispositivo.

- Gravações de ecrã manipuladas

Os atacantes estão a utilizar cada vez mais a IA para fabricar ou alterar gravações de ecrã, fazendo com que pareça que ocorreu uma ação de reembolso, transação ou bilhete de suporte.

Estas gravações falsas podem manipular os agentes de apoio, anular disputas ou aumentar os estornos.

A IA pode agora alterar os carimbos de data/hora, os saldos das contas e os elementos dinâmicos da interface do utilizador de forma tão convincente que uma inspeção casual não o detectará.

Os autores de fraudes podem até injetar vídeos pré-gravados ou manipulados em chamadas de apoio ao vivo através de plugins de câmaras virtuais.

Indicadores precoces de ameaças Deepfake

Os deepfakes modernos são convincentes. A prevenção eficaz de deepfakes envolve a procura destes “sinais”:

Avisos ao nível do áudio:

- As vozes clonadas soam planas e não têm mudanças de tom naturais.

- O discurso da IA não tem frequentemente sons normais de respiração e de enchimento.

- A voz pode não corresponder ao ruído de fundo.

- A conversão de voz em tempo real pode causar pequenos atrasos (200-400ms) em perguntas repentinas.

- As vozes de gravações de discursos públicos podem soar demasiado formais para uma conversa casual.

Informações de nível de vídeo:

- O cabelo, as orelhas e os bordos do maxilar podem parecer ligeiramente desfocados.

- A intermitência ocorre em intervalos muito regulares.

- O olhar dos olhos pode não seguir a câmara naturalmente.

- A iluminação do rosto pode não corresponder à da sala.

- As microexpressões estão ausentes ou são muito suaves.

- As más desculpas de ligação podem esconder artefactos de vídeo causados pela compressão.

Indicações comportamentais / de nível de interação:

- Os operadores de deepfake evitam pedidos de verificação inesperados.

- Podem contactá-lo primeiro através de aplicações informais antes de utilizarem os canais oficiais.

- A urgência e o secretismo em conjunto são um sinal de alerta.

- Resistem a controlos fora da banda, como ligar para um número conhecido.

Tirar partido das ferramentas de deteção de IA

O TruthScan é uma plataforma poderosa concebida para a deteção automática de fraudes, na qual mais de 250 milhões de utilizadores confiam.

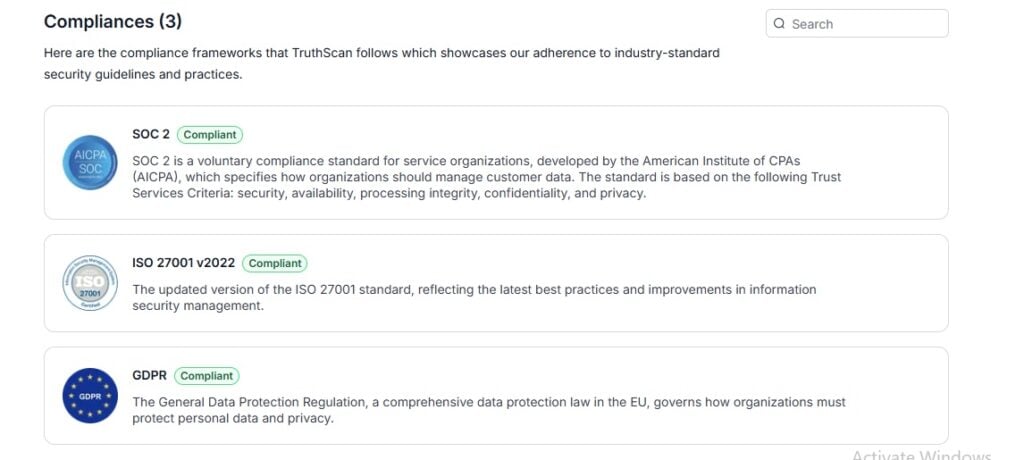

É totalmente certificado pela ISO 27001, SOC 2 e compatível com o RGPD, e funciona perfeitamente com ferramentas como Salesforce, Microsoft 365, Google Workspace, SAP e Zoom.

- Detetor de falsificação profunda

Este detetor de deepfake identifica vídeos gerados por IA, trocas de rostos e media manipulados em todos os principais formatos (MP4, AVI, MOV, MKV, WebM) até 4K.

Eis como funciona:

- Monitoriza os movimentos faciais, os padrões de pestanejo e as microexpressões.

- Detecta inconsistências ao nível dos píxeis, desfasamentos de iluminação e artefactos de fotograma para fotograma.

- Detecta modelos de geração baseados em GAN, como AnimateDiff, D-ID, HeyGen, Runway Gen-4, Stable Video Diffusion e muito mais.

Carregue um vídeo real conhecido e um deepfake (HeyGen/D-ID) no TruthScan's Detetor de falsificação profunda.

- Detetor de imagens AI

O detetor de imagens TruthScan AI bandeiras Imagens geradas ou manipuladas por IA de plataformas como Midjourney, DALL-E, Stable Diffusion, Canva AI, Grok Imagine, StyleGAN e ThisPersonDoesNotExist.

Eis como funciona:

- Sinaliza trocas de fundo, remoção de objectos e edições de iluminação.

- Gera pontuações de confiança e informações ao nível do pixel sem armazenar ficheiros.

Carregue imagens reais vs. imagens geradas por IA no TruthScan's Detetor de imagens AI para comparar os resultados de confiança.

Proteger os canais de suporte de forma eficaz

Em 2026, as equipas de apoio ao cliente estão sob a ameaça constante de fraudes baseadas em IA.

Os atacantes podem falsificar vozes, trocar rostos em vídeo em direto ou enviar ficheiros manipulados, tornando quase impossível aos agentes humanos distinguir o que é real do que não é.

É por isso que é essencial assegurar canais de apoio.

- Detetor de IA em tempo real

O Detetor de IA em tempo real foi concebido para detetar conteúdos gerados por IA antes de estes chegarem aos seus agentes ou clientes.

Ao contrário das ferramentas baseadas em ficheiros que analisam os carregamentos, esta plataforma monitoriza as interações ao vivo através de canais de correio eletrónico, chat, telefone e vídeo.

Como ajuda a sua equipa:

- Detecta tentativas de deteção de falsificação de identidade da IA em tempo real.

- Sinalizar mensagens ou chamadas geradas por IA que tentam enganar os agentes para que dêem acesso ou processem pedidos.

- Funciona com o Salesforce, Teams, Gmail, Zoom e muito mais para fornecer deteção automática de fraudes sem abrandar as operações.

- Lida com milhões de interações em todos os canais sem abrandar as operações.

- As certificações SOC 2, ISO 27001 e GDPR significam que todas as acções são auditáveis e estão prontas para serem julgadas.

Políticas e formação para as equipas

- Procedimentos operacionais normalizados

| Nome da apólice | Política |

| Verificação multi-fator | Exigir MFA para redefinições de conta, transacções de elevado valor e alterações de segurança. |

| Verificação de canais | Redirecionar todos os pedidos provenientes de canais informais (WhatsApp, Telegram, correio eletrónico pessoal) para os sistemas de apoio oficiais. |

| Registo de contactos | Os agentes devem registar os contactos invulgares, incluindo o canal, a hora e a natureza do pedido. |

| Sistema de palavras seguras | Utilize frases de verificação pré-registadas para contas de elevado valor. |

| Verificação fora de banda | Qualquer escalonamento interno ou pedido executivo deve ser verificado através de uma chamada de retorno para os números oficiais da lista telefónica. |

| Sem aprovação individual | Nunca autorize transacções ou alterações de segurança apenas com base em videochamadas ou mensagens de correio eletrónico. |

| Confirmação de voz | Exigir confirmação por voz para todas as transferências de fundos acima de um determinado limite. |

| Verificação dos meios de comunicação social | Analise todas as fotografias, vídeos e gravações de ecrã através dos detectores TruthScan antes da análise humana. |

| Verificações de metadados | Utilize um detetor de imagens AI para assinalar carimbos de data/hora ou EXIF inconsistentes. |

| Revisão secundária | Os pedidos de indemnização de elevado valor devem ser submetidos a uma análise secundária antes de serem processados. |

- Formação de sensibilização do pessoal para a fraude

Os funcionários precisam de experimentar deepfakes realistas. A investigação mostra que as taxas de deteção aumentam de 34% para 74% após cerca de uma dúzia de simulações em direto envolvendo um detetor de vídeo com IA.

Sinais de alerta a ter em conta:

- Urgência associada a secretismo

- Pedidos fora dos canais normais

- Resistência à chamada de retorno ou à verificação secundária

- Contornar processos normalizados

- Pressão emocional (medo, culpa, autoridade)

- Revisões de segurança de rotina

Em 2026, mesmo os melhores PONs exigem auditorias regulares através de protocolos automatizados de deteção de fraudes:

| Nome da apólice | Política |

| Avaliação trimestral da ameaça | Verifique se existem novas ferramentas de deepfake, valide os limiares de deteção e analise os incidentes de quase-acidente. |

| Auditoria de segurança do canal | Teste cada canal de suporte para detetar pontos fracos; os atacantes visam o caminho de menor resistência. |

| Validação da ferramenta de deteção | Passar periodicamente falsificações conhecidas pelo TruthScan para garantir que a precisão da deteção acompanha a evolução dos métodos de IA. |

| Exercícios de resposta a incidentes | Realizar exercícios de mesa simulando imitações de deepfake para testar notificações, bloqueios e velocidade de resposta. |

| Cheques de fornecedores e de terceiros | Verificar se as comunicações externas de parceiros ou clientes seguem as mesmas normas de autenticação forte que os canais internos. |

Como o TruthScan reforça a segurança do suporte ao cliente

O TruthScan foi criado para impedir fraudes de IA em todos os níveis do suporte ao cliente. Ele explica por que algo é suspeito, para que as equipes possam agir com confiança.

| Ferramenta | Objetivo e benefício |

| Detetor de voz AI | Detecta vozes clonadas em chamadas e gravações, protegendo as conversas em direto de imitações. |

| Detetor de falsificação profunda | Analisa vídeos e imagens para detetar trocas de rostos, personas sintéticas e meios de comunicação manipulados. |

| Detetor de imagens AI | Assinala fotografias de perfil geradas por IA, identificações falsas e capturas de ecrã manipuladas antes de ser tomada qualquer decisão. |

| Detetor de IA em tempo real | Monitoriza continuamente a conversação em direto, o correio eletrónico e o vídeo com alertas de deteção de fraude automatizados em segundos. |

| Detetor de recibos falsos | Detecta recibos gerados por IA ou documentos de prova utilizados em pedidos de indemnização fraudulentos. |

| Detetor de fraudes de correio eletrónico | Detecta tentativas de phishing geradas por IA e ataques BEC antes de chegarem à caixa de entrada. |

Como se adapta a uma pilha de segurança de apoio ao cliente:

- Meios de comunicação de entrada (fotografias, vídeos, gravações) → Detetor de deepfake + detetor de imagens de IA antes da revisão humana

- Chamadas de apoio em direto → Detetor de voz AI que analisa gravações de chamadas ou transmissões em direto

- Sessões de apoio em vídeo → Deepfake Detetor em tempo real ou após a chamada

- Correio eletrónico e canais de conversação → Detetor de IA em tempo real para monitorização contínua

- Apresentação de documentos (identificações, recibos, capturas de ecrã) → Detetor de recibos falsos + Detetor de imagens AI

Fale com o TruthScan sobre a proteção contra deepfake no suporte

Não espere até que seja tarde demais. O TruthScan ajuda sua equipe a detetar conteúdo de IA antes que ele chegue aos seus agentes.

Escolha como começar:

- Teste você mesmo: Experimente todas as ferramentas de deteção TruthScan com 20.000 créditos gratuitos. Não é necessário efetuar qualquer pagamento. → Inicie o seu teste gratuito em TruthScan.

- Demonstração da empresa: Deixe a nossa equipa mostrar-lhe uma implementação personalizada para Salesforce, Microsoft 365, Zoom e Google Workspace. → Marcar uma demonstração em TruthScan.

Proteja os seus canais de apoio hoje mesmo, porque ver já não é acreditar; verificar é.