Jak technologia deepfake wykrada miliardy z globalnych firm - i dlaczego każdy dyrektor jest teraz celem

Liczby nie kłamią

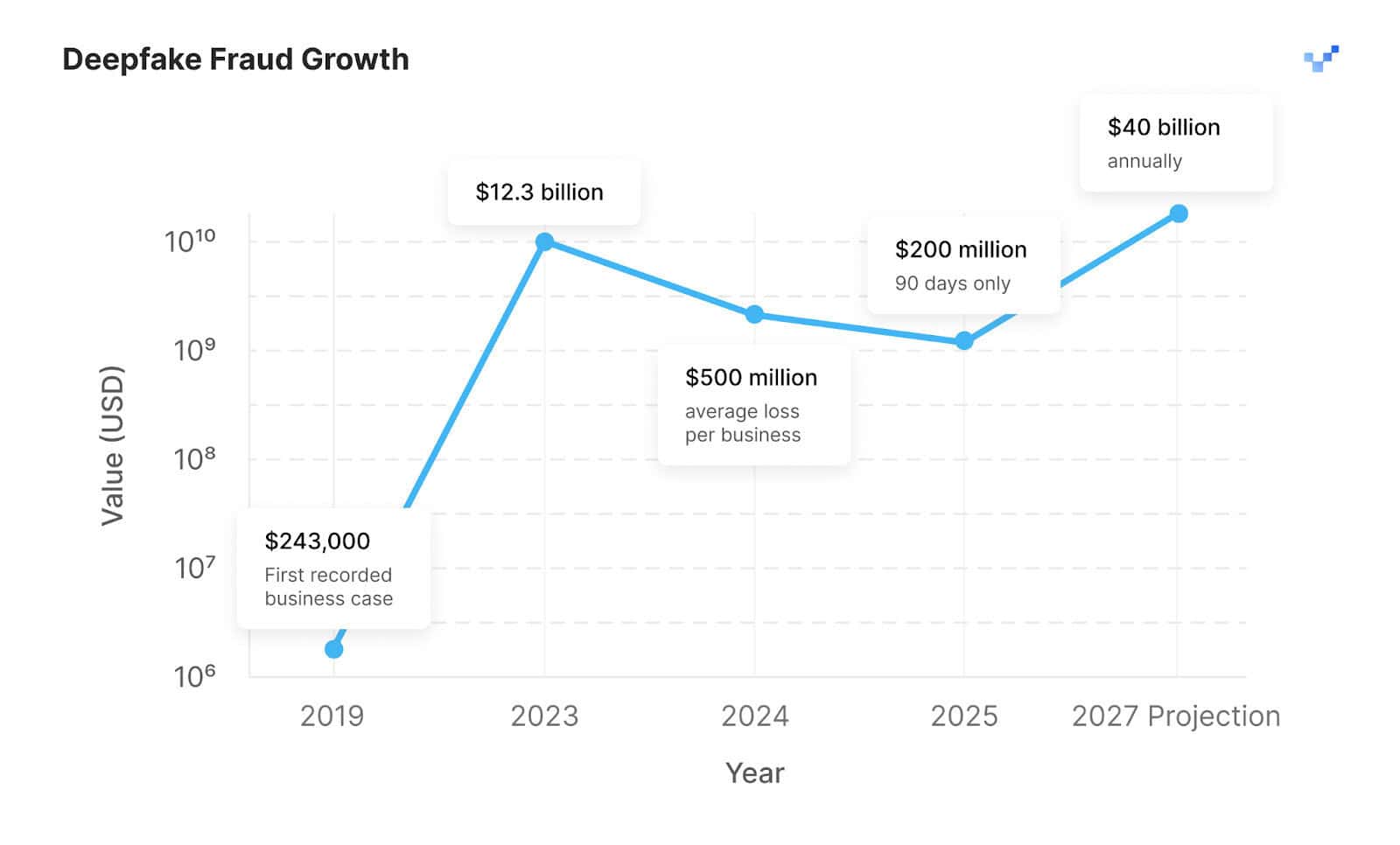

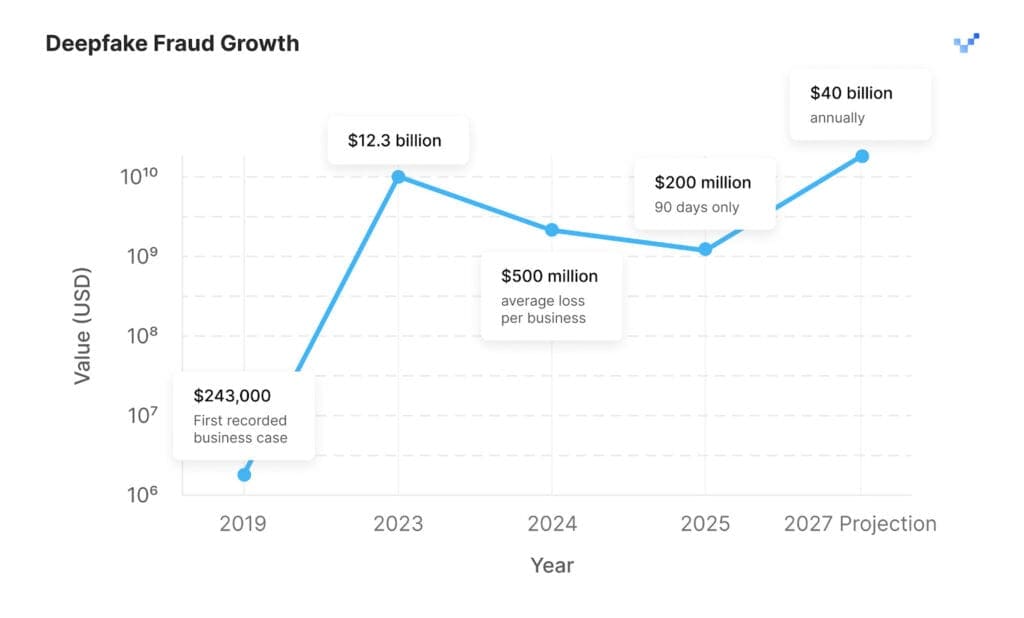

Oszustwa związane z Deepfake spowodowały ponad $200 milionów strat w pierwszym kwartale 2025 roku., zgodnie z najnowszym raportem Resemble AI dotyczącym incydentów. Ale to wierzchołek góry lodowej; eksperci ds. bezpieczeństwa ostrzegają, że może ona sięgnąć $40 mld rocznych strat w Stanach Zjednoczonych do 2027 r..

Matematyka cyfrowego oszustwa jest otrzeźwiająca:

Stanowi to Złożona roczna stopa wzrostu 32%-szybciej niż większość krzywych wdrażania technologii, a na pewno szybciej niż nasza zdolność do obrony przed nimi.

Nigdy więcej nie martw się o oszustwa związane ze sztuczną inteligencją. TruthScan Może ci pomóc:

- Wykrywanie wygenerowanych przez AI obrazy, tekst, głos i wideo.

- Unikać poważne oszustwa oparte na sztucznej inteligencji.

- Chroń swoje najbardziej wrażliwy aktywa przedsiębiorstwa.

Skala podatności na zagrożenia

Najnowsze badania Deloitte pokazują, że 25,9% członków kadry kierowniczej doświadczyło już incydentów deepfake, których celem były ich dane finansowe. w ciągu ostatnich 12 miesięcy. Bardziej niepokojące: 50% spodziewa się wzrostu liczby ataków w ciągu najbliższego roku.

Skutki regionalne są bardzo wyraźne:

- Ameryka Północna: 1,740% wzrost liczby przypadków oszustw typu deepfake w 2023 r.

- Średnia strata biznesowa: $500,000 za incydent

- Wpływ na duże przedsiębiorstwa: Do $680,000 za atak

Dlaczego eksplozja nastąpiła teraz?

Tworzenie deepfake'ów było kiedyś odizolowane od odległych zakątków głębokiej sieci, gdzie szemrani cyberprzestępcy wymieniali kryptowaluty na hasła.

Obecnie narzędzia sztucznej inteligencji są powszechnie dostępne dla każdego, a chatboty ogólnego przeznaczenia mogą być wykorzystywane do przypadkowego oszukiwania istniejących systemów.

Ich możliwości znacznie przewyższają zdolność ogółu społeczeństwa do ich rozpoznawania. Jak wyjaśnia ekspert ds. cyberbezpieczeństwa David Fairman z Netskope: "Publiczna dostępność tych usług obniżyła barierę wejścia dla cyberprzestępców - nie muszą już oni posiadać specjalnych umiejętności technologicznych".

Ekonomia kryminalna:

- Koszt utworzenia: Już od $20 za podstawowe oprogramowanie deepfake

- Wskaźnik sukcesu: Wystarczy tylko raz, aby uzyskać ogromny zwrot z inwestycji

- Współczynnik wykrywalności68% osób nie potrafi odróżnić prawdziwego wideo od fałszywego

- Klonowanie głosu: Wymaga tylko 3-5 sekund próbkowania dźwięku dla dokładności 85%.

Ostatnie ataki Deepfake

Wzrost liczby fałszywych ubezpieczeń komunikacyjnych w Wielkiej Brytanii (2024) Brytyjscy ubezpieczyciele, w tym Allianz i Zurich, zgłosili 300% wzrost liczby nieuczciwych roszczeń obejmujących zdjęcia i filmy zmanipulowane przez sztuczną inteligencję w latach 2021-2023, przy czym trend ten przyspieszył w 2024 roku. Konkretny przypadek dotyczył oszustów manipulujących dowodami CCTV w celu zmiany daty, godziny i numeru rejestracyjnego pojazdu na poparcie rzekomego roszczenia z tytułu wypadku Kennedys Law LLPMiłość do pieniędzy. Według Stowarzyszenia Brytyjskich Ubezpieczycieli (Association of British Insurers), przeciętne nieuczciwe roszczenie było warte 15 000 funtów w 2023 roku, a przestępstwa te dodawały około 50 funtów rocznie do przeciętnych składek na ubezpieczenie samochodu i domu ubezpieczającego

Próba podszycia się pod CEO Ferrari (2024) W lipcu 2024 r. włoska firma motoryzacyjna Ferrari doświadczyła ataku, w którym oszuści próbowali oszukać kierownictwo finansowe, używając cyfrowego podszywania się pod CEO Benedetto Vignę. Oszuści najpierw skontaktowali się z kierownictwem wyższego szczebla na WhatsApp, pytając o "duże przejęcie, które planujemy", a następnie eskalowali do głębokich fałszywych połączeń głosowych, które powielały charakterystyczny południowowłoski akcent Vigny (artykuł tutaj).

Oszustwa związane z federalnymi usługami rządowymi (2024) Badania przeprowadzone przez GB Group szacują, że około 8,6 miliona osób w Wielkiej Brytanii korzystało z fałszywych lub oszukańczych tożsamości w celu uzyskania dostępu do usług rządowych. Głębokie fałszywe identyfikatory z obsługą sztucznej inteligencji są coraz częściej wykorzystywane do różnych oszustw, w tym do uzyskiwania dostępu do usług rządowych przy użyciu fałszywych danych uwierzytelniających tożsamość .ID.me odnotowano gwałtowny wzrost liczby wektorów ataków w latach 2023-2024, przy czym ataki typu deepfake polegające na podmianie twarzy wzrosły o 300%, ataki polegające na wstrzykiwaniu obrazów i wideo wzrosły o 783%, a ataki z użyciem wirtualnych kamer gwałtownie wzrosły o 2665%.

Podatek powierniczy

Poza bezpośrednimi stratami finansowymi, deepfakes nakładają na globalny handel coś, co ekonomiści mogliby nazwać "podatkiem zaufania". Kiedy 32% liderów korporacyjnych nie ma pewności, że ich pracownicy są w stanie rozpoznać próby oszustw typu deepfake.Koszty wykraczają daleko poza pojedyncze incydenty.

Organizacje są teraz zmuszone do inwestowania:

- Ulepszone protokoły weryfikacji

- Programy szkoleniowe dla pracowników

- Zaawansowane technologie wykrywania

- Możliwości zarządzania kryzysowego

- Zgodność z prawem i przepisami

Jednak pomimo tego rosnącego zagrożenia, tylko 29% firm podjęło kroki w celu zapewnienia sobie ochronyz 46% bez jakiegokolwiek planu łagodzenia skutków.

Przed nami przyspieszenie

FinCEN (Financial Crimes Enforcement Network) zaobserwował "wzrost liczby podejrzanych działań zgłaszanych przez instytucje finansowe, opisujących podejrzane wykorzystanie deepfake media w schematach oszustw", począwszy od 2023 r. i kontynuując w 2024 r.

Problem $25 miliardów nie dotyczy tylko pieniędzy - chodzi o fundamentalną erozję zaufania do komunikacji cyfrowej, która napędza współczesny biznes. Każda rozmowa wideo, każda wiadomość audio, każda cyfrowa interakcja wiąże się teraz z pytaniem: "Skąd mam wiedzieć, że to prawda?".

Kierownictwo, które jako pierwsze rozwiąże ten kryzys zaufania, będzie miało decydującą przewagę. Ci, którzy tego nie zrobią, mogą znaleźć się w roli głównej we własnym studium przypadku oszustwa typu deepfake.

Referencje:

Raport z incydentu Deepfake w 1. kwartale 2025 r. - Resemble AI - $200 mln euro strat w pierwszym kwartale 2025 r.

Deloitte Center for Financial Services (maj 2024 r.) - Prognoza $40 mld do 2027 r., 25,9% dyrektorów doświadczyło incydentów, 50% spodziewa się wzrostów

Variety (18 kwietnia 2025 r.) - "Oszustwa z wykorzystaniem Deepfake spowodowały już $200 milionów strat finansowych w 2025 roku"

Eftsure US (2025) - "Statystyki Deepfake (2025): 25 nowych faktów dla dyrektorów finansowych" - $500 000 średnich strat biznesowych, $680 000 strat dużych przedsiębiorstw

CNBC (28 maja 2024 r.) - Cytat Davida Fairmana z Netskope

Raport Entrust 2025 dotyczący oszustw związanych z tożsamością - 3,000% wzrost liczby deepfake'ów w latach 2022-2023

Alert FinCEN FIN-2024-Alert004 - Wzrost liczby zgłoszeń podejrzanych działań

Różne badania cytowane w Eftsure - 32% liderów nie ma zaufania do rozpoznawania pracowników, 68% nie potrafi odróżnić prawdziwego wideo od fałszywego, 3-5 sekund potrzebne do klonowania głosu