W latach 90-tych było to DNA.

W latach 2000 były to pingi z wież komórkowych.

Ale w 2026 roku nowym złotym standardem dowodowym jest cyfrowy odcisk palca.

Pomyśl o tym w ten sposób...

Każdy plik wideo ma unikalny podpis.

Jeśli nawet jeden piksel zostanie zmieniony przez sztuczną inteligencję, odcisk palca zmieni się natychmiast.

Jeśli twój dowód AI nie ma zweryfikowanego znacznika czasu blockchain, aby zablokować ten odcisk palca, może równie dobrze być kreskówką w oczach współczesnego sędziego.

Oznacza to, że era “widzieć znaczy wierzyć” dobiegła końca.

Wkroczyliśmy w erę weryfikacji wideo AI, w której dowodem nie jest to, co widzisz, ale cyfrowy kod ukryty pod powierzchnią.

Na tym blogu zbadamy, dlaczego tradycyjne dowody zawodzą w walce z oszustwami wideo, jak wykryć zmanipulowane klipy, dlaczego weryfikacja ma kluczowe znaczenie dla dopuszczalności i dlaczego detektor wideo AI, taki jak TruthScan, jest teraz niezbędny dla zespołów prawnych.

Zanurzmy się.

Kluczowe wnioski

- W 2026 r. wszystkie dowody wideo będą musiały przejść weryfikację wideo AI, aby można je było uznać za wiarygodne.

- Oszustwa wideo obejmują drobne zmiany, takie jak manipulacja znacznikami czasu, a nie tylko pełną zamianę twarzy.

- Profesjonalny wykrywacz deepfake to jedyny sposób na wychwycenie artefaktów GAN, których ludzie nie dostrzegają.

- Nowe zasady, takie jak Federalna Reguła 707, standaryzują sposób dopuszczania dowodów AI w sądzie.

- Zautomatyzowana analiza dowodów pozwala firmom na szybkie i dokładne przetwarzanie ogromnych pakietów informacji.

- TruthScan zapobiega oszustwom podczas przesłuchań na żywo, wykrywając syntetyczne maski w czasie rzeczywistym.

Czym są dowody wideo w sporach prawnych?

Dowody wideo to w zasadzie wszelkie nagrane klipy wykorzystywane w sądzie do udowodnienia tego, co się wydarzyło. Od spraw karnych po ugody ubezpieczeniowe, jest wszędzie.

Jednak w 2026 r. wzrost liczby oszustw wideo sprawił, że “widzieć znaczy wierzyć” stało się niebezpiecznym założeniem. Prawnicy potrzebują teraz solidnej weryfikacji wideo AI, aby zapewnić integralność systemu wymiaru sprawiedliwości.

Rodzaje dowodów wideo wykorzystywanych przez sądy każdego dnia

Nigdy więcej nie martw się o oszustwa związane ze sztuczną inteligencją. TruthScan Może ci pomóc:

- Wykrywanie wygenerowanych przez AI obrazy, tekst, głos i wideo.

- Unikać poważne oszustwa oparte na sztucznej inteligencji.

- Chroń swoje najbardziej wrażliwy aktywa przedsiębiorstwa.

- Nadzór (CCTV): Kamery ze sklepów lub sygnalizacji świetlnej. Jest to najczęstszy dowód w sprawach karnych.

- Kamery ciała: Nagrania od funkcjonariuszy policji, wykorzystywane głównie w sprawach dotyczących praw obywatelskich lub nadmiernej siły.

- Kamery samochodowe: Dowód w przypadku wypadków samochodowych i walk ubezpieczeniowych.

- Nagrane świadectwa: Zeznania wideo lub zdalne zeznania świadków, które stały się normalne od czasu pandemii. Obecnie jest to standard, ale podatny na wyzwania związane z wykrywaniem oszustw prawnych.

- Smartfon i media społecznościowe: Filmy od osób postronnych lub posty potwierdzające czyjeś zachowanie lub lokalizację.

- Bezpieczeństwo firmy: Materiał filmowy wykorzystywany przez korporacje w sprawach o oszustwa lub “niesłuszne zwolnienia”.

Generatywna sztuczna inteligencja i technologia deepfake dodały nową warstwę ryzyka. W 2025 r:

- 1 na 20 weryfikacji tożsamości została oszukana przez sztuczną inteligencję typu deepfake

- Badanie przeprowadzone przez firmę Medius wykazało, że 43% profesjonalistów padło ofiarą próby oszustwa typu deepfake

Prawdziwe przypadki oszustw związanych z dowodami wideo

- Zmanipulowane klipy z sali sądowej

Zmanipulowane klipy sądowe odnoszą się do wszelkich dowodów wideo lub audio przedstawionych w sprawie sądowej, które zostały zmienione, edytowane lub całkowicie sfabrykowane przy użyciu technologii.

Przykłady:

- Fałszywy przypadek hrabstwa Alameda (2025): Sprawa cywilna w Kalifornii została oddalona po tym, jak sąd odkrył, że nagranie wideo świadka przedstawione jako dowód zostało w całości stworzone przy użyciu sztucznej inteligencji.

- Obrona przed deepfake'ami Sz Huang kontra Tesla (2023): W pozwie o bezprawną śmierć prawnicy Tesli twierdzili, że kluczowe nagranie z wypadku może być fałszywe.

Zmienione nagrania z monitoringu

Wideo z monitoringu jest jednym z najczęstszych rodzajów dowodów AI wykorzystywanych w sądzie. Jednak wiele osób błędnie uważa, że manipulacja to tylko pełne deepfake'i.

W rzeczywistości oszustwa wideo często mają miejsce na mniejsze, mniej oczywiste sposoby, które mogą zagrozić sprawie.

Typowe rodzaje manipulacji obejmują:

- Zmiany znacznika czasu

- Demontaż ramy

- Zmiany metadanych lub GPS

- Wymiana twarzy

- Usuwanie lub wkładanie obiektów

- Zapętlony materiał filmowy

- Pogorszenie jakości

Nagrania z monitoringu często pochodzą z wielu różnych miejsc, takich jak prywatne sklepy, domowe dzwonki do drzwi, parkingi i kamery miejskie. W przeciwieństwie do nagrań z kamer policyjnych, systemy te zwykle nie przestrzegają ścisłych zasad łańcucha dowodowego.

Oznacza to:

- Może nie być jasnego zapisu, kto zajmował się plikiem.

- Materiał filmowy może być wielokrotnie kopiowany, przesyłany lub konwertowany.

- Procedury uwierzytelniania mogą być słabe lub niespójne.

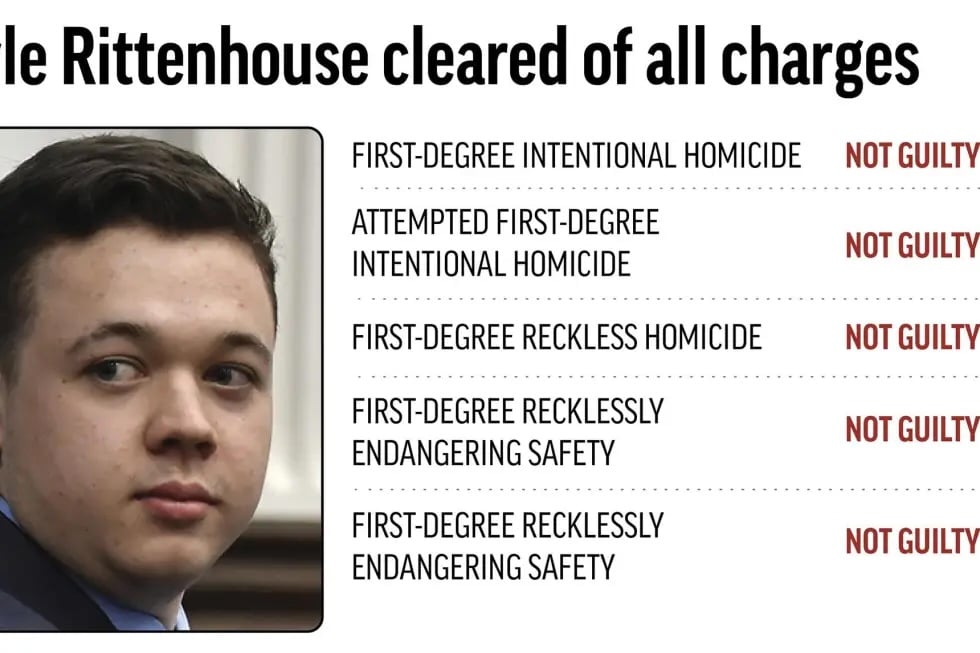

Przykład: Kwestia wzmocnienia sztucznej inteligencji w sprawie Wisconsin przeciwko Rittenhouse

Słynny przykład pochodzi z procesu Wisconsin przeciwko Rittenhouse. Oskarżenie próbowało użyć funkcji "pinch-to-zoom" iPada, aby pokazać szczegóły na filmie z drona.

Obrona argumentowała, że zoom Apple wykorzystuje interpolację AI, aby odgadnąć, co powinno tam być. Sędzia orzekł, że bez profesjonalnego detektora wideo AI, ulepszony materiał filmowy nie może zostać dopuszczony.

Kwestionowane zeznania wideo

Kwestionowane zeznania wideo zwykle wymagają legalnego wykrywania oszustw w celu ustalenia, czy nagranie jest prawdziwe:

- W pełni sfabrykowane zeznanie lub oświadczenie

- Prawdziwe zeznanie zakwestionowane jako fałszywe

- Zmanipulowane prawdziwe nagranie

Każdy z tych scenariuszy wiąże się z poważnym obciążeniem dla sądu.

Przykład: Sprawa o opiekę nad dzieckiem w Wielkiej Brytanii

W brytyjskim sporze przed sądem rodzinnym, cytowanym przez University of Baltimore Law Review, matka przedstawiła mocno zmienione nagranie, aby przedstawić ojca jako agresywnego podczas walki o opiekę.

Celem było ograniczenie jego dostępu do dzieci.

Wzrost popularności wideo generowanego przez sztuczną inteligencję w sprawach prawnych

Podróż w kierunku obecnej ery detektorów deepfake przebiegała w różnych fazach:

- Lata wczesnego ostrzegania (2017-2021)

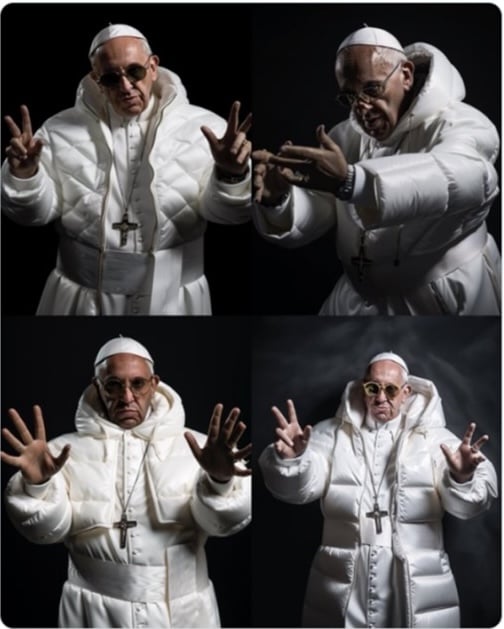

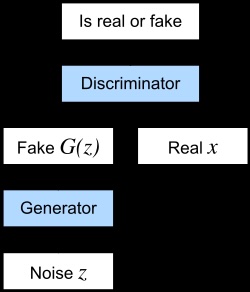

Technologia Deepfake (oparta na generatywnych sieciach przeciwstawnych (GAN)) pojawiła się publicznie około 2017 roku.

Wczesne deepfake'i były często niskiej jakości: twarze z dziwnymi zniekształceniami, dodatkowymi palcami, niedopasowanym oświetleniem i rozmytymi cechami, które sprawiały, że były łatwe do wykrycia.

- Faza eskalacji (2022-2023)

Do 2022 roku technologia uległa poprawie. Wiele z nich było darmowych i można było z nich korzystać na smartfonie.

W 2023 r. zaczęliśmy obserwować niektóre z pierwszych znaczących wyzwań związanych z deepfake w sprawach sądowych, w tym Sz Huang przeciwko Tesli, Stany Zjednoczone przeciwko Reffittowi i Stany Zjednoczone przeciwko Doolinowi, w których adwokat zadał pytania dotyczące tego, czy dowody wideo mogą być generowane przez sztuczną inteligencję.

Mniej więcej w tym samym czasie Komitet Doradczy ds. Zasad Dowodowych Amerykańskiego Stowarzyszenia Prawników formalnie rozpoczął badanie tej kwestii.

- Próg krytyczny (2024-2025)

Treści generowane przez sztuczną inteligencję nie pozostały długo akademickie. W 2024 r. w firmie inżynieryjnej Arup doszło do incydentu związanego z fałszywym połączeniem wideo wygenerowanym przez sztuczną inteligencję, które autoryzowało oszustwo. przelewy bankowe na łączną kwotę $25 milionów.

System prawny zaczął reagować.

W 2025 r, Luizjana przyjęła HB 178, tworząc pierwsze państwowe ramy weryfikacji dowodów AI.

Na poziomie federalnym, Amerykański Komitet Doradczy ds. Zasad Dowodowych zaproponował Reguła 707, skupiająca się na dowodach generowanych maszynowo.

Sytuacja w 2026 r.

Na początku 2026 r. regulacje dotyczące deepfake i AI-wideo przyspieszyły w całym kraju:

- 46 stanów przyjęły jakąś formę przepisów dotyczących deepfake.

- Od 2022 r, Uchwalono 169 ustaw, a w samym 2025 r. wprowadzono 146 ustaw.

- Reguła federalna 707 jest otwarta na publiczne komentarze do 16 lutego 2026 roku.

Lepsza weryfikacja wideo dzięki sztucznej inteligencji

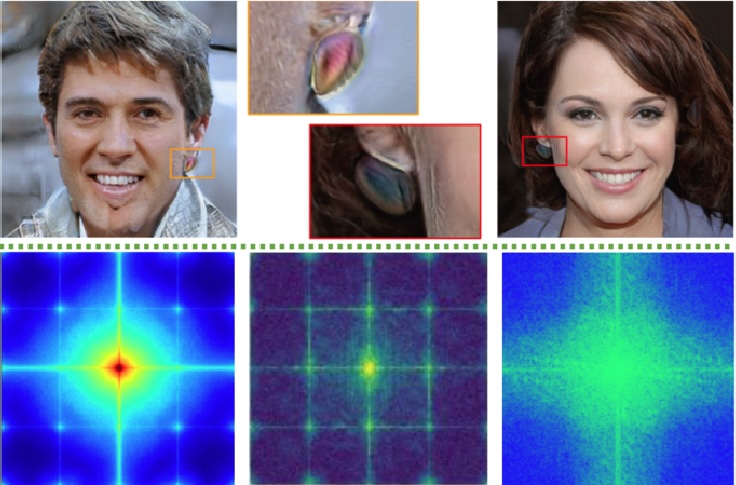

Najskuteczniejszym sposobem wykrywania filmów generowanych przez sztuczną inteligencję jest użycie samej sztucznej inteligencji.

Dzieje się tak, ponieważ deepfakes są tworzone przez systemy uczenia maszynowego, które pozostawiają po sobie subtelne cyfrowe wzorce.

Wzory te są zbyt małe lub zbyt złożone, by ludzkie oko mogło je dostrzec. Mogą one jednak zostać wykryte przez inne algorytmy.

Niezawodny system weryfikacji wideo AI może analizować wiele warstw wideo jednocześnie, w tym:

- Analiza na poziomie ramki sprawdza każdą klatkę pod kątem błędów wizualnych, takich jak dziwne tekstury, niedopasowanie oświetlenia lub problemy z mieszaniem wokół twarzy.

- Analiza spójności czasowej analizuje ruch w różnych klatkach, aby znaleźć nienaturalne skoki lub niespójny ruch.

- Śledzenie punktów orientacyjnych twarzy monitoruje ruchy oczu, mruganie i kształt twarzy w celu wykrycia nienaturalnych zmian.

- Testowanie synchronizacji audio-wideo sprawdza, czy ruchy warg dokładnie odpowiadają wypowiadanym słowom.

- Kryminalistyka audio analizuje głos pod kątem oznak klonowania, takich jak nietypowe wzorce dźwiękowe lub tony robotyczne.

- Analiza metadanych i kompresji Badanie ukrytych danych plików jest niezbędne do wykrywania oszustw prawnych w celu sprawdzenia, czy są one zgodne z oryginalnymi szczegółami nagrania.

Edukacja zespołów prawnych w zakresie oszustw wideo

Ponieważ sztuczna inteligencja może teraz naśladować ludzkie zachowanie z przerażającą dokładnością, firmy prawnicze wykorzystują zautomatyzowaną analizę dowodów i mieszankę tradycyjnych taktyk, aby pozostać na czele.

| Kategoria | Metoda | Opis |

| Oficjalne sposoby | Punkty CLE (Continuing Legal Education) | Obowiązkowe lub do wyboru kursy uczące prawników, jak uwierzytelniać dowody cyfrowe, rozumieć deepfake i spełniać standardy dowodowe. |

| Wyznaczeni przez sąd eksperci ds. sztucznej inteligencji | Ustanowienie certyfikowanych specjalistów medycyny sądowej AI, podobnych do ekspertów DNA, w celu oceny spornych dowodów wideo w sądzie. | |

| Sposoby nieoficjalne | Wewnętrzny Red-Teaming | Zatrudnienie specjalistów ds. cyberbezpieczeństwa w celu sprawdzenia, czy fałszywe lub zmanipulowane dowody mogą prześlizgnąć się przez firmowe systemy przyjmowania zgłoszeń. |

| “Protokół ”Vibe Check" | Przeszkolenie personelu w zakresie wykrywania typowych znaków ostrzegawczych deepfake, takich jak nienaturalne mruganie, zniekształcone rysy twarzy lub problemy z synchronizacją ruchu warg, przed eskalacją do analizy kryminalistycznej. |

Narzędzia i technologie walidacji dowodów

W 2026 roku wyszliśmy już poza prostą kontrolę wzrokową.

Ponieważ sztuczna inteligencja jest obecnie w stanie oszukać nawet najbardziej doświadczonych śledczych, zespoły prawne korzystają ze specjalnego zestawu narzędzi, aby zweryfikować, czy to, co widzą, jest absolutną prawdą.

Technologia stojąca za weryfikacją dowodów

- Deepfake Detectors: Są to specjalistyczne programy, które skanują w poszukiwaniu artefaktów GAN. Są to mikroskopijne, matematyczne wzory lub szumy pozostawione przez modele sztucznej inteligencji, które generują syntetyczne twarze. Podczas gdy człowiek widzi twarz, detektor widzi podpis cyfrowy, który do niej nie pasuje.

- TruthScan to głęboki wykrywacz podróbek, który skanuje filmy klatka po klatce w poszukiwaniu znaków AI, takich jak nietypowe mruganie, dziwne kształty twarzy lub błędy pikseli, w których dodawana jest fałszywa twarz.

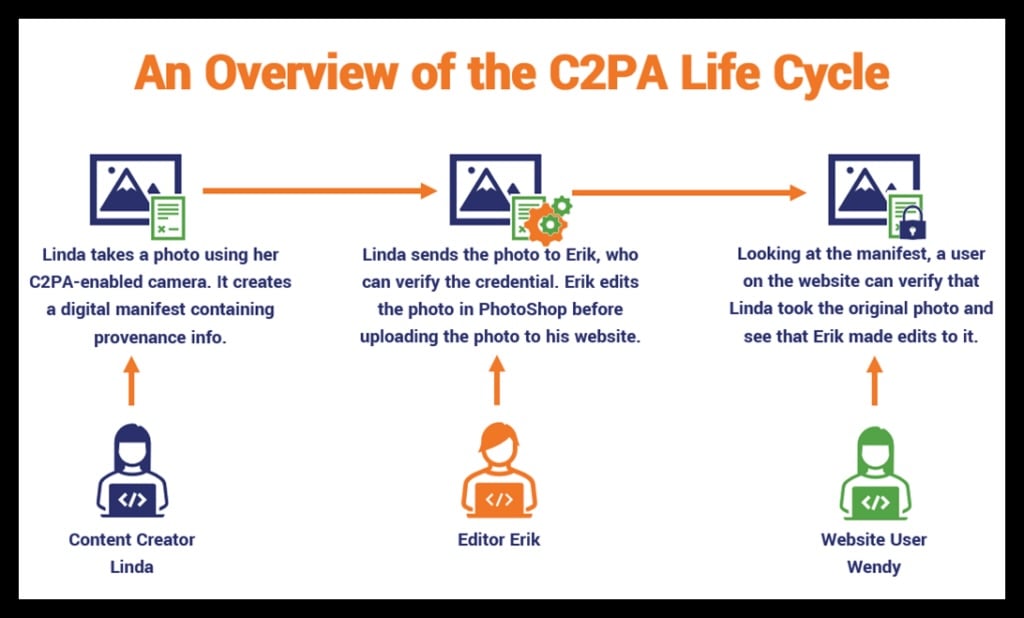

- Znaczniki czasu blockchain: Aby udowodnić, że wideo nie było dotykane od momentu jego nagrania, wiele agencji korzysta obecnie ze standardu C2PA. Gdy wideo jest nagrywane na zgodnym urządzeniu, tworzony jest unikalny cyfrowy odcisk palca (hash), który jest przechowywany w łańcuchu bloków.

- TruthScan może sprawdzić, czy ten odcisk palca pasuje do wideo, pokazując, czy plik został edytowany lub czy łańcuch dowodowy został przerwany.

- Narzędzia kryminalistyczne metadanych: Każdy plik cyfrowy posiada świadectwo urodzenia znane jako dane Exif. Narzędzia te sprawdzają, czy plik został ponownie zapisany w oprogramowaniu do edycji AI lub czy dane lokalizacji (GPS) zostały sfałszowane. Jeśli film twierdzi, że pochodzi z kamery sklepowej, ale metadane wskazują, że został wyeksportowany z edytora wideo, masz problem.

- Amped Software i TruthScan badają ukryte dane plików (Exif, nagłówki), aby sprawdzić, czy wideo było edytowane lub przetwarzane przez sztuczną inteligencję.

Trendy w dziedzinie dowodów wideo AI

Oto trzy trendy na rok 2026.

- Generatywna kryminalistyka kontradyktoryjna: AI vs. AI

Najbardziej zaawansowanym sposobem na złapanie deepfake'a w 2026 roku jest użycie tej samej technologii, która go stworzyła. Jest to znane jako Generative Adversarial Forensics.

- Jedna sztuczna inteligencja (generator) próbuje stworzyć fałszywkę, podczas gdy inna sztuczna inteligencja (dyskryminator) próbuje ją wyłapać. Na sali sądowej narzędzia takie jak TruthScan mogą być ostatecznym dyskryminatorem.

- Przykład: Powód przesyła nagranie wideo przedstawiające dyrektora generalnego zawierającego ustną umowę. TruthScan skanuje wideo przy użyciu własnych modeli przeciwstawnych w celu wykrycia artefaktów GAN. Jeśli oprogramowanie oznaczy syntetyczne prawdopodobieństwo 98%, dowód jest prawdopodobnie fałszerstwem mającym na celu oszukanie ludzkich oczu.

- Analiza synchronizacji audio-wideo (reguła 0,01 ms)

Ludzie zazwyczaj potrafią dostrzec opóźnienie, jeśli dźwięk wideo jest opóźniony o około 40-80 milisekund. Jednak deepfake'i z 2026 roku są często niemal idealne.

- Nowoczesne narzędzia kryminalistyczne AI szukają teraz 0,01-milisekundowego opóźnienia między fonetycznym dźwiękiem słowa a mechanicznym ruchem warg.

- Przykład: W sprawie o nękanie z 2026 r. pozwany twierdził, że nagranie wideo zostało sfałszowane. Kryminalistyczna zautomatyzowana analiza dowodów wykazała, że kształty ust “M” i “B” były o 0,02 ms niezsynchronizowane z dźwiękiem. Ten mikroskopijny błąd dowodzi, że głos został sklonowany i nałożony na inny film, co doprowadziło do oddalenia sprawy.

- Cheapfakes vs. Deepfakes

Podczas gdy deepfakes wykorzystują zaawansowaną sztuczną inteligencję, cheapfakes są najczęstszą formą oszustw wideo.

- Deepfake tworzy rzeczywistość, która nigdy nie miała miejsca (np. zamiana twarzy). Cheapfake wykorzystuje prawdziwy materiał filmowy i zmienia kontekst lub intencje za pomocą prostych narzędzi.

- Przykład (The Slow-Down): Wideo polityka wyglądającego na pijanego lub upośledzonego można stworzyć po prostu spowalniając materiał o 20% i dostosowując wysokość dźwięku.

- Przykład (Ponowny kontekst): Nagranie z protestu z 2022 roku w innym kraju zostaje opublikowane w 2026 roku jako dowód na lokalne zamieszki. Zespoły prawne korzystają teraz z analizy metadanych TruthScan, aby udowodnić rzeczywistą datę powstania filmu.

Jak TruthScan chroni legalne dowody wideo

TruthScan zapewnia, że każda klatka przedstawiona w sądzie jest autentyczna, zweryfikowana i prawnie możliwa do obrony.

Platforma usprawnia weryfikację wideo AI dzięki następującym korzyściom:

Zautomatyzowane dzienniki kontroli i dokumentacja łańcucha dostaw

- Niezawodność w sądzie: Generuje raporty PDF i JSON, które dokumentują każdy krok weryfikacji z dokładnymi wynikami zaufania i znacznikami czasu.

- Najwyższy poziom zgodności: Możesz spać spokojnie, wiedząc, że Twoje dane są bezpieczne i spełniają rygorystyczne globalne standardy, takie jak SOC 2, ISO 27001 i RODO.

- Elastyczna kontrola danych: Przechowuj poufne dowody w ramach wymaganej jurysdykcji dzięki opcjom wdrażania lokalnego lub VPC zaprojektowanym dla branż podlegających ścisłym regulacjom.

Przetwarzanie wsadowe i integracja API dla prawnych przepływów pracy

- Ogromna oszczędność czasu: Jednoczesne przetwarzanie tysięcy plików z pakietów Discovery lub zestawów do nadzoru przy użyciu masowego importu do pamięci masowej (S3/GCS).

- Płynne odzyskiwanie danych elektronicznych: Usprawnij swoje operacje, integrując weryfikację bezpośrednio z istniejącym oprogramowaniem za pośrednictwem webhooków i interfejsów API.

- Eliminacja błędów ręcznych: Zautomatyzuj pierwszy etap sprawdzania dowodów, aby Twój zespół mógł skupić się na strategii zamiast na żmudnym sprawdzaniu pliku po pliku.

Weryfikacja w czasie rzeczywistym dla zeznań i przesłuchań zdalnych

- Zatrzymaj podszywanie się: Użyj punktów końcowych transmisji strumieniowej na żywo, aby wykryć, czy deponent używa filtrów deepfake lub klonów głosowych podczas zdalnego przesłuchania.

- Zachowanie integralności sądu: Oznaczanie anomalii wizualnych lub dźwiękowych w czasie rzeczywistym, zapobieganie wprowadzaniu fałszywych zeznań do protokołu.

- Spokój ducha: Zapewnij swoim klientom i sądowi dodatkową warstwę bezpieczeństwa, która gwarantuje, że osoba na ekranie jest dokładnie tym, za kogo się podaje.

Dowiedz się więcej o zabezpieczaniu dowodów wideo AI

Chroń swoją firmę przed ryzykiem związanym ze zmanipulowanymi mediami. Detektor deepfake i technologia wykrywania wideo AI firmy TruthScan zapewniają najlepsze rozwiązanie do e-discovery i weryfikacji prawnej.

Chcesz zobaczyć TruthScan w akcji?

- Odwiedź truthscan.com aby otrzymać darmowe 20 000 kredytów.

- W przypadku zapytań korporacyjnych, integracji API lub niestandardowych opcji wdrażania, skontaktuj się z ich zespołem pod adresem Truthscan.com/contact.