Jeszcze kilka lat temu do naśladowania czyjegoś głosu potrzebne było profesjonalne studio i duże umiejętności techniczne.

Teraz każdy, kto ma połączenie z Internetem i trochę wolnego czasu, może stworzyć cyfrowego klona czyjegoś głosu w mniej niż minutę.

Narzędzia do takich ataków stają się coraz tańsze i bardziej dostępne dla każdego. A ponieważ tak wiele osób dzieli się swoim życiem w mediach społecznościowych, oszustom bardzo łatwo jest znaleźć potrzebny im materiał audio.

W tym artykule przedstawimy kilka znanych w świecie rzeczywistym przykładów oszustw audio. Przedstawimy również rozwiązanie, które w odpowiednim czasie położy kres tym zagrożeniom.

Kluczowe wnioski

- Próby oszustw głosowych typu deepfake wzrosły w ostatnich latach o ponad 217%, napędzane faktem, że nowoczesna sztuczna inteligencja może wygenerować dokładny klon głosowy 85% przy użyciu zaledwie trzech sekund dźwięku źródłowego.

- Słynne ataki w świecie rzeczywistym obejmują napad na firmę inżynieryjną Arup z 2024 r., w którym oszuści wykorzystali fałszywe wideo i audio dyrektora finansowego, aby nakłonić pracownika do przelania $25,6 mln euro.

- Poza kradzieżami korporacyjnymi, podrabianie głosu stwarza poważne ryzyko emocjonalne dla rodzin poprzez oszustwa związane z porwaniami i może ominąć tradycyjne biometryczne systemy bezpieczeństwa stosowane przez banki i inne aplikacje o wysokim poziomie bezpieczeństwa.

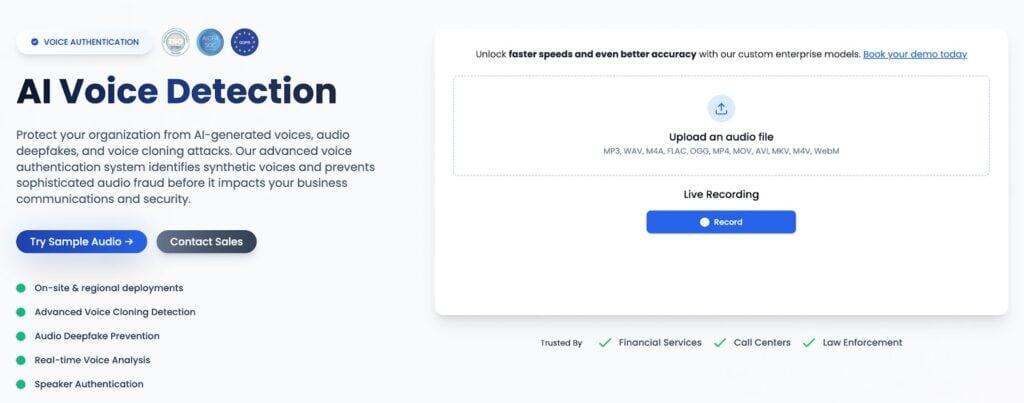

- Organizacje są zmuszone do wyjścia poza weryfikację wyłącznie przez człowieka, wdrażając wieloosobowe protokoły zatwierdzania dużych transferów i wdrażając detektory głosu AI, takie jak TruthScan, do analizy akustycznych odcisków palców w czasie rzeczywistym.

- TruthScan zabezpiecza interakcje w przedsiębiorstwach, identyfikując artefakty mowy syntetycznej z platform takich jak ElevenLabs i Murf z dokładnością ponad 99% we wszystkich głównych formatach audio i wideo.

Czym są ataki Voice Deepfake?

Fałszerstwo głosu to cyfrowe podrobienie czyjegoś głosu. Atakujący używa oprogramowania, które może analizować każdy najmniejszy szczegół tego, jak ktoś mówi z nagrania jego głosu.

Aby sklonować głos, oprogramowanie próbuje zauważyć wzorce w głosie. Oprogramowanie bierze pod uwagę głównie takie rzeczy jak wysokość, ton, sposób, w jaki ktoś oddycha między zdaniami itp.

Gdy już nauczy się tych wzorców, atakujący może sprawić, że powie wszystko tym głosem.

Nigdy więcej nie martw się o oszustwa związane ze sztuczną inteligencją. TruthScan Może ci pomóc:

- Wykrywanie wygenerowanych przez AI obrazy, tekst, głos i wideo.

- Unikać poważne oszustwa oparte na sztucznej inteligencji.

- Chroń swoje najbardziej wrażliwy aktywa przedsiębiorstwa.

Niebezpieczne jest to, że narzędzia do tworzenia deepfake'ów głosowych są łatwo dostępne. Większość z nich nie wymaga instalacji. Są one dostępne online w formie stron internetowych.

Wystarczy wyłożyć kilka dolarów i zacząć klonować głosy. Jeśli poszperasz trochę bardziej, możesz nawet znaleźć narzędzia, które pozwalają klonować głosy za darmo.

Ta nowa i łatwo dostępna technologia doprowadziła do gwałtownego wzrostu liczby oszustw audio.

Oszuści potrzebują tylko niewielkiego fragmentu dźwięku, który mogą pozyskać z mediów społecznościowych lub innego publicznego kanału, aby go sklonować.

Następnie mogą używać sklonowanego głosu do podszywania się pod daną osobę w sytuacjach takich jak rozmowy telefoniczne na żywo, spotkania wideo, notatki głosowe, ogłoszenia itp.

To nie są tylko hipotetyczne przypadki użycia głosowych ataków typu deepfake. Te rzeczy już się wydarzyły. Później omówimy niektóre z notorycznych ataków głosowych typu deepfake.

Potencjalne zagrożenia związane z głosowymi atakami Deepfake

Słysząc o deepfake'ach głosowych, mogłeś wyczarować obraz zabawnego filmu przedstawiającego celebrytę mówiącego rzeczy, których nigdy nie powiedział.

Ale to pozornie niewinne użycie sklonowanego głosu może spowodować poważne szkody dla zaangażowanych stron. Porozmawiajmy o ryzyku.

Katastrofa finansowa dla firm

Fałszywy głos może na zawsze zrujnować reputację firmy. Może również pozbawić ją dużych sum pieniędzy w ciągu kilku minut.

Jak to możliwe, można zapytać? Oszuści mogą klonować głos szefa firmy i używać go do dzwonienia do pracowników i zmuszania ich do robienia rzeczy, których nie powinni robić, takich jak przenoszenie pieniędzy na konto.

To tylko jeden z przykładów. Możliwości są nieograniczone.

Omijanie systemów bezpieczeństwa

Twój głos to biometria, której nikt inny nie powinien mieć. To dlatego, że używasz go jako hasła do logowania się do wielu aplikacji, zwłaszcza bankowych.

Chociaż aplikacje te mogą mieć wbudowany automatyczny system weryfikacji głosowej, aby zapobiec nieautoryzowanemu dostępowi, dobry klon głosowy nadal ma szansę je oszukać.

Emocjonalne obciążenie dla rodzin

Być może najłatwiejszym celem dla oszustów audio są starsze osoby w rodzinie. Na przykład rodzice i dziadkowie.

Oszuści mogą zadzwonić, powiedzmy, do matki i odtworzyć dźwięk jej córki wołającej o pomoc, mówiąc, że została porwana.

Spadek zaufania w miejscu pracy

Głosowe ataki typu deepfake również szkodzą zaufaniu w zdrowym miejscu pracy.

Pracownicy będą musieli dwukrotnie sprawdzać połączenia telefoniczne od swoich przełożonych, aby upewnić się, że nie jest to oszust nakazujący im wykonywanie ryzykownych czynności sklonowanym głosem.

Jakie są więc opcje, jeśli nie podwójne sprawdzenie ręczne? Wszystkie zagrożenia, które właśnie omówiliśmy, wskazują na potrzebę zautomatyzowanego zapobiegania atakom deepfake.

Na szczęście mamy teraz narzędzia do wykrywania fałszywych głosów AI, a TruthScan jest jednym z nich.

Zapobiegaj oszustwom i podszywaniu się pod inne osoby dzięki TruthScan Detektor głosu AI.

Przykłady ataków Voice Deepfake w świecie rzeczywistym

Dzięki sztucznej inteligencji osiągnęliśmy punkt, w którym nie możemy łatwo zaufać temu, co widzą nasze oczy lub słyszą nasze uszy. Sztuczna inteligencja jest teraz w stanie tworzyć realistyczne zdjęcia i filmy. To samo dotyczy dźwięku.

Być może słyszałeś już historie o ludziach, którzy padli ofiarą oszustwa deepfake audio. Od czasu do czasu pojawiają się one w wiadomościach i mediach społecznościowych. Niektóre z nich są trudne do zrozumienia.

Opowiemy o niektórych z najbardziej znanych ataków głosowych typu deepfake, abyś mógł zorientować się, jak sprytnie są one wykonywane.

Wirtualne spotkanie $25 Million, które nigdy się nie odbyło

Ten atak deepfake jest prawdopodobnie najczęściej zgłaszanym atakiem.

The Ofiarą była brytyjska firma inżynieryjna Arup, ale oszustwo miało swój początek w biurze firmy w Hongkongu.

Był początek 2024 roku, kiedy pracownik działu finansowego firmy otrzymał wiadomość e-mail od dyrektora finansowego firmy w Wielkiej Brytanii. W e-mailu pracownik otrzymał od dyrektora finansowego polecenie dokonania tajnych przelewów pieniężnych na niektóre konta bankowe.

Początkowo pracownik był dość podejrzliwy, ponieważ prośba wydawała się nieco dziwna i pomyślał, że może to być oszustwo phishingowe.

Następnie jednak pracownik został zaproszony na wideokonferencję. Kiedy pracownik dołączył do rozmowy, zobaczył coś, co wyglądało dokładnie jak dyrektor finansowy i kilku innych starszych kolegów.

Wszyscy wyglądali i brzmieli dokładnie tak, jak powinni. Rozmawiali też ze sobą, by wydawać się bardziej realnymi.

To całkowicie rozwiało wszelkie wątpliwości pracownika działu finansowego, który następnie wysłał ponad $25,6 mln (~HK$200 mln) na kilka różnych kont bankowych w Hongkongu za pośrednictwem 15 transakcji.

Później okazało się, że cała ta konfiguracja była głęboko sfałszowana. Żadna z osób biorących udział w rozmowie nie była tym, na kogo wyglądała, z wyjątkiem pracownika Arup. Oszuści doskonale skoordynowali atak przy użyciu wysokiej jakości klonów audio i wideo dyrektora finansowego firmy i starszych pracowników.

Włoski minister i ikony mody

Ten również miał miejsce w 2024 roku. A Fałszywy włoski minister obrony Guido Crosetto zadzwonił do kilku włoskich elit i poprosił o natychmiastową pomoc finansową w ratowaniu porwanych dziennikarzy.

W rozmowie fałszywy Guido Crosetto twierdził, że była to ściśle tajna operacja rządowa. Rozmówcy udało się nawet połączyć z legendarnymi postaciami mody, takimi jak Giorgio Armani.

Niestety, jedna osoba przelała około miliona dolarów. Prawdopodobnie miała ona większe poczucie patriotycznego obowiązku pomocy niż inni, co oszustom udało się wykorzystać.

Kradzież $243,000 UK Energy Heist

To wydarzyło się w 2019 roku i był to prawdopodobnie pierwszy w historii deepfake na taką skalę.

Dyrektor generalny brytyjskiej firmy energetycznej myślał, że rozmawia przez telefon ze swoim szefem z firmy macierzystej w Niemczech.

Dyrektorowi generalnemu nakazano przelać około 220 000 euro ($243 000) do dostawcy na Węgrzech. Powiedziano mu, że jest to krytyczna transakcja, która wymaga natychmiastowego przelewu. CEO dał się nabrać i przelał pieniądze.

Przerażający telefon do matki w Arizonie

Pamiętasz, jak rozmawialiśmy o deepfake'ach audio stanowiących zagrożenie dla rodzin? Podany przez nas przykład oszustwa rzeczywiście miał miejsce.

Oszuści sklonowali głos 15-letniej dziewczynki z filmu zamieszczonego w mediach społecznościowych. Następnie zadzwonili do jej matki i twierdzili głosem córki, że została porwana, a jej porywacze żądają natychmiastowego okupu.

Na szczęście ojciec był w stanie zadzwonić do swojej prawdziwej córki, która była bezpieczna podczas treningu narciarskiego. Udało im się uniknąć oszustwa.

Jak podróbki głosowe wpływają na przedsiębiorstwa

Głównym celem ataku typu deepfake jest kradzież pieniędzy.

Ale gdy celem są przedsiębiorstwa, szkody są wielowymiarowe.

Na przykład, deepfake może zatruć atmosferę między pracownikami firmy. Może stworzyć kulturę, w której pracownicy zawsze boją się popełnić błąd.

Weźmy na przykład call center. Widzimy doniesienia o cyberprzestępcach dzwoniących do nich i udających konkretnych klientów.

Ich sztuczka polega na tym, że agenci call center zmieniają dane konta tych klientów (np. adresy domowe, numery telefonów) i przejmują ich konta.

Zdalne zatrudnianie i wirtualne rozmowy kwalifikacyjne to kolejny obszar, w którym kandydaci mogą wykorzystywać fałszywe głosy do zdobycia pracy, do której nie mają kwalifikacji.

Ochrona firm przed głosowymi atakami typu deepfake

Tradycyjne zasady bezpieczeństwa w firmach zostały napisane w erze przed sztuczną inteligencją.

Najwyższy czas, aby firmy ponownie je rozważyły. Powinny one najpierw zacząć od edukacji na temat wielu nowych cyberzagrożeń, które wynikają z nadużywania sztucznej inteligencji.

Mogą na przykład zorganizować sesje szkoleniowe dla całego zespołu i pokazać im prawdziwe przykłady oszustw audio. Możesz zacząć od przykładów, które właśnie omówiliśmy powyżej. Te sesje szkoleniowe powinny również dać im wskazówki dotyczące zapobiegania atakom deepfake dla różnych scenariuszy.

Następnie można przystąpić do aktualizacji wewnętrznych zasad biznesowych. Jedną z ważnych zmian może być zaprzestanie zezwalania jednej osobie na samodzielne autoryzowanie masowych przelewów bankowych.

Duże płatności powinny wymagać zatwierdzenia przez cały panel, aby przynajmniej jeden z nich mógł w porę zauważyć, że coś jest nie tak.

Powinieneś także pomyśleć o zintegrowaniu zautomatyzowanego Detektor głosu AI aby działała w tle podczas połączeń.

Właśnie do tego zostały stworzone narzędzia TruthScan AI. Za pomocą naszych narzędzi AI można wykrywać, weryfikować i zapobiegać głosowym atakom typu deepfake. Powiemy ci, jak to zrobić.

Jak TruthScan zabezpiecza interakcje głosowe

Rozumiemy, że pracownicy nie są w stanie samodzielnie odróżnić głębokiego fałszywego głosu od prawdziwego głosu w trakcie stresującej rozmowy. Potrzebują dedykowanego asystenta, który mógłby zająć się tym zadaniem podczas rozmowy, podczas gdy Twój zespół może skupić się na robieniu tego, do czego został zatrudniony.

Nasz Detektor głosu AI jest rozwiązaniem dedykowanym.

Oto jak działa i do czego jest zdolny:

- Analizuje miliony różnych punktów danych w rozmowach telefonicznych na żywo i spotkaniach wideo, zapewniając dokładność na poziomie 99%.

- Wydaje ostrzeżenie natychmiast po wykryciu fałszywego głosu

- Wyłapuje wzorce spektralne i akustyczne odciski palców w głosie, które są pozostawiane tylko przez modele syntetyczne.

- Integruje się z istniejącym call center lub help desk za pomocą prostego interfejsu API REST.

- Może skanować wszystkie główne formaty audio i wideo

Porozmawiaj z TruthScan o zapobieganiu głosowym atakom Deepfake

Możesz powstrzymać oszustwa związane z klonowaniem głosu w czasie rzeczywistym dzięki TruthScan, ale pytanie brzmi: kiedy zamierzasz zacząć? Twoi pracownicy mogą prędzej czy później popełnić błąd i zostać oszukani. Nie czekaj na ten niefortunny moment.

Nasz wykrywacz głosu AI może oznaczać fałszywe głosy za pomocą platform takich jak ElevenLabs i Murf.

Działa w tle podczas rozmów telefonicznych na żywo i spotkań wideo, dzięki czemu agenci telefoniczni nie muszą wykonywać wielu zadań jednocześnie.

Wszystko, czego potrzeba, to szybka integracja za pośrednictwem naszego interfejsu API REST.

Rozpocznij z TruthScan i chroń swoją firmę przed oszustwami typu deepfake.