Nog maar een paar jaar geleden had je een professionele studio en veel technische vaardigheid nodig om iemands stem na te bootsen.

Nu kan iedereen met een internetverbinding en wat vrije tijd in minder dan een minuut een digitale kloon van iemands stem maken.

De tools voor deze aanvallen worden elke dag goedkoper en toegankelijker voor iedereen. En omdat zoveel mensen hun leven delen op sociale media, is het voor een oplichter heel gemakkelijk om de audio te vinden die hij nodig heeft.

In dit artikel nemen we een aantal beruchte voorbeelden van audiofraude met je door. We laten je ook kennismaken met een oplossing om tijdig een einde te maken aan deze bedreigingen.

Belangrijkste opmerkingen

- Pogingen tot stemfraude zijn de afgelopen jaren met meer dan 2.137% gestegen, aangewakkerd door het feit dat moderne AI een 85% accurate stemkloon kan genereren met slechts drie seconden bronaudio.

- Beruchte aanvallen in de echte wereld zijn onder andere de overval op het ingenieursbureau Arup in 2024, waarbij oplichters deepfake video en audio van een CFO gebruikten om een werknemer te verleiden tot het overmaken van $25,6 miljoen.

- Naast bedrijfsdiefstal vormen voice-fakes ernstige emotionele risico's voor gezinnen door middel van ontvoeringszwendel en kunnen ze traditionele biometrische beveiligingssystemen omzeilen die worden gebruikt door banken en andere zwaarbeveiligde apps.

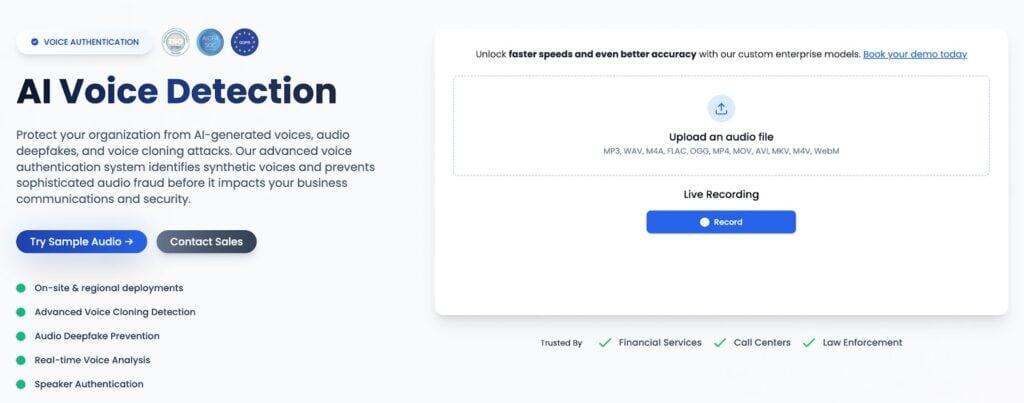

- Organisaties worden gedwongen om verder te gaan dan alleen menselijke verificatie door protocollen voor goedkeuring door meerdere personen te implementeren voor grote overdrachten en AI-spraakdetectors zoals TruthScan in te zetten om akoestische vingerafdrukken in realtime te analyseren.

- TruthScan beveiligt bedrijfsinteracties door synthetische spraakartefacten van platforms als ElevenLabs en Murf te identificeren met een nauwkeurigheid van meer dan 99% in alle belangrijke audio- en videoformaten.

Wat zijn Voice Deepfake-aanvallen?

Een voice deepfake is een digitale vervalsing van iemands stem. De aanvaller gebruikt software die elk klein detail van hoe iemand spreekt kan analyseren aan de hand van een stemopname.

Om de stem te klonen, probeert de software patronen in de stem op te merken. De software houdt voornamelijk rekening met zaken als de toonhoogte, de toon, de manier waarop iemand ademhaalt tussen zinnen, enz.

Zodra het deze patronen leert, kan de aanvaller het alles laten zeggen met die stem.

Maak je nooit meer zorgen over AI-fraude. TruthScan Kan je helpen:

- AI-opgewekt detecteren afbeeldingen, tekst, spraak en video.

- Vermijd grote AI-gestuurde fraude.

- Bescherm uw meest gevoelig bedrijfsmiddelen.

Wat gevaarlijk is, is dat tools om voicefakes te maken gemakkelijk toegankelijk zijn. En de meeste hebben geen installatie nodig. Ze zijn online beschikbaar in de vorm van websites.

Je hoeft ze alleen maar een paar dollar te geven om te beginnen met het klonen van stemmen. Als je wat verder zoekt, kun je zelfs tools vinden waarmee je gratis stemmen kunt klonen.

Deze nieuwe en gemakkelijk verkrijgbare technologie heeft geleid tot een sterke toename van fraude met audio.

Oplichters hebben maar een klein beetje audio van iemand nodig, dat ze kunnen halen uit sociale media of een ander openbaar kanaal, om het te klonen.

Vervolgens kunnen ze de gekloonde stem gebruiken om zich voor te doen als een persoon in situaties zoals live telefoongesprekken, videovergaderingen, spraaknotities, aankondigingen, etc.

Dit zijn niet alleen hypothetische use cases van voice deepfake aanvallen. Deze dingen zijn al gebeurd. We zullen later enkele van de beruchte voice deepfake aanvallen behandelen.

Potentiële risico's van Voice Deepfake-aanvallen

Bij het horen van voice deepfake heb je misschien beelden opgeroepen van een grappige video van een beroemdheid die dingen zegt die ze nooit gezegd hebben.

Maar dat schijnbaar onschuldige gebruik van een gekloonde stem kan ernstige schade toebrengen aan de betrokken partijen. Laten we het eens hebben over de risico's.

Financiële verwoesting voor bedrijven

Een voice deepfake kan de reputatie van een bedrijf voor altijd ruïneren. Het heeft ook het vermogen om het bedrijf binnen enkele minuten van grote sommen geld te beroven.

Hoe komt dat, vraag je je misschien af? Oplichters kunnen de stem van de baas van een bedrijf klonen en die gebruiken om werknemers te bellen en ze dingen te laten doen die niet mogen, zoals geld overmaken naar een rekening.

Dit is slechts één voorbeeld. De mogelijkheden zijn eindeloos.

Beveiligingssystemen omzeilen

Je stem is een biometrisch kenmerk dat niemand anders zou mogen hebben. Dat komt omdat je het als wachtwoord gebruikt om in te loggen op veel van je apps, vooral de bankapps.

Hoewel deze apps een ingebouwd automatisch stemverificatiesysteem hebben om ongeoorloofde toegang te voorkomen, heeft een goede stemkloon nog steeds een kans om ze voor de gek te houden.

De emotionele belasting voor gezinnen

Misschien wel de makkelijkste doelwitten voor audiofraudeurs zijn oudere mensen in de familie. Ouders en grootouders bijvoorbeeld.

Oplichters kunnen bijvoorbeeld een moeder bellen en het geluid afspelen van haar dochter die om hulp roept en zegt dat ze ontvoerd is.

Vertrouwen op de werkvloer afbrokkelen

Ook voice-fake aanvallen schaden het vertrouwen in een gezonde werkplek.

Werknemers moeten telefoontjes van hun manager dubbelchecken om er zeker van te zijn dat het geen oplichter is die hen met een gekloonde stem opdraagt riskante dingen te doen.

Wat zijn dan je opties als je niet handmatig dubbelcheckt? Alle risico's die we zojuist hebben besproken, wijzen op de noodzaak van een geautomatiseerde preventie van deepfake-aanvallen.

Gelukkig hebben we nu deepfake AI-stemdetectietools, waarvan TruthScan er één is.

Voorkom fraude en imitatie met TruthScan's AI-stemdetector.

Voorbeelden uit de praktijk van spraakherkenning (Voice Deepfake)

Dankzij AI hebben we nu een punt bereikt waarop we niet meer kunnen vertrouwen op wat onze ogen zien of onze oren horen. AI is nu in staat om realistische foto's en video's te maken. Hetzelfde geldt voor audio.

Je hebt misschien al verhalen gehoord van mensen die zijn gevallen voor deepfake audio-fraude. Het blijft ook af en toe opduiken in het nieuws en op sociale media. Sommige zijn moeilijk te bevatten.

Laten we je vertellen over een aantal van de meest beruchte voice deepfake aanvallen, zodat je een goed idee krijgt van hoe slim deze worden uitgevoerd.

De $25 Miljoen Virtuele Vergadering Die Nooit Heeft plaatsgevonden

Deze deepfake aanval is waarschijnlijk de meest gerapporteerde.

De slachtoffer was een Brits ingenieursbureau genaamd Arup, maar de zwendel vond zijn oorsprong in het kantoor in Hongkong.

Het was begin 2024 toen een werknemer op de financiële afdeling van het bedrijf een e-mail kreeg van de CFO van het bedrijf in het VK. In de e-mail kreeg de werknemer van de CFO de opdracht om geheime overschrijvingen te doen naar een aantal bankrekeningen.

In eerste instantie was de medewerker nogal achterdochtig omdat het verzoek een beetje vreemd aanvoelde en hij dacht dat het misschien om phishing ging.

Maar toen werd de werknemer uitgenodigd voor een video-conferentiegesprek. Toen de werknemer deelnam aan het gesprek, zag hij wat precies leek op de CFO en een aantal andere senior collega's.

Iedereen zag en klonk precies zoals het hoorde. Ze praatten ook met elkaar om het nog echter te laten lijken.

Dit nam alle twijfels weg van de medewerker van de financiële afdeling, die vervolgens via 15 transacties meer dan $25,6 miljoen (~HK$200 miljoen) naar verschillende bankrekeningen in Hong Kong stuurde.

Later bleek dat deze hele opstelling een deepfake was. Geen enkele persoon in het gesprek was wie ze leken, behalve de Arup-medewerker. De oplichters hadden de aanval perfect gecoördineerd met behulp van hoogwaardige audio- en videokloonen van de CFO en senior medewerkers van het bedrijf.

De Italiaanse minister en de mode-iconen

Deze vond ook plaats in 2024. A nep Italiaanse minister van defensie Guido Crosetto belde verschillende Italiaanse elites en vroeg hun onmiddellijke financiële hulp bij het redden van ontvoerde journalisten.

In het gesprek beweerde de valse Guido Crosetto dat dit een topgeheime overheidsoperatie was. De beller slaagde er zelfs in om legendarische modefiguren zoals Giorgio Armani aan de telefoon te krijgen.

Helaas heeft één persoon uiteindelijk ongeveer een miljoen dollar overgemaakt. Zij hadden waarschijnlijk een sterker gevoel van patriottische plicht om te helpen dan anderen, waar de oplichters misbruik van wisten te maken.

De $243.000 Britse energieoverval

Deze gebeurd in 2019 en was waarschijnlijk de eerste gerapporteerde deepfake van deze omvang.

Een CEO van een Brits energiebedrijf dacht dat hij aan de telefoon was met zijn baas van het moederbedrijf in Duitsland.

De CEO moest ongeveer € 220.000 ($243.000) overmaken naar een leverancier in Hongarije. Er werd hem verteld dat het om een kritieke deal ging die onmiddellijk moest worden overgemaakt. De CEO trapte in de zwendel en maakte het geld over.

Een angstaanjagend telefoontje voor een moeder in Arizona

Weet je nog dat we het hadden over audio deepfakes als bedreiging voor gezinnen? Het voorbeeld van de zwendel die we gaven is echt gebeurd.

Oplichters hadden de stem van een 15-jarig meisje gekloond van een video van haar op sociale media. Vervolgens belden ze haar moeder en beweerden met de stem van de dochter dat ze was ontvoerd en dat haar ontvoerders onmiddellijk losgeld eisten.

Gelukkig was de vader in staat om hun echte dochter te bellen, die veilig op een skitraining was tijdens de hele beproeving. Ze ontliepen de zwendel.

Hoe voice deepfakes bedrijven beïnvloeden

Het hoofddoel van een voice deepfake aanval is meestal om geld te stelen.

Maar als het doelwit ondernemingen zijn, is de schade multidimensionaal.

Deepfakes kunnen bijvoorbeeld de sfeer tussen de werknemers van een bedrijf vergiftigen. Het kan een cultuur creëren waarin werknemers altijd bang zijn om een blunder te maken.

Neem bijvoorbeeld callcenters. We zien meldingen van cybercriminelen die hen bellen en zich voordoen als specifieke klanten.

Hun truc is om de callcenter agents de accountgegevens van deze klanten te laten veranderen (bijv. huisadressen, telefoonnummers) en hun accounts over te nemen.

Sollicitaties op afstand en virtuele sollicitatiegesprekken zijn een ander gebied waar nepstemmen door kandidaten kunnen worden gebruikt om banen te krijgen waarvoor ze niet gekwalificeerd zijn.

Bedrijven beschermen tegen Voice Deepfake-aanvallen

De traditionele beveiligingsregels bij bedrijven zijn geschreven in het pre-AI tijdperk.

Het is hoog tijd dat bedrijven deze heroverwegen. Om te beginnen moeten ze zichzelf informeren over de vele nieuwe cyberbedreigingen die het gevolg zijn van misbruik van AI.

Ze kunnen bijvoorbeeld trainingssessies organiseren voor hun hele team en hen echte voorbeelden van audiofraude laten zien. Je kunt beginnen met de voorbeelden die we hierboven hebben besproken. Tijdens die trainingssessies moeten ze ook tips krijgen om deepfake-aanvallen te voorkomen in verschillende scenario's.

Vervolgens kun je het interne bedrijfsbeleid bijwerken. Een belangrijke verandering kan zijn om niet meer toe te staan dat één persoon in zijn eentje massale overschrijvingen autoriseert.

Voor grote betalingen zou de goedkeuring van een heel panel nodig moeten zijn, zodat ten minste één van hen op tijd kan merken dat er iets mis is.

Denk ook aan het integreren van een geautomatiseerde AI-stemdetector om op de achtergrond te draaien tijdens gesprekken.

Daar zijn de AI-tools van TruthScan voor gemaakt. Je kunt voice deepfake-aanvallen detecteren, verifiëren en voorkomen met onze AI-tools. We vertellen je hoe.

Hoe TruthScan steminteracties beveiligt

We begrijpen dat werknemers tijdens een stressvol gesprek niet in hun eentje een valse stem van een echte stem kunnen onderscheiden. Ze hebben een toegewijde assistent nodig die zich tijdens een gesprek met die taak kan bezighouden, terwijl jouw team zich kan concentreren op datgene waarvoor ze zijn aangenomen.

Onze AI-stemdetector is een speciale oplossing.

Dit is hoe het werkt en wat het kan:

- Analyseert miljoenen verschillende gegevenspunten in live telefoongesprekken en videovergaderingen en levert 99% nauwkeurigheid

- Geeft direct een waarschuwing af na het detecteren van een valse stem

- Vangt spectrale patronen en akoestische vingerafdrukken in spraak die alleen worden achtergelaten door synthetische modellen

- Integreert met je bestaande callcenter of helpdesk via een eenvoudige REST API

- Kan alle belangrijke audio- en videoformaten scannen

Praat met TruthScan over het voorkomen van Voice Deepfake-aanvallen

U kunt fraude met stemkloon in realtime stoppen met TruthScan, maar de vraag is wanneer u daarmee begint. Uw medewerkers kunnen vroeg of laat een blunder maken en u laten oplichten. Wacht niet op dat ongelukkige moment.

Onze AI-spraakdetector kan stemfraude signaleren met platforms als ElevenLabs en Murf.

Het werkt op de achtergrond tijdens live telefoongesprekken en videovergaderingen, zodat je call agents niet hoeven te multitasken.

Het enige wat hiervoor nodig is, is een snelle integratie via onze REST API.

Aan de slag met TruthScan nu en bescherm je bedrijf tegen deepfake scams.