Een normaal telefoontje van je CFO kan het moment zijn dat vertrouwen tegen je werkt. Stel je voor dat de breuk begint met;

“Kun je me voor de lunch het beheerderswachtwoord sturen?’

Je gehoorzaamt alsof gehoorzamen de enige manier is om de lunch te overleven. Klinkt redelijk, want het is een doodgewoon werkdagmoment.

Maar dit routinemoment op het werk wordt de openingsscène van een beveiligingsincident. Risico's worden nu vermomd als routine.

Begin 2024 arriveerde precies dit soort bedrog met een bekende stem en een vriendelijk gezicht toen een financieel medewerker in Hongkong zijn geld verzilverde. $25 miljoen aan iemand die er precies zo uitziet als hun echte CFO.

Uw onderneming kan het zich niet langer veroorloven om uit te gaan van goede bedoelingen. Het is alsof we op het kruispunt zitten van vertrouwen en wettelijke aansprakelijkheid.

Het is dus een wake-up call om je IT-protocollen af te stemmen op de nieuwste AI deepfake wetgeving. Want hackers spreken nu met stemmen die je dagelijks hoort.

Lees verder en stap binnen in het nieuwe juridische AI-tijdperk om te zien hoe valse beelden en geluiden voor echte juridische blootstelling kunnen zorgen.

Belangrijkste opmerkingen

- Vertrouwen is niet langer veilig. De $25 miljoen zwendel met CFO's in Hong Kong bewees dat vertrouwdheid overtuigend kan worden vervalst.

- De wet gaat nu sneller. Op het moment dat AI wordt ingezet, volgt juridische aansprakelijkheid de onderneming. Dus het maakt niet uit wie op “inzetten” drukte, de wet wijst naar jou.

- Synthetische media zijn zo ver vooruit dat alleen vertrouwen op menselijke instincten nu een gok is. Bedrijven hebben realtime AI-detectiesystemen nodig om elke e-mail, alle video- en telefoongesprekken en gedeelde bestanden te scannen op tekenen van manipulatie.

Wat is Deepfake-wetgeving?

Deepfake-wetgeving is niet langer abstract, of wat we zeggen “behoort alleen in theorie”. Het is een niet-onderhandelbare juridische noodzaak die zelfs gevestigde bedrijven onder druk zetten.

Maar wat zijn nu precies deze regels die je dwingen om moeilijke keuzes te maken? Niets verwarrends, gewoon een kaart die je nodig hebt om voorop te blijven in dit AI-tijdperk.

Aangezien elke pixel een verborgen waarheid bevat (of een leugen), zijn overheden wereldwijd aan het racen om te voorkomen dat AI-manipulatie bedrijven ten onder laat gaan. De EU AI-wet dwingt bedrijven nu om AI-inhoud te labelen of riskeren miljoenen boetes.

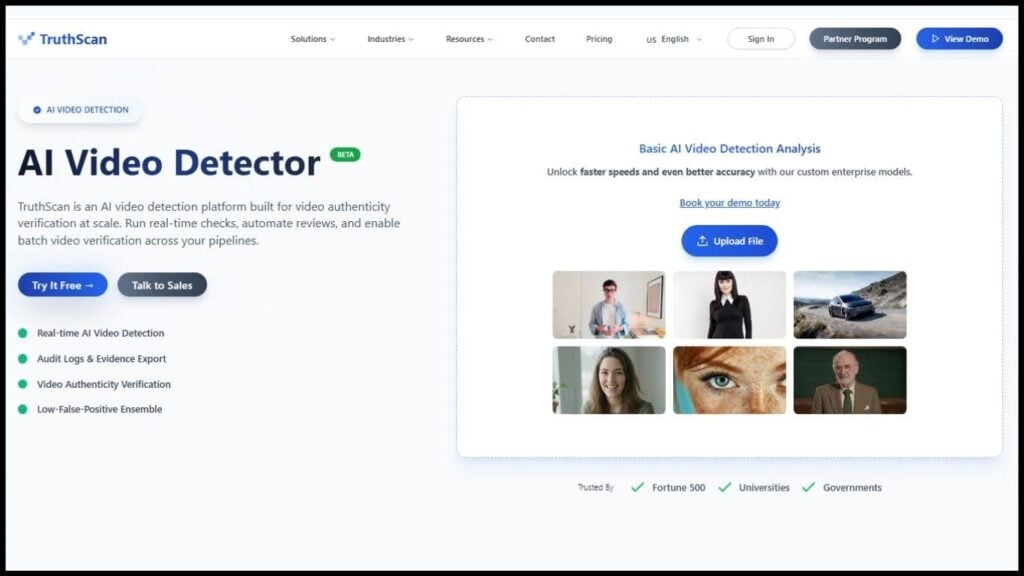

Maak je nooit meer zorgen over AI-fraude. TruthScan Kan je helpen:

- AI-opgewekt detecteren afbeeldingen, tekst, spraak en video.

- Vermijd grote AI-gestuurde fraude.

- Bescherm uw meest gevoelig bedrijfsmiddelen.

Omdat mensen moeten weten wanneer een AI spreekt en niet een echt persoon.

Hoe Deepfake bedrijven beïnvloedt

Phishing e-mails en netwerkinbreuken? Oud nieuws!

De bedreiging klinkt en ziet er nu uit als uw CEO (en met AI deepfake-wetgeving kunnen bedrijven het zich niet veroorloven om het te negeren). Een enkele “ja” kan miljoenen kosten. Het bewijst dat vertrouwen de wildste investering is - het kan zowel schat en val.

Maar wat als leugens eerst hun handen laten zien? Ja, deepfake leugens hebben hun gelijke gevonden: AI-detectie.

Organisaties zetten nu AI-detectoren via interne communicatiekanalen omdat ze bang zijn voor de “CEO” die nooit echt heeft gebeld.

En eerlijk gezegd is wachten op een inbreuk niets anders dan een gok van vele miljoenen dollars.

Het is meer een kwetsbaarheid, omdat deepfake video's tegenwoordig ons natuurlijke vermogen om een nepperd te herkennen voorbijgestreefd zijn.

De trieste realiteit is dat er geen verschil meer is tussen een BOSS en een pixel ghost, tenzij je een geloofwaardige AI-video detector die weigert om een marionet je loonlijst te laten beheren.

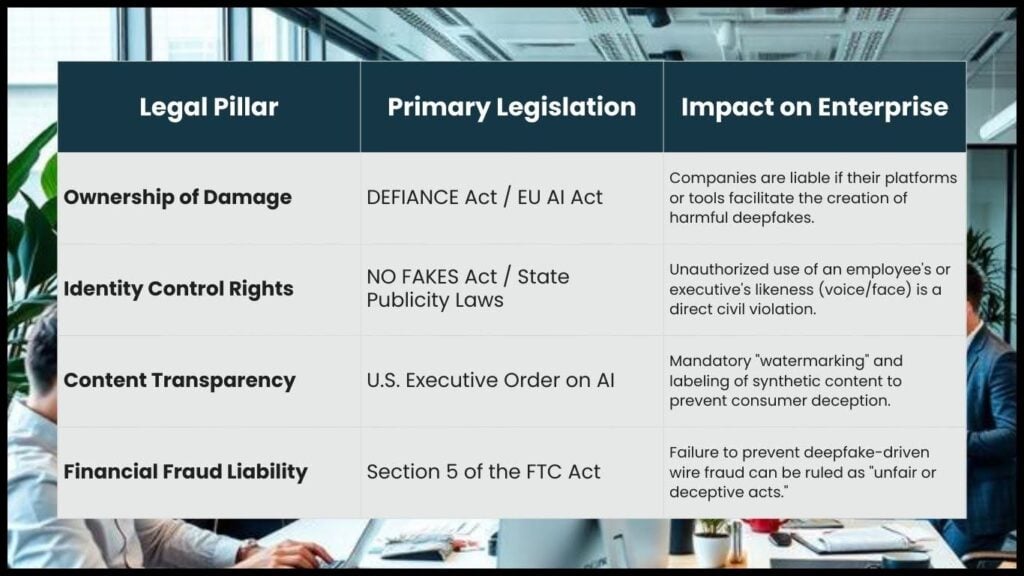

Juridische risico's voor bedrijven

“Dat wist ik niet” is geen geldig juridisch verweer in 2026 (met dank aan nieuwe nepwetgeving).

Als uw bedrijf AI-wetten als “suggesties” behandelt, is een rechtszaak slechts een kwestie van tijd. (Een leuk weetje: het is gewoon een manier om uw advocaten heel erg rijk te maken).

Om je C-suite te behoeden voor een fout van $25 miljoen en om uit de rechtszaal te blijven, is het essentieel om van “Verifiëren” het nieuwe favoriete woord van je bedrijf te maken.

Omdat, realistisch gezien, “Verifiëren” de enige interne controle is die een merk beschermt.

Het zorgt ervoor dat jouw bezittingen niet de ROI van iemand anders worden door de lus van misleiding te doorbreken.

‘Verifiëren’ is geen slagzin, het is een bevel!

De tijd dat vage beloftes en beleefde vragen effectief waren, is voorbij. Nu draait alles om duidelijke juridische ontvangstbewijzen en een zero tolerance beleid voor fouten.

De Uitvoeringsbesluit van de VS inzake AI, Het vraagt niet alleen om goede wil, maar ook om een koud, hard papierspoor en de AI-wetgeving voor vervalsingen voegt alleen maar meer tanden toe aan die verantwoordingsplicht.

Dus als je AI inhuurt en er een hoeksteen van je strategie van maakt, moet je ervoor zorgen dat het een ethische strategie is.

Want als je autonome AI-agent de wet overtreedt, zullen rechtbanken niet de bug de schuld geven, maar degene die hem heeft ingezet, wat betekent dat je onderneming juridisch aansprakelijk is. En dat loopt nooit goed af.

Nieuw tijdperk - Wetgeving wijst verantwoordelijkheid opnieuw toe

“Menselijke fouten kunnen gebeuren en het slachtoffer van een deepfake zou niet aangeklaagd moeten worden.”

Dat zijn de woorden van de nieuwe wet, zoals uitgelicht in het recente nieuws over deepfake-wetgeving, die nu de schijnwerpers richten op bedrog, niet op de bedrogenen.

Ik denk dat de infrastructuur het onderspit delft.

Dus als je onderneming nog steeds weerloos is, is het tijd om de juiste voorzorgsmaatregelen te nemen, want een confrontatie met een rechter die niet gelooft in “oeps” zal zeker zwaar zijn.

Drie kritieke gebieden van juridische blootstelling:

Ondernemingen hebben nu te maken met drie belangrijke juridische verdedigingslinies.

1- Eigendom van schade

De Wet op defiance en opkomende deepfake wetgeving stelt bedrijven duidelijk verantwoordelijk voor de downstream impact van hun technologie. Als jouw platform bijvoorbeeld de creatie van een schadelijke deepfake mogelijk maakt, dan ben jij verantwoordelijk.

2- Rechten voor identiteitscontrole

Veel Amerikaanse staten herdefiniëren wie de eigenaar is van iemands gelijkenis. Identiteit is ongetwijfeld een wettelijk beschermd bezit, maar in dit tijdperk van AI en synthetische media is misbruik niet langer een grijs gebied, het is een directe schending van de wet.

Dus als een bedrijf er niet in slaagt om identiteitsrechten te respecteren, wordt het bedrijf volledig aansprakelijk gesteld.

3-Wettelijke bescherming voor woorden en werken

Als iemand handelsmerkrechten schendt en auteursrechtelijk beschermd materiaal gebruikt zonder licentierechten, overweeg dan civielrechtelijke boetes die landen waar ze het meeste pijn doen - uw winst.

Compliance uitdagingen en vereisten

Er is een dunne lijn tussen wat echt is en wat alleen echt klinkt.

Compliance bestaat om te voorkomen dat die grens verdwijnt - vooral nu het nieuws over deepfake-wetgeving duidelijk maakt hoe snel AI de regels kan omzeilen.

Maar als die grens vervaagt, draagt fraude een vriendelijk gezicht. Om voorop te blijven lopen, activa te beschermen en subtiele leugens te ontdekken, moet je standaard waakzaam zijn.

Maar waarom ziet de compliance ons in de eerste plaats vallen? Omdat de AI leugens zo gladjes kan spinnen dat ze echter aanvoelen dan de waarheid zelf.

Uitdaging 1: Vals “Hallo.”

We worden niet voor de gek gehouden door geavanceerde AI-systemen en code alleen; we worden voor de gek gehouden door manieren.

Het is vrij duidelijk dat de AI-leugens gekleed gaan in de glimlach die men herkent, dus werknemers laten herkenning meestal prevaleren boven rede.

Van een vriendelijke begroeting in een e-mail tot een memo die lijkt op een gewone werkdagnotitie, niemand kan het het personeel kwalijk nemen dat ze niet op hun hoede zijn.

Omdat AI de mogelijkheid heeft om een vriendelijke “Hoi” om te zetten in een hightech overval zonder ooit argwaan te wekken.

Uitdaging 2: Achterstand in regelgeving (oude wetten, nieuwe oorlog)

AI evolueert sneller dan de regels die bedoeld zijn om het te controleren.

Bestaande wetten verifiëren ID's en logins zeker efficiënt, maar overtuigende patronen? Gebrek aan digitale intuïtie en tractie.

Compliance frameworks en zelfs deepfake wetgeving kunnen de snelheid van misleiding niet bijhouden en dit is een enorm risico voor organisaties overal ter wereld.

Omdat bedrijven verantwoordelijk worden gehouden voor risico's loopt de wet achter op de evolutie van AI.

Uitdaging 3: Overbelast menselijk oordeel

Hoe getraind je ook bent, mensen kunnen geen 24/7 perfectie handhaven in een 9-tot-5 brein.

Natuurlijk bestudeert het personeel e-mails, maar als het volume toeneemt, kan een burn-out kleine foutjes laten groeien.

Dus als bedrijven blijven vertrouwen op menselijke waakzaamheid, wordt zelfs één over het hoofd geziene e-mail een toegangspoort voor iets dodelijks, zoals:

- Reputatie ruïneren

- Juridische hoofdpijn

- Grote aansprakelijkheid

Vereiste 1: Gelaagd beveiligingsprotocol

Menselijke en geautomatiseerde validatie moet het volledige spectrum van beveiligingen doorlopen.

Gewone validatie bestaat meestal uit eenvoudige formuliercontroles en basis kruisverwijzingen, waardoor er mazen in de wet blijven die de beveiliging in gevaar kunnen brengen.

Aan de andere kant vereist geavanceerde gelaagde beveiliging controles in meerdere stappen voor elke actie.

Als er bijvoorbeeld een grote overboeking wordt gedaan, worden bij elke stap biometrische, geautomatiseerde en menselijke verificaties uitgevoerd.

Zo glipt er niets ongemerkt doorheen.

Vereiste 2: Cognitief horloge

Wie zegt dat alleen menselijke ogen valse signalen opvangen? De beste manier om synthetische gezichten te herkennen is door een scherpere AI elk signaal te laten scannen.

Dit is waar TruthScan's Realtime AI-detector staat als de ultieme compliance bewaker tegen elke AI misleiding.

Echte compliance is niet episodisch; de real-time AI-detector van TruthScan werkt 24/7 en zorgt ervoor dat fraude nooit een voet aan de grond krijgt.

Het scant e-mails, documenten en chatplatforms om synthetische trucs te ontmaskeren en valse identiteiten direct te ontmaskeren.

Eis 3: Gedragswaarnemer

Vragen stellen zou de standaard moeten zijn.

Als twijfel een beschermende gewoonte wordt, blijven ondernemingen bedrog twee stappen voor.

Wanneer een hooggeplaatste leidinggevende bijvoorbeeld een dringend, vreemd verzoek voor een overboeking stuurt, kan een moment van twijfel miljoenen besparen.

Beste praktijken voor paraatheid van ondernemingen

Voorbereiding is alles-vooral met deepfake wetgeving die verantwoording onvermijdelijk maakt.

De beste verdediging is een team dat voortdurend alert is. In een tijdperk van snelle digitale transformatie en constante cyberbedreigingen kunnen alleen waakzame mensen activa beschermen en bedreigingen neutraliseren.

De verdediging moet onbereikbaar zijn. In 2024 bereikten de kosten van zelfgenoegzaamheid recordhoogten. De $4,88 Miljoen verlies toont de werkelijke kosten van digitale nalatigheid.

Dus “voorbereid” zijn zou moeten betekenen dat er geen zwakke schakel in het zicht is, dat iedereen getraind is en dat elk systeem getest is op fouten.

1- Regelmatige audits en risicobeoordelingen

Als het niet in kaart is gebracht, is het onbewaakt.

Ondernemingen moeten risico's in kaart brengen en elk gat dichten voordat het een krantenkop wordt. Bedrijfstakken waar veel op het spel staat, zoals de financiële sector en de gezondheidszorg, vereisen minstens elk kwartaal een audit, omdat risico's geen pauze nemen.

Dan helpen deze audits bij het identificeren van elke verborgen kwetsbaarheid.

Overal waar je verdediging tekortschiet, kwantificeer je hoe ver je verwijderd bent van ISO- en NIST-standaarden.

Laat het niet bij een audit, maar richt je op het patroon en bestudeer trends die precies laten zien waar je systeem het meest kwetsbaar is.

Rennen “Tafeloefeningen”waar leiderschap boetes en openbaar toezicht simuleert.

2- Een plan voor crisisrespons ontwikkelen

Een plan dat niet wordt uitgevoerd, is slechts papier.

Een echt Crisis Response Plan (CRP) is een stappenplan dat onzekerheid omzet in gecoördineerde acties. Het is als een stapsgewijze verdediging tegen verstoringen.

Je moet bepalen wie wat doet en wanneer het eerste signaal van problemen verschijnt.

Maak de structuur van het Crisis Management Team (CMT) duidelijk.

Maak kant-en-klare sjablonen voor elk communicatiescenario. Bijvoorbeeld, Airbnb's reactie tijdens de COVID-19 reiscrisis veranderde een wereldwijde stilstand in een strategische voorsprong.

Door gebruik te maken van vooraf opgezette ‘Newsrooms’ en resource hubs, zorgden ze ervoor dat elk bericht op het juiste moment kwam en authentiek was. Dit hield belanghebbenden rustig, zelfs toen de wereld veranderde.

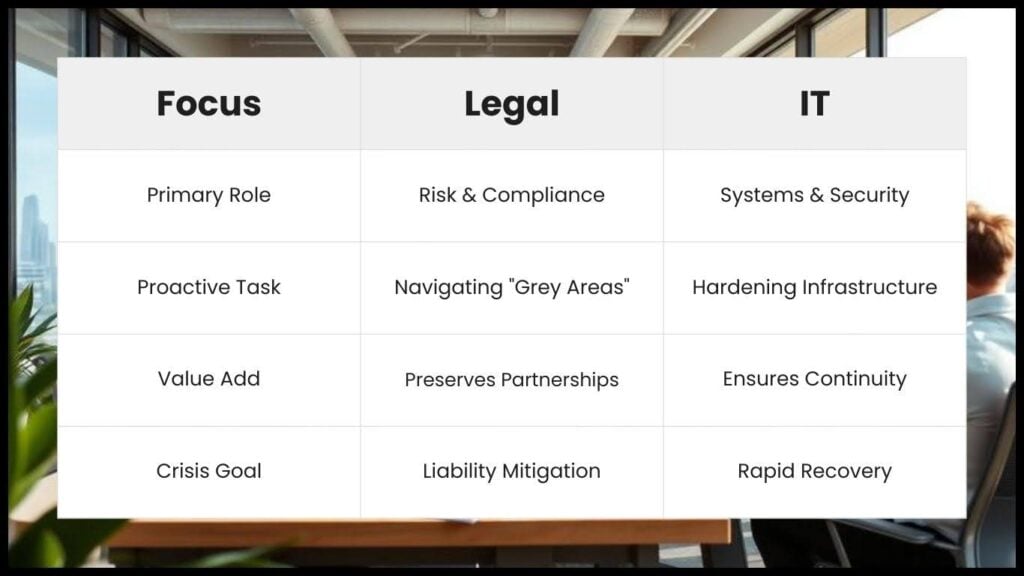

3- Proactieve samenwerking met juridische en IT-teams

Het isoleren van de afdelingen doet je bedrijf alleen maar pijn.

Legal en IT zijn onlosmakelijk met elkaar verbonden. In een crisis moeten deze twee afdelingen als één optreden, volledig op één lijn om de risico's aan te pakken die zijn gesignaleerd onder de 'deepfake'-wetgeving.

Juridisch als zakelijk brein

Juridische teams moeten worden betrokken bij elke beslissing, zodat uw bedrijf nooit op het verkeerde been wordt gezet.

Rechtsexperts laten uw leiderschap zien waar elk juridisch grijs gebied relaties met klanten en partners kan kosten.

IT als ruggengraat

IT is meer dan alleen “technische ondersteuning”, het is de bewaker van de operationele continuïteit. Hoe meer ze scannen, hoe minder fraude een weg naar binnen vindt.

Proactieve samenwerking maakt compliance en efficiëntie partners, wat betekent dat geen enkele digitale aanval de activiteiten verstoort.

Voorkomen is beter dan....Cure

De tijd bevestigt het gezegde.

De kosten om een crisis te voorkomen zijn slechts een fractie van wat het kost om de nasleep op te ruimen. De prijs van herstel is altijd veel hoger en hoger dan welk budget dan ook kan dragen.

1- Actieve verdediging

Kwetsbaarheden moeten worden aangepakt voordat de schade escaleert. Of het nu gaat om de toeleveringsketen, cyberbeveiliging of gegevensintegriteit, repareren voordat het fout gaat is de slimste strategie.

2- Financiering en toewijzing van krachten

Vooruitstrevende organisaties geven de voorkeur aan beveiliging boven het betalen van meer geld voor het oplossen van crises die door voorbereiding kunnen worden voorkomen.

Maersk, de wereldwijde scheepvaartgigant, leed bijvoorbeeld onder een $300 miljoen verlies in 2017 als gevolg van één systeeminbreuk.

Later gaf het bedrijf miljoenen uit om duizenden machines, waaronder 4.000 servers en 45.000 pc's, in slechts tien dagen opnieuw te installeren om te voorkomen dat hun toeleveringsketen in chaos zou vervallen.

Eindgedachten

Een goed voorbereid bedrijf is de enige manier om de volgende AI-gestuurde misleiding twee stappen voor te blijven.

Naarmate deepfake technologie vervaagt wat echt is en wat nep, overleven alleen degenen die voorbereid zijn. Het naleven van deepfake wetgeving zoals de EU AI Act of de U.S. Executive Order on AI is niet slechts een formaliteit, het is je verdediging tegen manipulatie.

Door geloofwaardige realtime AI-detectietools, videodetectoren, Door voorzichtigheid en voortdurende training van medewerkers wordt voorzichtigheid het ultieme schild tegen misleiding.