In de jaren 90 was het DNA.

In de jaren 2000 waren het pings van mobiele torens.

Maar in 2026 is de nieuwe gouden standaard van bewijs de digitale vingerafdruk.

Bekijk het zo...

Elk videobestand heeft een unieke handtekening.

Als zelfs maar één pixel door AI wordt gewijzigd, verandert die vingerafdruk onmiddellijk.

Als je AI-bewijs geen geverifieerde blockchain-tijdstempel heeft om die vingerafdruk vast te zetten, kan het in de ogen van een moderne rechter net zo goed een tekenfilm zijn.

Dit betekent dus dat het tijdperk van “zien is geloven” voorbij is.

We zijn het tijdperk van AI-videoverificatie binnengetreden, waar bewijs niet wordt gevonden in wat je ziet, maar in de digitale code die onder het oppervlak verborgen zit.

In deze blog onderzoeken we waarom traditioneel bewijs faalt in de strijd tegen videofraude, hoe je gemanipuleerde clips kunt herkennen, waarom verificatie cruciaal is voor ontvankelijkheid en waarom een AI-videodetector zoals TruthScan nu essentieel is voor juridische teams.

Laten we erin duiken.

Belangrijkste opmerkingen

- In 2026 moet al het videobewijs een AI-videoverificatie ondergaan om als betrouwbaar te worden beschouwd.

- Videofraude omvat kleine bewerkingen zoals tijdstempelmanipulatie, niet alleen volledige face-swaps.

- Een professionele deepfake detector is de enige manier om GAN-artefacten op te sporen die mensen missen.

- Nieuwe regels zoals Federal Rule 707 standaardiseren hoe AI-bewijs wordt toegelaten in de rechtszaal.

- Dankzij geautomatiseerde bewijsanalyse kunnen bedrijven enorme pakketten met bewijsmateriaal snel en nauwkeurig verwerken.

- TruthScan voorkomt fraude tijdens live hoorzittingen door synthetische maskers in realtime te detecteren.

Wat is videobewijs in juridische geschillen?

Videobewijs is in principe elk opgenomen filmpje dat in de rechtszaal wordt gebruikt om te bewijzen wat er is gebeurd. Van strafzaken tot verzekeringsschikkingen, het is overal.

Maar in 2026 heeft de opkomst van videofraude ervoor gezorgd dat “zien is geloven” een gevaarlijke aanname is geworden. Juridische professionals hebben nu robuuste AI-videoverificatie nodig om de integriteit van het rechtssysteem te waarborgen.

Soorten videobewijs die rechtbanken dagelijks gebruiken

Maak je nooit meer zorgen over AI-fraude. TruthScan Kan je helpen:

- AI-opgewekt detecteren afbeeldingen, tekst, spraak en video.

- Vermijd grote AI-gestuurde fraude.

- Bescherm uw meest gevoelig bedrijfsmiddelen.

- Bewaking (CCTV): Camera's van winkels of verkeerslichten. Dit is het meest voorkomende bewijs in strafzaken.

- Bodycams: Beelden van politieagenten, meestal gebruikt in zaken over burgerrechten of buitensporig geweld.

- Dashcams: Het aangewezen bewijs voor auto-ongelukken en verzekeringsgevechten.

- Opgenomen getuigenissen: Videoverslagen of getuigenverklaringen op afstand zijn normaal geworden sinds de pandemie. Nu een standaard, maar vatbaar voor juridische fraudedetectie-uitdagingen.

- Smartphone & sociale media: Video's van omstanders of berichten die iemands gedrag of locatie bewijzen.

- Bedrijfsbeveiliging: Beeldmateriaal gebruikt door bedrijven voor fraude of “onrechtmatig ontslag”.

Generatieve AI en deepfake technologie hebben een nieuwe risicolaag toegevoegd. In 2025:

- 1 op de 20 identiteitsverificaties werd gefopt door AI deepfakes

- Een Medius-onderzoek rapporteerde dat 43% van professionals was slachtoffer van een poging tot deepfake-fraude

Praktijkgevallen van videobewijsfraude

- Gemanipuleerde fragmenten uit de rechtszaal

Gemanipuleerde rechtbankfragmenten verwijzen naar video- of audiobewijsmateriaal dat in een rechtszaak is ingediend en dat is gewijzigd, bewerkt of volledig gefabriceerd met behulp van technologie.

Voorbeelden:

- Alameda county deepfake zaak (2025): Een civiele zaak in Californië werd verworpen nadat de rechtbank ontdekte dat een video van een getuige die als bewijs was ingediend, volledig was gemaakt met behulp van AI.

- De Sz Huang v. Tesla deepfake verdediging (2023): In een rechtszaak over een onrechtmatige dood beweerden de advocaten van Tesla dat belangrijke beelden van de crash wel eens deepfakes zouden kunnen zijn.

Gewijzigde bewakingsvideo's

Bewakingsvideo is een van de meest gebruikte soorten AI-bewijs in de rechtszaal. Veel mensen denken echter ten onrechte dat manipulatie alleen volledige deepfakes zijn.

In werkelijkheid gebeurt videofraude vaak op kleinere, minder voor de hand liggende manieren die een zaak in gevaar kunnen brengen.

Veel voorkomende soorten manipulatie zijn:

- Tijdstempelwijzigingen

- Frame verwijderen

- Metagegevens of GPS-wijzigingen

- Gezicht vervangen

- Objecten verwijderen of inbrengen

- Lopend beeldmateriaal

- Kwaliteitsvermindering

Bewakingsvideo's zijn vaak afkomstig van veel verschillende plaatsen, zoals privéwinkels, deurbellen thuis, parkeerplaatsen en stadscamera's. In tegenstelling tot bodycamera's van de politie, volgen deze systemen meestal geen strikte chain-of-custody regels. In tegenstelling tot camerabeelden van de politie, volgen deze systemen meestal geen strikte chain-of-custody regels.

Dat betekent:

- Het is mogelijk dat niet duidelijk is wie het dossier heeft behandeld.

- Het beeldmateriaal mag meerdere keren gekopieerd, overgedragen of geconverteerd worden.

- Authenticatieprocedures kunnen zwak of inconsistent zijn.

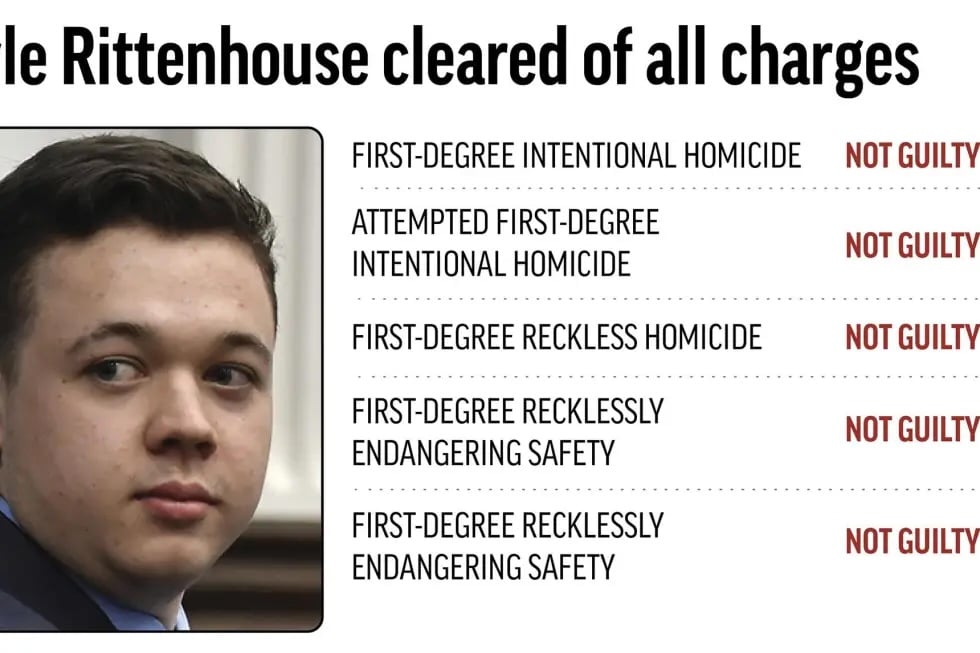

Voorbeeld: De kwestie Wisconsin tegen Rittenhouse AI-verhoging

Een beroemd voorbeeld kwam uit de zaak Wisconsin tegen Rittenhouse. De aanklager probeerde de knijp-naar-zoom functie van een iPad te gebruiken om details in een dronevideo te laten zien.

De verdediging voerde aan dat Apple's zoom AI-interpolatie gebruikt om te raden wat er zou moeten zijn. De rechter oordeelde dat zonder een professionele AI-videodetector de verbeterde beelden niet konden worden toegelaten.

Betwiste video getuigenissen

Een betwiste videogetuigenis vereist meestal wettelijke fraudedetectie om vast te stellen of een opname echt is:

- Een volledig verzonnen verklaring

- Een echte getuigenis betwist als nep

- Een gemanipuleerde echte opname

Elk scenario creëert een ernstige authenticatielast voor de rechtbank.

Voorbeeld: De Britse voogdijzaak

In een Brits familierechtelijk geschil, aangehaald door de University of Baltimore Law Review, diende een moeder een zwaar veranderde opname in om de vader als gewelddadig af te schilderen tijdens een voogdijgevecht.

Het doel was om zijn toegang tot zijn kinderen te beperken.

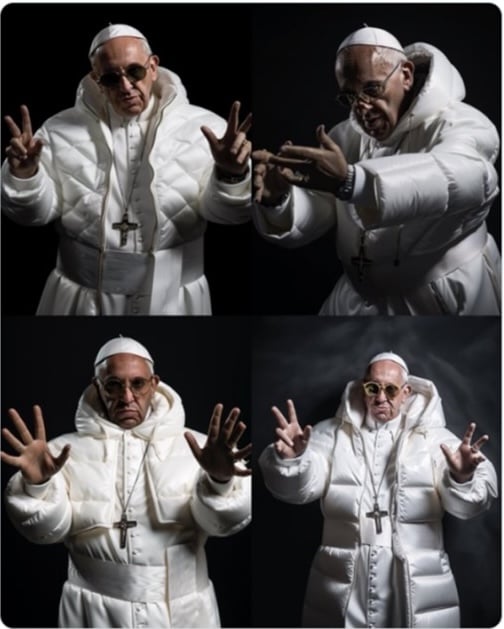

Opkomst van AI-gegenereerde video in juridische zaken

De reis naar het huidige tijdperk van de deepfake detector verliep in verschillende fasen:

- De vroege waarschuwingsjaren (2017-2021)

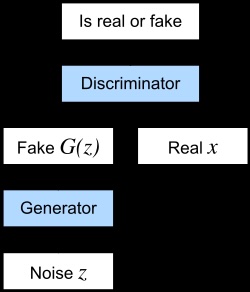

Deepfake-technologie (aangedreven door generative adversarial networks (GAN's)) kwam rond 2017 in de openbaarheid.

Vroege deepfakes waren vaak van lage kwaliteit: gezichten met rare vervormingen, extra vingers, verkeerde belichting en wazige kenmerken waardoor ze makkelijk te herkennen waren.

- De escalatiefase (2022-2023)

Tegen 2022 verbeterde de technologie. Velen waren gratis en bruikbaar op een smartphone.

In 2023 zagen we enkele van de eerste significante deepfake-gerelateerde uitdagingen in rechtszaken, waaronder Sz Huang v. Tesla, United States v. Reffitt, en United States v. Doolin, waarin raadslieden vragen stelden over de vraag of videobewijs mogelijk AI-gegenereerd is.

Rond dezelfde tijd begon het Adviescomité voor Bewijsregels van de American Bar Association formeel de kwestie te bestuderen.

- De kritieke drempel (2024-2025)

AI-gegenereerde inhoud bleef niet lang academisch. In 2024 was er een incident met een ingenieursbureau Arup, waarbij een door AI gegenereerd nepvideogesprek frauduleus werd geautoriseerd. overboekingen voor een totaalbedrag van $25 miljoen.

Het rechtssysteem begon te reageren.

In 2025, Louisiana heeft HB 178 goedgekeurd, Het creëren van het eerste toetsingskader voor AI-bewijs op staatsniveau.

Op federaal niveau stelde het Amerikaanse adviescomité voor de bewijsregels het volgende voor Regel 707, gericht op machinaal gegenereerd bewijs.

Hoe de zaken ervoor staan in 2026

Vanaf begin 2026 is de regulering van deepfake en AI-video landelijk in een stroomversnelling gekomen:

- 46 staten hebben een vorm van deepfake-wetgeving aangenomen.

- Sinds 2022, Er zijn 169 wetten aangenomen en alleen al in 2025 werden 146 wetsvoorstellen ingediend..

- Federal Rule 707 staat open voor publiek commentaar tot 16 februari 2026.

Video verificatie verbeteren met AI

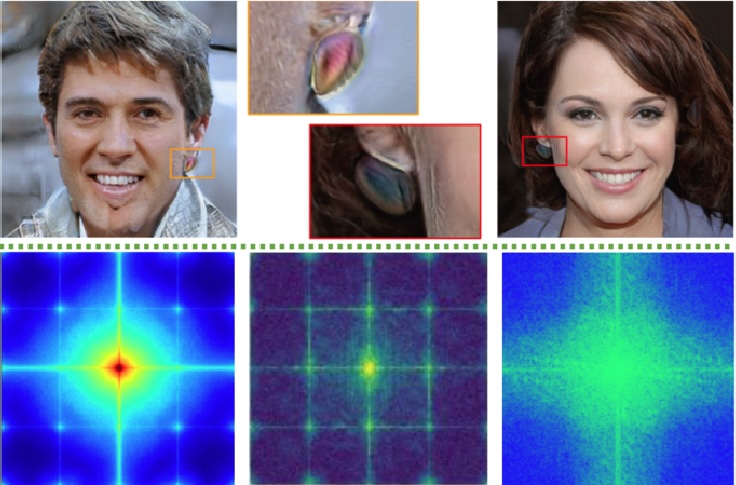

De meest effectieve manier om AI-gegenereerde video te detecteren is door AI zelf te gebruiken.

Dit komt doordat deepfakes worden gemaakt door machine-leersystemen die subtiele digitale patronen achterlaten.

Deze patronen zijn te klein of complex voor het menselijk oog om op te merken. Maar andere algoritmen kunnen ze wel detecteren.

Een betrouwbaar AI-videoverificatiesysteem kan meerdere lagen van een video tegelijk analyseren, waaronder:

- Analyse op frameniveau controleert elk frame op visuele fouten zoals vreemde texturen, belichtingsfouten of overvloeiproblemen rond gezichten.

- Temporele coherentieanalyse kijkt naar beweging over frames heen om onnatuurlijke sprongen of inconsistente bewegingen te vinden.

- Gezichtskenmerk volgen houdt oogbewegingen, knipperen en gezichtsvorm in de gaten om onnatuurlijke veranderingen te detecteren.

- Testen van audiovisuele synchronisatie controleert of de lipbewegingen precies overeenkomen met de gesproken woorden.

- Forensisch audioonderzoek analyseert de stem op tekenen van klonen, zoals ongebruikelijke geluidspatronen of robotachtige tonen.

- Analyse van metadata en compressie Het onderzoeken van verborgen bestandsgegevens is van vitaal belang voor het opsporen van legale fraude om te zien of deze overeenkomen met de oorspronkelijke opnamegegevens.

Juridische teams informeren over videofraude

Omdat AI nu met angstaanjagende nauwkeurigheid menselijk gedrag kan nabootsen, gebruiken advocatenkantoren geautomatiseerde bewijsanalyse en een mix van traditionele tactieken om voorop te blijven lopen.

| Categorie | Methode | Beschrijving |

| Officiële manieren | CLE (Voortgezette Juridische Opleiding) Studiepunten | Verplichte of keuzecursussen die advocaten leren hoe ze digitaal bewijs kunnen verifiëren, deepfakes kunnen begrijpen en aan bewijsnormen kunnen voldoen. |

| Door de rechtbank benoemde AI-deskundigen | Het instellen van gecertificeerde AI-forensische specialisten, vergelijkbaar met DNA-deskundigen, om betwist videomateriaal in de rechtszaal te evalueren. | |

| Niet-officiële manieren | Intern Red-Teaming | Professionals op het gebied van cyberbeveiliging inhuren om te testen of vals of gemanipuleerd bewijsmateriaal door de inname-systemen van bedrijven kan glippen. |

| “Protocol ”Vibe Check | Medewerkers trainen om veelvoorkomende waarschuwingssignalen van deepfakes te herkennen, zoals onnatuurlijk knipperen, vervormde gelaatstrekken of lipsync-problemen, voordat ze worden doorverwezen naar een forensisch onderzoek. |

Hulpmiddelen en technologie voor bewijsvalidatie

In 2026 zijn we verder gegaan dan eenvoudige inspectie met de ogen open.

Omdat AI nu in staat is om zelfs de meest doorgewinterde onderzoekers voor de gek te houden, gebruiken juridische teams een specifieke set tools om te controleren of wat ze zien de absolute waarheid is.

De technologie achter bewijsvalidatie

- Deepfake detectoren: Dit zijn gespecialiseerde softwareprogramma's die scannen op GAN artefacten. Dit zijn microscopische, wiskundige patronen of ruis die zijn achtergelaten door de AI-modellen die synthetische gezichten genereren. Terwijl een mens een gezicht ziet, ziet de detector een digitale handtekening die er niet hoort.

- TruthScan is een deepfake detector die video's frame voor frame scant op AI-tekens, zoals ongewoon knipperen, vreemde gezichtsvormen of pixelfouten waarbij een nepgezicht is toegevoegd.

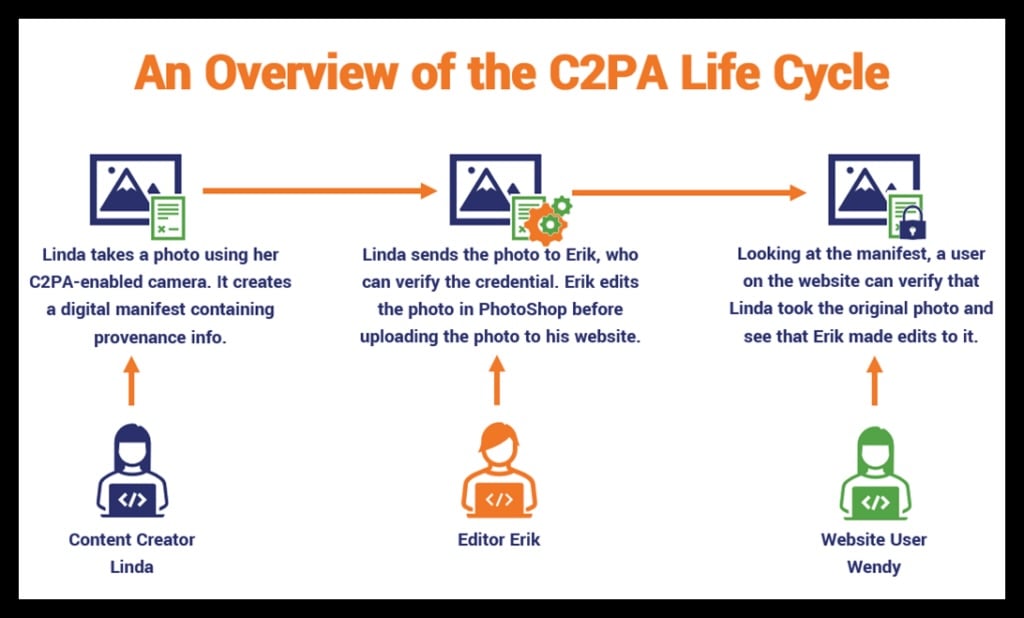

- Blockchain Tijdstempels: Om te bewijzen dat een video niet is aangeraakt sinds het moment dat deze is opgenomen, gebruiken veel instanties nu de C2PA-standaard. Wanneer een video wordt opgenomen op een apparaat dat hieraan voldoet, wordt een unieke digitale vingerafdruk (hash) gemaakt en opgeslagen op een blockchain.

- TruthScan kan controleren of deze vingerafdruk overeenkomt met de video, zodat duidelijk wordt of het bestand is bewerkt of dat de bewakingsketen is verbroken.

- Hulpmiddelen voor metadata forensisch onderzoek: Elk digitaal bestand heeft een geboorteakte die Exif-gegevens worden genoemd. Deze tools controleren of een bestand opnieuw is opgeslagen in AI-bewerkingssoftware of dat de locatiegegevens (GPS) zijn vervalst. Als een video beweert afkomstig te zijn van een winkelcamera, maar de metadata laten zien dat het geëxporteerd is vanuit een videobewerkingsprogramma, dan heb je een probleem.

- Amped Software en TruthScan onderzoeken verborgen bestandsgegevens (Exif, headers) om te zien of de video bewerkt of AI-verwerkt is.

Trends in AI-videobewijs

Dit zijn de drie trends van 2026.

- Generatief contradictoir forensisch onderzoek: AI vs. AI

De meest geavanceerde manier om een deepfake in 2026 te vangen, is door dezelfde technologie te gebruiken die de deepfake heeft gecreëerd. Dit staat bekend als Generative Adversarial Forensics.

- Eén AI (de generator) probeert een vervalsing te creëren, terwijl een andere AI (de discriminator) deze probeert te vangen. In de rechtszaal kunnen tools zoals TruthScan de ultieme discriminator zijn.

- Voorbeeld: Een eiser dient een video in van een CEO die een mondeling contract maakt. TruthScan scant de video met zijn eigen tegenstrijdige modellen om GAN-artefacten te detecteren. Als de software een 98% synthetische waarschijnlijkheid markeert, is het bewijs waarschijnlijk een vervalsing om menselijke ogen te misleiden.

- Audio-Video Sync Analyse (De 0,01ms Regel)

Mensen kunnen een vertraging meestal herkennen als de audio van een video 40-80 milliseconden afwijkt. Echter, 2026 deepfakes zijn vaak bijna perfect.

- Moderne forensische AI-tools zoeken nu naar een vertraging van 0,01 milliseconde tussen de fonetische klank van een woord en de mechanische beweging van de lippen.

- Voorbeeld: In een intimidatiezaak uit 2026 beweerde een beklaagde dat een video vervalst was. Forensische geautomatiseerde bewijsanalyse toonde aan dat de lipvormen van de “M” en “B” 0,02 ms niet synchroon liepen met de audio. Deze microscopische fout bewijst dat de stem was gekloond en over een andere video was gelaagd, wat leidde tot ontslag van rechtsvervolging.

- Cheapfakes vs. Deepfakes

Terwijl deepfakes gebruikmaken van geavanceerde AI, zijn cheapfakes de meest voorkomende vorm van videofraude.

- Een Deepfake creëert een werkelijkheid die nooit heeft plaatsgevonden (zoals een face-swap). Een Cheapfake neemt echt beeldmateriaal en verandert de context of bedoeling met behulp van eenvoudige tools.

- Voorbeeld (De vertraging): Een video van een politicus die dronken of dronken lijkt, kan eenvoudig worden gemaakt door de beelden te vertragen met 20% en de toonhoogte van het geluid aan te passen.

- Voorbeeld (De Re-Context): Beelden van een protest in 2022 in een ander land worden in 2026 gepost als live bewijs van een lokale rel. Juridische teams gebruiken nu de metadata-analyse van TruthScan om de werkelijke geboortedatum van de video te bewijzen.

Hoe TruthScan wettelijk videomateriaal beschermt

TruthScan zorgt ervoor dat elk frame dat je in de rechtszaal presenteert authentiek, geverifieerd en juridisch verdedigbaar is.

Het platform stroomlijnt AI-videoverificatie door middel van de volgende voordelen:

Geautomatiseerde controlelogboeken en Chain-of-Custody-documentatie

- Betrouwbaarheid voor de rechtbank: Genereert PDF- en JSON-rapporten die elke verificatiestap documenteren met nauwkeurige betrouwbaarheidsscores en tijdstempels.

- Hoogwaardige naleving: Wees gerust in de wetenschap dat je gegevens veilig blijven en voldoen aan strenge wereldwijde normen zoals SOC 2, ISO 27001 en GDPR.

- Flexibele gegevenscontrole: Houd gevoelig bewijs binnen uw vereiste jurisdictie met on-premise of VPC implementatie-opties die zijn ontworpen voor sterk gereguleerde industrieën.

Batchverwerking en API-integratie voor juridische workflows

- Enorme tijdsbesparing: Verwerk duizenden bestanden van ontdekkingspakketten of bewakingssets tegelijk met behulp van bulkopslagimport (S3/GCS).

- Naadloze E-Discovery: Stroomlijn je activiteiten door verificatie direct in je bestaande software te integreren via webhooks en API's.

- Geen handmatige fouten meer: Automatiseer de eerste screening van bewijsmateriaal, zodat je team zich kan richten op de strategie in plaats van op het saaie controleren van bestanden.

Realtime verificatie voor getuigenverklaringen en hoorzittingen op afstand

- Stop imitatie: Gebruik live streaming endpoints om te detecteren of een getuige deepfake filters of stemklonen gebruikt tijdens een hoorzitting op afstand.

- Behoud de integriteit van de rechtbank: Visuele of audio-afwijkingen in realtime markeren, zodat frauduleuze getuigenissen niet worden opgenomen.

- Gemoedsrust: Voorzie uw klanten en de rechtbank van een extra beveiligingslaag die garandeert dat de persoon op het scherm precies is wie hij beweert te zijn.

Meer informatie over het beveiligen van AI-videobewijs

Bescherm uw bedrijf tegen de risico's van gemanipuleerde media. De deepfake detector en AI-videodetectortechnologie van TruthScan bieden de ultieme oplossing voor e-discovery en juridische verificatie.

Klaar om TruthScan in actie te zien?

- Bezoek waarheidscan.nl om gratis 20.000 credits te krijgen.

- Neem voor vragen over bedrijven, API-integratie of aangepaste implementatieopties contact op met hun team op Waarheidsscan.nl/contact.