Inleiding

Generatieve AI zorgt voor een revolutie in de gezondheidszorg - en niet altijd ten goede. In 2025 is fraude in de gezondheidszorg digitaler en geavanceerder, aangewakkerd door datalekken, automatisering en generatieve AI[1]. Criminelen gebruiken AI-tools om Valse patiëntidentiteiten, synthetische verzekeringsclaims, door AI gegenereerde medische documenten, vervalste recepten en zelfs vervalste interacties tussen arts en patiënt.. Deze hightech misleidingen tillen fraude naar nieuwe hoogten en bedreigen de financiën van verzekeraars en de veiligheid van patiënten wereldwijd. De uitdaging is enorm: fraude in de gezondheidszorg kost nu al tientallen miljarden per jaar, en de opkomst van AI is intensivering van zowel de schaal als de complexiteit van oplichting[2][3]. Deze whitepaper biedt een gedetailleerde blik op de nieuwste AI-gedreven fraudetrends in de gezondheidszorg, praktijkgevallen uit 2025 en strategieën - van AI-contentdetectoren tot identiteitsverificatie - om deze evoluerende bedreiging te bestrijden.

De opkomst van AI-gestuurde fraude in de gezondheidszorg

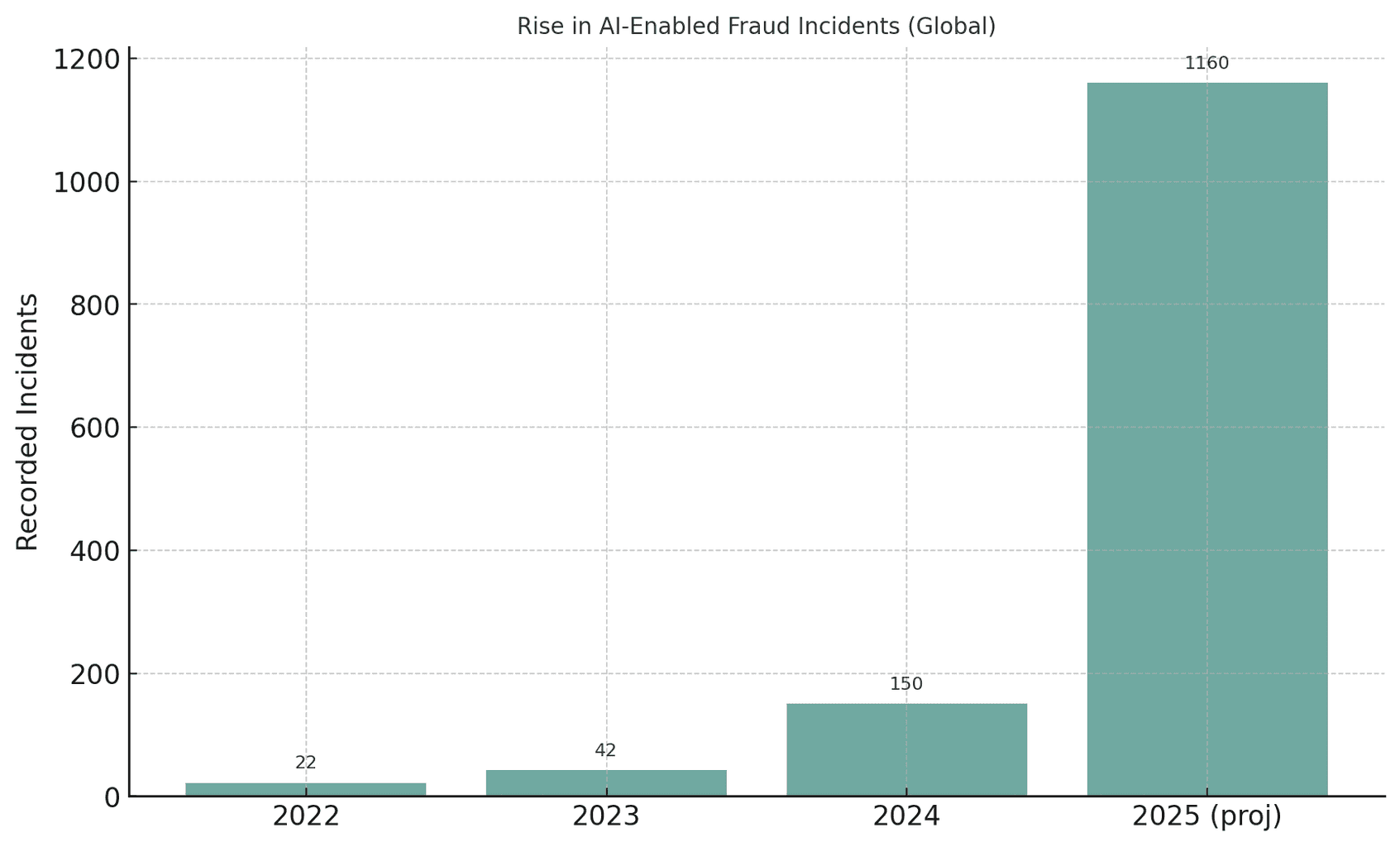

De wereldwijde gezondheidszorgsector maakt een Ongekende piek in pogingen tot AI-fraude. Naarmate generatieve AI toegankelijker wordt, kunnen fraudeurs oplichtingspraktijken automatiseren die vroeger handmatig werden uitgevoerd, door op grote schaal overtuigende valse identiteiten, documenten en zelfs stemmen of video's te produceren. Autoriteiten merkten bijvoorbeeld op dat pogingen tot fraude met deepfake media steeg met 3.000% in 2023 alleen[4][5]. Deepfake-gerelateerde incidenten verdubbelden bijna van 22 in 2022 naar 42 in 2023, en explodeerden vervolgens naar 150 incidenten in 2024; verbazingwekkend genoeg waren er in het eerste kwartaal van 2025 179 gevallen van deepfake-fraude - waarmee het totaal voor 2024 al werd overtroffen.[6][7]. Deze trend suggereert een explosieve groei in AI-gestuurde fraudeAnalisten voorspellen dat generatieve AI de fraudeverliezen zou kunnen opdrijven van $12,3 miljard in 2023 tot $40 miljard in 2027 (32% CAGR)[8].

Figuur: De explosieve groei van AI-ondersteunde fraude-incidenten in de afgelopen jaren. Het aantal gedetecteerde gevallen van deepfake of AI-ondersteunde fraude is tussen 2022 en 2025 drastisch gestegen, wat illustreert hoe generatieve AI-tools de pogingen tot oplichting hebben opgedreven.[4][7].

Maak je nooit meer zorgen over AI-fraude. TruthScan Kan je helpen:

- AI-opgewekt detecteren afbeeldingen, tekst, spraak en video.

- Vermijd grote AI-gestuurde fraude.

- Bescherm uw meest gevoelig bedrijfsmiddelen.

De gezondheidszorg is bijzonder kwetsbaar voor deze AI-gestuurde misdaadgolf. Het enorme, gefragmenteerde ecosysteem van de sector - ziekenhuizen, klinieken, verzekeraars, apotheken en telegezondheidszorgplatforms - biedt duizenden aanvalspunten[9][10]. Traditionele zwendelpraktijken (bijv. valse verzekeringspasjes of gestolen patiënt ID's) hebben evolueerde naar systemische uitbuiting AI gebruiken[10][11]. Bij een Amerikaanse inbeslagname in 2025 klaagde het Ministerie van Justitie 324 verdachten aan in regelingen voor in totaal $14,6 miljard in valse declaraties - de grootste fraudezaak in de gezondheidszorg ooit[12][13]. Veel oplichters hadden te maken met telegeneeskundige consulten en fraude met genetische tests, en een nieuwe DOJ Fraudegegevenscentrum gezondheidszorg AI-analyse gebruikt om proactief patronen te detecteren[14][15]. Het is duidelijk dat AI een tweesnijdend zwaard is: het helpt onderzoekers bij het opsporen van fraude, maar ook stelt criminelen in staat om fraude te plegen op een ongekende schaal en met een ongekend raffinement[11][2].

Veelvoorkomende AI-gestuurde fraudetechnieken in de gezondheidszorg (2025)

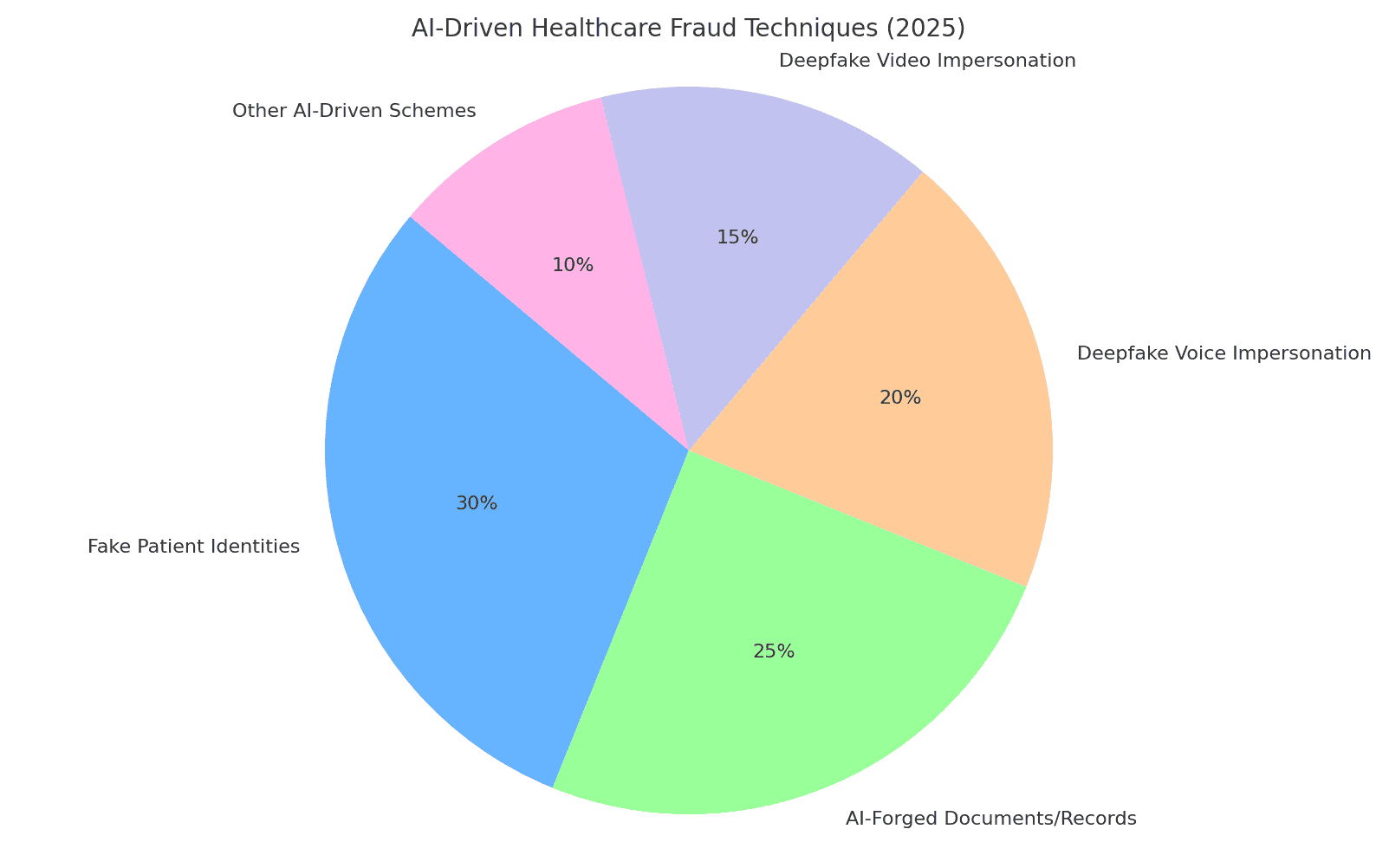

Fraudeurs in 2025 hebben een gereedschapskist met AI-tactieken om zorgstelsels en verzekeraars op te lichten. De belangrijkste trucs zijn het vervalsen van identiteiten en documenten, het genereren van valse medische gegevens en het zich voordoen als vertrouwd personeel via deepfakes. Hieronder geven we een overzicht van de meest voorkomende AI-gestuurde fraudetechnieken en hoe ze worden gebruikt tegen organisaties in de gezondheidszorg:

Figuur: Uitsplitsing van de belangrijkste AI-gedreven fraudetechnieken in de gezondheidszorg in 2025. Valse patiëntidentiteiten en AI-vervalste documenten (bijv. medische dossiers, claims) een groot deel van de regelingen uitmaken, terwijl deepfake stem en video-imitaties vormen een snelgroeiende bedreiging. "Andere AI-gestuurde programma's' omvatten met AI gemaakte phishing-e-mails, bots die patiëntportalen aanvallen en soortgelijke exploits (geschatte percentages op basis van rapporten uit de sector[8][16]).

Synthetische patiëntidentiteiten

Valse patiëntidentiteiten - vaak gecreëerd met behulp van AI - zijn een fundamentele fraudetactiek. In plaats van de identiteit van één persoon te stelen, combineren criminelen echte gegevens van meerdere mensen met verzonnen details om zo synthetische identiteiten die doorgaan als nieuwe patiënten[17][18]. Generatieve AI versnelt dit door realistische persoonlijke gegevens te produceren. AI kan bijvoorbeeld plausibele ID's, profielen, zelfs familiegeschiedenissen ("synthetische ouders") voor een neppatiënt[19][20]. Deze fantoompatiënten worden vervolgens gebruikt om rekeningen te openen, verzekeringspolissen af te sluiten of diensten te factureren die nooit heeft plaatsgevonden. Tijdens de COVID-19 pandemie gebruikten fraudeurs synthetische ID's om gezondheidsuitkeringen af te troggelen. valse verzekeringsclaims indienen of recepten krijgenwetende dat een goed ontworpen identiteit detectie kan ontwijken[21][22]. Volgens de U.S. Federal Reserve bedroegen de verliezen door synthetische identiteitsfraude $35 miljard in 2023 en blijven stijgen[23]. De gevolgen voor de gezondheidszorg zijn ernstig: oplichters kunnen het gestolen burgerservicenummer van een kind gebruiken om een valse patiënt met een perfect krediet te creëren, of gestolen patiëntgegevens combineren om de verificatie door verzekeraars te omzeilen.[17][24]. Elke synthetische patiënt die in het systeem wordt geïntroduceerd ondermijnt de integriteit van gegevens en kan leiden tot onterechte uitbetalingen of zelfs klinische fouten als de valse identiteit verstrengeld raakt met echte medische dossiers.

AI-gegenereerde medische documenten en verzekeringsclaims

Generatieve AI wordt nu gebruikt om medische documenten, dossiers en volledige verzekeringsclaims. Taalmodellen kunnen authentiek ogende doktersnota's, ontslagoverzichten, labresultaten of factureringsoverzichten vol medisch jargon produceren - allemaal op maat gemaakt om een frauduleuze claim te ondersteunen. Waarnemers uit de sector melden zelfs een 89% toename van door AI gegenereerde medische documenten worden ingediend, vergeleken met voorgaande jaren[25][26]. Oplichters gebruiken deze valse dossiers om dure procedures of medicijnen te rechtvaardigen die nooit zijn verstrekt, of om vergoedingscodes op te blazen. Een AI zou bijvoorbeeld een valse diagnostisch beeldvormingsrapport of labresultaat om een hoge kostenclaim voor oncologische geneesmiddelen te onderbouwen. Verzekeraars en zorgstelsels worden geconfronteerd met een stroom van dergelijke synthetisch papierwerkwaardoor het moeilijker wordt om legitieme claims van nepclaims te onderscheiden. In het Verenigd Koninkrijk merken verzekeraars een snel toenemend gebruik van deepfakes en vervalste documenten bij fraude met claimsvaak in schijnbaar routinematige claims van lage waarde om onderzoek te vermijden[27]. Zelfs klinische beelden zijn niet immuun - er is bewijs dat Fraudeurs gebruiken generatieve AI om medische beelden na te bootsen zoals röntgenstralen of scans[3]. De gevolgen gaan verder dan financieel verlies: als vervalste medische dossiers in patiëntendossiers terechtkomen, kunnen ze leiden tot verkeerde diagnoses of onjuiste behandelingen. Dus, Met AI geschreven gezondheidsdocumenten vormen een ernstig integriteits- en veiligheidsrisico.

Valse recepten en apotheekfraude

Fraude op recept is met AI het digitale tijdperk binnengetreden. Vervalste recepten - die van oudsher werden gemaakt met gestolen receptenblokjes of rudimentaire bewerkingen - kunnen nu automatisch worden gegenereerd met realistische details en handtekeningen van artsen. AI-afbeeldingsgeneratoren of -sjablonen maken het triviaal om Authentiek ogende afdrukken van elektronische recepten of bestelformulieren van apotheken. Nog verraderlijker is dat criminelen stem klonen om zich voor te doen als artsen in gesprekken met apothekers. In één gerapporteerde trend hackten oplichters medische dossiers om de DEA-registratienummers van artsen te stelen en gebruikten vervolgens deze gegevens om elektronische recepten voor gereguleerde stoffen te versturen.[28]. Er zijn gevallen bekend van AI-stem vervalsingen gebruikt om vullingen te autoriseren - krijgt een apotheker een telefoontje dat precies klinkt als een bekende arts die een recept bevestigt, maar in werkelijkheid is het een door AI gegenereerde stem. Hierdoor kunnen gecontroleerde medicijnen (zoals opioïden of stimulerende middelen) illegaal worden verkregen en omgeleid. Fraude met vervalste recepten veroorzaakt niet alleen financieel verlies voor verzekeraars en apotheken; het brengt ook patiënten in gevaar, die mogelijk onjuiste medicijnen in hun dossier krijgen. Als een fraudeur zich bijvoorbeeld voordoet als een patiënt om opioïde recepten te krijgen, kan de het medisch dossier van een echte patiënt kan worden bijgewerkt met geneesmiddelen die hij nooit heeft gebruikt, wat leidt tot gevaarlijke interacties of waardoor hij wordt gemarkeerd als een patiënt die op zoek is naar geneesmiddelen[29]. Deze mix van cybercriminaliteit en AI-exploitatie heeft geleid tot waarschuwingen van regelgevende instanties. Organisaties in de gezondheidszorg moeten nu verifiëren of elk recept - vooral medicijnen met een hoog risico - legitiem zijn en of het recept legitiem is. echt afkomstig van de geautoriseerde leveranciergeen deepfake of datalek.

Deepfake arts-patiënt imitaties

Misschien wel de meest in het oog springende ontwikkeling is het gebruik van deepfakes om zich voor te doen als medisch personeel of patiënten. Bij telegeneeskunde en klantenservice gebruiken oplichters AI-gegenereerde video en audio om de mensen aan de andere kant voor de gek te houden. Criminelen hebben bijvoorbeeld deepfake video's van patiënten voor telegezondheidsconsulten, waarbij artsen worden misleid om een "behandeling" te geven of doorverwijzingen die vervolgens in rekening worden gebracht bij de verzekering[30][31]. Omgekeerd kan een oplichter de gelijkenis van een arts fingeren - door het gezicht en de stem van een gerenommeerde arts te gebruiken - in een videogesprek om een patiënt overtuigen om te betalen voor een frauduleuze dienst of persoonlijke informatie vrij te geven. IT-deskundigen in de gezondheidszorg waarschuwen dat telegezondheidszorg is een rijp doelwit gewordenMen kan een virtuele afspraak maken met een valse patiëntidentiteit en vervolgens een AI avatar op video laten invallen om onder valse voorwendselen recepten of medisch advies te krijgen.[31][32]. Naast telegeneeskunde worden sociale media overspoeld met deepfakes in de vorm van "Dokter'-video's die wonderkuren promoten. In 2024 merkten experts op dat deepfaked video's van beroemde artsen "ging echt van start," gericht op een ouder publiek met valse gezondheidstips en zwendelproducten[33][34]. Vertrouwde tv-artsen in het Verenigd Koninkrijk en Frankrijk lieten hun gelijkenis klonen om nepdiabeteskuren en bloeddruksupplementen te promoten.[35][36]. Tot de helft van de kijkers kon niet zien dat deze deepfake medische video's nep waren[37]. Deze uitholling van de waarheid heeft tastbare kosten: patiënten kunnen schadelijk advies opvolgen van een valse doktersvideo, of oplichters kunnen verzekeraars factureren voor consulten die nooit hebben plaatsgevonden, behalve als een valse opname. Alles bij elkaar, AI-gestuurde imitatie ondermijnt het fundamentele vertrouwen in interacties in de gezondheidszorg - Als je er niet op kunt vertrouwen dat de persoon op het scherm of de telefoon is wie hij beweert, is het hele systeem in gevaar.

Impact en omvang: 2025 fraude in cijfers

AI-gestuurde fraude is niet langer een marginaal probleem - het is nu een grote financiële aderlating en bedreiging voor de veiligheid in wereldwijde gezondheidszorgsystemen. Kijk eens naar de volgende recente statistieken en gevallen die de omvang van het probleem:

- Jaarlijkse verliezen: Fraude in de gezondheidszorg kost de VS naar schatting $68 miljard of meer per jaar[25]ongeveer 3-10% van alle gezondheidsuitgaven[38]. Wereldwijd kan fraude ongeveer 6% aan uitgaven voor gezondheidszorg[39] - een verbijsterend cijfer gezien de wereldwijde uitgaven aan gezondheidszorg biljoenen dollars bedragen. Deze verliezen vertalen zich uiteindelijk in hogere premies, hogere ziekenhuiskosten en minder middelen voor patiëntenzorg.

- Fraudepiek in 2023-2025: De komst van generatieve AI heeft geleid tot een explosie van fraudepogingen. Deepfake-gerelateerde fraude-incidenten zijn toegenomen vertienvoudigen van 2022 tot 2023[4]. In 2024 stegen de gerapporteerde deepfake-incidenten tot 150 (een stijging van 257%).[40]en 2025 ligt op koers om dat ver te overtreffen (580 incidenten in alleen al de eerste helft van 2025, bijna 4× het totaal voor 2024)[7]. Fraude-experts merken op dat 46% hebben te maken gehad met synthetische ID-fraude, 37% met stemfraude en 29% met video-fraude. in hun onderzoeken[8] - waaruit blijkt hoe gewoon deze AI-technieken zijn geworden.

- Recordzettende takedowns: Handhavingsinstanties reageren met grotere strafmaatregelen. In juni 2025 kondigde de Amerikaanse DOJ de grootste fraude in de gezondheidszorg in de geschiedenis324 individuen aanklagen en $14,6 miljard in frauduleuze claims[1][13]. De oplichtingspraktijken bestonden uit telegezondheidsconsulten, fraude met genetische testen en grootschalige oplichting van duurzame medische apparatuur.[13]. Als onderdeel van deze inspanning heeft Medicare $4 miljard aan uitbetalingen opgeschort verdacht geacht[41]om deze verliezen te voorkomen. Een van de belangrijkste zaken ("Operation Gold Rush") onthulde een internationale bende die gestolen identiteiten gebruikte voor het indienen van $10,6 miljard aan valse claims voor medische benodigdheden[42] - een bewijs van hoe ver criminelen willen gaan wanneer ze gewapend zijn met gegevens waarvan ze slachtoffer zijn en automatisering.

- Gevolgen voor verzekeraars: Verzekeraars wereldwijd zien een Golf van AI-gerelateerde fraude. In het Verenigd Koninkrijk melden verzekeraars dat deepfakes steeds vaker worden gebruikt bij claims (vaak "low touch" claims om detectie te voorkomen).[27]. Een toonaangevend herverzekeringsbedrijf waarschuwt dat vervalste medische dossiers en vervalste gezondheidstoestanden acceptatie ondermijnen en levens- en zorgverzekeringsverliezen kunnen opdrijven.[43]. Een analyse van Deloitte uit 2024 voorspelde dat in 2027, generatieve AI-fraude kan verantwoordelijk zijn voor $40 miljard aan jaarlijkse verliezen in de VS. (van $12,3 miljard in 2023)[8]. Dit traject betekent een aanzienlijke klap voor de winst van verzekeraars als er geen krachtige tegenmaatregelen worden genomen.

- Slachtoffers van patiënten: Patiënten en het publiek verliezen ook geld door deze zwendelpraktijken. Vooral oudere volwassenen zijn het doelwit van AI-spraakzwendel ("kleinkind in nood"-telefoontjes) en gezondheidszwendel. In 2023 rapporteerden Amerikaanse senioren $3,4 miljard aan verliezen door fraude, een stijging van 11% ten opzichte van het voorgaande jaar[44][45] - Een deel hiervan wordt aangedreven door AI-verbeterde programma's. En naast de monetaire kosten is er een menselijke kostenFrauduleus medisch advies en nepbehandelingen waarvoor via AI reclame wordt gemaakt, kunnen leiden tot lichamelijke schade of verlies van vertrouwen in legitieme gezondheidszorg.

In het algemeen heeft 2025 duidelijk gemaakt dat AI voert traditionele fraude in de gezondheidszorg op. Wat vroeger kleinere, opportunistische zwendelpraktijken waren, is nu uitgegroeid tot geïndustrialiseerde operaties die zich uitstrekken over continenten. De combinatie van big data (vaak afkomstig van inbreuken) en AI betekent dat oplichting met angstaanjagende snelheid en aannemelijkheid kan worden uitgevoerd. De wereldwijde verliezen lopen in de tientallen miljarden en nemen toeen elke belanghebbende - van ziekenhuizen en verzekeraars tot patiënten - loopt risico. In het volgende gedeelte wordt besproken hoe de sector kan terugvechten met behulp van even geavanceerde technologieën en strategieën.

Verdedigen tegen AI-gestuurde fraude: Strategieën en oplossingen

Om AI-fraude in de gezondheidszorg het hoofd te bieden is een arsenaal aan even geavanceerde verdedigingsmechanismen nodig. Leidinggevenden in de gezondheidszorg, cyberbeveiligingsteams, compliance officers en verzekeraars moeten samenwerken om anti-fraudemaatregelen inbouwen op elk kwetsbaar punt - van de intake van patiënten tot de uitbetaling van claims. Hieronder staan de belangrijkste strategieën en technische oplossingen om AI-gestuurde fraude tegen te gaan:

- AI-inhouddetectietools: Net zoals criminelen AI gebruiken om content te fabriceren, kunnen organisaties AI gebruiken om het te detecteren. Geavanceerd AI-geschreven inhoudsdetectoren (zoals de suite van TruthScan) analyseren tekst, afbeeldingen, audio en video om de duidelijke tekenen van AI-generatie te identificeren. Het platform van TruthScan past bijvoorbeeld machine learning toe om statistische patronen en linguïstische eigenaardigheden te herkennen die duiden op door AI gegenereerde tekst met meer dan 99% nauwkeurigheid[46][47]. Deze tools kunnen worden geïntegreerd in systemen voor claimbeheer of elektronische patiëntendossiers om automatisch een markering aan te brengen in het systeem. verdachte documenten - bijvoorbeeld een medisch rapport dat waarschijnlijk is geschreven door ChatGPT - voor handmatige controle. Op dezelfde manier kan AI-beeldforensisch onderzoek gemanipuleerde medische scans of valse ID's detecteren, en kunnen deepfake detectiealgoritmen video's analyseren op tekenen van synthese (artefacten in pixels, vreemde timing van gezichtsbewegingen, enz.)[48][49]. Door multi-modale AI-detectoren in te zetten, kunnen gezondheidsorganisaties een groot deel van de door AI gesmede inhoud in realtime afschermen voordat het schade veroorzaakt.

- Verificatie medisch dossier en documenten: Zorgverleners wenden zich tot gespecialiseerde oplossingen om de authenticiteit van dossiers en claimdocumenten verifiëren. Dit omvat het hashen en digitaal ondertekenen van legitieme records, evenals het gebruik van databases met sjablonen van bekende documenten om deze te vergelijken met ingediende documenten. AI-gestuurde verificatiediensten (bijvoorbeeld TruthScan's Verificatie van medische documenten oplossing) kan onmiddellijk de inhoud en metadata van een document analyseren om te bepalen of het machinaal is gegenereerd of gewijzigd.[50][51]. Ze kijken naar inconsistenties die een mens misschien over het hoofd ziet, zoals subtiele afwijkingen in de opmaak of metagegevens die aangeven dat een afbeelding door AI is gemaakt. Real-time bewaking van patiëntendossiers en verzekeringsclaims Zoeken naar afwijkingen is ook essentieel[52]. Door continu nieuwe gegevens te scannen (labuitslagen, aantekeningen van artsen, bijlagen bij declaraties) kunnen deze systemen valse records opsporen. voor ze leiden tot frauduleuze uitbetalingen of klinische fouten. Sommige verzekeraars hebben regels geïmplementeerd waarbij alle claimdocumentatie die als AI-gegenereerd wordt geïdentificeerd, automatisch wordt opgevraagd voor fraudeonderzoek. Het doel is om ervoor te zorgen dat elk medisch dossier of elke claim die de workflow binnenkomt betrouwbaar en ongewijzigd is.

- Identiteitscontrole en -validatie: Het versterken van identiteitsverificatie is cruciaal in het tijdperk van synthetische ID's. Instellingen in de gezondheidszorg moeten het volgende afdwingen rigoureuze identiteitscontrole voor nieuwe patiënten, zorgverleners en leveranciers. Dit kan multifactorauthenticatie omvatten, biometrische controles (zoals gezichtsherkenning of vingerafdrukken bij registratie) en het gebruik van identiteitsverificatiediensten die gebruikmaken van AI om het volgende te detecteren valse ID's of niet overeenkomende persoonlijke gegevens. Gezichtsherkenning kan bijvoorbeeld worden gecombineerd met levendigheidstests om te voorkomen dat een door AI gegenereerd gezicht via een foto door kan gaan voor een echte patiënt. Aan de achterkant kunnen algoritmes de gegevens van een patiënt (adres, telefoon, e-mail, aanwezigheid op sociale media) kruiselings verifiëren om "dunne" identiteiten te herkennen die geen normale geschiedenis hebben - een bekende weggever van synthetische ID's.[53]. Financiële instellingen hebben dergelijke AI-gestuurde achtergrondcontroles met groot succes gebruikt[54]en de gezondheidszorg kan hetzelfde doen: bijvoorbeeld een nieuwe Medicare-aanvrager markeren als deze geen digitale voetafdruk heeft voorafgaand aan dit jaar. Identiteiten van providers valideren is net zo belangrijk - ervoor zorgen dat de arts op een telegezondheidsvideo een vergunning heeft en ook echt is wie hij beweert te zijn, bijvoorbeeld door digitale certificaten of video's met een watermerk uit te geven die moeilijk na te maken zijn door deepfakes. In apotheken moet het personeel ongebruikelijke receptaanvragen dubbel controleren door direct terug te bellen naar de leverancier en codezinnen of verificatievragen te gebruiken om mogelijke AI-stemmenbedriegers te verslaan.

- Geïntegreerde fraudedetectie in workflows: Om het systeem echt te beschermen, kan fraudedetectie geen op zichzelf staande stap zijn - het moet verweven in elke workflow in een gezondheidsorganisatie.

In de praktijk betekent dit dat ziekenhuizen en verzekeraars API-integraties inzetten om fraude-opsporingsservices op kritieke momenten aan te roepen. Als een zorgverlener bijvoorbeeld een declaratie met bijgevoegde documenten indient, kan een AI-dienst deze bijlagen binnen enkele seconden automatisch op echtheid beoordelen. Als er een telezorgafspraak wordt gemaakt, kan het platform op de achtergrond een passieve stemanalyse uitvoeren om er zeker van te zijn dat de beller geen gesynthetiseerde stem gebruikt. Continue bewaking is ook belangrijk: moderne fraudeplatforms bieden dashboards die fraudesignalen in de hele organisatie bijhouden (mislukte validaties, het vaak markeren van declaraties van een bepaalde kliniek, etc.) om patronen te identificeren, zoals een georganiseerde fraudebende die actief is met meerdere declaraties. Door fraude in de gezondheidszorg meer te behandelen als cyberbedreigingen - met 24/7 bewaking, detectie van anomalieën en snelle respons bij incidenten - organisaties problemen kunnen opvangen voordat ze in een spiraal terechtkomen[55].

- AI voor fraudeanalyse en patroonherkenning: De hoeveelheid gegevens over de gezondheidszorg is zo groot dat AI onmisbaar is bij het vinden van fraudepatronen die mensen over het hoofd zien. Machine-learningmodellen kunnen worden getraind op historische fraudegevallen om nieuwe fraudegevallen op te sporen (bijvoorbeeld het clusteren van declaraties met vergelijkbare ongebruikelijke ICD-codes of het identificeren wanneer de facturering van een arts sterk afwijkt van die van collega's). Verzekeraars gebruiken al voorspellende analyses om claims scoren op frauderisico in realtime. Opkomende technieken zoals neurale grafieknetwerken kunnen relaties tussen patiënten, zorgverleners, diagnoses en claims in kaart brengen om onwaarschijnlijke verbanden te ontdekken (zoals hetzelfde serienummer van een apparaat dat wordt gebruikt in claims uit verschillende staten). Het pakket verzekeringsfraude van TruthScan omvat bijvoorbeeld patroonherkenning van claims en voorspellende modellen om georganiseerde fraudebendes en atypische patronen op te sporen voordat de verliezen zich opstapelen[56][57]. Het DOJ Fusion Center uit 2025 was een voorbeeld van deze aanpak - het samenvoegen van gegevens van Medicare en particuliere verzekeraars om proactief clusters van verdachte activiteiten te vinden.[58]. Organisaties in de gezondheidszorg moeten ook gegevens en AI-modellen delen in consortia om de fraudesignalen die ze kunnen detecteren uit te breiden. Hoe meer gegevens (binnen privacygrenzen) deze modellen voeden, hoe beter ze worden in het onderscheiden van normaal versus frauduleus gedrag.

- Training van personeel en procescontroles: Technologie is cruciaal, maar menselijk bewustzijn blijft een krachtige verdediging. Medewerkers en beheerders in de gezondheidszorg moeten worden getraind in AI-gebaseerde fraudetactieken - bijvoorbeeld weten dat een Perfect geschreven e-mail van een CEO kan door AI gegenereerde phishing zijnof dat ze de identiteit van videobellers verifiëren als er iets niet klopt (vreemde oogbewegingen of geluidsvertraging kunnen wijzen op een deepfake). Regelmatige oefeningen en tips (vergelijkbaar met phishing-bewustzijnstraining) kunnen worden geïmplementeerd voor nieuwe bedreigingen zoals deepfake telefoonzwendel. Eenvoudige procescontroles voegen lagen van beveiliging toe: terugbelverzoeken of secundaire verificatie vereisen voor grote of ongebruikelijke betalingsverzoeken, het gebruik van bekende veilige communicatiekanalen voor gevoelige informatie en het onderhouden van een incident response plan specifiek voor vermoede AI-gemedieerde fraude. Belangrijk is dat organisaties een cultuur cultiveren waarin medewerkers voelen zich gesterkt om afwijkingen in twijfel te trekkenZelfs als het een "dokter" op video is die om een vreemd verzoek vraagt. Veel deepfake scams slagen door misbruik te maken van vertrouwen en autoriteit; een waakzaam personeelsbestand dat op de hoogte is van deze trucs kan incidenten vroegtijdig stoppen. Zoals een expert opmerkte, kan de confrontatie met deepfakes net zo routineus worden als het herkennen van phishingmails - een standaardonderdeel van cyberveiligheidshygiëne.[32][59].

- Gespecialiseerde diensten inzetten: Gezien de snelle evolutie van AI-bedreigingen werken veel organisaties in de gezondheidszorg samen met gespecialiseerde aanbieders van fraudepreventie. Diensten zoals TruthScan voor de gezondheidszorg bieden end-to-end oplossingen op maat voor medische gebruikssituaties, waaronder: real-time bewaking van de integriteit van elektronische medische dossiers (EMR), verificatie van patiëntdocumenten tegen AI-manipulatie, deepfake-detectie voor telegezondheidszorg en nalevingsrapportage (bijv. audit trails die due diligence in fraudedetectie bewijzen voor regelgevers)[60][51]. Dergelijke platforms bieden vaak API-integratie naadloos aansluiten op bestaande systemen en zijn gebouwd om te voldoen aan voorschriften voor de gezondheidszorg (HIPAA, GDPR)[61][62]. Door enterprise-grade tools te gebruiken, kunnen zelfs kleinere klinieken of regionale verzekeraars toegang krijgen tot geavanceerde AI-detectiemogelijkheden zonder deze zelf te ontwikkelen. Daarnaast moeten verzekeraars en zorgverleners letten op updates in regelgeving en industriestandaarden, bijvoorbeeld nieuwe wetten tegen deepfake fraude (sommige rechtsgebieden verbieden nu expliciet medische deepfakes en de VS breidt de wetgeving op identiteitsdiefstal uit naar AI-imitatie).[63]). Door zich aan te passen aan dergelijke standaarden en state-of-the-art tools in te zetten, verminder je niet alleen fraudeverliezen, maar toon je ook een sterke beveiligingshouding aan partners, auditors en patiënten.

Conclusie en vooruitblik

Het jaar 2025 heeft aangetoond dat de geest is uit de fles - Generatieve AI en automatisering zijn nu verweven met fraude in de gezondheidszorg. In de toekomst zullen fraudeurs waarschijnlijk blijven innoveren: misschien zien we AI-modellen die leren om de schrijfstijl van specifieke artsen na te bootsen of deepfakes die in realtime reageren op uitdagende vragen. De strijd zal een voortdurende wapenwedloop zijn. De gezondheidszorgsector reageert echter even krachtig en investeert in AI-gebaseerde verdediging en strengere beveiligingsworkflows. Door het combineren van geavanceerde detectietechnologie, strenge verificatieprocessen, het delen van gegevens tussen verschillende industrieën en waakzaamheid van werknemerskunnen organisaties in de gezondheidszorg de AI-gefaciliteerde frauderisico's aanzienlijk beperken.

Cruciaal is dat dit niet alleen een IT-kwestie is - het is een bestuurs- en vertrouwenskwestie. Raden van bestuur en leidinggevenden in de gezondheidszorg moeten AI-fraude erkennen als een strategisch risico voor de financiën en het vertrouwen van patiënten, dat regelmatig aandacht en middelen verdient. Compliance teams moeten hun frauderisicobeoordelingen bijwerken met AI-aspecten en verzekeraars zouden hun acceptatieaannames kunnen heroverwegen in de wetenschap dat een bepaald percentage van de claims door AI geassisteerde fraude zou kunnen zijn. Aan de andere kant zal het ethisch gebruik van AI in de gezondheidszorg (voor ondersteuning van klinische beslissingen, efficiëntie van facturering, enz.

Samengevat, Generatieve AI heeft het spel van fraude veranderd in de gezondheidszorg, maar met bewustzijn en geavanceerde tegenmaatregelen hoeft dit het systeem niet te overweldigen. Organisaties die op de hoogte blijven van nieuwe bedreigingen, zich snel aanpassen met AI-gebaseerde verdedigingsmechanismen en een cultuur van "verifiëren en vertrouwen" bevorderen in plaats van "standaard vertrouwen", zullen succesvol zijn. Door dit te doen, kan de gezondheidszorg veilig gebruik maken van de positieve kanten van AI en tegelijkertijd het misbruik ervan neutraliseren, waardoor zowel het resultaat als het welzijn van patiënten in het digitale tijdperk wordt beschermd.

Bronnen: Recente rapporten en zaken uit de sector zoals hierboven genoemd, waaronder Pymnts (juli 2025)[2][3], Swiss Re Institute (juni 2025)[27]Federal Reserve Bank of Boston (apr 2025)[19]BMJ (2024)[37]en TruthScan solution briefs (2025)[51][64]onder andere. Alle gegevens en citaten zijn de meest recente die beschikbaar zijn in 2024-2025 en illustreren de huidige staat van AI-gestuurde fraude in de gezondheidszorg en de antwoorden om deze te bestrijden.

[1] [2] [3] [9] [10] [11] [12] [13] [14] [15] [41] [42] [55] [58] DOJ dankt AI-tools aan historische fraude in de gezondheidszorg

[4] [5] [6] [7] [16] [40] [44] [45] Deepfake statistieken en trends 2025 | Belangrijkste gegevens en inzichten - Keepnet

https://keepnetlabs.com/blog/deepfake-statistics-and-trends

[8] Deepfakes en de crisis van het weten | UNESCO

https://www.unesco.org/en/articles/deepfakes-and-crisis-knowing

[17] [18] [19] [20] [21] [22] [23] [24] [53] [54] Gen AI verhoogt de dreiging van synthetische identiteitsfraude - Federal Reserve Bank of Boston

[25] [26] [56] [57] [62] [64] AI-fraudedetectie voor zorg- en levensverzekeringen | TruthScan

https://truthscan.com/solutions/health-life-commercial-insurance-fraud-detection-solution

[27] [43] Hoe deepfakes, desinformatie en AI verzekeringsfraude versterken | Swiss Re

[28] DEA waarschuwt voor fraude met elektronische recepten - Pharmacy Practice News

[29] [39] Cyberbeveiliging en fraude in de gezondheidszorg: Een diepe duik in de grootste risico's en verdediging van vandaag | CrossClassify

https://www.crossclassify.com/resources/articles/healthcare-cybersecurity-and-fraud/

[30] [31] [32] [59] De zich ontwikkelende dreiging van Deepfake telegeneeskundezwendel, Mike Ruggio

https://insights.taylorduma.com/post/102jkzn/the-evolving-threat-of-deepfake-telemedicine-scams

[33] [34] Experts waarschuwen voor oplichters die 'Deepfakes' van beroemde artsen gebruiken op sociale media

[35] [36] [37] Vertrouwde tv-artsen "gefingeerd" om gezondheidszwendel op sociale media te promoten - BMJ Group

https://bmjgroup.com/trusted-tv-doctors-deepfaked-to-promote-health-scams-on-social-media/

[38] [PDF] huidige stand van het onderzoek Ajit Appari en M. Eric Johnson

http://mba.tuck.dartmouth.edu/digital/Research/ResearchProjects/AJIJIEM.pdf

[46] [47] [48] [49] TruthScan - AI-detectie en inhoudbeveiliging voor ondernemingen

[50] [51] [52] [60] [61] AI-fraudedetectie in medische dossiers | CRO-oplossingen voor de gezondheidszorg | TruthScan

https://truthscan.com/solutions/healthcare-cro-fraud-detection

[63] Hoe gevaarlijk zijn Deepfakes en andere AI-fraude?