For bare noen få år siden trengte du et profesjonelt studio og mye teknisk kompetanse for å etterligne noens stemme.

Nå kan hvem som helst med en internettforbindelse og litt tid til overs lage en digital klone av hvem som helst sin stemme på mindre enn ett minutt.

Verktøyene for disse angrepene blir stadig billigere og mer tilgjengelige for alle. Og fordi så mange mennesker deler livene sine på sosiale medier, er det svært enkelt for en svindler å finne lyden de trenger.

I denne artikkelen går vi gjennom noen av de mest kjente eksemplene på lydsvindel i den virkelige verden. Vi presenterer også en løsning som kan sette en stopper for disse truslene i tide.

Det viktigste å ta med seg

- Forsøkene på stemmesvindel har økt med over 2 137% de siste årene, noe som skyldes at moderne kunstig intelligens kan generere en 85% nøyaktig stemmekloning ved hjelp av så lite som tre sekunder med kildelyd.

- Beryktede angrep i den virkelige verden inkluderer kuppet mot ingeniørfirmaet Arup i 2024, der svindlere brukte deepfake-video og -lyd av en finansdirektør for å lure en ansatt til å overføre $25,6 millioner.

- I tillegg til tyveri fra bedrifter utgjør stemmeforfalskninger en alvorlig emosjonell risiko for familier gjennom kidnappingssvindel og kan omgå tradisjonelle biometriske sikkerhetssystemer som brukes av banker og andre høysikkerhetsapper.

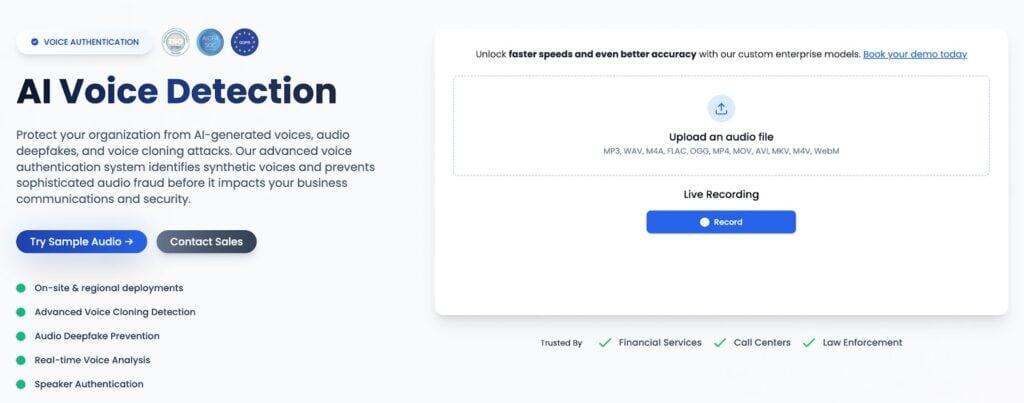

- Organisasjoner tvinges til å gå lenger enn bare menneskelig verifisering ved å implementere godkjenningsprotokoller med flere personer for store overføringer og ta i bruk AI-stemmedetektorer som TruthScan for å analysere akustiske fingeravtrykk i sanntid.

- TruthScan sikrer bedriftsinteraksjoner ved å identifisere syntetiske taleartefakter fra plattformer som ElevenLabs og Murf med over 99% nøyaktighet på tvers av alle større lyd- og videoformater.

Hva er Voice Deepfake-angrep?

En voice deepfake er en digital forfalskning av en persons stemme. Angriperen bruker programvare som kan analysere hver minste detalj i hvordan en person snakker ut fra et opptak av stemmen.

For å klone stemmen prøver programvaren å legge merke til mønstre i stemmen. Programvaren tar hovedsakelig hensyn til ting som tonehøyde, tonefall, måten en person puster på mellom setninger osv.

Når den har lært seg disse mønstrene, kan angriperen få den til å si hva som helst med den stemmen.

Aldri bekymre deg for AI-svindel igjen. TruthScan Kan hjelpe deg:

- Oppdage AI generert bilder, tekst, tale og video.

- Unngå stor AI-drevet svindel.

- Beskytt dine mest følsom virksomhetens eiendeler.

Det som er farlig er at voice deepfake-skapende verktøy er lett tilgjengelige. Og de fleste av dem trenger ingen installasjon. De er tilgjengelige på nettet i form av nettsteder.

Du trenger bare å kaste noen få dollar på dem og begynne å klone stemmer. Hvis du graver litt mer, kan du til og med finne verktøy som lar deg klone stemmer gratis.

Denne nye og lett tilgjengelige teknologien har ført til en kraftig økning i antall lydsvindelforsøk.

Svindlere trenger bare en liten lydbit av en person, som de kan hente fra sosiale medier eller andre offentlige kanaler, for å klone vedkommende.

Deretter kan de bruke den klonede stemmen til å utgi seg for å være en person i situasjoner som direkte telefonsamtaler, videomøter, talenotater, kunngjøringer osv.

Dette er ikke bare hypotetiske tilfeller av deepfake-angrep. Disse tingene har allerede skjedd. Vi skal ta for oss noen av de mest kjente deepfake-angrepene senere.

Potensielle risikoer ved Deepfake-angrep med stemme

Når du hører om voice deepfake, ser du kanskje for deg en morsom video av en kjendis som sier ting han eller hun aldri har sagt.

Men den tilsynelatende uskyldige bruken av klonet stemme kan forårsake alvorlig skade for de involverte partene. La oss snakke om risikoen.

Økonomiske ødeleggelser for bedrifter

En stemmejuks kan ødelegge et selskaps omdømme for alltid. Det kan også frarøve selskapet store pengesummer på få minutter.

Hvordan kan det ha seg, spør du kanskje? Svindlere kan klone stemmen til en bedriftssjef og bruke den til å ringe ansatte og få dem til å gjøre ting som ikke skal gjøres, som å flytte penger til en konto.

Dette er bare ett eksempel. Mulighetene er uendelige.

Omgåelse av sikkerhetssystemer

Stemmen din er et biometrisk kjennetegn som ingen andre bør ha. Det er fordi du bruker den som passord for å logge på mange av appene dine, spesielt bankappene.

Selv om disse appene kan ha et innebygd automatisk stemmebekreftelsessystem for å forhindre uautorisert tilgang, har en god stemmeklone fortsatt en sjanse til å lure dem.

Den følelsesmessige belastningen for familiene

De enkleste målene for lydsvindlere er kanskje eldre personer i familien. Foreldre og besteforeldre, for eksempel.

Svindlere kan ringe for eksempel en mor og spille av lyden av datteren som roper om hjelp, og si at hun har blitt kidnappet.

Svekket tillit på arbeidsplassen

Voice deepfake-angrep skader også tilliten på en sunn arbeidsplass.

Ansatte må dobbeltsjekke telefonsamtaler fra sjefen sin for å forsikre seg om at det ikke er en svindler som beordrer dem til å gjøre risikable ting med en klonet stemme.

Så hva er alternativene dine hvis du ikke dobbeltsjekker manuelt? Alle risikoene vi nettopp har diskutert, peker på behovet for en automatisert forebygging av deepfake-angrep.

Heldigvis har vi nå verktøy for å oppdage falske AI-stemmer, der TruthScan er ett av dem.

Forhindre svindel og etterligning med TruthScans AI Voice Detector.

Eksempler på Deepfake-angrep på stemmen i den virkelige verden

Takket være kunstig intelligens har vi nå nådd et punkt der vi ikke lenger uten videre kan stole på det øynene våre ser eller ørene våre hører. AI er nå i stand til å skape realistiske bilder og videoer. Det samme gjelder for lyd.

Du har kanskje allerede hørt historier om folk som faller for deepfake-lydsvindel. Det dukker stadig opp på nyhetene og i sosiale medier fra tid til annen. Noen av disse er vanskelige å forstå.

La oss fortelle deg om noen av de mest beryktede voice deepfake-angrepene, slik at du kan få et godt inntrykk av hvor smart disse blir utført.

Det virtuelle møtet til $25 millioner som aldri fant sted

Dette deepfake-angrepet er sannsynligvis det mest rapporterte.

Den offeret var et britisk ingeniørfirma ved navn Arup, men svindelen hadde sitt utspring i Hong Kong-kontoret.

Det var tidlig i 2024 da en ansatt i selskapets økonomiavdeling fikk en e-post fra selskapets finansdirektør i Storbritannia. I e-posten ble medarbeideren bedt av finansdirektøren om å foreta hemmelige pengeoverføringer til noen bankkontoer.

Først ble den ansatte faktisk ganske mistenksom fordi forespørselen føltes litt merkelig, og de trodde det kunne være en phishing-svindel.

Men så ble medarbeideren invitert til en videokonferansesamtale. Da medarbeideren ble med i samtalen, så han eller hun noe som så ut som finansdirektøren og flere andre høytstående kolleger.

Alle så ut og hørtes ut akkurat som de skulle. De snakket også med hverandre for å få det til å virke mer ekte.

Dette fjernet all tvil hos den ansatte i finansavdelingen, som deretter sendte over $25,6 millioner (~HK$200 millioner) til flere forskjellige bankkontoer i Hongkong via 15 transaksjoner.

Det viste seg senere at hele opplegget var en dyp forfalskning. Ingen av personene i samtalen var den de så ut som, bortsett fra den Arup-ansatte. Svindlerne hadde koordinert angrepet perfekt ved hjelp av lyd- og videokloner av høy kvalitet av selskapets finansdirektør og ledende ansatte.

Den italienske ministeren og moteikonene

Denne fant også sted i 2024. A den falske italienske forsvarsministeren Guido Crosetto ringte flere italienske eliter og ba dem om umiddelbar økonomisk hjelp til å redde de kidnappede journalistene.

I samtalen hevdet den falske Guido Crosetto at dette var en topphemmelig regjeringsoperasjon. Innringeren klarte til og med å komme i kontakt med legendariske motefigurer som Giorgio Armani.

Dessverre endte én person opp med å overføre rundt én million dollar. De hadde nok en sterkere følelse av patriotisk plikt til å hjelpe enn andre, noe svindlerne lyktes i å utnytte.

Energikuppet på $243 000 i Storbritannia

Dette skjedde i 2019 og var trolig den første rapporterte deepfake i denne størrelsesordenen noensinne.

En administrerende direktør i et britisk energiselskap trodde han snakket i telefon med sjefen fra morselskapet i Tyskland.

Administrerende direktør ble beordret til å overføre rundt 220 000 euro ($243 000) til en leverandør i Ungarn. Han ble fortalt at det dreide seg om en kritisk avtale som måtte overføres umiddelbart. Konsernsjefen falt for svindelen og overførte pengene.

En skremmende samtale til en mor i Arizona

Husker du at vi snakket om at lyd-deepfakes var en trussel for familier? Eksemplet på svindelen vi ga, skjedde faktisk.

Svindlere hadde klonet stemmen til en 15 år gammel jente fra en video av henne på sosiale medier. Deretter ringte de moren hennes og hevdet med datterens stemme at hun hadde blitt kidnappet, og at kidnapperne krevde løsepenger umiddelbart.

Heldigvis klarte faren å ringe den faktiske datteren, som var i sikkerhet på en skitrening under hele opptrinnet. De unngikk svindelen.

Hvordan Voice Deepfakes påvirker bedrifter

Hovedformålet med et voice deepfake-angrep er for det meste å stjele penger.

Men når målet er bedrifter, er skaden flerdimensjonal.

For eksempel kan deepfakes forgifte atmosfæren mellom de ansatte i en bedrift. Det kan skape en kultur der de ansatte alltid er livredde for å gjøre en tabbe.

Ta kundesentrene som eksempel. Vi ser rapporter om nettkriminelle som ringer dem og utgir seg for å være spesifikke kunder.

Trikset deres er å få kundesenteragentene til å endre kontoopplysningene til disse kundene (f.eks. hjemmeadresser, telefonnumre) og overta kontoene deres.

Fjernansettelser og virtuelle intervjuer er et annet område der falske stemmer kan brukes av kandidater til å få jobber de ikke er kvalifisert for.

Beskyttelse av virksomheter mot Deepfake-angrep

De tradisjonelle sikkerhetsreglene i virksomheter ble skrevet i tiden før AI.

Det er på høy tid at virksomhetene revurderer dem. De bør først og fremst begynne med å sette seg inn i de mange nye cybertruslene som har oppstått som følge av misbruk av kunstig intelligens.

De kan for eksempel organisere opplæringsøkter for hele teamet og vise dem reelle eksempler på lydsvindel. Du kan starte med eksemplene vi nettopp diskuterte ovenfor. Disse opplæringsøktene bør også gi dem tips om forebygging av deepfake-angrep i ulike scenarier.

Deretter kan du gå i gang med å oppdatere virksomhetens interne retningslinjer. En viktig endring kan være å slutte å tillate at én enkelt person autoriserer store bankoverføringer på egen hånd.

Store utbetalinger bør kreve godkjenning av et helt panel, slik at minst én av dem i tide kan oppdage at noe er galt.

Du bør også tenke på å integrere en automatisert AI Voice Detector til å kjøre i bakgrunnen under samtaler.

Det er det TruthScan AI-verktøy er laget for. Du kan oppdage, verifisere og forhindre deepfake-angrep ved hjelp av AI-verktøyene våre. La oss fortelle deg hvordan.

Hvordan TruthScan sikrer taleinteraksjoner

Vi forstår at de ansatte ikke på egen hånd kan skille en falsk stemme fra en ekte stemme midt i en stressende samtale. De trenger en dedikert assistent som kan ta seg av den jobben under en samtale, mens teamet ditt kan fokusere på å gjøre det de er ansatt for.

Våre AI Voice Detector er en dedikert løsning.

Slik fungerer den og hva den er i stand til:

- Analyserer millioner av ulike datapunkter i direkte telefonsamtaler og videomøter og leverer 99% nøyaktighet

- Utsteder en advarsel umiddelbart etter å ha oppdaget en falsk stemme

- Fanger opp spektrale mønstre og akustiske fingeravtrykk i stemmen som kun syntetiske modeller etterlater seg

- Kan integreres med ditt eksisterende kundesenter eller helpdesk via et enkelt REST API

- Kan skanne alle større lyd- og videoformater

Snakk med TruthScan om hvordan du kan forhindre Deepfake-angrep på stemmen

Du kan stoppe svindel med stemmekloning i sanntid med TruthScan, men spørsmålet er når du skal begynne. Før eller senere kan de ansatte gjøre en tabbe og få deg svindlet. Ikke vent på det uheldige øyeblikket.

AI-stemmedetektoren vår kan flagge stemmeforfalskninger ved hjelp av plattformer som ElevenLabs og Murf.

Den fungerer i bakgrunnen under direkte telefonsamtaler og videomøter, slik at samtalemedarbeiderne ikke trenger å gjøre flere ting samtidig.

Alt som trengs, er en rask integrering via vårt REST API.

Kom i gang med TruthScan nå og beskytt virksomheten din mot deepfake-svindel.