På 90-tallet var det DNA.

På 2000-tallet var det pinger fra mobilmastene.

Men i 2026 er den nye gullstandarden for bevis det digitale fingeravtrykket.

Tenk på det på denne måten...

Hver videofil har en unik signatur.

Hvis AI endrer så mye som en eneste piksel, endres fingeravtrykket umiddelbart.

Hvis AI-beviset ditt ikke har et verifisert blockchain-tidsstempel som låser fingeravtrykket, kan det like gjerne være en karikaturtegning i en moderne dommers øyne.

Dette betyr at tiden med “å se er å tro” er over.

Vi har gått inn i en tid med AI-videoverifisering, der beviset ikke ligger i det du ser, men i den digitale koden som ligger skjult under overflaten.

I denne bloggen forklarer vi hvorfor tradisjonelle bevis ikke holder mot videosvindel, hvordan man kan oppdage manipulerte klipp, hvorfor verifisering er avgjørende for å sikre gyldigheten, og hvorfor en AI-videodetektor som TruthScan nå er avgjørende for juridiske team.

La oss dykke ned i det.

Det viktigste å ta med seg

- I 2026 må alle videobevis gjennomgå AI-videoverifisering for å anses som pålitelige.

- Videosvindel inkluderer små redigeringer som manipulering av tidsstempler, ikke bare full ansiktsutskiftning.

- En profesjonell deepfake-detektor er den eneste måten å fange opp GAN-artefakter som mennesker overser.

- Nye regler som Federal Rule 707 standardiserer hvordan AI-bevis tas opp i retten.

- Automatisert bevisanalyse gjør det mulig for firmaer å behandle store bevispakker raskt og nøyaktig.

- TruthScan forhindrer svindel under direkte høringer ved å oppdage syntetiske masker i sanntid.

Hva er videobevis i rettstvister?

Videobevis er i utgangspunktet alle opptak som brukes i retten for å bevise hva som har skjedd. Videobevis finnes overalt, fra straffesaker til forsikringsoppgjør.

I 2026 har imidlertid fremveksten av videosvindel gjort “å se er å tro” til en farlig antakelse. Jurister trenger nå robust AI-videoverifisering for å sikre rettssystemets integritet.

Typer videobevis som domstolene bruker hver dag

Aldri bekymre deg for AI-svindel igjen. TruthScan Kan hjelpe deg:

- Oppdage AI generert bilder, tekst, tale og video.

- Unngå stor AI-drevet svindel.

- Beskytt dine mest følsom virksomhetens eiendeler.

- Overvåkning (CCTV): Kameraer fra butikker eller trafikklys. Dette er det vanligste beviset i straffesaker.

- Kroppskameraer: Opptak fra politibetjenter, som for det meste brukes i saker om sivile rettigheter eller overdreven maktbruk.

- Bilkameraer: Bevisene som brukes i bilulykker og forsikringstvister.

- Innspilte vitnesbyrd: Videoavhør eller vitneforklaringer på avstand har blitt vanlig siden pandemien. Nå er det blitt standard, men det kan by på utfordringer når det gjelder å avdekke juridiske misligheter.

- Smarttelefoner og sosiale medier: Videoer fra tilskuere eller innlegg som beviser en persons oppførsel eller plassering.

- Selskapets sikkerhet: Opptak som brukes av selskaper i forbindelse med bedrageri eller “urettmessige oppsigelser”.

Generativ kunstig intelligens og deepfake-teknologi har lagt til et nytt lag av risiko. I 2025:

- 1 av 20 identitetsbekreftelser ble lurt av AI deepfakes

- En Medius-undersøkelse rapporterte at 43% av fagfolk hadde blitt utsatt for et forsøk på deepfake-svindel

Virkelige tilfeller av svindel med videobevis

- Manipulerte klipp fra rettssalen

Manipulerte rettssalsklipp refererer til video- eller lydbevis som er fremlagt i en rettssak, og som er endret, redigert eller fullstendig fabrikkert ved hjelp av teknologi.

Eksempler:

- Alameda County Deepfake-saken (2025): En sivilsak i California ble avvist etter at retten oppdaget at en vitnevideo som ble lagt frem som bevis, i sin helhet var laget ved hjelp av kunstig intelligens.

- Sz Huang v. Tesla deepfake-forsvaret (2023): I et søksmål om urettmessig død hevdet Teslas advokater at viktige krasjopptak kan være en dyp forfalskning.

Endrede overvåkningsvideoer

Overvåkingsvideo er en av de vanligste typene AI-bevis som brukes i retten. Mange tenker imidlertid feilaktig på manipulasjon som bare fullstendige deepfakes.

I virkeligheten skjer videosvindel ofte på mindre, mindre åpenbare måter som kan kompromittere en sak.

Vanlige typer manipulasjon inkluderer:

- Tidsstempelendringer

- Fjerning av ramme

- Metadata eller GPS-endringer

- Utskifting av ansikt

- Fjerning eller innsetting av gjenstander

- Opptak i looping

- Kvalitetsforringelse

Overvåkingsvideo kommer ofte fra mange forskjellige steder, som private butikker, dørklokker i hjemmet, parkeringsplasser og bykameraer. I motsetning til politiets kroppskameraopptak, følger disse systemene vanligvis ikke strenge regler for oppbevaringskjede.

Det betyr..:

- Det er ikke sikkert at det finnes noen klar oversikt over hvem som har håndtert saken.

- Opptakene kan kopieres, overføres eller konverteres flere ganger.

- Autentiseringsprosedyrene kan være svake eller inkonsekvente.

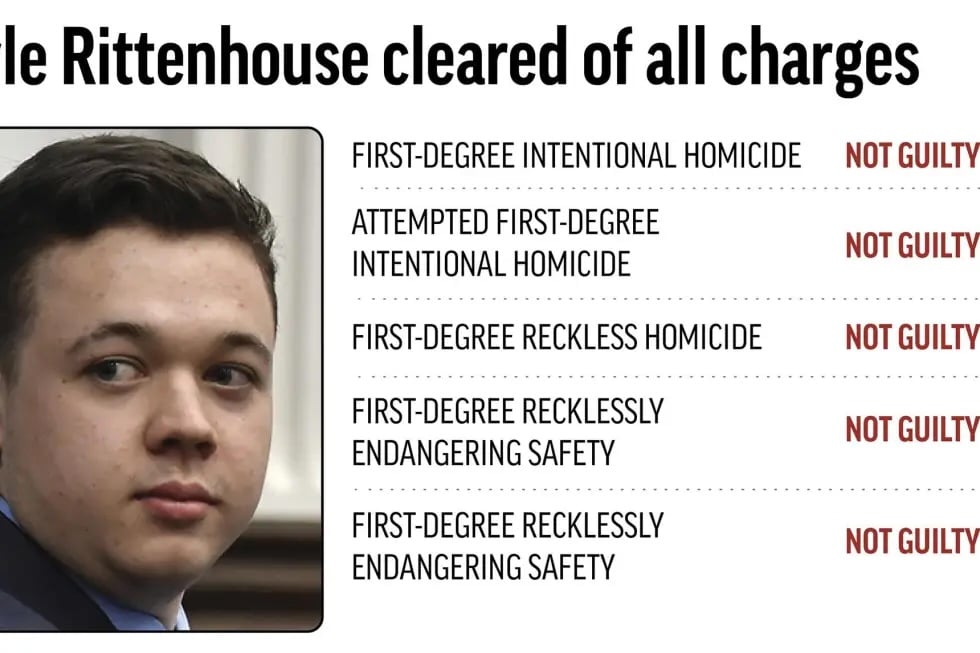

Eksempel: Wisconsin mot Rittenhouse - spørsmålet om AI-forbedring

Et berømt eksempel er fra rettssaken Wisconsin mot Rittenhouse. Påtalemyndigheten forsøkte å bruke en iPads knip-til-zoom-funksjon for å vise detaljer i en dronevideo.

Forsvaret hevdet at Apples zoom bruker AI-interpolering for å gjette hva som burde være der. Dommeren avgjorde at uten en profesjonell AI-videodetektor kunne ikke de forbedrede opptakene godkjennes.

Omstridte videovitnesbyrd

Et omstridt videovitnesbyrd krever vanligvis juridisk svindeloppdagelse for å avgjøre om et opptak er det:

- En fullstendig fabrikkert vitneforklaring eller uttalelse

- Et ekte vitnesbyrd som er blitt avslørt som falskt

- Et manipulert ekte opptak

Hvert scenario skaper en alvorlig autentiseringsbyrde for domstolen.

Eksempel: Den britiske barnefordelingssaken

I en britisk familiedomstolstvist, referert av University of Baltimore Law Review, sendte en mor inn et sterkt endret opptak for å fremstille faren som voldelig under en kamp om foreldreretten.

Målet var å begrense hans samvær med barna.

AI-generert video blir stadig vanligere i juridiske saker

Veien mot den nåværende epoken med deepfake-detektorer har gått i ulike faser:

- Årene med tidlig varsling (2017-2021)

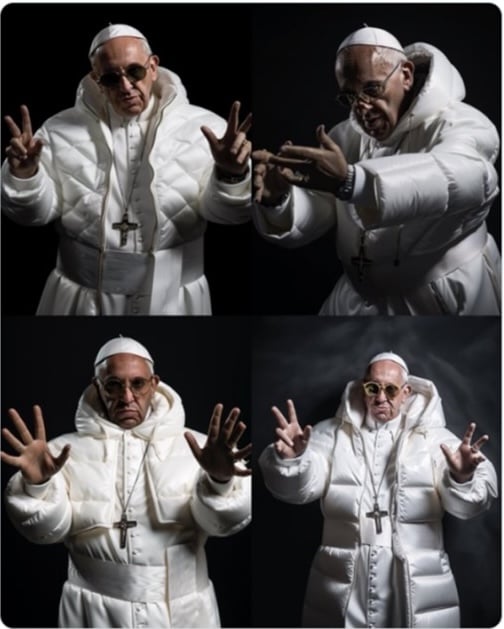

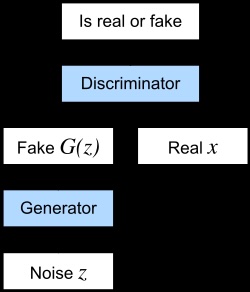

Deepfake-teknologi (drevet av generative adversarial networks (GAN)) ble kjent for offentligheten rundt 2017.

De første deepfakes var ofte av dårlig kvalitet: ansikter med rare forvrengninger, ekstra fingre, feilaktig belysning og uskarpe trekk som gjorde dem lette å gjenkjenne.

- Opptrappingsfasen (2022-2023)

I 2022 var teknologien blitt bedre. Mange var gratis og kunne brukes på smarttelefoner.

I 2023 begynte vi å se noen av de første betydelige deepfake-relaterte utfordringene i rettssaker, inkludert Sz Huang v. Tesla, United States v. Reffitt og United States v. Doolin, der advokater reiste spørsmål om hvorvidt videobevis kunne være AI-genererte.

Omtrent samtidig begynte American Bar Association's Advisory Committee on Evidence Rules formelt å studere spørsmålet.

- Den kritiske terskelen (2024-2025)

AI-generert innhold forble ikke akademisk lenge. I 2024 skjedde det en hendelse i ingeniørfirmaet Arup, som involverte en AI-generert falsk videosamtale som godkjente falske bankoverføringer på til sammen $25 millioner.

Rettssystemet begynte å reagere.

I 2025, Louisiana vedtok HB 178, og skapte det første rammeverket for verifisering av AI-bevis på statlig nivå.

På føderalt nivå foreslo den amerikanske Advisory Committee on Evidence Rules Regel 707, med fokus på maskingenererte bevis.

Hvor står vi i 2026?

Fra begynnelsen av 2026 har reguleringen av deepfake- og AI-video akselerert over hele landet:

- 46 stater har vedtatt en eller annen form for deepfake-lovgivning.

- Siden 2022, 169 lover har blitt vedtatt, og 146 lovforslag ble fremmet bare i 2025.

- Federal Rule 707 er åpen for offentlige kommentarer til og med 16. februar 2026.

Forbedret videoverifisering med kunstig intelligens

Den mest effektive måten å oppdage AI-genererte videoer på, er å bruke AI selv.

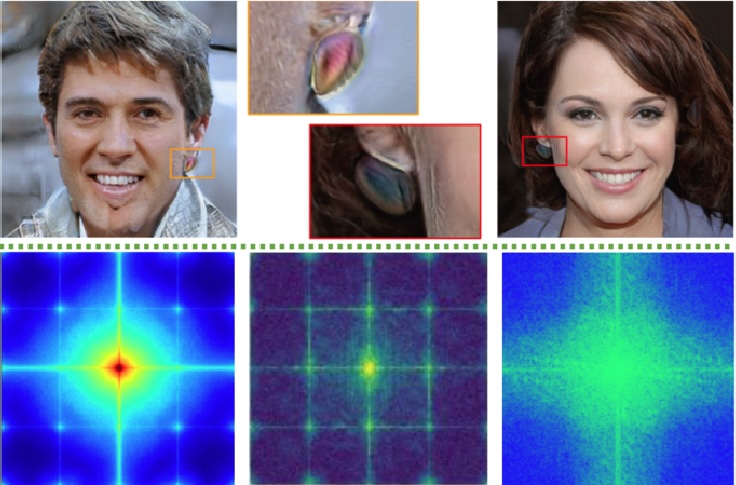

Dette skyldes at deepfakes skapes av maskinlæringssystemer som etterlater seg subtile digitale mønstre.

Disse mønstrene er for små eller komplekse til at det menneskelige øyet kan se dem. Men de kan oppdages av andre algoritmer.

Et pålitelig AI-videoverifiseringssystem kan analysere flere lag av en video samtidig, inkludert

- Analyse på rammenivå sjekker hver frame for visuelle feil som merkelige teksturer, feilaktig lyssetting eller problemer med blanding rundt ansikter.

- Analyse av temporal koherens ser på bevegelser på tvers av bilder for å finne unaturlige hopp eller inkonsekvente bevegelser.

- Sporing av landemerker i ansiktet overvåker øyebevegelser, blunking og ansiktsform for å oppdage unaturlige endringer.

- Test av audiovisuell synkronisering sjekker om leppebevegelsene stemmer nøyaktig overens med de talte ordene.

- Kriminalteknikk for lyd analyserer stemmen for tegn på kloning, for eksempel uvanlige lydmønstre eller robotaktige toner.

- Metadata og komprimeringsanalyse Det er viktig å undersøke skjulte fildata for å se om de stemmer overens med de opprinnelige opptaksdetaljene.

Utdanning av juridiske team om videosvindel

Siden kunstig intelligens nå kan etterligne menneskelig atferd med skremmende nøyaktighet, bruker advokatfirmaer automatisert bevisanalyse og en blanding av tradisjonelle taktikker for å holde seg i forkant.

| Kategori | Metode | Beskrivelse |

| Offisielle måter | CLE-poeng (videreutdanning i rettsvitenskap) | Obligatoriske eller valgfrie kurs som lærer advokater å autentisere digitale bevis, forstå deepfakes og oppfylle bevisstandarder. |

| Rettsoppnevnte AI-eksperter | Etablering av sertifiserte AI-rettsmedisinske spesialister, på samme måte som DNA-eksperter, for å vurdere omstridte videobevis i retten. | |

| Ikke-offisielle måter | Intern red-teaming | Ansette fagfolk innen cybersikkerhet for å teste om falske eller manipulerte bevis kan slippe gjennom firmaets inntakssystemer. |

| “Vibe Check”-protokollen | Opplæring av ansatte i å oppdage vanlige faresignaler som unaturlig blunking, forvrengte ansiktstrekk eller problemer med leppesynkronisering før de eskalerer til rettsmedisinsk granskning. |

Verktøy og teknologi for evidensvalidering

I 2026 har vi gått forbi den enkle inspeksjonen.

Fordi kunstig intelligens nå er i stand til å lure selv de mest erfarne etterforskerne, bruker juridiske team et spesifikt sett med verktøy for å verifisere at det de ser, er den absolutte sannheten.

Teknologien bak validering av bevismateriale

- Deepfake-detektorer: Dette er spesialiserte programmer som skanner etter GAN-artefakter. Dette er mikroskopiske, matematiske mønstre eller støy som etterlates av AI-modellene som genererer syntetiske ansikter. Mens et menneske ser et ansikt, ser detektoren en digital signatur som ikke hører hjemme der.

- TruthScan er en deepfake-detektor som skanner videoer bilde for bilde etter AI-tegn, som uvanlig blunking, merkelige ansiktsformer eller pikselfeil der et falskt ansikt er lagt til.

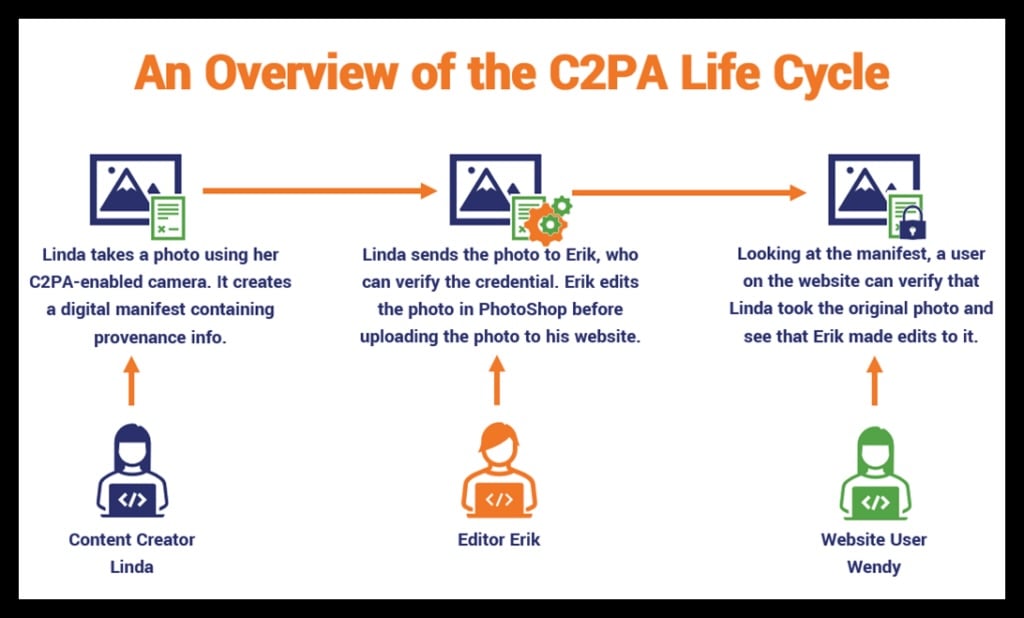

- Blockchain-tidsstempler: For å bevise at en video ikke har blitt rørt siden den ble tatt opp, bruker mange byråer nå C2PA-standarden. Når en video tas opp på en kompatibel enhet, opprettes det et unikt digitalt fingeravtrykk (hash) som lagres i en blokkjede.

- TruthScan kan sjekke om dette fingeravtrykket stemmer overens med videoen, og viser om filen er redigert eller om sporbarhetskjeden er brutt.

- Kriminaltekniske verktøy for metadata: Alle digitale filer har en fødselsattest som kalles Exif-data. Disse verktøyene sjekker om en fil er lagret på nytt i et redigeringsprogram, eller om posisjonsdataene (GPS) er forfalsket. Hvis en video utgir seg for å være fra et butikkamera, men metadataene viser at den er eksportert fra et videoredigeringsprogram, har du et problem.

- Amped Software og TruthScan undersøker skjulte fildata (Exif, overskrifter) for å se om videoen er redigert eller AI-behandlet.

Trender innen AI-videobevis

Her er de tre trendene i 2026.

- Generativ kontradiktorisk kriminalteknikk: AI vs. AI

Den mest avanserte måten å avsløre en deepfake på i 2026 er å bruke den samme teknologien som skapte den. Dette er kjent som Generative Adversarial Forensics.

- En kunstig intelligens (generatoren) prøver å skape en forfalskning, mens en annen kunstig intelligens (diskriminatoren) prøver å fange den opp. I rettssalen kan verktøy som TruthScan være den ultimate diskriminatoren.

- Eksempel: En saksøker sender inn en video av en administrerende direktør som inngår en muntlig kontrakt. TruthScan skanner videoen ved hjelp av sine egne kontradiktoriske modeller for å oppdage GAN-artefakter. Hvis programvaren flagger en 98%-syntetisk sannsynlighet, er beviset sannsynligvis en forfalskning for å lure menneskelige øyne.

- Synkroniseringsanalyse av lyd og video (0,01 ms-regelen)

Mennesker kan vanligvis oppdage en forsinkelse hvis lyden i en video er 40-80 millisekunder feil. Deepfakes fra 2026 er imidlertid ofte nesten perfekte.

- Moderne AI-verktøy for kriminalteknikk ser nå etter en forsinkelse på 0,01 millisekunder mellom den fonetiske lyden av et ord og den mekaniske bevegelsen av leppene.

- Eksempel: I en trakasseringssak fra 2026 hevdet en tiltalt at en video var forfalsket. En rettsmedisinsk, automatisert bevisanalyse viste at leppeformene “M” og “B” var 0,02 ms usynkronisert med lyden. Denne mikroskopiske feilen beviste at stemmen var klonet og lagt over en annen video, noe som førte til en avvisning.

- Cheapfakes vs. Deepfakes

Mens deepfakes bruker avansert kunstig intelligens, er cheapfakes den vanligste formen for videosvindel.

- En Deepfake skaper en virkelighet som aldri har skjedd (som et ansiktsbytte). En Cheapfake tar ekte opptak og endrer konteksten eller hensikten ved hjelp av enkle verktøy.

- Eksempel (nedbremsingen): En video av en politiker som virker beruset eller påvirket, kan enkelt lages ved å senke hastigheten på opptaket med 20% og justere lydhøyden.

- Eksempel (Den nye konteksten): Opptak fra en protest i et annet land i 2022 blir lagt ut i 2026 som direkte bevis på et lokalt opprør. Juridiske team bruker nå TruthScans metadataanalyse for å bevise videoens faktiske fødselsdato.

Hvordan TruthScan beskytter juridisk videobevis

TruthScan sørger for at hvert eneste bilde du presenterer i retten, er autentisk, verifisert og juridisk holdbart.

Plattformen effektiviserer AI-videoverifisering gjennom følgende fordeler

Automatiserte revisjonslogger og dokumentasjon av sporbarhet

- Rettsklar pålitelighet: Genererer PDF- og JSON-rapporter som dokumenterer hvert verifiseringstrinn med nøyaktige konfidenspoeng og tidsstempler.

- Overensstemmelse i toppsjiktet: Du kan være trygg på at dataene dine forblir sikre og oppfyller strenge globale standarder som SOC 2, ISO 27001 og GDPR.

- Fleksibel datakontroll: Hold sensitivt bevismateriale innenfor den nødvendige jurisdiksjonen med lokale eller VPC-distribusjonsalternativer som er utviklet for sterkt regulerte bransjer.

Batchbehandling og API-integrasjon for juridiske arbeidsflyter

- Enorme tidsbesparelser: Behandle tusenvis av filer fra oppdagelsespakker eller overvåkingssett samtidig ved hjelp av import av masselagring (S3/GCS).

- Sømløs E-Discovery: Effektiviser driften ved å integrere verifisering direkte i eksisterende programvare via webhooks og API-er.

- Eliminer manuelle feil: Automatiser den første gjennomgangen av bevismaterialet, slik at teamet ditt kan fokusere på strategi i stedet for kjedelig fil-for-fil-sjekk.

Sanntidsverifisering for vitneforklaringer og fjernmøter

- Stopp imitasjon: Bruk endepunkter for direktestrømming for å oppdage om en vitne bruker deepfake-filtre eller stemmekloner under en ekstern høring.

- Opprettholde domstolens integritet: Flagg visuelle eller lydavvik i sanntid, slik at falske vitneutsagn ikke kommer med i protokollen.

- Trygghet i sinnet: Gi klientene dine og retten et ekstra sikkerhetslag som garanterer at personen på skjermen er akkurat den han eller hun utgir seg for å være.

Lær mer om sikring av AI-videobevis

Beskytt firmaet ditt mot risikoen ved manipulerte medier. TruthScans deepfake-detektor og AI-videodetektorteknologi gir den ultimate løsningen for e-discovery og juridisk verifisering.

Er du klar til å se TruthScan i aksjon?

- Besøk truthscan.com for å få 20 000 kreditter gratis.

- For bedriftsforespørsler, API-integrasjon eller tilpassede distribusjonsalternativer, ta kontakt med teamet deres på Truthscan.com/kontakt.