En omfattende guide til å forstå, oppdage og forebygge AI-stemmebrudd i bedriften

Samtalen til $25 millioner som aldri fant sted

I februar 2024 mottok en økonomimedarbeider i et multinasjonalt selskap i Hongkong en videosamtale fra finansdirektøren sin.

Stemmen i den andre enden var umiskjennelig; hvert tonefall, hver pause og til og med den svake aksenten ble umiddelbart gjenkjent.

Han ba henne om å behandle 15 bankoverføringer på til sammen $25 millioner for å sluttføre et konfidensielt oppkjøp.

Aldri bekymre deg for AI-svindel igjen. TruthScan Kan hjelpe deg:

- Oppdage AI generert bilder, tekst, tale og video.

- Unngå stor AI-drevet svindel.

- Beskytt dine mest følsom virksomhetens eiendeler.

Finansdirektøren tok aldri den samtalen. Den var fullstendig AI-generert.

Dette var ikke et isolert tilfelle. Finansinstitusjoner opplever en kraftig økning i deepfake-svindel.

I løpet av de siste tre årene har antallet saker økt med 2,137%, og AI står nå for 42,5% av alle svindelforsøk i sektoren.

Selv med den kraftige økningen i AI-stemmebruk innrømmer over halvparten av bedriftslederne at de ansatte ikke har fått opplæring i å oppdage eller reagere på deepfake-angrep; nesten 80% av bedriftene har ingen formelle protokoller på plass for å håndtere disse hendelsene.

Hvordan AI-stemmekloning fungerer og hvorfor det er en trussel

Moderne AI-stemmesyntese trenger overraskende lite data. Bare noen få sekunder med lyd kan klone en stemme med opptil 85% nøyaktighet.

Prosessen består av tre hovedtrinn:

- Datainnsamling: Svindlere samler inn stemmeprøver fra offentlige kilder som konferansesamtaler, podkastintervjuer, klipp fra sosiale medier eller til og med videoinnlegg på LinkedIn.

- Modellopplæring: AI analyserer vokale egenskaper som tonehøyde, tonefall, aksent, tempo og pustemønster.

- Generasjon: Systemet skaper syntetisk tale som er overbevisende nok til å lure selv nære kolleger.

Tilgjengelighetsproblemet

Det som gjør denne trusselen enda farligere, er demokratiseringen av den. Svindlere trenger ikke lenger ressurser på Hollywood-nivå.

Alt som kreves, er en tilgjengelig programvare for å klone en stemme fra et kort klipp fra sosiale medier. Mange offentlig tilgjengelige verktøy, inkludert forbruker AI tekst til tale plattformer, kan misbrukes til å generere overbevisende syntetisk lyd.

Hvorfor ledere er toppmål for svindel

Ledere står overfor en farlig blanding av risikofaktorer.

De er synlige i sosiale medier, noe som gjør det lett å finne stemmeprøver, og deres autoritet får ofte de ansatte til å handle raskt på hasteforespørsler.

I gjennomsnitt har én av fire ledere begrenset forståelse av deepfake-teknologi.

Aktuell statistikk tegner et bekymringsfullt bilde

I en 2024 Deloitte-undersøkelse25,9% av lederne sa at organisasjonen deres hadde blitt utsatt for minst én deepfake-hendelse rettet mot finans- eller regnskapsdata det siste året, og halvparten av alle respondentene trodde at slike angrep ville øke i løpet av de neste 12 månedene.

Mest bekymringsfullt: Bare 52% av organisasjonene føler seg trygge på at de kan oppdage en deepfake av deres CEO.

Slik oppdager du AI Voice-svindel

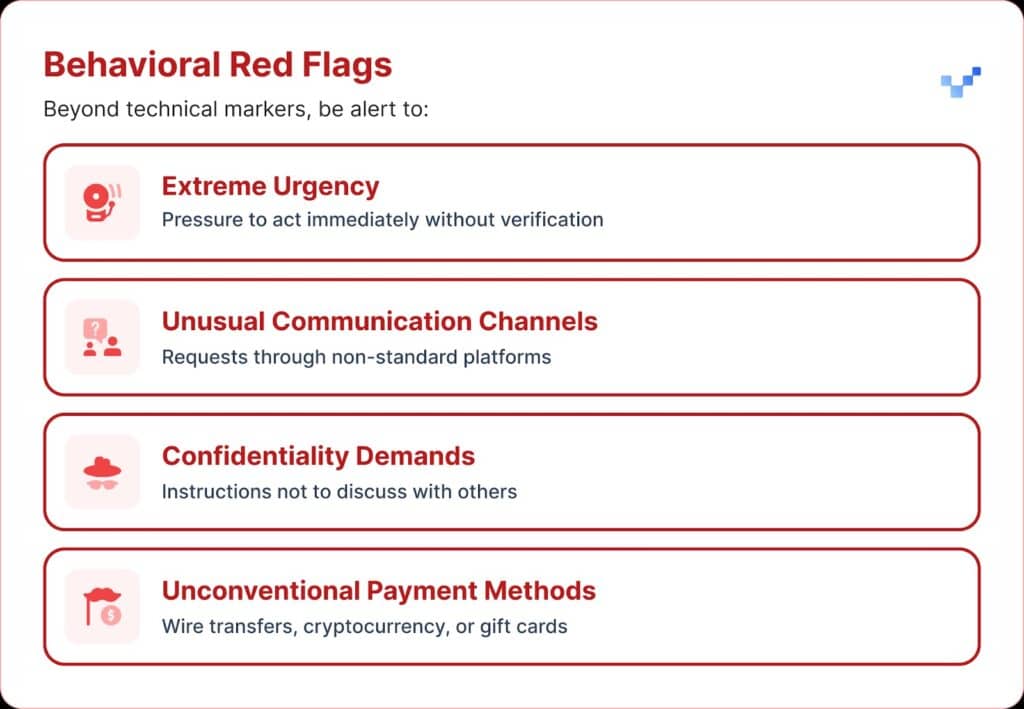

Når du mottar en mistenkelig talekommunikasjon, er det noen faresignaler du bør se etter.

AI-stemmesvindel høres ofte monotont eller flatt ut. Du kan også legge merke til uvanlig tempo, med merkelige pauser eller en unaturlig rytme.

Lyden kan også inneholde en svak elektronisk summing eller ekko, spesielt under lengre samtaler.

Og i mange tilfeller gjentar stemmen begrensede fraser som virker innstuderte eller innøvde.

Økonomiske konsekvenser og hva det egentlig koster

De fleste organisasjoner tapte i gjennomsnitt rundt $450 000, men i finanssektoren steg tapene til over $603 000.

Og i de mest alvorlige tilfellene rapporterte 1 av 10 organisasjoner om tap på mer enn $1 million.

Denne trenden har vokst raskt. Tidligere undersøkelser fra 2022 viste at den gjennomsnittlige økonomiske byrden ved identitetssvindel var på rundt $230 000, nesten halvparten av dagens tall.

Beregnede fremtidige tap

Ifølge Deloittes Center for Financial Services kan pengetapet som følge av AI-svindel i USA øke fra $12,3 milliarder i 2023 til $40 milliarder innen 2027. Det tilsvarer en vekst på 32% hvert år.

Regional sårbarhet

Nord-Amerika opplevde en økning på 1740% i deepfake-svindel.

Denne betydelige regionale økningen tyder på at Nord-Amerika kan være et hovedmål for deepfake-svindlere, sannsynligvis på grunn av landets store digitale økonomi og utstrakte bruk av nettbaserte tjenester.

Strategiske tilnærminger til lederbeskyttelse

1. Implementere verifiseringsprotokoller

En måte å styrke forsvaret på er å bruke et "safe word"-system, dvs. forhåndsavtalte autentiseringsfraser som deles med nøkkelpersoner.

En svindler som bruker AI-stemmekloning, vet ikke de riktige svarene på personlige verifiseringsspørsmål.

En annen sikkerhetsmekanisme er verifisering i flere kanaler.

Alle uvanlige økonomiske forespørsler bør bekreftes gjennom en separat kommunikasjonskanal, og man må aldri bare stole på den opprinnelige kontaktmetoden.

Bedriftene bør også sette opp klare regler for eskalering, med ventetider og godkjenningstrinn for store finansielle transaksjoner, uansett hvem som ber om dem.

2. Vær oppmerksom på digital eksponering

Et annet lag med beskyttelse er å begrense hvor mye lyd og video som er tilgjengelig på nettet. Jo flere eksempler svindlerne kan samle inn, desto mer overbevisende blir klonene deres.

Det er også nyttig å fastsette klare retningslinjer for ledere i sosiale medier, spesielt når det gjelder å legge ut videoer med ren lyd.

Og når det gjelder konferanser, bør organisasjoner være oppmerksomme på innspilte foredrag eller intervjuer som gir bort lange strekk med stemmeprøver.

3. Implementere tekniske løsninger

Det er her avansert AI-deteksjonsteknologi blir avgjørende.

Organisasjoner trenger talegodkjenning og -autentisering i bedriftsklasse deepfake-deteksjon evner som gir:

- Analyse i sanntid: Oppdager syntetiske stemmer under live-kommunikasjon

- Historisk verifisering: Analysere innspilte samtaler og meldinger for å sikre autentisitet

- Integrasjonskapasitet: Fungerer sømløst med eksisterende kommunikasjonsplattformer

- Høy nøyaktighetsgrad: Minimerer falske positiver og fanger opp sofistikerte forfalskninger

4. Omfattende opplæringsprogrammer

Ledergrupper trenger målrettet opplæring i AI-stemmetrusler og verifiseringsprosedyrer.

Like viktig er det å bevisstgjøre de ansatte.

Alle, uansett rolle, bør være rustet til å oppdage potensielle deepfakes og forhindre at cybertrusler kommer inn i organisasjonen.

Regelmessige simuleringsøvelser kan styrke denne beredskapen ved å bruke falske forsøk på stemmesvindel til å teste og forbedre responsrutinene.

Avanserte AI-løsninger for stemmegjenkjenning

Tradisjonelle forsvarsverk er bygget for nettverksbaserte trusler, ikke for AI-drevet etterligning av mennesker.

De viktigste årsakene til at standard cybersikkerhetsverktøy ikke kan håndtere stemmebasert sosial manipulering:

- Ingen signatur for skadelig programvare: Taleanrop utløser ikke tradisjonelle sikkerhetssystemer

- Menneskelig tillitsfaktor: Folk stoler naturlig nok på det de hører, spesielt kjente stemmer

- Mangler i deteksjonsteknologien: Til tross for økningen i AI-drevne svindelforsøk, inkludert deepfakes, er det bare 22% av finansinstitusjonene som har implementert AI-baserte verktøy for å forebygge svindel

Behovet for spesialisert stemmedeteksjon

Moderne stemmesvindel krever moderne deteksjonsfunksjoner.

Bedriftsklasse AI-systemer for stemmedeteksjon kan:

- Analyser vokale biomarkører: Oppdage subtile uoverensstemmelser i syntetisk tale

- Sanntidsbehandling: Gir umiddelbar varsling ved mistenkelige anrop

- Kontinuerlig læring: Tilpasning til nye stemmesyntese-teknikker

- Klar for integrering: Arbeid med eksisterende kommunikasjonsinfrastruktur

Organisasjoner som mener alvor med å beskytte seg mot stemmesvindel, må investere i spesialutviklet AI-deteksjonsteknologi som kan matche de sofistikerte truslene de står overfor.

Stemmesvindel er her nå, og det eskalerer

I første kvartal av 2025 forårsaket deepfake-svindel og identitetstyveri over $200 millioner i tap.

Stemmephishing med AI-kloner økte med 442%, og mer enn 400 bedrifter om dagen blir rammet av svindelforsøk med falske administrerende direktører eller finansdirektører.

Mens 56% av virksomhetene sier at de føler seg svært trygge på å oppdage deepfakes, er det bare 6% som faktisk har unngått å lide økonomiske tap på grunn av dem.

Det avgjørende er ikke om organisasjonen din vil bli utsatt for angrep, men om dere er klare for det.

Stemmesvindel endrer cybersikkerheten. Tradisjonelle forsvarsverk klarer ikke å holde tritt med AI-drevne etterligninger.

For å holde seg beskyttet trenger organisasjoner bedre deteksjonsverktøy, solide opplæringsprogrammer og klare verifiseringsprosedyrer.

Teknologien for å slå tilbake er allerede her. Spørsmålet er bare om du vil bruke den før eller etter den første hendelsen med stemmesvindel.