はじめにAIによる攻撃の新時代

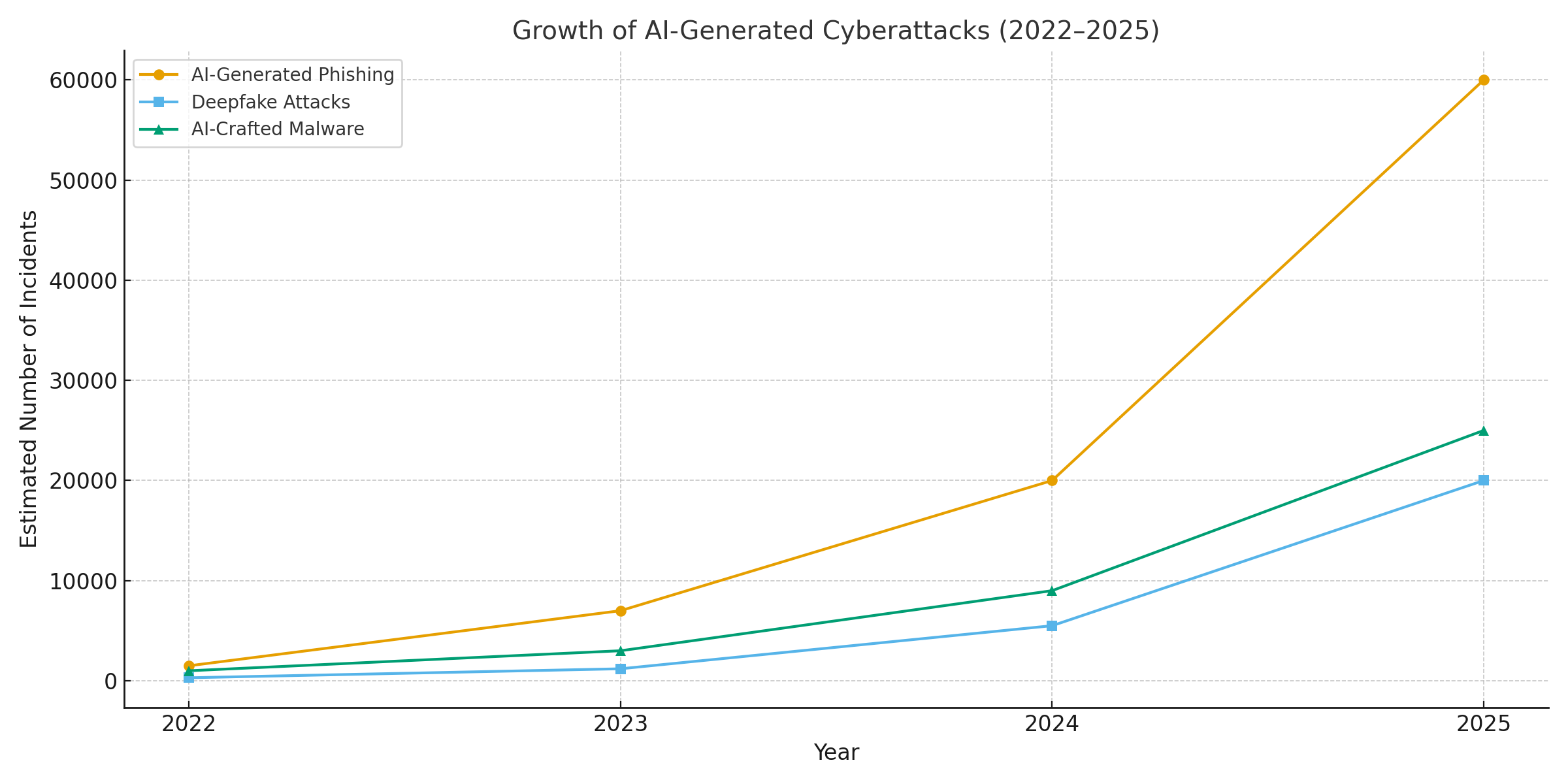

2025年、サイバーセキュリティは転換期を迎えた。ジェネレーティブAIがサイバー攻撃を急増させ、脅威の主体がより多くの攻撃を仕掛けることを可能にした。 頻繁で、現実的で、スケーラブル キャンペーンはかつてないほど活発になっている。実際、過去1年間で 報告されたサイバーインシデントの16%が、AIツールを活用した攻撃者によるものだった (画像や言語生成モデルなど)を使ってソーシャル・エンジニアリングを強化する。[1].非常に説得力のあるフィッシングメールからディープフェイクのオーディオ/ビデオ詐欺まで、悪意のある行為者はあらゆる分野でAIを武器にしている。現在、セキュリティ専門家の大多数が、AIを悪意のある行為に利用していると考えている。 サイバー攻撃の急増はAIによるものこれにより、悪質業者は被害者をより迅速かつスマートに悪用できるようになる。[2].ジェネレーティブAIは、サイバー犯罪のスキルを効果的に引き下げると同時に、その可能性を高めている。

なぜそんなに気になるのか? AIは、訓練されたユーザーをも欺く、洗練された文脈を意識したコンテンツを瞬時に作り出すことができる。AIは恐ろしい精度で声や顔になりすますことができ、検知を逃れるために変形する悪意のあるコードを生成することさえできる。その結果、サイバー攻撃は検出が難しくなり、実行が容易になっている。その 世界経済フォーラム 72%の組織が、ジェネレーティブAIの能力向上により、サイバーリスク(特にソーシャルエンジニアリングと詐欺)が増加していると警告している。[3].現実世界の事件がこれを裏付けている:2024年初頭、犯罪者がAIによって生成された ディープフェイク・ビデオコール 会社のCFOになりすまし、従業員を騙して転勤させる。 $2560万ドル 詐欺師たちへ[4].また別のケースでは、北朝鮮のハッカーが AIが生成する偽造身分証明書 防衛フィッシング・キャンペーンでセキュリティ・チェックを回避するために[5].これらの例は、AIが人間や技術的なコントロールを迂回する詐欺に力を与えていることを浮き彫りにしている。

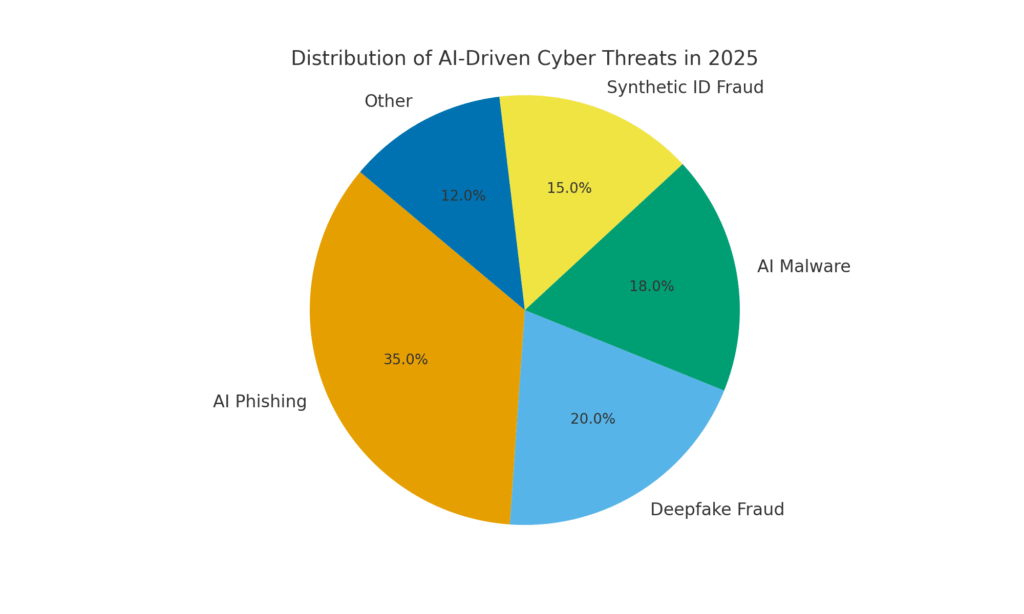

しかし、AIもまたソリューションの一部である。TruthScanのような)高度な検知ツールはAIを使用している。 に対して AI - コンテンツを分析し、機械生成の微妙な兆候を探る。このホワイトペーパーでは、2025年のAIによるサイバー脅威のトップと、組織がそれらをどのように軽減できるかを検証する。以下より AIが生成するフィッシング への ディープフェイクCEO詐欺, AIが作成したマルウェア, 合成アイデンティティなど、ジェネレーティブAIがどのように攻撃を再構築しているのかを探る。また、以下のような具体的な防御策についても議論する。 AIコンテンツ検出ディープフェイク・フォレンジック、本人確認技術など、セキュリティチームが再び優位に立つための技術を紹介する。その目的は、企業、MSSP、CISO、詐欺調査担当者がどのようにすれば以下のことができるかを明らかにすることである。 AI検知ツールをサイバーセキュリティ・スタック全体に統合する AIを駆使したこの脅威の波に対抗するために。

もうAI詐欺を心配する必要はない。 TruthScan あなたを助けることができる:

- AIが生成したものを検出する 画像、テキスト、音声、ビデオ。

- 避ける AIによる大規模な詐欺

- 最も大切なものを守る 繊細 企業資産。

AIが生み出すフィッシングとBEC:かつてない規模の詐欺行為

ジェネレーティブAIの最も明確な影響のひとつは、フィッシングや詐欺にある。 ビジネスメール侵害(BEC) スキームAI言語モデルは、流暢で文脈に合わせたEメールを数秒で作成することができ、かつてはフィッシングを見破られた文法の間違いやぎこちない言い回しを排除することができる。その結果、非常に説得力のある詐欺メールやテキストが氾濫することになる。2025年4月までに、 スパムメールの半数以上(51%)がAIによって書かれていた。2年前はほぼゼロだった[6].さらに憂慮すべきことに、研究者たちは次のことを発見した。 BEC攻撃メールの14%はAIが作成したものだった 2025年までに[7] - この数字は、犯罪者がChatGPTのようなツールを採用するにつれて上昇すると予想されている。いくつかの研究では 80%以上 フィッシングメールの作成にAIが関与している可能性[8].

こうしたAIが生成する誘い文句の量が爆発的に増加している。セキュリティー分析によると、生成AIに関連するフィッシング攻撃は以下のように急増している。 1,265% あっというまに[9].ある期間に、フィッシング事件の報告が急増した。 466%自動化されたフィッシングキットやボットがカスタマイズされた餌を送り出すことが主な原因である。[9][10].なぜこんなに急増したのか?AIが攻撃者に スケール 彼らの活動は劇的に変化する。一人の犯罪者がAIチャットボットを使って 数千 従業員や顧客をターゲットとした、パーソナライズされた詐欺メールが、これまで1通作成するのにかかっていた時間で作成できるようになるのだ。このような大量自動化により、FBIは、BECによる被害(2022年にはすでに17億件に達している)は、AIによって「被害がさらに拡大する恐れがある」として、さらに加速するだろうと警告している。[11][12].

フィッシング・メールが増えているだけでなく、次のようなことも起きている。 より効果的.被害者は、AIが取り入れることのできる洗練された言葉や文脈の詳細によって、より高い確率で騙される。ラボのテストでは、AIが作成したフィッシング・メールは、以下のような結果を出している。 54%のクリックスルー率 - 従来のフィッシングの試行における~12%をはるかに上回る。[13].このようなメッセージは、本物のCEOの文体のように読んだり、実際の会社の出来事について言及したりすることで、受信者の警戒心を低下させる。攻撃者は、AIを使ってさまざまな言い回しをA/Bテストし、最も成功するフックを反復することさえある。[14].そして人間と違って、AIはタイプミスをしたり、疲れたりしない。フィルターをすり抜けて誰かを騙すまで、無限に亜種を吐き出すことができる。

ケース・イン・ポイント 2025年半ばには ロイター 調査により、東南アジアの詐欺師が ChatGPT を利用して詐欺のコミュニケーションを自動化していたことが明らかになった。[15].彼らは、説得力のある銀行のEメールや顧客サービスのテキストを大量に作成し、スキームのリーチを大幅に増加させた。ヨーロッパの警察も同様に、ダークウェブ上でAIを使ったフィッシングキットが$20以下で販売されていることを報告しており、低スキルの行為者が洗練されたキャンペーンを展開することを可能にしている。[16][17].BECやフィッシングの参入障壁は実質的に消滅した。

防御策 - AIフィッシュを阻止する: このような猛攻を受け、企業はEメールとメッセージング・チャネルを強化しなければならない。そこで AIコンテンツ検出 が役立ちます。以下のようなツールがある。 TruthScanのAIテキスト検出器 と専門的な メールスキャナー は、AIが生成したテキストの統計的マーカーについて、受信メッセージを分析することができる。例えば TruthScan電子メール詐欺検出器 自然言語解析により、たとえ正当なメールであっても、AIから発信された可能性の高いメールにフラグを立てる。[18].これらの検出器は、完璧に洗練された文法、文の複雑さ、人間のライターには珍しい文体パターンなどを調べます。そして リアルタイムスキャン不審なメールは、ユーザーに届く前に隔離されたり、確認のためのフラグが立てられたりする。企業のセキュリティチームは、メールゲートウェイやメッセージングプラットフォームにこのようなAI駆動型フィルタを導入し始めている。実際には、これは従来のスパムフィルターの上に、AIが書いたコンテンツをキャッチするように明確に調整された防御の新しいレイヤーを追加するものである。2025年現在、大手企業はTruthScanのようなソリューションをAPI経由でセキュアなメールゲートウェイやクラウドコラボレーションスイートに統合し、以下のような自動チェックポイントを構築している。 AIが生成するフィッシング の内容だ。

ディープフェイクの声とビデオのなりすまし:百聞は一見にしかず」詐欺の手口

2025年におけるAIによる最も直接的な脅威は、おそらく次のようなものだろう。 ディープフェイク・ボイス&ビデオ攻撃.AIモデルを使えば、犯罪者はわずか数秒の音声から人物の声をコピーしたり、数枚の写真からリアルな顔の動画を生成したりすることができる。このようなディープフェイクは、CEO詐欺(「偽CEO」コール)から偽のビデオ会議など、高額ななりすまし詐欺に利用されている。最近の業界報告で明らかになった 47%の組織がディープフェイク攻撃を経験している 何らかの[19].2023年から2025年にかけて行われた複数の強盗事件によって、ディープフェイクは究極の認証である私たち自身の目と耳を打ち負かすことができることが証明された。

ある悪名高い事件では、国際銀行送金に関わるものだった。 $2500万ドル 従業員がディープフェイクのビデオ会議に騙されたためである。攻撃者はAIを使って、Zoom通話で同社のCFOの似顔絵を合成し、彼女の声と物腰を完全に再現して、従業員に資金を送金するよう指示した。[4][20].オーストラリアの別の事件では、地方自治体が $230万ドルの損失 詐欺師が不正な支払いを承認するために、市職員の声と映像の両方を偽装した場合[21].そして不穏なことに、犯罪者はAIでクローン化された声を「祖父母詐欺」に使っている。その FBI そして フィンセン を使った詐欺の急増について、2024年後半に警告を発した。 AIが生成する「ディープフェイク」メディアKYCの検証を回避するための偽の顧客サービス担当者や合成IDを含む。[22].

ディープフェイクに基づく犯罪の頻度は急速に上昇している。ある分析によると、2024年末までに 新しいディープフェイク詐欺が5分おきに発生していた 平均して[23].2025年第1四半期だけで、報告されたディープフェイク事件は19%急増した。 すべて 2024年[24][25].ディープフェイクは現在、推定で 詐欺攻撃全体の6.5%, a 2022年以降2137%増加[26][27].必要な技術は簡単に入手できるようになり、多くの場合、必要なのはほんのわずかである。 30秒間の音声 声のクローンを作ったり、1時間弱のサンプル映像で人の顔を納得のいくようにモデリングする。[20].つまり、これほど簡単なことはないのだ。 「なりすまし 被害者を騙して金銭や情報を渡すように仕向ける。

防御策 - 現実の認証: ディープフェイクの脅威に対抗するため、組織は先進的な技術に目を向けている。 合成媒体検出 道具を使う。例えば TruthScanのAI音声検出器 そして TruthScanディープフェイク検出器 は、AIを使って音声や映像を分析し、操作の痕跡を見つける。これらのシステムは、フレームごとの解析や波形解析を行い、不自然な顔の動き、リップシンクの問題、AIが作成したクリップを裏切る音声スペクトルの不規則性などのアーティファクトを発見する。テストでは、TruthScanのアルゴリズムは以下を達成しました。 99%+、AIが生成した声の識別精度 操作されたビデオフレームをリアルタイムで検出[28][29].実際、Genians Security Centerの研究者は最近、TruthScanの画像フォレンジックを使用して、北朝鮮のハッカーが使用した偽のIDカードを分析しました。 98%自信スピアフィッシングを阻止[5][30].

実用的な防御のために、企業はこれらの検知機能を重要なチョークポイントに配備している。 音声認証 例えば、"クライアント "が電話で多額の送金を要求した場合、音声をディープフェイク検出器にかけて、(AIの真似ではなく)本当に本人であることを確認することができる。同様に ビデオ会議プラットフォーム は、参加者のビデオストリームのライブディープフェイクスキャンを統合し、あらゆる合成顔をキャッチすることができます。例えば、TruthScanのディープフェイク検出スイートは以下を提供します。 リアルタイムビデオ通話分析と顔認証 API経由でZoomやWebExにプラグイン可能[31][29].つまり、AIが作成したCEOのビデオを使って誰かが会議に参加しようとした場合、システムは被害が及ぶ前に「ディープフェイクの可能性」にフラグを立てることができる。さらに、重要なトランザクションには、コンテンツ認証を活用した検証ステップ(帯域外または多要素)が含まれることが多くなっている。これらのツールを重ねることで、企業はセーフティネットを構築することができる。 見る または 聞く もっともらしいことを言っても、舞台裏のAIフォレンジックはその実態に疑問を呈するだろう。AIが浸透した脅威のランドスケープにおいて、 "信用するな - 検証せよ" は、金銭や機密アクセスを伴う音声またはビデオ通信のマントラとなる。

AIが作り出したマルウェアと難読化されたコード:進化するコードの脅威

AIの影響力はソーシャル・エンジニアリングにとどまらず、マルウェアの開発や回避攻撃コードにも変化をもたらしている。2025年、グーグルのスレット・インテリジェンス・グループは、次のようなものを発見した。 AIを利用した最初のマルウェア株 期間中 行動を変えるための実行[32][33].その一例が、こう呼ばれている。 プロンプトフラックスこの悪意あるスクリプトは、AI API(グーグルのGeminiモデル)を実際に呼び出すもので、次のようなものだった。 その場でコードを書き換えるアンチウイルスの検出を回避するため、難読化された新しい亜種を作り出す[34][35].この「ジャスト・イン・タイム」のAIの進化は、自律的でポリモーフィックなマルウェアへの飛躍を意味する。もうひとつのサンプル、 PROMPTSTEALAIコーディング・アシスタントを使用して、データ窃盗のための1行のWindowsコマンドを生成し、実質的にロジックの一部をリアルタイムでAIエンジンにアウトソーシングした。[36][37].これらの技術革新は、マルウェアが防御を破るために、人間のペン・テスターのように、自分自身を継続的に変形させることができる未来を指し示している。

オンザフライAIでなくとも、攻撃者は開発中にAIを使用して、より強力な悪意のあるコードを作成している。ジェネレーティブAIは、以下のようなマルウェアを作り出すことができる。 難読リバース・エンジニアリングの妨げとなる、混乱を招くロジックが何層にも重なっている。脅威情報によれば 2025年に発生した大規模な情報漏えいのうち、70%以上が何らかのポリモーフィック・マルウェアに関与していた。 検知されないようにシグネチャや動作を変更する[38].加えて、 フィッシングキャンペーンの76% 現在では、動的URLやAIが書き換えたペイロードのようなポリモーフィックな戦術を採用している。[38].ダークウェブのようなツール ワームGPT そして 不正GPT (ChatGPTの無制限クローン)は、専門家でなくても、欲しいものを記述するだけで、マルウェアドロッパー、キーロガー、ランサムウェアコードを生成することができます。[39].その結果、新たなマルウェアの亜種が大量に発生した。例えば、2024年には ブラックマンバ が出現した。 完全にAIが生成ChatGPTを使用してコードを分割して記述するため、実行するたびにわずかに異なるバイナリが生成され、従来のシグネチャベースのアンチウイルスを混乱させる。[38].セキュリティ研究者はまた、多くのエンドポイント保護を回避できる、AIが生成したポリモーフィック概念実証を実演した。[40].

その上、攻撃者はAIを活用して攻撃方法を微調整している。 配達 マルウェアのAIは、マルウェアのリンクを含むフィッシングメールをインテリジェントにスクリプト化することができる。また、新たな脆弱性の発見やシェルコードの最適化にAIを利用するなど、エクスプロイトの開発にも役立てることができる。例えば、AIを使用して新しい脆弱性を発見したり、シェルコードを最適化したりするような場合です。国家行為者は、ゼロデイ・エクスプロイトの発見やターゲットに合わせたマルウェアの開発を支援するために、高度なAIモデルを使用していると報告されています。[41].このような傾向はすべて、2025年のマルウェアがよりステルス化し、より適応的になることを意味している。マルウェアはしばしば 「AIとの「共創そのため、従来のルールでは検出が難しくなっている。

防御策 - マルウェア防御におけるAI対AI: AIが作成したマルウェアを防御するには、防御側で高度な検知とAIを活用した分析を組み合わせる必要があります。多くの組織では エンドポイントプロテクションとEDR(エンドポイントディテクション&レスポンス) AI/MLモデルを使って、AIが生成したコードの行動パターンを探します。例えば、突然のホスト上でのコード変換や異常なAPI呼び出しパターンは、PROMPTFLUXがそれ自体を再生成しているようなことを示しているかもしれない。同様に、ネットワーク監視は、マルウェアがAIサービスに接触するような異常(ユーザーアプリケーションにとっては「正常」ではない)をキャッチすることができる。ベンダーは、MLベースの検出器を ファミリー これまでに確認されたAI支援型マルウェアのうち、これらの新しい脅威の認識を向上させる。

新たなソリューションのひとつは 開発パイプラインとビルドパイプラインに統合されたAIコンテンツスキャン.これは、スクリプト、ソフトウェアビルド、さらには悪意のあるコンテンツやAIによって生成されたコンテンツの設定変更を分析するために、AI駆動型の検出器を使用することを意味する。例えば TruthScanのリアルタイム検出器 マルチモーダル分析により、難読化パターンを使用して機械的に生成されたコードや設定ファイルを認識し、疑わしいコードや設定ファイルにフラグを立てることができます。[42][43].開発チームやMSSPは、インフラストラクチャ・アズ・コードのスクリプト、PowerShellログ、その他のアーティファクトをスキャンして、攻撃者の手を示す可能性のあるAIが記述したセグメントの兆候を探し始めている。あるセキュリティ・チームは、AI検出器を使って、難読化されたフィッシング・キットのファイルを検出した。[44].そのファイルのコードは複雑で冗長(AI生成の特徴)であり、AIのコンテンツスキャンによって、人間が書いたものではない可能性が高いことが確認された。[40].

最後に、AIの脅威に焦点を当てた脅威インテリジェンスの共有は極めて重要である。Google GTIGがPromptベースのマルウェアの詳細を公表したときや、研究者が新たなAI回避テクニックを報告したとき、組織はそれらを検知エンジニアリングに反映させるべきである。 行動分析学 - 同じプロセスのコードを書き換えるスクリプトをプロセスが生成するようなアクションを探すことで、AI支援型マルウェアが示す異常を発見することができる。要するに、防御側は「火の粉には火の粉で対抗」しなければならないのだ。 AIを活用したセキュリティ・ツール これには、AIを活用したアンチウイルスから、アカウントやシステムが "人間らしからぬ "振る舞いを始めたことを特定できるユーザー行動分析までが含まれる。これには、AIで強化されたアンチウイルスから、アカウントやシステムが "人間離れ "した行動を取り始めたことを特定できるユーザー行動分析まで、あらゆるものが含まれる。AIを防御に活用することで、セキュリティ・チームはAIが攻撃者に与えるスピードと規模の優位性に対抗することができる。

合成IDとAIによる詐欺計画

マルウェアから詐欺の世界へ: なりすまし詐欺 は、ジェネレーティブAIの助けを借りて爆発的に増加している。合成ID詐欺は、本物のデータと偽のデータ(例えば、本物のSSN+偽の名前と書類)を組み合わせて架空のペルソナを作成する。これらの「フランケンシュタイン」IDは、銀行口座の開設、クレジットの申請、KYCチェックの通過に使用され、最終的にはローン未払いやマネーロンダリングにつながる。すでに急成長している詐欺のひとつだが、AIが火に油を注いでいる。合成ID詐欺による損失 2023年には$350億ドルを超える[45]そして、2025年初頭には、次のような予測もある。 銀行詐欺被害全体の約25% は合成アイデンティティによるものである。[46].エクスペリアンのアナリストによると 80%を超える新規口座詐欺 特定の市場では、合成IDにリンクしている。[19] - という驚くべき統計は、この詐欺がいかに蔓延しているかを浮き彫りにしている。

ジェネレーティブAIは、いくつかの方法で合成詐欺を増幅させる。まず第一に、AIは以下のようなものを簡単に作り出すことができる。 "ブリーダー資料" と、偽のIDを販売するために必要なデジタル足跡がある。かつては、詐欺師がIDをフォトショップで加工したり、偽の公共料金請求書を手作業で作成したりすることもあった。現在では 本物そっくりのプロフィール写真、身分証明書、パスポート、銀行取引明細書、ソーシャルメディアのプロフィールまで。 AI画像ジェネレーターと言語モデルを使用[47][48].例えば、AIを使って実在しない人物のリアルな顔写真を作成し(簡単な逆画像検索を防ぐ)、その写真と一致する偽の運転免許証を生成することができる。AIはまた、アイデンティティの「生命徴候」をシミュレートすることもできる。 人造人間の両親、住所、ソーシャルメディアへの投稿の記録 バックストーリーに肉付けする[49].ボストン連銀は、Gen AIは次のようなものさえ生み出すことができると指摘している。 ニセモノの音声と映像のディープフェイク - 例えば、自撮り検証ビデオに、AIが生成したユニークな顔や声を持った人工的なユーザーを「登場」させることができる。[50].

第二に、AIは詐欺師を助ける。 スケールアップ の業務が可能になる。一度に1つか2つのIDを偽造する代わりに、プログラムで数百または数千の完全なIDパッケージを生成し、新規口座の申請を一括して自動入力することができる。[51][52].いくつかのダークウェブサービスは、効果的に提供している。 「サービスとしての合成アイデンティティ例えば、COVID-19のパンデミック救済プログラムでは、犯罪者はAIが生成したボットを使って、ローンや給付金の申請を一斉に行った。例えば、COVID-19のパンデミック救済プログラムでは、犯罪者はAIが生成したIDを持つボットを使ってローンや給付金の申請を一斉に行い、偽の申請者でシステムを圧倒した。ジュニパー・リサーチが予測するように、(こうした手口による)デジタルID詐欺の世界的なコストは、以下のようになる。 2030年までに153%上昇 2025年比[53].

防御策 - AI世界における身元確認: 従来の身元証明方法は、AIが作成した偽物に苦戦している。それに適応するため、組織は次のような方法を採用している。 多層的な本人確認と行動確認 AIが強化。重要なレイヤーは高度な 文書と画像のフォレンジック.例えば、 TruthScanのAI画像検出器 そして 偽造文書検知器 は、アップロードされたID、自撮り写真、文書に合成や改ざんの兆候がないか分析する機能を提供します。これらのツールは、ピクセルレベルのアーティファクト、照明の不一致、メタデータを調べ、画像がAIによって生成されたものか、操作されたものかを判断します。GANで生成された写真と同じ背景パターンや、既知の政府テンプレートと一致しないIDのフォントやスペーシングなど、微妙な手がかりをキャッチすることができます。このような検出器をオンボーディング時に導入することで、銀行は申請者の運転免許証や自撮り写真がAIによって生成された可能性が高い場合、自動的にフラグを立てることができる(例えば、TruthScanのシステムはKimsuky APTフィッシング事件で使用された偽の軍用IDにフラグを立てただろう)。[5]).TruthScanのプレスリリースによると、同社のプラットフォームは、金融機関が大規模に文書の真正性を検証するために使用されており、極めて高い精度で深い偽物を識別している。[54].

もうひとつの層は 行動分析学 と相互参照チェック。本物のアイデンティティには、長年の履歴、公的記録、ソーシャルメディアでの活動など、深みがある。AIが生成したアイデンティティは、どんなに洗練されていても、こうした深い根を持たないことが多い。銀行や貸金業者は現在、AIを使って申請データを公開データや独自データと相互に関連付けている:この人物の電話番号や電子メールは利用履歴を示すか?この人物の電話番号や電子メールに利用履歴はあるか?彼らは人間的な方法でフォームにデータを入力しているのか、それとも(ボットが行うように)コピーペーストしているのか?AIモデルは、本物の顧客行動と合成パターンを区別するために訓練することができる。連邦準備制度理事会は次のように指摘している。 「人工的なアイデンティティーは浅い。 - AIベースの検証は、アイデンティティのデジタルフットプリントを素早く検索し、ほとんど見つからない場合はアラームを発することができる。[55].実際、ID認証サービスでは現在、ユーザーの自撮り写真が過去の写真と一致するかどうかをチェックしたり(顔の入れ替わりを検出するため)、さらには、生存性チェックの際にユーザーにランダムなアクション(特定のポーズやフレーズなど)を促したりするAIを採用しており、ディープフェイクが正しく反応することを難しくしている。[56][57].

最後に 連続モニタリング オンボーディング後のアカウント行動の把握は、すり抜けたシンセティック・アカウントの摘発に役立つ。これらの口座は実際のペルソナと結びついていないため、その利用パターンが最終的に目立ってしまうことがよくあります(例えば、完璧なタイミングで取引を行って信用を築き、その後最大限度額まで使い切るなど)。SiftやFeedzaiのプラットフォームのような)AIを活用した不正モニタリングは、口座の使用方法の異常を特定し、潜在的なシンセティックにフラグを立ててレビューすることができる。まとめると、AIを活用したID詐欺との戦いには以下が必要である。 AIによる身元証明 - ドキュメント・フォレンジック、バイオメトリック・チェック、データ相関、行動分析を組み合わせたものである。良いニュースは、不正行為を可能にする同じAIの進歩が、不正行為の検知にも使われていることだ。例えば、TruthScanは次のようなサービスを提供している。 アイデンティティ検証スイート を導入し、テキスト、画像、音声分析を統合して新規ユーザーを審査している。これらのツールを活用することで、ある大手銀行では、業界平均が上昇しているにもかかわらず、人工的な口座開設が大幅に減少した。軍拡競争は続いているが、AIがどんなに痕跡を消そうとしても、防衛側は合成人間のかすかな「デジタル・テロップ」を見破ることを学んでいる。

セキュリティ・スタック全体でAI検知を統合する

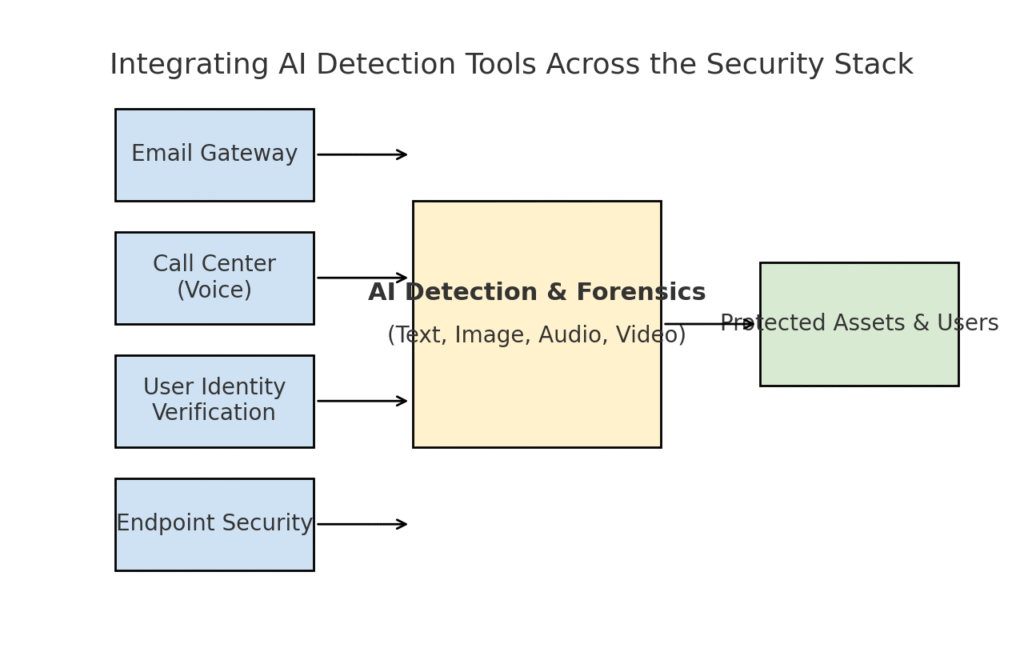

私たちは、フィッシング、ディープフェイク、マルウェア、合成詐欺など、AIによって強化されたいくつかの脅威の分野を調査してきた。それは明らかだ。 単一のツールや1回限りの修正なし が課題を解決する。その代わりに、企業には以下のような包括的な戦略が必要だ。 AIを活用した検知と検証を各レイヤーに組み込む サイバーセキュリティ・スタックのそのアプローチは、電子メール、ウェブ、音声、文書、アイデンティティ、そしてそれ以降をカバーする攻撃対象領域を反映したものでなければなりません。下図は、組織がTruthScanのAI検知ツール(および類似のソリューション)を一般的な企業セキュリティ・レイヤにどのように統合できるかを示している:

メールゲートウェイ、コールセンターからユーザー認証、エンドポイント保護まで、セキュリティスタックの複数のレイヤーにAI検知ツールを統合。AIコンテンツ検知(センター)は、テキスト、画像、音声、動画をリアルタイムで分析し、資産とユーザーを保護する実施ポイントに反映します。

このモデルでは、 マルチモーダルAIディテクターが脳の中枢として働く 様々なセキュリティーコントロールとのインターフェイスである:

- Eメールゲートウェイ: インバウンドメールは、受信トレイに届く前にAIテキスト/詐欺検出器を通過します。これは、私たちが説明したフィッシング詐欺対策と関連しています。 TruthScanの電子メール詐欺検出器 メールプロバイダのAPIを経由して、AIが作成した疑わしいメールを自動的に隔離します。[18].また、メッセージングプラットフォーム(チャットアプリ、SMSゲートウェイ)にも適用でき、フィッシングや詐欺のパターンがないかコンテンツをスキャンすることができる。

- コールセンターと音声システム 電話やVOIPチャネルは、音声ディープフェイク検出を統合することで保護される。例えば、銀行のカスタマー・サポート・ラインでは TruthScanのAI音声検出器 着信者の音声をリアルタイムで分析し、発信者の声紋が合成されたものであったり、既知のプロファイルと一致しない場合に警告を発する。[58][59].これはヴィッシングや音声なりすまし攻撃(偽CEOの電話など)の成功を防ぐのに役立つ。

- ユーザー本人確認プロセス: 口座の作成やリスクの高いユーザー操作(パスワードのリセット、電信送金)の際には、AIによる本人確認が行われる。アップロードされた写真IDは、画像フォレンジック・ツール(AIが生成したものか、写真の写真かをチェックするなど)によって吟味され、自撮り写真やビデオ通話はディープフェイク検出器によってスクリーニングされる。TruthScanの ディープフェイク検出器 顔認証は、カメラに映っている人物が本物であり、IDに一致することを確認するために利用できる。[60][61].行動シグナル(タイピングの頻度、デバイスの一貫性)は、ボットや合成IDを検出するためにAIモデルに供給することもできる。

- エンドポイントとネットワーク: エンドポイントセキュリティエージェントとプロキシサーバは、ファイルやスクリプトのAIコンテンツ分析を組み込むことができます。例えば、エンドポイントEDRが新しいスクリプトやEXEの実行を検出した場合、そのファイルのテキストコンテンツをAI検出器に送信し、既知のAIが生成したマルウェアに似ていないか、または難読化されたAIコードの特徴を示していないかをチェックすることができます。同様に、DLP(データ損失防止)システムは、AIテキスト検出を使用して、AIが生成した機密テキストにフラグを立てることができる(これは、データ流出メッセージの下書きやレポートの改ざんにAIを使用している内部関係者を示す可能性がある)。TruthScanの リアルタイム検出器 は、このようなワークフローにプラグインするように設計されており、自動化された応答オプションでプラットフォーム全体のコンテンツのライブ分析を提供します。[42][62] (例えば、AIが生成したマルウェアや偽情報と特定された場合、ファイルやメッセージを自動ブロックするなど)。

について 主な利点 この統合されたアプローチは スピードと一貫性.フィッシングメール、偽の音声、合成データなど、AI攻撃は一度に多くのチャネルを襲う可能性があります。これらすべてのチャネルにAI検知機能を搭載することで、企業はリアルタイムの可視性と徹底的な防御を得ることができる。あるチームは、企業のための「AI免疫システム」の構築と表現している。何かが伝達されるたびに(電子メール、ドキュメントのアップロード、音声通話など)、AI免疫システムは、異物(AIが生成した)シグネチャを「嗅ぎ分け」、悪意があると判断された場合はそれを無効化する。

TruthScanのエンタープライズ・スイートは、これを体現している。 ユニファイド・プラットフォーム テキスト、画像、音声、映像のAI検出をカバーし、モジュール式または全体として展開可能。[63][64].多くの企業は、1つか2つの機能(例えば、電子メールでのテキスト検出やオンボーディングでの画像検出)を導入することから始め、価値を見出したら他の機能へと拡大していく。 重要なのは、統合が開発者フレンドリーであることだ。 - TruthScanや同様のサービスはAPIやSDKを提供しているため、セキュリティチームは大規模な再設計を行うことなく、既存のシステムに検知をフックすることができる。SIEM、電子メールゲートウェイ、カスタムバンキングアプリ、CRMシステムのいずれであっても、検出は舞台裏で実行され、アラートや自動化されたアクションをフィードすることができる。例えば、ある大手ソーシャルメディア・プラットフォームは、コンテンツ・モデレーションAPIを統合し、アップロードから数分以内にディープフェイク動画を自動的に削除している。[65][66]AIが生成した誤った情報の拡散を防ぐ。

結論一歩先を行く

2025年、AI主導の脅威が急速に拡散し、組織は新たな課題に直面している。攻撃者は、声やIDのなりすまし、ソーシャル・エンジニアリングの自動化、適応性の高いコードによる防御の回避、偽の現実全体の捏造など、人間の信頼を大規模に悪用する手段を発見した。防御側にとっては大変なことだが、絶望的なことではない。犯罪者がAIを活用しているのと同様に、私たちもAIをセキュリティの味方につけることができる。AIの出現 AIコンテンツ検出、ディープフェイク・フォレンジック、合成IDスキャナー は、こうした新たな脅威に対する強力な対抗策を与えてくれる。これらのツールと すべてのレイヤーを統合する の防衛策を導入することで、企業はAIを利用した攻撃がすり抜けるリスクを劇的に減らすことができる。早期導入企業はすでに、ディープフェイクを現行犯逮捕することで、数百万ドル規模の詐欺未遂を阻止している。[26]また、AIが作成したメールをフィルタリングすることで、フィッシング詐欺の被害を防ぐこともできる。

テクノロジーだけでなく、組織は "trust but verify"(信頼するが、検証する)の文化を培うべきである。従業員は、AIの時代には、見る(または聞く)ことは必ずしも信じることではないことを認識すべきである。検証ワークフローと組み合わせた健全な懐疑心は、多くのソーシャル・エンジニアリングの策略を阻止することができる。トレーニングや意識向上と TruthScanのような自動検証ツールこれは強力な防御策となる。ある意味で、私たちは情報の認証と検証のハードルを上げなければならない。デジタル通信や文書はもはや額面通りに受け取ることはできず、その出所を機械やプロセスによってチェックする必要がある。

今後、攻撃者がAIの戦術をさらに洗練させていくことが予想されるが、同時に防御AIの技術革新が進むことも予想される。猫とネズミのダイナミズムは続くだろう。防御側の成功の鍵は 敏捷性と情報共有.新しい脅威インテリジェンス(例えば、新しいディープフェイク検知技術や更新されたAIモデルのシグネチャ)を迅速に取り入れる企業は、最新のAIツールを活用する攻撃者の一歩先を行くことができるだろう。NISTのAIリスクマネジメントフレームワークや、不正AIの検知に関する銀行間の協力のような機関からの警告やフレームワークの出現に見られるように、産学官の協力もこの戦いにおいて不可欠となる。

最後に、サイバーセキュリティ業界はAIによるパラダイムシフトの真っ只中にある。脅威は10年前のそれとは異なりますが、私たちは同様に前例のない防御策でそれに対応しています。高度な検知テクノロジーと強固なセキュリティ戦略の組み合わせにより、私たちは以下のことを実現します。 できる 生成的AIのリスクを軽減し、さらにはそれを有利にする。TruthScanのAI検出スイートのようなツールは、以下を可能にする。 信頼ゼロの世界で信頼を回復する - 電話の相手が本物であること、受信トレイにある文書が本物であること、ネットワークで実行されているコードが悪意のあるAIによって改ざんされていないことを確認するためだ。今、これらの機能に投資することで、組織は今日のAIを利用した攻撃から身を守るだけでなく、明日の進化する脅威に対するレジリエンスを構築することができる。要点は明確だ: AIはサイバー攻撃を急増させるかもしれないが、適切なアプローチをとれば、我々の防御を強化することもできる。

情報源 関連データと事例は、メイヤー・ブラウンのサイバーインシデント・トレンドを含む、2025年の脅威インテリジェンス・レポートと専門家によるものである。[1][67]フォーティネットの2025年脅威総覧[2][19]AIメール攻撃に関するバラクーダの調査[6][7]グーグルGTIGのAI脅威レポート[34]ボストン連邦準備制度理事会、合成詐欺に関する洞察[45][50]およびTruthScanが発表したケーススタディとプレスリリース[30][26]などがある。これらは、AIによる脅威の範囲と、現実のシナリオにおけるAIに焦点を当てた対策の有効性を示している。このようなインテリジェンスから学び、最先端のツールを導入することで、AIが強化するサイバーリスクの時代を自信を持って乗り切ることができる。

[1] [67] 2025 サイバーインシデントの動向 ビジネスが知っておくべきこと|インサイト|メイヤー・ブラウン

[2] [3] [19] サイバーセキュリティのトップ統計:2025年の事実、統計、侵害件数

https://www.fortinet.com/resources/cyberglossary/cybersecurity-statistics

[4] [11] [12] [16] [17] [20] [22] [47] [48] [52] 金融サービスにおけるAI主導の不正行為:最近の動向とソリューション|トゥルースキャン

https://truthscan.com/blog/ai-driven-fraud-in-financial-services-recent-trends-and-solutions

[5] [26] [30] [54] トゥルーススキャン、国防関係者に対する北朝鮮のディープフェイク攻撃を検知 - Bryan County Magazine

[6] [7] [14] 受信トレイのスパムの半分はAIによって生成されている - 高度な攻撃への利用は初期段階にある|バラクーダネットワークスブログ

https://blog.barracuda.com/2025/06/18/half-spam-inbox-ai-generated

[8] [10] 2025年第2四半期デジタル・トラスト・インデックス:AI不正データと洞察|Sift

https://sift.com/index-reports-ai-fraud-q2-2025

[9] [13] [24] [25] [38] [39] AIサイバーセキュリティの脅威2025年:$25.6Mディープフェイク

https://deepstrike.io/blog/ai-cybersecurity-threats-2025

[15] [21] 最新の脅威インテリジェンス|トゥルースキャン

[18] [63] [64] TruthScan - エンタープライズAI検知&コンテンツセキュリティ

[23] [46] [56] [57] ディープフェイクと預金:ジェネレーティブAI詐欺との戦い方

https://www.amount.com/blog/deepfakes-and-deposits-how-to-fight-generative-ai-fraud

[27] ディープフェイク攻撃とAI生成フィッシング:2025年統計

https://zerothreat.ai/blog/deepfake-and-ai-phishing-statistics

[28] [58] [59] AIボイス・ディテクター(偽声・声マネ)|TruthScan トゥルースキャン

https://truthscan.com/ai-voice-detector

[29] [31] [60] [61] [65] [66] ディープフェイク検出 - フェイク動画とAI動画を識別 - TruthScan

https://truthscan.com/deepfake-detector

[32] [33] [34] [35] [36] [37] [41] GTIG AI脅威トラッカー:脅威による AI ツール利用の進展|Google Cloud Blog

https://cloud.google.com/blog/topics/threat-intelligence/threat-actor-usage-of-ai-tools

[40] 冗長なAIコードでマルウェアを難読化するハッカーたち

https://www.bankinfosecurity.com/hackers-obfuscated-malware-verbose-ai-code-a-29541

[42] [43] [62] リアルタイムAI検知 - TruthScan

https://truthscan.com/real-time-ai-detector

[44] 悪のAIオペレーター、AI生成コードと偽アプリを遠距離通信に利用...

https://www.trendmicro.com/en_us/research/25/i/evilai.html

[45] [49] [50] [51] [55] AI世代が合成ID詐欺の脅威を高めている - ボストン連邦準備銀行

[53] 2025年の合成ID詐欺:AIによる検知と防止戦略