ほんの数年前までは、誰かの声を真似るにはプロのスタジオと多くの技術的スキルが必要だった。.

今や、インターネットに接続し、暇さえあれば、誰でも1分もかからずに誰の声でもデジタル・クローンを作ることができる。.

このような攻撃を行うためのツールは、日々安価になり、誰にとってもアクセスしやすくなっている。そして、多くの人々がソーシャルメディア上で生活を共有しているため、詐欺師が必要な音声を見つけるのは非常に簡単だ。.

この記事では、音声詐欺の悪名高い実例をいくつかご紹介します。また、このような脅威にタイムリーに終止符を打つためのソリューションもご紹介します。.

要点

- 音声ディープフェイク詐欺の試みは近年2,137%以上も急増しているが、これは最新のAIがわずか3秒のソース音声で85%もの正確な音声クローンを生成できるという事実が後押ししている。.

- 2024年にアラップ・エンジニアリング社で発生した強盗事件では、詐欺師がCFOのディープフェイク映像や音声を使い、従業員を騙して$2,560万ドルを送金させた。.

- 企業の窃盗だけでなく、音声偽装は誘拐詐欺を通じて家族に深刻な精神的リスクをもたらし、銀行やその他のセキュリティの高いアプリで使用されている従来の生体認証セキュリティシステムをバイパスすることができる。.

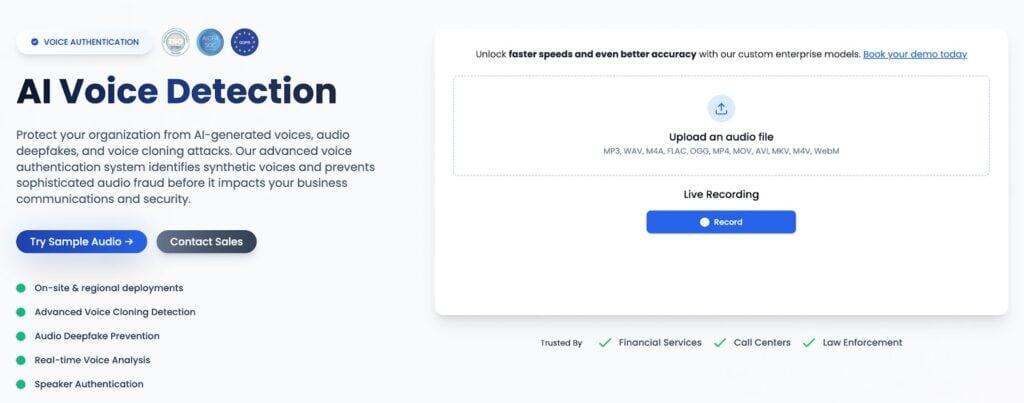

- 組織は、大規模な転送に複数人による承認プロトコルを導入したり、TruthScanのようなAI音声検出器を導入してリアルタイムで音響指紋を分析したりすることで、人間による確認だけでは乗り越えられない状況に追い込まれている。.

- TruthScanは、ElevenLabsやMurfのようなプラットフォームからの合成音声アーチファクトを、すべての主要な音声およびビデオフォーマットにおいて99%以上の精度で識別することで、企業間インタラクションを保護します。.

音声ディープフェイク攻撃とは何か?

ボイス・ディープフェイクとは、誰かの声をデジタルで偽造したものだ。攻撃者は、声の録音から話し方を細部まで分析できるソフトウェアを使用する。.

声のクローンを作るために、ソフトウェアは声のパターンに気づこうとする。主に、ピッチ、トーン、文と文の間の呼吸の仕方などがソフトウェアによって考慮される。.

いったんこれらのパターンを覚えてしまえば、攻撃者はその声で何でもしゃべらせることができる。.

もうAI詐欺を心配する必要はない。 TruthScan あなたを助けることができる:

- AIが生成したものを検出する 画像、テキスト、音声、ビデオ。

- 避ける AIによる大規模な詐欺

- 最も大切なものを守る 繊細 企業資産。

危険なのは、音声ディープフェイク作成ツールが簡単に手に入ることです。しかも、そのほとんどはインストールを必要としません。それらはウェブサイトの形でオンラインで利用可能です。.

数ドルを投じて、声のクローンを作る必要がある。もう少し掘り下げれば、無料で声のクローンを作れるツールも見つかるかもしれない。.

この新しく簡単に手に入る技術によって、オーディオ詐欺が急増している。.

詐欺師は、ソーシャル・メディアやその他のパブリック・チャンネルから、誰かの音声をほんの少し入手するだけで、その人のクローンを作ることができる。.

そして、そのクローン音声を使って、生電話、ビデオ会議、音声メモ、アナウンスなどの場面で本人になりすますことができる。.

これらは音声ディープフェイク攻撃の単なる仮想的な使用例ではない。これらはすでに起こっていることなのだ。後ほど、悪名高い音声ディープフェイク攻撃をいくつか取り上げます。.

音声ディープフェイク攻撃の潜在的リスク

ボイス・ディープフェイクと聞いて、有名人が言ったこともないことを言っている面白いビデオを思い浮かべるかもしれない。.

しかし、一見何の変哲もないクローン音声の利用が、当事者に深刻なダメージを与えることがある。そのリスクについて話そう。.

企業への財務的打撃

ボイス・ディープフェイクは、企業の評判を永遠に台無しにする可能性がある。また、数分で大金を奪う力もある。.

どうして、と聞かれるかもしれない。詐欺師は会社の上司の声をコピーし、それを使って従業員に電話をかけ、口座にお金を移動させるなど、本来やるべきでないことをさせることができる。.

これはほんの一例に過ぎない。可能性は無限にある。.

セキュリティ・システムのバイパス

あなたの声は、他の誰にも知られてはならない生体情報です。なぜなら、多くのアプリ、特に銀行系アプリにログインする際のパスワードとして使っているからだ。.

これらのアプリには、不正アクセスを防止するための自動音声認証システムが組み込まれているかもしれないが、優れたボイスクローンにはまだそれを欺くチャンスがある。.

家族への精神的打撃

おそらく、音声詐欺師が最もターゲットにしやすいのは、家族の高齢者だろう。例えば、両親や祖父母だ。.

詐欺師は、例えば母親に電話をかけ、娘が誘拐されたと言って助けを求める泣き声を聞かせるかもしれない。.

職場における信頼の低下

音声ディープフェイク攻撃は、健全な職場での信頼も傷つける。.

従業員は、上司からの電話を再確認し、詐欺師がコピー音声で危険なことを命じているのではないことを確認しなければならなくなる。.

では、手動でダブルチェックしないのであれば、どのような選択肢があるのだろうか?今述べたすべてのリスクは、自動化されたディープフェイク攻撃防止の必要性を指摘している。.

幸いなことに、現在ではディープフェイクAIの音声検出ツールがあり、TruthScanもその一つである。.

TruthScanで詐欺やなりすましを防ぐ AI音声検出器.

音声ディープフェイク攻撃の実例

AIのおかげで、私たちは今、目で見たり耳で聞いたりしたものを容易に信用できないところまで来ている。AIは今やリアルな写真や動画を作成することができる。音声も同様だ。.

ディープフェイク・オーディオ詐欺に引っかかったという話をすでに聞いたことがあるかもしれない。ニュースやソーシャル・メディアにも、時折このような話が登場します。これらの中には、あなたの頭を理解するのが難しいものもあります。.

最も悪名高いボイス・ディープフェイク攻撃について説明しよう。.

実際には行われなかった$2500万ドルのバーチャル会議

このディープフェイク攻撃は、おそらく最も多く報告されているものだろう。.

について 被害者はアラップという英国のエンジニアリング会社, しかし、詐欺の発信源は香港事務所だった。.

2024年初頭、ある会社の財務部に勤務する従業員が、英国にいる会社のCFOから電子メールを受け取った。そのメールには、その従業員がCFOからいくつかの銀行口座に秘密裏に送金するよう指示されていることが書かれていた。.

当初、その従業員は、その要求が少し奇妙に感じられ、フィッシング詐欺かもしれないと思い、かなり疑っていた。.

しかし、その従業員はビデオ会議に招待された。その社員がビデオ会議に参加すると、そこにはCFOらしき人物と数人の先輩社員の姿があった。.

みんな、見た目も声もそのまんまだった。よりリアルに見せるために、お互いに会話もしていた。.

これで財務部の従業員の疑念は完全に払拭され、その後、15回の取引を通じて1TP7,560万ドル(~2億香港ドル)以上を複数の異なる香港の銀行口座に送金した。.

後に、この設定はすべて深いフェイクであったことが判明した。通話に登場した人物は、アラップの従業員以外、誰一人として見かけ通りではなかったのだ。詐欺師たちは、同社のCFOや上級社員の高品質な音声と映像のクローンを使って、攻撃を完璧に調整していたのだ。.

イタリアの大臣とファッション界のアイコン

こちらも2024年の出来事だ。A 偽イタリア国防相グイド・クロゼット イタリアの数人のエリートに電話し、誘拐されたジャーナリストを救出するための緊急の資金援助を要請した。.

電話の中で偽のグイド・クロセットは、これは政府の極秘作戦だと主張した。電話の主は、ジョルジオ・アルマーニのような伝説的なファッション界の有名人にまで電話をかけることに成功した。.

悲しいことに、ある人は約100万ドルを振り込んでしまった。彼らはおそらく、他の人たちよりも助けなければならないという愛国的義務感が強く、詐欺師たちはそれを利用することに成功したのだろう。.

$243,000ドルの英国エネルギー強盗

これは 2019年の出来事 この規模のディープフェイクは、おそらく史上初めて報告されたものだろう。.

英国のあるエネルギー会社のCEOは、ドイツの親会社の上司と電話で話していると思っていた。.

CEOはハンガリーのサプライヤーに約22万ユーロ($243,000円)を送金するよう命じられた。すぐに送金しなければならない重要な取引だと言われた。CEOは詐欺に引っかかり、送金してしまった。.

アリゾナの母親への恐怖の電話

オーディオのディープフェイクは家族にとって脅威だという話をしたのを覚えているだろうか?私たちが挙げた詐欺の例は、実際に起こったものだ。.

詐欺師たちは、ソーシャル・メディアに投稿された15歳の少女の動画から声をクローンした。その後、彼らは彼女の母親に電話をかけ、誘拐され、誘拐犯がすぐに身代金を要求していると娘の声で主張した。.

幸運なことに、父親はこの試練の間、スキーの練習で無事だった実の娘に電話することができた。彼らは詐欺をかわしたのだ。.

音声ディープフェイクが企業に与える影響

ボイス・ディープフェイク攻撃の主な目的は、お金を盗むことだ。.

しかし、ターゲットが企業である場合、ダメージは多次元に及ぶ。.

例えば、ディープフェイクは企業の従業員間の雰囲気を悪くする可能性がある。従業員が失態を犯すことを常に恐れるような文化を生み出す可能性がある。.

コールセンターの例を見てみよう。サイバー犯罪者が特定の顧客になりすまして電話をかけてくるという報告がある。.

彼らの手口は、コールセンターのエージェントにその顧客の口座詳細(自宅の住所や電話番号など)を変更させ、口座を乗っ取るというものだ。.

リモート採用やバーチャル面接も、候補者が適性のない仕事を獲得するためにディープフェイクの声を利用できる分野だ。.

音声ディープフェイク攻撃から企業を守る

企業における従来のセキュリティ・ルールは、AI以前の時代に書かれたものだ。.

今こそ、企業はそれらを再考する必要がある。企業はまず、AIの乱用に起因する多くの新たなサイバー脅威について、自らを教育することから始めるべきである。.

例えば、チーム全員を対象としたトレーニングセッションを開催し、音声詐欺の実例を見せることができます。上記で説明した例から始めることができます。このようなトレーニングセッションでは、さまざまなシナリオに対応したディープフェイク攻撃防止のヒントも提供する必要があります。.

そうすれば、社内のビジネス・ポリシーを更新することができる。重要な変更のひとつは、一人の担当者が単独で大量の電信送金を承認することを許可しないようにすることだ。.

大口の支払いは、少なくともそのうちの1人が何かおかしいと気づくことができるように、委員会全体の承認を必要とすべきである。.

また、自動化された AI音声検出器 通話中にバックグラウンドで実行される。.

そのために作られたのがTruthScanのAIツールです。当社のAIツールを使って、音声ディープフェイク攻撃を検出、検証、防止することができます。その方法をご説明しましょう。.

TruthScanはどのように音声対話を保護するか

私たちは、従業員がストレスの多い通話の最中に、一人で深く作り込まれた声と本物の声を聞き分けることができないことを理解しています。そのような従業員には、通話中にその仕事を処理できる専任のアシスタントが必要です。.

私たちの AI音声検出器 は専用のソリューションである。.

その仕組みと能力を紹介しよう:

- ライブの電話やビデオ会議で何百万もの異なるデータポイントを分析し、99%の精度を実現

- 偽声を検知すると即座に警告を発する

- 合成モデルによってのみ残される音声のスペクトルパターンと音響フィンガープリントを捉える

- シンプルなREST APIを通じて、既存のコールセンターやヘルプデスクと統合します。

- すべての主要なオーディオおよびビデオフォーマットをスキャン可能

音声ディープフェイク攻撃の防止についてTruthScanに相談する

TruthScanを使えばリアルタイムで音声クローン詐欺を阻止できますが、問題はいつ始めるかです。従業員は遅かれ早かれ失態を犯し、詐欺に遭うかもしれません。その不運な瞬間を待ってはいけません。.

私たちのAI音声検出器は、ElevenLabsやMurfのようなプラットフォームを使用して、音声ディープフェイクにフラグを立てることができます。.

ライブ通話やビデオ会議中にバックグラウンドで動作するため、通話担当者はマルチタスクをこなす必要がありません。.

必要なのは、私たちのREST APIを通じて素早く統合することだけです。.

始めよう トゥルースキャン 今すぐ、ディープフェイク詐欺からあなたのビジネスを守りましょう。.