Solo pochi anni fa, per imitare la voce di qualcuno era necessario uno studio professionale e una grande abilità tecnica.

Ora, chiunque abbia una connessione a Internet e un po' di tempo libero può creare un clone digitale della voce di chiunque in meno di un minuto.

Gli strumenti per questi attacchi diventano ogni giorno più economici e accessibili a tutti. E poiché molte persone condividono la loro vita sui social media, è molto facile per un truffatore trovare l'audio di cui ha bisogno.

In questo articolo vi illustreremo alcuni dei più noti esempi reali di frode audio. Vi presenteremo inoltre una soluzione per porre tempestivamente fine a queste minacce.

Punti di forza

- I tentativi di frode con deepfake vocale sono aumentati di oltre 2.137% negli ultimi anni, alimentati dal fatto che la moderna IA è in grado di generare un clone vocale preciso 85% utilizzando appena tre secondi di audio sorgente.

- Tra gli attacchi più noti nel mondo reale c'è la rapina alla società di ingegneria Arup del 2024, in cui i truffatori hanno usato video e audio deepfake di un direttore finanziario per ingannare un dipendente e fargli trasferire $25,6 milioni.

- Oltre ai furti aziendali, i deepfake vocali comportano gravi rischi emotivi per le famiglie attraverso truffe di rapimento e possono aggirare i tradizionali sistemi di sicurezza biometrici utilizzati dalle banche e da altre applicazioni ad alta sicurezza.

- Le organizzazioni sono costrette a superare la sola verifica umana, implementando protocolli di approvazione a più persone per i trasferimenti di grandi dimensioni e impiegando rilevatori vocali AI come TruthScan per analizzare le impronte acustiche in tempo reale.

- TruthScan protegge le interazioni aziendali identificando gli artefatti vocali sintetici di piattaforme come ElevenLabs e Murf con una precisione superiore a 99% in tutti i principali formati audio e video.

Che cosa sono gli attacchi Voice Deepfake?

Un deepfake vocale è una contraffazione digitale della voce di una persona. L'aggressore utilizza un software in grado di analizzare ogni minimo dettaglio del modo in cui una persona parla a partire da una registrazione della sua voce.

Per clonare la voce, il software cerca di notare gli schemi della voce. Principalmente, il software prende in considerazione elementi come l'intonazione, il tono, il modo in cui si respira tra una frase e l'altra, ecc.

Una volta appresi questi schemi, l'aggressore può fargli dire qualsiasi cosa con quella voce.

Non preoccupatevi più delle frodi dell'IA. TruthScan Può aiutarvi:

- Rilevare l'IA generata immagini, testo, voce e video.

- Evitare frodi di grande portata guidate dall'intelligenza artificiale.

- Proteggete i vostri prodotti più sensibile beni dell'impresa.

L'aspetto pericoloso è che gli strumenti per la creazione di deepfake vocali sono facilmente accessibili. E la maggior parte di essi non richiede alcuna installazione. Sono disponibili online sotto forma di siti web.

È sufficiente sborsare qualche dollaro per iniziare a clonare le voci. Se si scava un po' di più, si possono anche trovare strumenti che permettono di clonare le voci gratuitamente.

Questa tecnologia nuova e facilmente disponibile ha portato a un forte aumento delle frodi audio.

I truffatori hanno bisogno solo di una piccola parte di audio di qualcuno, che possono reperire dai social media o da altri canali pubblici, per clonarlo.

Quindi possono usare la voce clonata per impersonare una persona in situazioni come telefonate dal vivo, riunioni video, note vocali, annunci, ecc.

Non si tratta di casi ipotetici di attacchi di deepfake vocale. Questi casi sono già accaduti. Più avanti tratteremo alcuni dei più noti attacchi di deepfake vocale.

Rischi potenziali degli attacchi Deepfake vocali

Quando avete sentito parlare di voice deepfake, potreste aver immaginato un video divertente di una celebrità che dice cose che non ha mai detto.

Ma l'uso apparentemente innocuo della voce clonata può causare gravi danni alle parti coinvolte. Parliamo dei rischi.

Devastazione finanziaria per le imprese

Un deepfake vocale può rovinare per sempre la reputazione di un'azienda. Ha anche il potere di derubarla di ingenti somme di denaro in pochi minuti.

Come mai, vi chiederete? I truffatori possono clonare la voce del capo di un'azienda e usarla per chiamare i dipendenti e fargli fare cose che non dovrebbero fare, come spostare denaro su un conto.

Questo è solo un esempio. Le possibilità sono infinite.

Bypassare i sistemi di sicurezza

La voce è un dato biometrico che nessun altro dovrebbe avere. Questo perché la utilizzate come password per accedere a molte delle vostre applicazioni, soprattutto quelle bancarie.

Anche se queste app possono avere un sistema di verifica vocale automatico integrato per impedire l'accesso non autorizzato, un buon clone vocale ha ancora la possibilità di ingannarli.

L'impatto emotivo sulle famiglie

Forse i bersagli più facili per i truffatori audio sono le persone anziane della famiglia. Genitori e nonni, ad esempio.

I truffatori potrebbero chiamare, ad esempio, una madre e farle sentire il suono della figlia che chiede aiuto, dicendo che è stata rapita.

Erosione della fiducia sul posto di lavoro

Gli attacchi voice deepfake danneggiano anche la fiducia in un ambiente di lavoro sano.

I dipendenti dovranno controllare due volte le telefonate del proprio manager per assicurarsi che non si tratti di un truffatore che ordina loro di fare cose rischiose con una voce clonata.

Quali sono quindi le opzioni se non il doppio controllo manuale? Tutti i rischi appena discussi indicano la necessità di una prevenzione automatica degli attacchi deepfake.

Per fortuna, oggi disponiamo di strumenti per il rilevamento di voci AI false, tra cui TruthScan.

Prevenzione delle frodi e delle impersonificazioni con TruthScan Rilevatore vocale AI.

Esempi reali di attacchi voice deepfake

Grazie all'intelligenza artificiale, siamo arrivati a un punto in cui non possiamo più fidarci di ciò che vedono i nostri occhi o sentono le nostre orecchie. L'intelligenza artificiale è ora in grado di creare immagini e video realistici. Lo stesso vale per l'audio.

Potreste aver già sentito storie di persone che sono cadute in una frode audio deepfake. Di tanto in tanto, la cosa fa capolino anche nei telegiornali e sui social media. Alcune di queste storie sono difficili da comprendere.

Vi illustriamo alcuni dei più noti attacchi di deepfake vocale, in modo che possiate farvi un'idea dell'abilità con cui vengono eseguiti.

La riunione virtuale da $25 milioni che non è mai avvenuta

Questo attacco deepfake è probabilmente quello più segnalato.

Il vittima è stata una società di ingegneria britannica chiamata Arup, ma la truffa ha avuto origine nel suo ufficio di Hong Kong.

Era l'inizio del 2024 quando un dipendente del dipartimento finanziario dell'azienda ricevette un'e-mail dal direttore finanziario dell'azienda nel Regno Unito. Nell'e-mail, il lavoratore riceveva istruzioni dal CFO di effettuare trasferimenti segreti di denaro su alcuni conti bancari.

All'inizio, il dipendente era piuttosto sospettoso perché la richiesta sembrava un po' strana e pensava che si trattasse di una truffa di phishing.

Ma poi il dipendente è stato invitato a una videoconferenza. Quando il dipendente si è unito alla chiamata, ha visto quello che sembrava esattamente il CFO e diversi altri colleghi senior.

Tutti avevano un aspetto e un suono esattamente come dovrebbero. Parlavano anche tra di loro per far sembrare il tutto più reale.

Questo ha cancellato completamente tutti i dubbi del dipendente del dipartimento finanziario, che ha poi inviato oltre $25,6 milioni (~HK$200 milioni) a diversi conti bancari di Hong Kong attraverso 15 transazioni.

In seguito si scoprì che l'intera configurazione era un deepfake. Nessuna persona nella telefonata era quella che sembrava, tranne il dipendente di Arup. I truffatori avevano coordinato perfettamente l'attacco utilizzando cloni audio e video di alta qualità del direttore finanziario e dei dipendenti senior dell'azienda.

Il Ministro italiano e le icone della moda

Anche questa ha avuto luogo nel 2024. A finto ministro della Difesa italiano Guido Crosetto ha chiamato diverse élite italiane e ha chiesto il loro immediato aiuto finanziario per salvare i giornalisti rapiti.

Nella telefonata, il falso Guido Crosetto ha affermato che si trattava di un'operazione governativa top-secret. L'interlocutore è riuscito persino a parlare al telefono con personaggi leggendari della moda come Giorgio Armani.

Purtroppo, una persona ha finito per trasferire circa un milione di dollari. Probabilmente aveva un senso del dovere patriottico più forte di altri, che i truffatori sono riusciti a sfruttare.

Il furto di $243.000 di energia nel Regno Unito

Questo è accaduto nel 2019 ed è stato probabilmente il primo deepfake mai segnalato di questa portata.

Un amministratore delegato di un'azienda energetica britannica pensava di essere al telefono con il suo capo della società madre in Germania.

All'amministratore delegato è stato ordinato di trasferire circa 220.000 euro ($243.000) a un fornitore in Ungheria. Gli è stato detto che si trattava di un affare critico che richiedeva un trasferimento immediato. L'amministratore delegato è caduto nella truffa e ha trasferito il denaro.

Una chiamata terrificante per una madre in Arizona

Ricordate che abbiamo parlato del fatto che gli audio deepfakes sono una minaccia per le famiglie? L'esempio di truffa che abbiamo riportato è realmente accaduto.

I truffatori hanno clonato la voce di una ragazza di 15 anni da un suo video sui social media. Poi hanno chiamato la madre e hanno affermato, con la voce della figlia, che era stata rapita e che i rapitori chiedevano immediatamente un riscatto.

Per fortuna, il padre è riuscito a chiamare la figlia vera, che durante l'intera vicenda si trovava al sicuro a un allenamento di sci. Hanno evitato la truffa.

Come i Deepfake vocali influenzano le imprese

Lo scopo principale di un attacco di deepfake vocale è principalmente quello di rubare denaro.

Ma quando l'obiettivo sono le imprese, il danno è multidimensionale.

Ad esempio, i deepfakes possono avvelenare l'atmosfera tra i dipendenti di un'azienda. Può creare una cultura in cui i dipendenti sono sempre terrorizzati dal rischio di commettere errori.

Prendiamo l'esempio dei call center. Ci giungono notizie di criminali informatici che li chiamano e fingono di essere clienti specifici.

Il loro trucco consiste nel far sì che gli agenti del call center modifichino i dettagli del conto di questi clienti (ad esempio, indirizzi di casa, numeri di telefono) e si impadroniscano dei loro conti.

Le assunzioni a distanza e i colloqui virtuali sono un'altra area in cui le voci falsificate possono essere utilizzate dai candidati per ottenere posti di lavoro per i quali non sono qualificati.

Proteggere le aziende dagli attacchi di Deepfake vocale

Le regole di sicurezza tradizionali delle aziende sono state scritte nell'era pre-AI.

È giunto il momento che le aziende le riconsiderino. Dovrebbero innanzitutto iniziare a informarsi sulle numerose nuove minacce informatiche derivanti dall'abuso dell'IA.

Ad esempio, possono organizzare sessioni di formazione per l'intero team e mostrare loro esempi reali di frode audio. Si può iniziare con gli esempi di cui abbiamo parlato sopra. Queste sessioni di formazione dovrebbero anche fornire suggerimenti per la prevenzione degli attacchi deepfake in diversi scenari.

A questo punto potete procedere all'aggiornamento delle politiche aziendali interne. Un cambiamento importante può essere quello di non permettere più a una sola persona di autorizzare da sola trasferimenti bancari massicci.

I grandi pagamenti dovrebbero richiedere l'approvazione di un intero gruppo di lavoro, in modo che almeno uno di loro possa accorgersi in tempo che qualcosa non va.

Si dovrebbe anche pensare di integrare un sistema automatico di Rilevatore vocale AI da eseguire in background durante le chiamate.

È per questo che sono stati creati gli strumenti AI di TruthScan. È possibile rilevare, verificare e prevenire gli attacchi di deepfake vocale utilizzando i nostri strumenti di intelligenza artificiale. Vi spieghiamo come.

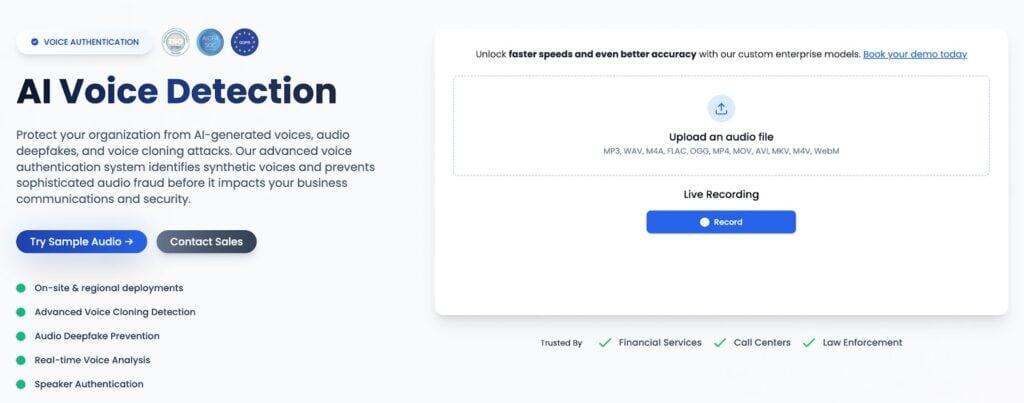

Come TruthScan protegge le interazioni vocali

Siamo consapevoli del fatto che i dipendenti non sono in grado di distinguere da soli una voce falsa da una voce reale nel bel mezzo di una telefonata stressante. Hanno bisogno di un assistente dedicato che possa occuparsi di questo lavoro durante la chiamata, mentre il vostro team può concentrarsi su ciò per cui è stato assunto.

Il nostro Rilevatore vocale AI è una soluzione dedicata.

Ecco come funziona e cosa è in grado di fare:

- Analizza milioni di punti di dati diversi in telefonate e videoconferenze dal vivo e offre un'accuratezza di 99%.

- Emette un avviso istantaneo dopo aver rilevato una voce falsa

- Cattura i modelli spettrali e le impronte acustiche della voce che vengono lasciate solo dai modelli sintetici.

- Si integra con il call center o l'help desk esistente attraverso una semplice API REST.

- Può scansionare tutti i principali formati audio e video

Parlate con TruthScan per prevenire gli attacchi Deepfake alla voce

Con TruthScan potete fermare le frodi di clonazione vocale in tempo reale, ma la domanda è: quando inizierete? Prima o poi i vostri dipendenti potrebbero commettere un errore e farvi truffare. Non aspettate quel momento sfortunato.

Il nostro rilevatore vocale AI è in grado di segnalare i deepfakes vocali utilizzando piattaforme come ElevenLabs e Murf.

Funziona in background durante le telefonate e le videoconferenze, in modo che gli operatori non debbano lavorare in multitasking.

Tutto ciò che serve è una rapida integrazione attraverso la nostra API REST.

Iniziare con TruthScan ora e proteggete la vostra attività dalle truffe deepfake.