Una guida completa per comprendere, individuare e prevenire le frodi vocali dell'IA in azienda.

La chiamata vocale da $25 milioni che non è mai avvenuta

Nel febbraio 2024, un'addetta alle finanze di una multinazionale di Hong Kong riceve una videochiamata dal suo direttore finanziario.

La voce all'altro capo era inconfondibile; ogni inflessione, ogni pausa e persino il leggero accento furono immediatamente riconosciuti.

Le chiese urgentemente di elaborare 15 bonifici, per un totale di $25 milioni, per finalizzare un'acquisizione riservata.

Non preoccupatevi più delle frodi dell'IA. TruthScan Può aiutarvi:

- Rilevare l'IA generata immagini, testo, voce e video.

- Evitare frodi di grande portata guidate dall'intelligenza artificiale.

- Proteggete i vostri prodotti più sensibile beni dell'impresa.

Il direttore finanziario non ha mai preso quella decisione. È stata completamente generata dall'intelligenza artificiale.

Non si tratta di un caso isolato. Le istituzioni finanziarie stanno assistendo a un forte aumento delle frodi deepfake.

Negli ultimi tre anni, i casi sono aumentati di 2.137%, e l'IA ora guida il 42,5% di tutti i tentativi di frode nel settore.

Anche con l'impennata delle frodi vocali AI, più della metà dei dirigenti aziendali ammette che i propri dipendenti non sono stati formati per individuare o rispondere agli attacchi deepfake; quasi 80% delle aziende non ha protocolli formali in atto per gestire questi incidenti.

Come funziona la clonazione vocale dell'intelligenza artificiale e perché è una minaccia

La moderna sintesi vocale dell'intelligenza artificiale necessita di un numero sorprendentemente basso di dati. Bastano pochi secondi di audio per clonare una voce con una precisione fino a 85%.

Il processo si riduce a tre fasi principali:

- Raccolta dati: I truffatori raccolgono campioni vocali da fonti pubbliche, come teleconferenze, interviste in podcast, clip sui social media o persino post video su LinkedIn.

- Formazione dei modelli: L'intelligenza artificiale analizza i tratti vocali come l'intonazione, il tono, l'accento, il ritmo e i modelli di respirazione.

- Generazione: Il sistema crea un discorso sintetico abbastanza convincente da ingannare anche i colleghi più stretti.

Il problema dell'accessibilità

Ciò che rende questa minaccia ancora più pericolosa è la sua democratizzazione. I truffatori non hanno più bisogno di risorse di livello hollywoodiano.

Tutto ciò che serve è un software accessibile per clonare una voce da un breve clip dei social media. Molti strumenti disponibili pubblicamente, compresi quelli di livello consumer AI text to speech possono essere utilizzati in modo improprio per generare audio sintetico convincente.

Perché i dirigenti sono i bersagli principali delle frodi

I dirigenti devono affrontare un pericoloso mix di fattori di rischio.

La loro esposizione pubblica attraverso i social media rende i campioni vocali facili da trovare e la loro autorità spesso spinge i dipendenti ad agire rapidamente su richieste urgenti.

In media, un dirigente su quattro ha una conoscenza limitata della tecnologia deepfake.

Le statistiche attuali dipingono un quadro preoccupante

In un 2024 Indagine DeloitteIl 25,9% dei dirigenti ha dichiarato che le loro organizzazioni hanno affrontato almeno un incidente di deepfake che ha preso di mira dati finanziari o contabili nell'ultimo anno e la metà di tutti gli intervistati ritiene che tali attacchi aumenteranno nei prossimi 12 mesi.

Il dato più preoccupante è che solo 52% delle organizzazioni si sentono sicure di poter individuare un deepfake del proprio CEO.

Come riconoscere le truffe dell'intelligenza artificiale

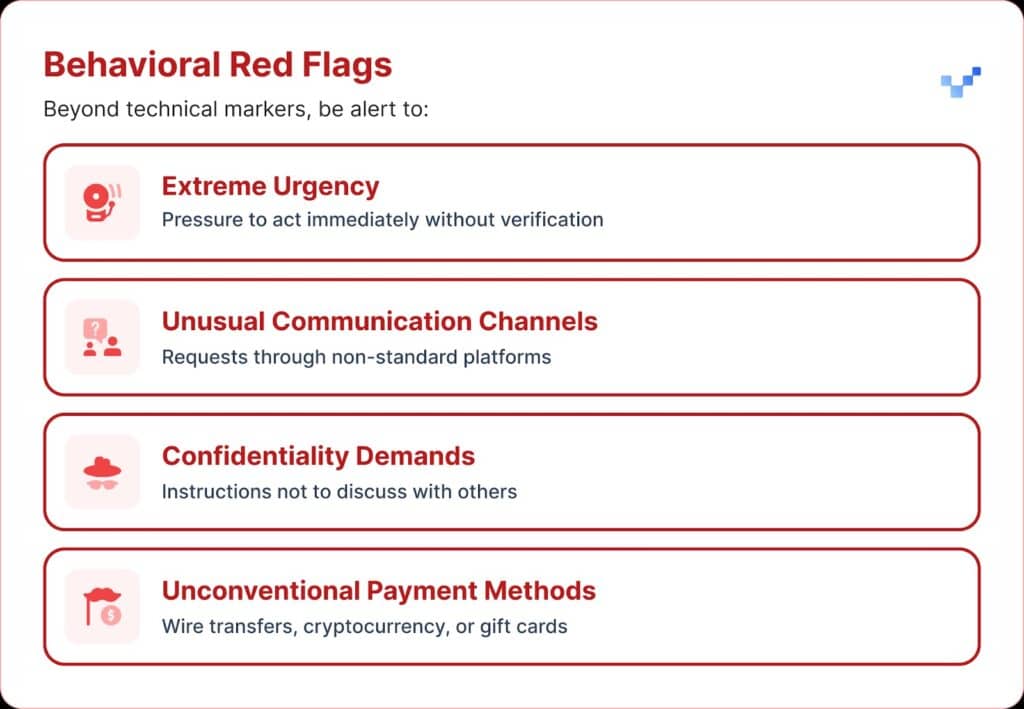

Quando si riceve una comunicazione vocale sospetta, ci sono alcuni segnali di allarme da tenere in considerazione.

Le voci truffaldine dell'intelligenza artificiale hanno spesso un suono monotono o piatto. Si può anche notare un ritmo insolito, con pause strane o un ritmo innaturale.

L'audio può essere accompagnato da lievi ronzii elettronici o echi, soprattutto durante le chiamate più lunghe.

In molti casi, la voce ripete frasi limitate che sembrano scritte o provate.

Impatto finanziario e costi reali

La maggior parte delle organizzazioni ha perso in media circa $450.000, ma nel settore dei servizi finanziari le perdite sono salite oltre $603.000.

Nei casi più gravi, 1 organizzazione su 10 ha riportato perdite superiori a $1 milioni.

Questa tendenza è cresciuta rapidamente. Una precedente ricerca del 2022 indicava che l'onere finanziario medio della frode d'identità era di circa $230.000, quasi la metà della cifra attuale.

Perdite future previste

Secondo il Center for Financial Services di Deloitte, il denaro perso a causa delle frodi AI negli Stati Uniti potrebbe passare da $12,3 miliardi nel 2023 a $40 miliardi entro il 2027. Si tratta di una crescita di circa 32% all'anno.

Vulnerabilità regionale

Il Nord America ha registrato un aumento di 1740% di frodi deepfake.

Questo significativo aumento regionale suggerisce che il Nord America potrebbe essere un obiettivo primario per i truffatori di deepfake, probabilmente a causa della sua grande economia digitale e dell'uso diffuso di servizi online.

Approcci strategici alla protezione dei dirigenti

1. Implementare i protocolli di verifica

Un modo per rafforzare le difese è quello di utilizzare un sistema di "parole sicure", frasi di autenticazione preconcordate e condivise con il personale chiave.

Un truffatore che utilizza la clonazione vocale dell'intelligenza artificiale non conosce le risposte giuste alle domande di verifica personale.

Un'altra salvaguardia è la verifica multicanale.

Qualsiasi richiesta finanziaria insolita deve essere confermata attraverso un canale di comunicazione separato, senza mai affidarsi solo al metodo di contatto originale.

Le aziende dovrebbero inoltre stabilire regole chiare per l'escalation, con periodi di attesa e fasi di approvazione per le grandi transazioni finanziarie, indipendentemente da chi le richiede.

2. Attenzione all'esposizione digitale

Un altro livello di protezione è rappresentato dalla limitazione della quantità di audio e video esecutivi disponibili online. Più campioni i truffatori possono raccogliere, più convincenti diventano i loro cloni.

È inoltre utile stabilire chiare linee guida sui social media per i dirigenti, soprattutto per quanto riguarda la pubblicazione di video con audio pulito.

E quando si tratta di conferenze, le organizzazioni devono prestare attenzione ai discorsi o alle interviste registrate che danno spazio a lunghi tratti di campioni vocali.

3. Implementazione di soluzioni tecniche

È qui che la tecnologia avanzata di rilevamento dell'intelligenza artificiale diventa fondamentale.

Le organizzazioni hanno bisogno di autenticazione vocale di livello aziendale e di rilevamento deepfake capacità che forniscono:

- Analisi in tempo reale: Rilevamento di voci sintetiche durante le comunicazioni dal vivo

- Verifica storica: Analizzare le chiamate e i messaggi registrati per verificarne l'autenticità

- Capacità di integrazione: Lavorare senza problemi con le piattaforme di comunicazione esistenti

- Alti tassi di precisione: Riduzione al minimo dei falsi positivi e cattura di falsi sofisticati

4. Programmi di formazione completi

I team di leadership hanno bisogno di una formazione mirata sulle minacce vocali dell'IA e sulle procedure di verifica.

Altrettanto importante è la sensibilizzazione dei dipendenti.

Tutti, in qualsiasi ruolo, dovrebbero essere attrezzati per individuare potenziali deepfake e prevenire l'ingresso di minacce informatiche nell'organizzazione.

Esercitazioni regolari di simulazione possono rafforzare questa prontezza utilizzando finti tentativi di frode vocale per testare e perfezionare le procedure di risposta.

Soluzioni avanzate di rilevamento vocale AI

Le difese tradizionali sono state costruite per le minacce basate sulla rete, non per l'impersonificazione umana basata sull'intelligenza artificiale.

I motivi principali per cui gli strumenti di cybersecurity standard non sono in grado di affrontare l'ingegneria sociale basata sulla voce:

- Nessuna firma di malware: Le chiamate vocali non attivano i sistemi di sicurezza tradizionali

- Fattore di fiducia umana: Le persone si fidano naturalmente di ciò che sentono, soprattutto delle voci familiari.

- Lacune tecnologiche di rilevamento: Nonostante l'aumento dei tentativi di frode guidati dall'intelligenza artificiale, compresi i deepfakes, solo il 22% delle istituzioni finanziarie ha implementato strumenti di prevenzione delle frodi basati sull'intelligenza artificiale.

La necessità di un rilevamento vocale specializzato

Le moderne frodi vocali richiedono moderne capacità di rilevamento.

Di livello aziendale Sistemi di rilevamento vocale AI può:

- Analizzare i biomarcatori vocali: Rilevare sottili incongruenze nel parlato sintetico

- Elaborazione in tempo reale: Fornire avvisi immediati durante le chiamate sospette

- Apprendimento continuo: Adattarsi alle nuove tecniche di sintesi vocale

- Pronto per l'integrazione: Lavorare con l'infrastruttura di comunicazione esistente

Le organizzazioni che intendono proteggersi dalle frodi vocali devono investire in una tecnologia di rilevamento dell'intelligenza artificiale appositamente concepita, in grado di soddisfare la sofisticatezza delle minacce che devono affrontare.

Le frodi vocali sono arrivate, e si stanno intensificando

Nel primo trimestre del 2025, le frodi deepfake e i furti di identità hanno causato perdite per oltre $200 milioni.

Il phishing vocale con cloni dell'intelligenza artificiale è aumentato di 442%, e più di 400 aziende al giorno vengono colpite da truffe con deepfake CEO o CFO.

Mentre il 56% delle aziende dichiara di sentirsi molto sicuro nell'individuare i deepfakes, solo il 6% ha effettivamente evitato di subire perdite finanziarie a causa di essi.

L'importante non è sapere se la vostra organizzazione sarà presa di mira, ma se siete pronti ad affrontarlo.

Le frodi vocali stanno cambiando il volto della cybersicurezza. Le difese tradizionali non sono in grado di tenere il passo con le impersonificazioni basate sull'intelligenza artificiale.

Per essere protette, le organizzazioni hanno bisogno di strumenti di rilevamento migliori, di programmi di formazione solidi e di procedure di verifica chiare.

La tecnologia per reagire è già qui. La vera domanda è se la userete prima del primo incidente di frode vocale o dopo.