Una normale telefonata del vostro CFO può essere il momento in cui la fiducia si ritorce contro di voi. Immaginate che la violazione inizi con;

“Puoi inviarmi la password di amministrazione prima di pranzo?’.’

Obbedite come se obbedire fosse l'unico modo per sopravvivere al pranzo. Sembra ragionevole, visto che si tratta di un momento perfettamente ordinario della giornata lavorativa.

Ma questo momento di routine al lavoro sta per diventare la scena iniziale di un incidente di sicurezza. Il rischio ora arriva travestito da routine.

All'inizio del 2024, questo tipo di inganno è arrivato con una voce familiare e un volto amichevole, quando un lavoratore della finanza di Hong Kong ha incassato $25 milioni a qualcuno che assomiglia esattamente al loro vero direttore finanziario.

La vostra azienda non può più permettersi di dare per scontate le buone intenzioni. È come se fossimo all'incrocio tra fiducia e responsabilità legale.

Si tratta quindi di un campanello d'allarme per allineare i vostri protocolli IT alla più recente legislazione sull'AI deepfake. Perché gli hacker ora parlano con voci che siete abituati a sentire ogni giorno.

Continuate a leggere e addentratevi nella nuova era legale dell'IA per capire come i falsi suoni e le false immagini possano creare una reale esposizione legale.

Punti di forza

- La fiducia non è più sicura. La truffa del CFO di Hong Kong da $25 milioni ha dimostrato che la familiarità può essere falsificata in modo convincente.

- La legge si muove più velocemente. Nel momento in cui l'IA viene utilizzata, la responsabilità legale segue l'impresa. Quindi, a prescindere da chi ha premuto “deploy”, la legge punta su di voi.

- I media sintetici sono così avanti che fidarsi solo dell'istinto umano è ormai un azzardo. Le aziende hanno bisogno di sistemi di rilevamento dell'intelligenza artificiale in tempo reale per analizzare ogni e-mail, tutte le chiamate video/vocali e i file condivisi alla ricerca di segni di manipolazione.

Che cos'è la legislazione Deepfake?

La legislazione Deepfake non è più astratta, o come si dice “appartiene solo alla teoria”. Si tratta di una necessità legale non negoziabile che anche le imprese consolidate sono costrette ad adottare.

Ma cos'è esattamente questa serie di regole che impongono scelte difficili? Niente di confuso, solo una mappa necessaria per essere all'avanguardia nell'era dell'intelligenza artificiale.

Dal momento che ogni pixel contiene una verità nascosta (o una bugia), i governi mondiali stanno facendo a gara per impedire che la manipolazione dell'IA affondi le aziende. Ad esempio, il Legge UE sull'AI ora obbliga le imprese a etichettare i contenuti di IA o a rischiare multe milionarie.

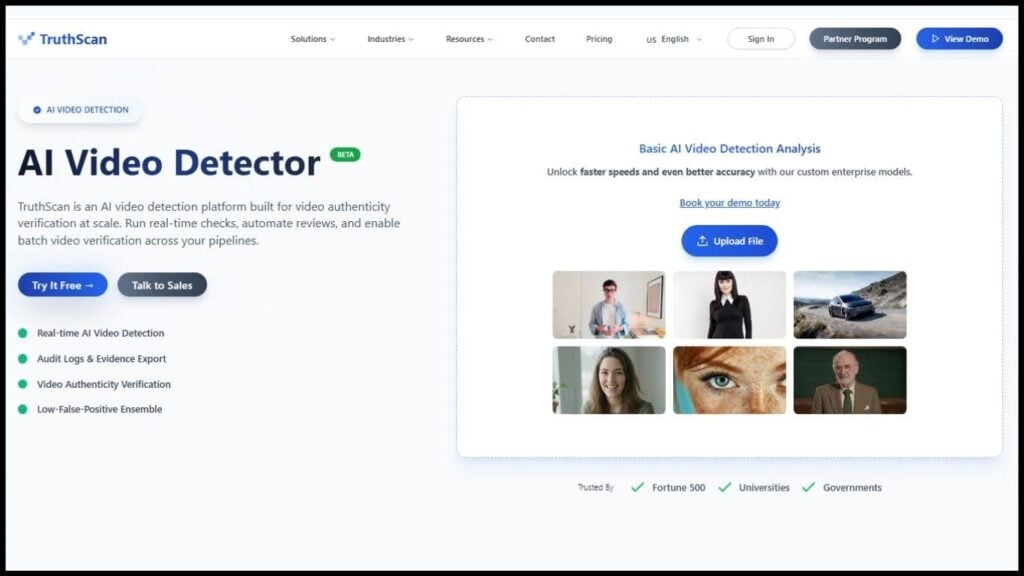

Non preoccupatevi più delle frodi dell'IA. TruthScan Può aiutarvi:

- Rilevare l'IA generata immagini, testo, voce e video.

- Evitare frodi di grande portata guidate dall'intelligenza artificiale.

- Proteggete i vostri prodotti più sensibile beni dell'impresa.

Perché gli esseri umani devono sapere quando a parlare è un'IA e non una persona reale.

Come Deepfake influisce sulle imprese

Email di phishing e violazioni della rete? Vecchie notizie!

La minaccia ora suona e assomiglia al vostro CEO (e con la legislazione sull'AI deepfake, le aziende non possono permettersi di ignorarla). Un solo “sì” può costare milioni. È la prova che la fiducia è l'investimento più azzardato, che può essere sia tesoro e trappola.

Ma cosa succede se le bugie mostrano le mani per prime? Sì, le bugie deepfake hanno trovato la loro strada: Il rilevamento dell'intelligenza artificiale.

Le organizzazioni stanno ora implementando Rivelatori AI attraverso i canali di comunicazione interni perché temono il “CEO” che non ha mai chiamato.

E onestamente aspettare una violazione non è altro che una scommessa multimilionaria.

È più che altro una vulnerabilità, perché i video deepfake di questi giorni hanno superato la nostra naturale capacità di individuare un falso.

La triste realtà è che non c'è più differenza tra un BOSS e un pixel ghost, a meno che non si utilizzi un credibile rilevatore video AI che si rifiuta di lasciare che un burattino gestisca il suo libro paga.

Rischi legali per le imprese

“Non lo sapevo” non è una difesa legale valida nel 2026 (grazie al nuovo legislazione deepfake).

Se la vostra azienda tratta le leggi sull'IA come “suggerimenti”, una causa legale è solo questione di tempo (un fatto divertente: è solo un modo per rendere i vostri avvocati molto, molto ricchi).

Ora, per proteggere la vostra C-suite da un errore da $25 milioni di dollari e di stare fuori dall'aula di tribunale, È fondamentale che “Verificare” diventi la nuova parola preferita della vostra azienda.

Perché, realisticamente, “Verify” è l'unico controllo interno che protegge un marchio.

Assicura che i vostri beni non diventino il ROI di qualcun altro, interrompendo il circuito dell'inganno.

‘Verificare non è una frase fatta, è un comando!

Sono finiti i tempi in cui le promesse vaghe e le richieste cortesi erano efficaci. Ora, tutto si basa su ricevute legali chiare e su una politica di tolleranza zero per gli errori.

Il Ordine esecutivo degli Stati Uniti sull'IA, La legge sull'AI deepfake non si limita a richiedere la buona volontà, ma impone una fredda e dura traccia cartacea, e la legislazione sull'AI deepfake non fa altro che aumentare la responsabilità.

Quindi, quando si assume l'IA e la si fa diventare una pietra miliare della propria strategia, l'obiettivo dovrebbe essere quello di garantire che sia etica.

Perché quando il vostro agente AI autonomo infrange la legge, i tribunali non daranno la colpa al bug, ma a chi lo ha implementato, il che significa che la vostra azienda sarà legalmente in pericolo. E questo non finisce mai bene.

Una nuova era: la legislazione assegna una nuova responsabilità

“L'errore umano può accadere, e la vittima di un deepfake non dovrebbe essere citata in giudizio”.”

Queste sono le parole della nuova legge, come evidenziato dalle recenti notizie sulla legislazione deepfake, che ora puntano i riflettori sull'inganno, non sull'ingannato.

Immagino che sia l'infrastruttura a farne le spese.

Quindi, se la vostra impresa è ancora indifesa, è il momento di prendere le giuste precauzioni, perché affrontare un giudice che non crede agli “ops” sarà sicuramente difficile.

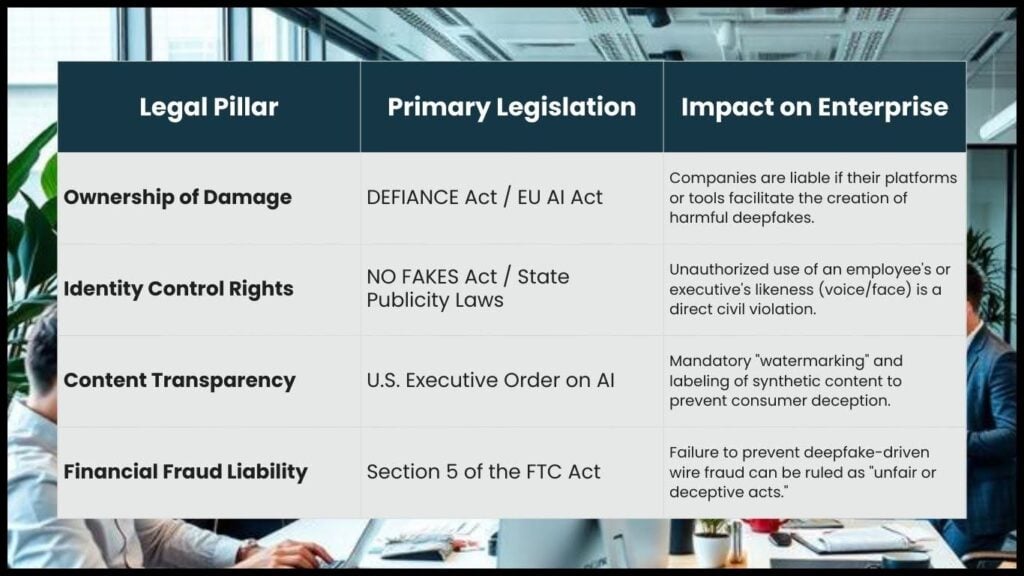

Tre aree critiche di esposizione legale:

Le imprese sono ora esposte a tre linee di difesa legali fondamentali.

1- Proprietà del danno

Il Atto di sfida e la legislazione emergente sui deepfake ritiene chiaramente che le aziende siano responsabili dell'impatto a valle della loro tecnologia. Se, ad esempio, la vostra piattaforma consente la creazione di un deepfake dannoso, la responsabilità ricadrà su di voi.

2- Diritti di controllo dell'identità

Molti Stati Uniti d'America stanno ridefinendo chi possiede l'immagine di una persona. L'identità è senza dubbio un bene protetto legalmente, ma nell'era dell'intelligenza artificiale e dei media sintetici, l'uso improprio non è più un'area grigia, ma un'area di rischio. violazione diretta della legge.

Pertanto, se un'impresa non rispetta i diritti di identità, la responsabilità ricadrà interamente sull'azienda.

3-Protezione legale per parole e opere

Se qualcuno viola i diritti di marchio e utilizza materiale protetto da copyright senza averne la licenza, considerate l'ipotesi di applicare sanzioni civili laddove fa più male: i vostri profitti.

Sfide e requisiti di conformità

C'è una linea sottile tra ciò che è reale e ciò che sembra solo reale.

La conformità esiste per evitare che questa linea scompaia, soprattutto con le notizie sulla legislazione deepfake che evidenziano quanto rapidamente l'IA possa eludere le regole.

Ma quando questa linea si confonde, la frode assume un volto amichevole. Per essere all'avanguardia, proteggere il patrimonio e cogliere le bugie più sottili, la vigilanza deve essere un requisito fondamentale.

Ma perché la conformità ci guarda cadere? Perché l'IA è in grado di far girare le bugie in modo così fluido da farle sembrare più reali della verità stessa.

Sfida 1: Falso “Ciao”.”

Non ci facciamo ingannare solo da sistemi avanzati di intelligenza artificiale e dal codice; ci facciamo ingannare dalle buone maniere.

È abbastanza chiaro che le bugie dell'IA si vestono del sorriso che si riconosce, quindi i dipendenti di solito lasciano che il riconoscimento prevalga sulla ragione.

Da un saluto amichevole in un'e-mail a un promemoria che sembra la solita nota di lavoro, nessuno può rimproverare al personale di aver abbassato la guardia.

Perché l'intelligenza artificiale è in grado di trasformare un amichevole “Ciao” in una rapina ad alta tecnologia senza mai destare sospetti.

Sfida 2: ritardo normativo (vecchie leggi, nuova guerra)

L'intelligenza artificiale si evolve più rapidamente delle regole che lo controllano.

Le leggi esistenti verificano sicuramente i documenti d'identità e i login in modo efficiente, ma i modelli persuasivi? Mancano l'intuizione e la trazione digitale.

I quadri di conformità e persino la legislazione in materia di deepfake non riescono a tenere il passo con la velocità dell'inganno, e questo è un rischio enorme per le organizzazioni di tutto il mondo.

Poiché le imprese sono ritenute responsabili dei rischi, la legge è in ritardo rispetto all'evoluzione dell'IA.

Sfida 3: sovraccarico del giudizio umano

Per quanto allenate, le persone non possono mantenere la perfezione 24 ore su 24, 7 giorni su 7, in un cervello da 9 a 5.

Sicuramente il personale esamina le e-mail, ma se il volume aumenta, la stanchezza fa crescere i piccoli errori.

Quindi, se le aziende continuano a fare affidamento sulla vigilanza umana, anche una sola e-mail trascurata diventerà una porta d'accesso per qualcosa di letale, come ad esempio:

- Rovina della reputazione

- Mal di testa legale

- Responsabilità ingente

Requisito 1: Protocollo di sicurezza a più livelli

La convalida umana e automatizzata deve passare attraverso l'intero spettro di salvaguardie.

La convalida ordinaria di solito include semplici controlli di forma e riferimenti incrociati di base, motivo per cui rimangono delle lacune che possono compromettere la sicurezza.

D'altra parte, la sicurezza avanzata a più livelli richiede ispezioni in più fasi per ogni azione.

Ad esempio, quando viene effettuato un bonifico bancario importante, ogni fase prevede una verifica biometrica, automatizzata e umana prima del completamento.

In questo modo, nulla passa inosservato.

Requisito 2: orologio cognitivo

Chi ha detto che solo gli occhi umani possono individuare i segnali falsi? Il modo migliore per individuare i volti sintetici è lasciare che un'intelligenza artificiale più acuta analizzi ogni segnale.

È qui che il sistema TruthScan Rilevatore AI in tempo reale è l'ultimo guardiano della compliance contro ogni inganno dell'IA.

Poiché la vera compliance non è episodica, il rilevatore AI in tempo reale di TruthScan funziona 24 ore su 24, 7 giorni su 7, assicurandosi che la frode non prenda mai piede.

Esegue la scansione di e-mail, documenti e piattaforme di chat per svelare trucchi sintetici e smascherare istantaneamente le identità false.

Requisito 3: Osservatore comportamentale

Le domande dovrebbero essere la norma.

Quando il dubbio diventa un'abitudine protettiva, le imprese sono due passi avanti rispetto all'inganno.

Ad esempio, quando un dirigente di alto livello invia una richiesta urgente e fuori dagli schemi per un trasferimento di fondi, un momento di dubbio può far risparmiare milioni.

Migliori pratiche per la preparazione delle imprese

La preparazione è tutto, soprattutto con la legislazione deepfake che rende inevitabile la responsabilità.

La migliore difesa è un team che si allerta costantemente. In un'epoca di rapida trasformazione digitale e di continue minacce informatiche, solo chi è vigile può proteggere le risorse e neutralizzare le minacce.

La difesa dovrebbe essere inattaccabile. Nel 2024, il costo della compiacenza ha raggiunto livelli record. Il $4,88 milioni La perdita mostra il costo reale della negligenza digitale.

Quindi, essere “preparati” dovrebbe significare non avere nessun anello debole in vista, ogni persona addestrata e ogni sistema testato per evitare guasti.

1- Audit e valutazioni del rischio regolari

Se è inesplorato, è incustodito.

Le imprese devono mappare i rischi e colmare ogni lacuna prima che diventi un titolo di giornale. I settori ad alto rischio, come quello finanziario e sanitario, richiedono verifiche almeno trimestrali, perché il rischio non conosce pause.

Questi audit aiuteranno a identificare ogni vulnerabilità nascosta.

Ovunque le vostre difese siano carenti, quantificate quanto siete lontani dagli standard ISO e NIST.

Non limitatevi all'audit, ma concentratevi sugli schemi e studiate le tendenze che mostrano esattamente dove il vostro sistema è più fragile.

Eseguire “Esercizi da tavolo” in cui la leadership simula multe e controlli pubblici.

2- Sviluppo di un piano di risposta alle crisi

Un piano che non viene messo in pratica è solo carta.

Un vero piano di risposta alle crisi (CRP) è una tabella di marcia che trasforma l'incertezza in azioni coordinate. È come una difesa passo dopo passo contro le interruzioni.

È necessario definire chi fa cosa e quando appare il primo segnale di difficoltà.

Stabilire chiaramente la struttura del Crisis Management Team (CMT).

Creare modelli pronti all'uso per ogni scenario di comunicazione. Ad esempio, La risposta di Airbnb durante la crisi dei viaggi COVID-19 ha trasformato una situazione di stallo globale in un vantaggio strategico.

Utilizzando ‘Newsroom’ e centri di risorse prestabiliti, hanno garantito che ogni messaggio fosse tempestivo e autentico. In questo modo, gli stakeholder sono rimasti tranquilli anche quando il mondo è cambiato.

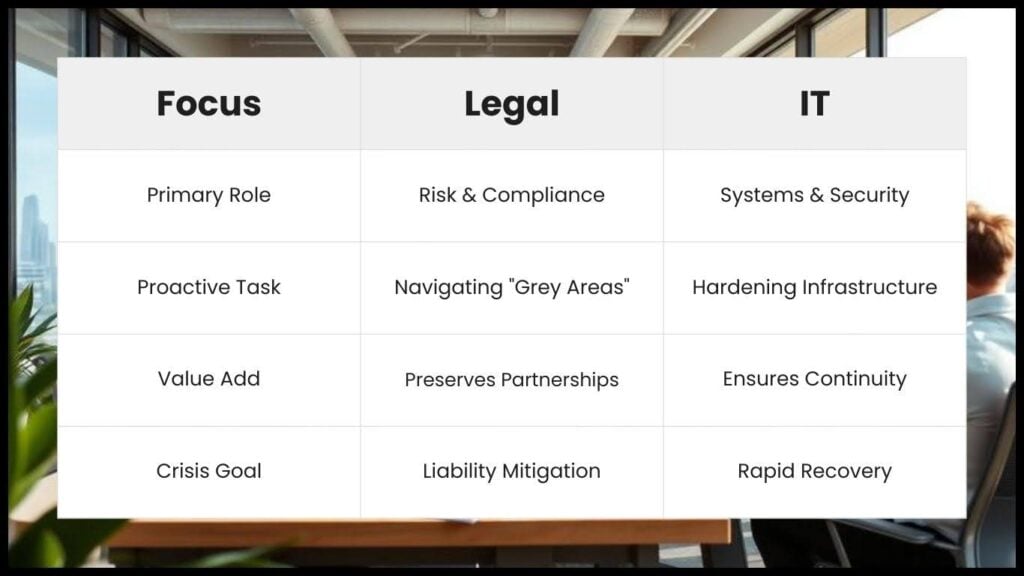

3- Collaborare in modo proattivo con i team legali e informatici.

Isolare i reparti non fa altro che danneggiare l'azienda.

L'ufficio legale e l'IT sono inseparabili. In caso di crisi, entrambi questi dipartimenti dovrebbero muoversi come un'unica entità, completamente allineata per affrontare i rischi segnalati dalla legislazione deepfake.

Il legale come cervello aziendale

I team legali devono essere coinvolti in ogni decisione, in modo che la vostra azienda non impari mai la lezione.

Gli esperti di diritto mostrano alla vostra leadership dove ogni zona d'ombra legale potrebbe costare i rapporti con i clienti e i partner.

L'IT come spina dorsale

L'IT è più di un semplice “supporto tecnico”, è il custode della continuità operativa. Più scansionano, meno frodi trovano spazio.

La collaborazione proattiva rende partner la conformità e l'efficienza, il che significa che nessun attacco digitale interrompe le operazioni.

Prevenire è meglio che....Curare

Il tempo conferma il detto.

Il costo della prevenzione di una crisi è una frazione di quello necessario per ripulire le conseguenze. Il prezzo del recupero è sempre molto più alto e superiore a qualsiasi budget.

1- Difesa attiva

Le vulnerabilità devono essere affrontate prima che il danno si aggravi. Che si tratti della catena di approvvigionamento, della sicurezza informatica o dell'integrità dei dati, la strategia più intelligente è quella di risolvere i problemi prima che si verifichino.

2- Finanziamento e allocazione delle forze

Le organizzazioni lungimiranti danno priorità alla protezione piuttosto che pagare di più per risolvere crisi che la preparazione potrebbe fermare.

Ad esempio, Maersk, il gigante mondiale del trasporto marittimo, ha subito una $300 milioni di perdita nel 2017 a causa di una singola violazione del sistema.

In seguito, l'azienda ha speso milioni per reinstallare migliaia di macchine, tra cui 4.000 server e 45.000 PC, in soli dieci giorni, per evitare di far sprofondare la propria catena di fornitura nel caos.

Pensieri finali

La preparazione delle aziende è l'unico modo per essere due passi avanti rispetto al prossimo inganno alimentato dall'intelligenza artificiale.

Mentre la tecnologia deepfake confonde ciò che è reale e ciò che è falso, solo chi è preparato sopravvive. Aderire alla legislazione sui deepfake, come l'AI Act dell'UE o l'ordine esecutivo degli Stati Uniti sull'AI, non è solo una formalità, ma una difesa contro la manipolazione.

Integrando un sistema di controllo credibile strumenti di rilevamento dell'intelligenza artificiale in tempo reale, rilevatori video, e la formazione continua dei dipendenti, trasformate la cautela nel vostro scudo definitivo contro l'inganno.