I vostri agenti di supporto sono addestrati per essere le persone più utili della vostra azienda.

Sono la prima linea della reputazione del vostro marchio e lavorano duramente per assicurarsi che ogni interazione finisca con un sorriso.

Ma conoscete l'ironia più pericolosa del 2026?

Proprio questa disponibilità li rende il più grande ostacolo per la sicurezza.

I vostri agenti si concentrano sulla soddisfazione del cliente.

Non sempre notano un leggero tono robotico nella voce di un chiamante o una piccola sfocatura intorno alla mascella di un cliente durante una videochiamata.

In questo modo le frodi ai danni dei clienti trovano la finestra perfetta per colpire.

Se il vostro servizio di assistenza non è supportato da un sistema di rilevamento automatico delle frodi, potreste essere già esposti.

In questo blog tratteremo di cosa sia l'impersonificazione deepfake, delle tecniche utilizzate dagli aggressori per aggirare le vostre difese, degli indicatori precoci che possono segnalare al vostro team e di come sfruttare un rilevatore AI in tempo reale per proteggere la vostra azienda.

Immergiamoci.

Punti di forza

- Gli agenti di assistenza sono addestrati per essere utili, il che li rende i principali bersagli per l'aggiramento del rilevamento dell'impersonificazione dell'IA.

- I moderni truffatori utilizzano un rilevatore AI in tempo reale per identificare i cloni vocali che si sincronizzano in meno di 50 millisecondi.

- Il rilevamento automatico delle frodi deve ora comprendere registrazioni di schermate manipolate, ricevute false e ID generati dall'intelligenza artificiale.

- Una prevenzione efficace dei deepfake richiede la scansione simultanea di audio, video e immagini.

- L'integrazione di un rilevatore di deepfake nei flussi di lavoro di e-discovery e di supporto riduce le perdite finanziarie dovute a BEC (Business Email Compromise) fino a 80%.

Cosa sono le imitazioni di Deepfake?

La parola “deepfake” deriva da apprendimento profondo (un tipo di IA) e falso.

Impersonare significa fingere di essere qualcun altro, di solito per ottenere fiducia, rubare denaro o accedere a informazioni private.

Le impersonificazioni di deepfake avvengono quando l'intelligenza artificiale copia il volto, la voce o il comportamento di una persona reale per creare contenuti falsi destinati a ingannare gli altri.

Non preoccupatevi più delle frodi dell'IA. TruthScan Può aiutarvi:

- Rilevare l'IA generata immagini, testo, voce e video.

- Evitare frodi di grande portata guidate dall'intelligenza artificiale.

- Proteggete i vostri prodotti più sensibile beni dell'impresa.

I deepfake non si limitano più a semplici scambi di volti. Nel 2026 vedremo deepfakes comportamentali in grado di copiare:

- Modelli di discorso

- Tono e pause

- Microespressioni facciali

- Anche le sfumature della personalità

Questo rende molto più difficile individuare la manipolazione a occhio nudo.

Esempio del mondo reale: Imitazione del CEO di WPP (maggio 2024)

I criminali informatici hanno utilizzato una foto pubblicamente disponibile del CEO di WPP Mark Read per creare un falso account WhatsApp.

Hanno attirato un dirigente in una riunione di Microsoft Teams, utilizzando un rilevatore di intelligenza artificiale in tempo reale per autorizzare un bonifico fraudolento.

Fortunatamente, un dipendente attento si è insospettito e ha segnalato l'incidente, evitando così una perdita finanziaria.

Perché l'assistenza clienti è vulnerabile

Il rischio di frodi ai danni dei clienti ha iniziato ad aumentare nel 2023-24, quando gli strumenti di IA generativa sono diventati ampiamente disponibili.

Ma nel 2025-26 la minaccia ha raggiunto una scala industriale.

Ciò che un tempo richiedeva competenze tecniche, oggi può essere fatto con semplici strumenti e pochi minuti di audio.

I team di assistenza clienti non sono diventati improvvisamente negligenti. Si sono esposti.

Gli agenti di assistenza sono addestrati ad aiutare le persone, non a fare domande, ed è per questo che la prevenzione dei deepfake è così difficile da gestire manualmente. Gli aggressori si affidano all'istinto di fiducia dell'agente e si muovono velocemente.

La maggior parte dei contact center verifica ancora l'identità con semplici domandenumeri di conto corrente, date di nascita, ultime quattro cifre di un documento di identità. Il problema è che queste informazioni non sono più private.

Le violazioni dei dati e i social media consentono di eludere facilmente i controlli tradizionali, rendendo il rilevamento delle impersonificazioni da parte dell'IA un livello di difesa obbligatorio.

C'è anche la pressione del volume. Molti agenti gestiscono da 80 a 120 interazioni al giorno. Quando le chiamate si susseguono, non c'è tempo per analizzare i sottili cambiamenti della voce.

È qui che il rilevamento automatico delle frodi diventa un salvavita. Senza un rilevatore AI in tempo reale che lavora in background, gli agenti sono costretti a rispondere all'urgenza e all'emozione.

Tecniche utilizzate dagli imitatori di Deepfake

- Clonazione vocale nelle chiamate

Entro il 2026, strumenti come ElevenLabs, Speechify e Murf potranno creare cloni convincenti da meno di 10 secondi di audio.

Ancora più preoccupante è la conversione vocale in tempo reale, che può trasformare la voce di un chiamante in quella di un altro in meno di 50 millisecondi.

Per la vittima, il suono è vivo, naturale e familiare.

Raramente c'è un indizio robotico evidente. Senza un software di protezione dalle frodi di supporto, gli agenti non riescono a cogliere gli artefatti più sottili, come le sfumature metalliche o i modelli di respirazione innaturali, che indicano una frode da parte del cliente.

Esempio:

- Wiz (fine 2024): Gli aggressori hanno clonato la voce dell'amministratore delegato Assaf Rappaport per richiedere le credenziali. Sebbene questo tentativo sia fallito a causa di una mancata corrispondenza dei toni, ha evidenziato l'urgente necessità di rilevare l'impersonificazione dell'intelligenza artificiale nelle comunicazioni aziendali.

- LastPass (inizio 2024): Un dipendente è stato preso di mira da un deepfake della voce dell'amministratore delegato addestrato sui video di YouTube. Questo incidente ha dimostrato che le persone di alto profilo sono costantemente a rischio e richiedono un rilevamento automatico delle frodi per salvaguardare i canali di assistenza interni.

- Video di agenti che si scambiano il volto

I face-swap deepfakes utilizzano modelli avanzati di intelligenza artificiale per sostituire il volto di una persona con un'altra in un video dal vivo.

Entro il 2026, strumenti come DeepFaceLive e Deep-Live-Cam potranno funzionare in tempo reale con un ritardo inferiore a 50 millisecondi.

I truffatori possono trasmettere questi video alterati attraverso piattaforme come Zoom, Microsoft Teams o Google Meet utilizzando strumenti di videocamera virtuale come OBS Studio. All'interlocutore sembra tutto normale.

Esempio:

KnowBe4 Caso di falso dipendente (luglio 2024): Un attore di Stato nordcoreano ha usato la tecnologia AI face-swap per passare interviste video in diretta con un'identità statunitense rubata. È stato catturato solo dopo che la sicurezza interna ha segnalato un'attività insolita del dispositivo.

- Registrazioni dello schermo manipolate

Gli aggressori utilizzano sempre più spesso l'intelligenza artificiale per fabbricare o alterare le registrazioni delle schermate, facendo credere che sia avvenuto un rimborso, una transazione o un'azione di assistenza.

Queste registrazioni false possono manipolare gli agenti dell'assistenza, annullare le controversie o aumentare i chargeback.

L'intelligenza artificiale è ora in grado di modificare i timestamp, i saldi dei conti e gli elementi dinamici dell'interfaccia utente in modo così convincente che un'ispezione occasionale non lo noterà.

I truffatori possono persino inserire video preregistrati o manipolati nelle chiamate di assistenza dal vivo tramite plugin di telecamere virtuali.

Indicatori precoci di minacce Deepfake

I deepfake moderni sono convincenti. Una prevenzione efficace dei deepfake consiste nel cercare questi “indizi”:

Racconti a livello audio:

- Le voci clonate hanno un suono piatto e mancano di variazioni naturali dell'intonazione.

- Nel parlato dell'IA spesso mancano i normali suoni di respirazione e di riempimento.

- La voce potrebbe non corrispondere al rumore di fondo.

- La conversione vocale in tempo reale può causare piccoli ritardi (200-400 ms) su domande improvvise.

- Le voci provenienti da registrazioni di discorsi pubblici possono sembrare troppo formali per una conversazione informale.

Racconti a livello video:

- I capelli, le orecchie e i bordi della mascella possono apparire leggermente sfocati.

- Il lampeggiamento avviene a intervalli molto regolari.

- Lo sguardo potrebbe non seguire naturalmente la telecamera.

- L'illuminazione del viso potrebbe non corrispondere a quella della stanza.

- Le microespressioni sono assenti o molto attenuate.

- Le scarse scuse di connessione possono nascondere gli artefatti video causati dalla compressione.

Informazioni comportamentali / a livello di interazione:

- Gli operatori Deepfake evitano richieste di verifica inaspettate.

- Potrebbero contattarvi prima su app informali prima di utilizzare i canali ufficiali.

- Urgenza e segretezza insieme sono un segnale di allarme.

- Resistono ai controlli fuori banda, come la chiamata a un numero noto.

Sfruttare gli strumenti di rilevamento dell'intelligenza artificiale

TruthScan è una potente piattaforma progettata per il rilevamento automatico delle frodi, di cui si fidano oltre 250 milioni di utenti.

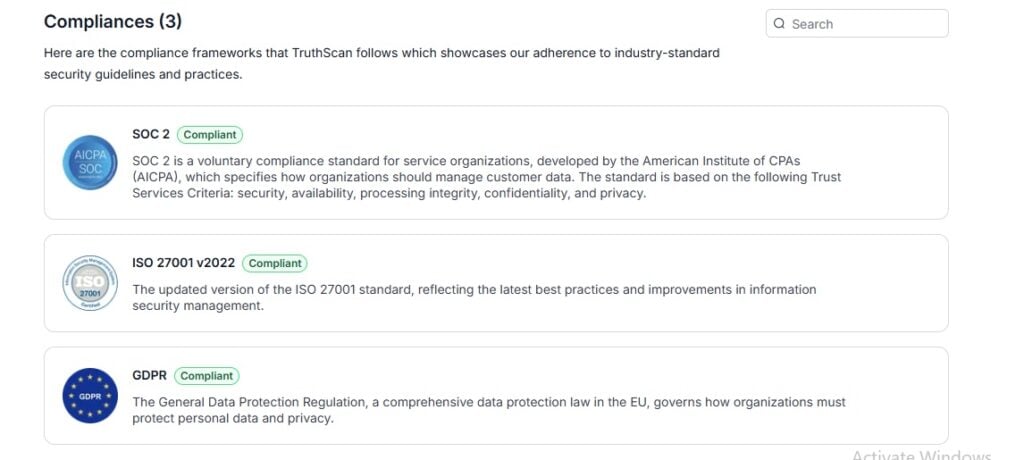

È completamente certificato ISO 27001, SOC 2 e conforme al GDPR e funziona perfettamente con strumenti come Salesforce, Microsoft 365, Google Workspace, SAP e Zoom.

- Rilevatore di deepfake

Questo rilevatore di deepfake identifica video generati dall'intelligenza artificiale, scambi di volti e media manipolati in tutti i principali formati (MP4, AVI, MOV, MKV, WebM) fino a 4K.

Ecco come funziona:

- Traccia i movimenti del viso, i modelli di battito delle palpebre e le microespressioni.

- Individua le incongruenze a livello di pixel, gli errori di illuminazione e gli artefatti da fotogramma a fotogramma.

- Rileva i modelli di generazione basati su GAN come AnimateDiff, D-ID, HeyGen, Runway Gen-4, Stable Video Diffusion e altri ancora.

Caricare un video reale noto e un deepfake (HeyGen/D-ID) sul sito di TruthScan Rilevatore di deepfake.

- Rilevatore di immagini AI

Il rilevatore di immagini TruthScan AI bandiere Immagini generate o manipolate dall'intelligenza artificiale da piattaforme come Midjourney, DALL-E, Stable Diffusion, Canva AI, Grok Imagine, StyleGAN e ThisPersonDoesNotExist.

Ecco come funziona:

- Scambia lo sfondo, rimuove gli oggetti e modifica l'illuminazione.

- Genera punteggi di confidenza e approfondimenti a livello di pixel senza memorizzare file.

Caricare le immagini reali rispetto a quelle generate dall'IA su TruthScan Rilevatore di immagini AI per confrontare i punteggi di confidenza.

Proteggere i canali di supporto in modo efficace

Nel 2026, i team di assistenza clienti sono costantemente minacciati dalle frodi guidate dall'intelligenza artificiale.

Gli aggressori possono fingere le voci, scambiare i volti nei video in diretta o inviare file manipolati, rendendo quasi impossibile per gli agenti umani capire cosa sia reale e cosa no.

Per questo motivo è essenziale garantire i canali di supporto.

- Rilevatore AI in tempo reale

L'AI Detector in tempo reale è progettato per catturare i contenuti generati dall'AI prima che raggiungano i vostri agenti o clienti.

A differenza degli strumenti basati su file che analizzano i caricamenti, questa piattaforma monitora le interazioni dal vivo attraverso i canali e-mail, chat, telefono e video.

Come aiuta il vostro team:

- Rileva i tentativi di rilevamento di impersonificazione dell'IA in tempo reale.

- Segnalare i messaggi o le chiamate generate dall'intelligenza artificiale che tentano di ingannare gli agenti per consentire l'accesso o l'elaborazione delle richieste.

- Funziona con Salesforce, Teams, Gmail, Zoom e altro ancora per fornire un rilevamento automatico delle frodi senza rallentare le operazioni.

- Gestisce milioni di interazioni su tutti i canali senza rallentare le operazioni.

- Le certificazioni SOC 2, ISO 27001 e GDPR fanno sì che ogni azione sia verificabile e pronta per il tribunale.

Politiche e formazione per i team

- Procedure operative standard

| Nome della politica | Politica |

| Verifica a più fattori | Richiedete l'MFA per il ripristino dell'account, le transazioni di alto valore e le modifiche alla sicurezza. |

| Verifica del canale | Reindirizzare tutte le richieste provenienti da canali informali (WhatsApp, Telegram, e-mail personali) ai sistemi di supporto ufficiali. |

| Registrazione dei contatti | Gli agenti devono registrare i contatti insoliti includendo il canale, l'ora e la natura della richiesta. |

| Sistema Safe Word | Utilizzate frasi di verifica preregistrate per i conti di alto valore. |

| Verifica fuori banda | Qualsiasi richiesta di escalation interna o esecutiva deve essere verificata tramite chiamata ai numeri ufficiali dell'elenco. |

| Nessuna approvazione in solitaria | Non autorizzate mai transazioni o modifiche alla sicurezza basandovi esclusivamente su videochiamate o e-mail. |

| Conferma vocale | Richiedere una conferma vocale per tutti i trasferimenti di fondi al di sopra di una soglia definita. |

| Verifica dei media | Eseguite la scansione di tutte le foto, i video e le registrazioni dello schermo attraverso i rilevatori TruthScan prima della revisione umana. |

| Controlli dei metadati | Utilizzare un rilevatore di immagini AI per segnalare EXIF o timestamp incoerenti. |

| Recensione secondaria | Le richieste di risarcimento di valore elevato devono essere sottoposte a una revisione secondaria prima di essere elaborate. |

- Formazione del personale sulla consapevolezza delle frodi

I dipendenti devono sperimentare deepfakes realistici. Le ricerche dimostrano che i tassi di rilevamento passano da 34% a 74% dopo una dozzina di simulazioni dal vivo con un rilevatore video AI.

Bandiere rosse da tenere d'occhio:

- Urgenza e segretezza

- Richieste al di fuori dei normali canali

- Resistenza al richiamo o alla verifica secondaria

- Bypassare i processi standard

- Pressione emotiva (paura, senso di colpa, autorità)

- Revisioni di routine della sicurezza

Nel 2026, anche le migliori SOP richiederanno un controllo regolare attraverso protocolli di rilevamento automatico delle frodi:

| Nome della politica | Politica |

| Valutazione trimestrale delle minacce | Verificare la presenza di nuovi strumenti di deepfake, convalidare le soglie di rilevamento ed esaminare gli incidenti sfiorati. |

| Audit sulla sicurezza del canale | Verificate ogni canale di supporto per individuare i punti deboli; gli aggressori mirano al percorso di minor resistenza. |

| Convalida dello strumento di rilevamento | Eseguire periodicamente i falsi noti con TruthScan per garantire che l'accuratezza del rilevamento sia al passo con l'evoluzione dei metodi di IA. |

| Esercitazioni di risposta agli incidenti | Condurre esercitazioni tabletop simulando impersonificazioni di deepfake per testare notifiche, blocchi e velocità di risposta. |

| Controlli di fornitori e terze parti | Verificare che le comunicazioni esterne di partner o clienti seguano gli stessi standard di autenticazione forte dei canali interni. |

Come TruthScan rafforza la sicurezza dell'assistenza clienti

TruthScan è stato creato per bloccare le frodi AI a tutti i livelli dell'assistenza clienti. Spiega perché qualcosa è sospetto, in modo che i team possano agire con fiducia.

| Strumento | Scopo e benefici |

| Rilevatore vocale AI | Individua le voci clonate nelle chiamate e nelle registrazioni, proteggendo le conversazioni dal vivo dall'impersonificazione. |

| Rilevatore di deepfake | Analizza video e immagini per individuare scambi di volti, personaggi sintetici e media manipolati. |

| Rilevatore di immagini AI | Segnala le foto profilo generate dall'intelligenza artificiale, gli ID falsi e le schermate manipolate prima che venga presa una decisione. |

| Rilevatore AI in tempo reale | Monitoraggio continuo di chat, e-mail e video con avvisi automatici di rilevamento delle frodi al secondo. |

| Rilevatore di ricevute false | Rileva le ricevute o i documenti di prova generati dall'IA e utilizzati per le richieste di risarcimento fraudolente. |

| Rilevatore di truffe via e-mail | Cattura i tentativi di phishing e gli attacchi BEC generati dall'intelligenza artificiale prima che raggiungano la casella di posta. |

Come si adatta allo stack di sicurezza dell'assistenza clienti:

- Media in entrata (foto, video, registrazioni) → Deepfake Detector + AI Image Detector prima della revisione umana

- Chiamate di assistenza dal vivo → Rilevatore vocale AI che analizza le registrazioni delle chiamate o i flussi in diretta

- Sessioni di supporto video → Deepfake Detector in tempo reale o dopo la chiamata

- Canali e-mail e chat → Rivelatore AI in tempo reale per il monitoraggio continuo

- Invio di documenti (documenti d'identità, ricevute, screenshot) → Rilevatore di ricevute false + Rilevatore di immagini AI

Parlate con TruthScan della protezione Deepfake in assistenza

Non aspettate che sia troppo tardi. TruthScan aiuta il vostro team a rilevare i contenuti AI prima che raggiungano i vostri agenti.

Scegliete come iniziare:

- Prova tu stesso: Provate tutti gli strumenti di rilevamento di TruthScan con 20.000 crediti gratuiti. Non è richiesto alcun pagamento. → Inizia la tua prova gratuita su TruthScan.

- Demo aziendale: Lasciate che il nostro team vi mostri una distribuzione su misura per Salesforce, Microsoft 365, Zoom e Google Workspace. → Prenotate una demo a TruthScan.

Assicuratevi oggi stesso i canali di supporto, perché vedere non significa più credere, ma verificare.